基于时空熵分析的组合高斯背景建模方法*

宋佳声 胡国清

(华南理工大学机械与汽车工程学院,广东广州510640)

从复杂的监控场景中提取出运动的前景目标是智能监控系统的首要问题.如果有一个自适应场景变化的背景模型,就可以通过背景减法分割出前景目标.高斯分布函数常被用来对场景背景进行建模.文献[1]中用单个高斯模型(SGM)对场景进行建模,适用于室内单纯的场景中.文献[2]中提出的混合高斯模型(GMM),虽然提高了前景分割的准确性,但模态数固定以及学习因子统一使其存在收敛与更新速度慢、对背景变化的适应能力与对前景异常的感知能力无法兼顾的问题[3].为此,文献[4]中将混合高斯模型的更新区分为背景学习和背景更新两个阶段,在不同的阶段采用不同的参数估计算法;文献[5]中通过对匹配数据个数的统计自适应地实时调整学习因子和模态个数;文献[6]中通过引入惩罚因子提出了一种自适应最小化模态个数的混合高斯模型;为避免繁琐的高斯模型参数估计问题,文献[7]中提出了一种固定窗口长度的非参数方法,但大量的数据存储要求以及复杂的计算限制了其应用;近年来人们提出了许多改进的算法[8];文献[9]中利用球面均值聚类算法找到光照改变时的颜色空间特征,据此为混合高斯模型参数更新提供了准确方向;文献[10]中提出了两种不同的学习因子,分别用于均值和方差的实时更新;文献[11]中将场景划分为背景、阴影、静态前景和移动前景4种区域,每个区域使用不同的模态学习因子,从而形成对混合高斯模型更新的反馈机制;文献[12]中提出了一种基于颜色、边缘和纹理的混合视觉特征的高斯建模方法;文献[13]中将偏差均值作为判断模型是否与当前像素值匹配的阈值参数;文献[14]中在混合高斯模型的框架下,通过改变计算策略来提高参数的更新速度,改善了GMM的实时性;文献[15]中通过统计模态匹配个数和引入惩罚因子来优化GMM的模态个数以及相应参数的更新速度.

为提高视频监控系统中背景高斯模型的更新速度,文中提出了基于时空熵分析的组合高斯背景建模方法(CGM),即对场景的不同区域使用不同的模型和更新机制.根据检测的全局特征的变化来实现不同模型之间的切换.文中通过时空采样模型获取像素颜色值在时域和空域的变化特征,进而检测出边缘或轮廓线所对应的像素区域.最后通过实验验证所提建模方法的有效性.

1 场景运动复杂性分析

1.1 场景运动复杂度的时空信息熵表示

场景中的像素是复杂多变的,其原因有自然景物的扰动、传感器的振颤、投影和光照的改变、颜色的二义性、前景运动的不确定性和遮挡等.这里的“复杂”是指本体论意义上的复杂性[16],体现为场景图像空间中像素的多样性和差异性,文中具体指像素颜色值在时域和空域变化的剧烈程度.场景运动复杂度是对像素变化剧烈程度的一种定量描述.文献[17]中从组合论的角度给出了复杂度的定义:一个系统(广义集合)的复杂度反映的是该集合内元素的种类以及各类中包含的元素个数等特征,体现为集合内部状态的丰富程度和差异程度,这种内部复杂度的计算公式为

式中,K为广义集合内不同标志值的个数,nk为第k类个体的数量,N为总个体数.据此可知,系统的复杂度是与其内部个体特征差异性相关联的,它是对个体特征差异性和多样性的一种度量:个体差异越大,总体复杂度越大;个体差异越小,总体复杂度越小.

图1 计算场景复杂度的采样空间Fig.1 Sampling space for calculating of scene complexity

监控系统得到的场景图像序列除了存在空间分布的差异性外,还有时间轴上分布的差异性.因此,文中建立图1所示的采样空间:时间滑窗长为L,空间窗长为W,则采样空间的总样本数为Np=W2L.根据式(1),将每个像素领域内的时空灰度分布的差异程度作为该像素的运动复杂度,称为像素熵值.为简化计算,将像素p按图1所示的采样空间中的样本多通道颜色值转化为单通道灰度值f(p),并对该灰度值按照式(2)进行压缩,其中Lg为压缩后的最大灰度,fmax为样本空间的最大采样值.压缩后的灰度级将大大减少,既保留了差异性,又减小了后续信息熵的计算.

统计各个灰度级g(g为0~Lg的整数)的采样值个数,将像素p的采样空间中灰度为g的像素个数记为np,g,根据式(1)可知该像素点的熵值为

1.2 基于时空熵的场景区域分割

在大多数监控场合,每个摄像头所监控的区域是固定的,区域中背景的颜色值也是相对稳定的.但在一些特殊的情况(如摄像头朝向的调整、光线的突然变化、背景某些区域永久性的移入/移出等)下,监控区域也会产生突然的、大范围的变化.此时,场景的运动复杂度可能发生很大的变化,必须根据新的场景更新相应的运动复杂度.如果没有及时更新场景的复杂度,将造成基于该场景复杂度的背景模型的偏差,进而导致大量前景目标的误检.为此,文中通过设定一个前景区域大小的阈值FT来检测这种变化.如果前景区域面积大于该阈值,则重新计算场景运动复杂度,并据此调整背景模型,具体流程见图2.

图2 基于场景复杂性的前景检测流程图Fig.2 Flowchart of foreground detection based on scene complexity

场景复杂性分析的目的是为背景建模提供先验知识,即掩码图.如图2所示,根据式(3)计算各个像素在各自采样空间中的运动复杂度,得到熵值E(p).然后,将所有像素的熵值转化为256个灰阶单通道图像,构成一幅熵值图.灰阶所描述的是像素的运动复杂度,其值越大则时域或空域变化越剧烈.为简化计算,将这些像素分成2类,分别代表图像的2类不同区域.为了保证分割后这2类区域的差异性,采用最大熵阈值分割的方法进行分割,得到一个二值化图像模板,即掩码图.对图3(a)所示的视频图像进行复杂度分析和最大熵阈值分割,结果如图3(b)、3(c)所示.将图像空间分为2类区域:(1)灰度值为0的黑色区域,对应于原场景中颜色值相对均匀、稳定的区域,文中称为稳定区域;(2)灰度值为255的白色区域,对应于原图像中颜色值富于变化的区域,多为边界或颜色值存在反复波动的区域,称为动态区域.在监控系统中,一般黑色区域占较大面积,如图3中稳定区域的像素占总像素的84.32%.

图3 场景复杂度分析过程图Fig.3 Procedure images of analysis on scene complexity

2 基于掩码的背景组合高斯模型

2.1 场景的背景建模

根据场景复杂性分析输出的掩码图,对处于稳定区域的像素采用单模态的高斯模型,对处于动态区域的像素采用多模态的高斯模型.在动态区域,每个像素的颜色值采用K个高斯模态建模,设第k个模态的均值为 μk,标准方差为 σk,先验概率为 ωk,参数集为 Θk={ωk,θk},其中 θk={μk,σk}.为避免复杂的矩阵求逆运算,假设像素颜色值的红色、绿色和蓝色分量相互独立,且具有相同的方差.像素颜色值的某个分量x的概率密度函数可表示为

设某像素有T个颜色值,对其中任意一个颜色值xt,先根据贝叶斯后验概率判定它属于哪个高斯模态,然后对含有该模态参数的似然函数求偏导,从而求得似然函数的最大值,由此得到如下估计量:

最后,将K个高斯分量按照ωk/σk从大到小的顺序排列,选取其中前B个高斯模态作为背景的一个建模,其中为小于1的预设正数.如果xt属于这B个模态,则xt为背景;否则xt为前景.

对处于稳定区域的像素,其颜色值x分布采用单高斯模态建模.具体过程如下:对任意一个采样值xt,根据它与模态中心的马氏距离判定它是否属于该模态,如果属于,则采用指数平滑学习进行模态参数估计,否则模态参数保持不变.

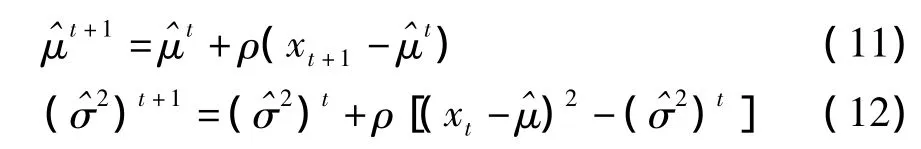

2.2 背景参数更新

对于采用背景减法得到前景目标的分割算法而言,背景维护是最为关键的问题.由于在图像的2类不同区域所采用的模态个数是不同的,因而相应的更新算法也不一样.在动态区域,根据背景模型参数的估计式可以得到

对于稳定区域,由于采用的是单模态,因而省去了模态匹配的过程,但需要判断颜色值与背景值的距离.根据正态分布的特征,取95%的置信区间为背景更新区间:如果颜色值处在背景值的约2个标准差之外,则不予采信,不做背景更新操作;如果颜色值处在置信区间内,则按式(11)、(12)进行背景更新,其中ρ为预设的学习因子.

2.3 模型切换

假设t时刻的掩码图为m.如果根据图2所示的流程检测到前景面积的变化大于预设阈值,则重新计算掩码图,记为m'.通过比较这两个掩码图可以知道场景中两类区域的变化情况,即像素点p(i,j)有如下2种情况:

(1)m(i,j)=0,m'(i,j)=255,像素背景模型由单模态变为多模态,将原模型中的单模态作为多模态模型中权值为1的模态.

(2)m(i,j)=255,m'(i,j)=0,像素背景模型由多模态变为单模态,选取多模态模型中权值最大者初始化单模态背景模型.

2.4 算法步骤

文中组合高斯背景建模算法主要包括2个步骤:(1)初始化模型.通过场景时空熵值的计算得到场景的运动复杂度图像,再通过最大熵阈值分割法得到像素分组的掩码图像(模板),按照该模板对稳定区域和动态区域分别进行高斯模态的初始化.(2)更新背景模型.采用背景减法分割运动目标,按照掩码图像对不同区域采用不同的更新策略.

根据L帧图像(总像素为M×N)初始化背景模型的伪代码如下:

根据图1定义的采样空间,对像素p进行灰度

采样,得到f(p);

根据式(2)对f(p)进行灰度压缩;

根据式(3)计算像素p的时空熵值E(p);

END FOR

根据最大熵阈值分割法将熵值图E划分为两类

区域,得到二值化图像模板m;

更新背景模型的伪代码如下:

3 算法评价

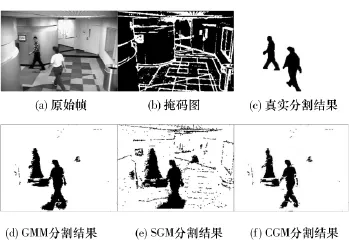

为验证文中模型(CGM)的分割效果,在联想ThinkPad-R60计算机上进行实验,并与SGM[1]和模态数固定(模态数为5)的GMM[2]进行比较.实验程序采用C语言编写.为客观地比较,实验程序中不含有形态学的滤波处理.选用PETS库中的视频进行了实验,结果如图4、5所示.

图4 视频PetsD2TeC1第950帧的分割结果Fig.4 Segmentation results of frame 950 in video PetsD2TeC1

图5 视频IndoorGTTest2第920帧的分割结果Fig.5 Segmentation results of frame 920 in video IndoorGTTest2

从图4可知:SGM存在明显的误检,将背景中各种实物的轮廓、摆动的树叶、直立的路灯柱及纹理与颜色的分界线误分割为前景,这些区域正是位于相应掩码图中白色显示的区域;GMM与GCM都采用了多模态建模区域,故能很好地解决误检问题.

从图5可知:SGM将场景中的轮廓、边缘及光照强度突变的区域误检为前景;GMM与CGM的检测结果大致相同且误检相对较少.

为进一步定量分析3种背景模型的分类效果,以像素为单位统计每帧中前景和背景的像素数,得到 4 个统计量 NTP、NFP、NFN和 NTN.其中,NTP表示真实前景区域中被检测为前景的像素数,NFP表示真实背景区域中被误检为前景的像素数,NFN表示真实前景区域中被误检为背景的像素数,NTN表示真实背景区域中被检测为背景的像素数.衡量当前帧分割效果的指标有检出率(RD)、误警率(RFA)、准确率(RA),计算式如下:

考虑到NTN相对于NTP而言是一个很大的值,因此RA的分子分母中均无NTN项.

实验统计第200帧以后的1000帧视频PetsD2TeC1的前景分割结果(检测阶段的更新公式中设定t=200),如图6所示,GMM与CGM的接受者操作特征比较接近,均远远高于SGM.对1000帧分割结果进行统计,得到GMM、CGM和SGM的平均准确率分别为 0.76、0.75、0.56,说明 CGM 前景分割的准确性接近于GMM,远优于SGM.

图6 3种背景模型的接受者操作特征曲线Fig.6 Receiver operating characteristic curves of three background models

模型运行时间主要包括模型初始化时间和模型更新时间.表1给出了3种模型处理视频PetsD2TeC1的运行时间,CGM消耗了较多的初始化时间,这主要是由场景分析中掩码图的计算量较大造成的.对于固定摄像头的监控系统,背景相对固定,初始化只发生在安装初期及前景面积变化大于规定阈值时,故CGM的初始化时间通常还是可以容忍的.CGM在初始化之后背景更新、前景分割的运算速度较快(接近于SGM),这有利于提高系统的实时性.

表1 3种背景模型的运行时间比较Table 1 Comparison of running time among three background models

综上所述,SGM存在明显的误检;GMM的分割效果最为理想,但较耗时;CGM虽然需要消耗较多的初始化时间,但背景更新用时较少,分割效果比较理想,表现出较好的实时性,即它在分割效果上接近于GMM,而运行时间上接近于SGM.

4 结语

在固定摄像头的监视系统中,其场景固定,视频背景稳定,文中针对此类应用提出了一种基于时空熵分析的组合高斯背景建模方法.首先分析场景的运动复杂性,建立像素颜色值的采样时空模型,并据此得到场景的运动复杂度;在随后的测量中,根据前景检测结果更新场景运动复杂度.然后利用最大熵阈值分割方法对场景图像的像素进行分类,将场景图像分为稳定区域和动态区域,形成差异性明显的掩码图像,再对不同区域采用不同的高斯模型及更新算法.实验结果表明,该模型能够保证分割效果,减少分割运算时间,提高系统的实时性,但模型的初始化耗时较长.文中使用较大的前景面积变化阈值以减少掩码图像更新的次数,这在大多数场合是适用的.像素颜色值的二义性、前景阴影的误检等问题有待进一步研究.

[1]Wren C,Azarbayejani A,Darrell T,et al.Pfinder:realtime tracking of the human body[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1997,19(7):780-785.

[2]Stauffer C,Grimson W E L.Adaptive background mixture models for real-time tracking[C]∥Proceedings of IEEE Computer Society Conference on Computer Vision and Pattern Recognition.Fort Collins:IEEE,1999:246-252.

[3]Power P Wayne,Schoonees Johann A.Understanding background mixture models for foreground segmentation[C]∥Proceedings Image and Vision Computing.New Zealand:University of Auckland,2002:267-271.

[4]KaewTraKulPong P,Bowden R.An improved adaptive background mixture model for real-time tracking with shadow detection[C]∥Proceedings of the 2nd European Workshop on Advanced Video Based Surveillance Systems.London:Kluwer Academic Publishers,2001:1-5.

[5]Lee D.Effective Gaussian mixture learning for video background subtraction [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2005,27(5):827-832.

[6]Zivkovic Z.Improved adaptive Gaussian mixture model for background subtraction[C]∥Proceedings of the 17th International Conference on Pattern Recognition.Cambridge:IEEE,2004:28-31.

[7]Elgammal A,Duraiswami R,Harwood D,et al.Background and foreground modeling using nonparametric kernel density estimation for visual surveillance[C]∥Proceedings of the IEEE,2002,90(7):1151-1163.

[8]宋佳声.动态场景的自适应高斯混合模型的研究[J].计算机工程与应用,2012,48(1):8-12.Song Jia-sheng.Study of adaptive Gaussian mixture models for dynamic scenes[J].Computer Engineering and Applications,2012,48(1):8-12.

[9]Li Dawei,Xu Lihong,Goodman Erik.Online background learning for illumination-robustforeground detection[C]∥Proceedings of the 11th International Conference on Control,Automation,Robotics and Vision.Singapore:IEEE,2010:1093-1100.

[10]Bouttefroy P L M,Bouzerdoum A,Phung S L,et al.On the analysis of background subtraction techniques using Gaussian mixture models[C]∥Proceedings of the 35th International Conference on Acoustics,Speech,and Signal Processing.Dallas:IEEE,2010:4025-4045.

[11]Lin Horng-hong,Chuang Jen-Hui,Liu Tyng-Luh.Regularized background adaptation:a novel learning rate control scheme for Gaussian mixture modeling[J].IEEE Transactions on Image Processing,2011,20(3):822-836.

[12]常晓夫,张文生,董维山.基于多种类视觉特征的混合高斯背景模型[J].中国图象图形学报,2011,16(5):829-834.Chang Xiao-fu,Zhang Wen-sheng,Dong Wei-shan.Mixture of Gaussian background modeling method based on multi-category visual features[J].Journal of Image and Graphics,2011,16(5):829-834.

[13]白向峰,李艾华,李喜来.新型背景混合高斯模型[J].中国图象图形学报,2011,16(6):983-988.Bai Xiang-feng,Li Ai-hua,Li Xi-lai.A novel background Gaussian mixture model[J].Journal of Image and Graphics,2011,16(6):983-988.

[14]Gorur P,Amrutur B.Speeded up Gaussian mixture model algorithm for background subtraction[C]∥Proceedings of the 8th IEEE International Conference on Advanced Video and Signal Based Surveillance.Klagenfurt:IEEE,2011:386-391.

[15]Chen Z,Ellis T.Self-adaptive Gaussian mixture model for urban traffic monitoring system[C]∥Proceeding of IEEE InternationalConferenceon ComputerVision Workshops.Barcelona:IEEE,2011:1769-1776.

[16]苗东升.论复杂性 [J].自然辩证法通讯,2000,22(6):87-92.Miao Dong-sheng.On complexity[J].Journal of Dialectics of Nature,2000,22(6):87-92.

[17]张学文.组成论[M].合肥:中国科学技术大学出版社,2003:19-87.