基于k均值聚类和自适应模板匹配的眼底出血点检测方法

肖志涛 赵北方 张 芳* 耿 磊 吴 骏 王 雯 张欣鹏苏 龙 陈莉明 单春燕

1(天津工业大学电子与信息工程学院,天津 300387)2(天津医科大学眼科医院,天津 300384)3(天津医科大学代谢病医院,天津 300070)

基于k均值聚类和自适应模板匹配的眼底出血点检测方法

肖志涛1赵北方1张 芳1*耿 磊1吴 骏1王 雯1张欣鹏1苏 龙2陈莉明3单春燕3

1(天津工业大学电子与信息工程学院,天津 300387)2(天津医科大学眼科医院,天津 300384)3(天津医科大学代谢病医院,天津 300070)

眼底出血点是糖尿病视网膜病变的早期症状,准确检测眼底图像中的出血点,对于构建糖尿病视网膜病变的自动筛查系统具有重要意义,本研究提出了一种基于k均值聚类和自适应模板匹配的出血点检测方法。首先利用HSV空间亮度校正以及对比度受限自适应直方图均衡化方法对眼底图像进行预处理,然后使用k均值聚类分割出候选目标,最后利用自适应归一化互相关模板匹配与支持向量机(SVM)分类器对候选目标进行筛选,从而得到真正的出血区。采用DIARETDB数据库的219幅眼底图像进行实验,本方法在图像水平的灵敏度为100%,特异性为80%,准确率为92.4%,在病灶水平的灵敏度为89%,阳性预测值为87.3%。结果表明本方法能够实现眼底图像中出血点的自动检测。

眼底图像;出血点;k均值聚类;自适应模板匹配;支持向量机

引言

随着生活水平的提高和生活模式的转变,糖尿病已经成为导致人类病残和死亡的重要原因之一。糖尿病视网膜病变(diabetic retinopathy,DR)是糖尿病最为常见和严重的微血管并发症,是目前全世界范围内成年人群致盲的主要原因,其患病率随患病时间和年龄的增长而升高,给人类健康和社会发展带来了沉重的负担,已经成为严重的全球性问题。出血点是DR的早期症状,多位于毛细血管静脉端、视网膜深层,呈红色或暗红色,为圆形斑点状。对其进行准确检测,对于实现DR的自动筛查、有效评估和抑制病情的发展具有重要意义。

目前,已有很多学者对出血点的检测进行了研究,主要方法有3种。一是数学形态学方法,Ravishankar等和Jaafar等利用形态学填充的方法检测红色病灶[1-2];Nutnaree等使用形态学高帽变换方法得到出血点[3]。二是分类器方法,Li等提出了一种基于网格特征分类的视网膜大面积出血的检测方法[4];Niemeijer等对眼底图像中每个像素进行分类,分割出血管和红色病灶,再利用K近邻分类得到真正的红色病灶区,该方法复杂度高且计算时间长[5]。三是灰度分析方法,Hatanaka等利用基于背景估计的方法及欧氏距离分类器检测出血点[6-7];Saleh等使用背景估计建立了一个DR自动诊断系统[8];García等使用局部灰度分析的方法找到红色病灶的候选区,然后利用分类器实现红色病灶的自动检测[9-10]。其中文献[9]使用多层感知器(multilayer perceptron,MLP)分类,文献[10]尝试了MLP、径向基函数(radial basis function,RBF)、支持向量机(support vector machine,SVM)及以上3种按照多数投票(majority voting,MV)准则结合的分类器。另外,Kande等使用匹配滤波检测红色病灶[11];Bae等把多模板匹配的方法应用于出血点的检测[12];Devaraj等用自适应阈值的方法检测DR红色病灶,该方法简单,但适用性不强[13]。

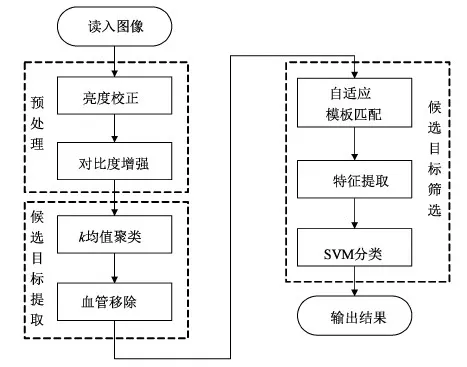

虽然上述方法均实现了出血点的自动检测,但存在误检率高、漏检率高、运算复杂等问题。主要原因是这些方法使用固定的尺寸检测出血点,没有考虑到出血点大小不一的特点,为此,本研究提出一种基于k均值聚类和自适应模板匹配的眼底图像出血点检测方法。k均值聚类是一种基于距离的自适应搜索算法,使用该算法能够确保分割出所有的出血点,自适应的模板会根据出血点的大小自适应生成尺寸合适的窗口,进行快速检测,消除待检目标尺寸的限制。本方法的检测过程如图1所示,主要包括预处理、候选目标提取和候选目标筛选等3个部分。首先对眼底图像进行亮度校正和对比度增强,消除光照不均的影响并提高出血点与眼底背景间的对比度;然后进行k均值聚类分割出眼底图像中的暗区域,在此基础上移除血管,得到出血点的候选目标;最后通过自适应模板匹配和SVM分类器对候选目标进行筛选,获得真正的出血点。

图1 出血点检测过程框图Fig.1 Block diagram of hemorrhages detection

1 材料与方法

1.1预处理

拍摄眼底图像的过程中,因光照等影响会出现亮度不均的现象,因此,本研究首先进行亮度校正。在HSV空间中,将亮度值V(i,j)校正为Bc(i,j)

(1)

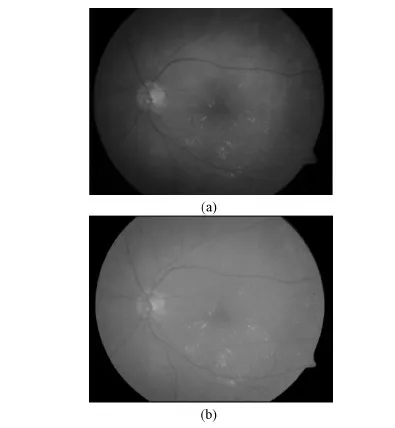

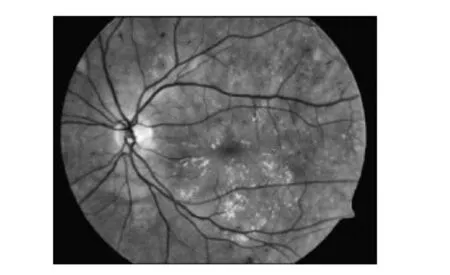

原始图像及其亮度校正后的图像如图2所示。

图2 原始图像及其亮度校正结果。(a)原始图像;(b)亮度校正结果Fig.2 Original image and result of brightness correction. (a)Original image;(b)Result of brightness correction

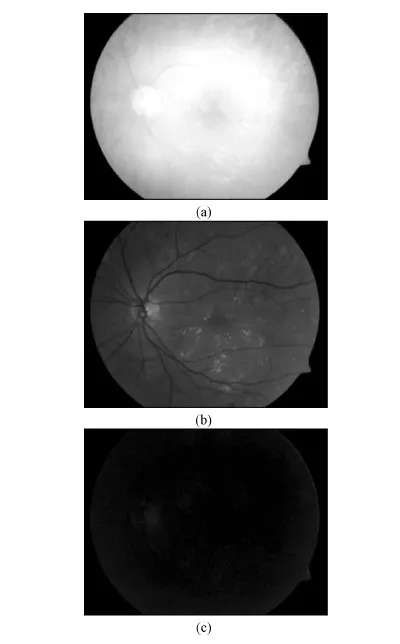

亮度校正后,眼底图像红、绿、蓝各通道图像如图3所示。从图中可以看出,相对于红色通道和蓝色通道的图像,绿色通道图像的对比度最高,包含的出血点特征最为明显。因此,选择绿色通道进行出血点的检测。

图3 眼底图像各通道图像。(a)红色通道;(b)绿色通道;(c)蓝色通道Fig.3 Each channel images. (a)The red channel;(b)The green channel;(c)The blue channel

采用对比度受限自适应直方图均衡化(contrast limited adaptive histogram equalization,CLAHE)算法提高出血点与背景之间的对比度。CLAHE可以增强感兴趣对象的细节,同时克服噪声过度放大的问题。对绿色通道进行CLAHE后,结果如图4所示。

图4 CLAHE结果Fig.4 Result of CLAHE

1.2候选目标提取

从图4可以看出,出血点对应图中灰度值较低的暗目标,所以首先估计背景灰度值找到图中的暗区域,实现出血点的粗分割,即

(2)

式中,Ip为预处理后的图像,Ib是用大尺寸窗口对Ip进行中值滤波得到的近似背景图,t为图像Ip与Ib对应像素相减得到的值。在进行背景估计时,为了保证大出血点的完整性,同时不漏掉小出血点,根据眼底图像的尺寸(本研究选用DIARETDB库,图像大小为1 500像素×1 152像素)和出血点的医学大小在眼底图像中的比例,本研究选择的窗口尺寸为80像素×80像素。对图像Id再次使用CLAHE提高对比度,并用窗口尺寸为5像素×5像素的中值滤波去除噪声,得到粗分割结果,如图5(a)所示。

经过上述运算,原灰度图像中较暗的出血点均变成明显的亮目标。为了获得其中的亮目标,传统的做法是对粗分割结果进行阈值分割。然而,眼底图像的质量不同,难以确定一个适用于所有图像的固定阈值。为了克服上述困难,采用k均值聚类[14]算法分割出血点候选区。首先随机选取k个像素点作为初始聚类中心,然后计算各个像素到各聚类中心的欧式距离,把所有像素归到离它最近的聚类中心所在的类,对分配完的每一个类计算灰度均值作为新的聚类中心,继续进行像素的分配,不断重复上述迭代过程,直至聚类准则函数式(3)收敛。

(3)

式中,xi为类别Ci中的像素灰度值,ci表示类别Ci的灰度均值。最终把所有像素分为k个类别,且每个类别内灰度差异最小,类别间的灰度差异最大。

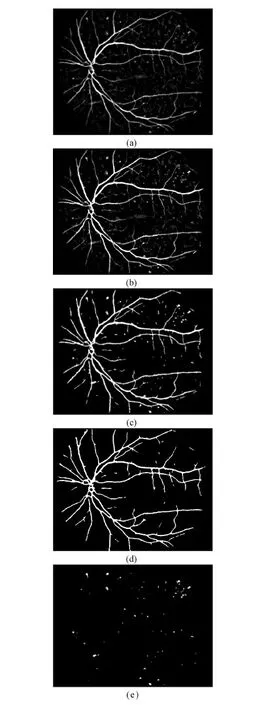

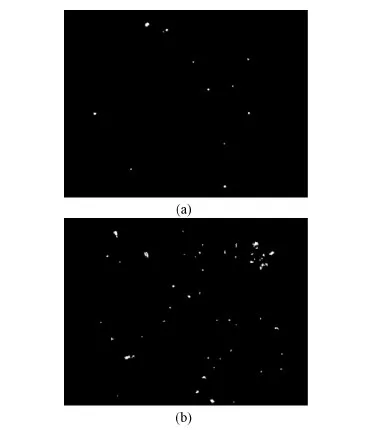

k值的选取决定了分割的效果,若k过大,会造成图像的过度分割;反之则会导致部分出血点和某些伪目标混为一类。实验证明k=5时,能够提取出所有出血点,聚类结果如图5(b)所示。其中出血点的灰度值较高,而眼底背景等的灰度值相对较低,保留聚类结果中灰度级较高的三类作为出血点的初步候选目标,如图5(c)所示。血管和出血点的灰度相近,经过类别选择后仍会被保留,采用文献[15]的方法得到血管网络,将血管从图5(e)中移除,得到出血点候选目标,如图5(e)所示。

图5 候选目标提取过程。(a)粗分割结果;(b) k均值聚类结果;(c)初步候选目标;(d)血管图;(e)候选目标Fig.5 Candidates extraction Process. (a)Coarse segmentation result;(b)Result of k-means clustering;(c)Preliminary candidates;(d)Blood vessel;(e)Candidates

1.3出血点筛选

经上述处理过程提取的出血点候选目标中,除包含出血点之外,仍存在血管片段、背景纹理突变部分等非出血点。为了提取出真正的出血点,本研究提出了自适应模板匹配方法,结合SVM分类器筛选候选目标。

1.3.1自适应模板匹配

出血点具有趋于圆形及低灰度值的特征,灰度分布表现为明显的高斯状波谷,因此可以根据此特征采用模板匹配法筛选出血点。归一化互相关(normalized cross correlation,NCC)[16]模板匹配是一种经典的图像匹配算法。模板T在图像I上从左至右、从上到下搜索,计算搜索窗口所覆盖的子图和模板图之间的互相关系数N(x,y)

(4)

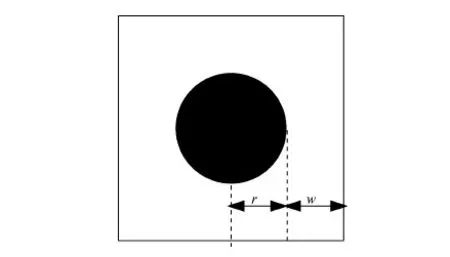

在模板匹配算法中,模板的大小对匹配结果至关重要。眼底图像中的出血点大小不等,因此本文选用自适应的模板。对每一个候选目标,取其外接矩形长和宽中的最大值为直径作圆,使此圆形区域能够完全包含该候选目标,选取以此圆心为中心、大小为2(r+w)×2(r+w)的矩形区域设为模板,如图6所示,r为模板中心圆的半径,w为圆到模板边界的距离。当w取值较大时,模板随之变大,包含较多背景区域,增加了计算的复杂度;当w取值较小时,包含的背景区域少,与眼底图像匹配时出血点与背景的灰度差异不明显,降低匹配的敏感程度。经多次实验,研究中选择w=5。

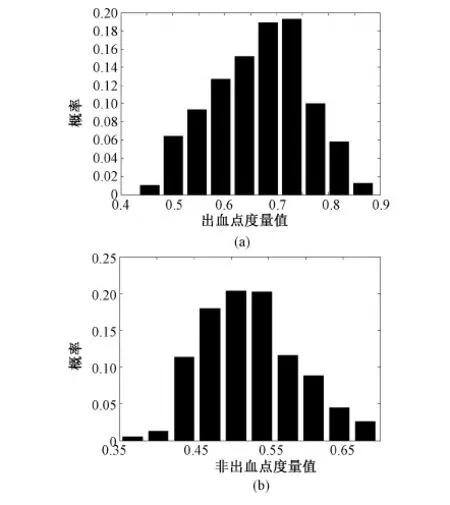

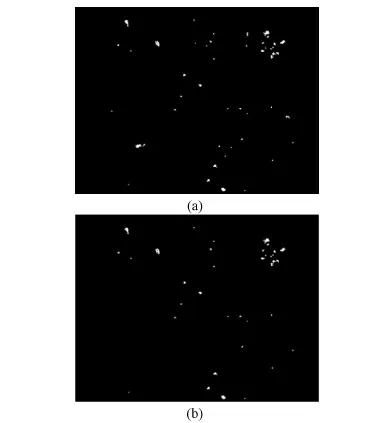

根据图5(e)中候选目标的定位结果,将每一个候选目标在预处理图Ip上选取对应的区域作为子图,与其对应的模板进行NCC匹配,取互相关系数的最大值作为匹配结果的度量值。根据专家标注结果,本研究计算出候选目标中出血点的度量值概率分布图,如图7(a)所示,横轴为度量值,纵轴为相应度量值分布区间内存在的出血点的概率,可以看出,出血点的度量值分布范围为0.45~0.88之间;图7(b)为非出血点的度量值概率分布图,可以看出,非出血点的度量值分布范围为0.35~0.68之间。通过对出血点与非出血点的度量值分布区间比较可知,度量值<0.45的候选目标为伪目标并予以剔除,度量值>0.70的候选目标认为是真正的出血点,如图8(a)所示,而度量值在0.45~0.70之间的候选目标需要进一步筛选,如图8(b)所示。

图6 模板示意图Fig.6 Shape of Template

图7 度量值分布图。(a)出血点;(b)非出血点Fig.7 Measurement value distribution. (a)Hemorrhages;(b)non-hemorrhages

图8 自适应模板匹配结果。(a)度量值大于0.7的出血点;(b)需进一步筛选的出血点Fig.8 Result of adaptive template matching. (a) Hemorrhages of measurement value greater than 0.7;(b)Further screened hemorrhages

1.3.2SVM分类器

模板匹配中度量值在0.45~0.70之间的候选目标,利用SVM分类器对其进行分类筛选。为了能够精确提取待分类目标的特征,首先进行区域生长。以每个目标的形心为种子点,生长范围为其外接矩形向四周扩展得到的区域。在生长过程中,若扩展的范围较大,可能会把邻近的目标包含进来;若扩展的范围较小,则不能完全恢复目标本身的形状,经过实验,选择扩展10个像素。在上述范围内的像素点(x,y),如果其灰度值f(x,y)满足生长准则,则将(x,y)加入区域R中。生长准则为

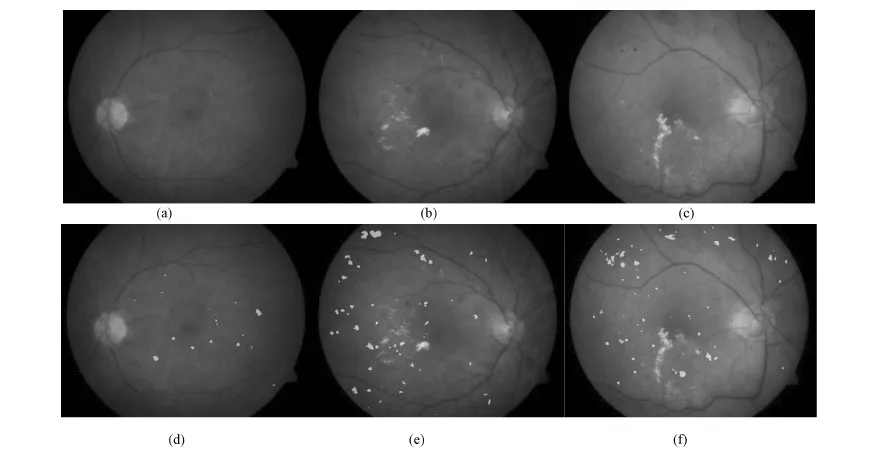

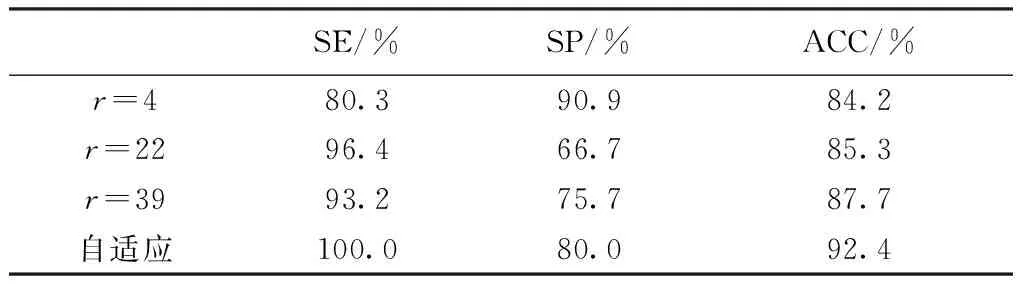

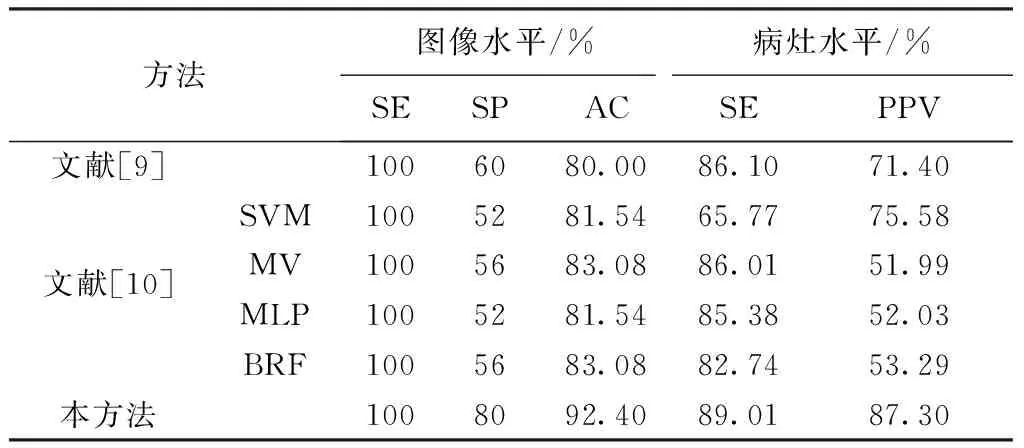

|f(x,y)-m| (5) 式中,m是已生长区域R的灰度均值,T0=100,T为每个生长范围的Otsu阈值。 候选目标中的非出血点主要是血管和干扰性背景区域,其中血管的灰度与出血点相近且呈线状结构,干扰性背景区域包括纹理突变的背景部分和亮病灶之间的正常眼底部分,前者与周围区域的对比度不高,后者周围区域的灰度值很高,而出血点多趋于圆形或椭圆形,且灰度值较低,与背景间的对比度较大。因此采取两个SVM分类器对候选目标进行级联分类,第1个分类器选用形状特征区分血管和出血点,第2个分类器选用灰度特征区分干扰性背景区域和出血点。经过大量实验和比较,最终选择的特征为 (1)离心率(eccentricity)。 (2)圆度(circularity),circularity=p2/4πa,p为周长,a为面积。 (3)长短轴比率(ratio),ratio=l1/l2,l1和l2分别为与区域相同二阶中心矩的椭圆的长轴长度和短轴长度。 (4)区域内部灰度均值(min)。 (5)区域外部灰度均值(mout)。 (6)对比度(md),md=mout-min。 上述特征中,(1)~(3)为形状特征,(4)~(6)为灰度特征。两次候选目标的排除结果分别如图9中(a)和(b)所示,图10为本方法在预处理图上标记的检测结果。 图9 分类器排除伪目标结果。(a)第1个分类器;(b)第2个分类器Fig.9 Classifiers results of false positive reduction. (a)The first classifier;(b)The second classifier 图10 最终检测结果Fig.10 Detection result 1.4算法验证 采用公开数据库DIARETDB进行实验,共219幅尺寸为1 500像素×1 152像素的彩色眼底图像,这些图像来源于一个普查项目,眼底相机以50°视场角度拍摄,专家从数以千计来自不同患者的眼底图像中进行手工挑选,其中包含正常的和存在不同程度病变的图像,具有很强的代表性。本方法随机选择其中的23幅图像作为训练集,其他图像作为测试集,并与医生标记的结果进行对比。 本研究在图像水平和病灶水平上评价检测结果,在图像水平上计算灵敏度(sensitivity,SE)、特异性(specificity,SP)、准确率(accuracy,AC),在病灶水平上计算灵敏度和阳性预测值(positive predict value,PPV),各指标的定义为 SE=TP/(TP+FN) (6) SP=TN/(TN+FP) (7) AC=(TP+TN)/(TP+FN+TN+FP) (8) PPV=TP/(TP+FP) (9) 式中,TP为真阳性,FP为假阳性,TN为真阴性,FN假阴性。对于检测为是出血点的区域,如果与医生标记的结果一致,则为TP,反之,则为FP;对于检测为无出血点的区域,如果与医生标记的结果一致,则为TN,反之,则为FN。灵敏度是对有出血点的图像的识别比率,特异性是对无出血点的图像的识别比率,准确率是对所有图像能够正确识别的比率,阳性预测值是检测为有出血点的图像中医生标记有出血点的图像所占比例,前面4个值越高代表检测效果越好。以上为图像水平的释义,病灶水平与之同理。 图11为本方法对不同彩色眼底图像的检测结果,3幅图像的亮度依次从低到高且均存在对比度低、光照不均等现象,检测结果用绿色标记。按照国际分期标准,图(a)有较少的出血点,属于中度病变,图(b)和图(c)有较多的出血点并伴有渗出物,属于重度病变。实验结果表明,在病变程度不同、图像对比度低、亮度不同及光照不均的情况下,均能正确地检测到出血点,说明本方法具有良好的鲁棒性。 图11 本方法的检测结果。(a)~(c)为原图;(d)~(f)为对应的检测结果图Fig.11 Detection result of this paper. (a) ~ (c)Original images;(d) ~ (f)Detection results of the proposed method correspondingly 表1为自适应模板方法与固定模板方法在图像水平上的比较,r代表模板半径。通过比较可以看出,自适应模板的方法效果优于固定模板。 本方法与其他方法在图像水平和病灶水平上的性能比较如表2所示,其中文献[10]包括4种分类器。从表1可以发现,无论图像水平还是病灶水平,本方法的各项指标均高于文献[9]和[10]的方法,结果表明本方法具有较好的检测性能。 表1 自适应模板与固定模板的比较Tab.1 Comparison of different templates 表2 本方法与其他方法的比较Tab.2 Comparison of different algorithms 分割效果的好坏、定位是否准确都将直接影响出血点能否被有效地识别出来,聚类方法可以根据图像特征的相似性对目标进行无监督的自动分割,因此本文利用k均值聚类提取出血点候选目标,避免了出血点尺寸对候选目标提取的影响,克服了阈值选取的困难,并且对灰度变化不敏感,防止出血点遗漏。使用自适应模板匹配法进行筛选,可根据候选目标的大小自适应生成尺寸合适的模板,并与之进行匹配,避免了盲目使用大量多尺寸模板进行全场扫描。 通过与固定模板方法比较可知,固定模板不能满足出血点尺寸差异的特点,产生的漏检多,使得灵敏度较低,同时该方法对出血点的识别能力差,使得特异性较高,而使用自适应的方法尽管特异性不高,但可充分识别出有病变的图像,具有更高的准确率和实用价值,故自适应模板的方法优于固定模板的方法。本方法在图像水平上检测的灵敏度为100%,特异性为80%,准确率为92.4%,在病灶水平的灵敏度为89%,阳性预测值为87.3%,各项数据表明本方法具有良好的病变检测能力,同时实验结果表明本方法对于对比度不同、病变程度不同的眼底图像均可实现出血点的自动检测。但是由于眼底图像的复杂性,血管、背景组织等因素对出血点检测存在很大干扰,导致本方法仍有一些误检和漏检,因此,在后续的研究中需进一步抑制伪目标,通过提取更全面、更准确的特征,提高本方法的检出率和计算效率。 本研究提出了一种基于k均值聚类和自适应模板匹配的眼底图像出血点的检测方法。首先采用亮度校正和对比度增强操作对图像进行预处理,然后根据背景估计实现出血点的粗定位,再利用k均值聚类提取候选目标,最后使用自适应模板匹配和SVM分类器剔除伪目标,获得真正的出血点,实现出血点的自动检测。 [1] Ravishankar S, Jain A, Mittal A. Automated feature extraction for early detection of diabetic retinopathy in fundus images [C] //International Conference on Computer Vision and Pattern Recognition. Miami: IEEE, 2009: 210-217. [2] Jaafar HF, Nandi AK, Al-Nuaimy W. Automated detection of red lesions from digital color fundus photographs [C] //33rd Annual International Conference of the Engineering in Medicine and Biology Society. Boston: IEEE, 2011: 6232-6235. [3] Nutnaree K, Smith G, Bunyarit U. Automated retinal hemorrhage detection using morphological top hat and rule-based classification [C] //3rd International Conference on Intelligent Computational Systems. Singapore: IEEE, 2013: 39-43. [4] Li Tang, Niemeijer M, Abramoff MD. Splat feature classification: detection of the presence of large retinal hemorrhages [C] //8th International Symposium on Biomedical Imaging: From Nano to Macro. Chicago: IEEE, 2011: 681-684. [5] Niemeijer M, Ginneken B, Staal J,etal. Automatic detection of red lesions in digital color fundus photographs [J]. IEEE Transactions on Medical Imaging, 2005,24(5): 584-592. [6] Hatanaka Y, Nakagawa T, Hayashi Y,etal. CAD scheme to detect hemorrhages and exudates in ocular fundus images [J]. SPIE Medical Imaging: Computer-Aided Diagnosis, 2007,6514(2): 1-8. [7] Hatanaka Y, Nakagawa T, Hayashi Y,etal. Improvement of automated detection method of hemorrhages in fundus images [C] //30th Annual International Conference of the Engineering in Medicine and Biology Society. Vancouver: IEEE, 2008: 5429-5432. [8] Saleh MD, Eswaran C. An automated decision-support system for non-proliferative diabetic retinopathy disease based on MA and HA detection [J]. Computer Methods and Programs in Biomedicine, 2012,108(1): 186-196. [9] García M, Sánchez CI, López MI,etal. Automatic detection of red lesions in retinal images using a multilayer perceptron neural network [C] //30th Annual International Conference of the Engineering in Medicine and Biology Society. Vancouver: IEEE, 2008: 5425-5428. [10] García M, López MI,lvarez D,etal. Assessment of four neural network based classifiers to automatically detect red lesions in retinal images [J]. Medical Engineering & Physics, 2010,32(10): 1085-1093. [11] Kande GB, Savithri TS, Subbaiah PV. Automatic detection of microaneurysms and hemorrhages in digital fundus images [J]. Journal of Digital Imaging, 2010,23(4): 430-437. [12] Bae JP, Kim KG, Kang HC,etal. A study on hemorrhage detection using hybrid method in fundus images [J]. Journal of Digital Imaging, 2011,24(3): 394-404. [13] Devaraj D, Nagaveena. Detection of red lesion in diabetic retinopathy using adaptive thresholding method [J]. International Journal of Engineering Research & Technology, 2013,2(4): 1889-1892. [14] Krishna K, Murty MN. Genetic K-means algorithm [J]. IEEE Transactions on System, Man and Cybernetics, 1999,29(3): 433-439. [15] Vlachos M, Dermatas E. Multi-scale retinal vessel segmentation using line tracking [J]. Computerized Medical Imaging and Graphics, 2010,34(3): 213-227. [16] Lewis JP. Fast template matching [C] //Canadian Image Processing and Pattern Recognition Society. Quebec: IEEE, 1995: 120-123. Hemorrhages Detection in Fundus Image Based on k-Means Clustering and Adaptive Template Matching Xiao Zhitao1Zhao Beifang1Zhang Fang1*Geng Lei1Wu Jun1Wang Wen1Zhang Xinpeng1Su Long2Chen Liming3Shan Chunyan3 1(School of Electronics and Information Engineering, Tianjin Polytechnic University, Tianjin 300387, China)2(Tianjin Medical University Eye Hospital, Tianjin 300384, China)3(Tianjin Medical University Metabolic Disease Hospital, Tianjin 300070, China) Hemorrhages are early symptoms of diabetic retinopathy (DR), the accurate detection of hemorrhages in fundus images is an important contribution for building automatic screening system of DR, a novel algorithm based onk-means clustering and adaptive template matching was proposed in this work. Firstly, HSV brightness correction and contrast limited adaptive histogram equalization were applied to fundus images. Then, the candidate hemorrhages were extracted by usingk-means clustering. At last, adaptive template matching with normalized cross-correlation and SVM classifier were used to screen the candidates, and the hemorrhages were detected. The approach was evaluated on 219 fundus images from the databases of DIARETDB. Using an image criterion, we achieved 100% sensitivity, 80% specificity and 92.4% accuracy. With a lesion criterion, we reached a sensitivity of 89% and a positive predictive value of 87.3%. The results show that hemorrhages in fundus images can be detected automatically using this method. fundus images; hemorrhages;k-meansclustering; adaptive template matching; support vector machine (SVM) 10.3969/j.issn.0258-8021. 2015. 03.002 2014-10-08, 录用日期:2015-04-10 天津市科技支撑计划重点项目(13ZCZDGX02100);天津市应用基础与前沿技术研究计划一般项目(15JCYBJC16600) R318;TP391.4 A 0258-8021(2015) 03-0264-08 *通信作者(Corresponding author), E-mail:hhzhangfang@126.com

2 实验结果

3 讨论和结论