基于局部特征匹配的双焦单目立体视觉深度估计

冯 春,吴小锋,尹飞鸿,杨名利

(常州工学院 机械与车辆工程学院,江苏 常州 213002)

基于局部特征匹配的双焦单目立体视觉深度估计

冯 春,吴小锋,尹飞鸿,杨名利

(常州工学院 机械与车辆工程学院,江苏 常州 213002)

针对基于双焦单目立体视觉的图像焦距变化和相似图像误匹配率高的问题,提出利用局部特征描述子结合“两步匹配法”进行图像匹配。将局部特征描述子引入基于双焦单目立体视觉系统中进行图像匹配。提出“两步匹配法”获取特征点集合,即交换小焦距与大焦距图像匹配顺序获取两个特征点集合,求交运算得到新的集合,并计算深度值。实验结果表明,SSURF(Simplified Speed-Up Robust Feature)匹配速度最快,获取的深度值与理想的深度值误差较小,从而验证了将局部特征用于双焦单目立体视觉进行图像匹配从而完成深度估计是可行的。

双焦成像;图像匹配;局部特征;深度估计;SSURF

0 引 言

视觉是智能机器人[1]的标志之一,计算机视觉技术获得了广泛的关注和深入的研究。单目立体视觉是计算机视觉新兴的一个重要分支,它只需要一台摄像机或其他图像采集设备对场景进行拍摄,以获取场景的图像信息。当前国内外所采用的单目立体视觉算法大致分为以下三种:基于对焦的算法、基于离焦的算法和基于变焦的算法。基于双焦的单目立体视觉[2]通过在两次不同焦距下对目标物体进行成像,在这两种情况下均可获得不同大小但清晰的像,依据目标物上特征点与其对应像点及两次成像的焦距之间的几何关系得到目标物的三维信息,它可以划分到基于变焦的单目立体视觉算法范畴。图像匹配[3-5]是指对拍摄于不同时间,不同传感器或不同视角的同一场景的两幅或多幅图像进行匹配、融合的法则。有关研究人员对图像匹配进行了大量的研究并在此基础上提出了许多匹配算法,如基于比值、面积、相位相关等算法[6-7]。但是这些算法要求图像之间的焦距不能发生变化,不能存在尺度缩放,旋转,变形不能太明显,光照、仿射变换受到限制。随着基于特征匹配算法的出现,可以用于具有不同特征图像及图像间变形严重的情况,而引入的尺度空间的特征检测算法可以鲁棒地完成位移较大的图像之间的精确特征检测及图像匹配。目前国内外特征匹配算法中比较成功的是局部描述子SIFT算法(Scale Invariant Feature Transform,尺度不变特征)及其相关的改进算法PCA-SIFT、SURF、SSURF。这些算法具有较好的匹配效果,能稳定地提取特征点,对于图像间发生平移、焦距改变、光照变化等情况均具有良好的匹配精度和鲁棒性。

文中在研究基于双焦成像算法及其精度分析和各种图像匹配算法的基础上,考虑到基于双焦单目立体视觉拍摄的图像是在不同焦距下获取的,图像的尺度变化是首要考虑的因素,提出利用局部描述子作为基于双焦成像立体视觉系统的图像匹配的特征描述,并在不同焦距下获取同一场景下的图像进行相关的特征提取及匹配的实验。提出利用“两步法”解决相似图像误匹配率高的问题,并完成深度信息的估计。

1 基于双焦成像单目立体视觉

1.1 双焦成像算法原理

双焦成像算法的基本原理[2,8-9]是利用空间物点深度与其在不同焦距下所成像的矢量位移与相应焦距大小之间的几何关系,在两幅变焦图像中获取相应的匹配点及像矢量大小,再结合给定的焦距值从而得到三维空间目标物的特征点的深度信息。

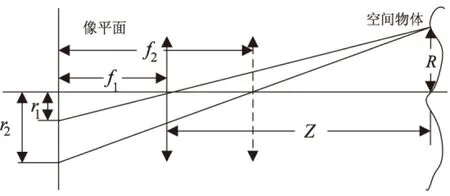

假定摄像机模型为理想的针孔透视变换模型,图1为该方法的几何模型。

图1 双焦成像几何模型

由图1可知,对于空间中某静止物体,当物镜前后移动时通过相机能够在两次不同焦距情况下在相同位置的像平面形成两幅清晰像。取相机坐标系为参考坐标系,取在较小焦距情况下相机的透镜中心为原点,同时取相机的透镜主轴为z轴。图1中,R表示空间物点距离摄像机主光轴的大小,Z为原点到物点所在平面的距离值,即深度。f1,f2分别代表较小焦距值和较大焦距值,r1,r2表示对应焦距下的像点向量(亦可描述为图像主点到像点的向量)大小。在理想的条件下,可以将像点向量的起点看作是图像的中心点。依据图1所示几何模型的关系可以推导出深度Z的计算式。

(1)

其中,Δr=r2-r1,a=(f2-f1)/f1。

由式(1)可知,当双焦相机的焦距f1,f2已知时,深度Z可由ar1/Δr唯一确定。

1.2 双焦单目测距精度

对处于同一平面的空间物点来说,Δr与R呈正比,那么空间物点距离图像中心越近,则其相应的Δr越小并且ar1与Δr之差与R亦呈线性关系。由此可知,对位于中心附近区域的空间物点,其所对应的像矢量的精度要求较高,计算得到的深度信息会有较大的误差;对处于边缘的空间物点,其所对应的像矢量精度要求较低,计算得到的深度信息误差较小,且越远离中心,误差越小。除上述物点与光轴距离对测距精度的影响以外,刘红波等重点论述了以下3种影响测距精度的原因[10]:

(1)双焦单目算法通过改变摄像机的焦距从而得到不同的图像,故在不同的焦距下均需对摄像机完成标定操作。因此,频繁进行摄像机标定其获得的精度对双焦单目测距的精度影响很大。

(2)像点径向视差Δr越小,则要求透镜系统对应的深度分辨率就越高,那么测距误差就越大。对处于同一平面的空间物点,在焦距确定的条件下,径向视差Δr与深度呈反比,故在标定图像的主点坐标时较小的标定误差给最终的深度估计带来比较大的误差。

(3)当相机在获取不同焦距下的两幅图像时,若出现偏移或者旋转,则像矢量r1,r2会产生偏差,这同样会影响测距精度。

综上可知,图像主点的标定误差是影响双焦测距精度的主要原因之一,文中主要研究如何消除主点标定误差对测距精度的影响问题。文献[10]采用目标面积不变性避免对图像主点的标定。但是,该方法中目标图像面积测量的精度对双焦测距的精度影响较大。目标面积受到照度变化的影响,焦距的变化会改变图像的照度。因此,该图像主点消除算法具有一定的局限性。文中提出一种简化的图像主点消除方法,利用双像点矢量取代目标面积,同样实现避免频繁标定主点的问题。

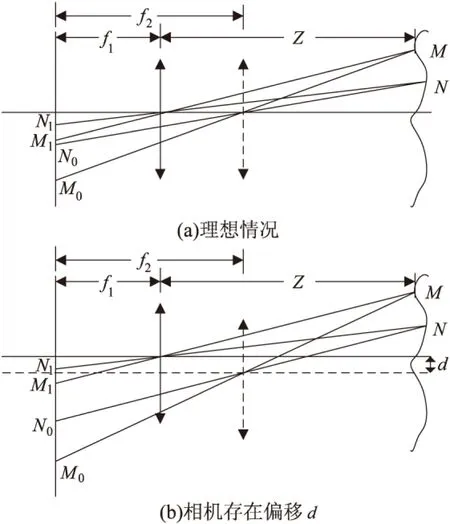

假定垂直光轴的平面空间内存在至少2个物点M、N,在小焦距下成像对应的像点为M1、N1,在理想状态下,在大焦距下成像对应的像点为M0、N0。若相机变焦过程中图像中心在像平面的投影存在侧向偏移d,M、N所对应的像点为M2、N2。

(2)

此时,用双像点矢量代替主点坐标的计算,消除图像主点坐标标定所造成的误差。实际应用时,在平面空间必然存在多个物点,可以利用最小二乘法进一步提高测距的精度。

图2 M、N两物点的双焦成像图

1.3 单目立体视觉系统分析

对于单目立体视觉系统来说,一般包括如下几个部分:采集图像,摄像机定标,特征提取,立体匹配,深度获取及深度内插。每一个环节都有相应的难点,都必须进行深入的研究才能最终获取精度较高的深度图。下面就双焦成像的运动模型作简要的分析[2]:假定两幅图像中对应点的坐标分别为(X1,Y1)和(X0,Y0),则两幅图像中对应点有如下关系:

(3)

两个方向的旋转量和沿z轴的平移很小,因此可以将上述模型简化为如下的二维运动模型[3]:

(4)

其中,S为相机的变焦系数比;θ为相对于z轴的旋转角度;(Δx,Δy)为不同焦距下图像的平移向量。

因此在两幅图像中获得N对特征匹配点对,从而利用上述方程可以建立方程组,采用最小二乘法的优化方法完成4个参数的求解,用以估计深度信息以及完成深度图的恢复和3D场景的重建。

2 SSURF局部算子特征匹配

前文提到单目立体视觉一般包括几个组成部分,其中图像匹配是深度估计和最终3D重建的关键环节[11],匹配的精度和实时性至关重要。文中首先采用基于SIFT[12]及其改进算法PCA-SIFT[13]和SURF特征匹配的算法进行图像匹配的研究。进一步,针对单目双焦立体视觉系统的特点,给出一种简化的SURF算子(Simplified Speed-Up Robust Feature)。SURF可以描述为两个阶段:第一阶段包括基于兴趣点圆形邻域内信息固定的方向迭代;第二阶段为对应所选择的方向构建一个正方形区域,并且以此提取SURF描述子。文中提出一种简化的SURF描述子,对于图像旋转并非保持不变但是适合于图像并无旋转的情况,具有比SURF更快的计算速度和更好的实用性。在SURF算法中,为了保持图像之间的旋转不变性,主要通过如下的方向分配步骤[14]:

为了保持旋转不变,提取的兴趣点支持可重复的方向。因此,在兴趣点周围半径为6s的圆形邻域内(其中s是检测兴趣点的尺度),首先计算在x和y方向的哈尔小波响应,它由当前的尺度s进行计算。因此,高尺度对应大尺寸的小波。可以再次利用积分图像加速滤波。选取小波的边长为4s,完成任意尺度下x或者y方向响应的计算仅需6次运算。一旦小波的响应需要通过兴趣点中心的高斯(σ=2.5s)进行计算和加权,则可以利用一个空间向量表示响应。此空间的水平响应沿着横坐标的方向而垂直响应则沿着纵坐标的方向。主方向是由一个覆盖π/3角度的滑动方向窗口内所有的响应和进行计算的,在该滑动窗口内的水平和垂直的响应求和则产生一个新的向量。最长的向量即为兴趣点的方向。滑动窗口的尺寸是一个参数,它可以用实验方法选取。小尺寸对应单一的主小波响应,大尺寸则在向量长度上产生极大值。它们均导致了在兴趣区域的一个不稳定的方向。该步骤可以保证图像的旋转不变性。

然而,单目双焦视觉条件下的图像近似为无旋转变换的理想条件,故能将此步骤精简以简化SURF算法,从而改善算法的运算效率,增强算子的实用性[2]。

3 实 验

实验所用摄像机采用CanonPowerShotA2000IS型彩色数码照相机和三角架等。用于图像处理的台式机的硬件配置为:CPU主频2.20GHz,内存2G。软件整体的开发环境采用VisualStudio2010和Matlab7.1,图像处理软件采用OpenCV2.4.3。文中利用文献[2]相同的手动摄像图片完成实验,CCD尺寸为1/2.3英寸,CCD面积约为5.56mm×4.17mm,选取的大小标称焦距值分别为6.4mm和14.72mm,最大光圈F3.2/5.9。由于数码相机的标称焦距与35mm胶片相机的焦距之间存在一个折算倍率,而且深度估计是基于35mm胶片相机得出的,所以在估算深度时应考虑折算倍率的修正。采集图像的大小为640×480像素,所拍摄的空间背景为墙面上的双插座,距离相机镜头距离约为0.5m。

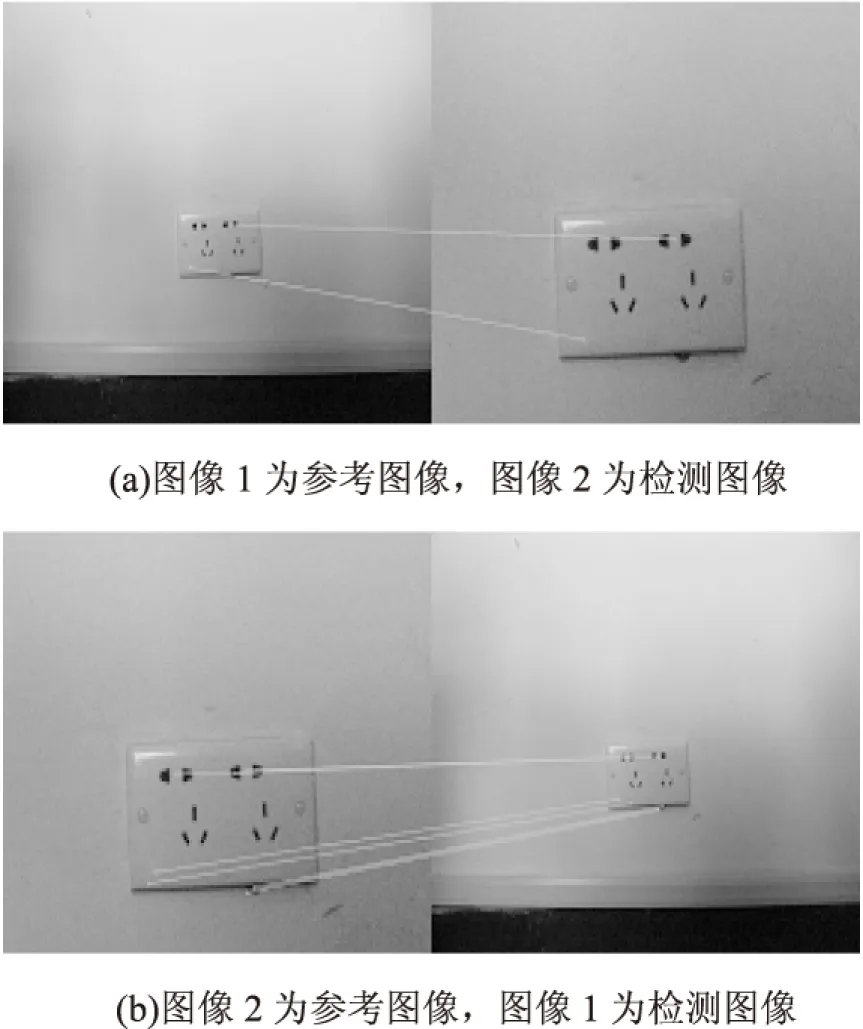

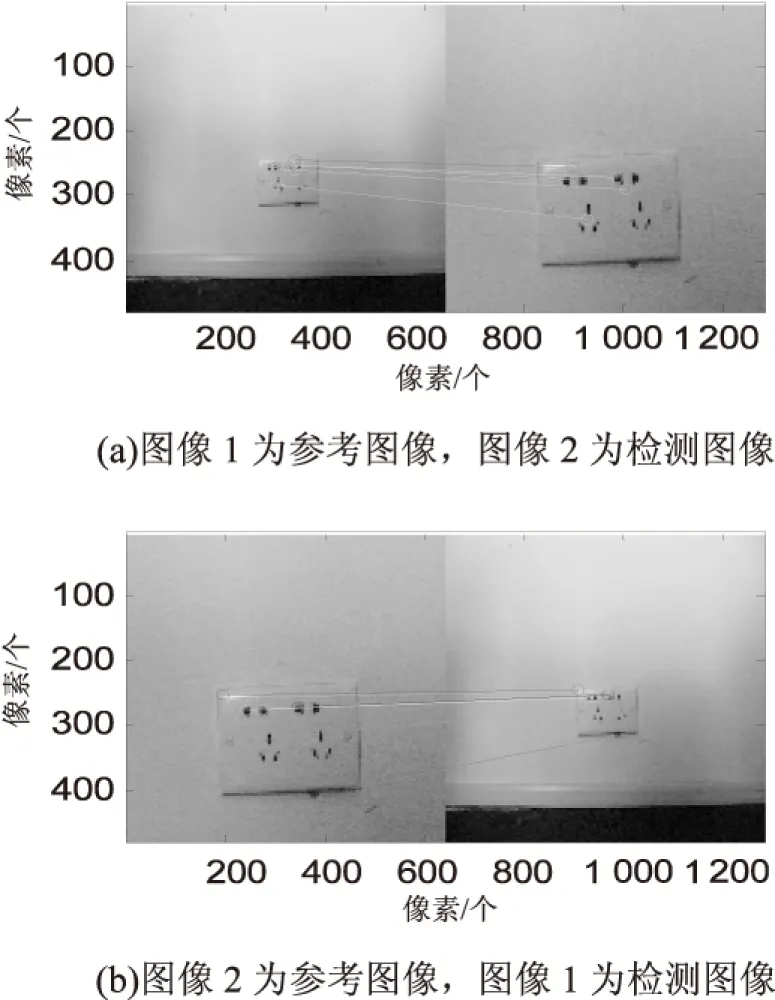

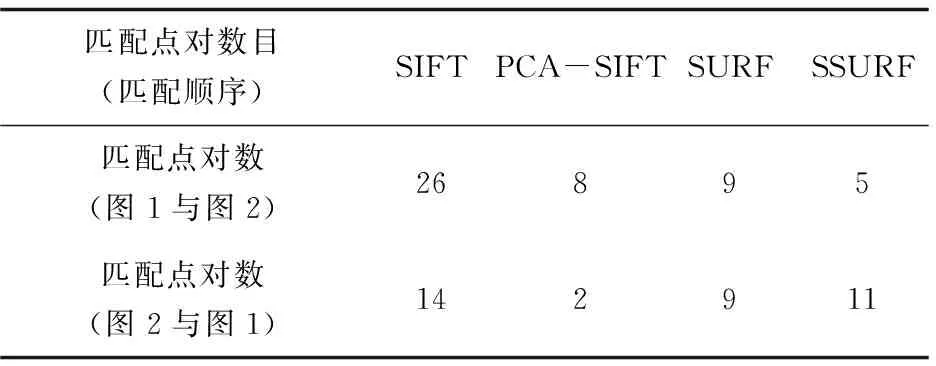

实验中的双插座图像具有良好的相似性,若仅利用小焦距图像作为参考图像,大焦距图像作为待匹配图像进行匹配,则图像的匹配正确性难以保证。故文中提出“两步匹配法”,首先选取图像1(小焦距)作为参考图像,以图像2(大焦距)图像作为待匹配图像获取匹配特征点集;然后交换参考图像与待匹配图像顺序获取匹配特征点集;最后取前两次匹配特征点的交集作为最后的匹配特征点集。部分实验结果如图3和图4所示,相关数据如表1和表2所示。

图3 PCA-SIFT特征匹配结果图

接着选取由SSURF算子检测的特征点坐标,在基于双焦单目立体视觉系统下进行深度的运算估计。在利用SSURF算子检测的特征点进行深度估计过程中,匹配点对的正确率是需要考虑的重要因素。以SSURF算子为例,当以图像1(小焦距)作为参考图像,以图像2(大焦距)作为待匹配图像所得的5对匹配点中,有4对匹配正确,正确率为0.8;当以图像2作为参考图像,以图像1作为待匹配图像所得的11对匹配点中,有5对匹配正确,匹配正确率为0.45;取两次匹配点的交集作为深度估计的特征点集合4对匹配正确,匹配的正确率为1。随后选择多组图像做了同样的实验,取其中3组匹配结果(如表3所示),证明了取两次匹配点的交集可以保证匹配的正确率,但是一般情况会减少相应的匹配点集合的元素个数。

图4 SSURF特征匹配结果图

匹配点对数目(匹配顺序)SIFTPCA-SIFTSURFSSURF匹配点对数(图1与图2)26895匹配点对数(图2与图1)142911

表2 基于各种局部描述子图像匹配时间 s

表3 “两步匹配法”获取图像匹配点对数目及正确率

最后选取第一组实验两次图像匹配获取的特征点交集,进行单目立体视觉系统深度的估计,以验证局部描述子在基于双焦单目立体视觉系统匹配中的有效性。将上述特征点交集代入方程(4),并利用摄像机标定获取的摄像机内部参数求得5个特征点对的深度值分别为:0.469 3m,0.522 4m,0.488 1m,0.507 84m,0.459 87m。考虑到影响双焦测距精度的因素众多,大量实验表明文中算法的测距精度与文献[6]相比精度相当或者更优,各物点的深度值差别不大,基本符合目标物到相机的距离0.5m的设置条件。

4 结束语

双焦成像测距算法是在两个不同焦距下获取图像并进行特征点匹配,再利用几何关系计算空间物点的距离。然而,变焦意味着频繁标定图像主点坐标。为了避免这个问题,文中提出采用双像点矢量代替单像点矢量,从而消除了图像主点标定极易产生误差的问题,最终的实验结果验证了该算法的有效性。

由于实验图像的目标物插座具有很好的相似性,实验发现各种局部描述子下均存在误匹配率比较高的情况。为了提高局部特征匹配的正确率,文中提出“两步匹配法”,即首先利用小焦距图像作为参考图像,大焦距图像作为待匹配图像进行匹配获取匹配点集,再交换参考图像与待匹配图像进行交运算获取最终匹配点集。由表3可知,此方法可保证较低的误匹配率。

基于双焦单目立体视觉是在不同焦距下采集两幅图像,两者基本不发生旋转变化,结合对几种局部描述子匹配的速度和获取匹配点的数目以及误匹配率结果,综合表1和表2可知,SSURF是所研究的几种描述子中最适合双焦单目立体视觉系统图像匹配的算法。

采用“两步匹配法”利用SSURF算法获取特征点集合进行目标物的深度估计,获取的特征点对交集求取的深度值基本符合理想深度值,能够反映出空间物点的深度情况,为后续的深度图恢复和3D重建做了很好的论证。

综上可知,采用局部特征描述子可以有效地解决基于双焦单目立体视觉系统图像匹配问题,完成深度估计。此单目立体视觉系统在移动机器人视觉导航、工业机器人手眼协调、医学图像分析、国防设备等领域有着广阔的应用前景,但是目前的单目立体视觉技术研究较少,同时仍有许多难题亟待解决,如何进一步提高局部特征匹配算法的实时性是接下来努力的方向。

[1] 熊有伦,丁 汉,刘恩沧.机器人学[M].北京:机械工业出版社,1993.

[2] 冯 春,吴洪涛,乔 兵,等.基于改进形状上下文的双焦图像深度估计[J].电子科技大学学报,2013,42(2):266-271.

[3] 石鸿雁,赵丽红.改进混沌优化算法在图像匹配中的应用[J].沈阳工业大学学报,2008,30(6):684-687.

[4] 贾世杰,王鹏翔,姜海洋,等.基于SIFT的图像匹配算法[J].大连交通大学学报,2010,31(4):17-21.

[5] 何 静.基于形状的图像匹配算法研究[D].西安:西安理工大学,2014.

[6] 杨理践,李 响,高松巍.排水管道视觉检测成像技术[J].沈阳工业大学学报,2010,32(2):177-181.

[7] 杜立婵,覃团发,黎相成.基于单目双焦及SIFT特征匹配的深度估计方法[J].电视技术,2013,37(9):19-22.

[8] 王 剑,王元庆.基于双焦成像的单眼立体视觉算法[J].机器人,2007,29(1):41-44.

[9] 徐姝姝,王元庆,张兆扬.新的单目立体视觉的视差图的获得方法[J].计算机应用,2011,31(2):341-343.

[10] 刘红波,赵勋杰,彭 翔.基于双焦成像的测距技术研究[J].激光与红外,2010,40(10):1136-1140.

[11]StrechaC,BronsteinAM,BronsteinMM,etal.Improvedmatchingwithsmallerdescriptors[J].IEEETransactionsonPatternAnalysisandMachineIntelligence,2012,34(1):66-78.

[12]LoweDG.Distinctiveimagefeaturesfromscale-invariantkeypoints[J].InternationalJournalofComputerVision,2004,60(2):91-110.

[13]YanKE,SukthankarR.Amoredistinctiverepresentationforlocalimagedescriptors[C]//ProceedingsofIEEEinternationalconferenceoncomputervisionandpatternrecognition.WashingtonDC,USA:IEEE,2004:504-513.

[14]BayH,TuytelaarsT,GoolLV.SURF:speededuprobustfeatures[C]//ProceedingsofAsianconferenceoncomputervision.[s.l.]:[s.n.],2006:918-927.

Depth Estimation for Bifocal Monocular Stereo Vision Based on LocalImage Feature Descriptors Matching

FENG Chun,WU Xiao-feng,YIN Fei-hong,YANG Ming-li

(College of Mechanical and Vehicular Engineering,Changzhou Institute of Technology,Changzhou 213002,China)

Focused on the issue of the focal length change of image based on the bifocal monocular stereo vision and the high rate of false matching of similar image,the use of local feature descriptors and ‘Two-step Matching Method’ for image matching is proposed.Local feature descriptors are used to complete the image feature matching in the monocular stereo vision system and compared with each other.‘Two-step matching method’ is used to obtain the set of feature points,and two sets of feature points are obtained by changing the order of two images,the small focal length one and the large focal length one,and then a new set can be got by an intersection operation between the above two point sets,thereby the depth estimation computation could be completed by the new set.Experimental results show that the SSURF has the fastest matching rate,and the depth value obtained by the above method is approximately equivalent to the ideal depth value,so it verifies that the local feature descriptors used for image matching based on bifocal monocular stereo vision to compute the depth estimation is feasible.

bifocal imaging;image matching;local feature;depth estimation;SSURF

2015-09-29

2016-02-25

时间:2016-08-23

江苏省自然科学基金青年项目(BK20140252);江苏省高校自然科学研究面上资助项目(14KJB510003);江苏省教育厅自然科学基金资助项目(13KJD460003)

冯 春(1981-),男,博士,讲师,研究方向为机器人视觉及其应用。

http://www.cnki.net/kcms/detail/61.1450.TP.20160823.1343.036.html

TP391

A

1673-629X(2016)10-0055-05

10.3969/j.issn.1673-629X.2016.10.012