基于卷积神经网络的极光图像分类

王菲 杨秋菊

(陕西师范大学, 陕西 西安 710119)

0 引言

极光是由太阳风中的高能带电粒子在极区电离层沿着磁力线方向映射时激发的瞬态发光现象。由于极光形态与地磁活动的内在联系, 极光图像对反演地球磁层结构和预测空间天气变换规律研究具有重要指导意义, 因此对极光进行准确分类成为日地物理学研究不可缺少的部分[1-2]。

1964年, Akasofu[3]已经开始对极光形态的探索。他揭示了极光运动形态与亚暴之间的联系,这一发现随后为极光亚暴的研究提供了理论依据。1986年, Meng等[4]根据地磁活动将正午极光分为平静扩张的正午极光卵、小的离散块状、午后明亮的孤立弧状、午后和傍晚扩张亮弧、午后活跃多重弧等5类。1999年, 胡红桥等[1]分析了中山站1995和1997年的4类极光事件, 统计了冕状、带状、极光浪涌、向日极光弧等各种极光形态的分布情况。2015年, Partamies等[5]采用芬兰和瑞典全天空大型实验站拍摄的极光数据, 用当地电集流指数描述亚暴发展的不同阶段, 预测大约1/3的极光结构是弧状极光, 由此推断极光弧是极光最主要的结构形式。

极光的探索从未停止, 每年新增的极光观测图像数据高达几百万幅[2]。以黄河站越冬观测为例, 从2003年12月起, 每年12月至次年2月期间全天空成像仪(All Sky Imager, ASI) CCD相机都会在世界时03:00—15:00 UTC(磁地方时06:00—18:00 MLT)对三波段极光进行高达1 200多小时的全天连续观测。面对海量的极光观测数据, 完全依靠研究人员肉眼观察和手工标记的分类机制在准确性上很难得到保证, 复杂冗余的工作量加上人的主观经验也难以进行推广和延伸。随着计算机视觉识别领域的发展, 让机器自动完成图像识别、分类具有重要意义。计算机图像处理和模式识别技术对极光结构的分析处理和自动分类方式正在成为取代人工肉眼识别的一种新手段。

2001年, Syrjäsuo等[6]首次实现对大型数据库中的极光事件进行自动定位和分类。2004年,他们将加拿大CANOPUS项目的全天空极光图像进行分析总结, 提出用计算机视觉的方式对极光图像自动分类, 根据极光形态分成弧型、斑块型、欧米伽型和南北结构型4大类典型的类别[7]。2011年, 王倩[8]结合局部二元模式提出使用基于空间纹理的全天空极光图像表征方法, 表征极光图像的全局形状和局部纹理, 并基于这一表征方法,将黄河站越冬观测的日侧极光图像分为弧状、帷幔冕状、辐射冕状和热点状4大类, 实现了极光图像自动分类。2013年, 韩冰等[9]在潜在狄利克雷分配模型(Latent Dirichlet Allocation, LDA)的基础上运用谱残差方法对这4大类极光分类机制进行验证, 通过一种融合显著信息的LDA方法对极光图像进行特征表示, 进一步提升了分类正确率。2012年, Syrjäsuo和Partamies[10]比较了极光图像的不同数值特征对检测极光存在与否的效果,得出采用监督学习和局部亮度不变特性时取得最好分类结果。2014年, Rao等[11]根据彩色极光图像对抗尺度不变特征变换(Opponent Scale Invariant Feature Transform, Opponent SIFT)将拍摄到的全天空图像分为有极光、无极光和云团状,这种分类机制不仅减少运算数据量, 也促进连接磁微动和极光活动的统计模型建立, 能更好地预测极光活动。2016年, 杨秋菊等[12]借助韦伯局部描述符(Weber Local Descriptor, WLD)表征全天空极光图像的纹理和亮度等形态特征, 验证了Hu等[13]的分类结果。

以上极光自动分类的机制都是采用传统模式识别方法, 通过精心设计特征描述子表征极光图像形态信息, 然后选择合适的分类器对极光图像进行自动分类。近几年随着人工智能的发展, 深度学习几乎已成为计算机视觉研究的标配, 在人脸识别、图像分类等众多领域取得了显著成功。2012年, Krizhevsky等[14]训练了一个深度卷积神经网络, 摘得了大规模视觉识别挑战赛(ImageNet Large Scale Visual Recognition Challenge, LSVRC)的桂冠, 成功将ImageNet数据集Top 5分类错误率降低到15.3%, 与第二名拉开10%的差距。2013年起, 百度、360先后成立深度学习研究院。2015年蚂蚁金服展现Smile to Pay扫脸技术, 将人脸辨认应用于金融认证。2016年DeepMind团队推出的人工智能程序阿尔法围棋(AlphaGo)第一次亮相并横扫欧洲, AlphaGo通过深度学习进行价值评估和策略评估, 完胜职业棋手[15]。2017年百度人工智能机器人“小度”在人脸识别任务中击败世界记忆大师。深度学习在学术研究和工业应用等方面都占据越来越重要的地位。卷积神经网络之父LeCun等[16]将深度学习定义为一种把原始数据通过非线性映射转变成为更高层次、更抽象表达的特征学习方式。本方法的优势在于卷积神经网络具有良好的容错性和并行处理能力; 它不需要过多的前端处理, 在性能上好于人工设计的预处理过程。相对于传统方法中手工特征提取的机制, 卷积网络对特征具有自学习能力。网络中用计算机模拟人的思维, 从训练数据自动学习特征, 用特征提取和分类的联合反馈实现对图像的识别。因此, 本文针对极光形态结构研究提出一种基于卷积神经网络的极光图像分类机制, 将原始极光图像的像素矩阵直接输入网络, 利用卷积神经网络自动获取极光图像的底层边缘特征和高层语义特征, 网络输出图像的类别, 从而实现“端到端”的全自动极光图像分类[17]。

1 基于卷积神经网络的ASI极光图像表征方法

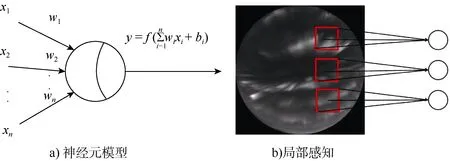

卷积神经网络(Convolutional Neural Network,CNN)是深度学习中一个重要的分支, 在图像分类和模式识别领域中具有广阔的应用前景。在生物神经网络中, 神经元与其他神经元相连, 当它“兴奋”时, 就会向相连的神经元发送化学物质,从而改变这些神经元内的电位; 当某个神经元电位超过“阈值”, 就会被激活, 即“兴奋”起来, 向其他神经元发送化学物质。1943年, McCulloch和Pitt模拟生物提出人工神经网络(Neural Network, NN)[18]。图1a为神经网络中最基本的感知单元神经元模型, 在模型中神经元接到来自n个其他神经元传递的信号, 这些输入信号通过带权重的连接进行传递, 神经元接收到的总输入值将与神经元的阈值进行比较, 然后通过激活函数处理以产生神经元的输出[19]。卷积神经网络是改进的人工神经网络。1980年, 日本学者Fukushima[20]首次提出理论模型Neocognitron是卷积神经网络的早期研究。卷积神经网络最重要的两个优势是局部感知和权值共享[21]。图1b为卷积神经网络局部感知模拟图。局部感知相当于眼睛聚焦在某一点, 即感受野仅与前一层部分神经元相连, 将感受野的局部感知组合, 得到整张图的特征信息; 同一特征映射面上的神经元共用一个卷积权值模板进行卷积运算, 减少权值参数的同时降低了网络的复杂性。通过卷积运算由浅入深的提取图像不同层次的特征, 使网络自主学习, 调节卷积核的参数, 获取合适的分类特征。此次实验将Alexnet模型[14]应用到极光图像的分类上,用迁移学习[22]训练出适合极光数据的权值。该网络一共分为8层, 包括5个卷积层和3个全连接层, 在每层后包含激励函数(Rectified Linear Units, RELU), 部分卷积层中有局部响应归一化(Local Response Normalization, LRN)和最大采样(Max- pooling)处理。

图1 神经元模型和局部感知模型Fig.1. Neuron model and local perception model

1.1 卷积层

卷积层是特征提取过程, 应用卷积核对原始图像进行卷积运算就是对图像的局部区域进行一次前馈计算。不同的卷积核提取不同的特征, 卷积核的数目越多, 提取的特征就越抽象。将输入图片与卷积核运算的结果加上一个偏置输入给激励函数RELU, 最后得到卷积层的输出结果特征图(Feature Map)。第l层的第j个特征图可表示为

1.2 池化层

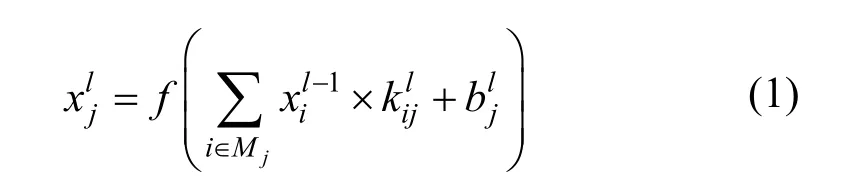

池化层将对卷积层得到的Feature Map进行小邻域内采样得到更抽象的特征, 相当于合并相似特征[16]。在网络中经过池化(pooling)运算, 特征图的数目不变, 尺寸会变小。实验中卷积网络采用Max-pooling方式, 通过计算图像采样区域的最大值对特征进行约减, 不仅降低数据维度,还能在很大程度上避免过拟合。根据文献[23], 选用Max-pooling能保留图像的纹理信息从而减小卷积层参数误差造成估计均值的偏移。池化过程的示意图如图2所示。Max-pooling选出每个采样区域的最大值作为输出。

图2 池化操作示意图Fig.2. Pooling operation process

1.3 全连接层

全连接层相当于多层感知机的隐含层。神经元节点与前一层的每个神经元连接, 本层神经元节点间不连接。通过连接线上的权值进行前向传播, 加权组合得到下一层神经元节点的输入[24]。

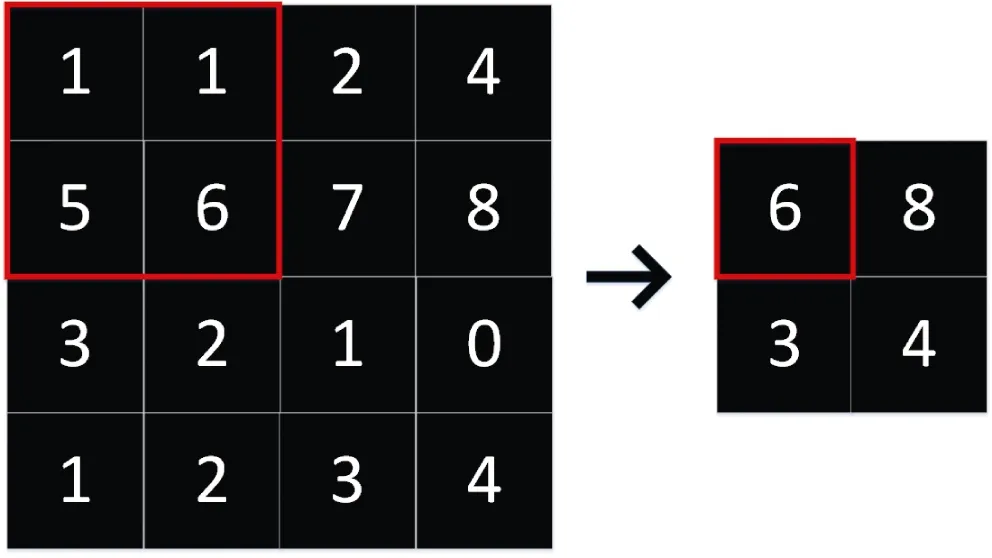

1.4 Softmax分类器

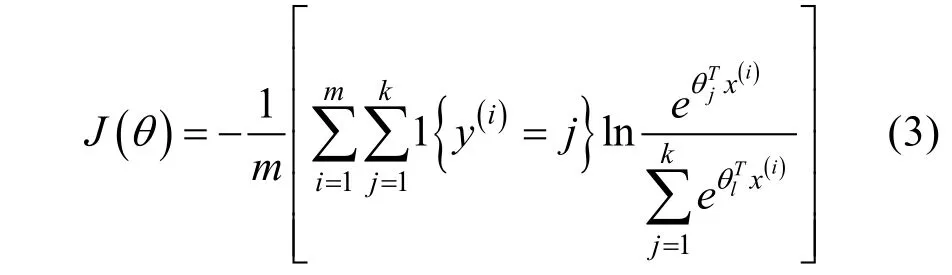

卷积网络对图像形态进行表征, 图像分类的另一个关键是输出层设计。在这一层将卷积网络提取的特征输入分类器, 分类器输出样本标签的统计概率。实验中采用了非线性分类能力强的Softmax分类器, 此分类器针对有且只有一个分类标签的样本。假设输入特征记为x(i), 样本标签记为y(i), 那么假设函数Hθ(x)和逻辑回归代价函数形式分别如下[25]:

式中,θ1,θ2,…,θk是模型的可学习参数,为归一化项。

Softmax逻辑回归代价函数的数学表达式为

其中,是一个指示性函数, 即当大括号中的值为真时, 该函数的结果就为1, 否则其结果为0。

1.5 训练算法

为了在训练中学习到样本的普遍性特征而不只依赖某些特定的训练集, Srivastava等[26]提出Dropout策略: 随机让网络的某些节点以一定概率p输出置零。由于随机让隐层的神经元不工作, 所以工作的神经元必须提取最本质的特征。这样能提高网络的泛化能力, 在一定程度上避免过拟合。

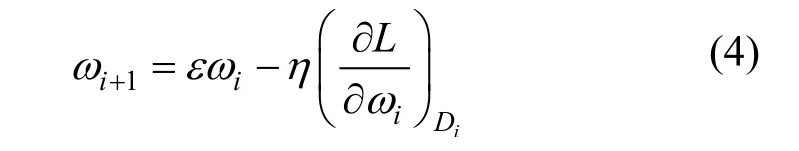

网络参数更新采用随机梯度下降法(Stochastic Gradient Descent, SGD), 用动量(Momentum)保留之前的更新方向, 同时利用当前批次(Batch)的梯度微调最终的更新方向。训练集样本分为n个Batch, 遍历完一个Batch, 更新一次网络参数。参数更新公式如下:

全省共投入各类治理资金约112亿元,完成工程2000余项,大量退化山体和矿山地质环境问题得到有效治理。图为威海华夏城废弃矿山退化山体整治前后对比。

其中,ωi是当前参数,ωi+1是更新后的参数,ε是动量,η是学习速率,是第i个Batch中误差对偏导的平均值。

2 ASI极光图像自动分类

2.1 数据预处理

数据采用我国2003—2009年黄河站三波段极光全天空CCD成像观测系统557.7 nm波段的越冬极光观测数据。对原始图像进行了减暗电流、旋转(逆时针旋转61.1°图像磁正北方向朝上)、灰度拉伸、剪裁等操作[8]。分类机制选用Hu等[13]提出的弧状、帷幔冕状、辐射冕状和热点状极光图像。对2003年38 044幅确定类型的极光图像进行人工标记, 作为数据集2(dataset2); 对dataset2按时间顺序每隔50 s采样抽出8 001幅典型极光数据作为数据集1(dataset1); 2004—2009年311 575幅未知类型越冬观测数据作为数据集3(dataset3)。数据集中各类极光数量见表1。

表1 实验数据集类别详情Table 1. Category details of experimental dataset

2.2 网络模型

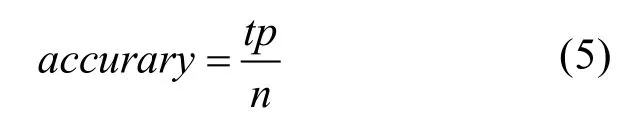

卷积神经网络模型如图3所示。输入网络的极光图像像素大小为256×256, 经网络裁剪(resize)大小为227×227, 每个卷积层中包含激励函数RELU, 池化层核大小为3×3。卷积层C1层经过96个大小为11×11的滤波器卷积运算后再经过一个激励函数加上C1层的偏置系数, 对结果进行归一化处理得到特征图大小为55×55。接着进入池化层S1下采样得到96个大小为27×27的特征图, 这是第一次特征提取阶段。第二次特征提取阶段与第一次类似, 经过5×5大小的卷积核和池化层S2得到256个大小为13×13的特征图。卷积层C3和C4通过384个大小为3×3的卷积核进行滤波, 中间没有池化层与归一化层。卷积层C5将大小为3×3滤波器提取特征送入池化层S5降维得到大小为6×6的256个特征图。全连接层将卷积提取的特征展开成4 096个一维特征向量,最后一个全连接层F8的输出被送到一个4类的Softmax分类器中。实际输出值与预期输出值之间的误差值不断反向传播更新网络权值, 直到网络收敛得到最小损失停止训练, 分类器输出分类正确率。分类正确率(accuracy)评价准则为

其中,tp表示测试样本中每一类识别结果与样本标签一致的目标数,n表示该类的测试样本总数。

图3 卷积神经网络模型. C: 卷积层; S: 池化层; F: 全连接层Fig.3. Convolutional Neural Network Model. C: convolutional layer; S: pooling layer; F: fully connected layer

2.3 参数设置

实验在Linux系统下的终端运行, 计算机CPU为3.4 GHz的Intel i7-6700, 内存为16 GB,极光图像卷积神经网络的训练, 一个Batch大小为10, 动量为0.9, 初始学习速率为0.000 01, 每迭代40 000次学习速率下降到原来的1/10。

2.4 实验结果

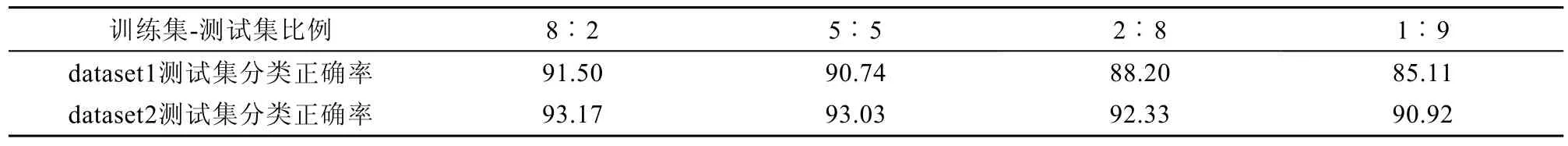

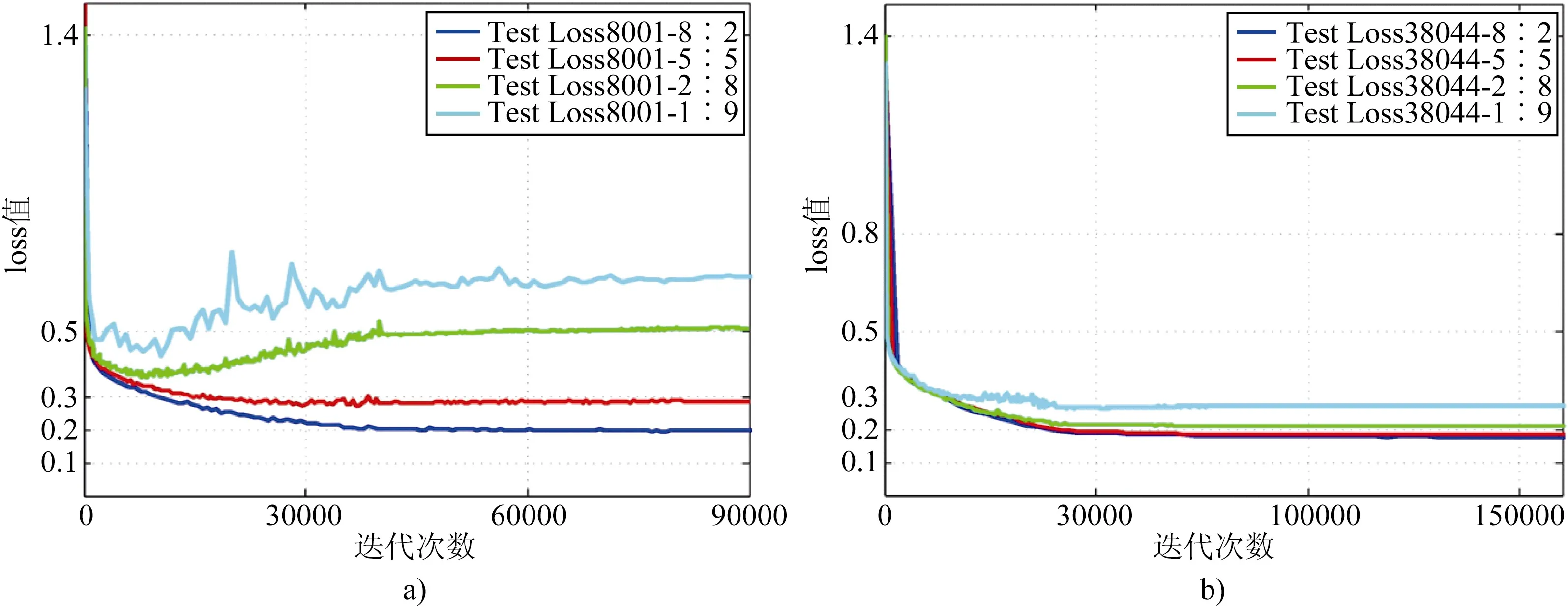

由表2和图4可以看出, 在dataset1数据集(图4a)中当训练集-测试集比例为1︰9时, 分类正确率最低, loss值先降低后升高。这是由于样本数量过低, 特征维度少出现了欠拟合现象。故调整训练集-测试集比例增加特征维度, 随着训练样本数量增加, 测试集的分类正确率逐步提高,损失值降低。样本为8︰2时, 样本分类正确率最高且收敛速度明显低于其他样本比例, 因其有大量数据, 需要更长的时间学习样本特征。

对比实验dataset2(图4b)中各比例样本收敛速度保持一致, 随训练集数目增加, 正确率平稳上升,loss值逐渐降低。对比在两个数据集上的实验结果,dataset2在整个测试过程中相对平稳, 因其样本数量较大具有完善的极光形态信息。所以dataset2呈现更高的极光分类正确率, 能较好的表征极光形态。

表2 数据集1和数据集2分类正确率Table 2. The accuracy rate of aurora dataset1 and dataset2

图4 极光测试损失曲线.a)数据集1, b)数据集2Fig.4. The test loss curve of aurora. a)dataset1, b)dataset2

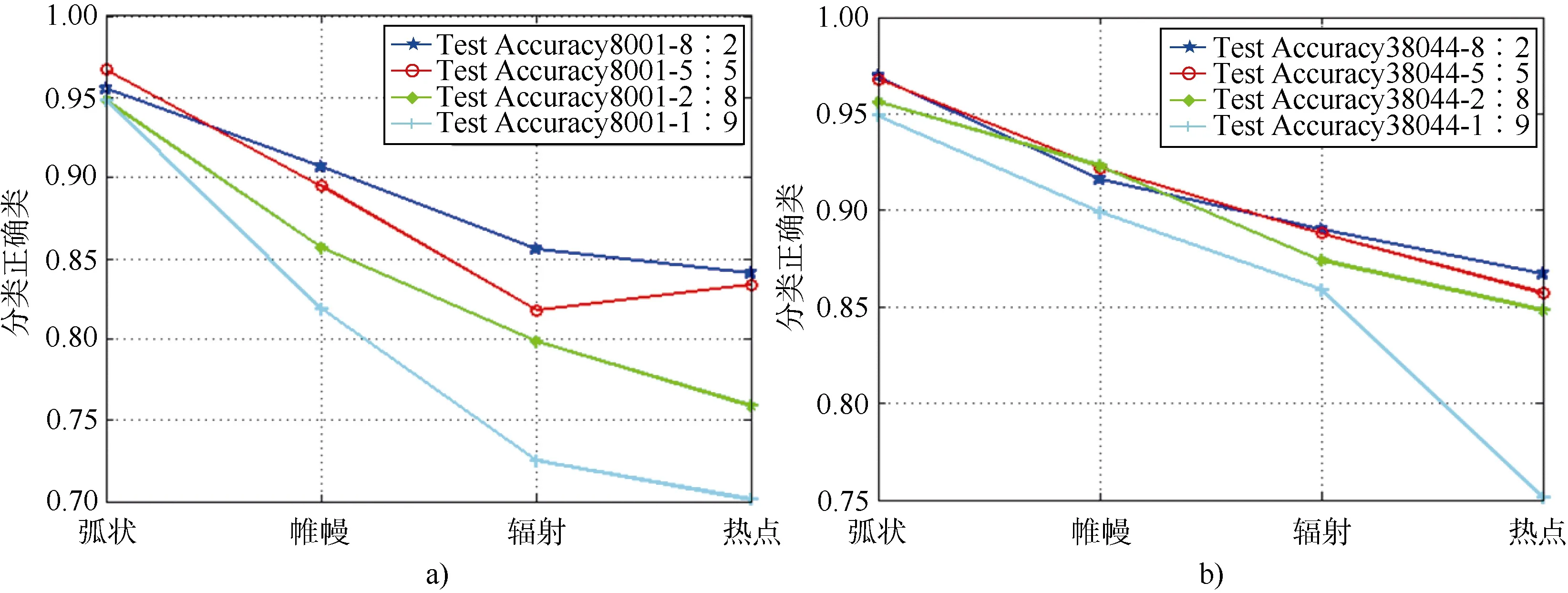

结合图5所示4种极光类型的分类正确率, 弧状的正确率最高, 辐射冕状和热点状的极光图像正确率较低。从极光形态特征上看弧状极光是东西向的条带状, 结构简单易于区分。相对而言, 热点极光呈现放射束状、点状和不规则块状的亮斑等多种形态,其形态比较复杂, 多种混合态难以区分辨别, 易导致网络出现分类偏差。从样本数量(表1)分析可能的原因是各类极光图像样本不均衡, 弧状极光样本数量远大于其他3类, 帷幔冕状数量次之, 热点状极光训练样本数量最少, 而当训练样本不够时, 深度网络未充分学习到图像特征从而降低了分类正确率。

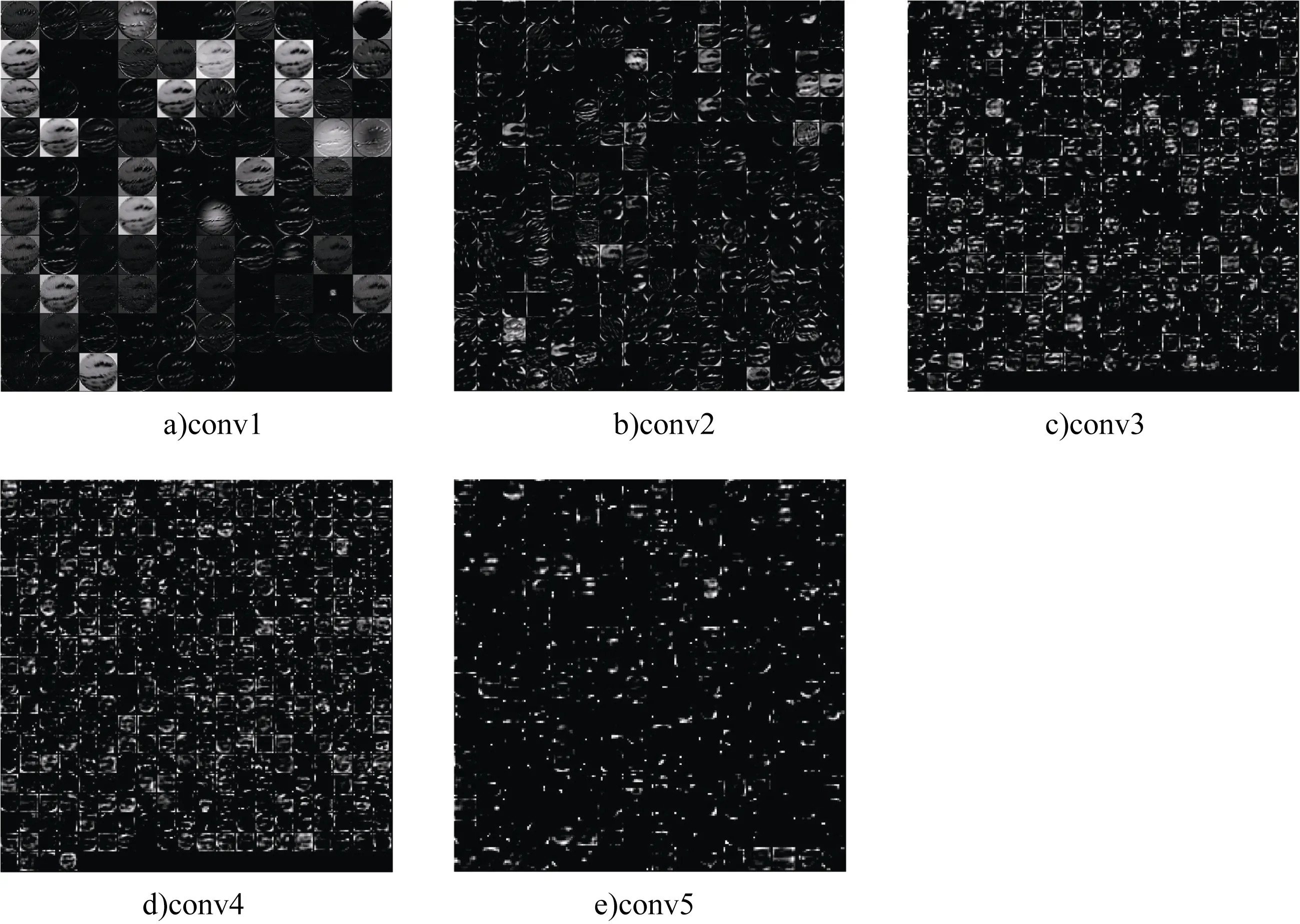

图6的a—e图为卷积层(Convolutional Layer,conv) conv1—conv5响应特征图, 从图中可以看出每个卷积层提取的特征各不相同。图6a中能看到清晰的极光轮廓, 这一层特征是以全局为主,每张小图代表一个卷积核, conv1层响应由96个卷积特征图构成。当网络层数加深, 极光轮廓模糊特征细化, 筛选出更抽象的局部特征。这种从低层全局特征到高层局部抽象特征的提取方式对样本具有很好的分辨能力。

图5 4种形态极光分类正确率曲线. a)数据集1, b)数据集2Fig.5. The test accuracy rate curve of four types of aurora. a)dataset1, b)dataset2

图6 卷积层响应特征图Fig.6. The convolutional layer response feature map

3 2004—2009年黄河站越冬观测ASI极光图像类型分布规律

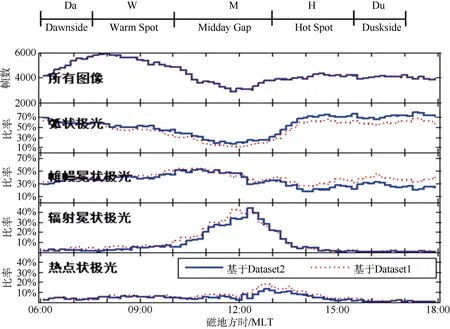

上述分类实验所用数据集dataset1来自同一年的越冬数据, 为了探究每一种类型极光发生的分布规律, 排除同一年份上极光观测图像的过拟合因素。采用半监督的方式, 分别使用2003年越冬观测19 d中确定类型的38 044幅极光数据(dataset2)和从中抽取的8 001幅典型极光数据(dataset1)训练好的权重参数模型对2004—2009年中5年的越冬观测数据(dataset3)进行预测。按时间区域划分, 统计各个时段10 min内发生的极光类型及其占该时段发生极光总数的比例。以下分别是两个数据集预测出的极光发生时间和类型的分布规律图。

Hu等[27]在557.7 nm波段极光观测中表明日侧极光主要分布在5个活动区, 即黎明区(Da,06:00—07:30 MLT)、午前(W, 07:30—10:00 MLT)、正午间隙区(M, 10:00—13:00 MLT)、午后(H, 13:00—15:30 MLT)、黄昏侧(Du, 15:30—17:00 MLT)。在图7中, 第一行为4个类型所有图像在极光卵不同区域的的分布图, 日侧极光分布呈现双峰结构,即上午09:00 MLT和下午15:00 MLT高峰[28]。后4行为各类极光分布规律: (1)从图中可以看到M区极光图像的数量最少, 符合卫星观测所谓正午空白区, 由于该区内极光强度较弱, 图像主要分布在午前和午后; (2)弧状极光的发生率最高, 主要分布在午后, 正午发生率最低, 是午前午后不对称双峰分界点; (3)辐射冕状极光的峰值集中在正午附近, 分布在M区的帷幔冕状极光发生率较高;(4)热点极光的整体发生率较低, 主要集中在午后;午前极光形态由较宽的弧状极光向冕状极光演变;午后极光形态表现为冕状极光向较窄的极光弧的演变; 黄昏侧各类极光的分布比较平稳。以上分布规律与胡泽骏等[2]在黄河站极光观测规律吻合。

图7 极光类型分布规律(基于2003—2009年的数据集1和数据集2)Fig.7. The auroral type distribution based on dataset1 and dataset2 from 2003 to 2009

对比本文基于数据集dataset1和dataset2所预测的极光类型分布规律, 两个数据集对未知图像的预测的结果基本一致, 在各个类型的极光分布上有些许差别, 主要的偏差来源于午后对弧状和冕状的划分上。这是由于这一阶段处于弧状和冕状的过渡阶段, 形态划分的界限比较模糊, 数据集dataset2更大, 在训练阶段进行了更充分的学习,相对dataset1在极光的连续性上更好, 能充分提取极光变化的动态特征。总体来讲, 两个数据集对极光分布规律的预测与文献[12]的结论一致。

4 结论与展望

基于深度学习算法本文提出了一种用卷积神经网络模型自动提取极光形态特征、用Softmax分类器对极光图像进行自动分类的极光图像分类方法, 实验中将分类器输出的分类结果与人工标记分类标记进行了验证。由于极光形态复杂, 特征动态多变, 针对极光识别这一问题,目前尚未有明确的极光分类机制。本文所用卷积神经网络采用的是有监督分类机制、监督学习样本中包含标签和特征等先验知识、能预先确定分类的类别。相对于无监督学习, 有监督分类机制样本可控, 通过反复训练样本, 提高分类精度[29]。本文样本标签来源于文献[13]的分类机制。将实验中得到的分类结果与样本标签对比, 正确率与现有结论十分接近, 验证了此次实验特征提取方法的有效性。

不足之处在于本文的分类机制对于形态复杂的热点极光的分类性能较差, 由于深度学习算法需要大量的训练数据, 少量数据无法将网络参数训练充分。如何对少量的数据进行数据增强来扩充训练样本以及采用多尺度特征融合来提高极光的分类正确率是下一步需要研究的问题。

1 胡红桥, 刘瑞源, 王敬芳, 等. 南极中山站极光形态的统计特征[J]. 极地研究, 1999, 11(1): 11—21.

2 胡泽骏, 杨惠根, 艾勇, 等. 日侧极光卵的可见光多波段观测特征——中国北极黄河站首次极光观测初步分析[J]. 极地研究,2005, 17(2): 107—114.

3 AKASOFU S I. The development of the auroral substorm[J]. Planetary and Space Science, 1964, 12(4): 273—282.

4 MENG C I, LUNDIN R. Auroral morphology of the midday oval[J]. Journal of Geophysical Research: Space Physics, 1986, 91(A2):1572—1584.

5 PARTAMIES N, JUUSOLA L, WHITER D, et al. Substorm evolution of auroral structures[J]. Journal of Geophysical Research: Space Physics, 2015, 120(7): 5958—5972.

6 SYRJÄSUO M T, KAURISTIE K, PULKKINEN T I. A search engine for auroral forms[J]. Advances in Space Research, 2001, 28(11):1611—1616.

7 SYRJÄSUO M T, DONOVAN E F. Diurnal auroral occurrence statistics obtained via machine vision[J]. Annales Geophysicae, 2004,22(4): 1103—1113.

8 王倩. 日侧全天空极光图像分类及动态过程分析方法研究[D]. 西安: 西安电子科技大学, 2011: 1—43.

9 韩冰, 杨辰, 高新波. 融合显著信息的LDA极光图像分类[J]. 软件学报, 2013, 24(11): 2758—2766.

10 SYRJÄSUO M, PARTAMIES N. Numeric image features for detection of aurora[J]. IEEE Geoscience and Remote Sensing Letters,2012, 9(2): 176—179.

11 RAO J, PARTAMIES N, AMARIUTEI O, et al. Automatic auroral detection in color all-sky camera images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(12): 4717—4725.

12 杨秋菊, 胡泽骏. 一种基于形态特征的极光自动分类方法[J]. 中国科学: 地球科学, 2017, 47(2): 252—260.

13 HU Z J, YANG H, HUANG D, et al. Synoptic distribution of dayside aurora: Multiple-wavelength all-sky observation at Yellow River Station in Ny-Ålesund, Svalbard[J]. Journal of Atmospheric and Solar-Terrestrial Physics, 2009, 71(8-9): 794—804.

14 KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 26th Annual Conference on Neural Information Processing Systems 2012. Lake Tahoe, Nevada, USA: Neural Information Processing Systems 2012: 1097—1105.

15 SILVER D, HUANG A, MADDISON C J, et al. Mastering the game of Go with deep neural networks and tree search[J]. Nature, 2016,529(7587): 484—489.

16 LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521(7553): 436—444.

17 ZEILER M D, FERGUS R. Visualizing and understanding convolutional networks[C]//Proceedings of the 13th European Conference on Computer Vision. Cham: Springer, 2014: 818—833.

18 ABRAHAM T H. (Physio)logical circuits: the intellectual origins of the McCulloch-Pitts neural networks[J]. Journal of the History of the Behavioral Sciences, 2002, 38(1): 3—25.

19 周志华. 机器学习[M]. 北京: 清华大学出版社, 2016: 99—98.

20 FUKUSHIMA K. Neocognitron: A self-organizing neural network model for a mechanism of pattern recognition unaffected by shift in position[J]. Biological Cybernetics, 1980, 36(4): 193—202.

21 LECUN Y, KAVUKCUOGLU K, FARABET C. Convolutional networks and applications in vision[C]//Proceedings of IEEE International Symposium on Circuits and Systems. Paris, France: IEEE, 2010: 253—256.

22 AYTAR Y, ZISSERMAN A. Tabula rasa: Model transfer for object category detection[C]//Proceedings of International Conference on Computer Vision. Barcelona, Spain: IEEE, 2011: 2252—2259.

23 BOUREAU Y L, BACH F, LECUN Y, et al. Learning mid-level features for recognition[C]//Proceedings of IEEE Computer Society Conference on Computer Vision and Pattern Recognition. San Francisco, CA, USA: IEEE, 2010: 2559—2566.

24 王华利, 邹俊忠, 张见, 等. 基于深度卷积神经网络的快速图像分类算法[J]. 计算机工程与应用, 2017, 53(13): 181—188.

25 付秀丽, 黎玲萍, 毛克彪, 等. 基于卷积神经网络模型的遥感图像分类[J]. 高技术通讯, 2017, 27(3): 203—212.

26 SRIVASTAVA N, HINTON G, KRIZHEVSKY A, et al. Dropout: a simple way to prevent neural networks from overfitting[J]. The Journal of Machine Learning Research, 2014, 15: 1929—1958.

27 HU Z J, YANG H G, HAN D S, et al. Dayside auroral emissions controlled by IMF: A survey for dayside auroral excitation at 557.7 and 630.0 nm in Ny-Ålesund, Svalbard[J]. Journal of Geophysical Research: Space Physics, 2012, 117(A2): A02201.

28 HU Z J, EBIHARA Y, YANG H G, et al. Hemispheric asymmetry of the structure of dayside auroral oval[J]. Geophysical Research Letters, 2014, 41(24): 8696—8703.

29 GOODFELLOW I, BENGIO Y, COURVILLE A. 深度学习[M]. 赵申剑, 黎彧君, 符天凡, 等译. 北京: 人民邮电出版社, 2017: 88—91.