交通视频的移动目标检测算法研究

黄金海 梁晓梅 桂邦豪

关键词: 背景差分; 帧间差分; 混合高斯模型; 移动目标检测; 动态阈值; 交通视频

中图分类号: TN911.73?34; TP391 文献标识码: A 文章编号: 1004?373X(2019)05?0053?04

Research on moving target detection algorithm for traffic video

HUANG Jinhai, LIANG Xiaomei, GUI Banghao

(Institute of Information Technology of GUET, Guilin 541004, China)

Abstract: It is a key technology for target identification and tracking monitoring of video sequence in the field of computer vision. A fusion method of inter?frame difference and Gaussian mixture background model is proposed on the basis of hotspot algorithm of image processing and target detection research directions, which is applied to the target tracking analysis of moving vehicle in traffic video. The algorithm can solve the dynamic threshold range influenced by illumination by means of background subtraction. If the light detection threshold is smaller than the illumination dynamic threshold, the Gaussian mixture background model is selected, otherwise the inter?frame difference is selected. The target can be accurately described by the opening operation, closed operation, connected domain calculation, and convex hull morphological operation of the region. The experimental results show that the fusion algorithm can eliminate the ghost phenomenon, and can be effectively applied to the target detection of moving vehicles in traffic video under the condition of illumination improvement.

Keywords: background difference; inter?frame difference; Gaussian mixture model; moving target detection; dynamic threshold; traffic video

0 引 言

视频监控已经普遍应用于各个公共场所,为进一步减轻管理人员的工作量,可以利用计算机视觉技术,自动对监控目标进行分析,则管理人员可对分析结果進行快速决策。例如,对城市道路上高峰时间段的交通视频进行车流分析,可方便车主提前知晓实时路况,并做出适当选择。目前,在静止摄像机的运动目标检测和分析研究中,常用的实现方法有背景差分法[1]、帧间差分法[2]、光流法[3?4]、ViBe以及改进的ViBe[5?7]算法等。帧间差分法算法简单,不易受光线影响,常与背景差分法融合计算,与单一的帧间差分法比较,克服了离散噪声的干扰。文献[3?4]采用未改进的光流法对运动目标进行检测,由于算法迭代运算量大,不适用于实时性环境要求较高的场合。文献[5?7]描述的ViBe背景提取算法,该算法处理检测到的背景突然明显变化的情况,容易形成鬼影。为解决动态背景被误检,改进ViBe算法则具有较高的鲁棒性,动态适应性较好,改进的ViBe算法相对未改进的ViBe算法应用于摄像机抖动情况下有良好的适应性。

本文根据上述目标识别检测算法的优缺点,针对交通视频监控的移动车辆的目标检测,提出帧间差分与混合高斯背景模型的融合算法[8]。该算法首先计算视频帧图像的动态阈值,根据阈值大小选择相应的帧间差分或者混合高斯背景模型进行运算,提取出目标和背景;然后对目标图像进行相应的开运算、闭运算、连通域计算和区域的凸包计算,即可完成对目标的识别和检测。本文算法设计流程如图1所示。

1 算法分析

1.1 视频序列帧提取

计算机通过API接口读取视频,从视频中读取帧图像,并通过彩色(RGB)到灰度图(GRAY)运算,完成视频图片的预处理过程。

1.2 背景动态阈值算法

光照的动态阈值[9]根据提取视频序列当前帧与背景帧图像进行动态背景差分运算,表达式为:

[R(i,j)=F(i,j)-B(i,j)] (1)

式中:[F(i,j)]表示前景图像;[B(i,j)]表示背景图像;对[R(i,j)]进行二值化,有:

[R(i,j)=1, Fi,j-Bi,j>T0, Fi,j-Bi,j≤T ] (2)

式中:[T]表示设定的灰度阈值;[R(i,j)]=1表示检测到目标。但仅靠式(2)的理论计算还是难以检测到有效目标,由于光照的影响,随时可能误判目标。考虑光线环境影响的因素,这里提出动态阈值[ΔT],即在原灰度阈值[T]的基础上增加[ΔT]项:

[ΔT=φ?1M×Ni=0N-1 j=0M-1F(i,j)-B(i,j)] (3)

式中:[φ]表示参考抑制系数,可根据实际情况将其设定为某个值,通常取值2;[M×N]表示视频帧图像尺寸大小。则改进的[R(i,j)]表达式为:

[R(i,j)=1, F(i,j)-B(i,j)>T+ΔT0, F(i,j)-B(i,j)≤T+ΔT] (4)

如果光照变化不明显,则[ΔT]很小,最终阈值变化不大。因此,引入动态阈值[ΔT]就可以判断下一步采用帧间差分法还是混合高斯背景模型法。设定一个最大动态阈值[ΔTmax],若[ΔT]>[ΔTmax]则采用帧间差分法,反之,采用混合高斯背景模型法。

1.3 帧间差分法

帧间差分法的优势是对光照变化不敏感,与上述背景差分有相似之处,都是对视频序列连续帧进行处理,背景差分是采样前几帧图像作为背景帧与当前帧求差分,而帧间差分采用连续三帧图像进行运算,可以减轻鬼影和空洞现象[10]。算法步骤如下:

1) 取视频序列连续三帧图像[Gk-1,Gk,Gk+1],分别对相邻两帧图像进行差分运算得到[Rk,Rk+1]:

[Rk(i, j)=Gk(i, j)-Gk-1(i, j)] (5)

[Rk+1(i, j)=Gk+1(i, j)-Gk(i, j)] (6)

2) 根据动态阈值[T+ΔT]对[Rk,Rk+1]进行二值化:

[Rk(i, j)=1, Rk(i, j)∩Rk+1(i, j)=1 0, 其他] (7)

由式(7)可知,对目标的确定需要两次连续二值化,确定都为1的目标后,才最终确定为目标。

1.4 混合高斯背景模型法

高斯背景需要在光照變化不敏感的情况下才能对视频背景序列采用混合高斯背景模型(Gaussian Mixture Model,GMM)建模[11],该模型对视频帧图像的某个像素点采用[k](3~5)个高斯分布描述,设某像素点[I(x0,y0)]在[t(t>1)]时刻内值的数学表达式为:

[x1,x2,…,xt=Ix0,y0,i:1 根据式(8)建立的观测值,[xt]的概率密度函数[p(x)]的[k]个混合高斯分布加权表达式为: [p(x)=i=0kωi,t?η(xt,μi,t,Σi,t)] (9) 式中:[ωi,t],[μi,t]和[Σi,t]分别表示[t]时刻混合高斯分布模型的第[i]个权值[i=1kωi,t=1]、均值和协方差矩阵;[η(xt,μi,t,Σi,t)]为高斯概率密度函数: [ηxt,μi,t,Σi,t=1(2π)n2Σi,t12?exp-(xt-μi,t)T2i,t(xt-μi,t)] (10) 式中:协方差矩阵[Σi,t=σ2tI]([I]为单位阵)。当[t+1]时刻观测值到来,像素点[xt+1]需要根据匹配规则判断其是否与已经存在的高斯分布相匹配,如果匹配,则该像素点为背景点[7]。该匹配规则为: [xt+1-μi,t 式中:[c]为参考系数,一般取2.5;[σi,t]为[t]时刻第[i]个高斯分布标准偏差。当像素点满足匹配规则后,会影响原来的概率分布,故需要更新高斯分布的相匹配像素点的均值、方差和权值,更新表达式为: [μi,t=1-αμk,t+αxt] (12) [σ2i,t=1-αμ2i,t-1+α(xt-μi,t)T(xt-μi,t)] (13) [ωi,t=1-ρωi,t-1+ρMi,t, i=1,2,…,k] (14) 式中:[α]为背景更新率;[ρ]为学习率。这两个参数均由实验调试的最佳效果确定。当第[i]个高斯分布与模型匹配时,[Mi,t]取值1,其余[k-1]个情况下[Mi,t]取值为0。为了取得可靠的背景模型,还需要对第[i]个像素的高斯分布权值以[ωi,tσ]做降序排列,[σ]的选取需设定下限值[σmin]。当[σ2i,t>σ2min],取实际值[σi,t];当[σ2i,t≤σ2min],取下限值[σmin]。经过降序排列的权值,取优先级较高的前[b]个作为描述稳定背景的高斯分布,[b]的选取根据经验表达式[b=argmini=1bωi,t>0.85]得到。由此可知,当像素点的值[xt]与前[b]个高斯分布背景匹配时,是背景点,否则为目标点。 1.5 形态学运算 通过前述运算,可以提取到需要跟踪的目标。另外,为了直观显示跟踪目标对象,还需要对目标进行相应的形态学运算才能在视频序列中准确描述目标。形态学运算包括先腐蚀后膨胀的开运算、先膨胀后腐蚀的闭运算、相关连通域的计算以及区域的凸包运算。

2 实验测试分析

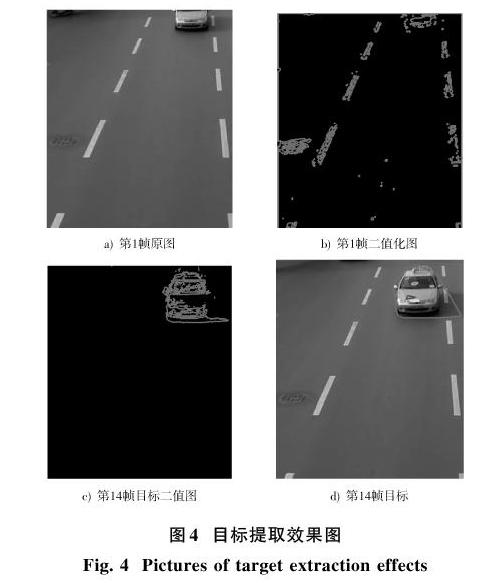

本文选取一段交通视频来测试对移动车辆的识别检测,在Visual Studio+Open cv环境下进行测试,调用API接口采集视频帧图像。为方便结果演示和分析,实验中取连续帧图像的测试效果并不明显,因此取视频中第1帧和第14帧图像进行测试,测试动态阈值[ΔTmax]取值3~11,当[ΔTmax]设置较小时,选择帧间差分法,测试目标检测效果如图2所示。[ΔTmax]设置较大时,选择混合高斯背景模型法,该算法需完成混合高斯背景建模后,提取出目标像素点再进行形态学处理,两部分测试效果如图3,图4所示。

通过以上帧间图像测试可知,可根据动态阈值调节,选取相应的目标检测算法。当光照影响较大时采用帧间差分法,当光照影响较小时,采用混合高斯背景模型法。

3 结 语

本文通过详细论述动态阈值、背景差分、帧间差分、混合高斯背景模型等运算过程,并通过实验测试有效消除了鬼影现象,其效果对环境要求较高,仍存在一定应用局限性。若对环境进行预处理改善后,该方法可有效应用于视频序列目标检测,也为工程技术人员快速解决类似的移动目标检测提供思路。

参考文献

[1] 袁益琴,何国金,王桂周,等.背景差分与帧间差分相融合的遥感卫星视频运动车辆检测方法[J].中国科学院大学学报,2018,35(1):50?58.

YUAN Y Q, HE G J, WANG G Z, et al. A background subtraction and frame subtraction combined method for moving vehicle detection in satellite video data [J]. Journal of University of Chinese Academy of Sciences, 2018, 35(1): 50?58.

[2] OHTA N. A statistical approach to background substraction for surveillance systems [C]// Proceedings of the Eighth IEEE International Conference on Computer Vision. Vancouver: IEEE, 2001: 481?486.

[3] 屈治华,邵毅明,邓天民.基于特征光流的多运动目标检测跟踪算法与评价[J].科学技术与工程,2018,18(22):97?104.

QU Zhihua, SHAO Yiming, DENG Tianmin. Multi?objective detection and tracking algorithm based on feature optical flow and its evaluation [J]. Science technology and engineering, 2018, 18(22): 97?104.

[4] 谢红,原博,解武.LK光流法和三帧差分法的运动目标检测算法[J].应用科技,2016,43(3):23?27.

XIE Hong, YUAN Bo, XIE Wu. Moving target detection algorithm based on LK optical flow and three?frame differences [J]. Applied science and technology, 2016, 43(3): 23?27.

[5] VAN DROOGENBROECK M, PAQUOT O. Background subtraction: experiments and improvements for ViBe [C]// 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops. Providence: IEEE, 2012: 32?37.

[6] 杨依忠,张强,汪鹏飞.基于改进ViBe算法与三帧差法的运动检测算法[J].合肥工业大学学报(自然科学版),2018,41(8):1052?1058.

YANG Yizhong, ZHANG Qiang, WANG Pengfei. A novel mo?ving objects detection algorithm based on improved ViBe and three?frame differencing algorithm [J]. Journal of Hefei University of Technology (natural science edition), 2018, 41(8): 1052?1058.

[7] 王旭,刘毅,李国燕.基于改进ViBe算法的运动目标检测方法[J].激光与光电子学进展,2017,37(2):99?102.

WANG Xu, LIU Yi, LI Guoyan. Moving object detection algorithm based on improved visual background extractor [J]. Laser & optoelectronics progress, 2017, 37(2): 99?102.

[8] 李晓瑜,马大中,付英杰.基于三帧差分混合高斯背景模型运动目标检测[J].吉林大学学报(信息科学版),2018,36(4):414?422.

LI Xiaoyu, MA Dazhong, FU Yingjie. Moving object detection using mixed Gauss background model based on three frame differencing [J]. Journal of Jilin University (information science edition), 2018, 36(4): 414?422.

[9] 陈凤东,洪炳镕.基于动态阈值背景差分算法的目标检测方法[J].哈尔滨工业大学学报,2005,37(7):883?884.

CHEN Fengdong, HONG Bingrong. Object detecting method based on background image difference using dynamic threshold [J]. Journal of Harbin Institute of Technology, 2005, 37(7): 883?884.

[10] 孙挺,齐迎春,耿国华.基于帧间差分和背景差分的运动目标检测算法[J].吉林大学学报(工学版),2016,46(4):1325?1329.

SUN Ting, QI Yingchun, GENG Guohua. Moving object detection algorithm based on frame difference and background subtraction [J]. Journal of Jilin University (engineering and technology edition), 2016, 46(4): 1325?1329.

[11] 卢章平,孔德飞,李小蕾,等.背景差分与三帧差分结合的运动目标检测算法[J].计算机测量与控制,2013,21(12):3315?3318.

LU Zhangping, KONG Defei, LI Xiaolei, et al. A method for moving object detection based on background subtraction and three?frame differencing [J]. Computer measurement & control, 2013, 21(12): 3315?3318.