基于Mask R-CNN网络模型的无人驾驶感知

刘俊生

基于Mask R-CNN网络模型的无人驾驶感知

刘俊生

(重庆理工大学车辆工程学院,重庆 400054)

近几年深度学习技术在图像检测方面的应用取得了极大的突破,利用卷积神经网络模型可高效且准确的识别目标。一种开源网络模型——Mask R-CNN,被用于无人驾驶感知检测,取得了较好的检测效果。为了进一步提高检测精度,提出迁移学习方法重新训练网络,使得网络更适用于无人驾驶领域的感知任务。

深度学习;卷积神经网络;Mask R-CNN;目标检测

前言

随着计算资源的增加和大数据的出现,基于深度学习的目标检测开始崭露头角。该技术里程碑式的进展出现在2012年,Krizhevsky[1]提出了基于卷积神经网络的图像分类。此后大量关于图像分类、目标检测的网络模型都是基于该基础模型的扩充、完善,不断演化而来的。比如基础模型有VGG[2], GoogleNet[3], ResNet[4]等,兼具精度与实时性的模型有SSD[5],YOLO[6]等。这些算法的提出与不断改进使得无人车技术的实现又向前迈进了一大步[7]。

1 Mask R-CNN

Mask R-CNN网络模型基于Faster R-CNN模型扩展了一个与现有目标检测和回归并行的分支——预测目标掩码分支。该网络有三个分支:类别标签分支、检测框回归分支、掩码分支。其中类别标签和检测框回归分支沿用的Faster R-CNN,而掩码分支等效FCN网络作用于每个感兴趣区域(RoI),并预测RoI的像素级的分割掩码。

该网络由Facebook AI 研究院(FAIR)发布开源于网上,供全世界研究人员方便开发应用于专用领域。根据其开源项目的介绍,配置计算机环境,下载软件平台——Detectron,就能调用网络进行具体的目标检测任务。

但该网络由COCO数据集训练而来,共可检测81种常规类别,其中背景算为1类。这大大多于无人驾驶所需检测识别的分类。因此直接调用模型,会出现一定量的误检情况。

2 迁移学习

为了使Mask R-CNN网络模型更适用于无人驾驶专用领域,可采用迁移学习重新训练网络。理论上,重新训练的网络能提高识别精度,减少误检率。

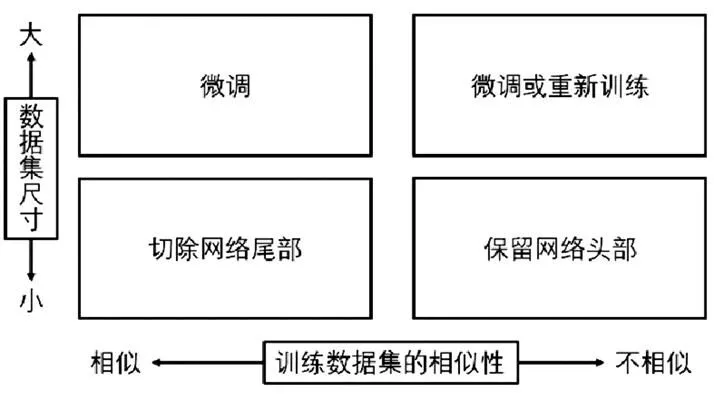

迁移学习采用哪种训练方式依赖于两点:新数据集的大小与新数据集与原始数据集的相似性。根据情况,使用迁移学习的方法会略有不同。主要有4种情况,分别为新数据集小,且与原始数据集相似;新数据集小,但不同于原始数据集;新数据集大,且相似于原始数据集;新数据集大,但不同于原始数据集。

图1 迁移学习训练策略分析图

对于数据集尺寸来说,大的数据集可能有一百万张图片,小的数据集可能2000张。当使用小数据集来进行迁移学习时,要注意避免过拟合。为了适应无人驾驶场景的应用,本文在网上下载了一批开源数据,这批数据是针对公路场景的。对于数据集相似性来说,一般认为狗的图片和狐狸的图片相似,他们共享通用特征。而花的图片就不同于狗的图片。显然,无人驾驶感知任务所要识别的类别已包含于COCO数据集所拥有的类别,因此数据集相似。

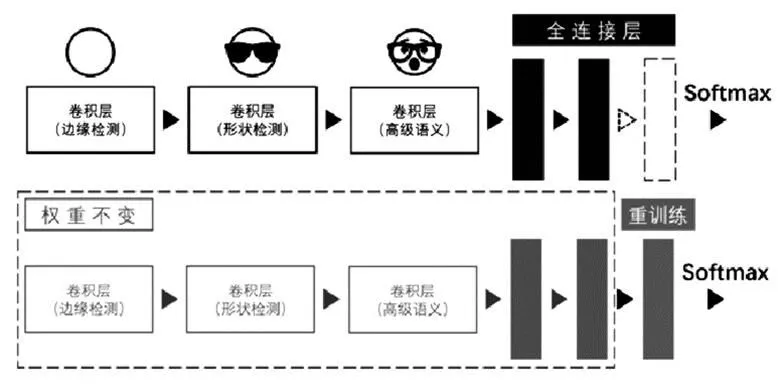

本文属于上述情况一——数据小且相似,因此根据图1所示,选择切除通用模型的全连接尾部,用下载好的图片重新训练网络,如图2所示。

图2 网络模型重训练方案

切掉神经网络的尾部,即全连接层,然后增加一个新的全连接层,并匹配新数据集的类别数量。接着随机初始化全连接层的权重,为了避免小数据集带来的过拟合问题,需要冻住预训练网络的权重。最后重新训练网络,更新新的全连接层的权重。

3 测试

为了验证网络模型的效果,本文自行采集了一批数据,并从中挑选几种较为典型的工况进行算法验证,共检测了2346张图像。

为了比较通用模型与重新训练的模型的差别,本文先后用同一批数据测试了这两个模型。效果如图3所示。

图3 最终测试结果个例及对比(Mask R-CNN+表示重训练模型)

图3例举了个别测试结果,并对比了原模型与重训练模型的效果。其中原模型检测时存在明显漏检的图片有122张,即这批数据的漏检率达到了5%。采用重新训练的模型再次检测上述122张漏检的图片后发现,成功去除了其中的92张,即该批数据漏检率下降到1.3%。

4 结论

深度学习技术展现出了强大的性能,使得越来越多的研究者将这个技术引入更多的领域解决更多的具体问题,如无人驾驶中的环境感知、决策等。本文采用Mask R-CNN网络模型检测图像,为了提高检测精度,采用迁移学习的方法重新训练了网络,并用自己采集的图像进行检测,取得了不错的效果。

[1] A. Krizhevsky, I. Sutskever, and G. E. Hinton, “Imagenet classifica -tion with deep convolutional neural networks,” in Proc. Advances in Neural Information Processing Systems, 2012.

[2] K. Simonyan and A. Zisserman, “Very deep convolutional networks for large-scale image recognition,” in Proc. International Conf. Lear -ning Representations, 2015.

[3] C. Szegedy, W. Liu, Y. Q. Jia, P. Sermanet, S. Reed, D. Anguelov, etc. Going Deeper with Convolutions. Computer Vision and Pattern Recognition. 2014

[4] K. He, X. Zhang, S. Ren, and J. Sun, “Deep residual learning for image recognition,” in Proc. IEEE Conf. Computer Vis. Pattern Recognition, 2016.

[5] W. Liu, D. Anguelov, D. Erhan, C. Szegedy, S. Reed, C. Fu, and A. Berg, “Ssd: Single shot multibox detector,” in Proc. European Conf. Computer Vision, 2016.

[6] J. Redmon, S. Divvala, R. Girshick, A. Farhadi. “You Only Look Once: Unified, Real-Time Object Detectrion” 2015.

[7] 张新钰,高洪波,赵建辉,周沫.基于深度学习的自动驾驶技术综述[J].清华大学学报(自然科学版),2018,58(04):438-444.

Perception of Unmanned Driving Based on Mask R-CNN

Liu Junsheng

(School of vehicle engineering, Chongqing university of technology, Chongqing 400054)

In recent years, the application of deep learning technology in image detection has made great breakthroughs. The Convolutional Neural Network(CNN) model can be used to identify targets efficiently and accurately. An open source model——Mask R-CNN, is used for environment detection and has achieved good detection results. In order to further improve the detection accuracy, a method named transfer learning is proposed to retrain the network, making the network more suitable for the perceptive task in the unmanned driving field.

Deep Learning;CNN;Mask R-CNN;Detection

U462.3

A

1671-7988(2019)07-39-02

刘俊生(1993-),重庆理工大学车辆工程学院,硕士研究生,研究方向汽车主动安全。

U462.3

A

1671-7988(2019)07-39-02

10.16638/j.cnki.1671-7988.2019.07.012