基于图像的昆虫分类识别研究综述

姚侃 徐鹏 张广群 汪杭军

摘 要:近年来,在自动化识别昆虫技术中,基于图像的昆虫分类识别研究逐渐发展起来。本文在查阅了近20年来具有代表性文章的基础上,对基于图像的昆虫分类识别研究的进展进行综述,介绍了图像获取、图像处理、分类方法三方面,并分析了现有方法的优缺点。最后展望了基于图像的昆虫分类识别研究的研究趋势和发展方向。

关键词: 图像分割; 昆虫分类; 特征提取; 分类识别

文章编号: 2095-2163(2019)03-0029-07 中图分类号: TP391.41 文献标志码: A

0 引 言

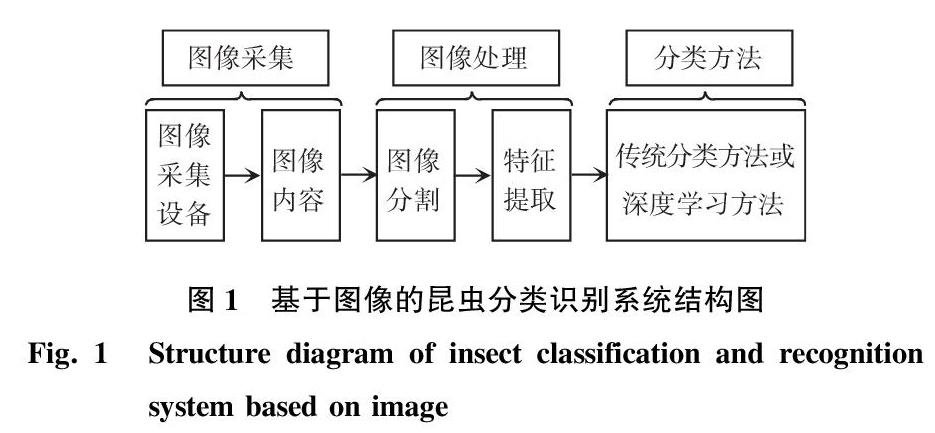

昆虫是动物界中种类最多,数量最大,分布最广,适应能力甚强,与人类关系极为密切的一类动物。迄今发现的昆虫有120多万种,占整个动物界种类的80% 左右[1]。更为重要的是,现在大部分农业和林业上的害虫属于昆虫,昆虫识别是昆虫研究和害虫防治的基础。传统的昆虫识别是通过分类学专家或具有昆虫分类知识的技术人员对昆虫进行种类的鉴定,但现有的分类学专家和掌握分类的技术人员无论在分布、或者在数目上均难于满足时下正呈现扩大倾向的各类实际场景需求。近年来,信息技术的快速发展,以计算机代替人脑进行判别的方法成为了可能。以计算机为基础的自动识别方法,可以采用最常见的数据形式—图像。采集的昆虫图像经过系统处理,进一步由图像分类系统进行分类。采集图像的方法不同,采获的图像也存在差别,不同的图像需要不同的图像处理和分类方法。因此,本次综述拟分如下3点来展开分析:图像获取、图像处理和分类方法。其中,图像获取包括图像获取的环境和设备,以及图像的内容(见本文第1节)。图像处理包括从图像中获取感兴趣的区域,以及对分类有用的特征信息(见本文第2节)。分类方法中,分类、即是基于提取的信息进行识别的实际步骤,本次研究则分传统分类方法和深度学习方法两方面进行综述探讨(见本文第3节)。图1即展示了本次研究中各主题要点间的相互关系。

1 图像獲取

图像获取是昆虫分类研究的基础,图像的获取方法影响图像的处理方法以及识别分类的成功率。本节将讨论影响图像效果的图像获取的环境和设备,以及图像的内容。

1.1 图像获取的环境和设备

图像获取的环境多种多样,大体上本文将其分为2种,即:实验室环境和自然环境。相应地,实验室环境主要是采集昆虫样本后在实验室中进行图像采集,而自然环境主要是直接在自然环境下(比如:农田、树林、湖泊、诱虫装置等)进行图像采集。

1.1.1 实验室环境

研究指出,实验室环境也是未来昆虫识别研究的主要环境。实验室环境背景比较单一,有助于图像处理。且可以对昆虫的姿态详加规定,便于后续的算法设计和系统开发。但实验室环境要求比较高,比如:特定的装置、光照设备等,研究人员工作也相对繁重,比如:昆虫姿态的设置、图像采集设备的组装等,且实验室环境下的昆虫一般都是在室外捕捉后带至实验室进行图像采集。采集方式可综合表述如下。

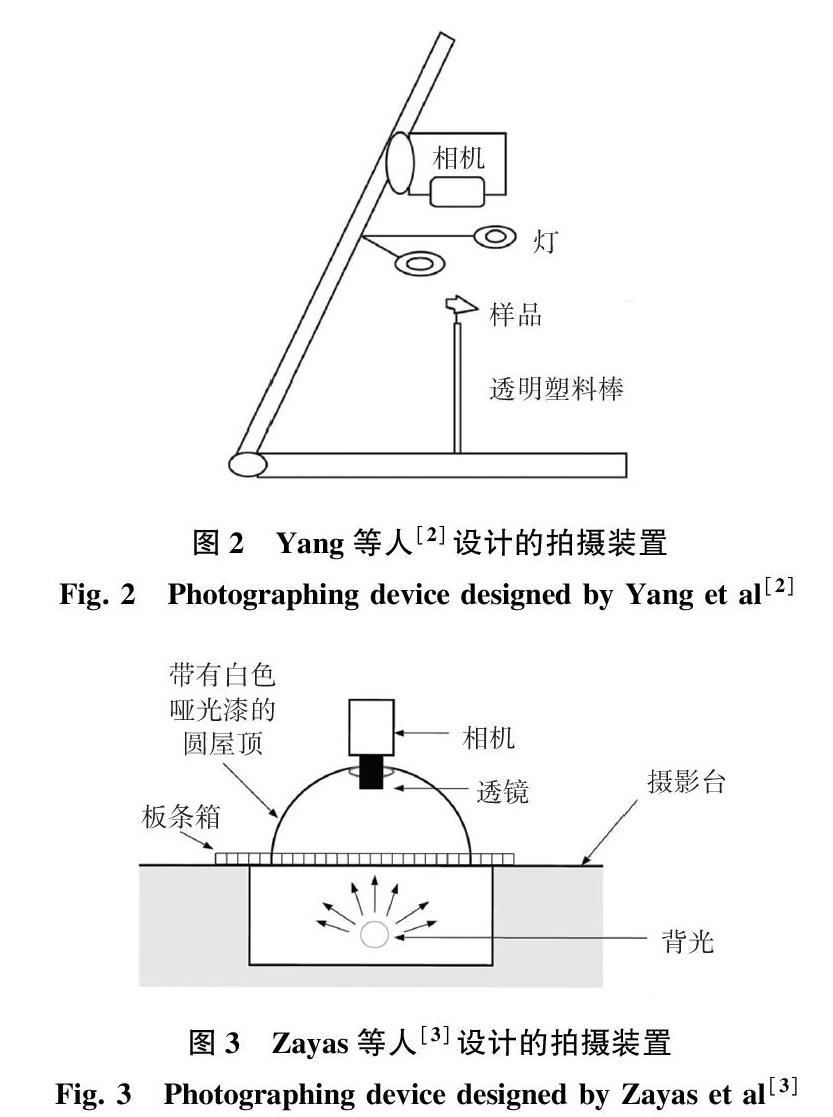

(1)相机拍摄。在实验室环境下拍摄的昆虫图像大都存在阴影,为了消除阴影,Yang等人[2]将一根透明塑料棒固定在白色泡沫板上,昆虫样本插在塑料棒远端,如图2所示。Zayas等人[3]采用被储粮害虫所污染的小麦,其中包含小麦籽粒、储粮害虫和草籽。将样品放置在一个箱子中,带有背光照明,在样品的上方放置了一个带有白色哑光漆的圆屋顶,相机则置于圆顶上面,如图3所示。分析可知,消除阴影即旨在减少拍摄过程中外界因素对昆虫图像质量的影响,而为了获取更多的昆虫图像特征,Yao等人[4]和吕军等人[5]把昆虫样本放置在一个透明玻璃板上,上下均架有一部相机,获得昆虫顶部和底部的照片。针对不同特征数据的采集,所需要的拍摄方法也有不同。杨红珍等人[6]建立了一套昆虫图像获取的标准。在获取昆虫形态特征数据时,图像采集主要采用标本底下加置透射光的方法;在获取昆虫的颜色或纹理特征数据时,应采用标本上方加置光源的方法,依靠反射光来获取标本正面的颜色与纹理信息。还有研究人员对在实验室环境中模拟出自然环境进行了研究,冼鼎翔等人[7]在封闭的恒定环境下,把灯诱昆虫自然跌落在白色背景平台上,尽可能使虫体不粘连,模拟出一个在灯诱状态下的昆虫形态,获取相对真实的灯诱状态下的昆虫图像。而邱道尹等人[8]通过在传送带上安装摄像机镜头进行图像采集,获取相对真实的在传送带上混有昆虫的图片。

(2)相机通过显微镜拍摄。直接通过相机拍摄昆虫,有些特征信息不是很明显。为了拍摄到需要的特征信息,Weeks等人[9]、Arbuckle等人[10]、Favre等人[11]通过显微镜拍摄昆虫某些细节或特殊部分,比如:翅膀等。Wen等人[12-13]将昆虫冷冻20 min,而后随机放置在一个白色平板上,从而获得不同的昆虫方向和2种姿势下(俯视图和侧视图)的图像。Larios等人[14]设计了一个复杂的图像采集装置,昆虫通过水流进入拍摄区域,然后形成漩涡使昆虫原地旋转,相机拍摄的每一张照片都通过一组镜子以90°的角度得到2幅图像。Sarpola等人[15]改进了Larios等人[14]的装置,采用2个摄像头来捕捉不同方向上的图像,其2个摄像头角度为90°。

1.1.2 自然环境

自然环境的图像采集没有固定的采集设备,可以由随身携带的手机、也可以采用数码相机进行采集,且以自然光作为主要光源。但自然环境的背景比较复杂,采集后图像处理任务要更加繁琐。且采集图像时昆虫的姿态比较多样化,增加了后续的算法设计和系统开发的难度。Yalcin等人[16]采集通过信息素陷阱捕获的昆虫,其背景是信息素陷阱的粘垫。Solissánchez等人[17]、杨信廷等人[18]采集图像的来源是黄色的粘性陷阱,如图4所示。为了采集更加真实的自然环境昆虫图像,Xie等人[19]、张永玲等人[20]直接在野外拍摄昆虫,其背景存在植物,即如图5所示。陈月华等人[21]为了更好地分割图像,采集的图像是一种带有害虫的叶片图像,另一种是纯叶片的图像。

1.2 图像内容

采集图像的内容会关系到后期图像处理的方法和分类的方法。其内容大致可分为昆虫要素和背景要素。一般来说,昆虫要素分为昆虫的数量多少和昆虫的种类多少。现在大部分的识别系统是以一张图像一只昆虫为基础。但也有以一张图像多种昆虫进行识别。文献[4-5,7,16-18,21-23]采集的图像就是多种昆虫集合在一张图像上,但其中的几种昆虫个体之间是不黏连的,而更为复杂的昆虫重叠图像对识别的影响也会更大,但这方面的研究到现在为止却依然少见。背景要素可分为简单背景和复杂背景。现在大多数采用简单背景,即一种颜色作为背景,例如:白色泡沫板[2]、白色背景平台[7]、白色平板[12-13]、透明玻璃板[4-5]等。单色作为背景的好处是便于分割图像。现在,复杂背景的研究也已引起了研究者的浓厚兴趣,例如:植物叶片[19-21]、其他干扰物[3,8]等。复杂背景大多是存在于自然环境中采集的图像里。

2 图像处理

图像处理是图像能否应用于识别的关键步骤,对最终的图像识别成功率也将产生决定性作用。本节研究主要立足于2个方面,即:图像分割(把感兴趣的昆虫从背景中分离出来)和特征提取(提取昆虫特征用于识别)。对此可做解析详述如下。

2.1 图像分割

图像分割是将图像分割成几个独特区域的过程,即从图像中分割出感兴趣的目标区域。但在某些情况下,图像又不需要进行分割[19,24-25]。这里将分别研究手工分割方法和自动分割方法,具体如下。

2.1.1 手工分割方法

手工分割方法是由用户自己来选择感兴趣的目标区域,文献[26-29]设计的系统,会向用户显示一个界面,可以让用户通过该界面来绘制感兴趣区域的轮廓。手工分割相对精确,但在很多时候也是一个耗时繁重的工作。

2.1.2 自动分割方法

考虑到手工分割方法费时费力,因此大部分分割方法均为自动分割方法。依赖于阈值的分割方法在处理昆虫图像时得到了最多应用。阈值可以由系统设定,也可以由用户输入。还有一种阈值的产生可以视其为是一个聚类问题,其中必须有2个或更多个区域[12,30-31]。Wen等人[12]、Faithpraise等人[30]使用k-means算法生成阈值。Mayo等人[31]使用迭代算法Isodata来生成阈值。除了阈值分割,还有其它的分割方法能够用于昆虫图像处理,Yalcin等人[16]使用了活动轮廓(Snake)模型,以简单的阈值掩码作为种子点获得更精确的分割效果。Yao等人[4]使用背景分割法来分割昆虫图像。但是自动化后的图像分割技术,有时候的分割并不齐全,还留有背景,或者分割的图像边缘也不完整,影响特征提取。图像自动分割技术尚有可观的待发展空间。

2.2 特征提取

特征提取是图像识别的关键点。特征是一个事物与另一个事物不同的地方,是用来区分2个事物的评判标准。研究可知,特征选择对图像识别成功率也将带来较大影响。在这里,研究参考文献[32]的特征分类标准(见图6),将特征分为3类,即:固定特征、中级特征和分级训练特征。对每类特征的研究分析可展开如下论述。

2.2.1 固定特征

固定特征是能够直接由特征提取器提取得到的,不需要再進一步训练的特征。以全局特征来进行昆虫识别是比较常见的识别方法。Arbuckle等人[10]以蜜蜂翅膀上的静脉以及其所包围的细胞为基础,生成数字特征向量。该文献认为翅膀上的静脉几乎都是指纹。Tofilski等人[33]也以翅膀静脉为基础,提取静脉坐标来生成翅膀图像,以此来作为特征。而Yang等人[2]用椭圆傅立叶系数重构翅膀轮廓,以翅膀轮廓作为特征进行识别。但以上方法只能用于特定昆虫,没有翅膀或甲壳类的昆虫将无法使用。Gassoumi等人[23]、Leow等人[34]从感兴趣区域的二进制图像的形状描述符中提取特征,测量面积、偏心率、长轴长度、短轴长度、周长、直径、长度、方向等。这些几何特征还是比较直观的。但是同时也会受昆虫姿态或拍摄角度等因素的限制,从而影响精确度。因此,Wang等人[28]舍弃了面积、周长、偏心度等参数,而是采用自己设定的一些参数,比如:头长度跟身体长度的比例等等。为了提高识别率,Hu矩(Hu)、椭圆傅立叶描述符(EFD)、径向距离函数(RDF)和本地二进制模式(LBP)这4个形状描述符已开始应用至各类研究中。Yalcin等人[16]使用了Hu矩(Hu)、椭圆傅立叶描述符(EFD)、径向距离函数(RDF)和本地二进制模式(LBP)提取特征,然后通过加权多数者,将基本特征的结果融合在一起,以获得后期的行为决策。单一特征在识别过程中抗干扰能力较差,很多研究人员开始应用多种类型特征来提高抗干扰能力。Wang 等人[29]在CBIR的基础上增加了一系列的形状、颜色和纹理特征,使蝴蝶图像识别达到了科的分类尺度。Yao等人[4]提取了每一种昆虫的颜色、形状和纹理特征,来描述整个昆虫。还有一些研究人员选用局部特征进行昆虫识别。Mayo等人[31]对图像进行预处理以检测昆虫的位置,然后测量全局颜色特征,最后,用补丁提取局部颜色特征。而文献[13-15,17,35-38]又提取了著名的SIFT(尺度不变特征变换)特征。Solissánchez等人[17]、Lytle等人[37]则提取SIFT特征直接匹配配对对象,以选票多少的形式来估计2幅图像的相似性。

2.2.2 中层特征

中层特征是由特征提取器提取的固定特征,再通过程序进行训练得到的特征。Weeks等人[9]应用数字自动识别系统(DAISI),通过采用主成分分析(PCA)方法获取几乎所有图像信息的图像特征。但PCA特征更适合物种之间识别。为了实现种内的识别,Xie等人[19]继而开发了名为物种自动化识别(SPIDA)的在线系统,利用Daubechies 4函数从小波变换的分量子集中使用蜘蛛细节的图像构建SPIDA的特征向量,用以识别不同的蜘蛛。而对局部特征的训练,还使分类精度得到更为显著的提升。文献[13-15]采用了视觉词典法。在该方法中,从图像中提取局部特征数据,并通过描述符的特征向量来表示局部特征数据。将训练集的所有描述符聚类来创建视觉词典。然后,使用该字典将新图像的区域描述符映射成单词,并将图像的特征袋映射到用于构造图像表示的一个词典中。这些词累积成直方图,再将这些直方图串联起来,生成最终的特征向量。由于昆虫图像的不同特征对昆虫分类的影响不同,文献[19-20,35-36]利用先进的多任务稀疏表示和多核学习(MKL)技术开发了昆虫识别系统,多任务稀疏表示技术可以结合昆虫的多个特征来提高昆虫的分类精度。

2.2.3 分级训练特征

分级训练特征是由特征提取器提取的固定特征,经系统训练得到中级特征,再通过系统训练得到分级训练特征,分级训练特征有很多中间表示。Wen等人[39]给出了一系列几何、形状、不变矩、纹理和颜色特征作为堆叠去噪自动编码器(SDAE)的输入。叠加去噪的自动编码器(SDAE)是由多个自动编码器(DAE)构成的一个深层网络,相对于一般的自动编码器(DAE)架构,SDAE架构将噪声添加到训练数据中,这意味着SDAE学习将会从真实数据中分离噪声。

3 分类方法

图像分类是图像识别的最终步骤。传统的图像分类方法有很多,例如:ANN、SVM等,然而随着计算机技术的发展,深度学习受到多方关注与重视,其在图像识别中的应用研究成果也在增加。为此,本文将从2个方面给出探讨论述如下。

3.1 传统分类方法

3.1.1 单个分类器

现在常用的传统单个分类器有决策树、支持向量机(SVM)、人工神经网络(ANN),但也有很多其它的分类器,例如:ABIS(蜜蜂自动识别系统)[10,27]、基于CBIR体系结构的识别系统[29]、基于核级特征融合的MKL方案[19]、LOSS V2算法[30]等。本节则拟就决策树、支持向量机(SVM)、人工神经网络(ANN)这3种分类器的设计工作做出研究概论如下。

(1)决策树。决策树[40-41]就是一个类似流程图的树型结构, 其中树的每个内部节点代表对一个属性的测试, 其分支就代表测试的结果, 而树的每个叶子节点就代表一个类别, 树的最高层节点就是根结点, 是整个决策树的开始。Mayo等人[31]、Silva等人[42]使用C4.5算法生成了经典决策树。Larios等人[14]使用Logistic模型树,且不同于经典树,因为该模型树的节点是逻辑回归分类器。决策树可以短时间处理大量数据,效率很高,但当类别太多时,却容易出错,另外在处理特征关联性比较强的数据时,所得效果也并不好。

(2)支持向量机。支持向量机(SVM)是在统计学习的VC 维理论和结构风险最小化原理基础上建立起来的机器学习方法,其训练算法本质上是一个二次规划的求解问题。文献[2,4,11,13,21,28,31,35-36,42]都使用了支持向量机(SVM)。研究可知,文献[11,31,35-36]使用的是线性SVM,而文献[2,4,13,21,28,42]使用的是核化SVM。文献[2,4,21,28]在研究中将标准差的高斯径向基函数σ作为一个核心。而Wen等人[13]、Silva等人[42]却使用了带有多项式核的SVM。SVM分类识别率相对较高,但对大规模训练难于实施,解决多分类方面也还存在一定困难。

(4)人工神经网络。人工神经网络(Artificial Neural Network,ANN)是基于模仿人脑神经网络的结构和功能而建立的一种信息处理模型。该模型由大量基本神经单元组成,具有较高的容错性和自学习等特征,在处理复杂、非线性、模糊关系等问题方面有着独特的优势。文献[24,28,34, 43]使用人工神经网络(ANN)进行分类。Wang等人[28]采用了一个BP神经网络进行训练,网络具有3层,即:输入层、隐藏层和输出层。而Al-saqer等人[24]使用的神经网络用缩放共轭梯度反向传播进行训练。人工神经网络的使用,使得快速进行大量运算成为可能。

3.1.2 组合分类器

由于单个分类器识别的不稳定性,还有一些识别方法由多个分类器组合而成。Russell等人[26]采用了SPIDA系統,这是由经过单独训练的ANNs组成的,而且每个ANNs都有2个输出节点,一个是正的,一个是负的,每个ANNs的正输出值被保存到一个文件中并进行排序。选择前三名,再从数据库中检索这些物种的信息,并向用户展示。除了ANN分类器组合,还有KNN分类器组合,Yalcin[16]使用4个K-最近邻分类器(KNN)在不同的特征描述符上进行训练,通过加权多数票投票,将基本特征的结果融合在一起,以获得决策。但同种框架分类器组合不能进行比较,当该框架识别率较低时,难以提高识别率,因此Wen等人[12]使用基于识别相关性的不同框架。如果第一分类相关性水平不够高,则运行第二分类。全局特征分类器(基于贝叶斯分类器)作为第一级分类器,局部特征分类器(具有最近邻分类器)作为二级分类器。首先调用全局分类器,如果相关性太低(低于给定的阈值),则调用局部特征分类器以给出最终决定。

3.2 深度学习方法

近年来,深度学习发展迅速,其基本模型大致分为3类,即:深度信念网络(Deep Belief Network,DBN)、卷积神经网络(Convolution Neural Networks,CNN)、递归神经网络(Recurrent Neural Network,RNN)。在基于图像的昆虫分类研究上主要采用卷积神经网络(CNN),其基本结构包含输入层、卷积层、激励层、池化层、全连接层和输出层。刘德营等人[44]利用Matlab(R2010b)和GitHub上一个开源的深度学习工具箱,以经典CNN结构LeNet-5进行卷积,避免了传统识别方法中复杂的图像预处理过程。随着深度学习框架的增加,运用不同框架对昆虫图像进行分类识别研究越来越多。周爱明等人[45]建立CaffeNet蝴蝶识别模型,其识别蝴蝶标本图像时,与传统SVM方法识别结果相差不大,但在识别自然环境下拍摄的蝴蝶图像时,其识别成功率远超传统SVM方法。程曦等人[25]使用了Alexnet 和GoogLeNet两种网络模型,2种模型所得出的结果相差不大,且均超过了传统方式下的识别准确率。为了提高自然环境下拍摄的昆虫图像的识别率,谢娟英等人[46]采用CNN的衍生算法、即Faster R-CNN算法对自然环境下拍摄的蝴蝶图像进行识别,得到了较高的识别率。现在移动设备的识别软件开发也逐渐成为学界瞩目焦点,为了使程序能在移动设备上运行,樊景超[47]通过MobileNets构建深度学习模型进行分类识别,其所构建的模型能够在移动设备上流畅运行,且具有较好的识别率。

4 討论

综合前文论述可以得出,现在基于图像的昆虫分类识别研究已经趋于相对成熟与完善,新的技术也将不断地应用到基于图像的昆虫分类识别研究当中,但随即也涌现出一些不容忽视的问题,亟待有效解决。

当今智能手机普及率达到了96%,通过智能手机采集图像也日渐增多,而且相对于相机来说,智能手机不逊色于普通相机的拍摄体验、携带方便、功能多样等特点也使人们钟爱于用手机进行拍摄。但其拍摄后图像的复杂性却势必影响着图像识别的成功率。因此,智能手机拍摄后的图像处理即已经成为时下的重点攻关研究课题之一。对于本文研究所用的图像还是以实验室背景下相机采集的图像为主。

故而,在此前提下,图像处理的技术需要及时做出相应的优化、及改进,现有的图像处理技术对自然环境下采集的图像处理效果尚未臻至理想,且自然环境下的图像以其复杂的背景和不同的姿态也在不断挑战着现有的图像处理技术。

随着深度学习技术的发展,深度学习技术应用于图像识别领域的可行性业已得到验证,将其应用于图像识别领域的研究也会越来越多。其较高的识别成功率、较少的图像处理步骤等优势就已成为吸引图像识别领域的技术人员一直保持不懈探索前行的研究动力。但特别说明的是,传统的识别方法仍是目前识别领域的主流,传统识别方法的程序已可堪称完备,且需要的图像远远少于深度学习方法。

5 结束语

随着现代科技的飞速进步,以手机拍摄的自然环境下的图像将越来越多,这将是未来昆虫图像识别领域采集图像的主要来源,且图像中昆虫个体的重叠或残缺也将是今后图像处理的另一个研发方向。图像处理技术也需要继续加大研究力度,进行探索、改进及创新,在复杂背景下能够正确分割出害虫图像,提取有价值的特征信息。而且,深度学习技术的不断发展,也将为基于图像的昆虫分类识别研究提供坚实基础。可以预期在不久的将来,深度学习技术也将会是基于图像的昆虫分类识别研究这一领域的主流技术。

参考文献

[1]阎锡海,王延锋,李延清. 昆虫起源、进化及其原因模糊性研究[J]. 延安大学学报(自然科学版),2003,22(1):81-84.

[2]YANG Heping, MA Chunsen, WEN Hui, et al. A tool for developing an automatic insect identification system based on wing outlines[J]. Scientific Reports, 2015, 5:12786.

[3]ZAYAS I Y, FLINN P W. Detection of insects in bulk wheat samples with machine vision[J]. Transactions of the ASAE, 1998, 41(3):883-888.

[4]YAO Qing, LV Jun, LIU Qingjie, et al. An insect imaging system to automate rice light-trap pest identification[J]. Journal of Integrative Agriculture, 2012, 11(6):978-985.

[5]吕军,姚青,刘庆杰,等. 基于模板匹配的多目标水稻灯诱害虫识别方法的研究[J]. 中国水稻科学,2012,26(5):619-623.

[6]杨红珍,张建伟,李湘涛,等. 基于图像的昆虫远程自动识别系统的研究[J] .农业工程学报,2008,24(1):188-192.

[7]冼鼎翔,姚青,杨保军,等. 基于图像的水稻灯诱害虫自动识别技术的研究[J]. 中国水稻科学,2015,29(3):299-304.

[8]邱道尹,张红涛,陈铁军,等. 基于机器视觉的储粮害虫智能检测系统软件设计[J]. 农业机械学报,2003,34(2):83-85.

[9]WEEKS P J D, O'NEILL M A, GASTON K J, et al. Automating insect identification: Exploring the limitations of a prototype system[J]. Journal of Applied Entomology, 2003, 123(1):1-8.

[10]ARBUCKLE T, SCHRDER S, STEINHAGE V, et al. Biodiversity informatics in action: Identification and monitoring of bee species using ABIS[C]// Proc. 15th International Symposium Informatics for Environmental Protection. Zürich: CiteSeer, 2001:425-430.

[11]FAVRET C, SIERACKI J M. Machine vision automated species identification scaled towards production levels[J]. Systematic Entomology, 2016, 41(1):133-143.

[12]WEN Chenglu, GUYER D. Image-based orchard insect automated identification and classification method[J]. Computers and Electronics in Agriculture, 2012, 89(3):110-115.

[13]WEN Chenglu, GUYER D E, LI Wei. Local feature-based identification and classification for orchard insects[J]. Biosystems Engineering, 2009, 104(3):299-307.

[14]LARIOS N, DENG Hongli, ZHANG Wei, et al. Automated insect identification through concatenated histograms of local appearance features[C]// IEEE Workshop on Applications of Computer Vision. Austin, Texas: IEEE, 2007:26.

[15]SARPOLA M J, PAASCH R K, MORTENSEN E N, et al. An aquatic insect imaging system to automate insect classification[J]. Transactions of the Asabe, 2008, 51(6):2217-2225.

[16]YALCIN H. Vision based automatic inspection of insects in pheromone traps[C]// 2015 Fourth International Conference on Agro-Geoinformatics. Istanbul,Turkey:IEEE, 2015:333-338.

[17]SOLIS-SNCHEZ L O, CASTAEDA-MIRANDA R, GARCA-ESCALANTE J J, et al. Scale invariant feature approach for insect monitoring[J]. Computers and Electronics in Agriculture, 2011, 75(1):92-99.

[18]杨信廷,刘蒙蒙,许建平,等. 自动监测装置用温室粉虱和蓟马成蟲图像分割识别算法[J]. 农业工程学报,2018,34(1):164-170.

[19]XIE Chengjun, ZHANG Jie, LI Rui, et al. Automatic classification for field crop insects via multiple-task sparse representation and multiple-kernel learning[J]. Computers & Electronics in Agriculture, 2015, 119:123-132.

[20]张永玲,姜梦洲,俞佩仕,等. 基于多特征融合和稀疏表示的农业害虫图像识别方法[J]. 中国农业科学,2018,51(11):2084-2093.

[21]陈月华,胡晓光,张长利. 基于机器视觉的小麦害虫分割算法研究[J]. 农业工程学报,2007,23(12):187-191.

[22]甄彤,范艳峰,邹炳强,等. 谷物害虫图像识别中特征值提取技术的研究[J]. 微电子学与计算机,2004,21(12):111-115.

[23]GASSOUMI H, PRASAD R, ELLINGTON J. Neural network-based approach for insect classification in cotton ecosystems[C]//International Conference on Intelligent Technologies (InTech 2000). Bangkok, Thailand: Kluwer Academic Publishers, 2000:1-7.

[24]AL-SAQER S M, HASSAN G M. Artificial neural networks based red palm Weevil (Rynchophorus Ferrugineous, Olivier) recognition system[J]. American Journal of Agricultural & Biological Science, 2011, 6(3):356-364.

[25]程曦,吴云志,张友华,等. 基于深度卷积神经网络的储粮害虫图像识别[J]. 中国农学通报,2018,34(1):154-158.

[26]RUSSELL K N, DO M T, HUFF J C, et al. Introducing SPIDA-Web: Wavelets, neural networks and internet accessibility in an image-based automated identification system[M]//MACLEOD N. Automated Taxon identification in systematics: Theory, approaches and applications.New York :CRC Press, 2007: 131-152.

[27]FRANCOY T M, WITTMANN D, DRAUSCHKE M, et al. Identification of Africanized honey bees through wing morphometrics: Two fast and efficient procedures[J]. Apidologie, 2008, 39(5):488-494.

[28]WANG Jiangning, LIN Congtian, JI Liqiang, et al. A new automatic identification system of insect images at the order level[J]. Knowledge-Based Systems, 2012, 33(3):102-110.

[29]WANG Jiangning, JI Liqiang, LIANG Aiping, et al. The identification of butterfly families using content-based image retrieval[J]. Biosystems Engineering, 2012, 111(1):24-32.

[30]FAITHPRAISE F, BIRCH P, YOUNG R, et al. Automatic plant pest detection and recognition using k-means clustering algorithm and correspondence filters[J]. International Journal of Advanced Biotechnology and Research, 2013,4(2):189-199.

[31]MAYO M, WATSON A T. Automatic species identification of live moths[J]. Knowledge-Based Systems, 2007, 20(2):195-202.

[32]LECUN Y. What's wrong with deep learning? [EB/OL]. [2015-06-10]. http://www.pamitc.org/cvpr15/files/ lecun-20150610-cvpr-keynote.pdf, 2015.

[33]TOFILSKI A. DrawWing, a program for numerical description of insect wings[J]. Journal of Insect Science, 2004, 4(1):17.

[34]LEOW L K, CHEW L L, CHONG V C, et al. Automated identification of copepods using digital image processing and artificial neural network[J]. Bmc Bioinformatics, 2015, 16(S18):S4.

[35]LU An, HOU Xinwen, CHEN Xiaolin, et al. Insect species recognition using sparse representation[C]//Proceedings of the British Machine Vision Conference. Aberystwyth, UK:British Machine Vision Association, 2010,108:1-10.

[36]LU An, HOU Xinwen, LIU Chenglin, et al. Insect species recognition using discriminative local soft coding[C]// 2012 21st International Conference on Pattern Recognition. Tsukuba, Japan:IEEE, 2012:1221-1224.

[37]LYTLE D A, MARTNEZ-MUOZ G, ZHANG W, et al. Automated processing and identification of benthic invertebrate samples[J]. Journal of the North American Benthological Society, 2010, 29(3):867-874.

[38]LOWE D G. Object recognition from local scale-invariant features[C]// Proceedings of the Seventh IEEE International Conference on Computer Vision(ICCV). Corfu, Greece:IEEE, 1999:1150.

[39]WEN Chenglu, WU Daoxi, HU Huosheng, et al. Pose estimation-dependent identification method for field moth images using deep learning architecture[J]. Biosystems Engineering, 2015, 136:117-128.

[40]HAN J, KAMBER M. Data mining concept and techniques[M]. San Meteo, California:Morgan Kaufmann, 2006.

[41]BERSON A, SMITH S, THEARLING K. Building data mining applications for CRM[M]. New York: McGraw-Hill, Inc, 2000.

[42]Da SILVA F L, SELLA M L G, FRANCOY T M, et al. Evaluating classification and feature selection techniques for honeybee subspecies identification using wing images[J]. Computers and Electronics in Agriculture, 2015, 114(C):68-77.

[43]BONIECKI P, KOSZELA K, PIEKARSKA-BONIECKA H, et al. Neural identification of selected apple pests[J]. Computers and Electronics in Agriculture, 2015, 110:9-16.

[44]劉德营,王家亮,林相泽,等. 基于卷积神经网络的白背飞虱识别方法[J]. 农业机械学报,2018,49(5):51-56.

[45]周爱明,马鹏鹏,席天宇,等. 基于深度学习的蝴蝶科级标本图像自动识别[J]. 昆虫学报,2017,60(11):1339-1348.

[46]谢娟英,侯琦,史颖欢,等. 蝴蝶种类自动识别研究[J]. 计算机研究与发展, 2018, 55(8):1609-1618.

[47]樊景超. 基于MobileNets的果园害虫分类识别模型研究[J]. 天津农业科学,2018,24(9):11-13,26.