基于生成对抗网络的对抗样本生成

郭清杨

(四川大学计算机学院,成都 610065)

0 引言

过去几年里,机器学习和神经网络已经取得了很多成就,包括在计算机视觉、自然语言处理等方面。但是近来许多工作已经证明其在对抗干扰上是很脆弱的,容易受到一些精心设计的攻击方法的攻击。因为机器学习和神经网络已经广泛应用于安全相关的应用领域,例如自动驾驶、用户验证和能源管理等。

因此,深度模型的对抗样本引起了许多研究者的关注,例如,Szegedy等为图像添加了不可察觉的扰动,以最大化训练神经网络的分类错误,使网络无法正确分类图像[1]。Goodfellow等人提出了FGSM这种基于梯度的算法来生成对抗样本[2]。Papernot等人是用Jacobian矩阵来确定在生成对抗样本时要修改哪些特征[3]。大多数攻击算法,依靠简单的像素空间度量优化方案,来鼓励视觉真实感,并且在正确样本的梯度上添加微小扰动,从而生成感知真实的对抗样本。本文提出训练一个产生扰动的深度卷积网络作为生成模型来生成不同的对抗样本,一个残差网络作为判别模型来确保生成的样本看起来是真实的。本文使用生成对抗网络(GAN,Generative Adversarial Network)[4]在黑盒攻击中生成对抗样本。由于WGAN-GP(Wasserstein GANGradient Penalty)[5]能够生成高质量的图像[Ishaan等,2017],因此本文基于WGAN-GP模型提出AWGAN(Adversarial on Wasserstein GAN)方法来生成感知现实的对抗样本。

在以前的白盒攻击中,如FGSM和优化方法,对手需要有白盒访问的架构和模型的权重参数等。然而通过部署AWGAN,一旦生成器得到训练,它可以立即为任何输入实例产生扰动,而不再需要访问模型本身,我们将此攻击设置为黑盒攻击。

为了评估攻击策略AWGAN的有效性,首先基于AWGAN和其他针对不同目标模型的攻击策略生成对抗性实例,然后应用最先进的防御系统来抵御这些产生的对抗样本。我们评估了这些攻击策略在黑盒攻击中的性能,证明了由AWGAN生成的对抗样本可以获得较高的攻击成功率,这可能是因为与其他最近的攻击策略相比,这些对抗样本更接近真实的实例。

1 相关工作

1.1 黑盒攻击和白盒攻击

黑盒攻击就是攻击者无法得知目标模型的内部结构、训练参数、防御方法等,只能通过输出输出与模型进行交互。白盒攻击则是攻击者知道目标模型的内部结构,训练参数等数据,可以根据目标模型具体的信息来进行有针对性的攻击。因为在实际的应用场景中,攻击者很难对防御模型进行白盒访问,因此本文主要研究目标为黑盒攻击。

1.2 对抗样本

对抗样本由Christian Szegedy等人提出,是指在数据集中通过故意添加细微的干扰所形成的输入样本,导致模型以高置信度给出一个错误的输出。这种愚弄神经网络的方法就是对抗样本。这种方法在安全领域受到十分密切的关注,因为随着人工智能应用的普及,其安全性就越来越重要,如果一个AI很容易被骗过,那么将非常容易被黑客利用。例如,垃圾邮件发送者可以通过欺骗AI来防止被过滤掉,而更严重的例子是,自动驾驶技术中就包括了行人、车辆的识别,如果黑客使用对抗样本使得AI误以为路面上没有人,那就将造成重大交通事故。

1.3 基于梯度的方法

目前已经提出一些对抗样本的生成方法,但是这些方法大都需要知道模型的结构和参数权重,属于白盒攻击。这里将介绍三种典型的基于梯度的攻击方法:

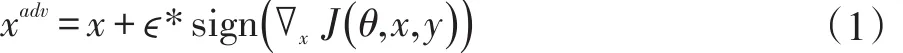

(1)Fast Gradient Sign Method

FGSM由Goodfellow等人在2015年提出,是一种在输入图像梯度方向上增加扰动的方法,生成样本公式如下:

这里x是真实样本,y是真实样本x的真实标签,θ是模型参数,ϵ是添加噪声扰动的幅度。

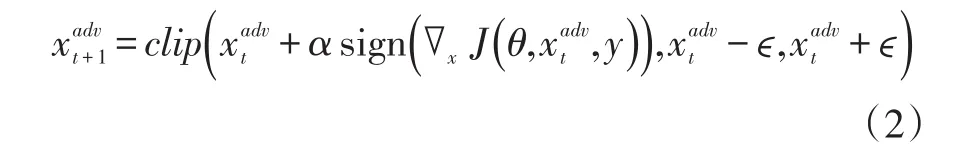

(2)Projected Gradient Descent

PGD方法由Kurakin等人在2017年提出,是FGSM方法的多步骤变体[6]。FGSM方法是在一定阈值限制之下沿着梯度方向移动一步或添加一次扰动,而PGD方法则是通过多步更小的移动来使得构造结果更加精准。生成样本公式如下:

这里clip(x,p,q)表示强制输入x在范围[p,q]中,并且上边公式需满足

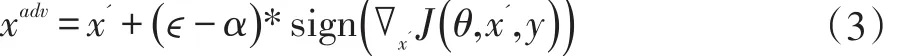

(3)Rand FGSM

Rand FGSM方法由Tramer等人在2018年提出,是先对正确图像进行小的随机扰动,然后再使用FGSM方法来进行基于扰动后的图像对抗样本生成[7]。生成样本公式如下:

这里 x'=x+α*sign(N(Od,Id))。

2 基于残差生成对抗网络的对抗样本生成

我们提出了基于WGAN-GP的AWGAN模型并引入了深度残差网络来生成图像逼真的对抗样本,本节对具体算法进行介绍。

2.1 生成对抗网络(GAN)

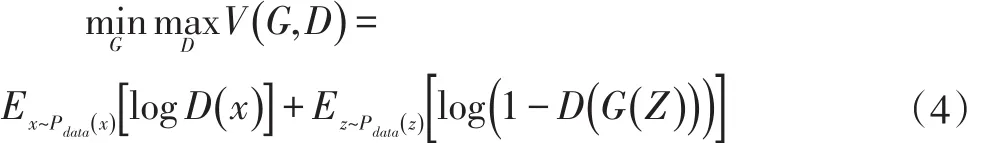

在2014年,Goodfellow在论文中提出了生成生成对抗网络(GAN),如图1所示,该网络由两个相互对抗的神经网络组成。生成器G(Generator)用来估计数据分布并生成图像,判别器D(Discriminator)用来区分输入数据中的真实样本和由G生成的伪样本。G和D的目标可以形式化为最大最小值函数V(G,D):

图1 GAN结构图

然而,在该论文中,Goodfellow利用数学推导证明了,在一般情况下目标函数V会带来梯度消失问题。如果D训练的太好,G就无法得到足够的梯度继续进行优化,而如果D训练的太弱,指示作用不明显,同样无法让G进行有效学习,结果就是在训练中D的训练程度非常难以把控。

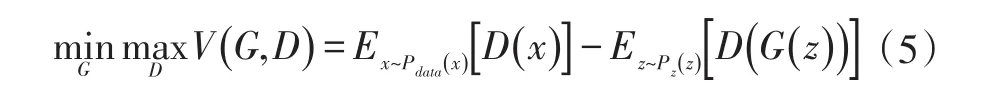

因此,Arjovsky等人将EM距离引入GAN当中,提出了WGAN[8]。而WGAN的目标函数为:

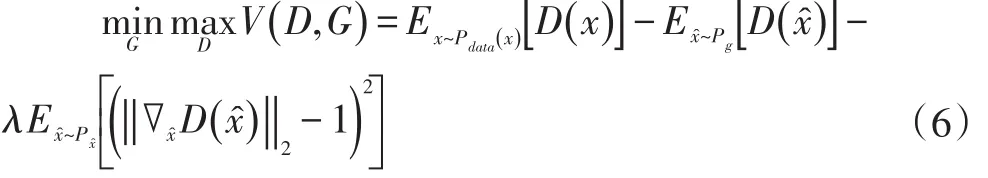

WGAN解决了梯度消失问题,大大提高了GAN训练的稳定性。但是,因为WGAN为了保证Lipschitz限制,采用了weight clipping的方法,会使得模型有时候产生样本质量低,难以收敛等问题,因此Ishaan等人提出了WGAN-GP,给WGAN中的Dloss加入梯度惩罚,即Grandient Penalty(GP).WGAN-GP目标函数为:

2.2 基于GAN的对抗样本生成

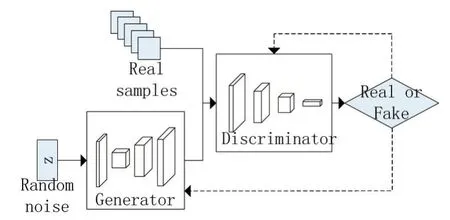

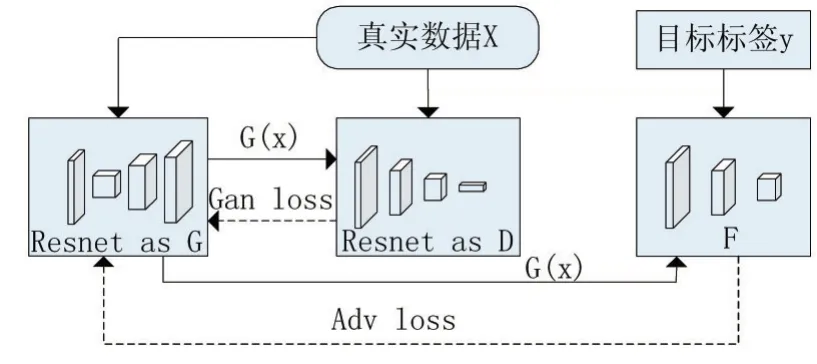

我们提出了以WGAN-GP为基础的AWGAN模型,模型的总体架构如图2所示。主要由生成器G、判别器D、目标模型F三部分组成。

图2 AWGAN总体架构

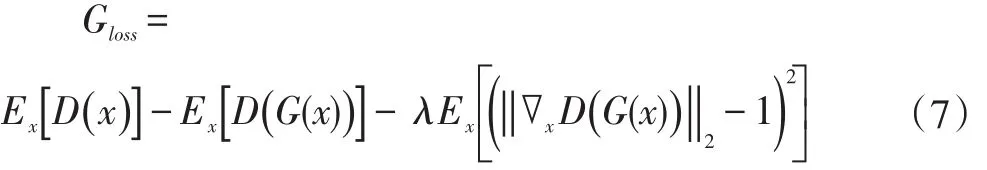

这里生成器G以真实数据x为输入,产生扰动G(x),然后分别将G(x)发送给判别器D和目标模型F。判别器以G(X)和真实数据x为输入,用Gan loss来计算分生成数据和真实数据的距离,从而使生成数据真实度更接近真实数据。Gan loss可写为:

目标模型 f以G(x),真实数据x,目标标签y为输入,用Adv loss来计算扰动与目标标签的距离。Adv loss可写为:

这里 f为训练原始模型的损失函数,Floss鼓励生成的数据被错误分类到目标y中,c表示一个用户指定约束,用以稳固GAN的训练。所以对抗样本生成公式可写为:

在判别器的模型中,使用深度残差网络来代替WGAN-GP中的卷积网络,将Leaky Relu作为激活函数,并且用Instance Normalization代替Batch Normalization,使得判别器的判别效果明显得到改善。在生成器模型中,首先进行卷积运算,再使用下采样减少参数,接着进行残差网络运算提取特征并保持输出维度,最后再进行上采样。

3 实验设计及结果

3.1 实验环境和数据集

实验平台为Ubuntu16.04操作系统,CPU为AMD Ryzen7 2700X@3.70Ghz处理器,运行内存16G,使用了NVIDIA GeForce RTX 2080Ti 11GB显存显卡,实验的配置环境为PyTorch1.1.0,PyTorch3.7.3。为了验证提出的模型在对抗样本的生成问题上的可行性,我们采用率了Mnist和Cifar-10数据集。

3.2 实验设计

Mnist数据集和Cifar-10数据集分别有10个类别,我们针对这些类别,分别使用FGSM、PGD和AWGAN三个方法做攻击测试。目标模型我们选取Inception v3网络,扰动限制为5%。

在第一个训练阶段,我们需要训练一个WGANGP网络,目标是得到一个训练好的生成器和判别器。然后把目标模型加入进来,组成一个完整的AWGAN模型。在第二阶段,我们开始转换生成器以学习对抗样本的分布,在训练过程中,目标模型和判别器轮流训练,以保证在生成有效的对抗样本的同时,图像能保持高还原度。在第二阶段训练完成之后,即可得到一个能够生成对抗样本的AWGAN模型。

3.3 实验结果

因为我们的攻击为黑盒攻击,所以对于FGSM和PGD两种方法,使用可转移性评估。我们使两种方法在已知目标网络中进行对抗性训练,然后转移至统一目标模型进行对抗攻击,得到了如表1的实验结果。

表1三种方法攻击成功率

表中成功率取自多次实验结果,我们在多次试验中使用相同数据集对三种方法进行训练,并且在测试过程中分别对两个数据集设置相同的攻击目标标签,然后进行攻击成功率统计。从结果表明,在Mnist数据集上,AWGAN的成功率相较于FGSM提高了15.0%,比PGD成功率提高了7.1%。而在Cifar-10数据集上,AWGAN的成功率相较于FGSM提高了18.3%,比PGD成功率提高了11.1%。说明本文提出的新方法相较于已有的基于梯度的方法,在黑盒攻击方向有着更好的攻击效果,生成的对抗样本攻击成功率更高。同时,攻击效率如表2所示:

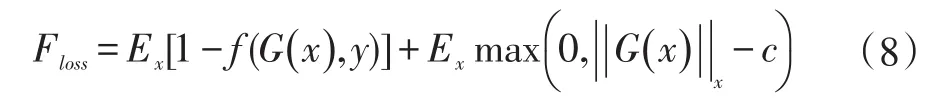

表2三种方法的样本生成效率

我们比较了三种方法的性能,在使用相同数据集训练好之后,设定同一目标进行在同一数据集中进行样本生成,可以看到AWGAN的生成效率是最快的。

4 结语

在本文中,我们提出了AWGAN模型,使用生成对抗网络(GAN)来生成对抗样本。在我们的模型中,因为WGAN-GP网络可以生成高质量的图像,所以我们得到的对抗样本相较于其他方法更为逼真,并且摆脱了其他方法对于目标网络梯度参数的依赖,具有更好的黑盒攻击能力。实验结果也表明AWGAN可以提高网络攻击成功率和效率,同时提升样本图像的质量。但是模型生成样本的迁移性是一个难以攻克的点,尚需下一步继续研究。