基于GANs的训练技术的改进及应用

杨振 李丹

摘 要:GANs作为典型的生成对抗网络,具有较高的应用价值和发展潜力,文章改进了GANs网络的一些新技术(训练深度生成半质量网络dcgan),针对其中部分缺点进行了有效改善,从网络架构、特征匹配和多形差值学习技术维度进行优化,并将其与bird数据集*80进行训练,得出观察结果,为未来的应用前景和环境拓展研究提供进一步可能性,以期在更多的场景中使用该算法。

关键词:GANs网络的技术改进;数据新集;网络机构;特征匹配;多形差值学习

中图分类号:TP18 文献标识码:A文章编号:2096-4706(2021)21-0102-03

Abstract: As a typical generation countermeasure network, GANs has higher application value and development potential. In this paper, some new technologies of GANs network are improved (training depth generation semi-mass network dcgan), and some of the shortcomings are effectively improved. The algorithm is optimized from the network architecture, feature matching and polymorphic difference learning technology dimensions, and is trained with bird dataset *80 to obtain the observation results, providing further possibility for the research of future application prospects and environment expansion, in order to use the algorithm in more scenarios.

Keywords: GANs network's technology improvement; new dataset; network organization; feature matching; polymorphic difference learning

0 引 言

一个生成性的对抗网络(GANs)就是由一个生成器G和一个鉴别器D所组合构成的,它们在两个玩家最小游戏中相互竞争:鉴别器尝试区分真实训练数据和一个合成的图像,生成器尝试欺骗一个鉴别器。具体地说,D和 G在V(D、G)上可以玩以下游戏:mingmaxdV(D、G)=exblogpdata(x)[logd(x)]+ex2fpz(z)[log(1-D(G(z)))]。这个极大的极小函数博弈公式具有了在pg=pdata时的博弈全局最优,并且在温和的条件下具有全局最优。G与D之间有一个足够的容量pg收敛在pdata。在实践中,在训练开始时,D的样本非常差,被D充满信心地拒绝。研究发现,在实践中,生成器可以更好地最大化对数(D(G(z))),而不是最小化对数(1-D(G(z)))。卷积网络监督学习技术在计算机和视觉应用中具有很大的普遍性。与此相比,CNN的无监督学习方式所受到的重视程度更低。在这个工作中,我们深切地希望CNN能够帮助我们弥补其他国家在没有监督和不加以监管的学习中取得成功。我们希望它能在更深层次上得到应用。本文主要介绍了CNN,即卷生成了对抗网络(dcgan)。它们都是具有某种系统性和结构上的约束,这也证明了它们都是无监督学习的强力候选。文本的深度和数量以及返回网络能够高度识别和宣传(学习意义的零镜头)自动学习的文本显示,以文字和文本(red等,016)。这些方法是加州理工大学加利福尼亚大学鸟类数据库(WAH等,011)基于以上零镜头字幕搜索的属性。在这些工作的鼓励下,我们的目标是学习从单词和文本到图像像素的直接表示技术。

1 技术改进

1.1 方法

将深度卷积函数生成递归式为对抗神经网络的先决条件(dc-gan)将其作为一个混合字符层卷积函数递归式为神经网络编码的文本函数,DC-GAN全称叫作:Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks,在外层,用饱满的神经网络代替原始G中的多层传感器生成网络G和传感器网络D,并基于文本特征进行前馈推理。DC-GAN同时还具有两种功能,dc-gan实现了两种功能,一种就是它们可以被用来当作无监督的特征提取器,类似于k-means。其他一种就是让这张图片在语言学上实现像字向量一般的类似单词向量这么多的加减。

1.2 网络架构

使用以下表示法。生成器网络表示G:RZ×RT→RD,鉴别器D:RD×RT→{0,1},其中T是文本描述嵌入的尺寸,D是图像的尺寸,Z是输入到G的噪声维度。图1中说明了本文的网络结构。在对生成器G中,首先从文本查询t(0,1)之前的噪声中进行采样,并且可以通过使用文本编码器G对文本查询t(t)进行编码。为了简单地描述嵌入式的RI(t),首先要把一个完整的连接层通过压缩得到一个较小的维度(其实我们是18),然后再通过leaky-relu然后把它与噪声矢量z相連。接下来,推理像是在一个正常的逆褶积网络中一样顺利地进行:我们通过生成器G前馈它;通过 ←G(z,?(t))生成一个合成图像 。与基于查询文本和噪音样品的生成器G中相对应的图像生成方法是基于查询文本的生成器G中。在鉴定器D中,我们使用空间批处理归一化进行Ioffe-卷积(Ioffe&Szegedy,015),然后是使用ReLU。我们再次减少了将?(t)嵌入到一个(单独的)全连通层中的描述的维数,然后进行了校正。例如,当一个鉴别器的空间维数设定为4×4时,我们可以使用空间连接方式来复制其描述性地嵌入,并执行深度连接。然后我们分别执行1×1卷积,然后通过校正和4×4卷积计算D的最终得分。对所有卷积层进行批处理归一化。

生成器和文本识别者都通常是用于使用新的文本格式编码器(t)。它被二维投影投射到一个较低层的维度和深层,与三维图像中的特征图和地形图相互连接,以此更便于进一步卷积化并处理下一阶段。

1.3 特征匹配

GAN网络的训练主要包含纳什均衡。獲取它的成本函数是每个参与者的目的,J(D)(θ(D),θ(G))为判别器,J(G)(θ(D),θ(G))为生成器。纳什均衡是一个点(θ(D),θ(G)),使J(D)相对于θ(D)最小,J(G)相对于θ(G)最小。不幸的是,找到纳什均衡是一个非常困难的问题。对于存在于特殊情况下的算法,我们不知道是否有相关算法来应用到GAN博弈中,代价函数处于非凸时,参数及参数空间分别对应的连续的和高维的[1]。

当参与者代价处于最小化状态时,就会产生一个纳什均衡,提高了应用传统基于梯度的最小化技术想法,并且也实现了每个参与的成本节省。但是正确地这样做有一个缺点(D)的校正减少了J(D)但增加了J(G),校正减少了J(G)但增加了J(D),例如,如果一个参与者最小化x与XY,并最小化另一个参与者与-XY的关系,则梯度会落入稳定轨道,而不是收敛到x=y=0,即理想平衡点。特征匹配是通过给生成器制订一个新的目标值来有效地防止它对当前的评估器进行了过度的训练,从而解决了GANs的不稳定性。新的目标并不是直接地最大化鉴别仪的输出,但要求鉴别仪生成与真实数据统计相对应的数据。我们只使用鉴别器来指定我们认为有用的统计信息。特别地说,我们的训练产物生成器和识别函数在中间层上的期望值都是完全匹配的[2]。这种方法是由于学习识别生成器对于匹配统计信息进行自然选择,因为通过学习识别鉴定器,我们需要他找到一个最有可能准确地区分现实的数据和目前模型产生的各种对抗性数据。设f(x)代表判别器中间一层上的激活,我们将新生成器目标定义为||ex2010pdataf(x)-ez-pz(z)f(G(z))||,判别器f(x)按常规训练,等同于GAN训练。这样使得目标存在一个固定点,其(G)能够实现训练数据的精准匹配,目前,在实验中无法对相关过程进行有效保障,但从丰富的实验结果中,表面特征匹配能够有效地适用于常规gan不稳定情况,更具有应用价值和效果。

1.4 多形插值学习(GAN-INT)

深度网络可以学习插值的表示形式,并且已被证明接近数据流的形式。在此基础上,我们可以通过简单地插入训练短语标签来生成大量额外的文本插入。要插入文本,不需要与实际笔迹相对应的文本,因此不需要额外的标签成本。这意味着生成器可以被看作是增加了一个额外的术语,以最小化:ET1,T2 ~ pdata[log(1-D(G(z,βT1+(1-β)T2)))]。

其中Z是从噪声分布中提取的,将T1和T2插入文本中,实际上我们已经找到了一个解决方案。b=0.5是有效的。由于插入值是合成的,所以鉴别器D不对应于“真实”图像和文本对。D学习预测图像和文本是否一致。如果D在这方面工作得很好,它将对应于D的插入文本。如果插入G,您可以学会填补训练点之间数据流之间的空白 ,T1和T2可以来自不同的图像,甚至不同的类型[3]。

其中Z从噪声分布中提取,并插入T1和T2之间的文本。在实践中,我们发现Fix=0.5非常有效。Da这是一种合成插值,当D位于该上下文中时,鉴别器D的训练图像对应于“实际”文本。在T1和T2中,G可以对应于D的插入文本,并学习如何填充训练点之间的数据空间。T1和T2可以从不同的图像甚至不同的分类中生成[4]。

2 实验数据集

我们采用了Birds*80的数据集(来自加州理工大学uasd的数据集)来应用本文算法,在实验中,将每个数据图像进行HD5格式转换,并使用其中80组图像进行数据集实验,在具体运行中环境和技术差异因素,我们会对改进的GAN技术进行一定的优化调整。

在实验过程中,首先出现在kaggle上运行visdom时出现兼容问题,我们通过配置兼容的虚拟环境进行了有效解决,并通过将学习率从0.000 2提高一倍到0.000 34时,发现结果有了一定的改进,

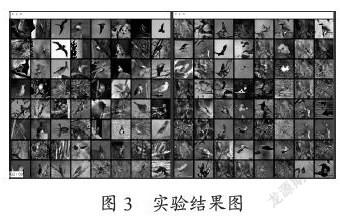

经过kaggle的训练后得到如下数据。从这张图片中我们可以清楚地看到通过我们对改进的GAN算法训练得出来的模型在性能、准确度等各个方面都已经有了显著的改善,表明我们所采用的GAN模型已经在对建模这一数据集的各种条件下分布等技术上做得很好。

3 算法的应用

改善的GAN网络(DC-GAN)可以应用在人脸图像的生成。原始的GAN网络在自我博弈过程中生成的图像质量无法达到我们的预期或者不稳定容易产生模式单一化或者模型崩溃,这是因为生成器和判别器运用的是相同的反向传播网络。我们将原生成器网络用卷积神经网络替代原理的MLP实现较为稳定的网络,并产生高质量的图片,这就是DC-GAN的由来[5]。

在山洪、地震等自然灾害的事后救援行动中搜救机器人就可以通过搭载这种算法不仅能提高救援效率还可以提高资源的利用率,我们希望在以后的研究中将此方向作为研究重点去帮助更多的读者[6]。

4 结 论

GAN是一种潜力巨大的生成性对抗网络,本文所提到的DC-GAN这是其中的一种演变,我们希望在这基础上做更多的尝试并加入更多的新技术,例如:半监督学习、小批量判别等算法进一步改善网络的质量以此来适应更多更大的数据集。众所周知,GANs的压力训练并不稳定,往往这样会直接导致两个制备器同时产生一个几乎毫无意义的压力输出。在我们尝试系统理解和深入分析关于GANs赋值学习的理论基础上,以及如何将多层次在GANs的中间的赋值函数进行组合表示。还需要进行更多的实验。

参考文献:

[1] YAN X C,YANG J M,SOHNK. Attribute2Image:Conditional Image Generation from Visual Attributes [J/OL].arXiv:1512.00570 [cs.LG].[2021-08-22].https://arxiv.org/abs/1512.00570.

[2] VINYALS O,TOSHEV A,BENGIO S,et al. Show and tell:A neural image caption generator [C]//2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Boston:IEEE,2015,3156-3164.

[3] FUKUMIZU K,GRETTON A,SUN X H,et al. Kernel Measures of Conditional Dependence [EB/OL].[2021-08-22].http://citeseerx.ist.psu.edu/viewdoc/download;jsessionid=C6AE3A04010B73BEE01147FB4BD2FCC0?doi=10.1.1.143.5575&rep=rep1&type=pdf.

[4] LI Y J,SWERSKY K,ZEMEL R. Generative Moment Matching Networks [J/OL].arXiv:1502.02761 [cs.LG].[2021-08-22].https://arxiv.org/abs/1502.02761.

[5] 翁邦碧,杨波,姚璞,等.应用多媒体与实战模拟训练法改进自救互救技术教学 [J].西南军医,2020,22(5):478-481.

[6] 胡涛,李金龙.基于单阶段GANs的文本生成图像模型 [J].信息技术与网络安全,2021,40(6):50-55.

作者简介:杨振(2000—),男,汉族,四川井研人,本科在读,研究方向:人工智能。