基于协同特征的显著性目标检测算法*

陈恒晟,王 军,毛 毅,孟祥豪,刘 刚,吴国栋

(1.国防科技大学,安徽 合肥 230037;2.中国人民解放军91306 部队,上海 201900;3.中国人民解放军第61516 部队,北京 100071)

0 引言

人类在面对自然场景时,会对所接收到的视觉信息进行预处理,自动过滤掉无关紧要的背景,筛选出最引人注意的目标。显著性目标检测算法正是模拟人类这种视觉注意机制,通过构建有效的计算模型,从图像中检测出最具有代表性和显著性的目标,从而提取图像关键信息,简洁高效地表达图像内容。在以往的研究中,显著性目标检测往往只针对一幅静态图像,即通过提取单幅图像的特征描述其显著性信息。然而随着时代的发展,显著性目标检测应用的场景越来越复杂,对于目标检测的要求和标准也越来越高,基于单一图像场景的显著性目标检测已无法满足应用需求。因此,近年来基于多图像协同的显著性目标检测正逐渐成为一个热门研究课题。所谓协同显著性,是指多场景中共同存在的相同或者相似目标的显著程度。其不仅要考虑单幅图像的显著性目标特征,而且还需要兼顾一组图像之中共同目标之间的协同性特征。协同显著性在协同分割、目标跟踪、多场景目标识别、人脸识别等领域[1]都有着重要的研究价值。

近年来,针对协同显著性目标检测问题,不少学者做了大量的研究工作并提出了很多优秀的算法。这些算法大致可以分为基于特征融合的算法和基于图融合的算法。基于特征融合的算法旨在提取不同图像之间的协同一致性特征,并将这种协同一致性融入显著性目标检测计算过程。如Chen 等人[2]基于视觉注意机制,通过对分割图像块的稀疏特征进行匹配,得到协同检测结果。Fu 等人[3]通过将所有的图像进行颜色聚类,构造每种聚类颜色值的分布直方图,然后将对比度特征、空间分布性特征和一致性特征进行整合得到协同显著性目标检测结果。Liu 等人[4]通过对图像的分层分割,利用颜色直方图计算分割区域的全局相似性,从而得到协同显著图。以上算法在一些简单的场景下有着较好的检测效果,能够有效准确地检测出显著性目标,但是上述算法主要通过提取图像中的如颜色、对比度等底层特征或是物理特征对图像进行处理,难以在复杂的背景下取得较好的检测效果。随着深度学习技术在图像领域的应用,也出现了不少基于深度特征的协同显著性目标检测模型。如Zhang 等人[5]分别选取同组内和其他组图像的候选目标集作为正负样本训练集,提取高维的深度特征,然后提出一种基于贝叶斯推理的协同显著性检测模型;Wei 等人[6]通过深度学习提取输入图像组的共同语义特征来寻找共同显著目标。以上算法虽然能够取得较高的算法精度,但是必须要有大量训练集作支撑,且需要人工预先精确标定出协同显著的目标区域,算法开发的复杂性较高。

基于图融合的方法可以直接利用现有的模型检测结果,通过设计适当的融合策略获得协同显著图。例如Cao 等人[7]将M种单幅图像显著性检测算法的显著图按照一定的阈值进行前景和背景分割,构建特征矩阵并进行低秩分解得到协同显著图。Li 等人[8]在获得单个图像显著图的基础上,采用高效流行排序算法实现对其融合得到协同显著图。Tsai 等人[9]通过设计栈式自动编码器来对多个显著图线索进行编码译码,从而得到最终协同显著图。基于图融合算法的优点是能够充分利用多个显著图线索之间的互补性,缺点是对融合策略的设计要求较高。

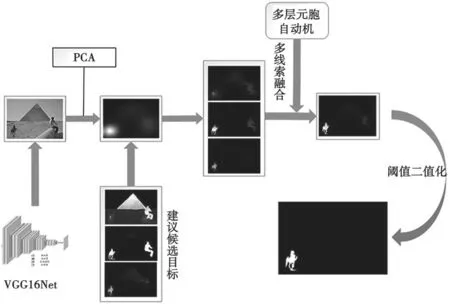

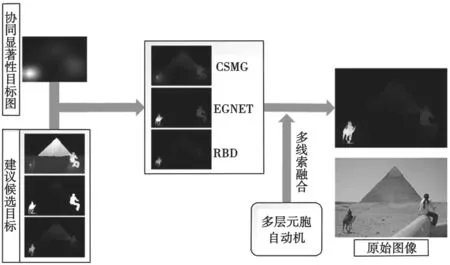

综上,本文提出一种基于协同注意和多线索融合的显著性目标检测算法,算法流程如图1 所示。

图1 本文算法基本流程

该算法一方面通过深度卷积神经网络提取受检测图像的深度语义特征,另一方面运用主成分分析对提取的群组图像的深度特征向量进行处理得到目标的协同特征向量。基于现有的图像显著性目标检测算法提取群组图像的协同显著性目标建议候选对象,并将协同注意图与不同显著性检测算法结果进行乘法融合,运用元胞自动机算法对不同显著性检测结果进行整合,以去除干扰目标,达到准确定位协同显著目标的目的。通过在已公开的数据集进行实验表明,本文所提算法在检测精度和普适性上优于目前的主流算法,具有较强的鲁棒性。

针对常规协同显著性目标检测算法复杂、设计要求较高的问题,结合上述思路,本文设计结构如下。

(1)对协同特征进行提取,通过基于VGG16Net深度学习网络框架的算法,构建全卷积结构的显著性检测网络,并简要介绍卷积神经网络如何对图像进行深度语义特征提取。

(2)为从深度语义特征中提取出协同特征,根据主成分分析的原理,介绍了相关的协同特征提取方法。

(3)为了对提取得到的协同特征进行多线索融合,通过乘法融合和多层元胞自动机两种方法,对初始显著图进行多线索融合。

(4)利用二值化的方法对显著图进行优化,并通过与其他显著性检测算法进行实验对比,得出相关结论。

1 基于主成分分析的协同特征提取

协同特征的应用是协同显著性检测研究中至关重要的环节。这种协同特征一般指的是一个图像组内具有相同或者相似颜色、纹理或者语义特征的显著目标之间的一致性。一般来说,一个图像组内的协同目标往往是包含信息量最大的部分,即该部分图像区域所对应的特征描述明显地区别于其他图像区域,而主成分分析(Principal Component Analysis,PCA)能够很好地描述大数据中包含信息量最大的特征成分。因此受文献[10-11]的启发,本文采用主成分分析法来提取图像组之间的协同特征。

1.1 图像特征提取

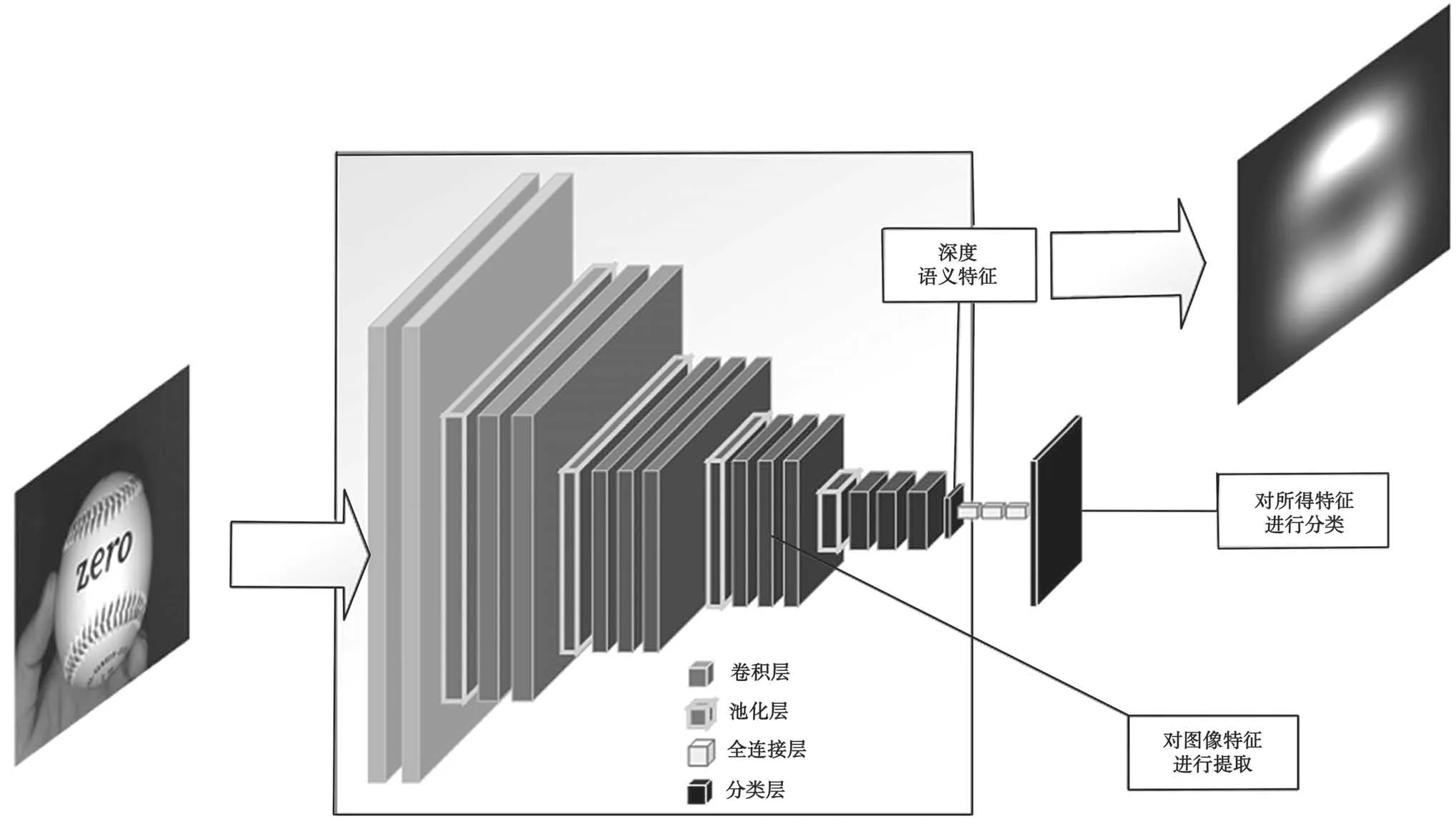

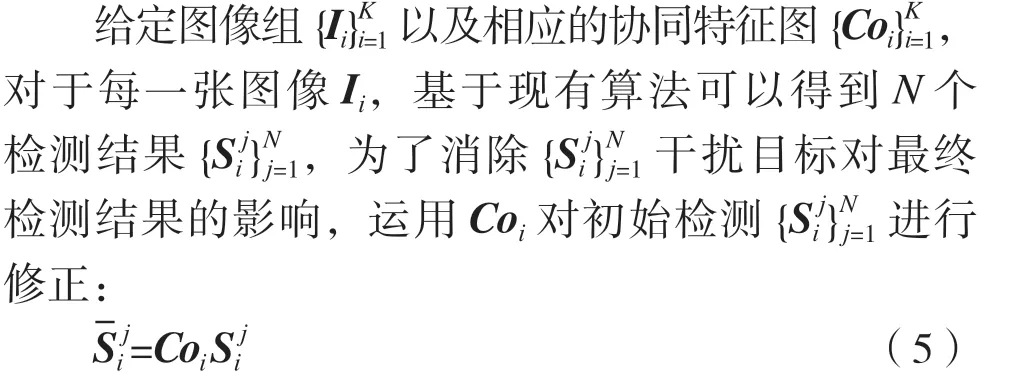

一般而言,用于描述图像目标检测的特征有颜色、纹理、直方图、对比度等低层次特征。在面对较为简单的图像时,基于这些特征的算法能够达到一定的效果,但是当面对的图像场景较为复杂时,往往存在较大的局限性。尤其是对于多图像的协同显著性目标检测而言,面临的图像场景更加复杂,需要设计具有语义分析功能的高级特征。卷积神经网络(Convolutional Neural Networks,CNN)作为深度学习的代表算法之一,在图像处理方面有着重要的影响。它能够自动从大规模的数据中学习特征,并把结果向同类型未知数据泛化。通过多层卷积和池化,逐层提取图像的特征,最终得到目标的深度语义特征。基于深度卷积网络的图像语义特征提取示意图如图2 所示。

图2 卷积神经网络原理

卷积神经网络一般包含输入层、卷积层、池化层和输出层。图2 为卷积神经网络VGG-net 的网络结构图。对于卷积神经网络而言,前端的卷积层往往提取的是图像的颜色、纹理、边缘等浅层特征,而后端卷积层是对前端的输入特征进行分析综合,得到更深层次的语义特征。研究表明[12-13],这种语义特征对于准确检测图像中的目标更有帮助。对于输入图像In,经过深度卷积网络的多次卷积和池化处理,从最后一个卷积层的输出特征为X,其维度为H×W×K(此处以VGG-net[14]为例进行说明),其中H和W为特征X的长和宽,K为特征通道的个数。该特征向量X经过高度抽象,去除了图像中大量的背景冗余信息,保留了图像中深层次的目标语义信息。

1.2 主成分分析

式中,为所有特征向量的均值,令:

那么,根据PCA 原理,可得协方差矩阵:

对于上述协方差矩阵,可以求得最大特征值λ及其对应的特征向量v,那么最终的协同目标激活图Coi(k,p)为:

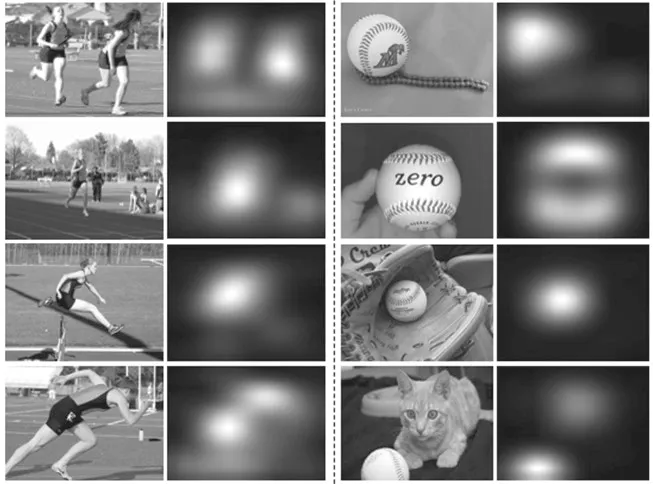

图3 协同目标成分激活示例

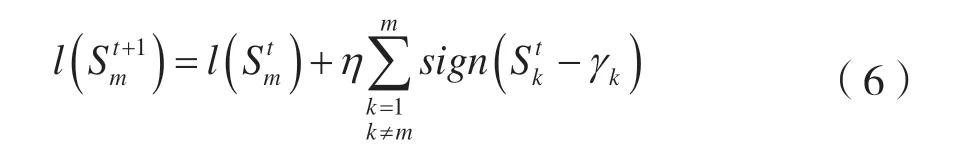

2 基于协同特征引导的多线索融合

第1 节得到的协同特征图的主成分分析方式模拟了协同注意机制,将协同目标区域的显著值给予大致的标注,起到初步定位协同显著性目标的作用,但无法明确地检测出协同显著性目标的具体轮廓。而现有的许多图像显著性检测算法结果中,大多检测结果比较准确,但是存在干扰目标的影响,无法准确检测出具有协同性的目标。本节基于现有图像显著性目标检测算法提供的显著性目标检测结果,首先将前文得到的协同显著性目标特征图作为先验信息;其次,将协同特征图与现有的显著性目标初始候选对象进行乘法融合,以对初始目标候选对象进行修正,去除不具有协同一致性的目标对象;最后,运用多层元胞自动机对不同线索进行融合,从而充分利用不同检测方法之间的互补性,提升检测结果。其基本流程如图4 所示。

图4 多线索融合流程

式中,为修正后的显著图,由此可以得到图像Ii的N个线索。文献[15]提出多层元胞自动机算法来对多个显著图线索进行融合,多层元胞自动机模型能够充分利用不同线索之间的互补性,构造多个线索之间的影响关系,通过不断迭代更新,求得最终的显著图。适用于显著图融合的多层元胞自动机的数学模型为:

式中:l(·)为以e为底的对数函数;可以理解为线索为m的显著图在“感受”到其他线索的状态后,在下一次t+1 时刻更新后的显著值;Smt为其在t时刻的显著值;γk为自适应阈值;η为固定常数,一般取0.15。由式(6)可知,若一个线索“感受”它的邻居(其他线索)的显著值“状态”后,它应该相应增加或者减少自身的显著值,以保证和其他线索能共同构成一个稳定的状态。

对于协同显著性检测而言,本文基于协同特征图对不同线索进行修正引导后,分别将送入多层元胞自动机模型中,使不同的显著图线索相互影响,并达到一个相对稳定的状态后输出最终显著图结果。判断稳态的收敛条件为:

式中,ξ为一个较小的非零阈值,一般情况下当所有显著图线索不再发生明显差异时,即可以认为更新达到稳定状态。

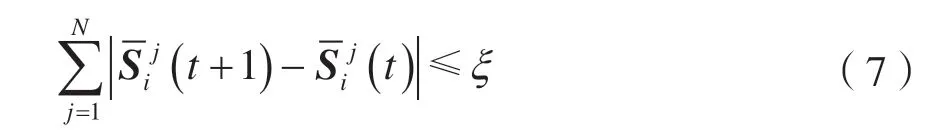

本文在实验测试中,主要采用了通过模板引导的协同显著性检测算法(Co-Saliency Detection via Mask-Guided,CSMG)[16]、通过边缘网络引导的显著性目标检测算法(Edge Guidance Network for Salient Object Detection,EGNET)[17]以及鲁棒背景检测中的显著性优化算法(Saliency Optimization from Robust Background Detection,RBD)[18]3 种 显著性算法进行融合,主要原因是这些算法对于目标的边缘检测效果较好,能够弥补本文协同显著图对于目标边缘检测结果较差的缺点。图5 给出了几个示例,从图3 中可以看出进行多线索融合后的图像相较于未融合的目标显著图在目标识别的准确度上有显著的提升。

图5 多线索融合示例

本文算法输入图像Map,输出显著图Sal。整体流程如下所示:

(1)利用深度卷积神经网络对输入的相关群组图像提取深度特征X;

(2)对卷积层得到的深度特征X进行主成分分析,得到相应的协同特征向量ξ*;

(3)利用协同特征向量和初始显著性目标候选对象进行乘法融合,得到显著图;

(4)利用元胞自动机对显著图进行多线索融合;

(5)对融合显著图进行优化,得到最终显著图。

3 实验与评估

3.1 实验设置

3.1.1 测试数据集

本文在iCoseg 数据集上[19]对各类算法进行测试。iCoseg 数据集中包含各类物品、人物、建筑等目标,背景复杂,具有一定的挑战性,能够有效地检测协同显著性模型的适用性,数据集中的每一张图片都有像素级别的真值标注,以便和计算结果进行对比。本文主要结合基于聚类的协同显著性检测算法(Cluster Based Co-saliency Detection,CB_C)[20]、CSMG、基于层次分割的协同显著性目标检测算法(Co-saliency Detection Based on Hierarchical Segmentation,HS)[4]、RBD 这5 种算法,对结果进行分析与比较。

3.1.2 评价指标

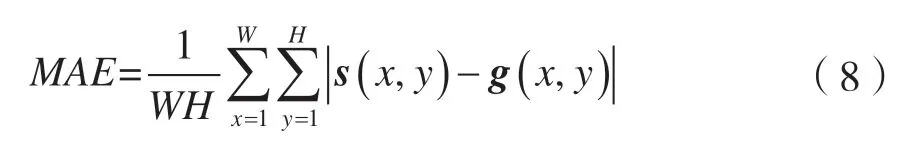

本文主要通过PR 曲线、平均绝对误差(Mean Absolute Error,MAE)、F-measure值、S-measure值[21]4 个评价指标对结果进行评价。PR 曲线中的P代表的是Precision(精准率),R 代表的是Recall(召回率),其代表的是精准率与召回率的关系;MAE值为平均绝对误差,其在像素层次计算显著图s(x,y)与真值图g(x,y)之间的误差,并在整幅图像上求平均:

式中,W、H分别为图像的宽与高。

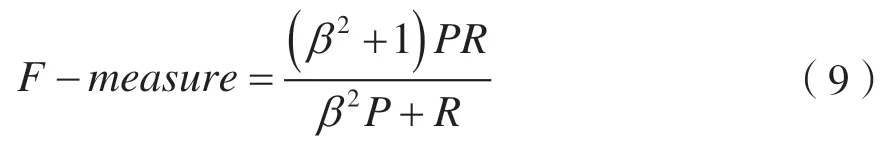

F-measure值为精确度和召回率的加权和平均,用于测量两幅图像相匹配的程度:

式中:P为精确度;R为召回率;β2为参数,取0.3。

S-measure为目标显著图的背景图和真值图之间的相似值,计算得出两者之间的得分:

式中:So和Sr分别为面向物体和面向区域的结构相似性度量;α为参数,取0.5。

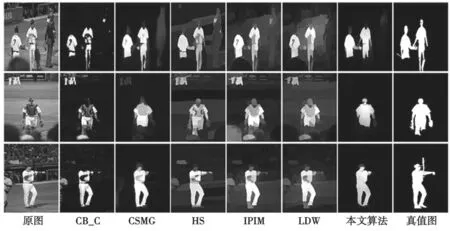

3.2 定性分析

图6 给出了本文算法与其他算法的检测结果示例,可以看出:CB_C 算法显著值差异大,且存在错检误检的情况;CSMG 算法总体较好,但是存在检测目标不完全的情况;HS 算法由于其检测存在局限性,因此前景和背景在特定情况下无法进行有效区分和检测。本文通过卷积神经网络提取图像的深度特征,使其能够准确定位显著目标,同时通过多层元胞自动机,利用互补性来弥补算法之间的不足。因此,本文算法在上述场景下都能够更加精确地检测出共同目标区域,而且几乎不存在误检测问题,体现了较强的鲁棒性。

图6 本文算法与其他算法对比

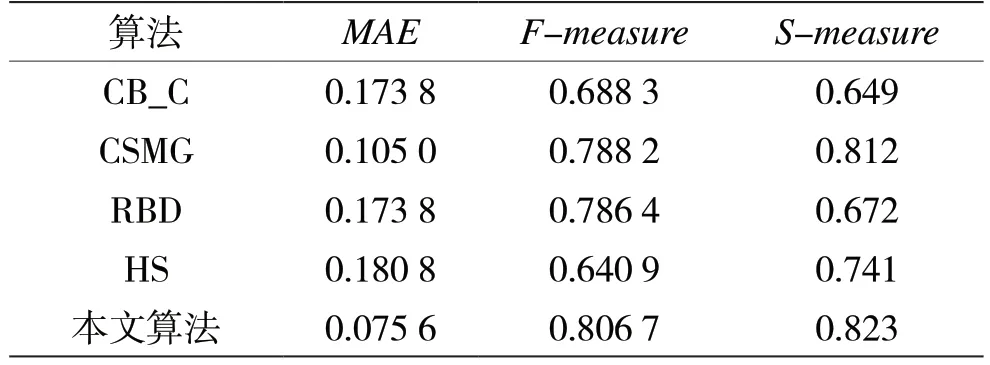

3.3 定量分析

MAE值、F-measure值、S-measure值作为图像检测精度和误差的重要指标,在一定程度上决定了显著性目标图的好坏。其中:MAE值越小,代表图像的平均绝对误差越小;F-measure值越大,代表图像的精确率和召回率越高;S-measure值越大,代表图像与真值图之间相似度越高。通过3.1 节中提到的计算方法,表1 给出了本文算法与其他算法的MAE值、F-measure值、S-measure值的对比。

表1 不同算法的评估结果对比

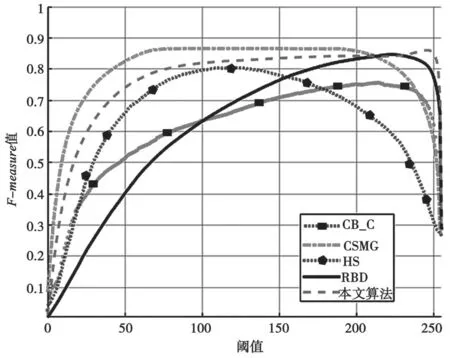

从表1 中数据可以看出,本文算法在MAE值上均低于其他算法,F-measure和S-measure值均大于其他算法,从图7可以看出:在阈值大于230时,本文所提的算法F-measure值大于其他算法,并且在低于230 时也大于其余大部分算法,表明了该算法的精确率和召回率较高,结果与真值图之间的匹配程度较好。

图7 各算法F-measure 曲线

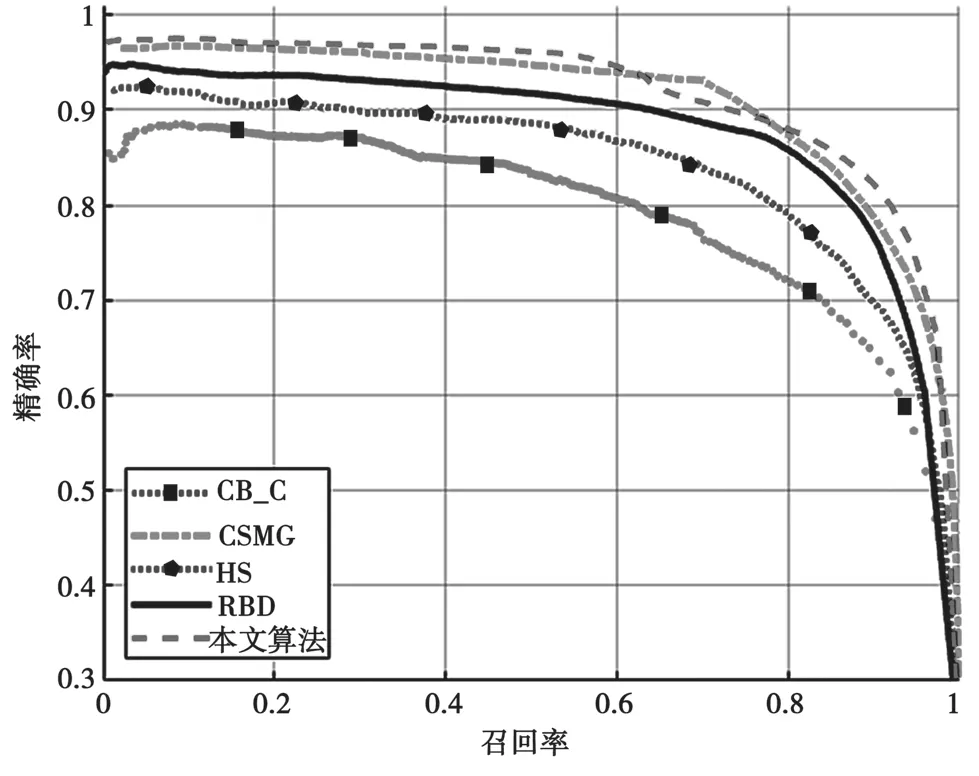

同时本文画出了目标显著图的PR 曲线,并给出了本文算法和其他算法的比较。图8 给出了本文算法和部分其他算法在数据集上的PR 曲线,可以看出本文算法所得结果拥有较为饱和的PR 曲线,说明本文算法在精确度与召回率方面相对于以往算法均有一定的提升。

图8 各算法PR 曲线

综上,本文在MAE值、F-measure值、S-measure值上均大于其他几种算法,并且在精准度、召回率、PR 曲线等指标下也优于大部分算法。以上实验数据说明了本文所提算法产生的显著图与真值图更加接近,且各方面性能指标均优于大部分算法。

4 结语

本文提出了基于协同特征和多线索融合的显著性目标检测算法。所提算法结合深度学习和主成分分析提取目标的协同特征,以此来确保显著性目标提取的准确性和普适性。为了充分利用各算法之间的互补性,本文通过多层元胞自动机对显著图进行优化,使得显著图相较于未优化前有了明显的改善,提升了算法在面对复杂场景时的适用性。实验表明,本文所提算法能够在一定程度上改善显著性目标检测的准确性,有效区分检测目标边界轮廓,并且各项参数均优于目前主流的大部分显著性目标检测算法,具有较强的鲁棒性和适用性。