基于卷积网络实现图像配准与图像融合算法的研究

臧景峰 徐宁雪

摘要:图像的配准与融合是计算机视觉和模式识别的研究热点,在航拍视频序列处理、医学图像分析、运动分析等领域有着广泛的应用。视频增强技术只在去雾、图像配准、图像融合等某一个特定任务中表现很好,具有一定的局限性。而卷积神经网络的堆叠和利用可以同时实现视频图像增强所需的多种功能。本文采用孪生结构的深度卷积神经网络实现图像配准和图像融合,具有重大应用价值。

关键词:孪生结构;图像配准;图像融合

引言

为获得场景信息更丰富的图像,通常用到图像配准与图像融合方法,图像融合是将多幅不同图像集成为一幅图像,集成后的图像蕴涵着所有图像的优势信息,融合算法的基础是图像的配准技术,深度学习具有提升图像融合和配准质量的潜力。

1 孪生卷积神经网络的设计

本文所设计的孪生卷积网络(Siamese Network)由两个权重相同的卷积神经网络(Convolutional Neural Network,CNN)组成。每个CNN由两个卷积层,两个池化层,一个残差块以及一个全连接层组成的,将原本Siamese网络中的一个卷积层换成了残差块。输入的patch为16×16,即卷积层和池化层的通道数都是16(即卷积模板为16种),其卷积核的大小为3×3,池化窗口尺寸为2×2,卷积方式为零填充(zero padding),卷积层的激活函数为Relu,且子CNN输出的是256维特征向量,每个池化层包括跨信道归一单元。

2 基于Siamese網络的图像配准算法

本文提出一种孪生结构的深度卷积神经网络来提取图像卷积特征,算法先逐像素地提取固定图像和浮动图像的图像块对,并利用Siamese网络提取图像块的特征。然后将提取到的特征构建能量损失函数,通过最小化能量损失函数,在得到参考图像与待配准图像特征点的对应关系后,以仿射变换模型来求解参数,仿射变换计算公式为:

在得到配准变换参数后,即可将待配准图像转换到参考图像的坐标系下。本文采用三次样条插值对待配准图像进行插值,得到与固定图像极为接近的配准后图像。

3 基于Siamese网络的图像融合算法

3.1 基于Siamese网络的图像融合框架

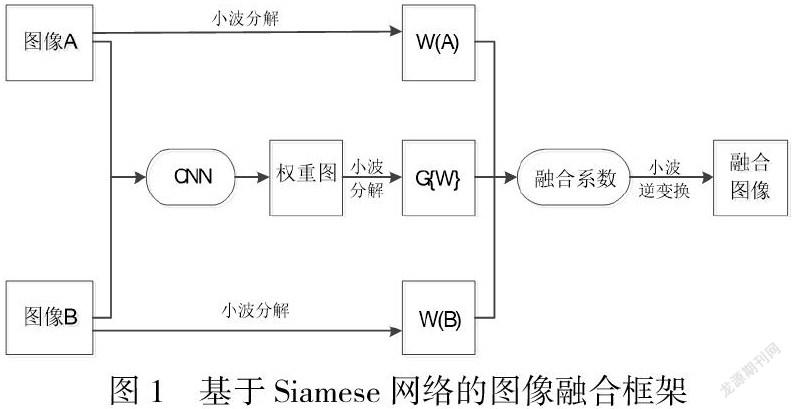

整个图像融合过程可以分为两个部分,第一个部分用Siamese网络进行图像信息的提取得到一个权重图,第二部分是利用小波变换分解后再融合对小波分解后的不同的子带分别采用不同融合方法进行处理。基于Siamese网络的图像融合框架如图1所示 。

先将第一部分得到的权重图W经过小波变换得到G{W},再将两张待融合图片A和B进行小波变换分别得到W(A)和W(B),再将得到的G{W}和W(A)、W(A)分别进行基于边缘检测的小波变换图像融合,最终进行小波逆变换得到最终的融合图像。

3.2 融合规则

在小波分解这一过程中,选用Db4小波作为小波基对图像与权值图进行小波变换。

1)使用Canny边缘检测算法提取低频分量中包含的边缘轮廓细节后,对低频分量以平均数法进行处理,再将提取出的边缘轮廓细节与高频分量内相应分辨率的点通过绝大值系数法进行处理,最后通过小波逆变换得到融合图像。低频分量平均数法表示为:

其中f1、f2表示原图像分解后在对应的(m,n)上的小波系数,f3表示结果图像在(m,n)上的小波系数。

2)高频系数绝大值法表示为:

式中表示小波分解系数。对子系数以小波逆变换处理,得到融合图像。

4 实验结果

本文方法与现存两种融合方法基于导向滤波 (Guided Filtering,GF)的融合方法、基于小波变换(Wavelet Transform,WT)的融合方法进行比较,且比较了原始Siamese网络结构的结果和改进后Siamese网络的结果。为了更加客观的表示融合效果,选取了几个客观的图像融合评价标准。互信息 (MI),平均梯度 (AG),边缘强度 (ES),最后给出了所有的方法在 CPU 上的运行时间作参考。对比结果如表1所示。

从表 1中可见,本文所用方法融合后图像的MI和AG的数值都要大于用GF和WT的数值,说明本文所提方法融合后图像包含原图像的信息度上和清晰度上都要优于GF和WT的融合图像。与原始Siamese网络结构对比,运行时间明显减少。综上所述,本文所提出的方法是具有一定的实用性的。

5 结论

本文提出了一种基于改进的Siamese网络的图像配准与融合方法,将原本Siamese网络中的一个卷积层换成了残差块,比原本的算法更为简略,并且实验所用的时间更短,实现了像素级的图像融合。

参考文献

[1]王金宝.基于图像融合的实时全景融合模型的设计与实现[D].中国科学院大学(中国科学院沈阳计算技术研究所),2019.

[2]李增祥,漆志亮,贾楠,等.基于小波图像金字塔的工件目标检测与定位研究.现代电子技术,2019,42(15):33–37.

[3]孔韦韦,雷阳,任聪,赵文阳.基于改进型CNN的多聚焦图像融合方法[J].郑州大学学报(理学版),2019,51(02):29-33.

[4]Zhang Y,Liu Y,Sun P,etal.IFCNN:A general image fusion framework based on convolutional neural network.Information Fusion,2020,54:99-118.

[5]Eppenhof K A J,Lafarge M W,Moeskops P,etal.Deformable image registration using convolutional neural networks[C].Medical Imaging 2018:Image Processing.

基金项目:吉林省教育厅科学研究项目(JJKH20210839KJ),雨雾场景中基于卷积神经网络的视频图像增强方法研究