一种基于关键点的红外图像人体摔倒检测方法

徐世文,王 姮,张 华,庞 杰

一种基于关键点的红外图像人体摔倒检测方法

徐世文,王 姮,张 华,庞 杰

(西南科技大学 信息工程学院,四川 绵阳 621000)

针对已有人体摔倒检测方法在复杂环境场景下易受光照影响、适应性差、误检率高等问题,提出了一种基于关键点估计的红外图像人体摔倒检测方法。该方法采用红外图像,有效避免了光照等因素的影响,经过神经网络找到人体目标中心点,然后回归人体目标属性,如目标尺寸、标签等,从而得到检测结果。使用红外相机采集不同情况下的人体摔倒图像,建立红外图像人体摔倒数据集并使用提出的方法进行检测,识别率达到97%以上。实验结果表明提出的方法在红外图像人体摔倒检测中具有较高的精度与速度。

红外图像;关键点估计;摔倒检测;神经网络

0 引言

随着医疗保障的提高,人口老龄化已是当今社会的一个问题。根据相关调查表明,老年人受到意外伤害的主要原因之一就是摔倒。因此,防止老年人摔倒也变得越来越重要。世界卫生组织报告说,每年因跌倒造成的严重伤害超过3730万人次,死亡64.6万人[1]。摔倒是一个重要的公共健康问题,其伤害很大程度上取决于救助响应时间的长短。智能的摔倒检测系统可以全天候工作,及时做出反应,实时保护人们的安全。

现在主流的人体摔倒检测方法根据检测传感器的不同大致分为基于穿戴式的摔倒检测、基于环境式的摔倒检测以及基于计算机视觉的摔倒检测3类。基于穿戴式检测法通常将加速度计以及陀螺仪等传感器佩戴在身体上,收集运动数据[2-4],使用采集得到的传感器数据训练MLP[5](multilayer perceptron)、SVM[6](support vector machines)等机器学习算法进行人体摔倒检测。基于外部传感器的摔倒检测方法需要随身穿戴传感器,存在用户穿戴起来不方便和不自在,容易脱落等问题。基于环境式的摔倒检测是提前在指定的区域布置好诸如压力传感器、声音传感器等,通过传感器采集到的数据进行检测,这种方法存在容易被环境噪声影响[7],成本高等问题。另外,基于计算机视觉的摔倒检测法通常对摄像头拍摄到的图像进行目标的提取,获取其特征,再通过对特征的分析从而得到摔倒检测结果。文献[8]将行人用矩形框表示,通过矩形框的长宽比例来说明行人的姿态,从而进行摔倒检测;文献[9]将目标的轮廓拟合成椭圆,提取其几何与运动两种特征,组成一个新的特征,使用SVM进行摔倒判断;文献[10]使用高斯混合模型得到人体目标,提取多帧特征并融合得到基于时间序列的运动特征,使用一个简单的卷积神经网络判断摔倒。文献[11]中提出一种基于人体骨骼关键点和神经网络的人体摔倒检测方法,通过Alphapose检测人体骨骼关键点,并用来训练LSTM(long short term memory)神经网络,实现人体摔倒的检测。

上述人体摔倒检测研究中使用的视频与图像均是可见光图像,然而在生活中应用人体摔倒检测的往往是老人和容易出现情况的病人,这些地方一般都是需要24h监控。可见光图像在夜晚和光照条件不好的场景中不能很好地呈现出图像,在这些情况下不能做到准确地检测摔倒情况。红外图像目标识别技术是指通过对红外图像进行预处理,然后提取目标特征,最后实现目标的定位与识别[12]。与可见光图像相比,红外图像直观反映的是物体的温度,一般而言红外图像中行人的亮度比背景亮度要高,且纹理、颜色和光照对红外图像几乎没什么影响,这使得红外图像在进行人体检测方面具有很大的优势和潜力。

针对上述问题,本文提出了一种基于关键点估计的红外图像人体摔倒检测方法。该方法采用红外相机采集图像,图像经过全卷积网络得到人体目标中心点,并在中心点位置回归出目标位置以及状态属性等,从而实现人体摔倒检测。

1 基于中心点的目标检测方法

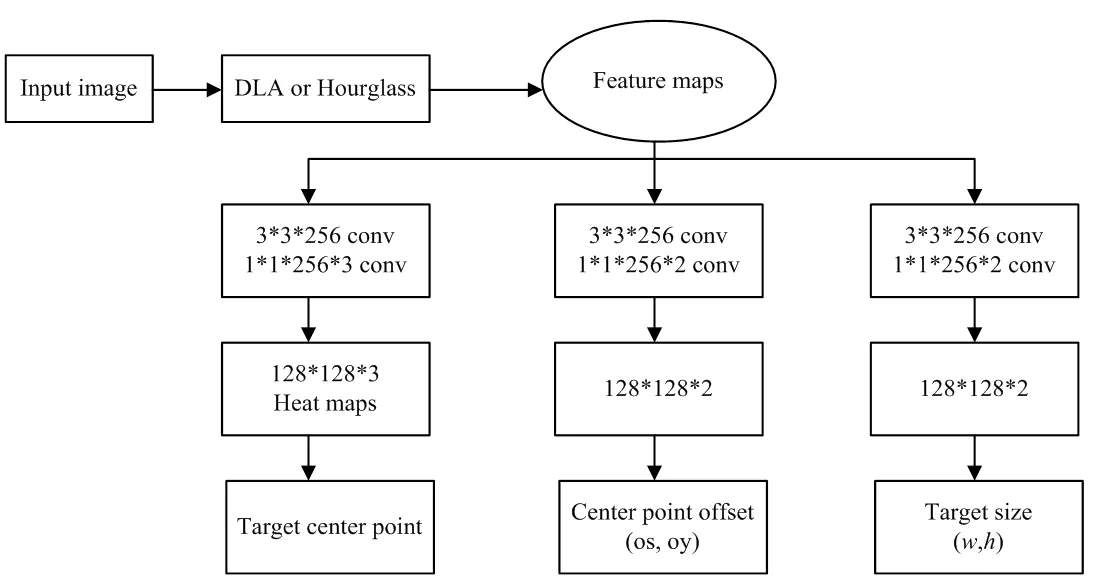

目标检测识别往往在图像上将目标以轴对称的框形式框出,大多数成功的目标检测器都是罗列出大量的候选框并对其分类。这样做法浪费时间,并且低效,还需要额外的后处理。本文中提出采用一种不同的方法,构建模型是将目标作为一个点,即目标的中心点。检测器通过热力图寻找中心点然后回归目标的其他属性,比如大小,3D位置坐标,方向甚至姿态。相比较于基于目标框的检测器,基于中心点的检测网络centernet[13]是一个端到端的、独特的、简单而快速的目标检测器。

在网络中,仅仅将图像传入全卷积网络,得到高维特征图,然后在特征图上进行卷积操作得到热力图,确定目标中心点、中心点偏移值以及目标尺寸大小。网络整体架构如图1所示。

图1 Centernet网络整体架构

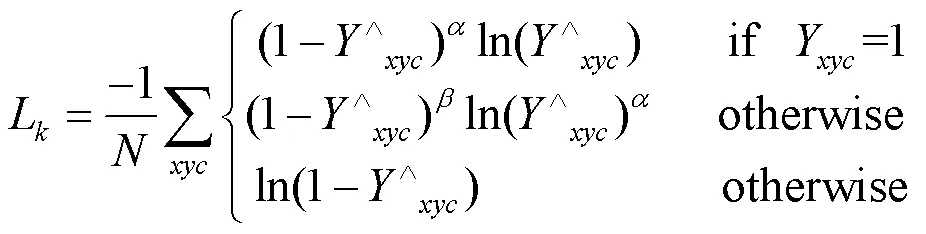

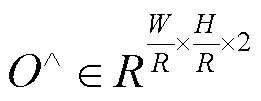

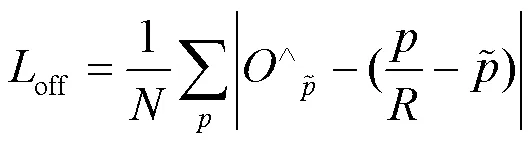

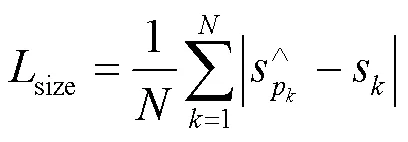

1.1 关键点估计

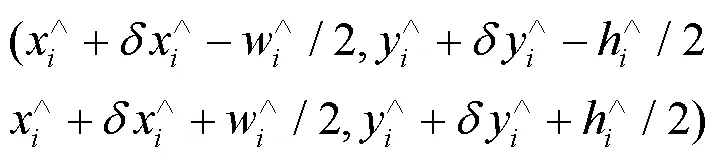

式中:和是损失函数的超参数;是图像中的关键点个数,式中除以是为了将所有焦点损失归一化。在实验中,一般选取=2,=3。

1.2 目标作为点

在此方法中,不用归一化目标尺寸而是直接使用原始像素坐标。为了调节总的loss的影响,分别对损失函数中的偏移损失和尺寸损失乘以一个影响系数,整个训练的目标损失函数如式(4)所示:

det=L+sizesize+offoff(4)

1.3 从点回归到边界框

2 数据集采集与处理

目前基本上所有的基于视觉的摔倒检测研究都是在可见光图像上基础上进行的,为了避免复杂光照条件影响以及能在夜晚和白天24h工作,本文研究了基于红外图像下的人体摔倒检测。因为没有公开的红外图像人体摔倒数据集,为此在这对公开的人体摔倒数据集进行分析,了解其数据集中的人体行为,摔倒场景,图像分辨率等内容。在此基础上,搭建人体摔倒场景,设定行为内容,然后使用红外成像设备获取红外数据,制作红外图像人体摔倒数据集。

2.1 公开人体数据集分析

本文主要研究了MuHAVi-MAS17和Le2i两个公开数据集,这两个摔倒数据集在摔倒检测中使用最多,其数据量大,内容丰富,是目前主流的人体摔倒检测数据库。

MuHAVi-MAS17是一个行为识别数据集,其中包含了人们在生活中的常做的行为,诸如走路、坐、奔跑以及需要的摔倒动作。此数据集使用8个摄像头在不同的方位来录制数据,内容丰富且样本多样化。数据集中每个人都有多个不同视角的摔倒图像,有左摔和右摔姿势,分辨率为720×576。

Le2i摔倒数据集是法国学者们使用一个分辨率为320×240的相机在一个拟真的场景中录制而来。数据集中有200多个视频序列,包含办公室、咖啡室、客厅以及演讲室等不同场景。在各种场景中的人进行了多种日常动作和摔倒行为,日常动作有下蹲、行走以及弯腰等,摔倒姿势有前后摔和左右摔等,内容丰富,数据充足。

2.2 红外图像采集系统

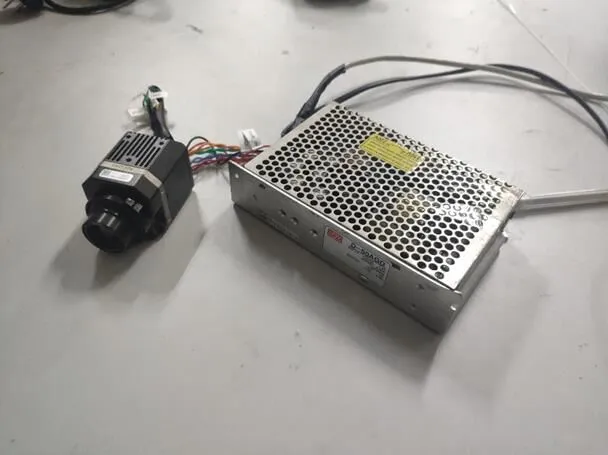

通过对上述摔倒数据集的分析与研究,本文使用红外图像设备自行采集红外图像人体摔倒图像,建立摔倒数据集。选择在一间场景较为简单的房间为摔倒场景,将红外相机放置在房间的不同角落以获得不同方向的图像。红外相机分辨率为640×480,输入电压12V,是一款高清单目热红外成像仪。红外相机如图2所示。

图2 红外相机以及电源

通过电脑读取红外相机获取的原始实时流数据,由于原始红外数据是14位的,无法使用电脑显示出来,所以使用OpenCV对其进行预处理,转为8位数据,并对图像线性拉伸,提高对比度。整套录制场景如图3所示。

图3 红外数据录制场景

3 实验对比与分析

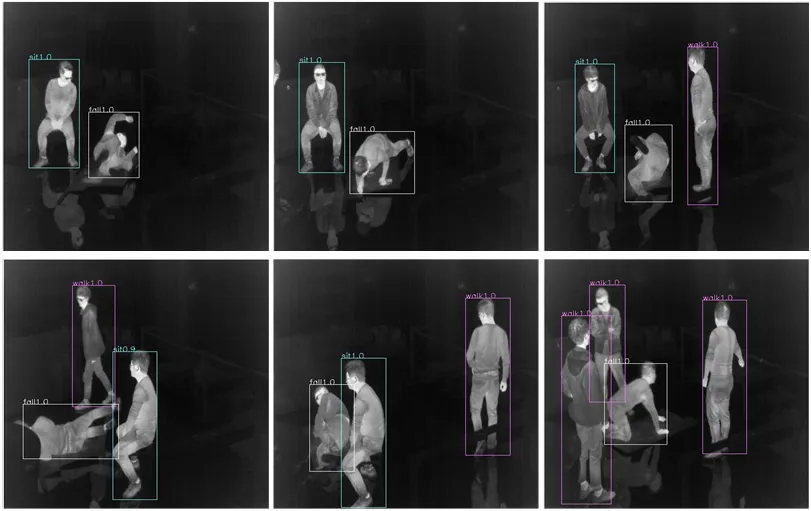

本文实验平台是一台Intel Xeon 八核E5- 2620V4(2.1GHz,QPI速度8.0GT/s),64G内存的高性能计算工作站。为了验证本文提出的检测方法,邀请了几位成人模拟室内日常活动以及摔倒行为,图像中包含单人活动、两人活动以及多人(3~4人)活动,共录制了4组数据,共获取到30000多张红外图像。对已经获取的红外人体摔倒数据集进行筛选,考虑到获取数据时帧率很高,导致相邻的图像内容变化不大,经过观察选择每10张中提取一张作为有效数据,提取大约3000张图像作为训练与测试数据,其中训练集2500余张,测试集约260余张。部分数据集如图4所示。

通过使用本文提出的检测方法在制作的红外行人摔倒数据集上进行测试,经过参数的调整,得到比较好的结果,部分实验结果如图5所示。

图4 部分人体摔倒数据集

图5 人体摔倒检测效果

在以往的人体摔倒检测中,摔倒的状态往往是平躺或者侧躺的姿势,本文为了提高样本的多样性,更加真实地模拟现实场景中的摔倒,添加了例如趴着、跪着摔倒以及由于摔倒而脚抬升等不同的摔倒姿势。通过图5中的实验结果可以看出,算法能够准确地检测出各种摔倒姿态与正常两状态。对于在摔倒时发生前有行人或物体遮挡情况下亦能准确检测,能够满足在一定场景内的行人摔倒检测需求。

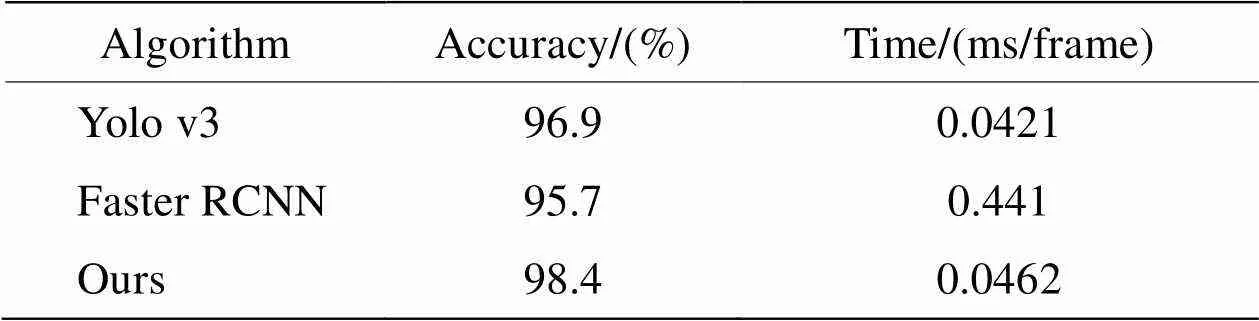

为了分析本文提出算法的性能和实时性,通过使用YOLO v3、Faster RCNN算法与之做对比实验,测试结果如表1所示。

表1 对比实验结果

从表中可以看出,Yolo v3与本文算法的运行速度很快,而Faster RCNN算法速度较慢。由于本文方法网络的整个输出都是直接从关键点估计得出,因此不需要基于IOU(intersection over union)的非极大值抑制NMS(non max suppression)或者其他后续处理,这对整个网络的检测速度有了很大的提升。表中可以看出本文方法在红外图像人体摔倒检测中准确率达到了98%以上,比其他两种方法高,对有遮挡和各种不同姿态的摔倒方式等较为复杂的情况下都能有效定位与识别。

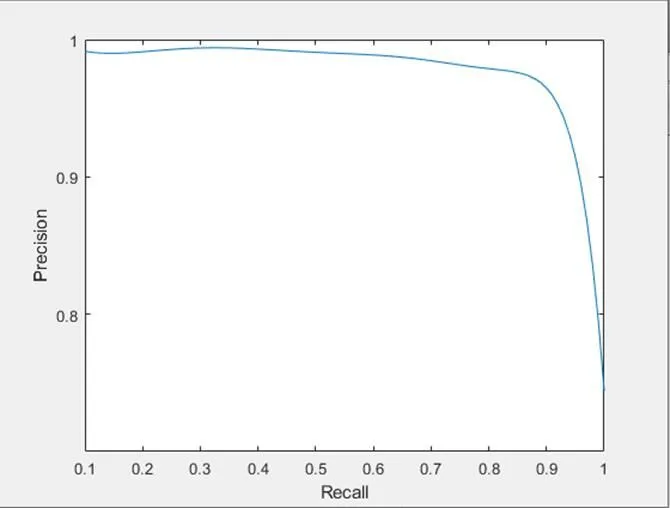

为了进一步分析实验结果的可靠性,选择摔倒检测中常用的准确率和召回率来对本文训练的模型进行评判。通过改变识别阈值,得到不同阈值下的准确率与召回率,最后得到P-R(precision-recall)曲线,如图6所示。

图6 本文算法的P-R曲线

对于P-R曲线来说,曲线下的面积越大,即AP(average precision)值越大,证明模型的性能越好。从图6曲线中能够看出,在使用的较少的测试数据下本文训练的模型性能优越,能够准确进行红外图像下的人体摔倒检测。

4 结束语

针对人体摔倒检测问题,本文提出了一种基于关键点估计的红外图像人体摔倒检测方法。基于目前人体摔倒检测所使用的数据集特点,搭建红外图像采集系统与环境,建立了自己的红外图像人体摔倒数据集。通过关键点估计来找到人体目标中心点,然后回归人体目标属性,如目标尺寸、标签等,从而得到检测结果。实验结果表明,本文提出的方法在红外图像上能实时地进行人体摔倒检测,有较好的准确性和鲁棒性,具有较高的实际应用价值。在未来的工作中,扩展自建的红外图像人体摔倒数据集,丰富人体摔倒的场景和姿态,进一步研究红外图像下人体摔倒检测问题是未来工作的重点研究内容。

[1] Santos G , Endo P, Monteiro K , et al. Accelerometer-based human fall detection using convolutional neural networks[J]., 2019, 19(7): 1644.

[2] Gia T N, Sarker V K, Tcarenko I, et al. Energy efficient wearable sensor node for IoT-based fall detection systems[J]., 2018, 56: 34-46.

[3] Nadee C, Chamnongthai K. Multi sensor system for automatic fall detection[C]//, 2015: DOI: 10.1109/APSIPA.2015.7415408.

[4] Tzeng H W, CHEN M Y, CHE J Y. Design of fall detection system with floor pressure and infrared im age[C]//2010, 2010: 131-135.

[5] Kerdegari H, Samsudin K, Rahman Ramli A, et al. Development of wearable human fall detection system using multilayer perceptron neural network[J]., 2013, 6(1): 127-136.

[6] LIU Chengyin, JIANG Zhaoshuo, SU Xiangxiang, et al. Detection of human fall using floor vibration and multi-features semi-supervised SVM[J]., 2019, 19(17): 3720(doi: 10.3390/s19173720).

[7] Mazurek P, Wagner J, Morawski R Z. Use of kinematic and mel- cepstrum-related features for fall detection based on data from infrared depth sensors[J]., 2018, 40: 102-110.

[8] MIN W, CUI H, RAO H, et al. Detection of human falls on furniture using scene analysis based on deep learning and activity characteristics[J/OL]., 2018, 6: 9324-9335.

[9] FENG W, LIU R, ZHU M. Fall detection for elderly person care in a vision-based home surveillance environment using a monocular camera[J].,, 2014, 8(6): 1129-1138.

[10] 邓志锋, 闵卫东, 邹松. 一种基于CNN和人体椭圆轮廓运动特征的摔倒检测方法[J]. 图学学报, 2018, 39(6): 30-35.

DENG Zhifeng, MIN Weidong, ZOU Song.A fall detection method based on CNN and human elliptical contour motion features[J]., 2018, 39(6): 30-35.

[11] 卫少洁, 周永霞. 一种结合Alphapose和LSTM的人体摔倒检测模型[J]. 小型微型计算机系统, 2019, 40(9): 1886-1890.

WEI Shaojie, ZHOU Yongxia.A human fall detection model combining alphapose and LSTM[J]., 2019, 40(9): 1886-1890.

[12] 赵芹, 周涛, 舒勤. 飞机红外图像的目标识别及姿态判断[J]. 红外技术, 2007, 29(3): 167-169.

ZHAO Qin, ZHOU Tao, SHU Qin.Target recognition and attitude judgment of aircraft infrared image[J]., 2007, 29(3): 167-169.

[13] ZHOU X, WANG D , Krhenbühl P. Objects as points [J/OL]. [2019- 04-25]. arXiv:1904.07850(https://arxiv.org/ abs/1904.07850).

[14] YU F, WANG D, Shelhamer E, et al. Deep layer aggregation[J/OL]. [2019-01-04]. arXiv:1707.06484(https://arxiv.org/abs/1707.06484)

[15] Law H, DENG J . CornerNet: detecting objects as paired keypoints[J]., 2020, 128(3): 642-656.

[16] LIN T Y, Goyal P, Girshick R, et al. Focal loss for dense object detection[J]., 2017: DOI: 10.1109/ICCV.2017.324.

Human Fall Detection Method Based on Key Points in Infrared Images

XU Shiwen,WANG Heng,ZHANG Hua,PANG Jie

(,,621000, China)

To address the problems with existing human fall detection methods for complex environments, which are susceptible to light, poor adaptability, and high false detection rates, an infrared image human fall detection method based on key point estimation is proposed. This method uses infrared images, which effectively eliminates the influence of factors such as lighting; first, the center point of the human target is found through a neural network, and second, the human target attributes, such as the target size and label, are regressed to obtain detection results. An infrared camera was used to collect human body fall images in different situations and establish datasets containing infrared images of human falls. The proposed method was used for experiments; the recognition rate exceeded 97%. The experimental results show that the proposed method has a higher accuracy and speed than other two methods in infrared image human fall detection.

infrared image, key point estimation, fall detection, neural network

TP391.4

A

1001-8891(2021)10-1003-05

2020-02-18;

2020-02-21.

徐世文(1994-),男,四川省成都市人,硕士研究生,主要研究方向为计算机视觉与图像处理、深度学习。E-mail:1411761943@qq.com。

王姮(1971-),女,硕士,教授,主要研究方向为机器人技术及应用、自动化技术研究。E-mail:wh839@qq.com。