MS-ADoG域结合ReNLU与VGG-16的矿井双波段图像融合算法

孙继平,范伟强

(中国矿业大学(北京)机电与信息工程学院,北京100083)

0 引言

煤炭是我国最主要的一次能源[1]。煤炭行业是高危行业,瓦斯、水、火、冲击地压、顶板、机电、运输等事故困扰着煤矿安全生产[2-3]。减少煤矿井下作业人员是煤矿安全生产的有效措施,是现代化煤矿的发展方向[4]。视频监控是煤矿井下少人和无人作业的必然选择[5-6]。矿用可见光(Visible,VIS)视频监控的图像具有分辨率高、色彩信息丰富的优点,但易受到人工光源(如矿灯、巷道灯、车灯等)干扰[3,7],导致图像探测器出现“光致饱和”和“图像串扰”,进而造成可见光图像中出现大面积亮斑和晕光等现象[8-9]。矿用远红外(Far Infrared,FIR)视频监控的图像抗干扰能力强,易于捕获暗环境或遮蔽后的热目标[10],但存在色彩单一、细节信息严重缺失、视觉效果不理想等问题[3,7]。基于VIS 和FIR 图像优势互补的异源图像融合技术,可有效提高低照度或复杂光照环境下目标与背景的信息[11-12],但无法消除矿井可见光图像的大面积亮斑和晕光。因此,解决视频监控中的伪目标、模糊目标、光晕掩藏目标等问题,提升视频图像质量,是矿井图像智能分析和地面远程监视亟待解决的问题。

近年来,国内外学者对不同谱段的图像融合技术进行了研究[13-14],并且在遥感监测、国防建设、工业视觉、医学诊断等领域得到了广泛应用[15],但其在矿井视频监控的图像应用方面却鲜有报道。目前,图像融合方法主要包括基于空间域[16]、变换域[16]、稀疏表示[17]、深度学习[18]的图像融合。其中,基于空间域的图像融合策略,如:Independent Component Analysis(ICA)[19]、Intensity Hue Saturation(IHS)[20]、YUV[21]、Brovery Transform[22]、Gram-Schmidt[23]算法等,执行效率高,能够保留红外目标信息及可见光细节特征,但在融合过程中易引入红外热噪声并出现伪影现象。基于变换域的图像融合策略中,已广泛采用的DWT、Contourlet变换、Curvelet 变换不具有平移不变性[24],导致融合图像易出现伪吉布斯现象,影响图像的视觉效果。Non-Subsampled Contourlet Transform(NSCT)、Non-Subsampled Shearlet Transform(NSST)、非下采样双树复轮廓波变换等具有平移不变性,但存在图像融合过程耗时长、运算效率低等缺陷[11,25-26]。基于稀疏表示的图像融合需要根据先验知识构造过完备字典和稀疏系数表示模型,计算过程复杂,模型具有较大局限性[17-18]。基于深度学习的图像融合具有提取源图像深层特征的优点,但存在卷积网络层数多,深度特征提取效率低,以及特征融合过程复杂等缺点。

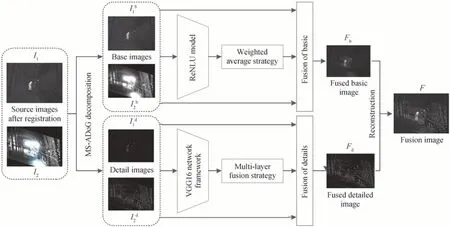

针对上述图像融合方法存在的问题,本文构建了基于多尺度和自适应高斯差分(Multi-scale and Adaptive Difference of Gaussian,MS-ADoG)的源图像分解模型,并通过该分解模型将源图像分解为基础图像和细节图像,设计了基于修正非线性单元(Rectified Non-Linear Units,ReNLU)的基础图像融合规则,使FIR 基础图像的权值随VIS 基础图像的灰度自动调节;采用预训练的VGG-16 神经网络模型提取细节图像的多层深度特征,并根据不同层的深度特征构造对应的显著图,利用池化反运算和加权融合策略,获取具有不同深度特征的融合图像,并通过“极大值选择”策略得到融合细节图像;将融合的基础图像和细节图像进行重构,得到消除光源干扰和场景清晰、特征显著的融合图像。

1 图像融合算法基础

基于变换域的融合图像具有细节信息丰富、视觉效果好等优点,实际应用较多。该融合算法首先采用变换函数对FIR 和VIS 图像进行多尺度分解,接着设计不同的融合策略对各层次的子图像进行融合,最后利用逆变换函数获取融合图像。基于高斯拉普拉斯变换的FIR 与VIS 图像融合框架如图1所示。

图1 基于高斯拉普拉斯变换的FIR 与VIS 图像融合框架Fig.1 Framework of FIR and VIS image fusion based on Laplace of Gaussian transform

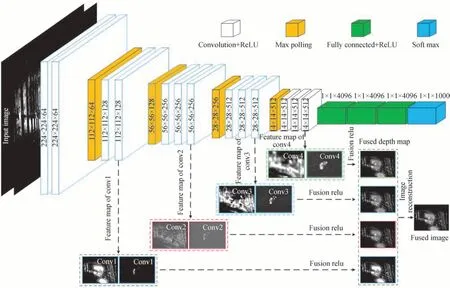

基于深度学习的图像融合技术以FIR 和VIS 图像的深度特征作为一种显著特征,用于重构融合图像。首先,利用卷积神经网络获取FIR 和VIS 图像的深度特征;接着,采用特定的融合规则对同一深度的显著特征进行融合[27];最后,对不同深度的融合特征图进行重构,获取融合图像。采用预训练的VGG-16 神经网络进行图像融合,对应的图像融合框架如图2所示。

图2 基于VGG-16 的FIR 与VIS 图像融合框架Fig.2 Fusion framework of FIR and VIS image based on VGG-16

2 双波段图像融合算法

2.1 基于MS-ADoG 的源图像分解模型

2.2 基于ReNLU 的基础图像融合规则

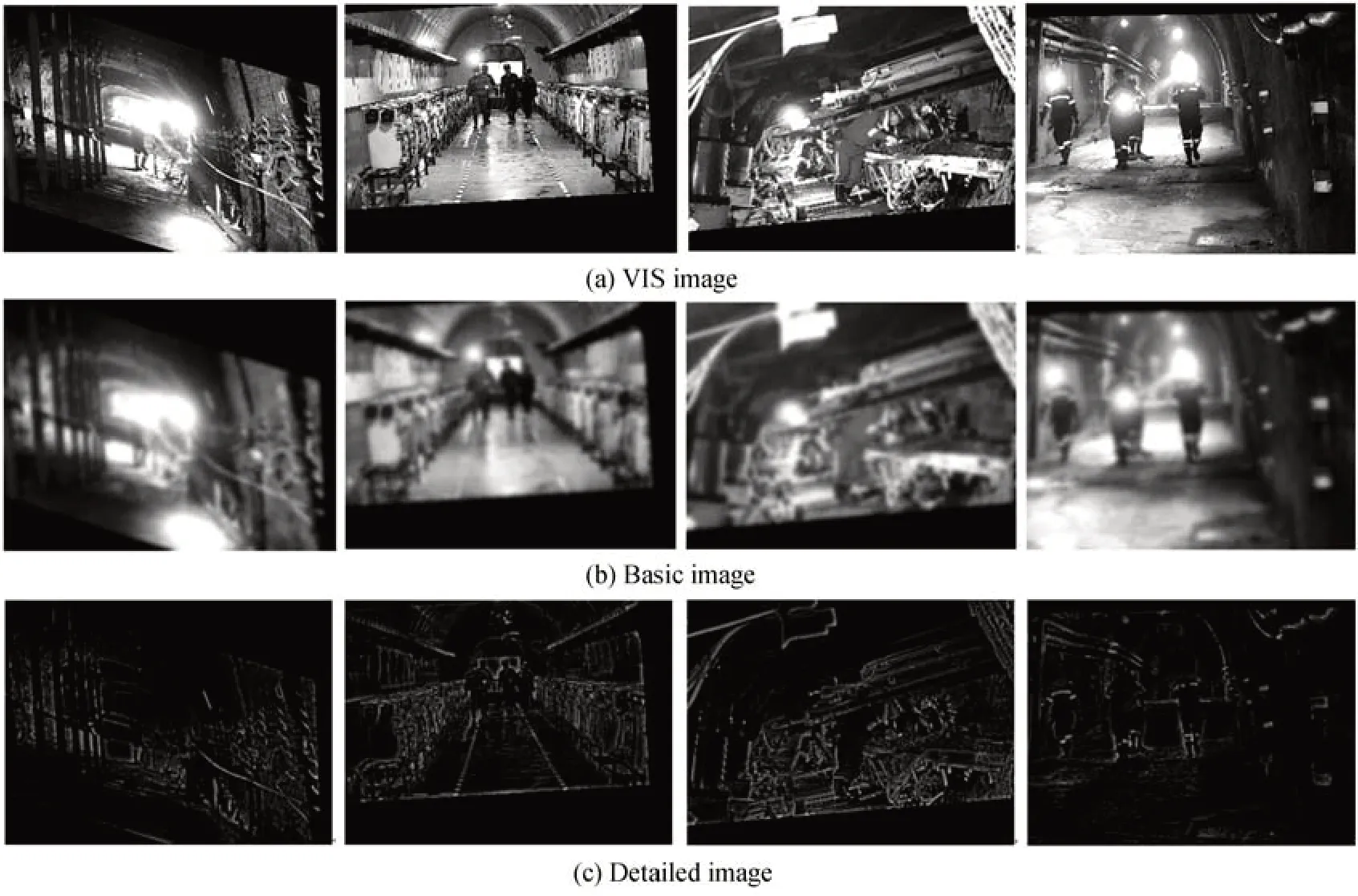

由图3 可知,矿井下VIS 图像的光源干扰部分集中于可见光基础图像(VIS 基础图像)中,并且在光源干扰部分无任何有效的场景信息。为提高矿井下融合图像的整体对比度和信息丰富度,对Ibk的融合策略要以消除VIS 基础图像中光源干扰部分为目的。鉴于此,根据光源干扰部分的灰度明显大于非光源干扰部分,并且灰度值逐渐增大至趋近于恒常数的特点,提出了基于ReNLU 函数的基础图像融合规则,使远红外基础图像(FIR 基础图像)的权值随VIS 基础图像的灰度自动调节。其主要融合思想为:在非光源干扰部分采用恒定权值方法实现VIS 基础图像和FIR 基础图像的信息融合;在光源干扰部分采用非恒定权值方法对两者进行融合,且随着干扰光源的灰度逐渐增大,FIR 基础图像对应的信息所占权重逐渐增大,VIS 基础图像对应的信息所占权重逐渐减小,当干扰光源中心区域对应的灰度趋于恒常数时,FIR 基础图像对应的信息所占权重趋近于1,VIS 基础图像对应的信息所占权重趋近于0,进而在融合后图像中消除光源干扰区域。构造的ReNLU 函数为

图3 VIS 图像、基础图像和细节图像Fig.3 VIS image,basic image and detailed image

式中,Imax为VIS 基础图像中像素的最大值。

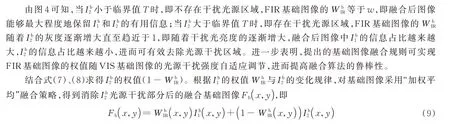

当w和Imax已知时,通过式(8)求得ReNLU 函数中a、b、c、d的数值。为了尽可能保留红外目标区域信息及可见光背景细节,并抑制可见光光源干扰区域,w取0.5。则ReNLU 函数关系如图4所示。

图4 权值w 与临界值T 的函数关系Fig.4 The functional relationship between the weight w and the critical value T

式中,Fb(x,y)为融合后的基础图像Fb在坐标(x,y)处的像素值。

由式(9)可知,融合基础图像Fb在光源干扰部分主要取红外图像信息,在非光源干扰部分对两者信息进行加权融合,以最大程度地保留两波段图像的有用信息。

2.3 基于VGG-16 的细节图像融合策略

由于VGG 是在AlexNet 网络的基础上开发的,具有良好的泛化能力,且采用的卷积网络能够很好地提取待融合图像中包含不同信息的深度特征[33]。为此,基于VGG-16 网络模型提出了一种新的细节图像融合策略,如图5所示。首先,采用预训练的VGG-16 网络模型[34]分别提取细节图像的多层深度特征;然后,根据多层深度特征构造深度特征权重图;最后,通过不同权重图与细节图像的融合和“极大值选择”的重构融合得到细节图像Fd。

图5 细节图像的融合策略框架Fig.5 The fusion strategy framework of detailed images

2.4 算法实现过程

图6 融合算法框架Fig.6 Framework diagram of fusion algorithm

3 实验结果与分析

为了验证本文算法的有效性,于2021年6月在宁夏煤业双马煤矿井下摄取了巷道、回采工作面、机电硐室等可见光和远红外图像,分辨率为384×288 像素。选取4 组经过配准的源图像进行实验验证。融合实验均在Windows 10 操作系统上进行测试,CPU 主频3.20GHz,内存16.00GB,编程工具为Matlab R2020a。此外,将本文算法与其他5 种典型融合算法(VSM-WLS[36]、LatLRR[37]、Improved HIS Curvelet[24]、DLFVGG16[33]、ResNet50-ZCA[38])的结果进行实验对比,从主观视觉效果和客观评价指标两方面对其进行分析讨论。实验中,为保证最佳的图像融合质量和融合效率,高斯模糊半径分别取2、4、6,其他5 种对比融合算法的参数设置均与原文献保持一致。

3.1 主观评价

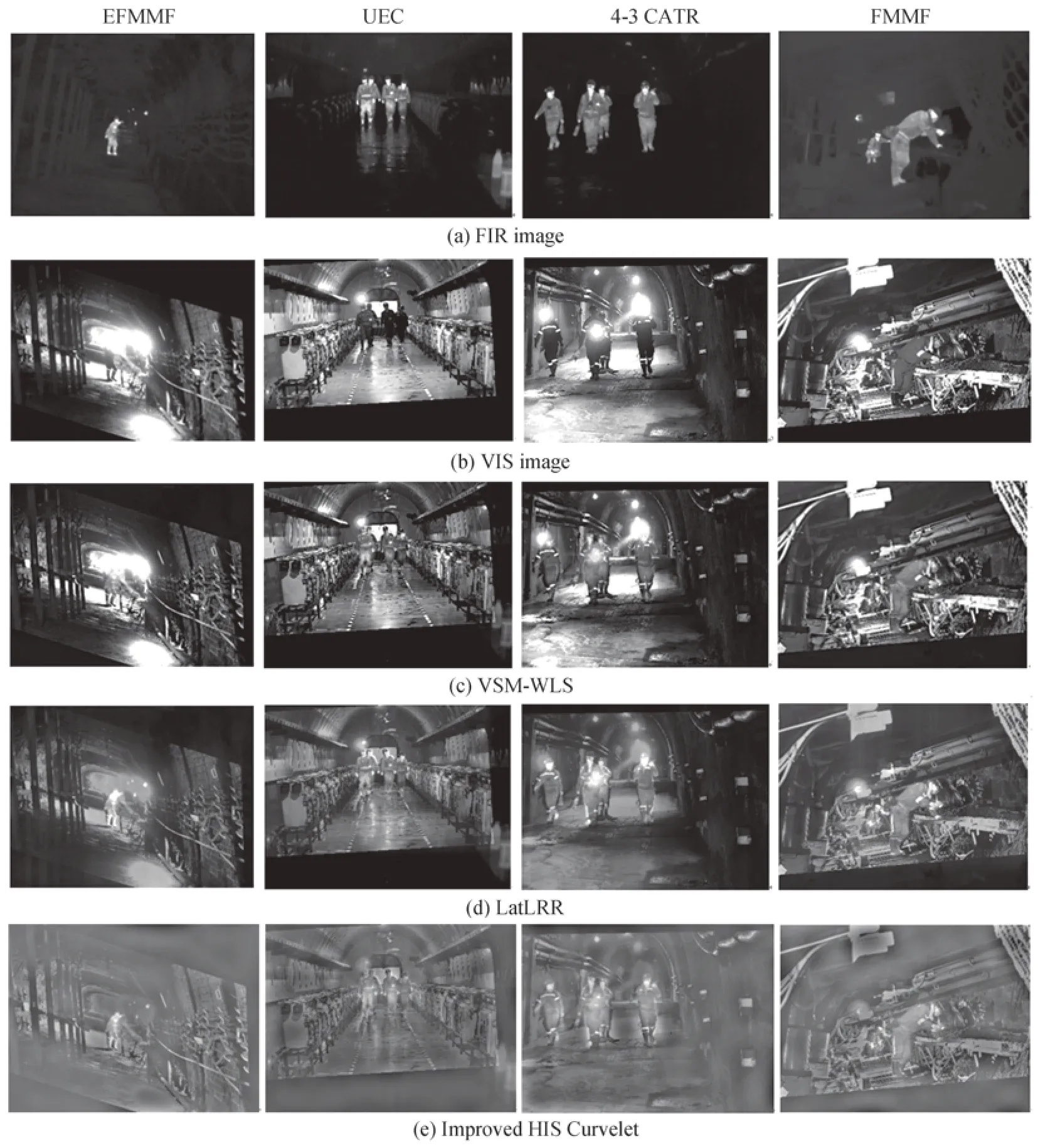

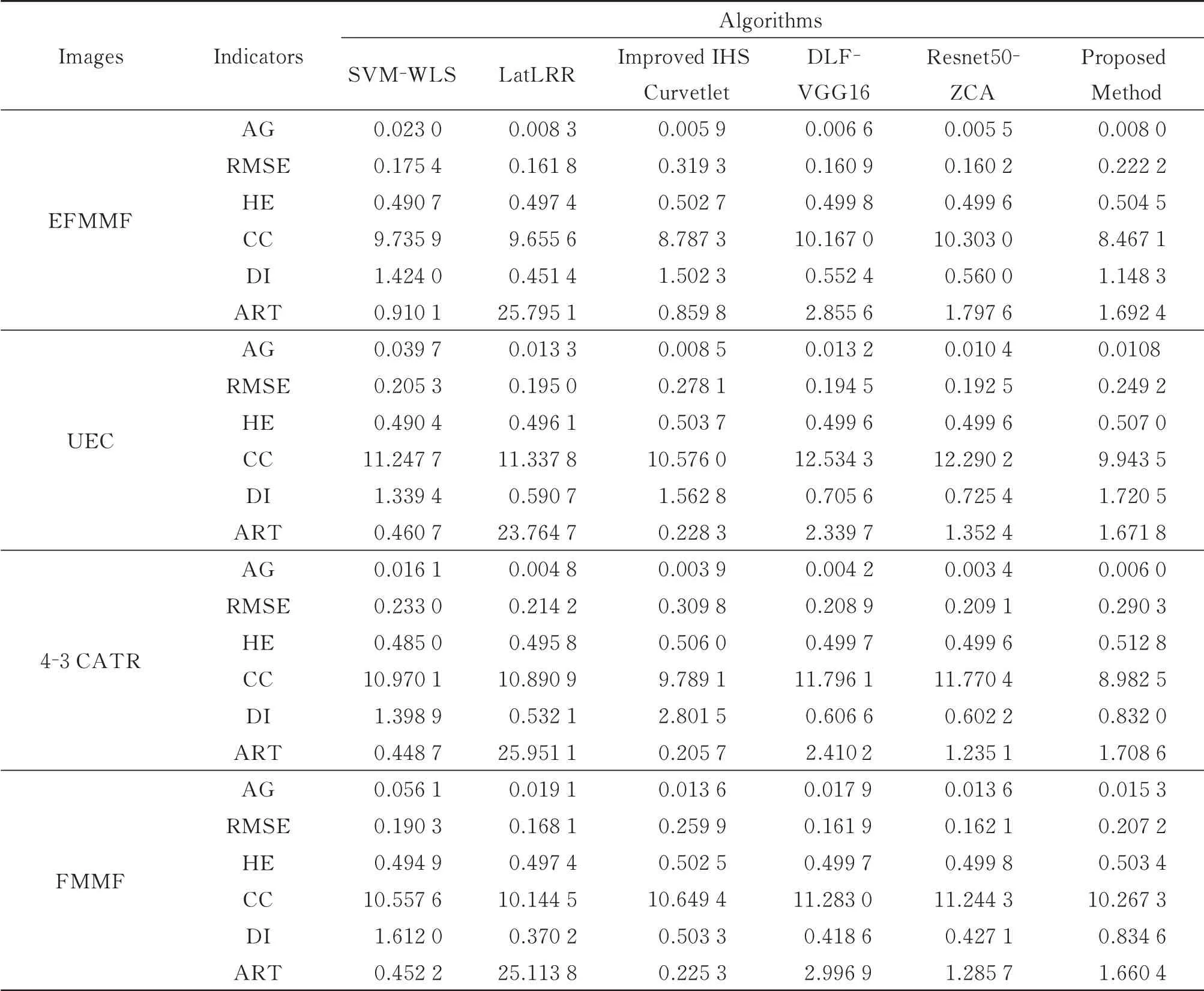

从构建的测试数据集中选取4 类典型的源图像进行融合实验,实验结果如图7所示。源图像分别采集于综采工作面端头(End of Fully Mechanized Mining face,EFMMF)、井下机电硐室(Underground Electromechanical Chamber,UEC)、4-3 煤辅助运输大巷(4-3 Coal Auxiliary Transportation Roadway,4-3 CATR)、综采工作面(Fully Mechanized Mining Face,FMMF)。

图7 FIR 与VIS 图像及其融合图像Fig.7 FIR and VIS images and fusion images

由各种融合算法的融合结果可知,图7(c)中的光源干扰部分无法消除,无法提高FIR 图像中热目标的显著性,图7(d)、(f)、(g)中的场景信息丰富度得到了显著提高,但光源干扰部分的抑制程度未发生明显性变化;图7(e)中的光源干扰部分消除不彻底,场景信息模糊,且整体清晰度较低;图7(h)中的光源干扰部分得到了可靠的消除,且场景信息的丰富度得到了显著提高,同时视场的概貌特征和目标的边缘、纹理等细节信息清晰度高,视觉感良好。

综上分析,5 种典型融合算法的融合图像均具有不同的缺陷,其中VSM-WLS 采用视觉显著图的低频融合策略提高了融合图像的亮度,但无法消除光源干扰对融合图像造成的影响;LatLRR、DLF-VGG16 和ResNet50-ZCA 采用的融合策略均侧重于对细节图像的融合,融合图像的细节信息得到了较好的融合,但未考虑低频部分中光源干扰对融合图像的影响;Improved HIS Curvelet 采用低频系数权值自动调节的融合策略能够消除矿井下的光源干扰,但对高频系数直接采用“极大值选择”方法进行融合,导致融合后图像中引入大量噪声,造成目标轮廓模糊,整体清晰度不高;本文算法采用基于MS-ADoG 的源图像分解模型,可相对彻底地分离出基础图像中的细节信息,采用基于ReNLU 的基础图像融合策略可实现对光源干扰的消除,通过多层深度特征的细节图像融合策略较好地保留了背景和目标的细节特征,更符合人的视觉特性。

3.2 客观评价

为了验证算法在不同光照环境中的融合性能,选取5 种典型指标对5 种对比算法和本文算法的融合性能进行比较。同时,采用平均运行时间(Average Running Time,ART)作为一个重要指标,对不同融合算法的运行效率进行评价。

1)平均梯度(Average Gradient,AG)。AG 用于描述图像的整体空间活跃度[39],反映图像中的微小细节反差和纹理变化能力。AG 越大,融合图像越清晰。AG 的值RAG表示为

式中,M×N为图像尺寸,∇fx、∇fy分别为图像在行、列方向上的一阶差分算子。

2)均方根误差(Root Mean Square Error,RMSE)。RMSE 通过计算融合图像与参考图像之间像素误差的全局大小来衡量图像质量的好坏[40]。RMSE 的值越大,表明融合算法对抑制图像噪声和消除光源干扰部分的能力越强。RMSE 的值RRMSE表示为

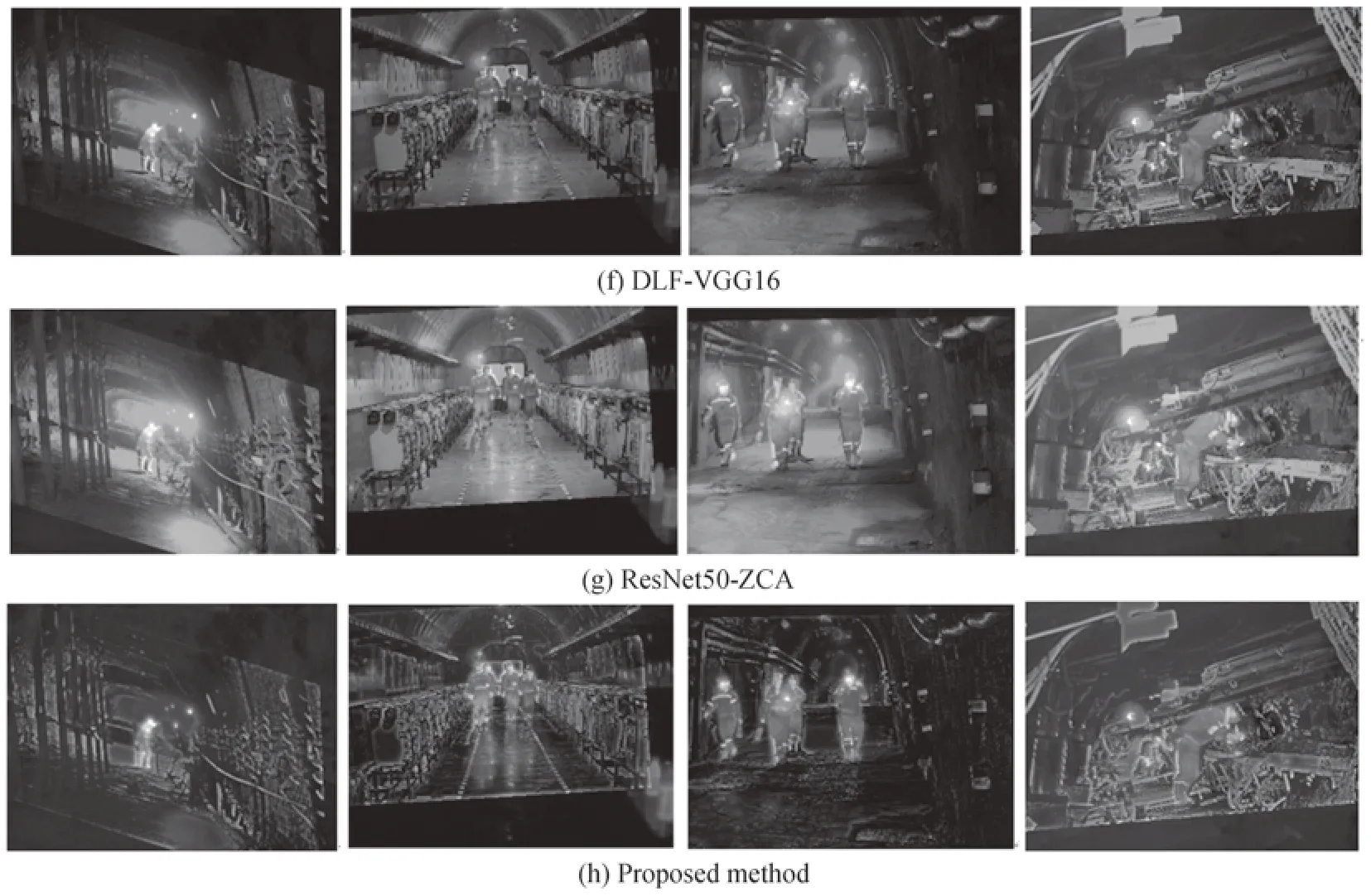

3)相关系数(Correlation Coefficient,CC)。CC 反映了融合图像与参考图像之间的相关程度[39]。CC 的值越大,表明两幅图像高度相关,说明对原始信息的保持越好。CC 的值RCC可表示为

4)光晕消除度(Halation Elimination,HE)。HE 用于评价融合图像对光源干扰部分的消除能力,能够更加客观评价图像的人眼主观效果[41]。HE 的值越大,融合图像对光源干扰部分的消除效果越好,表示为

式中,RHE为光晕消除度指标值,SSIM(·)为结构相似性算子。

5)偏差指数(Deviation Index,DI)。DI 表示融合图像与参考图像的相对偏差。DI 的值越大,两者在光谱信息上的相对差异越大[40],即融合图像对参考图像的噪声抑制作用越大。DI 的值RDI可表示为

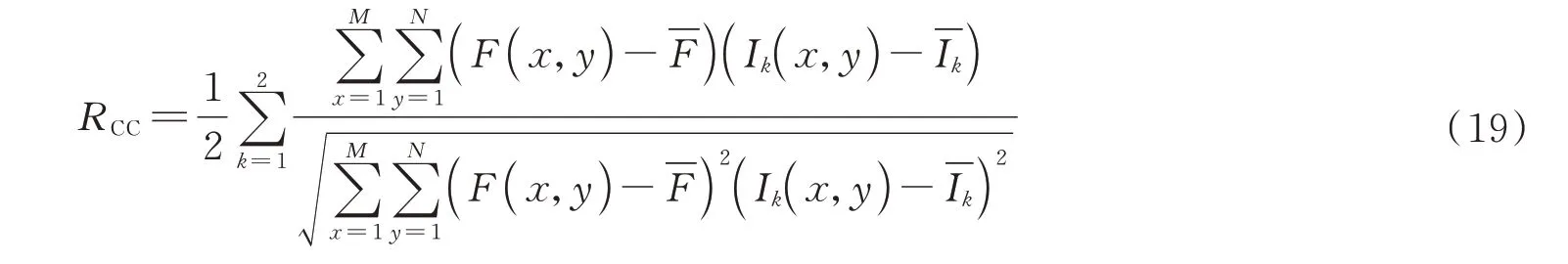

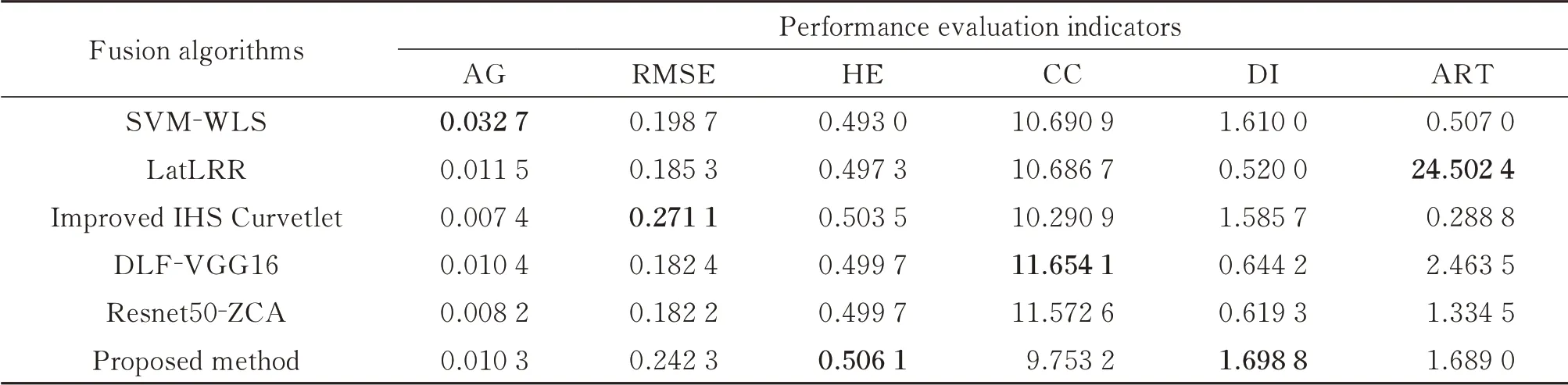

依据5 种典型客观评价指标和ART,依次获取4 类典型源图像所对应融合图像的客观评价指标值,如表1所示。

表1 不同算法在4 类源图像下的性能指标Table 1 Performance indicators of different algorithms under 4 types of source images

根据5 种典型客观评价指标和ART 求解公式,获取数据集中13 组源图像在融合后的客观评价指标。结合表1 数据,计算13 组融合图像的客观评价指标平均值,如表2所示。

表2 不同融合方法的性能指标平均值Table 2 Average performance indicators of different fusion methods

根据表2 数据绘制折线图,如图8所示。

图8 评价指标折线图Fig.8 Line chart of evaluation indicators

根据表1~2 和图8 中的5 种典型评价指标和ART 可知,本文算法的AG、RMSE、HE、DI 值较高,表明该算法比其他对比算法获得的融合图像质量更高。本文算法在抑制图像噪声和消除图像中的光源干扰时,在一定程度降低了原图像和融合图像的相关程度CC 值,但也反映了本文算法在增强图像清晰度、抑制图像噪声和消除图像中光源干扰方面具有明显的优势,这与主观视觉分析一致。SVM-WLS 算法的AG、DI 值很大,但HE 值很小,即该类方法能够增强图像清晰度,但无法去除图像中的光源干扰;LatLRR、DLFVGG16、ResNet50-ZCA 算法的RMSE、HE、DI 值较小,即该类方法对抑制图像噪声和消除光源干扰部分的能力较弱;Improved IHS Curvetlet 算法的RMSE、HE、DI 值较大,但AG 较小,即该类方法能够消除图像中的光源干扰,但易导致图像概貌特征丢失,无法改善图像的清晰度。Improved IHS Curvetlet 算法的CC 值较小,这是由于在消除光晕现象时,一定程度上扭曲了源图像的结构信息,导致相关系数偏低。从ART 的数据值和折线图来看,LatLRR 算法的ART 值较大,即该类图像融合方法易降低融合效率;本文算法与SVMWLS、Improved IHS Curvetlet、DLF-VGG16、Resnet50-ZCA 算法相比ART 值较小,即该算法能够适用于实时性要求较高的场所。

通过主观视觉和客观评价可知,本文算法不仅具有较高的融合质量和融合效率,而且能够很好地保留背景和目标的细节特征,更符合人的视觉特性。此外,本文算法在抑制图像噪声和消除井下人工光源干扰方面优于对比算法,更够满足矿井多源图像智能分析和地面远程监视的实际需求。

4 结论

本文提出了MS-ADoG域结合ReNLU与VGG-16的矿井双波段图像融合算法。利用设计的MSADoG 分解模型,实现了将源图像分解为包含概貌特征的基础图像和纹理信息的细节图像;采用构造的ReNLU 函数,实现了FIR 基础图像的权值随VIS 基础图像的灰度值自动调节的目的,并实现了对FIR 和VIS 基础图像的快速融合和干扰光源的消除;通过基于预训练的VGG-16 网络模型获得细节图像的不同网络深度特征,并使用l1范数和高斯算子得到了不同深度特征的显著图;利用池化反运算和加权融合策略获取每一对显著图对应的初始融合的细节图像,并采用“极大值选择”方法获取了融合的细节图像。将融合的基础图像和细节图像进行重构,得到了消除光源干扰和场景清晰、特征显著的融合图像。

选取煤矿井下4 种不同场景中的源图像,结合5 种典型的图像融合算法进行主观分析,并采用5 种融合图像质量评价指标和平均运行时间进行客观评价。实验结果表明,本文提出的矿井双波段图像融合算法具有较高的融合质量和融合效率,在抑制图像噪声和消除井下人工光源干扰方面优于现有算法,可用于矿井多源图像智能分析和地面远程监视,还可用于消除地下空间、地下工程或夜间道路视频监控图像中的人工光源干扰问题。