基于深度多级小波U-Net的车牌雾图去雾算法

陈炳权 朱熙 汪政阳 梁寅聪

摘要:为了解决雾天拍摄的车牌图像边缘模糊、色彩失真的问题,提出了端到端的基于深度多级小波U-Net的车牌雾图去雾算法.以MWCNN为去雾网络的主体框架,利用“SOS”增强策略和编解码器之间的跨层连接整合小波域中的特征信息,采用离散小波变换的像素-通道联合注意力块降低去雾车牌图像中的雾度残留.此外,利用跨尺度聚合增强块补充小波域图像中缺失的空间域图像信息,进一步提高了去雾车牌图像质量.仿真实验表明,该网络在结构相似度和峰值信噪比上具有明显的优势,在处理合成车牌雾图和实际拍摄的车牌雾图上,去雾效果表现良好.

关键词:车牌雾图去雾;MWCNN;“SOS”增强策略;跨层连接;注意力;跨尺度聚合

中图分类号:TP391.41文献标志码:A

Dehazing Algorithm of License Plate Fog Image Based on Deep Multi-level Wavelet U-Net

CHEN Bingquan,ZHU Xi,WANG Zhengyang,LIANG Yincong

(College of Information Science and Engineering,Jishou University,Jishou 416000,China)

Abstract:To solve the problem of edge blurring and color distortion of license plate images taken in foggy weather,an end-to-end depth multilevel wavelet U-Net based algorithm for license plate fog image removal is presented. Taking MWCNN as the main frame work of the defogging network,the feature information in the wavelet domain is integrated using the “SOS”enhancement strategy and the cross-layer connection between the codec. The pixel-channel joint attention block of the discrete wavelet transform is used to reduce the fog residue in the defrosted license plate image. In addition,the cross-scale aggregation enhancement blocks are used to supplement the missing spatial domain image information in the wavelet domain image,which further improves the quality of the defogging license plate image. The simulation results show that the network has obvious advantages in structural similarity and peak signal-to-noise ratio,and it performs well in dealing with the composite plate fog image and the actual photographed plate fog image.

Key words:license plate fog image defogging;MWCNN;“SOS”enhancement strategy;cross-layer connection;attention mechanism;cross-scale aggregation

在大霧天气下使用光学成像器件(如相机、监控摄像头等)对目标场景或物体进行拍摄时,往往会使得图像对比度低,边缘、字符等细节信息模糊.图像去雾是图像处理中典型的不适定问题,旨在从雾天图像中复原出相应的无雾图像,作为一种提升图像质量的方法,已被广泛应用于图像分类、识别、交通监控等领域.近年来,针对不同场景(室内家居场景、室外自然场景、交通道路场景、夜间雾霾场景等)下均匀雾度或非均匀雾度图像的去雾技术引起了广泛关注与研究,但由于实际雾霾对图像影响的复杂多变性,从真实的雾天图像中复原无雾图像仍具有诸多挑战性.

图像去雾技术发展至今,主要分为以下三类:基于数学模型的去雾技术,如直方图均衡[1]、小波变换[2]、色彩恒常性理论[3](Retinex)等;基于大气散射模型(ASM)和相关统计先验的去雾技术,如暗通道先验[4-5](DCP)、色衰减先验[6](CAP)、非局部先验[7](NLP)等;基于深度学习的去雾技术,如DehazeNet[8]、DCPDN[9]、AODNet[10].近年来,深度卷积神经网络在计算机视觉中应用广泛,2019年Liu等[11]认为传统的卷积神经网络(CNN)在采用池化或空洞滤波器来增大感受野时势必会造成信息的丢失或网格效应,于是将多级小波变换嵌入到CNN中,在感受野大小和计算效率之间取得了良好的折中,因而首次提出了多级小波卷积神经网络(MWCNN)模型,并证实了其在诸如图像去噪、单图像超分辨率、图像分类等任务中的有效性.同年,Yang等[12]也认为离散小波变换及其逆变化可以很好地替代U-Net中的下采样和上采样操作,因而提出了一种用于单幅图像去雾的小波U-Net网络,该网络与MWCNN结构非常相似.2020年,Yang等[13]将多级小波与通道注意力相结合设计了一种小波通道注意力模块,据此构建了单幅图像去雨网络模型.同年,Peng等[14]则将残差块与MWCNN相结合提出了一种用于图像去噪的多级小波残差网络(MWRN).2021年,陈书贞等[15]在已有的MWCNN结构上加入多尺度稠密块以提取图像的多尺度信息,并在空间域对重构图像进行进一步细化处理,以弥补小波域和空间域对图像信息表示存在的差异性,从而实现了图像的盲去模糊.

为了解决大雾天气下车牌图像对比度低和边缘、字符等信息模糊不清的问题,很多研究人员开始将已有的图像去雾技术应用于车牌识别的预处理中.但大多数只是对已有图像去雾算法进行了简单改进,如对Retinex或DCP等去雾算法进行改进,直接应用于车牌检测识别中.虽然取得了一定的去雾效果,但其并没有很好地复原出车牌图像的特征,且很难应对中等雾和浓雾下的车牌图像.2020年王巧月等[16]则有意识地针对车牌图像的颜色和字符信息进行车牌图像的去雾,提高了车牌图像的质量.

受上述研究的启发,本文提出一种基于深度多级小波U-Net的车牌雾图去雾算法,以端到端的方式来实现不同雾度下不同车牌类型的去雾.首先,提出了一种结合DWT、通道注意力(CA)和像素注意力(PA)的三分支结构,该结构可以对编码器每层输出特征的通道和像素进行加权处理,从而让去雾网络聚焦于车牌雾图中的有雾区域;其次,在解码器中引入“SOS”增强模块(“SOS”Block)来对解码器和下层输入的特征进行进一步融合和增强,提高去雾图像的峰值信噪比,并在U-Net编解码结构之间进行了层与层之间的连接,以此来充分利用不同网络层和尺度上的特征信息;最后,为弥补小波域和空间域之间网络表达图像信息的差异,提出了一种结合跨尺度聚合(CSA)的多尺度残差增强模块(CSAE Block),在空间域上进一步丰富网络对于图像细节信息的表达,有效地提高去雾图像的质量.

1去雾网络结构

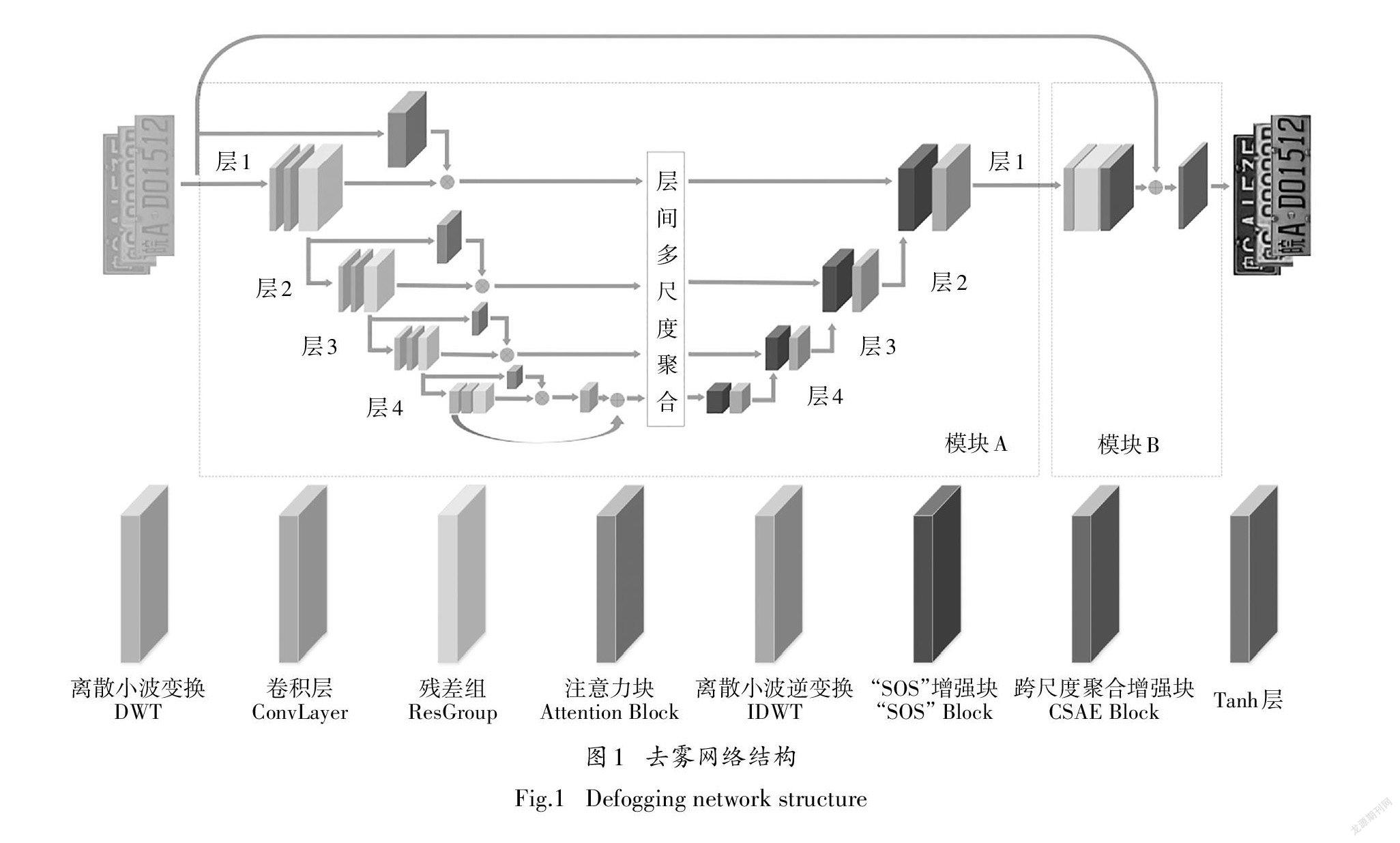

本文去雾网络结构如图1所示.

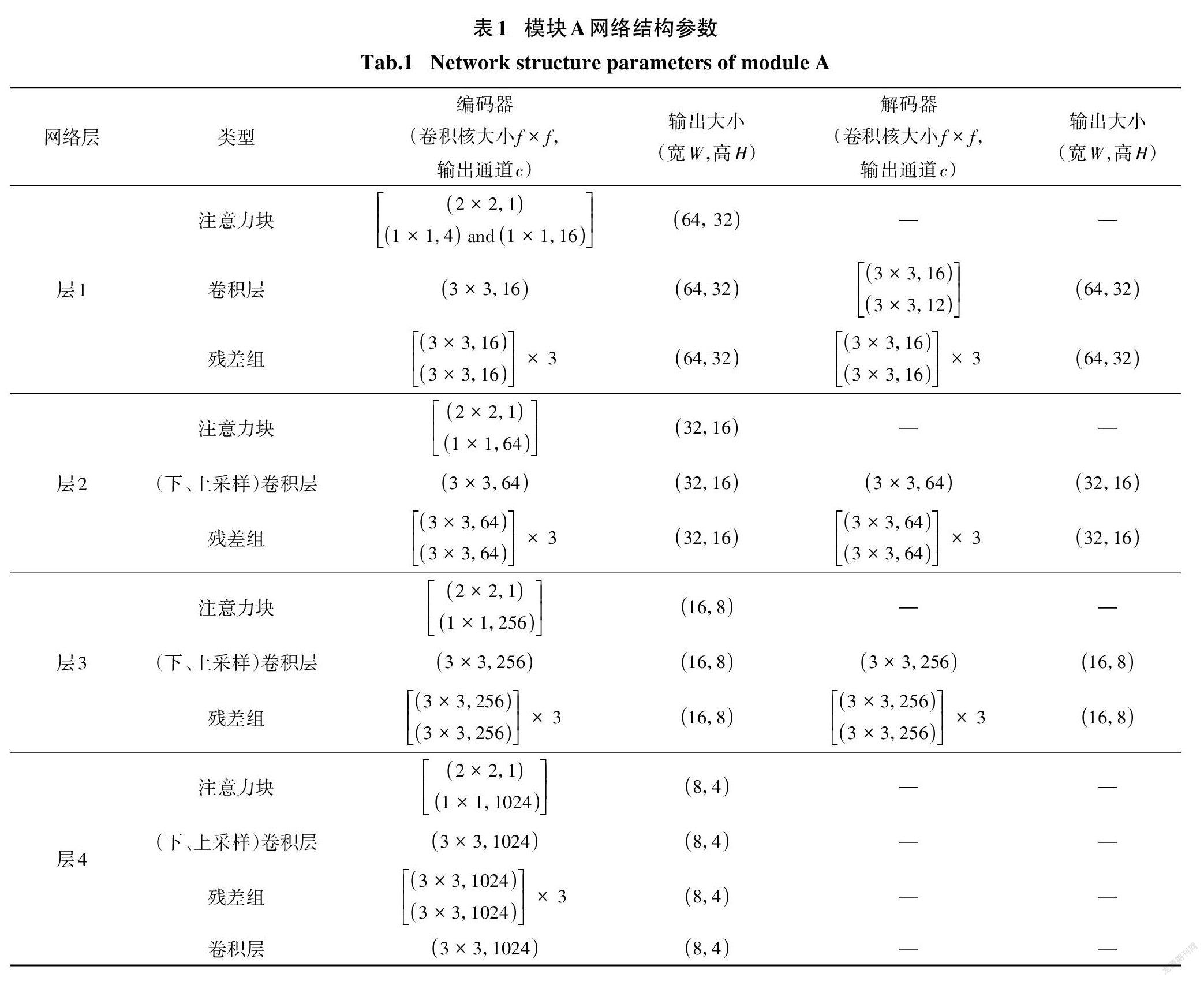

该网络主要分为A与B这2大模块,前者在小波域中实现对车牌雾图x的去雾,后者在空间域上对模块A输出的无雾图像进行进一步优化,模块A 的网络结构参数见表1.整个网络结构的输出为:

y=y(y(x;θ);θ)(1)

式中:y(·)和y(·)分别为模块A和B的输出,θ

和θ分别表示模块A和B的可学习参数.

1.1小波U-Net

二维离散小波变换(2D-DWT)可以实现对给定的图像I的小波域分解,分解过程可视为将图像I与4个滤波器进行卷积,即1个低通滤波器f和3个高通滤波器(f、f和f),这4个滤波器(即卷积核)分别由低通滤波器f和高通滤波器f构成.以Haar小波为例,该卷积核表示为:

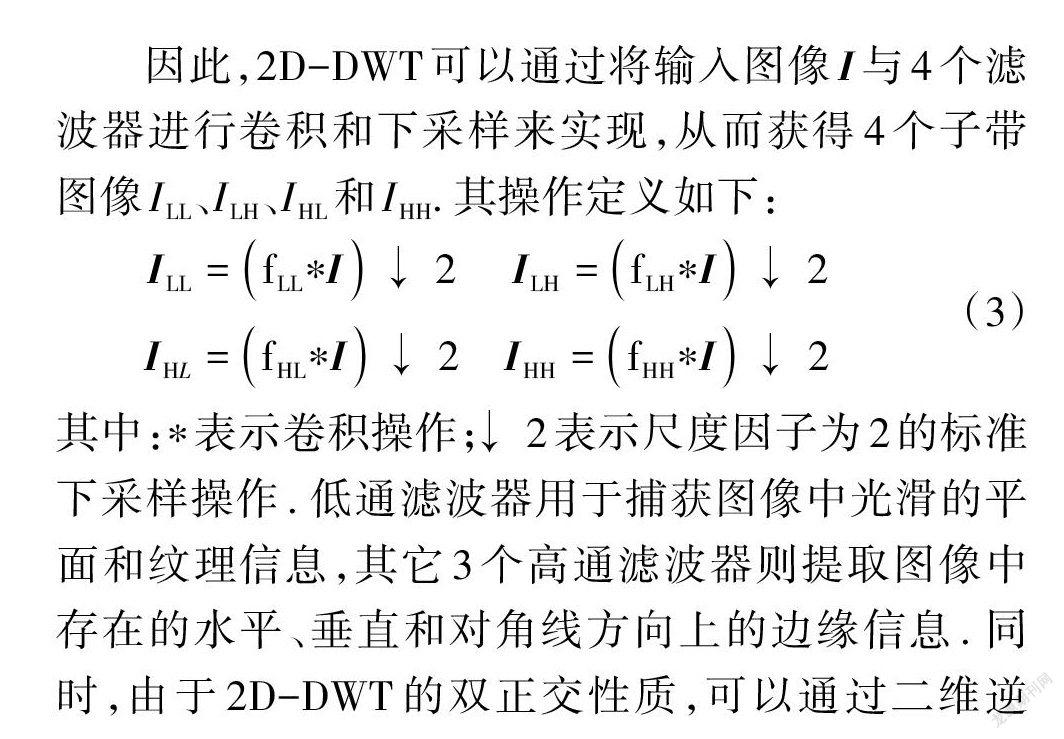

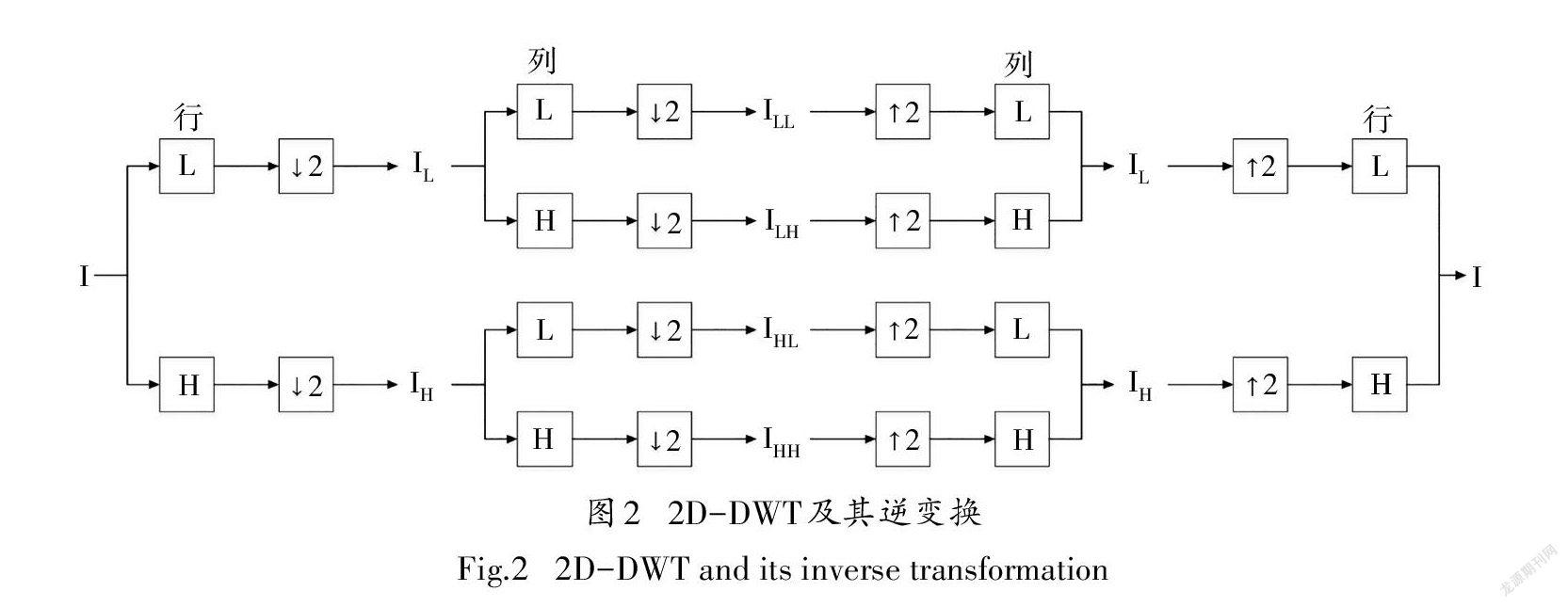

因此,2D-DWT可以通过将输入图像I与4个滤波器进行卷积和下采样来实现,从而获得4个子带图像I、I、I和I.其操作定义如下:

I=(f*I)↓2I=(f*I)↓2

I=(f*I)↓2I=(f*I)↓2(3)

其中:*表示卷積操作;↓2表示尺度因子为2的标准下采样操作.低通滤波器用于捕获图像中光滑的平面和纹理信息,其它3个高通滤波器则提取图像中存在的水平、垂直和对角线方向上的边缘信息.同时,由于2D-DWT的双正交性质,可以通过二维逆DWT的精确重建出原始图像.2D-DWT及其逆变换的分解和重建示意图如图2所示.

本文将2D-DWT及其逆变换嵌入到U-Net网络结构中,改善原始U-Net网络的结构.首先,对输入的3通道车牌雾图进行离散小波变换处理,输出图像的通道数变为原来的4倍,图像大小变为原来的1/2;然后,使用一个单独的卷积层“3×3卷积+Lea- kyReLU”)将输入图像扩展为16通道的图像;最后,在U-Net的每层中迭代使用卷积层和离散小波变换用于提取多尺度边缘特征.

1.2基于2D-DWT的通道-像素联合注意力块(DCPA Block)

在去雾网络中平等对待不同的通道和像素特征,对于处理非均匀雾度图像是不利的.为了能灵活处理不同类型的特征信息,Qin等[17]和Wu等[18]均采用CA和PA,前者主要用于对不同通道特征进行加权,而后者则是对具有不同雾度的图像像素进行加权,从而使网络更关注雾度浓厚的像素和高频区域.

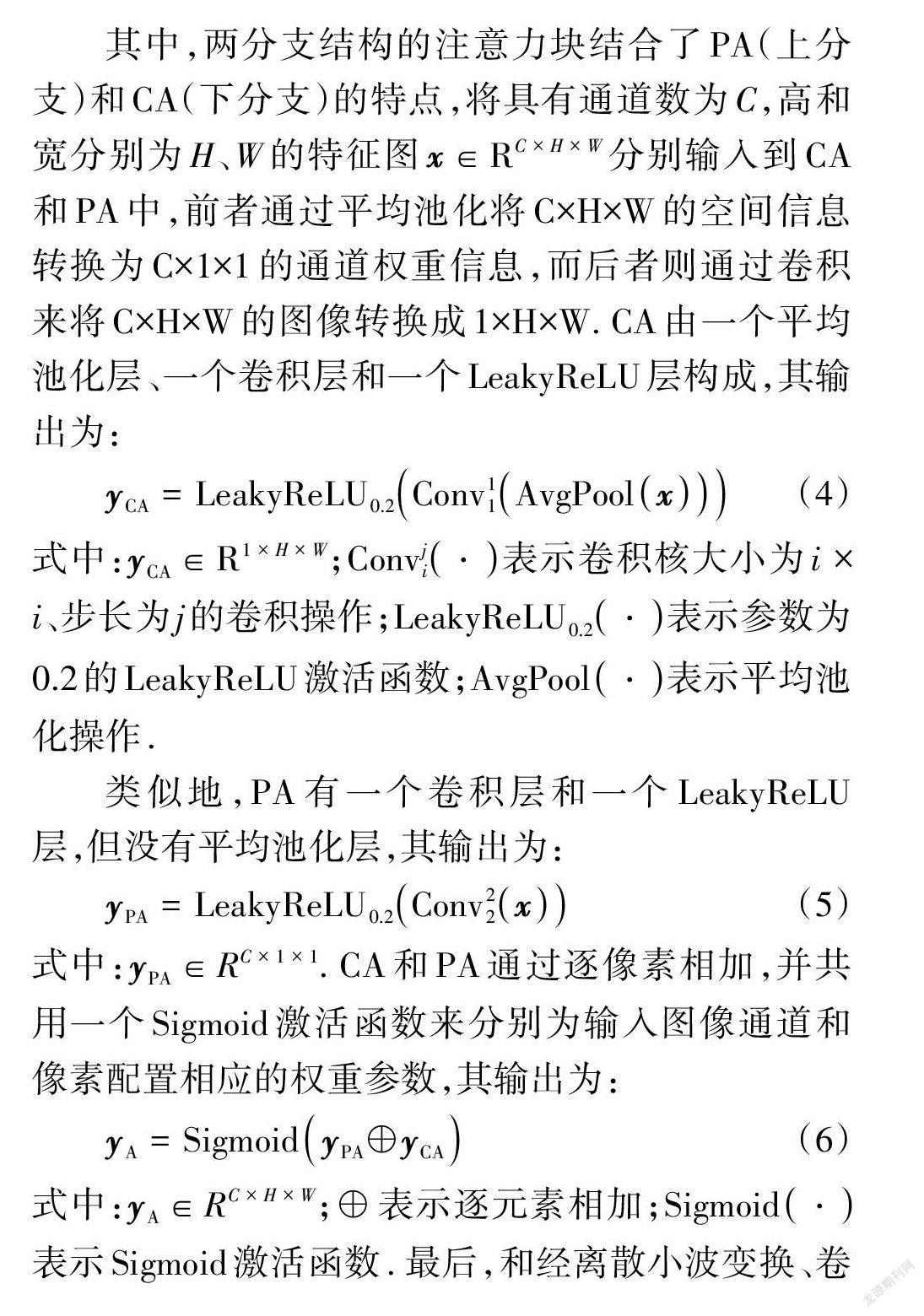

引入Hao-Hsiang Yang等[13]的小波通道注意力块,本文提出了一种基于二维DWT的通道-像素联合注意力模块,将DWT、CA和PA构建并行的三分支结构,如图3所示.

其中,两分支结构的注意力块结合了PA(上分支)和CA(下分支)的特点,将具有通道数为C,高和宽分别为H、W的特征图x∈R分别输入到CA和PA中,前者通过平均池化将C×H×W的空间信息转换为C×1×1的通道权重信息,而后者则通过卷积来将C×H×W的图像转换成1×H×W.CA由一个平均池化层、一个卷积层和一个LeakyReLU层构成,其输出为:

类似地,PA有一个卷积层和一个LeakyReLU 层,但没有平均池化层,其输出为:

式中:y∈R.CA和PA通过逐像素相加,并共用一个Sigmoid激活函数来分别为输入图像通道和像素配置相应的权重参数,其输出为:

y=Sigmoid(y⊕y)(6)

式中:y∈R;⊕表示逐元素相加;Sigmoid(·)表示Sigmoid激活函数.最后,和经离散小波变换、卷积层和残差组处理后的特征图进行逐元素相乘,从而实现对特征图的加权,其最终输出为:

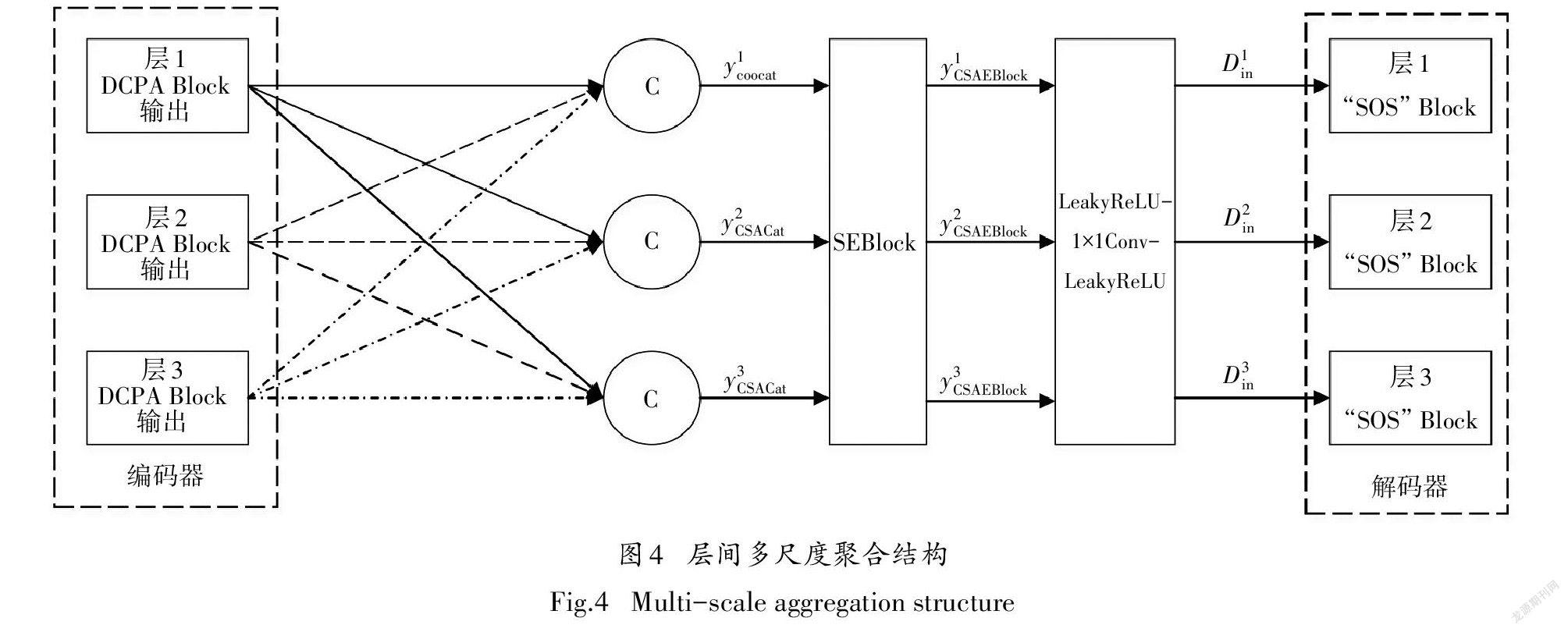

1.3层间多尺度聚合(LMSA)

受到Park等[19]在图像去雾任务中采用多级连接来复原图像细节信息的启示,将U-Net编码器中前3 层中DCPA Block的输出进行跨层和跨尺度的特征聚合,使网络能充分利用图像潜在的特征信息,其结构如图4所示.

式中:FC(·)表示全连接层函数;ReLU(·)为ReLU非线性激活函数.SEBlock的结构如图5所示.

通过“LeakyRelu-Conv-LeakyRelu”操作减少每层输出特征的通道数,输入到U-Net解码器中前3层的“USOS”Block中,提升重构图像的峰值信噪比.

U-Net网络中的第4层则聚合前2层的DCPA Block输出特征和第3层的DWT输出特征,同样经过SEBlock 和“LeakyRelu-Conv-LeakyRelu”操作后作为第4层的输入特征进行后续操作.其数学表达式为:

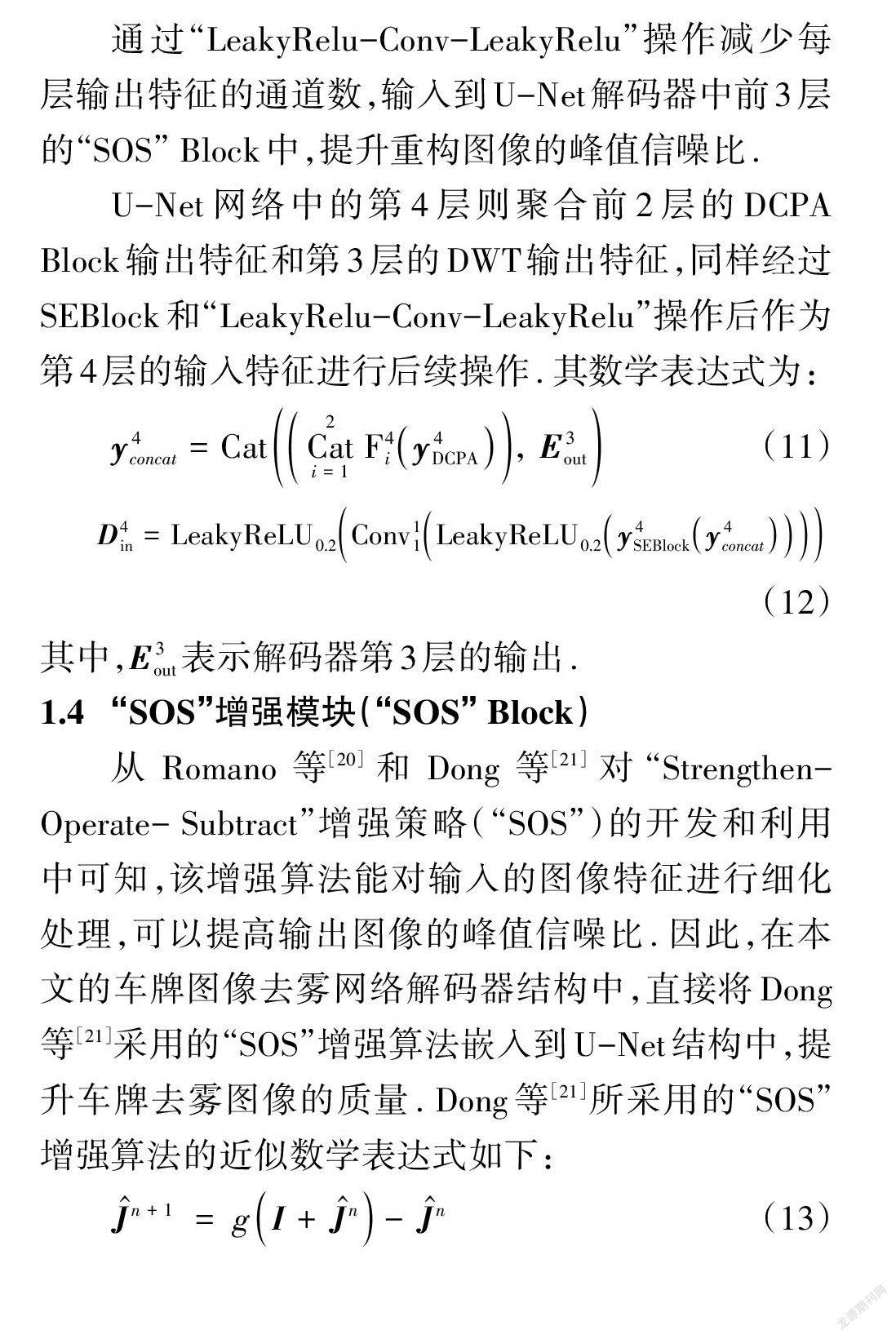

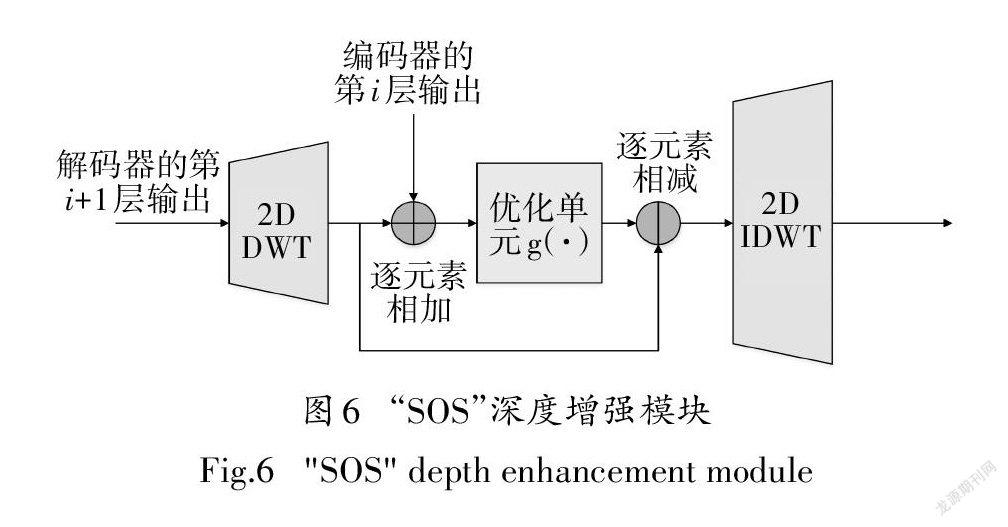

1.4“SOS”增强模块(“SOS”Block)

从Romano等[20]和Dong等[21]对“Strengthen- Operate-Subtract”增强策略(“SOS”)的开发和利用中可知,该增强算法能对输入的图像特征进行细化处理,可以提高输出图像的峰值信噪比.因此,在本文的车牌图像去雾网络解码器结构中,直接将Dong等[21]采用的“SOS”增强算法嵌入到U-Net结构中,提升车牌去雾图像的质量.Dong等[21]所采用的“SOS”增强算法的近似数学表达式如下:

其中:↑2表示尺度因子为2的上采样操作.其与U- Net相结合的结构示意图如图6所示.

1.5跨尺度聚合增强模块(CSAE Block)

为了弥补小波域中去雾网络所忽略的精细空间域图像特征信息,本文提出了一种基于残差组的跨尺度聚合增强模块(CSAE Block),对小波域网络(模块A)最后输出的重构图像进行空间域上的图像细节特征补充.CSAE Block结构如图7所示.

CSAE Block主要由卷积层(即“3×3卷积-LeakyReLU”)、残差组、平均池化、CSA和级联操作构成.首先,卷积层和残差组负责对模块A输出的空间域图像y进行特征提取,平均池化将输入特征分解为4个不同尺度(S=1/4,S=1/8,S=1/16和S=1/32)的输出,即:

然后,CSA实现对输入的不同尺度、空间分辨率的特征信息进行聚合,从而达到在所有尺度级别上有用信息的融合,并在每个分辨率级别上生成精细特征;最后,通过“LeakyRelu-Conv-LeakyRelu”操作来对输入特征的通道数进行调整.

该模块可以通过聚合不同尺度之间、不同分辨率之间的特征来使去雾网络获得较强的上下文信息处理能力.该聚合操作可表示如下:

善其梯度流.

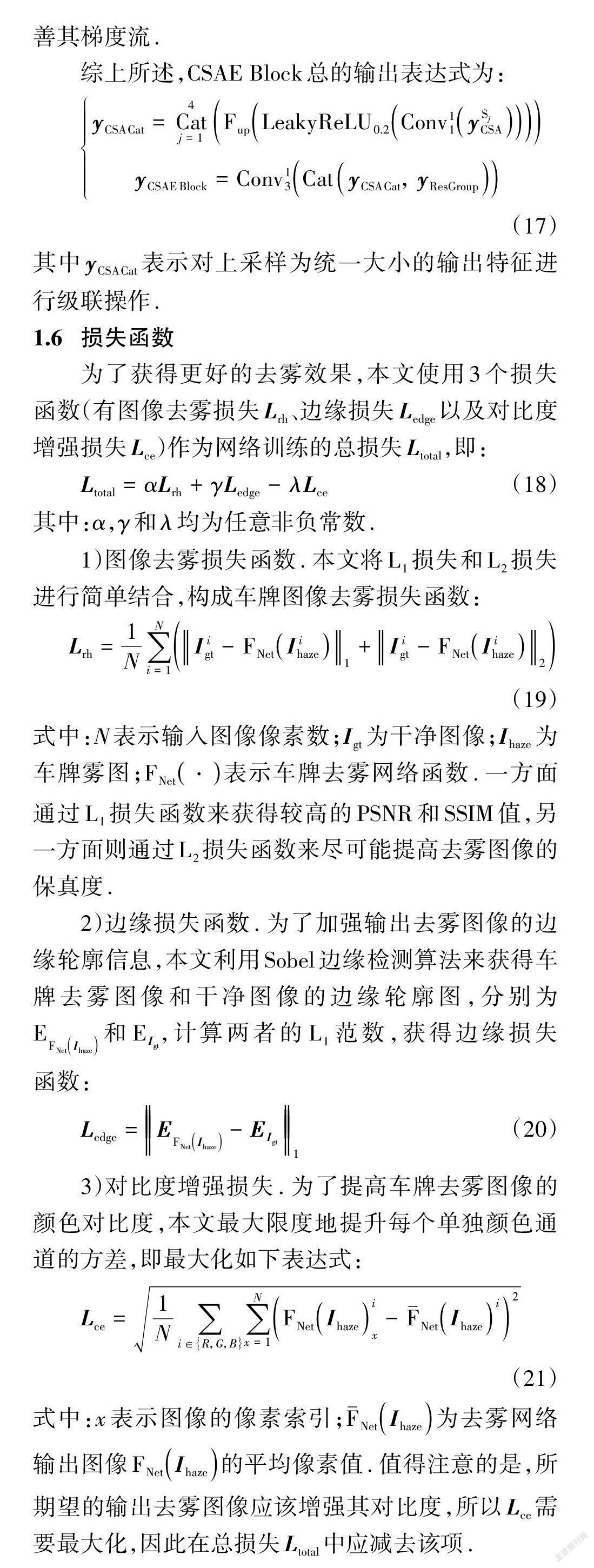

综上所述,CSAE Block总的输出表达式为:

其中y表示对上采样为统一大小的输出特征进行级联操作.

1.6损失函数

为了获得更好的去雾效果,本文使用3个损失函数(有图像去雾损失Lrh、边缘损失L以及对比度增强损失L)作为网络训练的总损失L,即:

L=αL+γL-λL(18)

其中:α,γ和λ均为任意非负常数.

1)图像去雾损失函数.本文将L损失和L损失进行简单结合,构成车牌图像去雾损失函数:

式中:N表示输入图像像素数;I为干净图像;I为车牌雾图;F(·)表示车牌去雾网络函数.一方面通过L损失函数来获得较高的PSNR和SSIM值,另一方面则通过L损失函数来尽可能提高去雾图像的保真度.

3)对比度增强损失.为了提高车牌去雾图像的颜色对比度,本文最大限度地提升每个单独颜色通道的方差,即最大化如下表达式:

2训练与测试

2.1车牌雾图数据集(LPHazeDataset)的制作

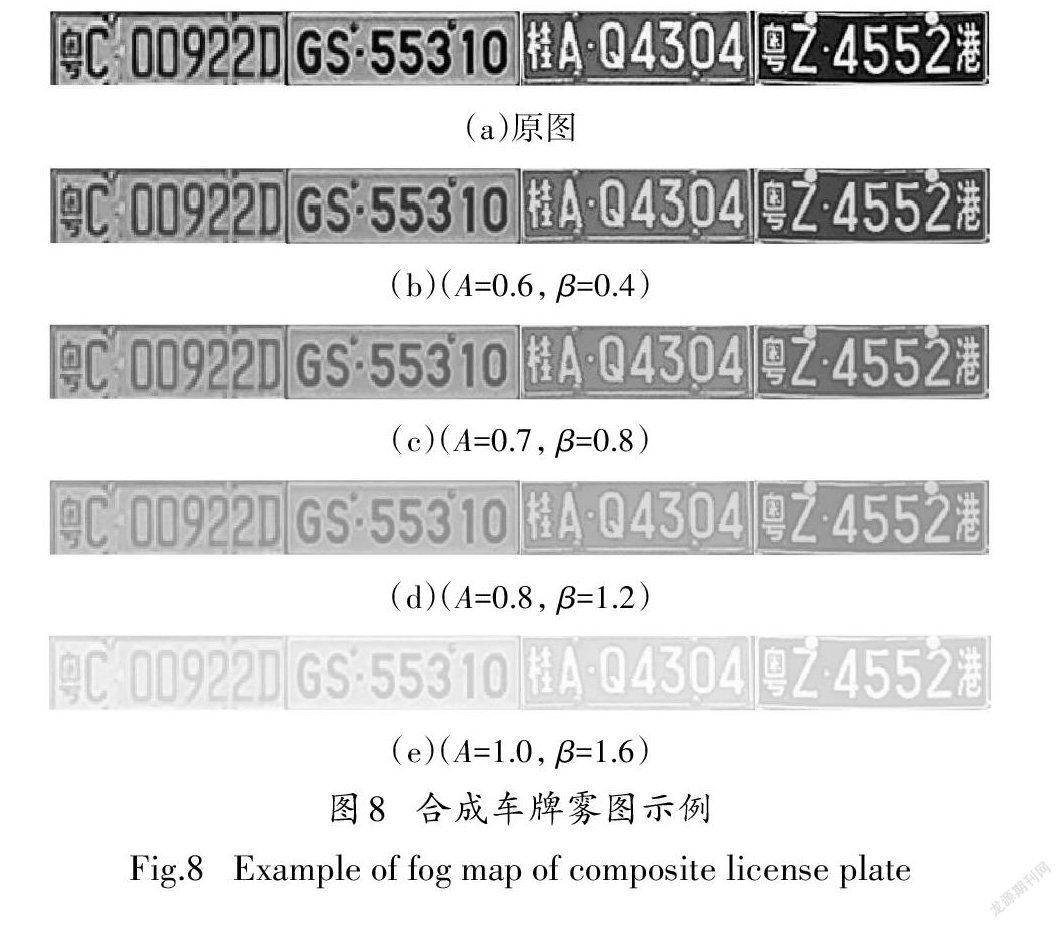

为了解决车牌去雾网络训练过程中缺失的车牌雾图数据集问题,受RESIDE数据集制作方法的启示,本文采用成熟的ASM理论来进行车牌雾图数据集的制作.车牌图像数据主要来源于OpenITS提供的OpenData V3.1-SYSU功能性能车牌图像数据库,并以中科大开源数据集CCPD3作为补充,具体制作方法如下:

1)预处理.从OpenITS和CCPD数据集中随机选取2291张清晰图像,并对这些清晰车牌图像的车牌区域进行截取;

2)配置大气散射模型参数值.参照RESIDE数据集所选取的参数值范围,隨机选取如下一组大气光值A =[0.6,0.7,0.8,0.9,1.0]和一组大气散射系数值B=[0.4,0.6,0.8,1.0,1.2,1.4,1.6],并将场景深度d(x)置为1;

3)合成车牌有雾-无雾图像对.采取一张清晰车牌图像对应多张车牌雾图的方法来合成图像对,即根据大气散射模型,结合步骤2中选定的参数值,以一张车牌无雾图像对应35张有雾图像的方法来合成数据集.合成车牌雾图示例如图8所示.

4)划分训练集和验证集.训练集中干净车牌图像共1 697张,对应的车牌雾图共59 395张;验证集中干净图像共594张,对应车牌雾图共20 790张.

2.2实验设置

本文采用自制的车牌雾图数据集(LPHaze Dataset)作为车牌图像去雾网络的训练和验证数据,其中所有图像像素大小均设置为64×128×3,batch size 为64.并对训练数据进行数据增强操作:随机水平翻转和随机垂直翻转(翻转概率随机取值0或1),以提升网络的鲁棒性.此外,在训练过程中,使用Adam优化器来优化网络,其参数均采用默认值(β=0.9和β=0.999),并通过梯度裁剪策略加速网络收敛,训练800个epoch,初始学习率为1e,总损失函数中α=1、γ=0.1和λ=0.01.采用Pytorch包进行车牌雾图去雾网络结构代码的编写和训练,整个训练过程均在NVIDIA Tesla T4的显卡上运行.

实验主要包括两个部分:其一,测试本文提出的车牌雾图去雾网络模型,其二,对其进行消融实验.上述实验在合成车牌雾图和自然拍摄的车牌雾图上进行测试,所有测试图像均随机选自OpenITS提供的车牌图像数据库(与LPHaze Dataset训练集中的数据不重合),并从测试结果中选取如下5种组合类型进行定性和定量分析,分别为(A=0.6,β=0.8)、(A=0.7,β=1.0)、(A=0.8,β=1.2)、(A=0.9,β=1.4)和(A=1.0,β=1.6),同时对其依次编号为组合A到E.

3结果与分析

3.1测试实验

1)合成车牌雾图去雾结果

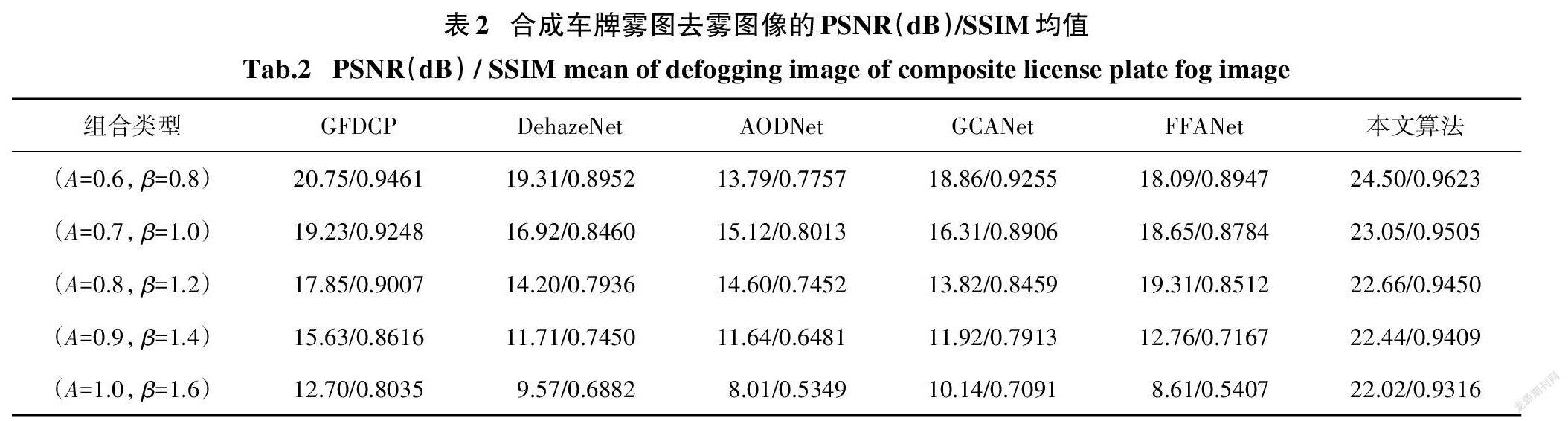

为了进一步评估算法性能,将本文算法与最近出现的经典去雾算法(基于引导滤波器的暗通道先验算法[4](GFDCP)、基于深度学习的端到端的去雾网络[8](DehazeNet)、端到端的一体化去雾网络(AODNet)、端到端门控上下文聚合去雾网络[23](GCANet)和端到端特征融合注意力去雾网络[17](FFANet)进行比较.以上算法统一在LPHaze Dataset的验证集上进行测试,并选取其中5类合成车牌雾图的测试结果进行实验分析,其结果见表2.

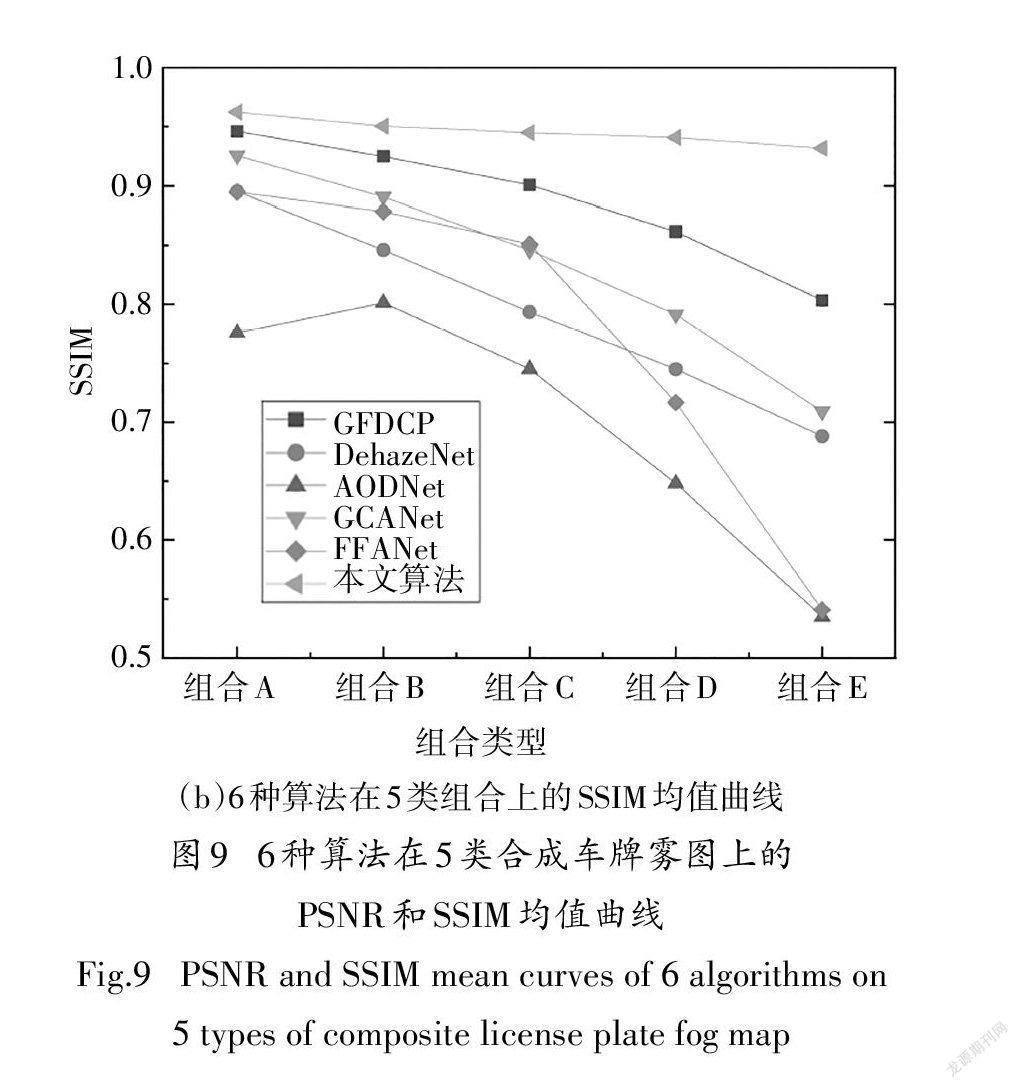

由表2可以看出,在5类不同大气光和散射系数的合成车牌雾图上,与GCANet得到的结果相比,在PSNR 均值上分别提高了5.64、6.74、8.84、10.52、11.88 dB,SSIM均值上则分别提高了0.036 8、0.059 9、0.099 1、0.149 6、0.222 5.同时,在图9中的PSNR和SSIM均值曲线图中亦可知,在重构图像质量方面,本文算法在处理不同雾度的合成车牌雾图上明显优于上述5类经典算法.最后,从合成车牌雾图的去雾图像中选取部分图片进行效果展示,如图10所示. 从去雾效果中可以直观感受到,本文算法相较于其它算法而言,具有较少的雾度残留以及颜色失真.

2)自然车牌雾图去雾结果

本文还对实际拍摄的自然车牌雾图进行测试,并与上述5种经典算法的去雾效果进行视觉比较. 该测试数据选自OpenITS的车牌图像数据库,共915张实际拍摄的车牌雾图,视觉对比结果如图11所示.

从图11可知:在处理常见的蓝底车牌雾图时,本文算法很少出现过度曝光和图像整体偏暗的问题,且雾度残留也很少;对于其它底色的车牌雾图(如图11中的黄底和蓝底车牌),本文算法在去雾效果上相较于上述5种经典算法仍能保持自身优势,并且在颜色、字符等图像信息上也能得到较好的恢复.

3.2不同模块对网络性能的影响

为了分析其中各个模块的重要性,本文在LPHaze Dataset数据集上进行消融研究分析,以基于ResGroup和“SOS”Block的MWCNN去雾网络作为基准网络模块,对于其他不同的网络模块,其简化形式及说明如下,R:基于ResGroup和“SOS”Block的MWCNN作为基准网络,该网络不包含DCPA Block、LMSA和CSAE Block;R:具有DCPA Block的基准网络;R:具有DCPA Block、LMSA和CSAE Block的基准网络,即最终的车牌雾图去雾网络.上述网络模块均只训练150个epoch,且初始学习率均为1e,并在LPHaze Dataset的验证集上进行测试,其测试结果如表3所示.

由表3可得,在不加入DCPA Block、LMSA和CSAE Block的情形下,PSNR和SSIM的均值分别可以达到22.47 dB和0.942 1,而在加入三者后,PSNR和SSIM均值则分别提升了0.8 dB和0.009 2,从而使网络能重建出高质量的去雾图像.

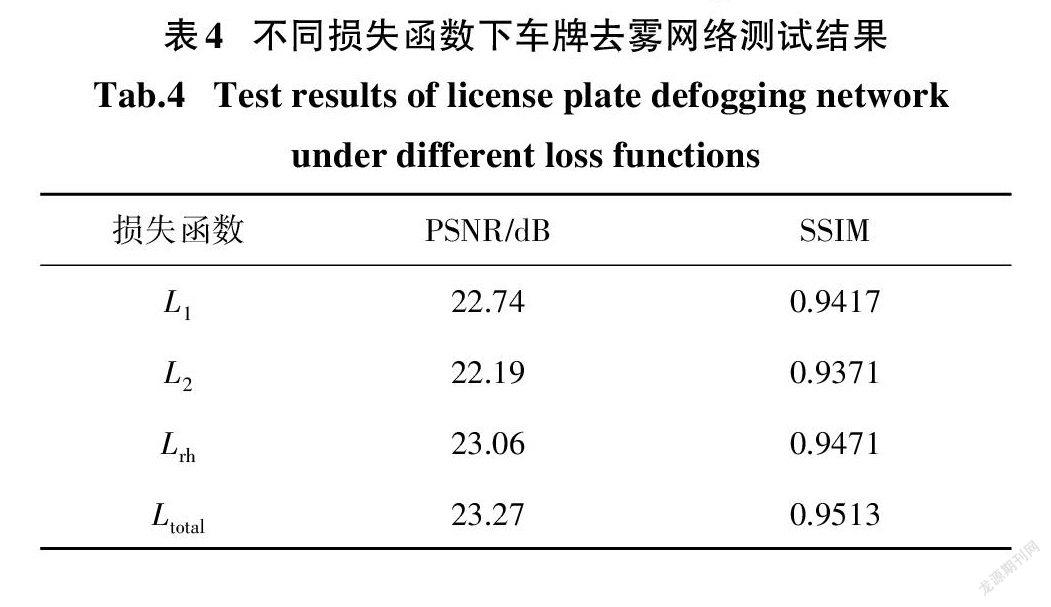

3.3不同损失函数对网络性能的影响

为了分析损失函数的有效性,本文算法分别采用L、L、L(即L和L损失的简单结合)和L这四类损失函数来进行网络模型的训练,训练150个epoch,且初始学习率为1e.分别在LPHaze Dataset的驗证集上进行PSNR和SSIM的指标测试,其实验结果如表4所示.从表4可知,只使用L损失函数时,平均PSNR和SSIM可达到23.06 dB和0.947 1,且相较于单独使用L或L时均有着明显提升.而使用总损失函数L时,平均PSNR和SSIM分别提升了0.21 dB和0.004 2,从而使网络性能得到较大的改善.

4結论

本文提出了一种基于深度多级小波U-Net的车牌雾图去雾算法,该算法以MWCNN作为去雾网络主体框架.首先,为了在小波域和空间域中尽可能地整合不同层级和尺度的图像特征,引入了“SOS”增强策略,并在MWCNN中间进行跨层连接,以此对图像特征进行整合、完善和优化;其次,本文将像素注意力、通道注意力和离散小波变换进行有效融合,从而尽可能去除车牌雾图中的雾度;最后,通过跨尺度聚合增强模块来弥补小波域和空间域之间存在的图像信息差异,进一步提高了重构图像质量.自然车牌雾图和LPHaze Dataset的验证集上的实验结果表明,在处理具有不同大气光照和雾度的车牌雾图上,本文算法具有较好的去雾表现,并且在处理具有不同底色的车牌雾图时具有一定的优势.

参考文献

[1] YADAV G,MAHESHWARI S,AGARWAL A. Foggy image enhancement using contrast limited adaptive histogram equalization of digitally filtered image:performance improvement[C]//2014 International Conference on Advances in Computing,Communications and Informatics(ICACCI). September 24-27,2014,Delhi,India. IEEE,2014:2225-2231.

[2] RUSSO F. An image enhancement technique combining sharpening and noise reduction[J]. IEEE Transactions on Instrumentation and Measurement,2002,51(4):824-828.

[3] GALDRAN A,BRIA A,ALVAREZ-GILA A,et al. On the duality between retinex and image dehazing [C]//2018 IEEE/CVF (Conference on Computer Vision and Pattern Recognition. June 18- 23,2018,Salt Lake City,UT,USA. IEEE,2018:8212-8221.

[4] HE K,SUN J,TANG X. Guided image filtering[C]//DANIILIDIS K,MARAGOS P,PARAGIOS N. Computer Vision - ECCV 2010,11th European Conference on Computer Vision,Heraklion,Crete,Greece,September 5-11,2010,Proceedings,Part I. Springer,2010,6311:1-14.

[5] HE K M,SUN J,TANG X O.Single image haze removal using dark channel prior [C]//IEEE Transactions on Pattern Analysis and Machine Intelligence.IEEE,:2341-2353.

[6] ZHU Q S,MAI J M,SHAO L. A fast single image haze removalalgorithm using color attenuation prior[J]. IEEE Transactions on Image Processing,2015,24(11):3522-3533.

[7] BERMAN D,TREIBITZ T,AVIDAN S. Non-local image dehazing[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. June 27-30,2016,Las Vegas,NV,USA. IEEE,2016:1674-1682.

[8] CAI B L,XU X M,JIA K,et al. DehazeNet:an end-to-end system for single image haze removal[J]. IEEE Transactions on Image Processing:a Publication of the IEEE Signal Processing Society,2016,25(11):5187-5198.

[9] ZHANG H,PATEL V M. Densely connected pyramid dehazing network[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. June 18-23,2018,Salt Lake City,UT,USA.IEEE,2018:3194-3203.

[10] LI B Y,PENG X L,WANG Z Y,et al. AOD-net:all-in-one dehazing network [C]//2017 IEEE International Conference on Computer Vision (ICCV). October 22-29,2017. Venice. IEEE,2017:4780-4788.

[11] LIU P J,ZHANG H Z,LIAN W,et al.Multi-level wavelet convolutional neural networks[J].IEEE Access,2019,7:74973- 74985.

[12] YANG H H,FU Y W.Wavelet U-net and the chromatic adaptation transform for single image dehazing[C]//2019 IEEE International Conference on Image Processing.September 22-25,2019,Taipei,Taiwan,China.IEEE,2019:2736-2740.

[13] YANG H H,YANG C H H,WANG Y C F.Wavelet channel attention module with A fusion network for single image deraining [C]//2020 IEEE International Conference on Image Processing. October 25-28,2020,Abu Dhabi,United Arab Emirates.IEEE,2020:883-887.

[14] PENG Y L,CAO Y,LIU S G,et al.Progressive training of multilevel wavelet residual networks for image denoising[EB/OL].2020:arXiv:2010.12422 [eess. IV]. https://arxiv.org/abs/2010.12422.

[15]陳书贞,曹世鹏,崔美玥,等.基于深度多级小波变换的图像盲去模糊算法[J].电子与信息学报,2021,43(1):154-161.

CHEN S Z,CAO S P,CUI M Y,et al.Image blind deblurring algorithm based on deep multi-level wavelet transform[J].Journal of Electronics & Information Technology,2021,43(1):154-161. (In Chinese).

[16]王巧月,陈树越.车牌图像色彩迁移与正则化约束去雾算法[J].计算机工程与应用,2021,57(14):217-222.

WANG Q Y,CHEN S Y. Defogging algorithm based on color transfer and regularization constraints of license plate images[J].Computer Engineering and Applications,2021,57(14):217-222. (In Chinese)

[17] QIN X,WANG Z L,BAI Y C,et al.FFA-net:feature fusion attention network for single image dehazing[J].Proceedings of the AAAI Conference on Artificial Intelligence,2020,34(7):11908- 11915.

[18] WU H Y,LIU J,XIE Y,et al.Knowledge transfer dehazing network for NonHomogeneous dehazing[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW).June 14-19,2020,Seattle,WA,USA.IEEE,2020:1975-1983.

[19] PARK Y,JEON M,LEE J,et al.MCW-net:single image deraining with multi-level connections and wide regional non-local blocks[EB/OL].2020:arXiv:2009.13990[cs.CV].https://arxiv.org/abs/2009.13990.

[20] ROMANO Y,ELAD M.Boosting of image denoising algorithms [J].SIAM Journal on Imaging Sciences,2015,8(2):1187- 1219.

[21] DONG H,PAN J S,XIANG L,et al.Multi-scale boosted dehazing network with dense feature fusion[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR).June 13-19,2020,Seattle,WA,USA.IEEE,2020:2154-2164.

[22] XU Z B,YANG W,MENG A J,et al.Towards end-to-end license plate detection and recognition:A large dataset and baseline[M]//Computer Vision - ECCV 2018.Cham:Springer International Publishing,2018:261-277.

[23] CHEN D D,HE M M,FAN Q N,et al. Gated context aggregation network for image dehazing and deraining[C]//2019 IEEE Winter Conference on Applications of Computer Vision.January 7-11,2019,Waikoloa,HI,USA.IEEE,2019:1375-1383.