基于通道间相关性的图像重着色检测

陈诺,祁树仁,张玉书,薛明富,花忠云

基于通道间相关性的图像重着色检测

陈诺1,祁树仁1,张玉书1,薛明富1,花忠云2

(1. 南京航空航天大学计算机科学与技术学院,江苏 南京 211106;2. 哈尔滨工业大学(深圳)计算机科学与技术学院,广东 深圳 518055)

图像重着色是一种新兴的图像编辑技术,通过篡改像素值达到改变图像颜色风格的目的。随着社交网络和图像编辑技术的快速发展,重着色图像已经严重阻碍了信息传达的真实性。然而,专门为重着色而设计的工作少之又少,现有的重着色检测方法在传统重着色场景下仍有很大提升空间,在应对手工重着色图像时效果不佳。为此,提出了一种基于通道间相关性的重着色图像检测方法,该方法适用于重着色任务中的传统重着色和手工重着色场景。基于相机成像和重着色图像生成方式之间存在显著差异这一现象,提出重着色操作或许会破坏自然图像的通道间相关性这一假设。通过数值分析说明,通道间相关性差异可作为区分重着色图像和自然图像的重要鉴别度量。基于上述先验知识,所提方法通过提取差分图像的一阶微分残差的通道共生矩阵,获得图像的通道间相关性特征集。此外,根据实际情况,假设了3种检测场景,包括训练−测试数据之间匹配、不匹配以及手工重着色场景。实验结果表明,所提方法能够准确识别重着色图像,在假设的3种场景下均优于现有方法,取得了较高的检测精度。除此之外,所提方法对训练数据量的依赖性较小,在训练数据有限的情况下,能实现相当精确的预测结果。

图像重着色;篡改检测;通道间相关性;图像取证

0 引言

随着智能手机和移动互联网的普及,每一个人不仅是信息的接收者还是信息的生产者与传播者。图像相比文字符号,具有更强的还原现实和展现生活的能力,被广泛分享到微信、微博等社交媒体上。然而,随着AdobePhotoshop等图像编辑软件的迅速发展,任何人都能以极低的成本对图像进行篡改,并且产生的内容从视觉上难以分辨真假[1]。除了对图像的内容进行拼接、复制−粘贴、修补、删除等篡改操作[2],最新的图像编辑技术(如图像重着色),还可以改变图像的风格。

图像重着色不改变原始图像内容,而通过篡改像素值的方式来改变图像的主题或风格[3]。自2001年以来,各种图像重着色方法被提出。根据其运行机制大致可分为两类:传统的重着色[3-17]和基于深度学习的重着色[18-27]。大多数传统的重着色方法具有高度可定制化和低成本的优点,但需要根据特定图像和重着色区域动态地调整参数。基于深度学习的重着色方法可以根据图像的高级语义信息学习适当的特征表示,但由于目标分割算法的局限性,在小目标上的重着色效果显著下降,且所需的样本数目较大、运算时间都较长。

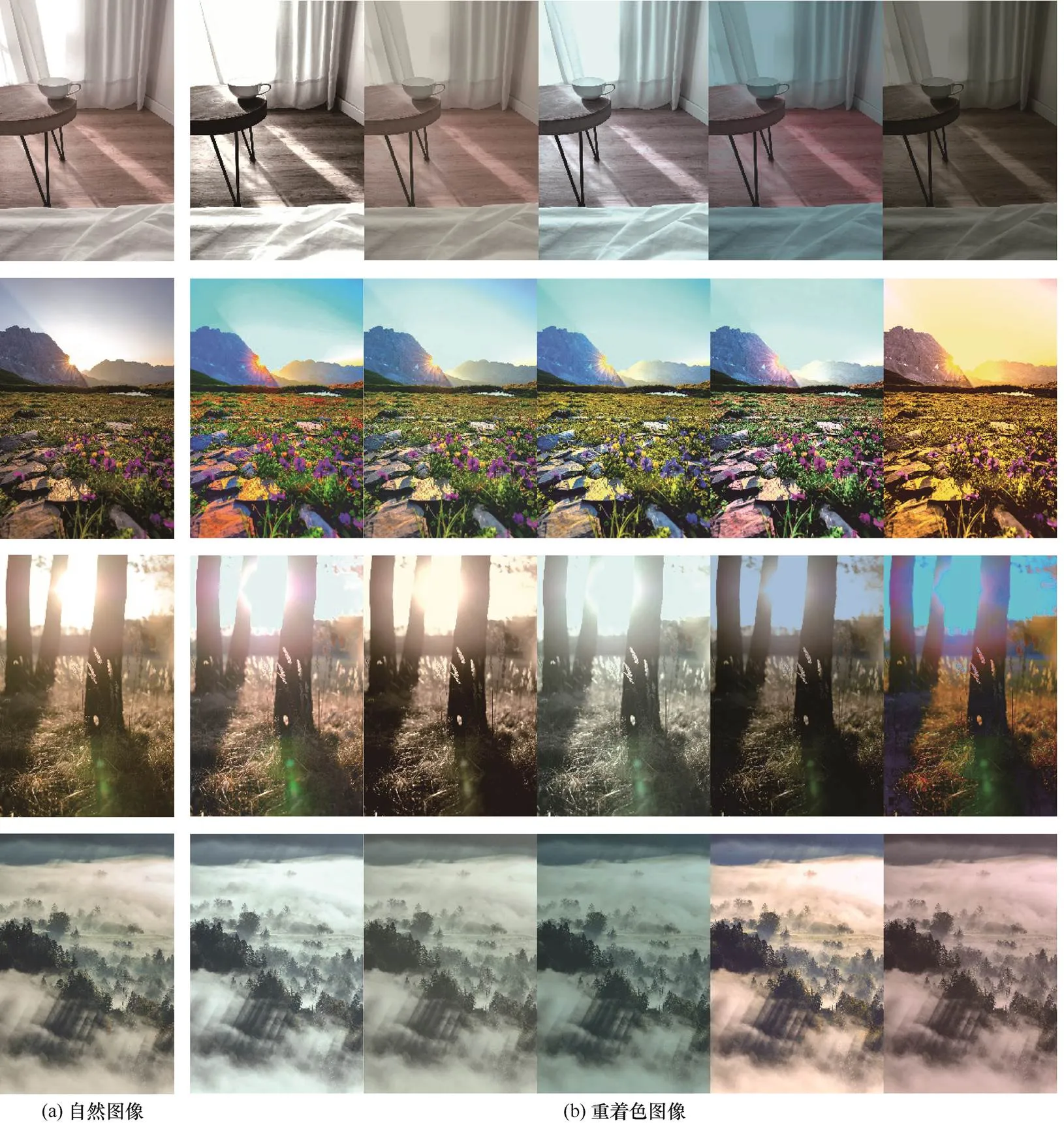

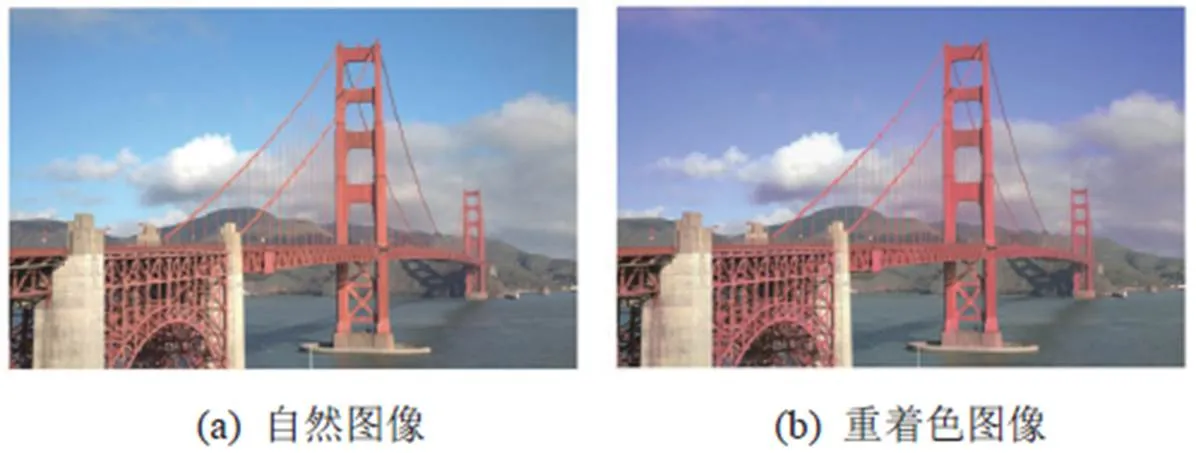

虽然大多数人仅出于娱乐目的对图像进行重着色,但由于颜色对于视觉系统至关重要,这种类型的篡改严重阻碍了信息传达的真实性。图像重着色示例如图1所示,此种肉眼难辨真伪的重着色图像不仅可能误导个人及公众的意见形成,甚至可能干扰与安全密切相关的人工视觉系统的正常工作。

因此,迫切需要数字图像内容取证技术来鉴定数字图像的真实性和完整性。近年来,学术界在数字图像盲取证领域取得了显著进展[28]。盲取证,又被称为被动取证,不依赖数字水印[29]等任何形式的先验知识,仅依赖所分析的数字图像,并试图揭示在数字相机成像阶段或图像编辑阶段产生的特定伪像。例如,Yerushalmy等[30]利用透镜和传感器之间的相互作用所产生的像差进行伪造检测。一些研究利用图像域[31-32]或小波域[33]的统计工具分析伪造图像的局部噪声。由于复制−粘贴篡改在图像中有相同区域,Fridrich等[34]在2003年提出针对复制−粘贴篡改的检测工作。

总体来说,现有的取证方法在检测传统篡改方面取得了良好的性能。但是将这些方法直接应用于重着色场景的效果并不令人满意,因为它们没有考虑到重着色过程产生的特定伪像。虽然改变颜色是图像处理中最常见的操作之一,但专门为重着色图像而设计的取证工作仍然很少。Yan等[35]尝试从图像的通道间相关性和光照一致性的角度来应对传统的重着色。尽管他们的方法表现出良好的泛化性能,但没有充分发掘出通道间相关性的潜力,仍有很大提升空间。紧随其后,Zhang等[36]提出了一种基于空间相关性的重着色检测方法,该方法显示出了对传统和深度学习重着色的通用检测能力,但在应对手工制作的重着色场景时效果不佳。

图1 图像重着色示例

Figure 1 Examples of image recoloring

为了缓解来自传统重着色的挑战及提高在手工重着色场景下的泛化能力,本文充分挖掘图像的通道间相关性,提出了一种有效且具有可解释性的检测方法来区分自然图像(NI,natural image)和重着色图像(RI,recolored image)。

本文的工作始于如下假设:由于相机成像和图像重着色方式之间存在内在差异,重着色操作或许会破坏、、通道之间的相关性。随后的数值分析实验验证了这一假设。基于上述先验知识,为了更好地表示通道间相关性,首先使用高通滤波抑制通道间图像中与伪像无关的内容,然后提取其中的通道间相关性特征。

本文的主要贡献总结如下。

1) 提出了一种基于通道间相关性的重着色图像检测方法,该方法能够有效缓解来自传统重着色面临的问题,提高在手工重着色场景下的泛化能力。

2) 通过理论分析得出,重着色操作或许会破坏自然图像的通道间相关性。此外,数值实验还验证了通道间相关性是一种具有区分性的特征。

3) 提出了一种有效的通道间相关性特征集用于重着色检测。

1 相关工作

1.1 传统的重着色方法

根据篡改机制,传统的重着色方法可大致分为:基于示例的重着色[3-9]、基于编辑传播的重着色[10-14]、基于调色板的重着色[15-17]。

基于示例的重着色方法通过将参考图像的颜色风格迁移到目标图像,实现重着色。早期方法[3]通过分析图像的全局颜色分布,将参考图像的特征应用到目标图像中,这类方法属于全局颜色迁移。此外,局部颜色迁移方法[5]首先识别目标图像和参考图像之间的区域相关性,然后在对应的区域之间迁移颜色分布。

基于编辑传播的方法要求用户首先使用所需的颜色在图像的特定区域涂鸦;然后,算法将这些编辑自动传播到邻近区域中的相似像素。此类方法具有高度可定制的优点,缺点是需要动态地调整参数到特定的图像和区域。

基于调色板的方法根据输入图像的内容生成一个合适的调色板。用户只需要替换调色板中的颜色,图像的颜色样式就会自动改变。大多数方法使用聚类算法来定制特定图像的调色板,因此不适合大批量生成图像。

1.2 重着色检测方法

迄今为止,很少有专门区分自然图像和重着色图像的工作。Yan等[35]尝试为重着色图像设计检测算法。他们发现,从RGB图像中得到的通道间图像[37]和光照图像[38]可能对伪造检测[39]有效。因此,利用上述特征,设计了一个基于深度神经网络[40]的重着色图像检测模型,该模型由3个特征提取模块、一个特征融合模块和一个分类模块组成。首先,将原始RGB图像、通道间图像和光照图像分别输入一个特征提取分支(深度神经网络的前3个卷积阶段);在前一阶段提取与伪造相关的伪像特征后,采用连接层来融合这些特征;最后,在分类阶段获得图像经过重着色的概率。从检测结果来看,该方法可以在一定程度上识别重着色图像。然而,在制作精良的手工数据集上,他们的方法仅能获得65%的准确率。随后,Zhang等[36]提出了一个基于空间相关性的通用检测方法,通过理论和数值分析发现重着色操作或许会破坏像素之间的空间相关性。基于这样的先验知识,设计了一个识别重着色图像的特征集,该特征集使用共生矩阵统计每个颜色分量上相邻像素之间的空间相关性;然后,将该特征集送入卷积神经网络中学习高级表征;最后,输出一张图片经过重着色篡改的概率。虽然该方法显示出了在传统和基于深度学习的重着色场景下的通用检测能力,但由于没有充分考虑到传统重着色的特定伪像,检测效果仍有很大的提升空间。

2 本文方法

本文提出了一个简单有效的方法用于检测重着色图像,总体框架如图2所示。该方法分为两个阶段:特征提取阶段和分类阶段。在特征提取阶段,首先,为了过滤与特定伪像无关的内容信息,依次获得原始图像的差分图像和残差图像;然后,提取残差图像的通道间相关性并组成特征集,记作通道共生矩阵。在分类阶段,使用支持向量机(SVM,support vector machine)训练分类器,该分类器根据提取的相关性特征判断图像是否经过重着色篡改。

图2 所提方法的总体框架

Figure 2 The overall framework of the proposed method

2.1 通道间相关性的分析

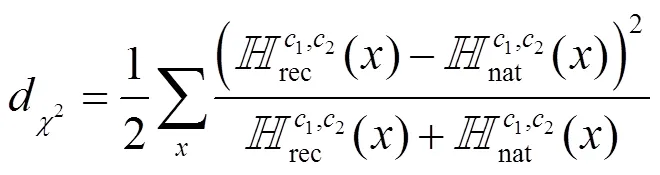

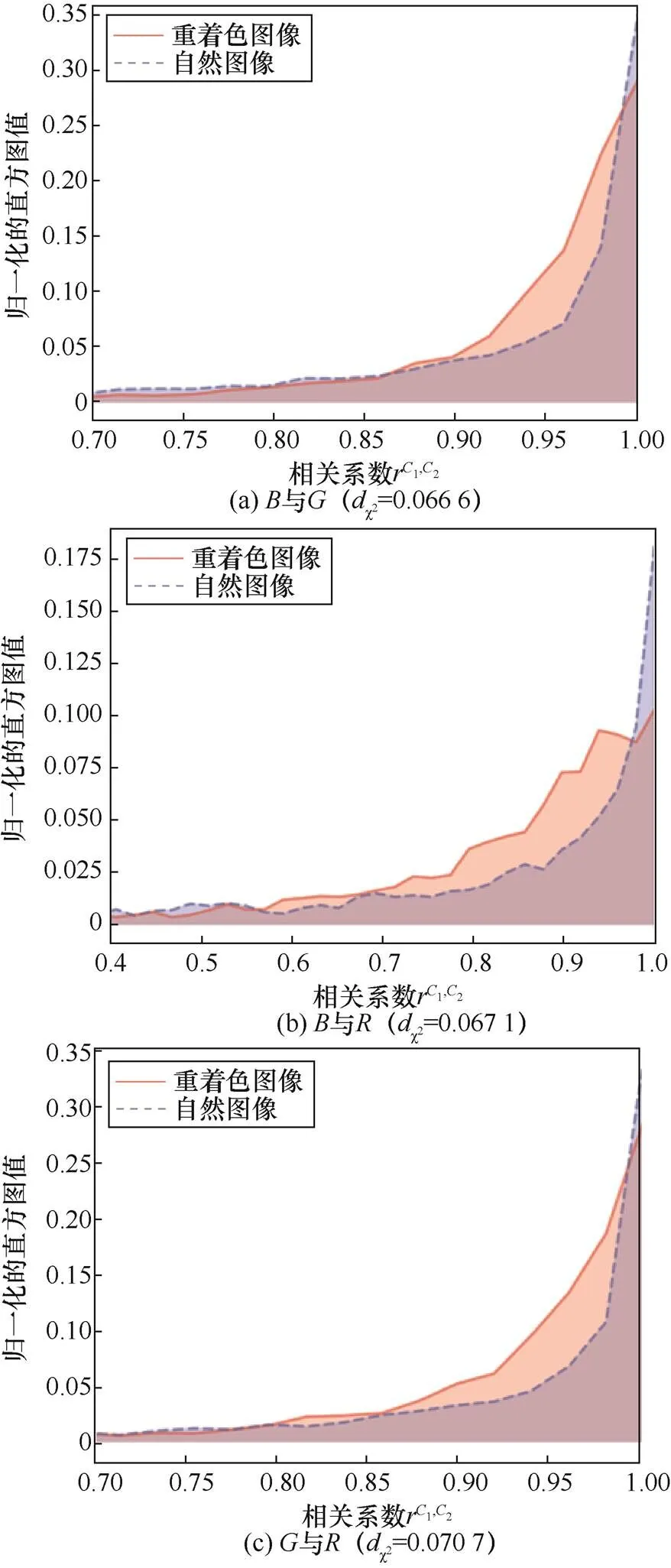

相机成像与重着色图像的生成方式之间具有很大的区别。在自然图像中,由于成像过程中的彩色滤波阵列插值算法,不同颜色通道间存在高度相关性。然而,对于重着色图像,由于重着色操作中、、这3个颜色通道的数值变化往往是不同的,所以3个通道间的相关性往往会遭受一定程度的破坏。因此,与自然图像不同的是,重着色图像中不同颜色通道之间并不是高度相关的。在接下来的分析中,将展示一些实验证据来支持这一假设。

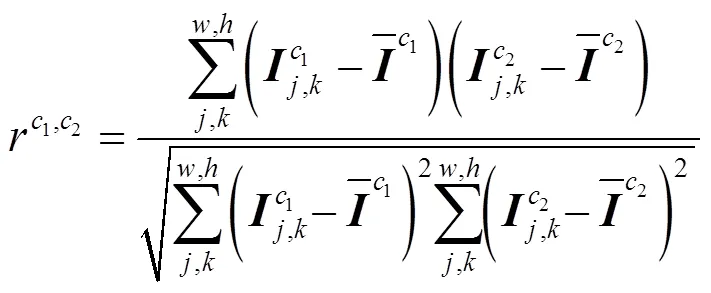

虽然重着色图像与自然图像在视觉上难以区分,但重着色过程可能会改变自然图像的统计特征,如颜色通道间的相关性。因此,本文使用一种度量方法来展现自然图像和重着色图像的R、G、B颜色分量间的通道相关性差异。

图3 重着色图像和自然图像的通道间相关性直方图的差异

Figure 3 Differences in inter-channel correlation histograms of recolored images and natural images

2.2 提取通道间相关性特征

步骤1 计算差分图像

基于上述分析,充分挖掘差分图像的通道间相关性特征。Gunturk等[41]提出,自然图像的不同颜色通道的高频分量间具有很强的相关性。图像的一个颜色通道可表示为:

因此,在自然图像的差分图像中,相应的高频分量被过滤,只保留低频分量。

步骤2 计算差分图像的一阶微分残差

由上述分析可知,自然图像的差分图像中,只包含低频分量;而重着色图像中除了包含低频分量外,还包含高频分量。两类图像中均包含的低频分量可能对二者之间差异的分析产生负面影响。因此,首先采用高通滤波抑制差分图像的低频分量,然后研究残差图像之间的差异更具合理性。

本文使用一阶微分算子获得残差图像:

步骤3 截断残差图像

通过步骤2,分别获得了差分图像在竖直方向和水平方向的残差图像。然而残差图像中有太多不同的元素值,如果直接对原始残差数据提取通道间相关性特征,会使获得的通道共生矩阵维数较大,增加了运算的复杂度。因此,在计算通道相关性之前,还需要对残差图像进行预处理。

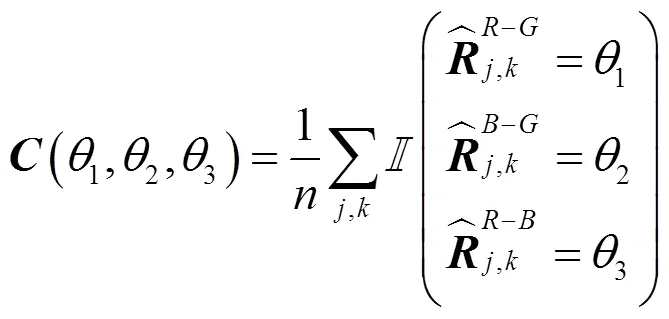

步骤4 提取通道间相关性特征

受灰度共生矩阵的启发,使用式(8)计算残差图像的通道间相关性,记作通道共生矩阵:

3 实验

3.1 训练集和评价指标

图4 训练集D1的示例

Figure 4 Examples selected from the training set1

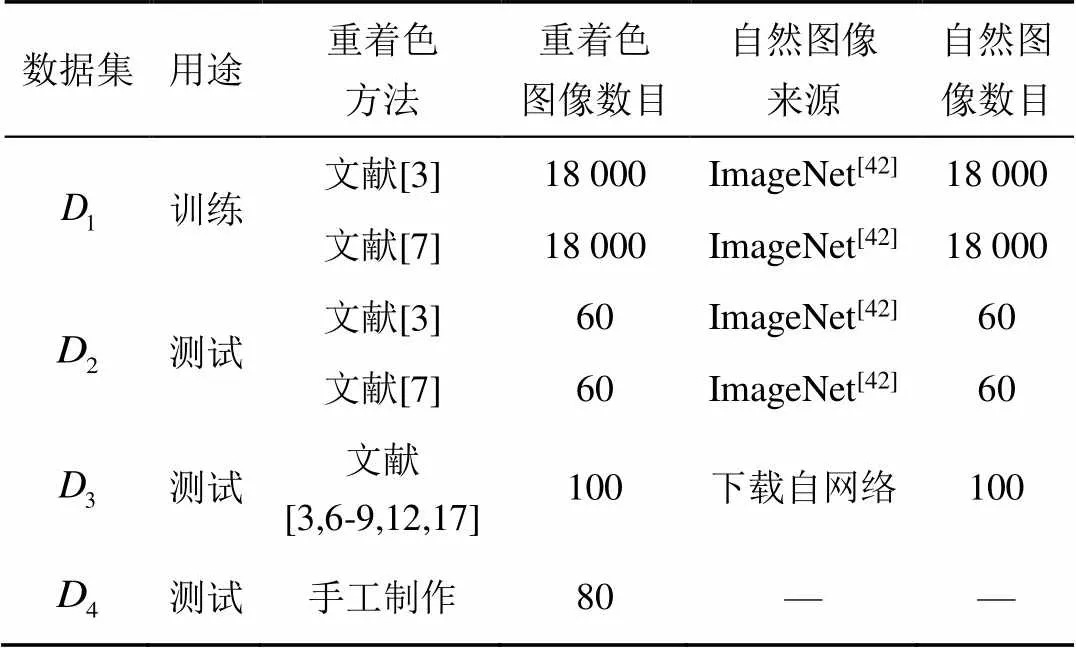

表1 实验中使用的数据集汇总

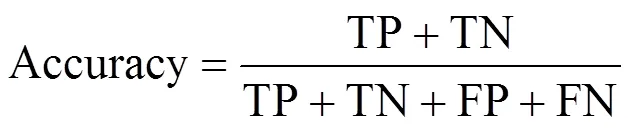

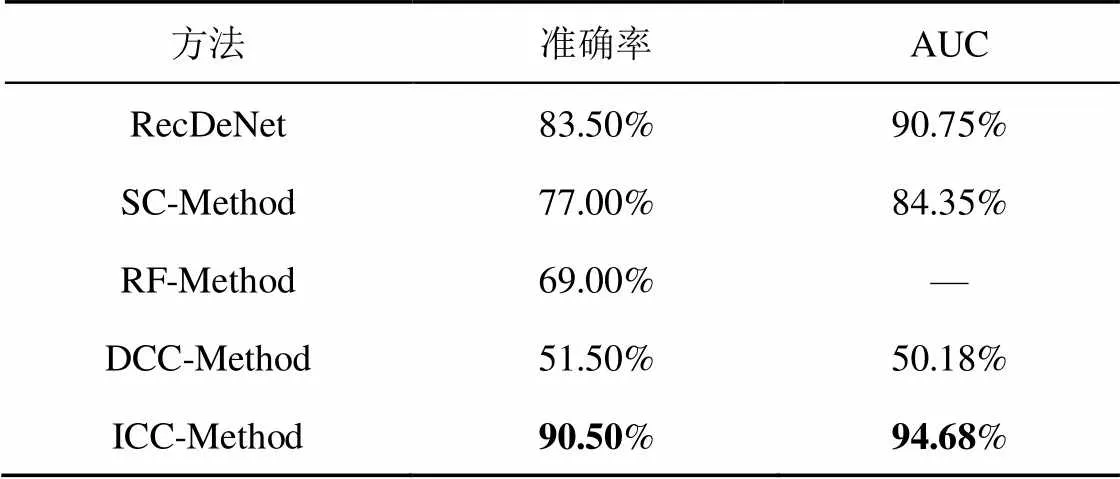

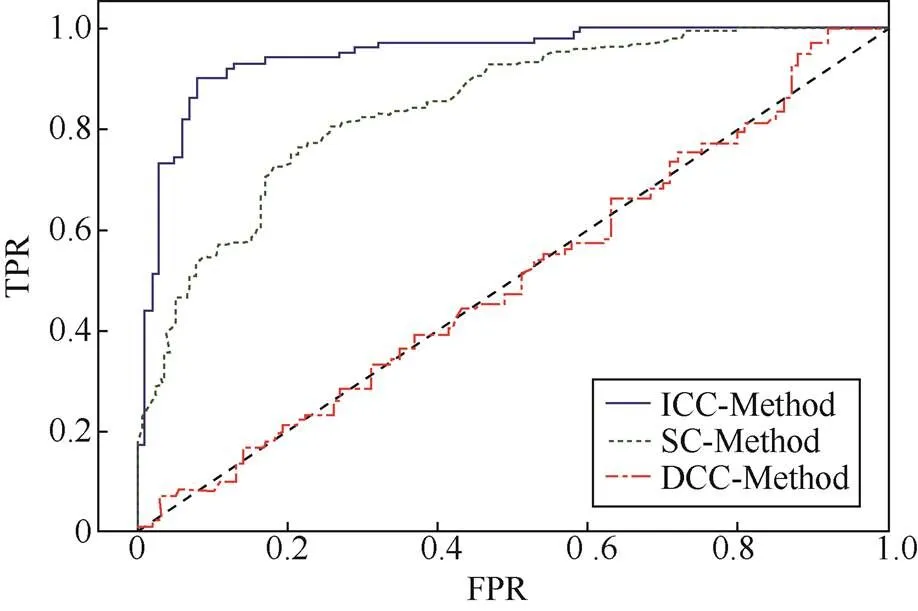

为了评估ICC-Method在重着色检测中的性能,本文使用准确率和受试者工作特征(ROC,receiver operating characteristic)曲线下的面积(AUC,area under the curve)两个指标对实验结果进行分析。

准确率指的是正确预测样本数在测试样本总数中的比例,其计算如下:

其中,TP为将自然图像预测为自然图像,TN为将重着色图像预测为重着色图像,FP为将重着色图像预测为自然图像,FN为将自然图像预测为重着色图像。

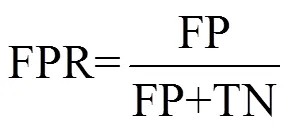

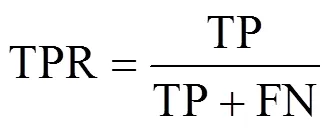

ROC曲线的横坐标为假阳性率(FPR,false positive ratio), 纵坐标是真阳性率(TPR,true positive ratio)。二者的计算如下:

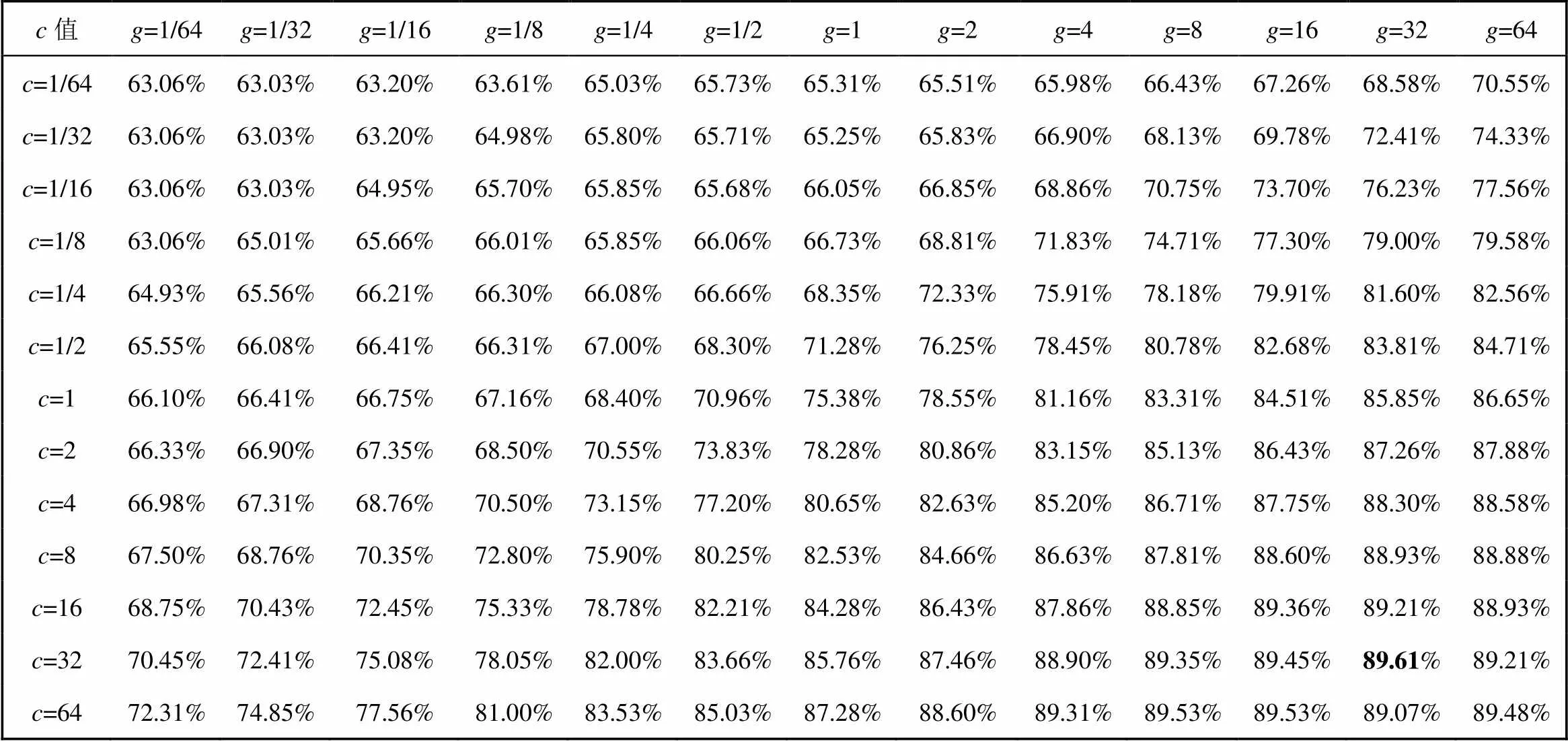

3.2 参数选择

3.3 性能评估

场景1 训练集与测试集匹配

c值g=1/64g=1/32g=1/16g=1/8g=1/4g=1/2g=1g=2g=4g=8g=16g=32g=64 c=1/6463.06%63.03%63.20%63.61%65.03%65.73%65.31%65.51%65.98%66.43%67.26%68.58%70.55% c=1/3263.06%63.03%63.20%64.98%65.80%65.71%65.25%65.83%66.90%68.13%69.78%72.41%74.33% c=1/1663.06%63.03%64.95%65.70%65.85%65.68%66.05%66.85%68.86%70.75%73.70%76.23%77.56% c=1/863.06%65.01%65.66%66.01%65.85%66.06%66.73%68.81%71.83%74.71%77.30%79.00%79.58% c=1/464.93%65.56%66.21%66.30%66.08%66.66%68.35%72.33%75.91%78.18%79.91%81.60%82.56% c=1/265.55%66.08%66.41%66.31%67.00%68.30%71.28%76.25%78.45%80.78%82.68%83.81%84.71% c=166.10%66.41%66.75%67.16%68.40%70.96%75.38%78.55%81.16%83.31%84.51%85.85%86.65% c=266.33%66.90%67.35%68.50%70.55%73.83%78.28%80.86%83.15%85.13%86.43%87.26%87.88% c=466.98%67.31%68.76%70.50%73.15%77.20%80.65%82.63%85.20%86.71%87.75%88.30%88.58% c=867.50%68.76%70.35%72.80%75.90%80.25%82.53%84.66%86.63%87.81%88.60%88.93%88.88% c=1668.75%70.43%72.45%75.33%78.78%82.21%84.28%86.43%87.86%88.85%89.36%89.21%88.93% c=3270.45%72.41%75.08%78.05%82.00%83.66%85.76%87.46%88.90%89.35%89.45%89.61%89.21% c=6472.31%74.85%77.56%81.00%83.53%85.03%87.28%88.60%89.31%89.53%89.53%89.07%89.48%

Figure5 Accuracy of ICC-Method for different SVM parameter settings

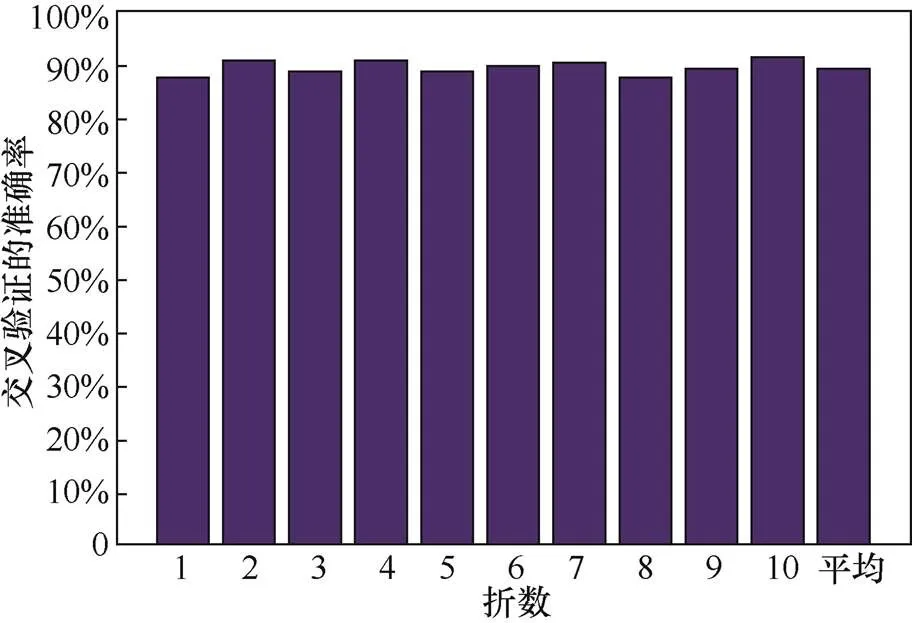

图6 ICC-Method的十折交叉验证的准确率

Figure 6 Accuracy of ICC-Method with 10-fold cross validation

表2 ICC-Method在不同测试集上的结果

场景2 训练集与测试集不匹配

实际上,研究人员可能并不完全知道图像来源或图像经何种重着色方法篡改过。在这种情况下,训练数据和测试数据之间存在不匹配,包括两种情况:第一种情况,训练数据和测试数据中的图片来源不同;第二种情况,训练数据和测试数据经过不同的重着色方法生成。

图7 从D3中随机选择的图像示例

Figure 7 Example images randomly selected from3

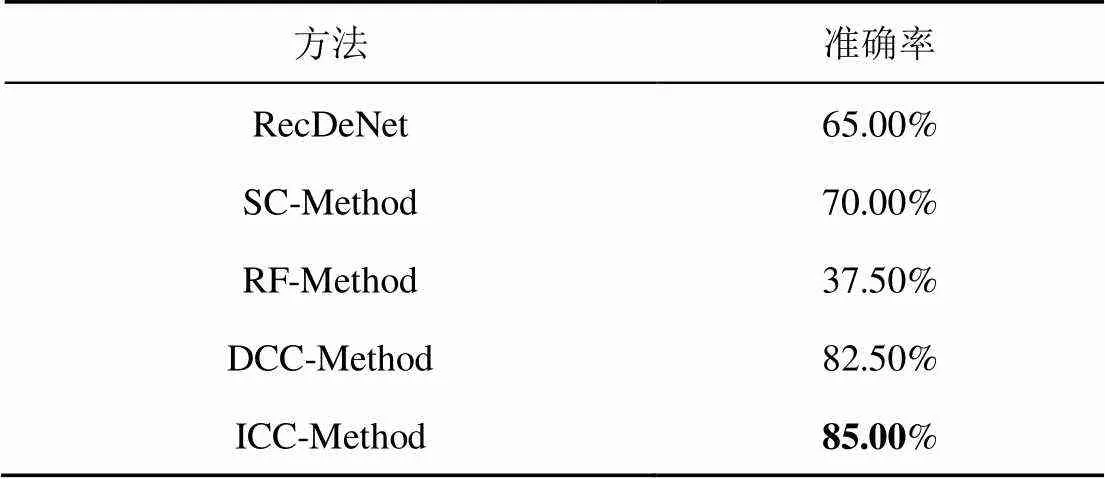

为了更好地说明ICC-Method的优越性,本文将其与目前的4种方法进行了比较。

1) RecDeNet(recolored detection network):Yan等[35]专门为传统重着色篡改而设计的检测方法。该方法使用原始的RGB图像及其派生的通道间图像和光照图像来检测图像是否经过传统重着色篡改。

2) SC-Method(method based on spatial correlation):Zhang等[36]提出的应对传统和深度重着色的通用检测方法。该方法通过卷积神经网络从空间相关特征集中学习特征表示。

3) RF-Method(method based on rich features):Goljan等[44]为图像隐写分析而设计的方法。该方法在图像取证方面取得了良好的性能。该方法首先提取SCRMQ1特征,然后训练一个SVM进行分类。

4) DCC-Method(method based on disparities in color components):Li等[45]提出的应对生成对抗网络(GAN,generative adversarial network)生成图像的识别问题。该方法假设GAN生成的图像与自然图像在颜色分量上存在差异,因此可用于检测图像重着色篡改。

表3 在测试集D3上的比较结果

图8 在测试集D3上的ROC曲线

Figure 8 ROC curves on testing set3

场景3 手工重着色场景

图9 从D4中随机选择的图像示例

Figure 9 Example images randomly selected from4

表4 在测试集D4上的比较结果

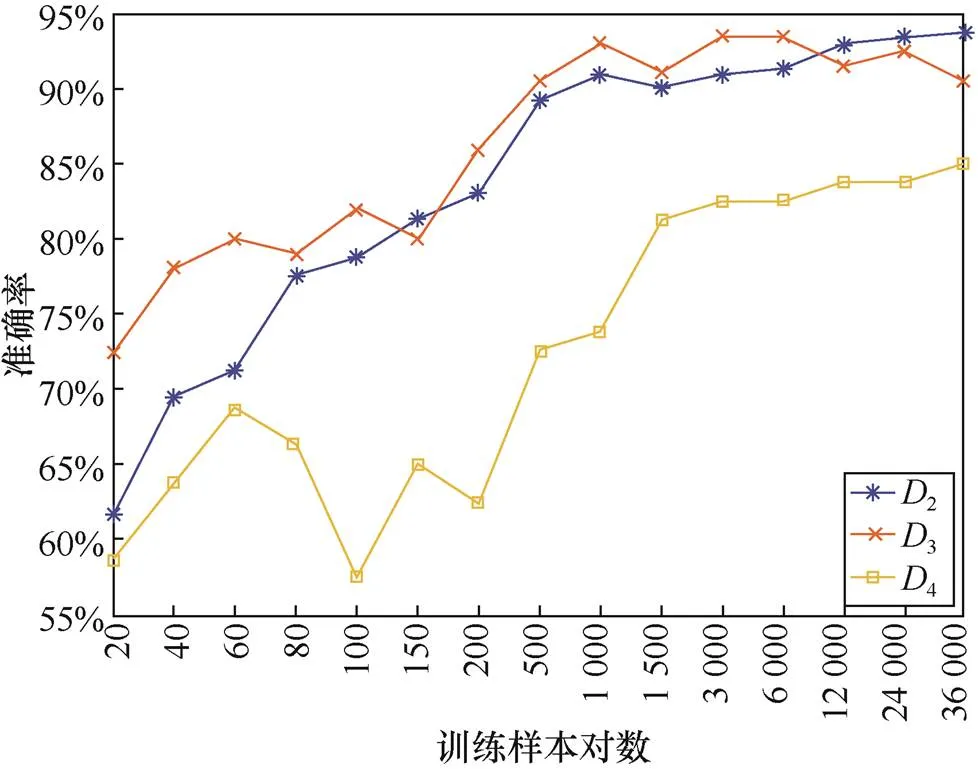

3.4 训练集数目对性能的影响

图10 不同数量的训练样本对的准确率

Figure 10 The accuracy of different numbers of training sample pairs

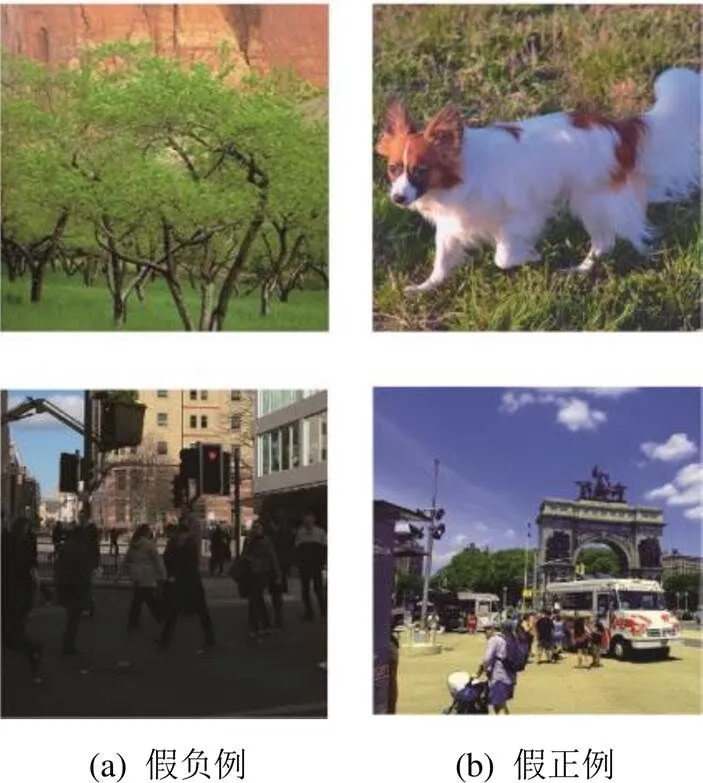

3.5 失败案例

图11 失败案例

Figure 11 Failure cases

3.6 实际场景应用

重着色技术是把“双刃剑”,在给人们带来便利的同时也产生了负面的影响。在特定的背景和应用场合下,肉眼难辨真伪的重着色图像不仅可能误导个人及公众的意见形成,甚至可能干扰司法,对社会造成很大的影响。如据美联社5月26日报道,有网络用户在社交网络推特上称美国广播公司在报道得克萨斯州校园枪击案时,对枪手的照片进行了包括重着色在内的编辑,“使他看起来更像白人”。虽然随后被证实为谣言,但截至该推特被平台处理时,该谣言已获得2 500多个转发和近4 000个赞。

为此,本文从COCO数据集[46]中挑选了60张人物肖像照片,其中包含不同的肤色、性别、年龄段、场景。随后使用图像编辑软件“美图秀秀”对每张图片进行了提亮肤色、添加滤镜等重着色操作。虽然重着色图像肉眼难辨真伪,但ICC-Method仍能获得90.83%的准确率。

上述结果表明本文提出的基于通道间相关性的检测方法能够为现实世界的重着色相关纠纷提供技术支持。

4 结束语

本文提出了一种基于通道间相关性的重着色图像检测方法,适用于重着色任务中的传统重着色和手工重着色场景。基于相机成像和重着色图像生成方式之间的显著差异,假设重着色操作或许会破坏自然图像的通道间相关性。随后的数值分析表明,虽然自然图像和重着色图像在视觉上难以分辨,但通道间相关性差异可作为区分二者的重要鉴别度量。基于上述先验知识,本文提取差分图像的一阶微分残差的通道共生矩阵特征,并且在3种不同假设情况下,评估了ICC-Method的有效性。实验结果表明,即使是训练数据与测试数据不匹配和手工重着色这两种具有挑战性的场景,ICC-Method也能取得较高的检测准确率,所提出的通道间相关性特征具有良好的泛化能力。同时,ICC-Method对训练数据量的依赖性较小。希望本文关于通道间相关性的发现能为重着色检测任务及相关的图像取证任务提供有用的见解。在未来,将探索更具有区别性的特征和更有效的特征编码方法来提高检测性能。

[1] NIGHTINGALE S J, WADE K A, WATSON D G. Can people identify original and manipulated photos of real-world scenes[J]. Cognitive Research: Principles and Implications, 2017, 2(1): 30.

[2] VERDOLIVA L. Media forensics and DeepFakes: an overview[J]. IEEE Journal of Selected Topics in Signal Processing, 2020, 14(5): 910-932.

[3] REINHARD E, ADHIKHMIN M, GOOCH B, et al. Color transfer between images[J]. IEEE Computer Graphics and Applications, 2001, 21(5): 34-41.

[4] PITIE F, KOKARAM A C, DAHYOT R. N-dimensional probability density function transfer and its application to color transfer[C]//Proceedings of Tenth IEEE International Conference on Computer Vision (ICCV'05). 2005: 1434-1439.

[5] TAI Y W, JIA J, TANG C K. Local color transfer via probabilistic segmentation by expectation-maximization[C]//Proceedings of 2005 IEEE Conference on Computer Vision and Pattern Recognition. 2005: 747-754.

[6] BEIGPOUR S, VAN DE WEIJER J. Object recoloring based on intrinsic image estimation[C]//Proceedings of 2011 International Conference on Computer Vision. 2011: 327-334.

[7] PITIÉ F, KOKARAM A C, DAHYOT R. Automated colour grading using colour distribution transfer[J]. Computer Vision and Image Understanding, 2007, 107(1/2): 123-137.

[8] PITIÉ F, KOKARAM A. The linear monge-kantorovitch linear colour mapping for example-based colour transfer[C]//European Conference on Visual Media Production. 2007: 1-9.

[9] GROGAN M, PRASAD M, DAHYOT R. L2 registration for colour transfer[C]//Proceedings of 2015 23rd European Signal Processing Conference (EUSIPCO). 2015: 1-5.

[10] LEVIN A, LISCHINSKI D, WEISS Y. Colorization using optimization[M]//ACM Siggraph. 2004: 689-694.

[11] QU Y, WONG T T, HENG P A. Manga colorization[J]. ACM Transactions on Graphics (TOG), 2006, 25(3): 1214-1220.

[12] AN X B, PELLACINI F. AppProp: all-pairs appearance-space edit propagation[C]//Proceedings of ACM SIGGRAPH 2008. 2008: 1-9.

[13] XU K, LI Y, JU T, et al. Efficient affinity-based edit propagation using KD tree[J]. ACM Transactions on Graphics (TOG), 2009, 28(5): 1-6.

[14] CHEN X W, ZOU D Q, LI J W, et al. Sparse dictionary learning for edit propagation of high-resolution images[C]//Proceedings of 2014 IEEE Conference on Computer Vision and Pattern Recognition. 2014: 2854-2861.

[15] O'DONOVAN P, AGARWALA A, HERTZMANN A. Color compatibility from large datasets[M]//ACM Siggraph. 2011: 1-12.

[16] LIN S, RITCHIE D, FISHER M, et al. Probabilistic color-by-numbers: Suggesting pattern colorizations using factor graphs[J]. ACM Transactions on Graphics (TOG), 2013, 32(4): 1-12.

[17] CHANG H, FRIED O, LIU Y, et al. Palette-based photo recoloring[J]. ACM Transactions on Graphics (TOG), 2015, 34(4): 1-11.

[18] TSAI Y H, SHEN X H, LIN Z, et al. Sky is not the limit: semantic-aware sky replacement[J]. ACM Transactions on Graphics, 2016, 35(4): 1-11.

[19] LEE J Y, SON H, LEE G, et al. Deep color transfer using histogram analogy[J]. The Visual Computer, 2020, 36(10): 2129-2143.

[20] HE M, LIAO J, CHEN D, et al. Progressive color transfer with dense semantic correspondences[J]. ACM Transactions on Graphics (TOG), 2019, 38(2): 1-18.

[21] ENDO Y, IIZUKA S, KANAMORI Y, et al. DeepProp: extracting deep features from a single image for edit propagation[J]. Computer Graphics Forum, 2016, 35(2): 189-201.

[22] ZHANG R, ZHU J Y, ISOLA P, et al. Real-time user-guided image colorization with learned deep priors[J]. arXiv preprint arXiv:1705.02999, 2017.

[23] CHO J, YUN S, LEE K, et al. PaletteNet: image recolorization with given color palette[C]//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops. 2017: 1058-1066.

[24] AFIFI M, PRICE B L, COHEN S, et al. Image recoloring based on object color distributions[C]//Eurographics (Short Papers). 2019: 33-36.

[25] LUAN F, PARIS S, SHECHTMAN E, et al. Deep photo style transfer[C]//Proceedings of 2017 IEEE Conference on Computer Vision and Pattern Recognition. 2017: 4990-4998.

[26] LI Y J, LIU M Y, LI X T, et al. A closed-form solution to photorealistic image stylization[C]//Proceedings of the European Conference on Computer Vision. 2018: 453-468.

[27] YOO J, UH Y, CHUN S, et al. Photorealistic style transfer via wavelet transforms[C]//Proceedings of 2019 IEEE/CVF International Conference on Computer Vision (ICCV). 2019: 9035-9044.

[28] BIRAJDAR G K, MANKAR V H. Digital image forgery detection using passive techniques: a survey[J]. Digital Investigation, 2013, 10(3): 226-245.

[29] 吴金海, 林福宗. 基于数字水印的图像认证技术[J]. 计算机学报, 2004, 27(9): 1153-1161.

WU J H, LIN F Z. Image authentication based on digital watermarking[J]. Chinese Journal of Computers, 2004, 27(9): 1153-1161.

[30] YERUSHALMY I, HEL-OR H. Digital image forgery detection based on lens and sensor aberration[J]. International Journal of Computer Vision, 2011, 92(1): 71-91.

[31] POPESCU A C, FARID H. Statistical tools for digital forensics[C]//International Workshop on Information Hiding. 2004: 128-147.

[32] LYU S W, PAN X Y, ZHANG X. Exposing region splicing forgeries with blind local noise estimation[J]. International Journal of Computer Vision, 2014, 110(2): 202-221.

[33] MAHDIAN B, SAIC S. Using noise inconsistencies for blind image forensics[J]. Image and Vision Computing, 2009, 27(10): 1497-1503.

[34] FRIDRICH A J, SOUKAL B D, LUKÁŠ A J. Detection of copy-move forgery in digital images[C]//Digital Forensic Research Workshop. 2003.

[35] YAN Y Y, REN W Q, CAO X C. Recolored image detection via a deep discriminative model[J]. IEEE Transactions on Information Forensics and Security, 2019, 14(1): 5-17.

[36] ZHANG Y S, CHEN N, QI S R, et al. Detecting recolored image by spatial correlation[J]. arXiv preprint arXiv:2204.10973, 2022.

[37] HO J S, AU O C, ZHOU J T, et al. Inter-channel demosaicking traces for digital image forensics[C]//Proceedings of 2010 IEEE International Conference on Multimedia and Expo. 2010: 1475-1480.

[38] VAN DE WEIJER J, GEVERS T, GIJSENIJ A. Edge-based color constancy[J]. IEEE Transactions on Image Processing: a Publication of the IEEE Signal Processing Society, 2007, 16(9): 2207-2214.

[39] CARVALHO T, FARIA F A, PEDRINI H, et al. Illuminant-based transformed spaces for image forensics[J]. IEEE Transactions on Information Forensics and Security, 2016, 11(4): 720-733.

[40] SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[J]. arXiv preprint arXiv:1409.1556, 2014.

[41] GUNTURK B K, ALTUNBASAK Y, MERSEREAU R M. Color plane interpolation using alternating projections[J]. IEEE Transactions on Image Processing: a Publication of the IEEE Signal Processing Society, 2002, 11(9): 997-1013.

[42] RUSSAKOVSKY O, DENG J, SU H, et al. ImageNet large scale visual recognition challenge[J]. International Journal of Computer Vision, 2015, 115(3): 211-252.

[43] CHANG C C, LIN C J. LIBSVM: a library for support vector machines[J]. ACM Transactions on Intelligent Systems and Technology, 2011, 2(3): 27.

[44] GOLJAN M, FRIDRICH J, COGRANNE R. Rich model for Steganalysis of color images[C]//Proceedings of 2014 IEEE International Workshop on Information Forensics and Security. 2014: 185-190.

[45] LI H D, LI B, TAN S Q, et al. Identification of deep network generated images using disparities in color components[J]. Signal Processing, 2020, 174: 107616.

[46] LIN T Y, MAIRE M, BELONGIE S, et al. Microsoft coco: common objects in context[C]//European Conference on Computer Vision. 2014: 740-755.

Image recoloring detection based on inter-channel correlation

CHEN Nuo1, QI Shuren1, ZHANG Yushu1, XUE Mingfu1, HUA Zhongyun2

1. College of Computer Science and Technology, Nanjing University of Aeronautics and Astronautics, Nanjing 211106, China 2. College of Computer Science and Technology, Harbin Institute of Technology, Shenzhen 518055, China

Image recoloring is an emerging editing technique that can change the color style of an image by modifying pixel values. With the rapid proliferation of social networks and image editing techniques, recolored images have seriously hampered the authenticity of the communicated information. However, there are few works specifically designed for image recoloring. Existing recoloring detection methods still have much improvement space in conventional recoloring scenarios and are ineffective in dealing with hand-crafted recolored images. For this purpose, a recolored image detection method based on inter-channel correlation was proposed for conventional recoloring and hand-crafted recoloring scenarios. Based on the phenomenon that there were significant disparities between camera imaging and recolored image generation methods, the hypothesis that recoloring operations might destroy the inter-channel correlation of natural images was proposed. The numerical analysis demonstrated that the inter-channel correlation disparities can be used as an important discriminative metric to distinguish between recolored images and natural images. Based on such new prior knowledge, the proposed method obtained the inter-channel correlation feature set of the image. The feature set was extracted from the channel co-occurrence matrix of the first-order differential residuals of the differential image. In addition, three detection scenarios were assumed based on practical situations, including scenarios with matching and mismatching between training-testing data, and scenario with hand-crafted recoloring. Experimental results show that the proposed method can accurately identify recolored images and outperforms existing methods in all three hypothetical scenarios, achieving state-of-the-art detection accuracy. In addition, the proposed method is less dependent on the amount of training data and can achieve fairly accurate prediction results with limited training data.

image recoloring, forgery detection, inter-channel correlation, image forensics

TP393

A

10.11959/j.issn.2096−109x.2022057

2022−05−25;

2022−07−01

张玉书,yushu@nuaa.edu.cn

南京航空航天大学研究生科研与实践创新计划项目(xcxjh20211606)

Graduate Research and Practice Innovation Program Project of Nanjing University of Aeronautics and Astronautics (xcxjh20211606)

陈诺, 祁树仁, 张玉书, 等. 基于通道间相关性的图像重着色检测[J]. 网络与信息安全学报, 2022, 8(5): 167-178.

Format: CHEN N, QI S R, ZHANG Y S, et al. Image recoloring detection based on inter-channel correlation [J]. Chinese Journal of Network and Information Security, 2022, 8(5): 167-178.

陈诺(1996− ),男,安徽六安人,南京航空航天大学硕士生,主要研究方向为数字图像内容取证。

祁树仁(1994−),男,辽宁朝阳人,南京航空航天大学博士生,主要研究方向为视觉表征、稳健模式识别和媒体内容安全。

张玉书(1987−),男,甘肃庆阳人,南京航空航天大学教授、博士生导师,主要研究方向为多媒体安全与人工智能、区块链与物联网安全、云计算与大数据安全。

薛明富(1986−),男,江苏南京人,南京航空航天大学副教授,主要研究方向为人工智能安全、硬件安全、硬件木马检测和深度学习模型的版权保护。

花忠云(1989−),男,湖南湘西州人,哈尔滨工业大学(深圳)副教授、博士生导师,主要研究方向为混沌理论及应用、多媒体安全、信息隐藏和图像处理。