基于相关滤波的舰船目标抗干扰跟踪算法

邱千钧, 周鹏耀, 高 欣, 张 芳, 吕梅柏

(1. 海军装备部驻北京地区第二军事代表室, 北京 100000; 2. 西北工业大学, 西安 710072; 3. 军工保密资格审查认证中心, 北京 100089; 4. 西安应用光学研究所, 西安 710065)

0 引 言

海上舰船目标跟踪是制导导弹实现准确打击的关键之一, 在跟踪算法中, 目标特征选取及特征提取方法很大程度上决定了跟踪性能的好坏。 舰船类目标制导系统特征的提取难点主要在于尺度缩放和特征丢失问题。 这些问题的存在使得跟踪任务可能会受到影响, 造成目标丢失、 跟踪非选中目标等结果。

随着计算机技术广泛应用到生产与生活中, 计算机数字处理技术在图像处理中的应用发展迅速[1]。 计算机视觉是图像处理中一个重要的研究方向, 其主要任务是利用计算机代替人眼对场景进行感知[2], 通过对摄取到的图像信息进行提取, 实现目标跟踪功能。

目标跟踪[3]作用机理是通过给定视频流中的第一帧或后续某一帧目标的坐标和长宽后, 在后续帧中对目标进行识别, 持续稳定跟踪目标的位置状态。 基于视觉目标跟踪主要分为基于可见光目标跟踪和基于红外目标跟踪[4]。 由于可见光图像容易获取并且拥有较高的分辨率和较为丰富的纹理细节, 因此本文目标跟踪算法基于可见光图像。

目标跟踪中基于相关滤波的跟踪算法应用较为广泛, 最早将相关性应用到目标跟踪中的算法是MOSSE(Minimum Output Sum of Squared Error)[5], 而之后衍生出的KCF(Kernelized Correlation Filters)算法[6]应用最广泛。

基于相关滤波开展的KCF算法使用目标的HOG(Histogram of Oriented Gradient)特征, 但这种特征对于目标尺度缩放、 目标形态变化等带来的特征丢失、 局部特征不足、 抗尺度变化能力不够等问题不能很好的解决。 因此, 本文针对以上问题, 开展基于HOG, LBP(Local binary patterns), CN(Color Names)三种特征柔性融合技术对原有KCF算法特征丢失及局部特征不足进行改进, 开展多分辨率阈值选取算法研究, 对KCF算法抗尺度缩放干扰能力不足进行优化。

实验研究表明, 本文提出的基于特征柔性融合和多分辨阈值选取的改进KCF算法, 有效解决了舰船类目标跟踪过程中特征模糊及丢失导致的形态变化和目标尺度缩放问题。

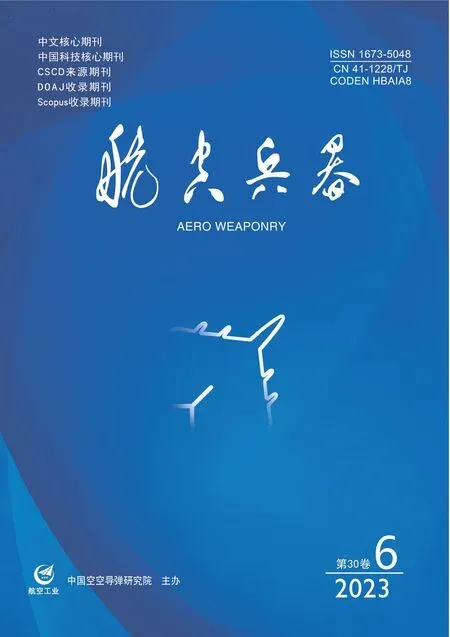

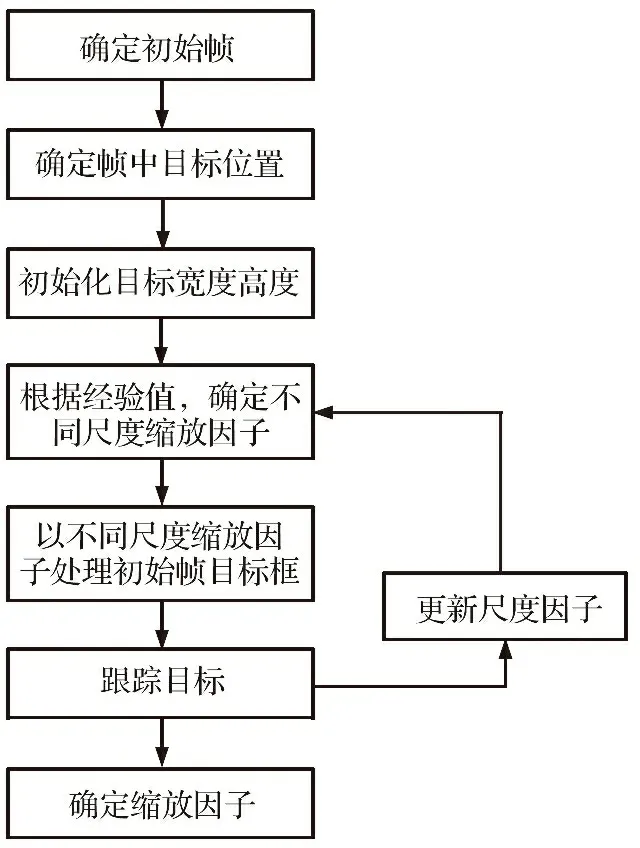

本文研究的算法逻辑流程如图1所示。

图1 算法逻辑流程图Fig.1 Algorithm logic flow chart

1 HOG, LBP, CN特征融合

可见光图像, 一般为RGB三通道[7], 其本质是一个二维矩阵, RGB图像是利用红色(Red)、 绿色(Green)、 蓝色(Blue)三个颜色进行加权堆叠得到二维矩阵中的一个像素。

特征提取是可见光目标跟踪制导系统的一个重要组成部分, 图像特征提取利用计算机提取图像的信息, 判别图像的像素点是否属于图像的一个特征。 特征提取把图像上的像素点分成不同子集[8], 子集一般分为孤立的点、 连续曲线或者连续区域。

图像特征种类很多, 因其应用于不同任务有很多种分类方法, 本文主要介绍三种特征, 分别为HOG特征、 CN特征、 LBP特征。 利用这三种特征进行特征像素级融合, 提高目标跟踪特征提取能力, 解决特征模糊问题。

1.1 HOG特征提取

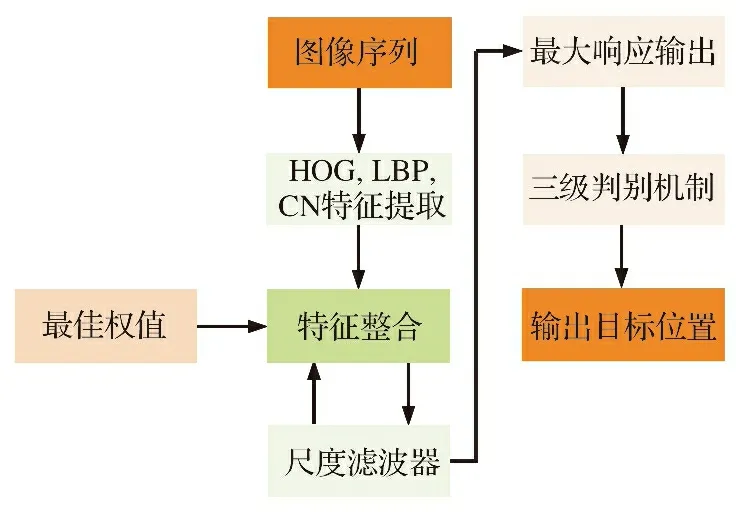

HOG特征是一种特性描述子, 即计算每个像素的梯度得到HOG特征[9]。 目标的局部形状可以被梯度很好地描述, 因为梯度主要存在于局部目标中的边缘区域。 提取HOG特征的步骤如图2所示。

图2 HOG特征提取流程示意图Fig.2 Diagram of HOG feature extraction

(1) 首先是输入图片, 之后对图像做归一化处理, 由于采集到的图像有时会过亮或过暗, 利用Gamma校正可以解决此问题[10], 其原理如下:

I0(x,y)=I(x,y)γ

(1)

式中:I(x,y)表示像素点的灰度值;I0(x,y)表示经过Gamma校正后的灰度值;γ表示矫正系数。 可以看出, Gamma校正本质是对图像灰度值做非线性操作, 使输出图像灰度值与输入图像灰度值呈指数关系, 当γ>1时, 图像中灰度较高的区域对比度增强, 图像变暗; 当γ<1时, 图像中灰度较低的区域对比度增强, 图像变亮; 当γ=1时, 不改变图像的灰度。

(2) 图像归一化后, 对图像中每个像素点计算梯度;

(3) 将图片分成若干个8×8的单元, 那么一个单元里会包含8×8×2个值, 即每个像素点包含两个信息, 梯度幅值和梯度方向, 将这128个值统计为梯度直方图, 此时特征从128维降到9维。 把0°~180°分成9个间距相等的直方图, 统计各个像素点从属于哪个直方图;

(4) 得到每一个单元的梯度直方图后, 每4个单元为一个子块, 即2×2个单元组成一个子块, 每个单元为1×9维, 4个单元则为1×36维, 再对子块进行归一化;

(5) 将子块框在图像上滑动遍历, 可以得到若干个归一化后的1×36维子块向量, 将这些向量整合拼接, 便可得到HOG特征向量。

1.2 LBP特征提取

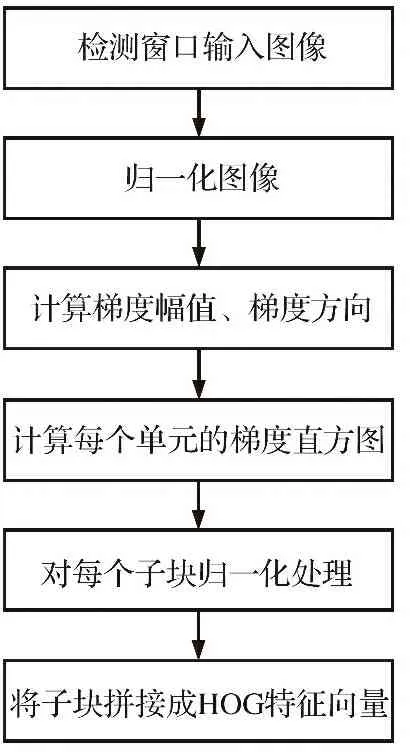

原始LBP特征提取时, 定义以当前像素为中心, 取大小为3×3的邻域, 把中心点像素灰度值作为阈值, 和相邻的8个像素的灰度值做比较, 如图3所示。

图3 中心像素LBP值提取示意图Fig.3 Schematic diagram of LBP value extraction of center pixel

对原图中某一像素点及其邻域灰度求解得到图3(b), 以中心点周围像素的灰度值大于中心点时记为1, 否则记为0作为判断标准, 对图3(b)进行阈值判断得到图3(c)。 将图3(c)中这8个数按顺时针组成一个8位二进制数, 这个数就是中心像素的LBP值。

原始LBP特征值计算公式为

(2)

式中: (xc,yc)为中心像素的坐标;n为3×3邻域中第n个像素;N为采样个数;i为邻域像素灰度值;ic为中心像素灰度值; sgn(x)为符号函数。

1.3 CN特征提取

颜色特征作为一种全局特征, 描述了图像或者图像区域对应景物的表面特征。 由于颜色对图像或者图像区域的方向、 大小等变化不敏感, 造成目标定位准确率低, 单独使用CN特征会造成许多不必要的图像也被检索出来。 但由于CN特征不受图像旋转和尺度变化的影响, 舰船类目标CN特征相对于背景较为明显, 所以采用CN特征对舰船类目标进行特征增强, 缩小背景噪声干扰。

颜色矩作为一种常用的CN特征提取方法, 采用颜色的一阶矩、 二阶矩足以表达图像的颜色分布。 相比于其他方法, 该方法无需对特征进行向量化, 一定程度上减少算法的参数, 提高算法实时性:

(3)

(4)

1.4 特征加权融合

考虑到舰船类目标由于目标形态变化等问题, 原有KCF使用的HOG特征无法解决上述问题。 因此, 提出了一种基于HOG特征, 对LBP和CN特征加权的特征提取方法。 该方法将舰船类目标图像进行均匀分块, 根据不同块对于LBP和CN特征识别贡献率添加不同权重, 加强舰船类目标重要部位对识别效果的影响。 该方法实现步骤如下:

(1) 使用m×m卷积将图像分成m块并提取HOG, LBP, CN特征。 整幅图像的特征向量为

H=(h1,h2,h3,h4, …,hm)

(5)

L=(l1,l2,l3,l4, …,lm)

(6)

式中:hi(1≤i≤m)表示第i子块的HOG特征向量;li(1≤i≤m)表示第i子块的LBP特征向量。

(2) 计算每个分块的加权系数。 由于舰船颜色与背景区分较为明显, 子块颜色标准差能够较为准确反映该子块内舰船颜色所占整个子块的比例。 因此, 比较子块标准差与舰船类目标颜色阈值的大小, 并统计符合阈值的子块, 若子块标准差越高, 赋予子块的权重就越大。 对划分为m块的每个子块提取到的颜色特征, 通过舰船类目标颜色阈值选取每个子块合适的权重。

C=(c1,c2,c3,c4, …,cm)

(7)

(8)

(9)

(3) 将不同子块的权重系数赋予相应子块的HOG特征向量和LBP向量, 得到加权后的HOG-LBP特征。

经实验测试, 本方法提出的HOG, LBP, CN融合算法对目标形态变化的问题有很好的改善效果, 解决了原有HOG特征在上述情况下的特征模糊及丢失问题。

2 KCF算法原理

2.1 岭回归分类器

KCF的基本模型是岭回归分类器。 这个分类器和目标的相似值为一个理想值, 也就是目标的中心为1, 其周围逐渐降低, 直至为0[11]。 设用于训练的样本集为(xi,yi), 可以得到线性回归函数f(xi):

f(xi)=ωTxi

(10)

式中:ω为列向量, 表示权重系数, 也是待求的项, 可通过最小二乘法求解。

(11)

式中:λ为正则化参数, 以防止过拟合。 将式(11)写为矩阵形式, 即

(12)

ω=(XTX+λI)-1XTy

(13)

2.2 循环矩阵

(14)

循环矩阵有很多良好的性质, 例如相似对角化[14], 即在复数域中任何n阶循环矩阵都可以对角化。

(15)

式中:F为酉矩阵。

2.3 ω简化计算

在引入循环矩阵后, 利用循环矩阵对角化的性质:

(16)

因此有

(17)

式中: ⊙代表点乘运算。

把式(16)代入式(13)中:

(18)

继续化简得到

(19)

对式(19)循环矩阵求逆的对角化性质:

(20)

式中:f为傅里叶变换,f-1为傅里叶逆变换。 之后再利用循环矩阵的卷积性质, 得到

(21)

2.4 核函数回归训练提速

f(z)=wTψ(z)

(22)

式中:f(z)转换为变换结果的线性函数;w是由训练样本的非线性变换ψ(xi)线性组合而成。

(23)

把式(23)代入式(22)中, 可得

(24)

(25)

式中:α为N×1维,κ(z)为N×1维, 其中第i个元素为训练的样本xi和测试的样本z的核函数值, 此时虽然f(z)是关于z的非线性函数, 但其却是关于核函数κ(z)的线性函数, 因此可以用线性函数优化法求解α:

α=(K+λI)-1y

(26)

式中:K为总训练样本的核相关矩阵,Kij=κ(xi,xj), 当K为高斯核时, 核相关矩阵也是循环矩阵[15], 因此可以对闭式解α进行简化:

(27)

(28)

再进行傅里叶变换, 得到最终简化结果:

(29)

3 KCF抗干扰改进算法

针对KCF算法中单训练滤波器造成的形态变化问题, 以及固定尺寸目标框响应峰值相对固定造成的尺度单一问题, 本文采用HOG, LBP, CN多特征滤波器融合及多分辨率目标框方法进行解决。

3.1 形态变化

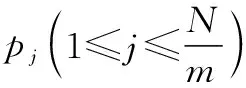

目标形态变化是目标跟踪领域中一个重要的挑战, 例如人在运动时躯体的变化, 鸟在飞翔时外观的改变。 形态外观的改变随之带来的是目标特征的改变, 因此选取对目标外观改变不敏感的特征进行相关滤波目标跟踪, 是解决形态变化的一种思路。 HOG特征具有几何不变与光学不变性[16], LBP特征具有旋转不变性和灰度不变性[17], 对HOG, LBP两种特征以及CN特征进行三特征融合。 利用式(29)对融合后的加权HOG-LBP特征训练滤波器:

(30)

(31)

将阈值乘以各自对应的响应矩阵, 得到最终响应矩阵, 可得最终响应图。 根据最终响应图中最高峰坐标得到目标位置, 如图4所示。

图4 三特征融合示意图Fig.4 Diagram of three features fusion

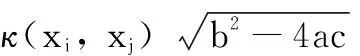

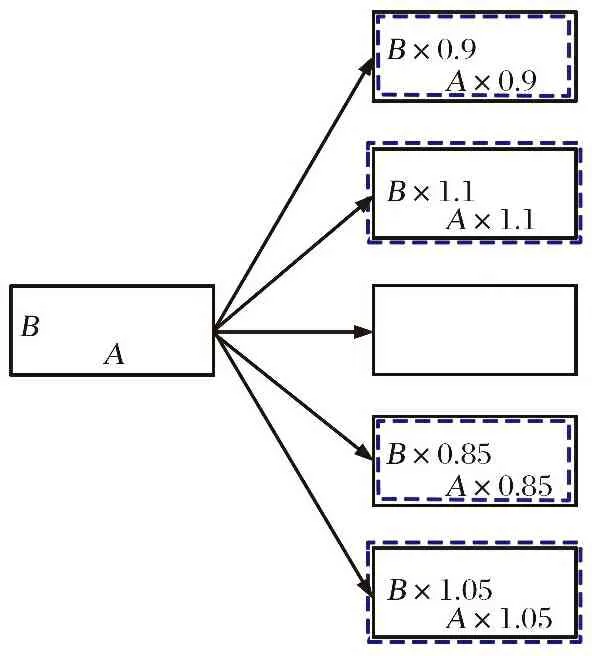

3.2 尺度缩放

针对舰船类目标跟踪过程中由于目标尺度问题造成的特征丢失问题, 提出了一种多分辨率目标框的解决方法。 该方法通过对目标框进行适当的缩放, 对每一帧的响应图用滤波器和训练样本与待检测区域样本之间的核相关矩阵按元素相乘得到。 在根据目标框获取待检测区域时, 对目标框进行缩放, 如图5所示, 图中黑框代表原目标框, 蓝框代表缩放后的目标框。

图5 五尺度目标框示意图Fig.5 Schematic diagram of five scale target frame

图5中所使用的0.9, 1.1, 0.85, 1.05缩放倍数通过由远及近多组舰船类目标由图6经验取值流程得到。

图6 缩放因子经验取值流程Fig.6 Empirical value setting process for scaling factors

图7 五尺度目标框生成响应示意图Fig.7 Response diagram of five scale target frame

4 KCF抗干扰改进算法实验

4.1 算法性能对比测试

为了进一步验证本文提出的跟踪算法性能, 将本方法和其他主流的目标跟踪方法进行性能对比, 以精确度及成功率作为视频跟踪效果的评价指标, 精确度指标反映了目标中心位置误差小于20像素的帧数占比, 中心位置误差即算法标定的中心位置与真实中心位置之间的平均欧式距离, 误差差值取20个像素。 假设算法标定的目标框的中心位置为(xpre,ypre), 真实目标框的中心位置为(xgt,ygt), 则中心位置误差计算公式如下:

(32)

算法标定成功率表示在总帧数中重叠率大于阈值的帧数占比, 该阈值取为0.5。 边界框重叠率即算法标定的目标框与真实目标框的交并比。 假设算法标定的目标框为Apre, 真实目标框为Agt, 重叠率OR的计算公式如下:

(33)

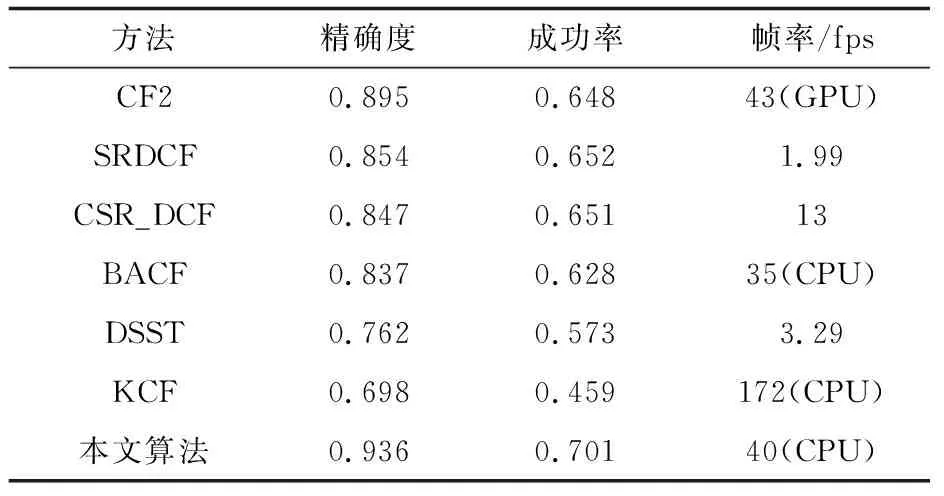

在海上目标数据集进行测试得到结果如图8所示。

图8 海上目标数据集上的测试结果Fig.8 Testing results on OTB

可以观察得到, 本文改进算法的性能均优于经典的滤波类跟踪算法, 精确度为 0.936, 较CF2算法性能提高了4.1%, 较KCF算法性能提升了23.8%; 成功率为0.701, 较CF2跟踪算法性能提高了5.3%, 较KCF算法性能提升了24.2%。 在海上目标跟踪数据集进行测试, 与其他六种算法的对比跟踪结果如表1所示。

表1 对比算法跟踪结果Table 1 Comparison of algorithm tracking results

4.2 OTB数据集实验

由于舰船类目标针对形变和尺度变化实验样本少, 而OTB数据集作为跟踪数据集包含各种复杂情况, 故本文所提出的三特征融合算法拟先在OTB数据集上验证抗形变和尺度变化能力。 本文选取OTB数据集中的DEF(形变)属性的视频作为实验对象, 其中较为经典的是Bolt2视频帧, 百米运动员在比赛奔跑过程中身体外观变化较大, 因此适用于测试抗形态变化相关滤波目标跟踪算法, 如图9所示, 图中黄色框为三特征融合后的跟踪结果, 绿框为灰度单特征的跟踪结果, 在前10帧时, 由于目标形态外观变化不大, 单特征算法与三特征融合算法表现都较好, 第24帧时单特征算法跟踪出现了位置漂移, 并且漂移量随着跟踪的进行持续增大, 在第143帧时完全丢失目标, 而三特征融合算法跟踪结果一直较为稳定, 未出现明显漂移现象, 也未出现跟丢目标的情况, 因此采用非独立置信度融合法对三特征进行融合后的相关滤波目标跟踪算法对于目标形态变化有较好的鲁棒性。

图9 抗形态变化相关滤波目标跟踪算法效果Fig.9 Effect of target tracking algorithm with correlation filtering against morphological changes

同样, 针对五尺度目标框测试, 首先在OTB数据集中CarScale视频中进行测试, 然后在舰船类目标测试。 如图10所示, 可以看到开始跟踪后第37帧和第116帧的目标大小比例变化不大, 第175帧、 第196帧和第232帧目标大小比例变化较大, 五尺度目标框可以较好地应对目标大小比例变化。

图10 五尺度目标框车辆测试视频Fig.10 Five scale target frame vehicle test video

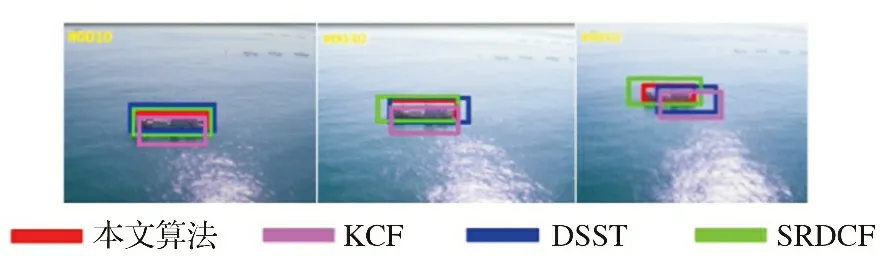

在舰船目标跟踪实验中, 选择同一场景下同一舰船目标进行算法对比实验结果展示。 对SRDCF, DSST, KCF经典滤波算法和本文算法进行定性实验, 对比跟踪结果如图11所示。

图11 跟踪结果Fig.11 Tracking Results

4.3 舰船目标实验

使用本算法对海上舰船目标进行实验, 分别选取舰船目标形态变化和尺度缩放的情况。 如图12所示, 航空母舰在转弯时会因自身角度变化导致形态变化, 本文提出的算法稳定锁住目标。

图12 舰船目标形态变化实验图Fig.12 Experimental image of ship target morphology change

由于真实军舰素材对于尺度验证难度大, 本方法采用仿真生成不同尺度下的军舰。 如图13所示, 军舰在由远及近靠近摄像头时, 军舰尺度会发生变化, 本文提出的算法稳定锁住目标。

图13 舰船目标尺度缩放实验图Fig.13 Experimental image of ship target scale change

5 结 论

为了解决舰船类目标由于特征模糊及形态变化和尺度缩放导致的目标丢失问题。 通过对于多特征融合和相关滤波机理性研究, 可以得出以下结论:

(1) 在形态变化中, 利用非独立置信度融合法对跟踪响应图进行阈值自适应融合, 将HOG、 CN和LBP特征进行了多特征融合, 较好地解决了目标形态变化对目标跟踪任务产生的问题。

(2) 在尺度缩放中, 利用五尺度分辨率目标框应对目标尺度缩放问题, 通过不同尺度目标框产生的跟踪响应图来得到目标的当前帧尺度, 较好地解决了目标尺度缩放对目标跟踪任务产生的问题。