基于多尺度混合注意力机制的SAR图像房屋分割方法

周一鸣,滕旭阳

(杭州电子科技大学,浙江杭州 310018)

0 引言

目前,在中国城镇化改造的背景下,对于一个地区城市变迁的分析需求日益强烈。SAR 图像相较于传统的光学图像,具有成像幅宽大、抗干扰能力强等优点,对于房屋建筑面积的变化情况、人口密度的分析、人口迁徙情况的观察和违章建筑的监督等研究具有重要意义[1]。然而,随着近年SAR 图像数据的急速增加,对于SAR 图像的识别和分割工作相对落后,因此,对于SAR 图像的语义分割、目标识别和对检测结果的分析等方面的研究具有重要意义。

在计算机视觉领域,关于SAR图像的解译一直是研究的热点,但受斑点噪声的影响,使得SAR 图像的分割工作变得十分困难[2]。在传统的检测分割方法中,郭拯危等人[3]提出了基于模糊聚类与最大类间方差法的混合模糊分割算法,该算法优化了聚类中心,在噪声较大、背景环境复杂的SAR 图像中有较大优势。齐千慧等人[4]提出了基于马尔科夫随机场的改变势函数的遥感图像分割方法,该方法将图像邻域像素点的相关性引入势函数,提高了检测系统的泛化能力。武尧等人[5]提出了基于机器视觉的多目标图像分割方法,对检测图像通过搜索范围来绘制灰度直方图,并以自适应算法确定最佳阈值,完成阈值分割。邢涛等人[6]提出了基于动态K均值的毫米波SAR图像分割方法,用图像数目的正比函数对适应度函数进行加以平均,提高了分割效率。上述传统分割方法提高了SAR 图像的分割效率,缓解了人工压力,但依然存在图像预处理复杂,使用场景受限,鲁棒性较差等问题。

现阶段,随着深度学习的研究不断深入,卷积神经网络(Convolutional Neural Network,CNN)的提出为SAR 图像的分割带来了新的研究方向,CNN[7]可以通过浅层学习的纹理特征和深层学习的语义特征,对SAR 图像的特征进行识别和分割。目前广泛使用的语义分割网络包括U-Net[8]、DeepLab 系列[9-12]网络、CBAM[13]、DANet[14]等。乌兰等人[15]提出了基于改进DeepLabv3+的马铃薯根系图像分割方法,DeepLabv3+可获得不同尺度的特征信息,但解码器部分易损失较多的细节信息。范艺华等人[16]提出了结合上下文编码和特征融合的SAR图像分割方法,降低了模型的复杂度和对计算资源的需求,但在物体的边缘分割上存在缺陷。

受成像机制的影响,SAR 图像在成像的过程中,房屋建筑由于平台的不稳定导致几何形变,也会由于斜距成像产生透视收缩,此外,房屋还会和有一定高度的地物产生叠掩现象,这些都大大增加了图像信息的提取难度。所以,基于传统的深度学习方法对SAR图像中的建筑进行分割,效果往往不尽如人意。本文提出了一种基于多尺度混合注意力机制融合的SAR图像房屋分割网络。首先在特征提取部分引入CBAM 注意力模块对重要通道和关键位置进行特征增强,并对主干网络引入不同膨胀率的空洞卷积扩大感受野。然后将提取到的特征图输入至DANet 双通道自注意力网络,提取上下文信息,避免相同特征受透视收缩和几何形变而变化。在解码部分,采用多尺度特征融合处理,增强各局部特征的依赖性。

1 算法模型

1.1 CBAM注意力机制

CBAM 注意力机制由通道注意力模块(Channel Attention Module,CAM)和空间注意力模块(Spatial Attention Module,SAM)串行组成。其中CAM 对输入特征图进行基于宽度和高度的全局最大池化和全局平局池化,然后通过多层感知机激活,最后将两模块进行基于元素的加和得到输入特征图中每个通道的权值,将权值与原始特征图点乘,以加强关键通道的特征表现。公式可表示为:

其中F为输入特征图,Mc()为通道注意力模块,σ为sigmoid激活函数,MPL为多层感知模块,AvgPool和MaxPool分别为全局平局池化和全局最大池化。

针对SAR 图像中的房屋建筑分割存在部分目标小,边界难以划分的问题,可通过SAM 模块进行特征增强,强化边界特征。SAM对输入特征图进行基于通道的全局最大池化和全局平均池化,然后对两特征图进行通道拼接,最后降维后得到每个特征点的权值,将权值与原始特征图点乘,以加强关键位置的特征表现。公式表示为:

其中Ms()为空间注意力模块,f7×7为7 × 7 的卷积核,[· ;·]为基于通道维度的拼接。

图1 CBAM网络结构

1.2 DANet注意力机制

CBAM 模块可以加强对关键通道和重要位置的特征表现,但是无法捕捉相同特征的长距离依赖,和上下文信息,受SAR图像成像过程中几何形变和透视收缩的影响,需对网络增加自注意模块,加强相同特征的长距离依赖关系。

DANet 注意力机制由空间自注意力机制和通道自注意力机制两部分并行组成,该注意力机制可自适应地将局部特征与全局特征进行集成,捕捉丰富的上下文信息。空间自注意力模块可将特征图中相似的特征进行关联,捕获网络中局部特征的长距离关系;通道自注意力模块可加强不同通道间的相互依赖关系。通过加强相似特征间的关联性,解决SAR图像中房屋几何形变和透视收缩等带来的问题。

对于尺寸为C×H×W的输入特征图A,空间自注意力模块处理步骤如下:

其中,A 为输入的特征图,B、C、D 为经过卷积层后得到的特征图,sij为第i 个位置对第j 个位置的影响,α为尺度参数,初始设置为0,E∈RC×H×W为最后的输出特征图。通道自注意力机制用于捕获各个通道间的依赖关系,具体步骤如下:

其中,A*为重塑后得到的特征图,xij为第i个通道对第j个通道的影响,β为尺度参数,并初始化为0,E∈RC×H×W为最后的输出特征图。最后将两个分支得到的特征图进行相加融合,得到输出结果。

1.3 空洞卷积

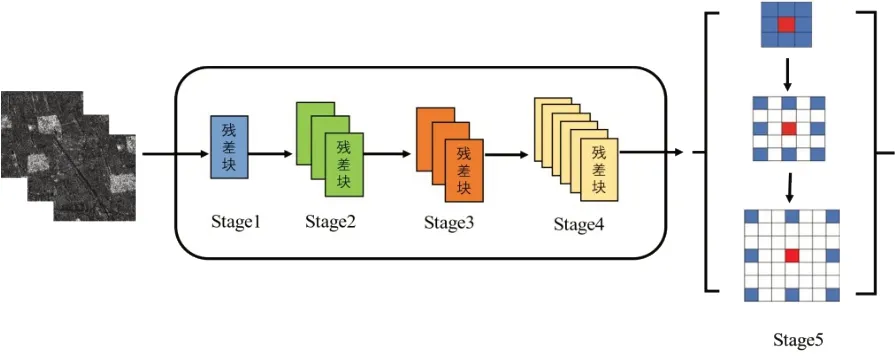

传统的特征提取网络,在提取特征的过程中为增加卷积核的感受野,降低计算量,会通过下采样降低特征图的分辨率,造成细节特征的损失。为不丢失分辨率同时扩大感受野,本文使用空洞卷积,扩大感受野的特点可有效适应大幅宽的SAR图像分割任务,同时通过调整卷积核的膨胀率可以得到不同尺度的信息。不同膨胀率的卷积核如图所示,本文主干网络采用ResNet50,ResNet50 包含5 个stages,共有5 种不同参数的卷积阶段,可以利用ResNet50网络的特殊的残差跳连结构来避免因网络加深带来的梯度爆炸和梯度消失的问题,加快模型的收敛。本文将stage5 中的卷积改为不同膨胀率的空洞卷积来增大卷积核的感受野,网络结构如下图。

图2 不同膨胀率的卷积核

图3 添加了空洞卷积的ResNet网络结构

1.4 多尺度特征融合

在上述编码部分,通过ResNet50主干网络获得了图像的基本特征,空洞卷积扩大了卷积核的感受野,CBAM 注意力模块对特征图的重要通道和关键位置做了特征增强,DANet自注意力模块在空间和通道两个维度上建立了相同特征之间的长距离依赖,得到了输出特征图。为充分利用各模块提取的特征,增强各模块在解码器中的表现,本文提出了基于多尺度融合的解码分类器。通过ResNet50 的stages4 输出的为1 024 通道的特征图,包含通过CBAM 注意力模块得到的房屋特征,可通过1 × 1 的卷积核对特征图进行逐像素点卷积降维至512维,同理将stage5得到的2 048通道的特征图通过1 × 1的卷积核降维至512维,并进行2 倍上采样,最后将DANet 自注意模块的输出特征图与上述特征2倍上采样后进行拼接,上采样至初始分辨率。通过多尺度融合,可充分利用浅层特征和上下文信息。

图4 本文算法网络结构

2 实验过程与结果分析

2.1 数据集

实验数据为高分三号(GF-3)精细模式SAR 图像SARBuD1.0[17],该数据集包含中国不同区域、不同地形、不同建筑分布类型的建筑区共60 000 个大小为256 × 256的SAR图像样本,数据集中包含,不同极化方式、不同升降轨的样本,可提高模型的泛化能力,且已完成了对数据集的预处理,包括幅度图的生成、地理编码、辐射定标等。本文实验总共选取不同地形的房屋样本3000 张,随机抽取500 作为测试集,将剩余的样本按照10:1 的比例随机划分为训练集和验证集进行训练。

2.2 实验条件

本实验所使用硬件环境:处理器为Intel(R) Core(TM) i9-10920X CPU @ 3.50GHz,GPU 型 号NVIDIA GeForce RTX 3090,软件环境:Ubuntu18.04,CUDA-11.3,PyTorch-1.10,Python-3.8。实验相关参数:权重衰减为1e-4,初始学习率0.01,批处理量为8,迭代次数为200次。

2.3 算法评价标准

为测试训练模型的性能,将分割结果与真实的标签图进行分析比较,需选取合适的评价指标,本文选取像素准确率(Pixel Accuracy,PA)、类别像素准确率(Class Pixel Accuray,CPA)、平均交并比(Mean Interisection over Union,MIou)、频权交并比(Frequency Weighted Intersection over Union,FWIoU)四个语义分割领域常用的评价指标对分割结果进行综合评价。各评价指标计算公式分别为:

本实验中,SAR 图像中的房屋建筑为正例,背景为负例。其中TP表示将各个像素点正确地划分为正例的个数,TN表示正确地划分为负例的个数,FP为错误地划分为正例的个数,FN 表示错误地划分为负例的个数。PA则可以表示对房屋和背景正确预测的像素数占总像素数的比例。CPA 则表示在所有被预测为是房屋的像素中,真正属于房屋的像素。MIoU 表示SAR 图像数据集真实值和预测值两集合交集和并集之比。各指标越接近1,代表分类器越好。

2.4 结果分析

为验证本文算法在对于SAR 图像房屋建筑分割任务上的优势,在相同的实验条件下将分割结果分别与CBAM、DANet 三个网络进行对比。对比结果如表1所示。

表1 各网络分割结果对比

传统的深度学习网络,在SAR图像房屋建筑分割任务上,受斑点噪声的影响,存在特征难以提取、相同特征在成像过程中易变形的问题。本文算法在编码端添加了基于CBAM的空间和通道注意力模块,基于DANet 的自注意力模块用于强化特征表现并建立特征间的长距离依赖,避免了相同特征受透视收缩和几何形变而难以识别,增强了网络的特征提取能力。对比各个网络的分割结果,本文算法在PA、MIoU、FWIoU三个指标上均为最高,PA达到96.54%且MIoU达到87.22%。与其他网络相比,本文算法在MIoU 上分别提高了5.1%、0.99%。分割效果对比如图5所示。

图5 各网络分割效果对比图

本文算法在编码端,在ResNet网络的基础上添加了空洞卷积用于扩大感受野,提高特征提取能力。在编码端采用了基于多尺度特征融合的解码方式,充分利用各个注意力模块,提高特征表现能力。为验证两模块在算法中的有效性,将本文算法与未改进的算法进行比较,表2为本文算法与未加入空洞卷积和未使用多尺度特征融合网络的对比结果。

表2 不同模块的性能效果

由表2 可知,使用传统的解码器,在SARBuD1.0数据集的测试上,各指标与加入多尺度融合算法的解码器相比有明显下降。对比数据,PA 提高了1.13%,CPA提高了2.04%,MIoU提高了1.95%,FWIoU提高了1.67%,说明了在解码端引入多尺度融合模块,可有效利用浅层特征和上下文信息,充分利用各注意力模块。由数据可知,空洞卷积的加入也使各指标有了较为明显的提升,说明空洞卷积可有效扩大网络的感受野,增加分辨率,更加精确的定位目标。

3 结论

针对目前传统算法对于SAR 图像房屋检测任务特征提取不足的问题,本文提出了基于多尺度混合注意力融合机制的SAR图像房屋分割方法,利用CBAM模块对于重点信息的特征增强能力和DANet 建立特征长距离依赖的能力,提高了网络的特征提取能力,其次,在解码端使用多尺度特征融合的方法充分利用上下文信息,提高了图像的分割精度。实验结果表明,本算法在SAR房屋建筑分割任务上与传统网络相比有更好的性能。PA 达到96.54%且MIoU 达到了87.22%。与CBAM 和DANet 相比,本文算法在MIoU上分别提高了5.1%、0.99%,验证了本文算法的有效性。