面向知识图谱链接预测任务的解释子图生成模型

姚俊萍 袁聪 李晓军 郭毅 王浩 周志杰

收稿日期:2023-06-02;修回日期:2023-08-14 基金項目:国家自然科学基金资助项目;陕西省科技创新团队项目

作者简介:姚俊萍(1978—),女,陕西人,教授,硕导,博士,主要研究方向为信息系统与数据工程;袁聪(1996—),男,河南淇县人,硕士研究生,主要研究方向为知识图谱推理;李晓军(1981—),男(通信作者),河北人,副教授,硕导,博士,主要研究方向为信息系统与数据工程(xi_anlxj@126.com);郭毅(1981—),男,陕西西安人,工程师,博士,主要研究方向为大数据与软件工程;王浩(1996—),男,内蒙古呼和浩特人,硕士研究生,主要研究方向为数据噪声标签处理;周志杰(1978—),男,山西人,教授,博导,博士,主要研究方向为证据推理、置信规则库.

摘 要:近年来图神经网络(GNN)发展迅速,相关模型在知识图谱链接预测任务上的性能显著提升。为解释性能提升的原因,研究人员需要提取GNN学习到的子图模式。然而现有GNN解释器在知识图谱这类典型多关系(multi-relation)图数据场景下的解释准确性尚未被验证,且相关工具尚未实现,导致解释子图提取困难。针对该问题,提出一种将多关系的知识图谱转换为单关系(uni-relational)图的知识图谱链接预测模型,该模型通过将知识图谱中的实体组合为新的节点,并将关系作为新节点的特征,生成只有单一关系的新图,并在新图上训练去噪自编码器使其获得链接预测能力,最后使用GNN解释器生成子图解释。在三个基准数据集上的实验表明,与不进行转换的GraIL相比,基于单关系转换的链接预测模型的相对AUC指标提升显著。最后,该模型选取FB15K-237数据集进行解释子图提取实验,验证了模型在直接提取链接预测解释方面的有效性。

关键词:可解释性;知识图谱;知识推理;图神经网络;模型无关解释方法

中图分类号:TP391 文献标志码:A 文章编号:1001-3695(2024)02-008-0375-06

doi:10.19734/j.issn.1001-3695.2023.06.0260Interpretive subgraph generation model for

knowledge graph link prediction task

Yao Junping,Yuan Cong,Li Xiaojun,Guo Yi,Wang Hao,Zhou Zhijie

(Rocket Force University of Engineering,Xian 710025,China)

Abstract:In recent years,GNN has developed rapidly,and the performance of related models in knowledge graph link prediction tasks has been significantly improved.To explain the performance improvement,the researchers need to extract the subgraph patterns learned by the GNN.However,the interpretation accuracy of existing GNN interpreters in typical multi-relational graph data scenarios such as knowledge graphs has not been verified,and related tools have not yet been implemented,resulting in difficulty in extracting interpretation subgraphs.In response to this problem,this paper proposed a knowledge graph link prediction model that converted a multi-relational knowledge graph into a uni-relational graph.The model combined the entities in the knowledge graph into new nodes and the relationship as a new node.Node features generated a new graph with only a single relationship,and trained a denoising autoencoder on the new graph to obtain link prediction capabilities,and finally used a GNN interpreter to generate subgraph explanations.Experiments on three benchmark datasets show that the relative AUC index of the link prediction model based on single-relational transformation is significantly improved compared with GraIL without transformation.Finally,this paper selected the FB15K-237 dataset to conduct explanatory subgraph extraction experiments,and verified the effectiveness of the model in directly extracting link prediction explanations.

Key words:interpretability;knowledge graph(KG);knowledge reasoning;graph neural network(GNN);model-agnostic explanatory methods

0 引言

知识图谱(KG)[1]是一种使用标准格式三元组表示的事实集合。同时,它也被认为是一种以图结构作为存储形式的数据库,图中的每个节点和边分别代表知识图谱中的实体和它们之间的关系。由于现实中的知识图谱,尤其是大规模知识图谱往往不是完备的,这导致许多下游任务如基于知识图谱的问答系统[2,3]和推荐系统[4,5]在实践中的表现受到限制。因此,为了实现对实体间缺失关系的预测,进而对不完整的知识图谱进行自动补全,知识图谱上的链接预测任务受到了越来越多的关注。基于嵌入的知识图谱链接预测模型[6]旨在为知识图谱中的实体和关系学习合适的向量表示,并基于学习到的表示得到关系的预测结果。得益于图神经网络(graph neural network,GNN)近年来的发展,基于嵌入的知识图谱链接预测模型有了新的编码器可以选择。根据消息传递范式MPNN[7]对GNN的描述,GNN是通过聚合(aggregate)和更新(update)两个函数更新每个节点特征,在聚合每个节点邻域的过程中将图数据的拓扑信息也编码到了节点表示中,因而学习到的嵌入相比传统方法效果更好。知识图谱的逻辑结构也是一种图结构数据,因而使用GNN来获得知识图谱的表示,进而对知识图谱进行补全成为一个自然的研究方向[8]。

可解释性一直是所有基于神经网络的算法和应用实践中面临的共同挑战。研究可解释性可以建立用户的信任,另一方面对研究者而言,给出的解释也是辅助科学发现的重要途径。当前对于基于GNN的相关模型的可解释性研究主要集中在开发一种解释器,通过解释器寻找输入图中与模型预测结果最相关的子图。这些子图可以反映出GNN在决策时所依据的模式。

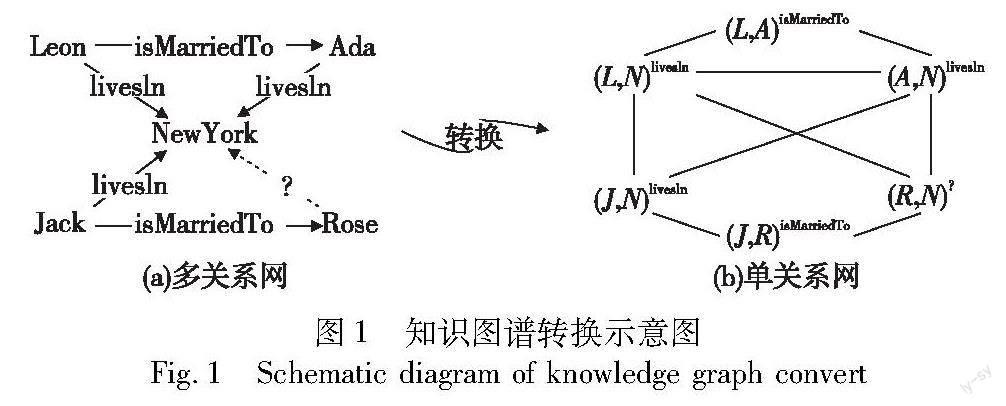

GNN主要面向单关系数据上的节点分类任务以及图分类任务[9],因而现有的解释器也主要面向单关系场景。要想为知识图谱上的链接预测任务生成解释,则需要解释器可以在多关系图上正常工作,但现有的解释工具发展均不成熟,针对知识图谱中推理模式的研究难以开展。为解决这一问题,本文提出一种将多关系图转换为单关系图的知识图谱链接预测模型。通过这样的转换,一方面可以将复杂的多关系图转换为更简单的单关系图,另一方面也可以将链接预测任务转换为一种节点分类任务。图1展示了一个转换的示例。

图1(a)是一个小型的知识图谱,存在两种关系(livesIn和isMarriedTo)以及五个实体。可以看出它是一个比较复杂的有向多关系图,通过转换,图1(b)中已经不包含关系的类型单关系图,且每条边都是无向的。GNN只需要在转换后的图上学习如何准确预测节点(Rose,NewYork)的类型为livesIn。

在此背景下,本文开展基于单关系转换的知识图谱链接预测子图解释生成研究,主要贡献为:

a)提出了一种将多关系图向单关系图进行转换的方法。这种转换可以令现有的解释器不加改动地应用到知识图谱链接预测的任务上。

b)验证了在多关系数据场景下提取解释子图的可行性,并就提取的子图进行了分类分析。

1 相关工作

a)基于GNN的知识图谱补全。知识图谱是一种多关系图,而GNN主要是为单关系图设计的,因此要应用在知识图谱上,需要根据这样的数据特点进行针对性设计。Marcheggiani等人[10]提出一种新的基于GNN的语义标注模型Syntactic GCN,该模型首次将句法依存树视做一种图结构数据进行处理,并第一次提出了为每种不同类型的边分别定义参数矩阵的思想。Schlichtkrull等人[11]在这项研究的基础上进一步抽象总结提出了R-GCN模型,第一次证明了GNN可以应用于建模知识图谱这样的关系数据。类似地,Vashishth等人[12]认为R-GCN仅学习了节点表示而没有学习关系的表示,因此不能直接应用于需要关系嵌入的链接预测任务中,于是提出CompGCN来解决此问题。除了为每种关系定义参数矩阵外,Nathani等人[13]提出可以在聚合时为每条边分配注意力分数,通过注意力分数控制在聚合时不同类型边上的消息传播。上述工作均聚焦于改进GNN自身的聚合组件,另一些工作致力于通过对知识图谱进行一定的预处理后再利用R-GCN 等捕获相关特征。例如:GraIL[14]通过提取目标三元组的局部子图,然后结合GNN进行推理;RED-GNN[15]借助KG中提取的有向关系图,然后基于关系有向图训练GNN进行推理。以上基于GNN的模型在各项指标上取得了良好的表现,其有效性往往归因于GNN从数据中学习到了传统方法所不能感知的拓扑结构信息,而要显式提取出所学习到的拓扑结构则需要借助于面向GNN的解释方法。

b)面向GNN的解释方法。可解释性是深度学习领域的一个重要研究内容,文献对其分类的角度比较多。主要的二分法有实例级和模型级解释、事前解释和事后解释以及模型相关和模型无关解释。要解释基于GNN的知识推理模型,则必须要解释作为推理核心的GNN组件。GNN由于发展较晚,对其可解释性的研究也处于起步阶段。目前的研究主要集中于模型无关的实例级事后解释方法,其主要思想是通过最大化子图与模型预测之间的互信息来寻找与模型预测最相关的子图,某种意义上可以认为是一种对原图去噪的过程。例如,GNN-Explainer[16]为每张图单独训练生成掩码。而Luo等人[17]认为前者在生成掩码效率方面存在缺陷,于是提出PGExplainer为多张图同时训练掩码。最近,Amara等人[18]尝试将所有解释方法进行归納总结,建立统一框架横向评估各类GNN解释模型,无论是否存在ground-truth解释。以上解释方法在解释单关系图上的节点分类结果时较为准确,这在一些人造数据集上已经得到验证,但在知识图谱上还没有进行实验验证,且它们不能直接解释链接预测的结果。

2 基于单关系图转换的知识图谱链接预测模型

2.1 模型框架

知识图谱链接预测模型旨在通过已知信息推断实体间缺失的链接,也可以认为是一种对数据集的去噪问题,其中缺失的链接即为图中的噪声。去噪自编码器(denoising auto-encoder,DAE)[19]是一种常见的模型,它通过按一定比例随机破坏输入数据并以未破坏的原始数据为优化目标进行学习,最终模型可以学会如何对缺失的数据进行补全。基于此,本文将模型构造为一个在图上工作的DAE。模型的整体结构如图2所示。本文按照一定比例随机掩盖知识图谱中的三元组,这相当于为知识图谱人工添加噪声。然后将带有噪声的知识图谱转换为单关系无向图,并在此基础上应用GNN进行去噪编码。当GNN成功学习到如何去噪时,也就学会了如何进行链接预测。最后本文研究了GNN解释器学习到的补全模式。

以上过程用符号化的描述为:对于一个知识图谱K,由于K中不存在负例,所以首先需要通过负采样将 K 扩展为,中的每一个三元组都被分配了一个二元标签并形成一个四元组(h,r,t,l)。当 l=1 时表示正例,即该三元组是原本存在于K中的;l=0时为负例,表示该三元组由负采样得到。然后本文将按一定比例随机遮蔽(mask),得到c和被遮蔽的三元组集合Λ。模型的训练目标即为将Λ准确还原到c中。从数据结构的角度看,是一种图m,其中的节点和边分别为中的实体和关系。m是一个多关系的有向图,单关系无向图上的解释器难以应用,因此需要进一步转换为单关系(uni-relation)无向图u。之所以要研究模型在数据集上的解释,是因为本文希望了解基于GNN的链接预测模型会在知识图谱上捕获到何种模式。图1(a)是一个知识图谱上链接预测的示例,从中可以观察到一个明显的模式,即结婚的两个人住在同一座城市。基于此模式,人類可以很有信心地推理出(Rose,livesIn,NewYork),而一个训练好的链接预测模型也应该可以从数据集中学习到这样的模式并作出正确的预测,而GNN解释器的研究提供了理解模型决策的途径。

2.2 单关系图转换

复杂的多关系有向图m向单关系无向图u转换可以分为节点的转换和边的转换两个部分。在m中,每条边连接着两个不同的节点,边的类型代表了节点之间的语义联系,边的方向指出了头尾顺序。为了可以通过转换使新图成为单一关系类型,本文提出将m中存在连接的两个节点组成有序偶充当新图中的节点,有序偶的顺序即是原本边的方向,而原本边上的类型则由新图的特征向量中的非零元素指示。为了尽可能连接所有新节点,保证信息连通,本文规定只要两个有序偶共享相同的元素,即将两者用一条无类型的无向边连接。

同时通过这样的转换,原m上的链接预测问题等效于有序偶的分类问题,进而可以使用普通的GNN模型对其中的模式进行学习,并利用现有的GNN解释器提取解释。以下分别从节点和边的生成阐述具体的转换过程。

2.2.1 节点转换规则

单一关系图转换的整体过程如式(1)所示。

m=(V,E,R)u=(V′,E′,T)(1)

其中:V、E、R分别表示节点和边以及边的类型集合;V′、E′和T分别为u中的节点、边以及节点的类型集合。针对节点转换任务,本文遍历E并取(h,t)∈E,构成新图u中的一个节点vr(h,t),上标r∈Euclid Math TwoRAp表示该节点所属的类别。

以图2为例,本文用首字母缩写L、A、J、R分别代表节点Leon、Ada、Jack、Rose,于是V={L,A,J,R},E={(L,A),(A,L),(L,N),(J,N),(J,R),(R,J),(A,N)},R={isMarriedTo,livesIn}。节点转换共有两个任务:

a)构造V′。由于本文目标是通过边获得有序偶进而构成V′,所以直接令V′=E。为了表示的紧凑性,本文为V′中的每个节点分配一个唯一的ID,如{(L,A):0,(A,L):1,…}。

b)初始化V′的特征。对于V′的特征初始化,每个节点首先会被分配一个维度为|R|的全零向量x。然后为R中的元素按首字母排序并分配ID,如R={isMarriedTo:0,livesIn:1}。根据R中关系的ID,本文将x中相应id的元素置为1,即xi=1。如本文对V′中的节点(L,A)isMarriedTo的特征进行初始化, 由于|R|=2,于是令x=[0,0]。由于id(isMarriedTo)=0,所以将x的第0个元素置为1,即x=[1,0],这样就得到了节点的初始化特征。

2.2.2 边转换规则

u相较于m的重要区别在于前者的边是单关系类型且无向的。通过节点转换,本文可以得到V′,V′是由有序偶构成的。为了连接这些有序偶,本文规定:对于两个节点vi和vj,若两者对应的有序偶中存在相同的实体,则将两者用一条无向边e相连。例如,假设u有节点v(a,b)和v(b,c),其中a、b、c表示m中的节点,因为两者共享节点b,此时它们之间将生成一条无向边e=(v(a,b),v(b,c))。该无向边本身不具有属性,仅表示一种邻接关系。

2.2.3 转换图空间复杂度分析

为了估计转换后的单关系图u与原图m之间的规模关系,本文已知m的节点数为|V|=m,假设m中的每一个节点都与其他m-1个节点有关联,则可以得到m最多有|E|=m2条边。通过将m转换为u,u的节点数|V′|取决于m的边数|E|,假设u是全连接图,则u的边数|E′|=|E|2,即在全连接的情况下u的边数相较于m的边数呈二次方增长,或者节点数的m4增长。通过以上估算,即使在连接最密集的情况下,转换后的图规模与原图之间依然是多项式复杂度的。多项式复杂度的算法在实践中可以被接受。且由于知识图谱中的连接一般具有稀疏性,u相较于m,在图的大小方面不满足2次增长关系,所以可以认为这样的转换是线性的。

2.3 GNN模型设置

在MPNN框架的描述中,GNN的工作主要分消息传递(massage passing)和读出(read-out)两个阶段。在消息传递阶段,GNN主要执行了消息函数、聚合(aggragated)函数和更新(update)函数三个子函数。在读出阶段GNN执行读出函数。形式上,一个消息传递的网络可以由如下方程定义:

m(t+1)e=(x(t)v,x(t)u,w(t)e),(u,v,e)∈Euclid Math OneEAp(2)

x(t+1)v=ψ(x(t)v,ρ({m(t+1)e:(u,v,e)∈Euclid Math OneEAp}))(3)

=R({xTv|v∈G})(4)

其中:消息函数通过将边上的特征与所连接节点的特征相结合生成消息。聚合函数ρ会将从边上传递的消息聚合到节点,最常见的聚合函数可以是简单的加和(sum),也可以是max或者min。最后更新函数ψ会结合聚合后的消息和节点本身更新特征。对于普通的节点分类任务,读出函数可以是一个softmax函数,而对于图级分类任务,读出函数可能需要将所有节点做加和后归一化以得到全图的表示。

在本文方法中,GNN模块由两层图卷积神经网络(GCN)构成,使用ReLU作为激活函数。ReLU具有计算效率高,可以防止梯度消失问题的优点。为便于计算损失,在最后一层,本文使用sigmoid将输出值限制在(0,1)。

2.4 解释生成

在本文方法中,为了生成链接预测的解释,采用目前性能表现最良好[20]的解释器GNNExplainer。GNNExplainer的核心观点是GNN对图上某个节点作出预测所需要的全部信息完全由其周邊邻域节点和边所决定。基于此观点,GNNExplainer通过识别输入图中对预测结果起到关键作用的一个小子图以及最有影响力的一部分节点特征来为预测结果生成解释。具体而言,GNNExplainer通过最大化解释子图Gs与模型预测Y之间的互信息,以获取最符合模型预测的子图。GNNExplainer是一个模型无关的解释方法,从方法的输入上看,它只需要一个训练好的模型以及模型的输入图和要解释的对象。

maxGSMI(Y,(GS,XS))=H(Y)-H(Y|G=GS,X=XS)(5)

对于节点分类任务,GNNExplainer会提取目标节点的k阶邻域生成子图,然后通过不断优化掩码过滤掉对预测结果不重要的边和节点。这个过程可以视为对原始图数据的去噪。经过对以目标节点为中心的子图的去噪处理,即可以得到此次预测的解释子图。为了便于观察,本文选取top-10的掩码生成子图。有研究认为,GNN可以学习到输入图数据中的常见模式,因此本文希望提取出的解释子图可以反映这一点。

3 实验与评估

本文的实验主要分为两个部分:a)比较基于同质图转换的GNN知识图谱补全与其他直接在多关系图上进行KGC的模型之间的性能表现;b)对提取的解释子图进行分析。

3.1 实验设定

本文方法依赖PyTorch v1.0.0和PyTorch Geometric v1.5.0实现,并在一台配有Intel Xeon 2.30 GHz处理器,128 GB内存和NVIDIA v100 GPU的Ubuntu 20.04服务器上完成模型的训练和解释提取。

1)基线 将本文方法与R-GCN[11]、GraIL[14]以及INDIGO[21]三种直接在多关系图上进行知识图谱链接预测的方法进行比较。 R-GCN是一种典型的基于图卷积神经网络的关系型数据处理方法;本文使用了与GraIL相同的数据集,GraIL是一种基于子图推理的知识图谱补全模型;INDIGO是一种基于GNN的归纳式知识图谱补全模型;本文采用了动机不同但相似的知识图谱转换方式。

2)数据集 本文使用Teru等人[14]的数据集分割方案,将FB15K-237[22]、NELL-995[23]和WN18RR[24]分别拆分为四个版本,用v1、v2、v3和v4表示。其中每个版本的数据集K分为Ktrain和Ktest两个实体不相交的子集,且Ktrain中的关系包含Ktest中的全部关系。数据集的相关统计数据如表1、2所示,其中表1统计了各数据集中的三元组数量,表2则根据图的结构信息,如节点、关系和边的数量进行统计。

3)模型训练 本文将模型训练为一个降噪自编码器(denoising autoencoder,DAE)[19]。每个训练集以9:1的比例分为不完整的数据集 K′train和作为补全目标的候选三元组集KCtrain。本文将KCtrain的三元组作为训练的正例,通过负采样可以为每个正例最多获得9个负例。为了确保准确率和召回率的平衡,本文令正例和负例的数量相同。数据集处理完成后,本文设置损失函数为标准交叉熵损失函数,并使用Adam优化器将模型在每个数据集上训练3 000个epoch。

3.2 知识图谱补全实验与结果分析

为了证明本文方法在进行同质图转换后在推理任务的性能表现与不进行转换的模型性能相当,进行了如下性能测试。

3.2.1 实验指标设置

本文实验通过基于准确度的指标和基于排名的指标综合评估模型的性能。这些指标是根据模型在正例和负例集P和N上的结果计算得出的,如下所述。请注意,N*通常非常大,使用它的所有三元组并不可行,所以需要采样。为了减轻可能由采样引起的波动的影响,本文使用独立采样的负面示例集在给定的基准测试中评估每个系统超过10次的运行,并报告每个指标的平均值和方差。

为了确保系统无法通过在训练期间对负例采用特定的采样策略来获得优势[25],本文对P中的每个正例以等概率随机采样N*的一个元素来构造N。实验中,本文使用准确率、召回率和精度。除此之外,还使用 F1分数和精确召回曲线(PRC)的曲线下面积(AUC),它们通常根据不同阈值的精确度和召回率定义(使用基于置信度的预测计算)。

对于基于排名(rank)的指标,本文通过随机替换正例集中的三元组分量来构建负例集N,例如,对于(a,r,b)∈P,本文可以随机替换a,r,b。特别地,对于P中的每个正例(Ktest,(c,r,d)),集合Nc中包含50个随机采样的负例,形式为(Ktest,(c′,r,d));集合Nr和Nd类似地通过替换r和d并分别获取所有样本和50个样本来构造(请注意,Nr的候选数受Ktest中的关系数限制)。然后,在P和N上评估的KG补全系统的基于排名的指标计算如下。对于每个λ∈Λ+测试和x∈{c,r,d},令Rankx(c)为(Ktest,KCtest)在系统对P∪Nx中所有示例的置信度预测的降序列表中的位置。为了减轻随机采样对结果的影响,本文使用独立采样的负例在给定的基准测试中将每个系统运行10次,并取平均值和方差作为最终测试结果。

3.2.2 实验结果

表3展示了本文方法在三个数据集上的评估结果,其中R、G、I分别代表R-GCN、GraIL以及INDIGO。

可以看到,本文方法几乎在所有指标上的表现始终优于基线,并且大幅领先R-GCN和GraIL,对于INDIGO也在各项指标有超过2%的平均相对提升。除了性能的提升以外,本文方法在训练速度上也有明显提升。在本文的实验条件下,R-GCN训练花费1.2 h,GraIL训练花费4 h,INDIGO训练花费了0.45 h。本文方法训练花费了0.61 h,训练速度显著超过R-GCN和GraIL,但相对INDIGO较慢。这是因为根据本文方法所转换的新图相较INDIGO的方法规模更大,导致训练速度减慢。

3.3 解释提取实验与结果分析

相较于WN18RR以及NELL-995,FB15K-237数据集中的知识更加贴近常识,对解释子图的理解不需要专业背景知识,因此本文选择FB15K-237作为提取解释的实验数据集,并选择GNNExplainer作为解释生成器。

3.3.1 GNNExplainer设定

对于GNNExplainer的设置,本文采用Amara等人[18]提出的统一框架GraphFramEx进行描述。

a)explanation type。在GraphFramEx中,解释的类型可以分为model和phenomenon,其中phenomenon是指对模型的标签进行解释,即寻找能够令模型产生目标标签的解释子图。而model则是指对模型的一次预测进行解释。由于本文只关心正确的预测,所以采用phenomenon类型的解释。

b)node mask type和edge mask type。节点和边的掩模类型使用object,这种类型的粒度较粗,且对于预测任务而言,关注特征的某个分量并无必要,且较粗粒度的掩模形成的子图更便于观察解释结构特征。

c)threshold type。阈值的类型决定了解释子图的最终呈现。在本文中选择top-10进行展示。

基于以上的设定,本文为每个节点训练500个epoch后提取解释。

3.3.2 解释节点粒度及选择

为了研究所生成的解释子图之间的关联,本文选择那些具有相同关系特征并且尾实体相同的实体对进行解释。这样做的原因在于,将关系和尾实体固定下来以后即可专注于不同头实体条件下所生成的解释的特点。为了便于展示和理解,本文最终选择了较为常见的出生地(place of birth,)、居住地(place lived)以及專业(profession)三种关系进行说明。

表4为提取的一部分解释子图,其中a1、a2、a3表示三种不同的解释目标节点。由于模型的预测本质上依靠对数据集的统计规律的学习,所以一些示例在数据集中比较稀少,故解释效果不佳,如模型对于(A,place of birth,New York City)的解释子图连通性差,难以辨识。

通过对解释的观察发现,GNNExplainer在关系和尾实体固定的条件下生成的子图解释具有很高的相似性,它们反映了GNN在进行知识推理时遵循的模式。这种现象是合理的,比如当模型可以预测出三元组(a1,place lived,Syrause)和(a2,place lived,Syrause),即模型通过学习已经可以正确预测一个人是否居住在某地时,那么有理由认为模型在作出这两个相似的判断时采用的是同一套推理模式,因为模式是具有通用性的,而这种推理模式反映到不同预测的解释子图上就是它们具有相似甚至相同的结构。

4 结束语

本文针对当前的解释方法在基于GNN的KG链接预测任务上发展不成熟的问题,开展对现有解释方法的适应性研究,提出一种基于单关系图转换的子图解释生成模型。该模型通过单关系转换,将基于GNN的KG上链接预测任务转换成更容易解释的节点分类任务,解决了当前解释方法在多关系图下难以应用的问题。对于研究GNN在知识图谱链接预测中学习到的推理模式以及在实践中建立用户对链接预测结果的信任具有重要的意义和价值,实验结果表明:

a)基于单关系图转换的模型在分类性能的各项指标上有着比原生KG链接预测模型更好的表现,可以支撑对模型捕获模式的研究。

b)通过对所生成的子图解释进行分类研究发现,属于同一类的节点存在多种不同解释的现象,这种现象证明,基于GNN的KG链接预测模型根据目标节点邻域的特点学习到了不同的模式。

同時,本文在对子图解释的量化分析方面存在局限性,由于缺乏对子图解释有效量化评估的标准,所以对子图解释的评估主要依靠人工观察其合理性。后续可开展子图解释与逻辑规则的转换研究,将生成的子图解释更进一步转换为明确的逻辑规则,并从逻辑规则质量角度对捕获的子图进行量化评估,以解决对子图解释的量化分析,研究不足的问题。

参考文献:

[1]Ji Shaoxiong,Pan Shirui,Cambria E,et al.A survey on knowledge graphs:representation,acquisition and applications[J].IEEE Trans on Neural Networks and Learning Systems,2022,33(2):494-514.

[2]Cui Wanyun,Xiao Yanghua,Wang Haixun,et al.KBQA:learning question answering over QA corpora and knowledge bases[J].Proceedings of the VLDB Endowment,2017,10(5):565-576.

[3]Lan Yunshi,He Gaole,Jiang Jinhao,et al.A survey on complex knowledge base question answering:methods,challenges and solutions[C]//Proc of the 30th International Joint Conference on Artificial Intelligence.Montreal,Canada:International Joint Conferences on Artificial Intelligence Organization,2021:4483-4491.

[4]Wang Hongwei,Zhang Fuzheng,Zhao Miao,et al.Multi-task feature learning for knowledge graph enhanced recommendation[C]//Proc of World Wide Web Conference.New York:ACM Press,2019:2000-2010.

[5]程开原,姚俊萍,李晓军,等.时态网络中知识图谱推荐:关键技术与研究进展[J].中国电子科学研究院学报,2021,16(2):174-183,188.(Cheng Kaiyuan,Yao Junping,Li Xiaojun,et al.Recommendation based on knowledge graph in temporal networks:key technologies and progress[J].Journal of China Academy of Electronics and Information Technology,2021,16(2):174-183,188).

[6]Chen Yonghong,Li Hao,Li Han,et al.An overview of knowledge graph reasoning:key technologies and applications[J].Journal of Sensor and Actuator Networks,2022,11(4):78-94.

[7]Gilmer J,Schoenholz S S,Riley P F,et al.Neural message passing for Quantum chemistry[C]//Proc of the 34th International Conference on Machine Learning.[S.l.]:JMLR.org,2017:1263-1272.

[8]Shang Chao,Tang Yun,Huang Jing,et al.End-to-end structure-aware convolutional networks for knowledge base completion[C]//Proc of the 33rd AAAI Conference on Artificial Intelligence and the 31st Innovative Applications of Artificial Intelligence Conference and the 9th AAAI Symposium on Educational Advances in Artificial Intelligence.Palo Alto,CA:AAAI Press,2019:3060-3067.

[9]Li Juanhui.From uni-relational to multi-relational graph neural networks[C]//Proc of the 15th ACM International Conference on Web Search and Data Mining.New York:ACM Press,2022:1551-1552.

[10]Marcheggiani D,Titov I.Encoding sentences with graph convolutional networks for semantic role labeling[C]//Proc of Conference on Empirical Methods in Natural Language Processing.Stroudsburg,PA:Association for Computational Linguistics,2017:1506-1515.

[11]Schlichtkrull M,Kipf T N,Bloem P,et al.Modeling relational data with graph convolutional networks[C]//Proc of European Semantic Web Conference.Berlin:Springer,2018:593-607.

[12]Vashishth S,Sanyal S,Nitin V,et al.Composition-based multi-relational graph convolutional networks[C]//Proc of International Conference on Learning Representations.New York:ACM Press,2020:151-162.

[13]Nathani D,Chauhan J,Sharma C,et al.Learning attention-based embeddings for relation prediction in knowledge graphs[C]//Proc of the 57th Annual Meeting of the Association for Computational Linguistics.Stroudsburg,PA:Association for Computational Linguistics,2019:4710-4723.

[14]Teru K,Denis E,Hamilton W.Inductive relation prediction by subgraph reasoning[C]//Proc of the 37th International Conference on Machine Learning.[S.l.]:JMLR.org,2020:9448-9457.

[15]Zhang Yongqi,Yao Quanming.Knowledge graph reasoning with relational digraph[C]//Proc of ACM Web Conference .New York:ACM Press,2022:912-924.

[16]Ying R,Bourgeois D,You Jiaxuan,et al.GNNExplainer:generating explanations for graph neural networks[C]//Proc of the 33rd International Conference on Neural Information Processing Systems.Red Hook,NY:Curran Associates Inc.,2019:9244-9255.

[17]Luo Dongsheng,Cheng Wei,Xu Dongkuan,et al.Parameterized explainer for graph neural network[C]//Proc of the 34th International Conference on Neural Information Processing Systems.Red Hook,NY:Curran Associates Inc.,2020:19620-19631.

[18]Amara K,Ying Zhitao,Zhang Zitao,et al.GraphFramEx:towards systematic evaluation of explainability methods for graph neural networks[C]//Proc of the 1st Learning on Graphs Conference.[S.l.]:JMLR.org,2022:2045-2053.

[19]Vincent P,Larochelle H,Lajoie I,et al.Stacked denoising autoenco-ders:learning useful representations in a deep network with a local denoising criterion[J].Journal of Machine Learning Research,2010,11(1):3371-3408.

[20]Yuan Hao,Yu Haiyang,Gui Shurui,et al.Explainability in graph neural networks:a taxonomic survey[J].IEEE Trans on Pattern Analysis and Machine Intelligence,2022,32(7):1-19.

[21]Liu Shuwen,Grau B,Horrocks I,et al.INDIGO:GNN-based inductive knowledge graph completion using pair-wise encoding[C]//Advances in Neural Information Processing Systems.Red Hook,NY:Curran Associates Inc.,2021:2034-2045.

[22]Bordes A,Usunier N,Garcia-Duran A,et al.Translating embeddings for modeling multi-relational data[C]//Proc of the 26th International Conference on Neural Information Processing Systems.Red Hook,NY:Curran Associates Inc.,2013:2787-2795.

[23]Xiong Wenhan,Hoang T,Wang W Y.DeepPath:a reinforcement learning method for knowledge graph reasoning[C]//Proc of Confe-rence on Empirical Methods in Natural Language Processing.Stroudsburg,PA:Association for Computational Linguistics,2017:564-573.

[24]Dettmers T,Minervini P,Stenetorp P,et al.Convolutional 2D know-ledge graph embeddings[C]//Proc of the 32nd AAAI Conference on Artificial Intelligence and the 30th Innovative Applications of Artificial Intelligence Conference and the 8th AAAI Symposium on Educational Advances in Artificial Intelligence.Palo Alto,CA:AAAI Press,2018:1811-1818.

[25]Pezeshkpour P,Tian Yifan,Singh S.Revisiting evaluation of knowledge base completion models[C]//Proc of Automated Knowledge Base Construction.Red Hook,NY:Curran Associates Inc.,2020:23-34.