智能电视中的人机交互技术

潘 榕,谢于迪

(国家广播电视产品质量监督检验中心,北京 100015)

智能电视的概念随着技术发展在不断发生变化,从模拟电视到数字电视的变革,从单纯的电视功能芯片向多核心多功能的系统级SoC芯片的演进,从简单的上网到OTT业务的广泛开展,从操纵遥控器到使用各种先进的人机交互技术,每一次都在为智能电视的概念增添新的内容。因此,对智能电视的定义是相对和动态的,在智能电视的每一个发展阶段都不尽相同。

在现阶段,智能电视可定义为:除具备传统电视功能之外,拥有以高性能处理芯片为核心的硬件平台、独立的操作系统平台、丰富的应用软件和内容平台,具备先进的人机交互功能,支持互联网接入,可由用户主动获取互联网内容,下载、安装和卸载各类应用软件,也可自动提示或下载系统和应用更新,持续对功能进行扩展和升级,从而满足用户多样化和个性化需求的电视产品。

智能电视的核心要素是“智能”。“云电视”曾经被视为智能电视更先进的形态,但云电视的落脚点在“云”,即利用云计算技术,将电视与网络更加密切地结合起来,拓展了智能电视的网络功能,也使智能电视的自我进化成为可能。智能电视除具备“云”的功能外,还必须具备其他能体现其智能化水平的功能。其中,人机交互技术是非常重要的方面,它是智能电视发展的技术瓶颈,在一定程度上决定了未来智能电视的技术水平。目前,在智能电视中应用的人机交互技术主要有新型遥控、体感技术、语音识别和多屏互动等四种。

1 新型遥控

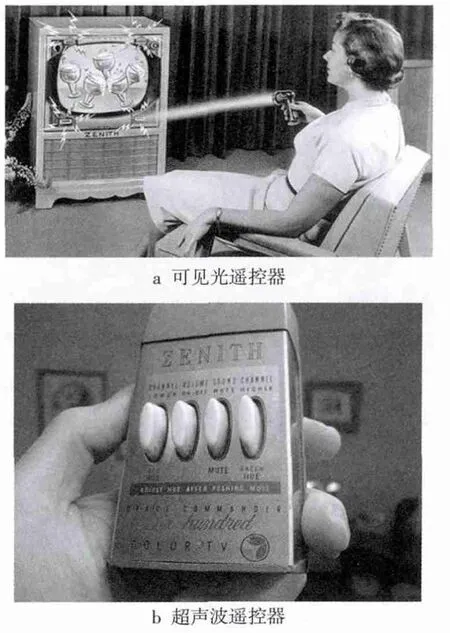

自20世纪30年代电视诞生以来,在较长的一段时间内,操作电视的主要方法是手动调节电视机上的机械旋钮和按键。1950年,美国天顶电子开发了一款有线遥控器,开启了电视遥控的时代。随后,该公司相继开发了基于可见光和超声波的无线遥控器(见图1),但由于其局限性,没有得到广泛应用。1980年,加拿大人保罗·哈里夫纳克研发了第一款红外线遥控器,迅速成为了主流的电视遥控方式。但智能电视的界面元素和功能更加丰富,应用和内容的表现方式更加多元,传统的遥控器已不敷使用。因此,需要用一种新的理念来设计智能电视遥控器,从而满足智能电视操控的需要。目前遥控器向简约化和多功能化两个方向发展。

图1 可见光和超声波遥控器

1.1 简约遥控器

简约遥控器运用了人机工程学设计原理,综合考虑人的思维习惯、手部生理特征、操控力度、电视功能等多种因素,对遥控器的尺寸、界面布局、使用方式(按键或滚轮)以及与电视信息的关联等方面进行优化,实现用户在遥控器上的盲操作。实例产品如图2所示。

图2 简约遥控器(左:苹果;右:小米)

简约遥控器一般会有主页键、菜单键、移动键、选择键等按键,而摒弃数字键等普通遥控器上必备的按键。这类遥控器适用于操纵智能电视界面,选择应用程序,实现收看流媒体视频等功能,而不适用于收看广播电视节目。在国内绝大部分用户使用机顶盒收看电视节目的情况下,简约遥控器已经足够用于操作智能电视,收看电视节目功能自有机顶盒遥控器来完成。

1.2 多功能遥控器

智能电视遥控器的另一个发展方向是集多种功能于一身,包括传统操控、空间操控、语音操控和触摸操控。传统操控即普通遥控器的功能。空间操控指可以在空间中自由控制遥控器,实现遥控光标自由移动的方式,也称为“空鼠”,一般装备陀螺仪和加速度传感器,根据人的手部动作,做到倾斜和上下旋转,倾斜和左右旋转,围着主轴旋转,上下加速度,左右加速度,朝向屏幕加速和远离屏幕加速等操控动作,移动光标只是它最基本的功能,其主要作用是供人们在体育和休闲游戏中体验到更多的沉浸式感受,达到娱乐和健身的目的。语音遥控是将语音键设置在遥控器上,用户可以通过遥控器这一信息转换装置,将语音信息传送给电视,从而实现对应功能。触摸操控指在遥控器上有一块触摸屏,用户通过触摸可以控制电视屏幕上光标的移动以及功能选择(类似于笔记本计算机上的触摸板),目前也有少量的自带触摸功能的电视,但该类电视主要用于教学、信息查询等场合。

多功能遥控器实例产品如图3所示。

图3 多功能遥控器(左:LG;右:三星)

此外,空间遥控、语音遥控和触摸遥控由于所需传送的信息量大,无法采用传统遥控器的红外通信模式,而需采用2.4G或5G国际开放频段的无线传输模块(如蓝牙、WiFi等),它不但具备电压低、效率高、成本低、可进行双向高速数据传输的特点,还可实现快速跳频,前向纠错及进行校验等功能,完全能满足上述遥控传输信息的需要。即使只具备简单的按键(譬如传统遥控器和简约遥控器),普通的红外技术完全能实现信息的传输,现在也有该类遥控器采用蓝牙等传输协议,其目的是为了克服红外信号直线传输的缺陷,达到遥控信息的无死角覆盖。

2 体感技术

人们在人际交往中,多达93%的信息是通过非语言方式传递,其中又以肢体语言为主。因此动作识别是人机交互的一种重要形式,能识别动作的技术一般称为人体动作感应技术,简称为体感技术,使人们可以不必借助复杂的设备,就能很直接地使用肢体动作,身临其境地与内容做互动。在电视中体感技术主要用于菜单控制和游戏控制,菜单控制一般使用手势识别技术,这是动作识别中较简单和典型的一种方式,游戏控制则较为复杂,一般使用肢体识别技术。体感技术主要使用光学感测的原理,利用摄像头通过光学传感器主要获取以2D平面为主的人体影像,再将此人体影像所表达的肢体动作与内容进行互动,此外,红外和声波等感应技术也可用于体感识别中。根据识别的不同目标,除手势识别和肢体识别外,体感识别技术还有面部识别和眼动追踪等。

2.1 手势识别

从手势识别的角度考虑可以把手势定义为[1]:人手或者手和臂结合所产生的各种姿势和动作,它包括静态手势(指姿态,单个手形)和动态手势(指动作,由一系列姿态组成)。静态手势对应模型参数空间里的一个点,而动态手势对应着模型参数空间里的一条轨迹,需要使用随时间变化的空间特征来表述。手势识别原理虽然简单,但在实现时由于背景的多样性和环境因素的不可预见性、人手运动的灵活性和不同个体的差异性、从立体空间到平面空间的投影信息处理的复杂性等众多原因,在具体实现时还是有一定难度。

目前在手势识别方面还没有专门的标准予以规范,因此各个企业开发的手势识别技术各不相同,相同的含义有多种手势予以规定,从而使得消费者面对不同的采用手势识别技术的产品时需要重新学习,非常繁琐。

企业自设定手势如图4所示。

图4 企业自设定手势(Engram Tech.)

2.2 肢体识别

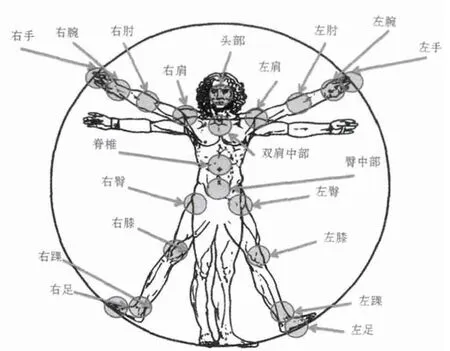

肢体识别不仅要识别人手的动作,还要识别人全身的运动,涉及到的关键技术是骨骼追踪,建立人的骨骼模型。通过摄像头拍摄到实时图像后,将图像信息和三维空间数据整合,使用者图像的每个像素都被传送进一个辨别人体部位及其学习系统中。随后该系统将给出某个特定像素属于哪个身体部位的可能性,将所有的这些可能性输入到接下来的处理流程中并且等到最后阶段进行判断。通过所有数据的全面对比计算,最后可以描绘出骨骼模型,从而对使用者的肢体动作进行跟踪。以目前典型的微软kinect技术为例[2],如图5所示,它可以主动追踪最多两名使用者的全身骨架。

2.3 面部识别

面部识别在电视中主要用于电视及其应用的加密、性别和年龄的识别等,如电视QQ有“刷脸”登录功能,如图6所示。面部识别也需要使用视频拍摄设备得到人脸面部图像,然后再送给机器自动识别。主要有基于几何特征、基于统计和基于连接机制等面部识别方法。目前,面部识别技术面临的困难主要有[3]:1)面部结构相似。不同个体之间的面部及其器官结构相似,有利于面部检测和定位,但不利于识别个体;2)面部外形不稳定。首先是人的面部会有各种丰富的表情,其次面部外形会受头发、胡须等因素的影响;3)面部特征受环境干扰。不同的光照条件(光强、光源方向)、观察距离和角度,会使面部明暗程度不均匀,影响识别效果。

图5 kinect骨骼模型

图6 电视QQ“刷脸”登录

2.4 眼动追踪

眼动追踪是指通过测量眼睛注视点的位置或者眼球相对头部的运动而实现对眼球运动的追踪[4],如图7所示。目前在电视中主要的方式是通过视频拍摄设备来获取眼睛的位置,根据眼睛注视点的不同位置,从而判断用户预想的不同行为,譬如换台、调节音量等。海尔的眼球控制电视技术就是眼动追踪技术的具体应用。眼动追踪技术主要包括两部分:瞳孔定位技术和视线估计技术。眼动追踪技术目前需要克服的难点是:1)眼动数据提取。人的头部和身体的运动,会导致场景不停改变,为数据提取带来困难,用户的自由移动受到限制。2)眼动数据解释。眼球存在固有的颤动和眨眼,导致从眼动数据中提取有用信息较为困难,数据解释和分析的精度也会下降。3)用户意图识别。用户移动视线不代表就要发出一条指令,需要区分用户无意和有意的视线移动。

3 语音识别

语音识别是指用户通过语音对话的形式,将指令发送给智能电视,令其完成某项工作。语音识别涉及到语义分析和语音识别技术,是一种让机器通过识别和理解过程把语音信号转变为相应的文本或命令的技术。

图7 眼动追踪技术应用品牌(海尔)

语音识别方法主要是模式匹配法,其关键是语音大数据库的应用。在训练阶段,用户将词汇表中的每一词依次说一遍,并且将其特征矢量作为模板存入模板库,经过大量收集统计,形成大数据库。在识别阶段,将输入语音的特征矢量依次与数据库中的每个模板进行相似度比较,将相似度最高者作为识别结果输出。

目前,语音识别技术还不是很成熟,它需要解决的问题有:1)对自然语言的识别和理解。首先必须将连续的讲话分解为词、音素等单位,其次要建立一个理解语义的规则。2)语音信息量大。语音模式不仅对不同的说话人不同,对同一说话人也是不同的,例如,一个说话人在随意说话和认真说话时的语音信息是不同的。一个人的说话方式会随着时间变化。3)语音的模糊性。说话者在讲话时,不同的词可能听起来是相似的。这在英语和汉语中常见。4)单个字母或词、字的语音特性受上下文的影响,以致改变了重音、音调、音量和发音速度等。5)环境噪声和干扰对语音识别有严重影响,致使识别率低。

目前,在语音识别中,国内各个电视整机企业基本采用讯飞的技术,整机企业本身没有研发语音识别技术。因为语音识别技术是大数据时代的典型技术,需要在数据库中进行大量比较、判定,才能达到较高的识别率,因此对语音识别技术的研究,是一项复杂的科学研究工作,整机企业花费大量人力物力,对语音识别技术进行开发,既不经济,也无必要。除讯飞外,国内还有一些具备自主语音识别技术,包括中科模识科技、捷通华声、云知声等。

4 多屏互动

多屏互动是指在不同的操作系统,以及不同的终端设备之间可以相互兼容跨越操作,通过无线网络连接的方式,实现数字多媒体内容的传输,可以同步不同屏幕的显示内容,可以通过智能终端实现控制设备等一系列操作。多媒体内容传输的功能也称为无线传屏。能实现多屏互动的技术协议主要有:

1)DLNA。由索尼、英特尔、微软等发起成立,旨在解决包括个人PC、消费电器、移动设备在内的无线网络和有线网络的互联互通。

2)Miracast。WiFi Alliance于2012年9月19日宣布启动的WiFi CERTIFIED Miracast认证项目。Miracast设备提供简化发现和设置,用户可以迅速在设备间传输视频。

3)WiDi。全称为 Intel WirelessDisplay,无线高清技术,它是通过WiFi信号来实现计算机和显示设备的无线连接。在英特尔发布Capella移动平台之后,WiDi技术已经能够运用在相关产品之中。

4)AirPlay。由美国苹果公司推出的无线技术。

5)闪联。联想、TCL、康佳、海信、长城联合发起的协议标准,支持各种3C设备智能互联、资源共享和协同服务,实现“3C设备+网络运营+内容/服务”的全新网络架构。

但目前这些协议之间本身无法兼容互通,各家公司必须通过自己的技术来兼容众多不同协议,才能真正实现跨系统平台操作的多屏互动。因此,在多屏互动技术方面,还需要整合各个标准,使得多屏互动应用具备更好的通用性。

5 发展趋势

操作系统、应用软件、视频资源汇聚和点播、网络冲浪等智能电视的各个方面的技术,都在可预见的未来能达到非常成熟的程度。而人机交互,却是智能电视发展中的难点,也是重点。目前不成熟的人机交互技术在电视中的广泛使用,反而降低了用户对智能电视的接受程度。因此,文中的各项人机交互技术的未来发展趋势,就是要解决目前存在的问题。其中,用语言与电视进行沟通是最自然、最便捷的一种交互方式,随着大数据技术的广泛应用,语音识别技术将快速发展。另外,可穿戴式设备(如健康医疗类的穿戴式设备)、家用智能电器等设备通过人的设定和操作与电视之间进行互动,也是智能电视人机交互技术的重要发展趋势。

[1] 孙丽娟,张立材,郭彩龙.基于视觉的手势识别技术[J].计算机技术与发展,2008,18(10):214-216.

[2] 李兆堃.基于Kinect体感技术的人机交互环境[J].数字技术与应用,2013(9):65-66.

[3] 郝立涛.基于特征脸的面部识别技术研究[D].石家庄:河北科技大学,2010.

[4] 刘涛.眼动跟踪技术的研究及优化实现[D].西安:西安电子科技大学,2011.