汽车类外观专利图像三维重建

张 丹,吕学强,李 卓,徐丽萍

(1.北京信息科技大学 网络文化与数字传播北京市重点实验室,北京100101;2.北京城市系统工程研究中心,北京100089)

0 引 言

以图像形式存在的外观设计专利在给设计者带来权益保护的同时,也给外观设计专利的申请及检索带来了挑战。通过三维重建,根据得到的三维模型进行三维检索是改善外观设计专利图像检索的重要方式。汽车外观设计是吸引消费者购车的重要因素,是汽车企业的一项核心竞争力[1]。随着侵权行为的不断出现,汽车外观设计的保护越来越受到重视。目前外观专利产品中立体产品约占75%[2],而常用的外观专利审查方式是基于内容的图像检索技术,其主要面向对象是平面图像。由于用二维平面图像表示立体产品容易丢失物体的三维信息且观察不够直观,未来的外观设计专利将以数字三维图像为标准,因此对汽车类外观专利图像进行三维重建,不仅是通过三维模型检索技术对汽车外观设计维权的基本前提,而且符合未来外观设计专利领域的发展趋势。汽车类外观专利图像如图1所示。

从图1可以看出汽车类外观专利图像有如下特点:

图1 外观设计专利图像实例

(1)基本由六视图 (主视图、后视图、左视图、右视图、俯视图、立体图)构成,任意两视图间视角比较大,公共区域比较小;

(2)具有对称性,如主视图与后视图为对称图像;

(3)图像纹理信息较弱;

(4)各视图的轮廓线间存在一定的对应关系,即不同视图中某一区域的变化趋势相同;

(5)图像具有历史性,图像的质量与拍摄年代、相机参数等有很大关系;

(6)汽车两侧的车轮相互独立。

基于此类图像序列的三维重建方法主要是基于图像序列,包括特征点检测与匹配、相机标定等过程,该方法所针对的对象要求相邻图像间公共区域比较大,特征点比较明显[3]。因此针对汽车类外观专利图像序列的特点,采用轮廓线连接的方法将多视图信息进行融合,从而恢复物体的三维模型。

基于轮廓线的三维重建方法是根据切片序列的轮廓线进行面片重构[4],实现整个物体的三维表面重建。经过学者的不断研究,该方法已经在许多领域进行了应用,如医学、地质等领域[5]。对于密集轮廓线序列,该方法能够较好恢复物体各面的凹凸性,不会丢失太多细节信息,而对于外观专利图像,用于进行连接的轮廓线只有2条,容易丢失各面的凹凸性,使得到的三维模型真实感比较差。

为弥补轮廓线法在外观专利图像三维重建上的缺陷,恢复各面的深度信息,需利用基于单幅图像的三维重建技术。从明暗恢复形状 (shape from shading,SFS)在单幅图像的三维重建领域应用比较广泛。

SFS方法的基本思想是根据图像的灰度信息获得物体的高度信息。国内外许多学者对SFS方法进行了研究,最初的SFS技术由MIT 的Horn提出,为了得到较好的结果,其要求[6]:①摄像机的投影方式为正交投影;②光源为无限远处的点光源或者均匀照射的平行光;③物体表面为朗伯体表面,即理想漫反射表面。这些假设在实际应用中很难满足,为了克服传统SFS方法所做的假设,Kumar等[7]针对非朗伯体的三维重建提出了基于张样量条的框架用于人脸图像分析及表面恢复,Ahmed和Farag用Ward反射模型描述了混合表面的SFS问题[8]。

针对光源方向及反射模型的参数估计方面,许多学者研究如何从单幅图像中估计光源方向及反射模型的参数[9,10];马银平[11]提出了基于变化反照率值的灰度图像重建算法,消除了传统SFS算法假设物体表面仅有单一反照率值带来的影响;何炳蔚等[12]通过融合SFS技术与主动视觉技术进行三维重建,能够提高重建精度,但是需要借助单目线激光扫描仪。虽然SFS方法得到了很大改善,但是目前该方法依然局限于单幅图像的三维重建,而不能恢复整个物体的三维模型,需要与其它技术相结合提高重建精度[13]。受图像亮度信息的影响,光源照射到的局部得到的表面高度较高,与物体的实际高度分布不一致,因此单纯依靠灰度图像中的亮度恢复表面高度会对重建模型的精度产生不利影响。

本文根据汽车类外观专利图像的特点及SFS方法、轮廓线法的缺陷,提出了改进的SFS方法与轮廓线法融合的汽车类外观专利图像三维重建。该方法采用传统的SFS方法进行单幅图像的深度恢复,并结合主视图及右视图、左视图的轮廓信息对得到的单幅图像模型进行深度信息校正;根据汽车类外观专利图像的特征,采用曲线拟合的方式获取主视图与后视图轮廓线之间的距离信息,同时结合主视图及右视图提取车轮部分位置信息与厚度信息,以生成三维空间点;采用经纬线法轮廓线连接方式构造四角面片,获得全景模型,并通过融合各视图在独立模型中的位置,实现汽车类外观专利图像的三维重建。

1 结合多幅图像的单幅图像SFS模型校正

由于不同区域深度变化趋势不同,而由SFS得到的模型整体轮廓信息与实际信息不符,因此为了实现对SFS模型中不同区域的曲线约束,需要对主视图按照深度变化程度进行区域分割,得到深度变化比较明显的阶段。

采用标注主视图轮廓线中分段关键点的方式进行区域分割,并根据汽车车身中的不同部分具有不同深度变化趋势的特点,将汽车的主轮廓线近似为分段曲线;根据其轮廓形状,对由SFS方法得到的表面深度,结合轮廓线变化信息进行优化,使重建模型更逼真、直观。

1.1 分段关键点的获取

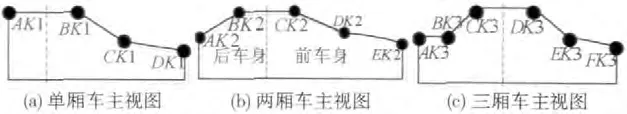

根据汽车的车身结构可将常规汽车分为单厢车、两厢车和三厢车三类。根据每一类车型各自的特点,将汽车车身进行分段,通过人工标注获取分段关键点。

单厢车、两厢车、三厢车主视图中分段关键点在车身中的位置如图2所示。

图2 各类车主视图分段关键点

将整体车身分为前车身与后车身,图2 各主视图中,虚线右侧部分为前车身,左侧部分为后车身,主视图中位于前车身与后车身的分段关键点分别对应右视图与左视图中相应位置的分段关键点。可以将三厢车的左、右视图各分为三部分,两厢车左、右视图分别分为两部分和三部分,单厢车左、右视图分别分为一部分、三部分。以三车厢为例,前车身的分界关键点位置可定义为车顶部分、车后视镜处、前车灯处。

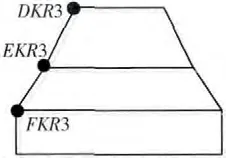

对于右视图,将其对应相应主视图,标注其关键点,其中右视图中关键点对应位于主视图前车身部分的关键点,左视图关键点对应位于主视图后车身部分的关键点。以三车厢右视图为例,其关键点标注如图3所示。

图3 三厢车对应的右视图分段关键点标注

图3中点DKR3、EKR3、FKR3分别对应图2 (c)中DK3、EK3、FK3。通过人工标注,获取每个关键点的坐标信息,记录相邻关键点之间车身部分在整个车身中所占的比例关系。车身中分段关键点集合为InfPSet ={InfP1(x1,y1),InfP2(x2,y2),…,InfPn(xn,yn)}, 其中InfPi(xi,yi)为分段关键点,n 为车身中标注的关键点数目。前车身与后车身的分段关键点集合分别为InfPFSet ={InfP1(x1,y1),InfP2(x2,y2),…,InfPnf(xnf,ynf)},nf <n(nf 为前车身分段关键点数目),InfPBSet ={InfPnf+1(xnf+1,ynf+1),InfPnf+2(xnf+2,ynf+2),…,InfPn(xn,yn)}。

1.2 尺寸信息校正

为避免某一视图模型中背景信息对其他视图模型产生遮挡,采用基于背景去除的SFS方法[9]获取物体的相对深度信息,根据汽车主视图及右视图关键点之间的比例关系,将由SFS得到的表面深度信息映射到轮廓线模型。

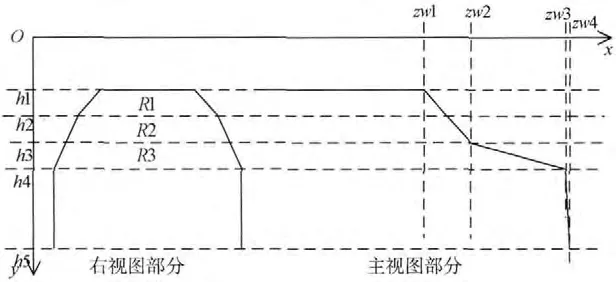

右视图与主视图对应部分如图4所示。

图4 右视图与主视图对应部分

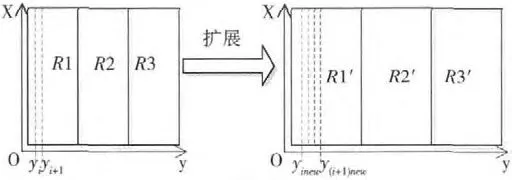

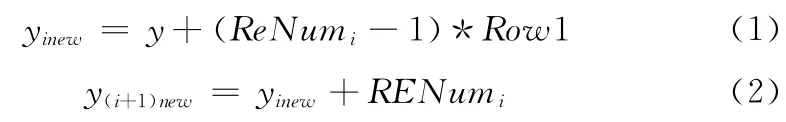

图4中右视图部分中直线y=h1与y=h2、y=h2与y =h4、y=h4与y=h5之间的部分分别对应主视图部分直线x=zw1与x=zw2、x=zw2与x=zw3、x=zw3与x =zw4之间的部分;右视图中两直线间的距离信息应该对应主视图中相应部分的宽度信息,从图中可以看出,两视图中对应部分的尺寸信息并不一致,这将导致右视图模型与轮廓线模型融合时,存在衔接不当的问题,因此需要对右视图模型按照主视图轮廓线相应部分进行尺寸扩展。右视图模型尺寸扩展如图5所示。

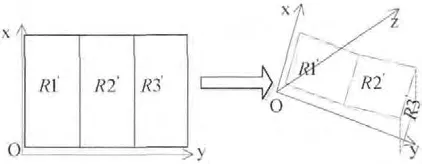

图5 右视图模型尺寸扩展

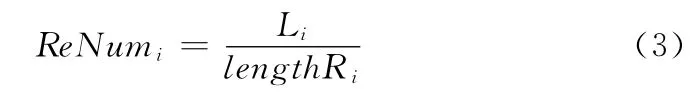

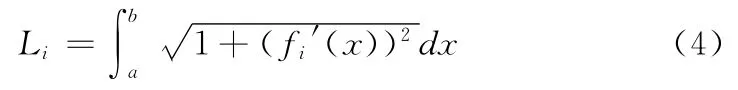

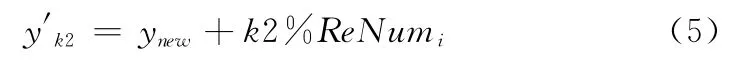

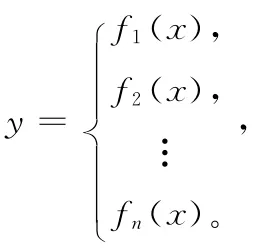

如图5 所示,区域R1′、R2′、R3′ 分别由区域R1、R2、R3各自扩展获得,为了达到尺寸扩展的目的,需要在原有模型的基础上新增行,并且保证新增行与原有模型信息的连贯性。本文采用线性插值的方式在相邻两行之间插入新增行信息,因此右视图模型中各点y 坐标需进行变换,计算公式为

式中:Row1——需要进行重复的行数,ReNumi——yi与yi+1之间需要插入的行数,其计算公式为

式中:Li——相邻 2 个关键点 InfPi(xi,yi) 及InfPi+1(xi+1,yi+1)之间的曲线长度,lengthRi——右视 图中相应部分的长度,Li可利用曲线积分的方式计算

式中:fi(x)∈CL,a,b——主视图中该曲线两端点的x 坐标值,即a=xi,b=xi+1。

yi与yi+1之间新插入的行数其深度信息与yi行一致,其y 坐标为

式中,0≤k2≤ReNumi且k2为整数。左视图的尺寸可根据主视图后车身中关键点间距离进行扩展,其扩展方式与右视图类似。

1.3 斜率优化

将右视图根据主视图尺寸进行扩展后,得到与主视图相应位置尺寸一致的单幅图像模型,由于图像亮度对SFS方法得到的模型效果具有决定性的影响作用,因此,物体的材质、光源、摄像机等的影响,将导致由SFS得到的模型整体高度信息与实际物体不一致,只能得到局部相对高度,并不能得到其准确的深度信息。因此,通过结合右视图及主视图轮廓线变化趋势,获取右视图的深度信息。右视图模型斜率变换如图6所示。

图6 右视图斜率校正

通过SFS得到的模型能够恢复物体的深度信息,但是对于深度变化较快的区域,获得的深度信息与实际深度信息差异较大,其整体走势仍然是趋于平面。根据人工标注得到的分界点及主视图轮廓线的变化趋势,获取图像的深度信息。其变化趋势与主视图中相应分段关键点之间的曲线CL 一致。

2 融合SFS与轮廓线法的三维重建

对于由改进的SFS得到的单幅图像三维模型,各个面都是孤立的,而不是完整的模型,为了获得完整模型需要将各视图进行拼接融合。在融合过程中需要对各视图的相对位置进行调整,本文根据由轮廓线法获得的全景三维模型对由SFS方法得到的单面三维模型进行位置约束。通过调整SFS模型的位置信息,使其起始点与轮廓线模型相应位置的起始点位置一致,从而使得融合后的模型既保留了物体的细节信息,又能进行全景观察。

2.1 轮廓线法汽车类外观专利图像三维重建

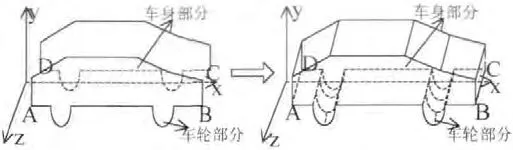

根据汽车类外观专利图像主视图与后视图对称的特点,采用轮廓线连接法[11]构建物体的整体模型。将各视图进行边缘检测得到图像的轮廓线,主视图与后视图轮廓线为用于连接的相邻轮廓线,根据俯视图获取主视图与后视图轮廓线间的距离信息,结合右视图及汽车的特点提取车轮部分的厚度信息及位置信息,进行连接时对车身部分及车轮部分采用不同的连接方式。模型连接如图7所示。

图7 轮廓线连接

图7中,平面ABCD 为车身部分与车轮部分的分界面,在连接轮廓线构造四角面片时,对于车身部分,进行主视图与后视图轮廓线之间的连接,即将两轮廓线上相应的点进行连接;而对于车轮部分,实际汽车模型中,两侧的车轮并没有连接在一起,因此需要根据车轮的厚度信息,结合主视图与后视图轮廓线上车轮部分的轮廓点添加相应的车轮轮廓点,然后对每组车轮轮廓线进行组内连接,得到整体三维模型。

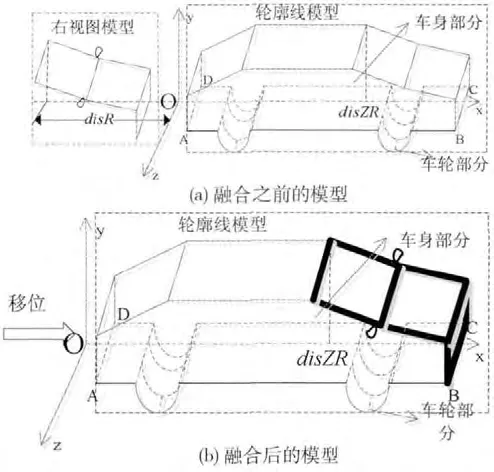

2.2 右视图模型坐标系的转换

为简化模型融合时的移位方式,需将右视图模型坐标系变换为与轮廓线模型坐标系一致。即将SFS的深度方向设为x 轴,原图像的y 轴对应新的y 轴,原图像的x 轴对应新的z 轴。由SFS得到的各视图的模型及由轮廓线法得到的模型在三维坐标系中的初始位置及融合之后的模型分别如图8 (a)、(b)所示。

图8 右视图SFS模型及轮廓线模型融合

2.3 模型融合

根据SFS方法及轮廓线法得到的三维模型,采用位置对齐及深度信息叠加的方法进行两模型之间的融合。

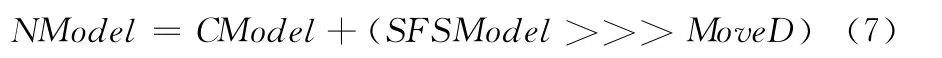

定义由改进的SFS方法得到的模型为SFSModel,由轮廓线法得到的模型为CModel,则新模型NModel按下式计算得到

式中:+——2种模型之间的融合,>>>——向右移位运算,MoveD ——移位距离,且有

式中:disR ——右视图模型最左侧边界到平面yOz 的距离,如图8 (a)所示,且其外轮廓尺寸、斜率信息与轮廓线模型相应位置一致,disZR 为轮廓线全景模型中右视图对应部分即车前身中首个关键点的x 坐标值。

按照式 (7)、式 (8)进行计算,将SFSModel 移位到与CModel 中相应位置重合,得到融合之后的模型如图8 (b)所示。

3 实验结果及分析

本文对34组数据分别采用SFS方法、轮廓线法及SFS与轮廓线法融合的方法进行三维重建实验。实验数据来自专利信息服务平台 (http://search.cnipr.com/),主要汽车类别分布为9组单厢车、17组两厢车、8 组三厢车。本文从实验效果图及融合改善率2个方面评价实验结果,其中融合改善率的定义如下:

定义 融合改善率IMR 是指将SFS模型及轮廓线模型进行融合得到的重建效果优于单独采用2种方法进行重建的效果的组数NumIM占总实验数据量NumT的百分比。即

3.1 改进的SFS单幅图像重建实验结果

采用传统的SFS算法与本文改进的SFS进行单幅图像重建得到的实验效果如图9所示。

图9 2种方法得到的单幅图像重建效果

图9中可以看出,传统的基于SFS方法的三维重建对图像亮度比较敏感,图像中的亮度信息受2个因素的影响:一是图像颜色本身的亮度,二是光照的影响。对于同一位置,如果其颜色不同,得到的表面高度也不相同;当局部区域颜色、材质相同,且受到的光照相同时,其恢复得到的表面高度相同,没有深度信息的区分;本文方法不仅考虑到了图像的颜色、光照等对亮度的影响,同时还结合了图像各视图的轮廓信息。物体在不同角度的图像轮廓能够反映物体在某一角度的深度信息,能够较好的得到其深度信息。

3.2 融合SFS与轮廓线法的实验结果及分析

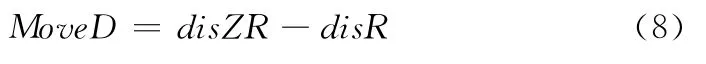

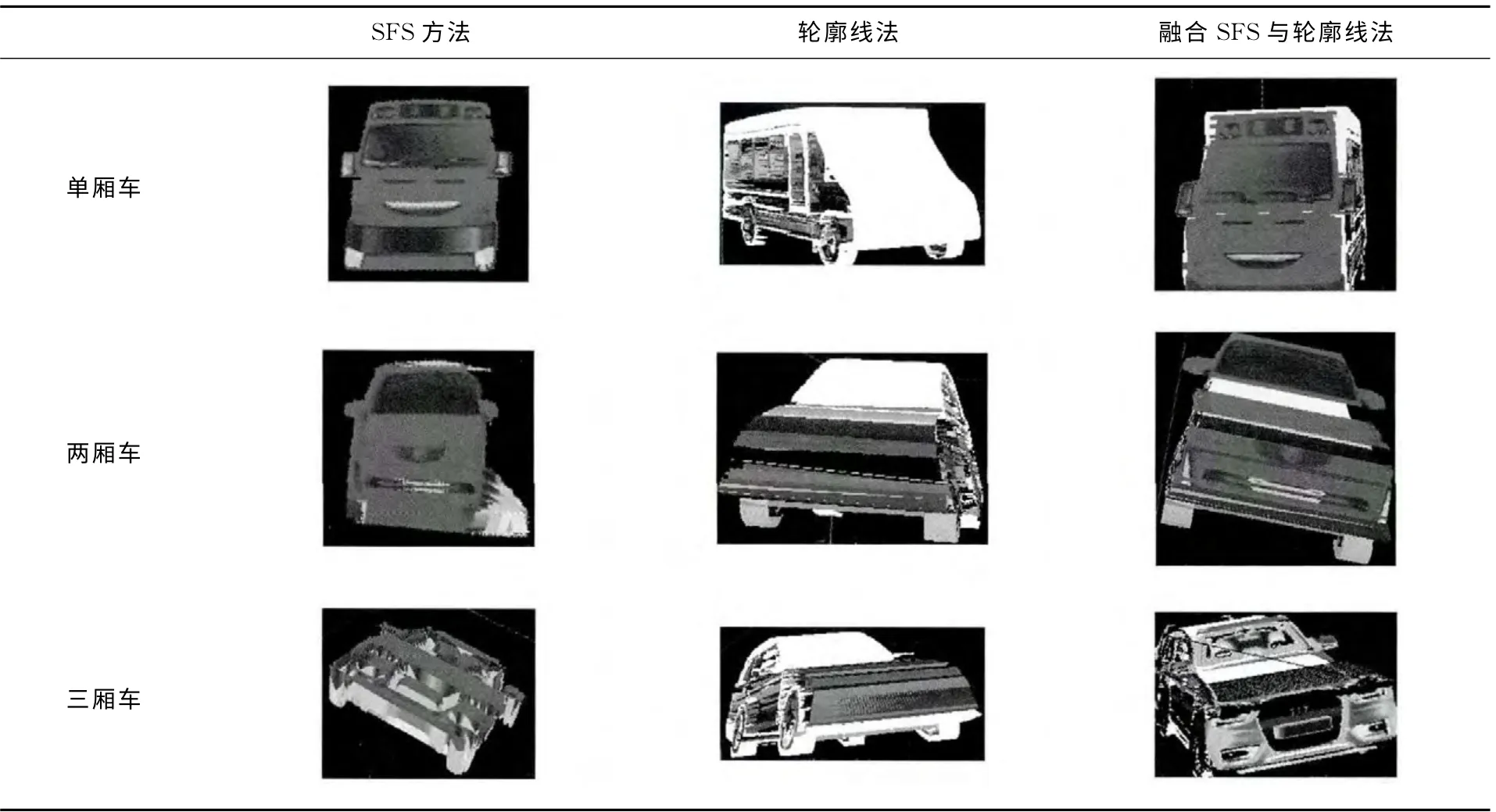

从34组实验数据中每个类别随机抽取一组进行效果图对比分析,对比结果见表1。

表1 实验效果图对比

从表1中可以看出,采用单一的SFS方法进行三维重建,能获得各面的表面相对高度信息,恢复单面的三维模型,但是不能将各面进行联系,因此不能得到组合的三维模型,并且当材质及光照相同时,恢复得到的表面高度信息一致,丢失了其本身的深度信息;轮廓线法得到的模型为全景模型,但是丢失了各面的凹凸性信息;采用本文方法进行SFS模型与轮廓线模型的融合得到的三维模型不仅得到了物体的全景模型,还保留了各面的细节信息,使重建模型更具真实感、立体感。

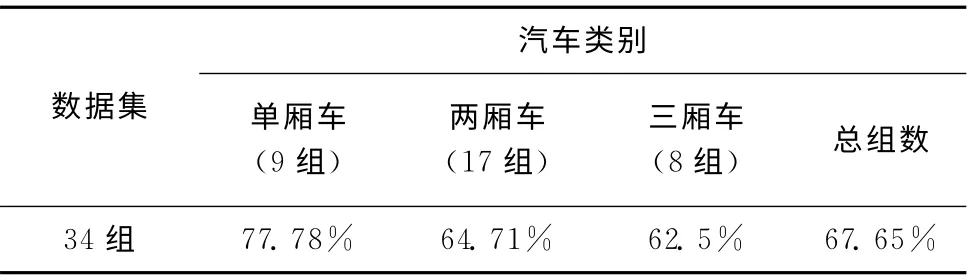

34组数据重建效果的统计数据见表2。

表2 采用融合方法改善率统计

从表2可以看出,采用2种方法融合进行三维重建能够对重建效果起到一定改善作用,结合实验数据分析发现,效果改善较大的专利图像满足如下规则:

规则1:根据三视图理论,以主视图尺寸为参照标准,将其他视图参照主视图尺寸进行归一化后,右视图目标区域后视镜对应的宽度与俯视图最大边界宽度误差不超过5%。

不符合规则1的专利图像右视图如图10所示。

图10 不合符规则1的右视图

对图10所示专利图像采用融合方法进行实验发现融合之后SFS模型的边界在轮廓线模型边界之外。通过分析发现融合失败的原因主要有以下2个方面:一是虽然结合了主视图与右视图及左视图的轮廓线信息,但图像获取时相机参数、相机位置及相机与物体之间角度的影响,导致得到的图像中各部分的相对关系与实际物体中相应部分的对应关系不一致,从而使得到的深度信息存在一定差异,如在二维右视图中车前身部分的宽度宽于后视镜部分,这种现象在实际汽车产品中几乎是不存在的;二是获取主视图与后视图距离信息时采用的是曲线拟合的方式,得到的是距离的近似值,因此在融合时导致两模型不能完全衔接。

对34组数据中符合规则1的25组数据进行统计得到融合改善率见表3。

表3 按规则1分类统计融合改善率

4 结束语

SFS方法与轮廓线法各自的局限性导致采用单一方法进行三维重建得到的三维模型存在不足之处,一是不能恢复完整的物体模型,二是容易丢失各面的凹凸性信息。本文通过分析2种方法的缺陷,结合汽车类外观专利图像的特点,提出了融合SFS与轮廓线法的汽车类外观专利图像三维重建方法。该方法根据主视图的轮廓线及与右视图的对应关系,获取右视图局部信息的深度;根据2种方法得到的模型间的位置差距,然后进行位置对齐,将2种方法得到的模型融合在一起。实验结果表明,该方法不仅能够恢复物体的全景模型,还能保留物体各面的细节信息,对单一方法的三维重建起到一定的改进作用。但是在重建精度及光滑度方面有待提高,下一步将利用摄像机标定方法解决摄像机多焦距、多参数问题,对重建模型进行校正。

[1]CHU Xiaolin.The protection of industrial designs of automobile[D].Wuhan:Huazhong University of Science and Technology,2012 (in Chinese). [初晓琳.汽车的外观设计保护[D].武汉:华中科技大学,2012.]

[2]SHI Shuicai,CHENG Tao.Image retrieval technology in design patents examination of appearance design [J].Journal of Beijing Information Science and Technology University,2011,26 (2):1-5 (in Chinese).[施水才,程涛.外观设计专利审查中的图像检索关键技术 [J].北京信息科技大学学报,2011,26 (2):1-5.]

[3]TONG Shuai,XU Xiaogang,YI Chengtao,et al.Overview on vision-based 3Dreconstruction[J].Application Research of Computers,2011,28 (7):2411-2417 (in Chinese). [佟帅,徐晓刚,易成涛,等.基于视觉的三维重建技术综述 [J].计算机应用研究,2011,28 (7):2411-2417.]

[4]SHU Bo,QIU Xianjie,WANG Zhaoqi.Survey of shape from image[J].Journal of Computer Research and Development,2010,47 (3):549-560 (in Chinese). [束搏,邱显杰,王兆其.基于图像的几何建模技术综述 [J].计算机研究与发展,2010,47 (3):549-560.]

[5]ZHENG Liping,LI Guangyao,JIANG Hua.Contour connecting method based on interzone line[J].Journal of Computer Applications,2011,31 (10):2708-2710 (in Chinese).[郑丽萍,李光耀,姜华.轮廓线的经纬线连接法 [J].计算机应用,2011,31 (10):2708-2710.]

[6]LI Jialu,SONG Aiguo,WU Juan,et al.Research on the method of haptic texture display based on SFS [J].Chinese Journal of Scientific Instrument,2010,31 (4):812-817 (in Chinese).[李佳璐,宋爱国,吴涓,等.基于SFS技术的纹理力触觉再现方法研究 [J].仪器仪表学报,2010,31 (4):812-817.]

[7]Kumar R,Barmpoutis A,Banerjee A,et al.Non-lambertian reflectance modeling and shape recovery of faces using tensor splines[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2011,33 (3):533-567.

[8]Ahmed A,Farag A.Shape from shading for hybrid surfaces[C]//IEEE International Conference on Image Processing.IEEE,2007:525-528.

[9]ZHU Li,ZHU Chunqiang.Research on point light source illumination parameters algorithms [J].Computer Simulation,2012,29 (12):317-320 (in Chinese).[朱莉,朱春强.点光源照明参数估计的算法研究 [J].计算机仿真,2012,29(12):317-320.]

[10]Dosselmann R,Yang XD.Improved method of finding the illuminant direction of a sphere[J].Journal of Electronic Imaging,2013,22 (1):013035.

[11]MA Yinping.Study of algorithm of 3Dreconstruction from single image based on variable albedo [D].Nanchang:Nanchang University of Aeronautics,2008 (in Chinese). [马银平.基于变化反照率值的单幅图像三维重建算法研究 [D].南昌:南昌航空大学,2008.]

[12]HE Bingwei,CHEN Zhipeng,LIN Dongyi,et al.Research on reconstruction method for unknown objects through incor-porating SFS algorithm and active vision technology [J].Chinese Journal of Scientific Instrument,2012,33 (4):727-736(in Chinese).[何炳蔚,陈志鹏,林东艺,等.融合SFS和主动视觉技术的未知物体重建方法 [J].仪器仪表学报,2012,33 (4):727-736.]

[13]WANG Guohui,WANG Jian,SUN Shuai.Research on development status and trend of SFS-based 3D reconstruction technique[J].Optical Instruments,2011,33 (4):90-94(in Chinese).[王国珲,王建,孙帅.SFS三维重构技术的发展现状与趋势研究 [J].光学仪器,2011,33(4):90-94.]