随机森林和支持向量机算法在β-发夹模体预测中的比较

贾少春

(忻州师范学院数学系,山西忻州 034000)

随机森林和支持向量机算法在β-发夹模体预测中的比较

贾少春

(忻州师范学院数学系,山西忻州 034000)

基于对β-发夹模体的预测探索,本文使用随机森林和支持向量机两种算法,对ArchDB40数据库及自建数据集中的β-发夹模体进行预测.对于同一数据集,在特征参数和检验方法均相同的情况下,随机森林算法的预测精度要高于支持向量机算法.此外,由于随机森林算法在参数维数较高的情况下不会发生过拟合现象,所以本文采用了将高维特征参数输入随机森林算法的方法来预测β-发夹,得到了较好的预测效果:对ArchDB40数据库中的β-发夹进行预测,其5-交叉检验的预测精度和相关系数分别是83.3%和0.59;对自建数据集中的β-发夹进行预测,其5-交叉检验的预测精度和相关系数分别是85.2%和0.62.

随机森林算法;支持向量机算法;β-发夹模体;离散增量;预测的二级结构信息

β-发夹是一种特殊的超二级结构模体.对于β-β超二级结构,如果两个反平行的β-strand被连接多肽(loop)连接,而且两个strand之间存在一个或多个氢键,则称这种超二级结构为β-发夹,否则称为非β-发夹[1-3].前人在β-发夹模体识别的研究过程中,使用不同的算法对不同数据库中的研究对象进行了预测,已经取得了一系列较好的研究成果.2002年,Cruz等[4]使用人工神经网络(ANN),对序列相似性小于35%的534个蛋白质中的β-发夹进行识别,5-fold交叉检验的预测精度是47.7%.2004年Kuhn[1]等使用ANN方法预测局域发夹和非局域diverging turn,对2 209个蛋白质中的β-发夹预测精度是75.9%.2005年,Kumar等[5]使用两种机器记忆技术——支持向量机和ANN模型,对EVA的序列相似性小于33%的2 880个非冗余蛋白质中β-发夹进行识别,5-fold交叉检验的预测精度为79.2%.2007年,胡秀珍等[6]使用支持向量机,对ArchDB40和EVA数据库中的β-发夹模体进行识别,5-fold交叉检验预测精度分别是79.9%和83.3%.2008年,胡秀珍等[7]使用二次判别方法,对ArchDB40和EVA数据库中β-发夹进行识别,5-fold交叉检验的预测精度分别达到了83.1%和80.7%.本文是对该研究的进一步探索,具体采用的是随机森林和支持向量机两种分类算法,选用的数据集一个是前人使用过的ArchDB40数据集,一个是新整理的包含4 070个非冗余蛋白质链的数据集,对这两个数据集中的β-发夹进行预测,随机森林算法的效果均好于支持向量机算法的.

1 数据及方法

1.1 数据集

1.1.1 ArchDB40数据集

ArchDB40数据库[8-9]是本文选用的第一个数据集.具体的研究对象是loop长为2-8个氨基酸残基的模体.固定序列模式长选为12,截取规则有5位点法、8位点法和中心位点法[6],分别用5-12、8-12 和Lr-12来表示,具体示例见图1.

图1 固定模式的三种截取方式

1.1.2 自建数据集

本文选用的第二个数据集是笔者自己构建的数据库,即一个序列相似性小于25%、分辨率高于3Å的包含4 070条蛋白质链的数据库.下面是整理数据库的具体过程:

第一步:从SCOP数据库的ASTRAL(1.75版)中下载序列相似性低于95%的序列;

第二步:使用Blast软件获得序列相似性低于25%的序列4 174条(仅包含全β、α / β和α + β类的蛋白质序列),并从中筛选出分辨率高于3Å的序列4 070条;

第三步:使用DSSP[10]找出ECE模式16 917个;

第四步:使用PROMOTIF软件[11]得到9 046个β-发夹模体,与ECE模式匹配的笔者认为是β-发夹,共8 800个,剩余的8 117个为非β-发夹模体;

第五步:对得到的模体进行统计分析,发现loop长为2 - 10个氨基酸残基的β-发夹模体和非β-发夹模体分别有8 291和6 865个,各占了此类模体总数的94%和85%,故选取loop长为2 -10个氨基酸残基的模体作为具体研究对象;

第六步:计算上述数据集中β-发夹模体和非β-发夹模体的平均长度,分别是16.58和15.65,故选取固定序列模式长为17,截取规则为中心位点法.

1.2 特征参数

1.2.1 位点分析

使用weblogo网页(http://weblogo.berkeley.edu/logo.cgi)对ArchDB40数据集中β-发夹和非β-发夹模体的固定序列片段(12个位点)分别进行统计分析,结果见图2.

图2 β-发夹和非β-发夹固定序列片段的位点氨基酸保守信息 (ArchDB40数据集)

再用weblogo网页(http://weblogo.berkeley.edu/logo.cgi)对自建数据集中β-发夹和非β-发夹模体的固定序列片段(17个位点)分别进行统计分析,结果见图3.

图3 β-发夹和非β-发夹固定序列片段的位点氨基酸保守信息 (自建数据集)

1.2.2 参数选取

通过位点分析发现,ArchDB40数据库和自建数据集中的固定序列片段的位点保守性都较强,故提取了以下几项作为特征参数.

1)位点氨基酸组分A 对ArchDB40数据集而言,由于固定序列模式长是12且采用了三种固定序列片段截取方式,所以每个固定序列片段的位点氨基酸组分[12-13]是一个756维(21 × 12 × 3,这里21表示20种氨基酸和1个空位)的向量;对自建数据集而言,由于固定序列模式长是17且仅采用了中心位点法一种截取方式,所以每个固定序列片段的位点氨基酸组分是一个357维(21 × 17)的向量.

2)位点亲疏水组分Q 同理,对ArchDB40数据集而言,其位点亲疏水组分[14]是一个252维(7 × 12 × 3,这里7表示6种亲疏水特性和1个空位)的向量;对自建数据集而言,位点亲疏水组分是一个119维(7 × 17)的向量.

3)基于位点氨基酸组分的离散增量值ID(A) 以位点氨基酸组分作为ID的输入参数,用训练集中的β-发夹序列片段和非β-发夹序列片段作标准离散源,进而计算出检验集中每条序列的2个离散增量值[15-18].对ArchDB40数据集而言,由于采用了三种截取方式,所以每条被检片段可得6个离散增量值ID(A);对自建数据集而言,由于只有一种截取方式,所以每条被检片段可得2个离散增量值ID(A).

4)基于位点亲疏水组分的离散增量值ID(Q) 类似地,以位点亲疏水组分作为ID的输入参数,对ArchDB40数据集而言,每条被检片段可计算得6个离散增量值ID(Q);对自建数据集而言,每条被检片段可计算得2个离散增量值ID(Q).

5)基于位点氨基酸组分的打分函数值S(A) 以位点氨基酸组分作为打分函数S的输入参数,利用训练集中的β-发夹和非β-发夹构造标准打分矩阵,进而计算出检验集中每条序列的2个打分值[19-22].对ArchDB40数据集而言,由于采用了三种截取方式,所以每条被检片段可得6个打分值S12(A);对自建数据集而言,因只有一种截取方式,所以每条被检片段可得2个打分值S17(A).

6)预测的二级结构信息PSS 预测的二级结构信息由PSIPRED[5]得到,并用一个3维的向量来表示,其中的3个分量分别表示对β-发夹和非β-发夹模体序列片段进行预测得到的α螺旋、β折叠和无规卷曲coil的频数.

1.3 算法简介

1.3.1 随机森林算法(RF)

随机森林是Leo Breiman于2001年提出的一种新型机器学习算法[23-27],其思想是将众多弱分类器集成为一个强分类器进行分类.随机森林由很多互不关联的决策树组成,输入样本时森林中的每一棵决策树各自进行判断,最终的决策结果则由综合全部决策树的分类结果而定.本文的随机森林算法是通过R软件[28-30]来实现的,使用的是R2.8.1版本(http://www.r-project.org/).

1.3.2 支持向量机算法(SVM)

支持向量机(SVM)算法是由Vapnik[31]等提出来的一种新型的机器学习方法,其基本思想是通过非线性变换把输入向量映射到一个高维特征空间,再在高维特征空间构造线性判别函数,进而寻找最优超平面,使其与各类样本之间的距离达到最大.

本文支持向量机(SVM)算法是通过调用libsvm-2.89程序包[32]来实现的(http://www.csie. ntu.edu.tw/~cjlin/libsvm).

1.4 检验方法和评价指标

1.4.1 检验方法

做模体预测常用的检验方法有自洽检验、独立检验、k-fold交叉检验和Jack-knife检验.本文采用的是5-fold交叉检验[6-7],即将数据集平均分成5份,其中4份作为训练集,剩余的1份作为检验集,重复做5次独立检验后求其平均的检验方法.

1.4.2 评价指标

本文使用的评价指标[6-7]有:Qo(H)、Qo(NH)、Qp(H)、Qp(NH)、Acc和MCC,具体计算公式如下:

其中,p为β-发夹被正确识别的数量,r为非β-发夹被正确识别的数量,u为β-发夹被预测为非β-发夹的数量,o为非β-发夹被预测为β-发夹的数量.

2 结果与分析

2.1 对ArchDB40数据集的预测结果

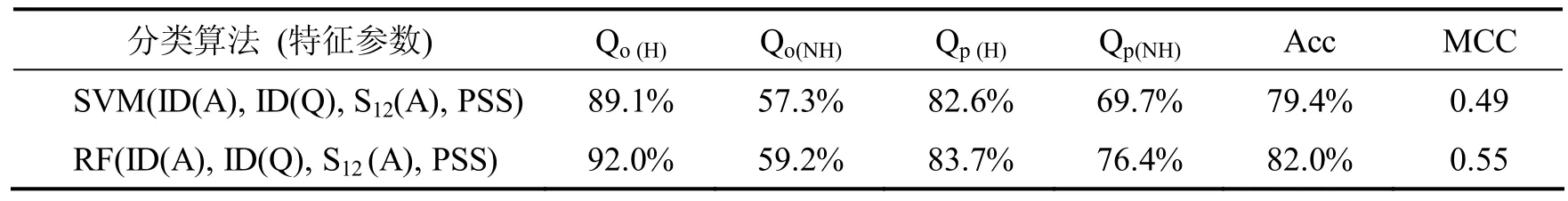

对ArchDB40数据库中的β-发夹模体,用基于位点氨基酸组分得到的6个离散增量值ID(A)、基于位点亲疏水组分得到的6个离散增量值ID(Q)、基于位点氨基酸组分得到的6个打分函数值S12(A)和3维预测的二级结构信息PSS的组合向量作为特征参数(ID(A) + ID(Q) + S12(A) + PSS),采用支持向量机(SVM)算法进行预测,其5-fold交叉检验的Acc和MCC的值分别为79.4%和0.49.采用随机森林(RF)算法对该数据库中的β-发夹模体进行预测,实施5-fold交叉检验,Acc和MCC的值均得到了提高,分别达到82.0%和0.55,具体结果见表1.

2.2 对自建数据集的预测结果

对于自建数据集中的β-发夹模体,我们也提取了ID(A) + ID(Q) + S17(A) + PSS作为特征参数进行预测,其支持向量机(SVM)算法结合5-fold交叉检验的结果是:Acc和MCC的值分别为80.2%和0.51.采用随机森林(RF)算法对该数据库中的β-发夹模体进行预测,实施5-fold交叉检验,其结果也有所提高,Acc和MCC的值分别达到83.5%和0.59,具体结果见表2.

表1 对ArchDB40数据库中β-发夹预测的结果比较

表2 对自建数据库中β-发夹预测结果的比较

2.3 基于高维特征参数的随机森林算法的预测结果

考虑到随机森林算法所具有的特殊性能,我们也直接使用位点氨基酸组分(A)、位点亲疏水组分(Q)和预测的二级结构(PSS)的组合向量(A + Q + PSS)作为输入参数进行识别.需要指出的是对ArchDB40数据库中的β-发夹来说,这里的位点氨基酸组分(A)和位点亲疏水组分(Q)仅建立在前两种截取方式(5-12和8-12)之上,故A + Q + PSS参数共675(21 × 12 × 2 + 7 × 12 × 2 + 3)维,将其输入RF算法做5-fold交叉检验,其Acc和MCC的值分别是83.3%和0.59.对自建数据集中的β-发夹来说,由于每个片段只有一种截取方式,故A + Q + PSS参数共479维(21 × 17 + 7 × 17 + 3),将其输入RF算法做5-交叉检验,其预测精度和相关系数分别是85.2%和0.62,详细结果见表3.

3 结 论

本文对β-发夹模体的预测探索有以下几点创新:1)整理了一个新的β-发夹数据集,这不仅丰富了β-发夹的模体数,而且使得β-发夹模体包含的信息更加全面;2)对比了随机森林(RF)和支持向量机(SVM)两种算法的分类效果,结果显示RF算法要好于SVM算法;3)选取了高维特征参数(A + Q + PSS)输入RF算法进行预测,其结果得到进一步改善.

[1] Kuhn M, Meiler J, Baker D. Strand-loop-strand motifs: Prediction of hairpins and diverging turns in proteins [J]. Proteins: Structure, Function, and Bioinformatics, 2004, 54(2): 282-288.

[2] Wintjens R T, Rooman M J, Wodak S J. Automatic classification and analysis of alpha-alpha-turn motifs in proteins[J]. Journal of Molecular Biology, 1996, 255(1): 235-253.

[3] Jones D T. Protein secondary structure prediction based on position-specific scoring matrices [J]. Journal of Molecular Biology, 1999, 292(2): 195-202.

[4] Cruz X, Hutchinson E G, Shepherd A. Toward predicting protein topology: an approach to identifying β hairpins [J]. Proceedings of the National Academy Sciences of the USA, 2002, 99(17): 11157-11162.

[5] Kumar M, Bhasin M, Natt N K, et al. BhairPred: prediction of β-hairpins in a protein from multiple alignment information using ANN and SVM techniques [J]. Nucleic Acids Research, 2005, 33: 154-159.

[6] Hu X Z, Li Q Z. Prediction of the β-hairpins in proteins using support vector machine [J].Protein Journal, 2008, 27(2):115-122.

[7] Hu X Z, Li Q Z, Wang C L. Recognition of β-hairpin motifs in proteins by using the composite vector [J]. Amino Acids, 2010, 38(3): 915-921.

[8] Oliva A, Bates P A, Querol E, et al. An automated classification of the structure of protein loops [J]. Journal of Molecular Biology, 1997, 266(4): 814-830.

[9] Espadaler J, Fuentes N F, Hermoso A, et al. ArchDB: automated protein loop classification as a tool for structural genomics [J]. Nucleic Acids Research, 2004(32): 185-188.

[10] Kabsch W, Sander C. Dictionary of protein secondary structure: Pattern recognition of hydrogen-bonded and geometrical features [J]. Biopolymers, 1983, 22(12): 2577-2637.

[11] Hutchinson E G, Thornton J M. PROMOTIF-A program to identify and analyze structural motifs in proteins [J]. Protein Science, 1996, 5(2): 212-220.

[12] Panek J, Eidhammer I, Aasland R. A new method for identification of protein (sub) families in a set of proteins based on hydropathy distribution in proteins [J]. Proteins: Structure, Function, Bioinformatics, 2005, 58(4): 923-934.

[13] 高苏娟, 胡秀珍. 蛋白质中四类简单超二级结构的分类[J]. 内蒙古工业大学学报, 2013, 32(1): 21-26.

[14] 贾少春, 胡秀珍. 基于添加功能位点信息的组合向量预测β-发夹模体[J]. 内蒙古工业大学学报, 2012, 31(3):1-9.

[15] Laxton R R. The measure of diversity [J]. Journal of Theoretical Biology, 1978, 71(1): 51-67.

[16] Zhang L R, Luo L F. Splice site prediction with quadratic discriminate analysis using diversity measure [J]. Nucleic Acids Research, 2003, 31(21): 6214-6220.

[17] Chen Y L, Li Q Z. Prediction of the subcellular location of apoptosis proteins [J]. Journal of Theoretical Biology,2007, 245(4): 775-783.

[18] 宋航宇, 胡秀珍, 冯振兴, 等. 基于统计特征的酶蛋白质中特殊模体βαβ的预测[J]. 生物物理学报, 2013,29(9): 658-668.

[19] Kel A E, Gobling E, Reuter I, et al. MATCHTM: a tool for searching transcription factor binding sites in DNA sequences [J]. Nucleic Acids Research, 2003, 31(13): 3576-3579.

[20] 杨科利, 李前忠, 林昊. 预测酵母(Yeast)基因转录因子结合位点[J]. 内蒙古大学学报(自然科学版), 2006,37(5): 524-530.

[21] Cartharius K, Frech K, Grote K, et al. MatInspector and beyond: promoter analysis based on transcription factor binding sites [J]. Bioinformatics, 2005, 21(13): 2933-2942.

[22] 宋航宇, 胡秀珍. 基于矩阵打分值和化学位移值预测酶蛋白质中β-发夹模体[J]. 内蒙古工业大学学报, 2014,33(3): 175-180.

[23] Breiman L. Random forests [J]. Machine Learning, 2001, 45(1): 5-32.

[24] Okun O, Priisalu H. Random forest for gene expression based cancer classification: Overlooked issues [J]. PatternRecognition and Image Analysis, 2007, 4478(partⅡ): 483-490.

[25] 袁敏, 胡秀珍. 随机森林方法预测膜蛋白类型[J]. 生物物理学报, 2009, 25(5): 349-355.

[26] 王丽爱, 马昌, 周旭东, 等. 基于随机森林回归算法的小麦叶片SPAD值遥感估算[J]. 农业机械学报, 2015,46(1): 259-265.

[27] 林劼, 林舒晔. 基于随机森林算法的葡萄酒品质预测方法[J]. 莆田学院学报, 2012, 19(5): 88-92.

[28] Liaw A, Wiener M. Classification and regression by random forest [J]. R News, 2002, 2(3): 18-22.

[29] 张超, 孙凤, 曾宪涛. R软件调用JAGS软件实现网状Meta分析[J]. 中国循证医学杂志, 2014, 14(2): 241-248.

[30] 张超, 耿培亮, 郭毅, 等. 应用R语言netmeta程序包实现网状Meta分析[J]. 中国循证医学杂志, 2014, 14(5):625-630.

[31] Vapnik V. An overview of statistical learning theory [J]. IEEE Transactions on Neural Networks, 1999, 10(5):988-999.

[32] Chang C C, Lin C J. LIBSVM: a library for support vector machines [J]. ACM Transactions on Intelligent Systems and Technology, 2011, 2(3): 389-396.

Comparison between Random Forest and Support Vector Machine Algorithm for Prediction of β-hairpin Motif

JIA Shaochun

(Department of Mathematics, Xinzhou Teachers College, Xinzhou, China 034000)

Based on the prediction exploration of β-hairpin motifs in proteins, the random forest and support vector machine algorithm is applied in this paper to predict β-hairpin motifs in ArchDB40 (Specific database name) and the self-built dataset. For the same dataset, when using the same characteristic parameters and the same test method, Random Forest algorithm is more accurate than Support Vector Machine. In addition,Random Forest algorithm never results in the overfitting phenomenon under the higher dimension of characteristic parameters, so the Random Forest based on higher dimension characteristic parameters is applied to predict β-hairpin motifs. The better prediction results are obtained: 1. Prediction of β-hairpin motifs in ArchDB40 dataset, the overall accuracy and Matthew’s correlation coefficient of 5-fold cross-validation achieve 83.3% and 0.59 respectively; 2. Prediction of β-hairpin motifs in the self-built dataset, the overall accuracy and Matthew’s correlation coefficient of 5-fold cross-validation achieve 85.2% and 0.62,respectively.

Random Forest Algorithm; Support Vector Machine(SVM) Algorithm; β-hairpin Motif;Increment of Diversity; Predicted Secondary Structure Information

TP181

A

1674-3563(2016)03-0026-08

10.3875/j.issn.1674-3563.2016.03.005 本文的PDF文件可以从xuebao.wzu.edu.cn获得

(编辑:王一芳)

2016-03-15

贾少春(1984- ),女,山西原平人,助教,硕士,研究方向:算法和模体预测