基于贝叶斯框架的显著物体检测*

黄炜亮 段先华

(江苏科技大学 镇江 212003)

1 引言

显著物体检测旨在能够完整检测出可能由几个不同性质的区域共同构成的显著物体,完整的显著物体检测结果为后期的目标识别、跟踪等任务提供了重要的先验信息,特别是许多实际场景的应用[2~3]。显著物体检测已经在越来越多的实际环境或复杂场景的数据集中得到了成功的应用,提高了图像识别理解等计算机视觉工作计算的准确率。

传统的视觉显著性将研究重点放在符合视觉原理的数学模型的建立与理论的优化上,然而研究工作大多没有和实际场景下的具体应用结合起来[1],这些数学模型在具体场景应用中很难发挥出显著性的优势。如Itti[4]等较早提出基于中心-周围环绕对比度的显著性模型,其主要包括特征提取、最终显著图合成、视觉注意焦点选择和转移三个阶段,最终提取出分辨率较低的显著性边缘等信息。Harel[17]等通过归一化 Itti等的特征图,突出了图像的显著区域,并且计算所得的显著图可与其它显著图像进行融合。Achanta[10]等提出一种基于频率调协的算法,以此获取多尺度的显著性区域检测结果。Hou[21]等提出一种基于频域普残差的显著性计算模型,计算效率较高。以上两种算法均通过在频域中计算频谱差异作为该位置的显著性度量,速度虽然较快,然而计算过程无法用生物视觉原理解释,且检测精度较低。Bruce等认为人们倾向于注意哪些场景中具有较高不可预测性的区域,而这种不可预测恰恰可以用该区域相对于场景整体的自信息(self-information)来度量,即显著性正比于自信息,由此而提出了视觉注意的信息最大化模型。与Bruce的工作不同,Zhang[25]等认为信号的显著性可以由其自身的不可预测性(自底向上)和其对目标的预测能力(自顶向下)来共同衡量,并可以由贝叶斯推理计算得出。Lu[19]等综合考虑图像低层信息(像素点)和中层信息(超像素),通过凸包粗糙检测以及贝叶斯融合得到了检测精度较高的显著图。

综上所述,传统的显著性模型大多重视局部显著性的计算,以像素点为基本计算单元,检测出显著物体边缘或角点等区域[1,19]。另一方面,传统显著性数学模型的表示方式过于单一,通过传统的特征融合原理(Feature Integration Theory,FIT)综合显著性特征图,很难完整地表述复杂的视觉场景处理过程中许多重要信息。因此,传统视觉显著性方法更多的注重理论研究,很难将视觉场景中目标物体完整检测出来,无法应用于实际应用场景中。

为解决以上问题,本文提出一种基于贝叶斯框架的显著物体检测算法,通过引入图像中层超像素信息,使得算法不仅仅是检测显著物体的边缘和角点等信息,而是以显著物体整体为目标从图像中完整分割出来。同时通过似物性模型计算显著物体出现的大致区域,作为位置信息。最终通过贝叶斯框架[25]融合自底向上的显著性、位置信息和自顶向下的显著性,计算得到最终的显著物体。

2 基于贝叶斯框架的显著物体检测

2.1 超像素级显著性方法

显著性计算底层依赖于不同特征之间的比较,也即对比度法则[1,4]。各特征之间的对比度值是反应局部区域和周围环境差异的关键因素,对比度大则能够引起人们注意。这种对比度差异可以是颜色特征之间的、纹理特征之间的或者是形状等特征之间的,对比区域可以是局部的也可以是全局的,局部对比度往往更关心中心与周围区域的差异程度,差别越大则说明该位置对人眼的刺激程度越大。而全局对比度则计算的是中心区域与整个场景的差别程度。对比度差异可以在空间域中计算,也可以在频域中计算,如Hou[21]等通过频域中频谱差异计算不同区域的显著程度。

本文通过计算像素点之间的颜色对比度得到像素级显著性信息,由于CIELab空间更符合人眼视觉机制,因此将原图像从RGB空间转换到CIELab空间,计算每个像素点xi的全局对比度值,,N为图像中像素总数:

将计算出的像素级显著性值进行Min-Max标准化处理,得到归一化后的像素级显著性。由于单个像素点无法保存过多的关于视觉场景内目标物体本身的重要信息,而过分割后的图像中超像素能完整地保留了前景目标物体边缘结构化等信息,因此本文对过分割后的超像素内所有像素点的显著值累加取均值,作为该超像素的显著值:

由于超像素具有空间一致性、紧致性等特性,本文基于相邻超像素之间的紧致性与颜色关系,通过拉格朗日函数优化超像素级显著性:

图1 超像素级显著图

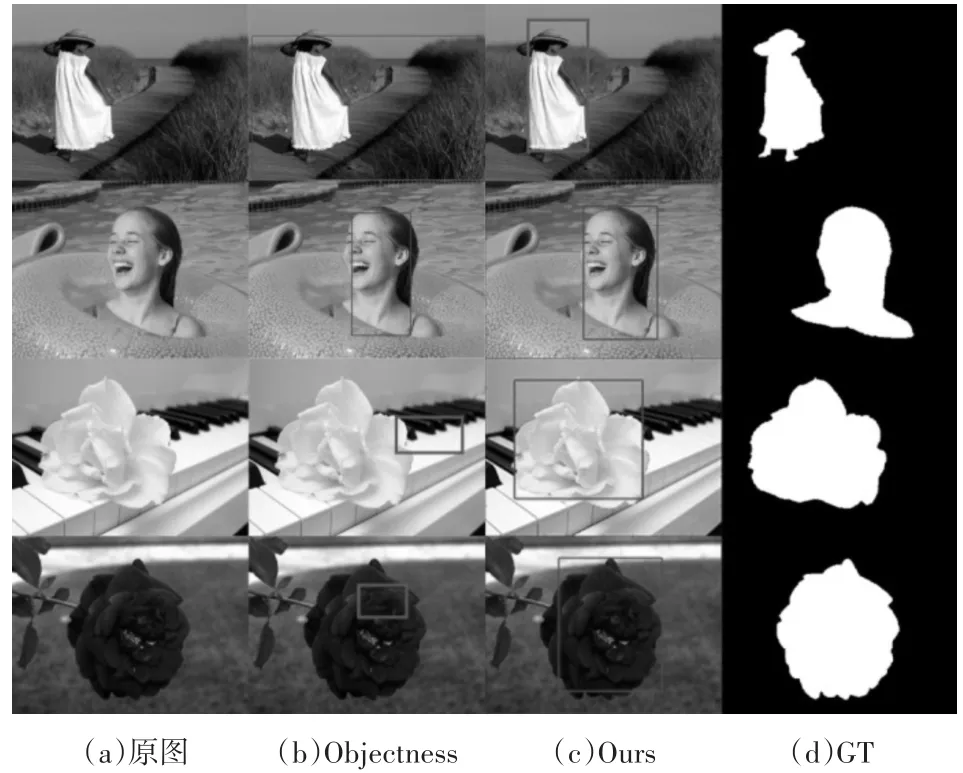

2.2 似物性位置信息计算

传统的目标检测常使用滑动窗口(slidingwindow)法,然而滑动窗口计算量巨大,耗时较高,在不同场景图像上的实验表明对单个目标的检测常常需要消耗104-105个窗口,针对多个目标的场景下检测则多达106-107个窗口[2~3]。而一般环境下经常含有多个目标,多尺度滑动窗口检测方法效率低下,预处理阶段的巨大计算资源开销使得许多与目标检测有关的图像处理任务最终效果较差。为解决不同场景下目标检测效率较低与检测质量较差的问题,研究人员提出目标建议(objectproposal)方法,又称为似物性检测。目前,各种似物性模型在PASCAL、ImageNet、MSCOCO等数据集上均得到了较高的检测精度,不仅成为支撑图像检测、识别、理解等许多图像领域任务的重要方法,也是目前流形的深度神经网络的一种重要的输入特征[4]。

本文通过Alexe[12]等提出的通用似物性度量Objectness计算目标物体出现的概率,作为物体粗糙检测,为后文贝叶斯框架融合提供物体位置信息。原始Objectness中使用SR[21]显著性作为生成似物性窗口的特征之一,SR方法使用傅里叶变换生成的普残差计算全局显著性,生成整幅图像 f的感兴趣区域。显著图I以及每个像素点 p的关系如下:

图2 似物性检测结果

2.3 贝叶斯显著性融合

传统的显著性检测方法常通过利用视觉机制相关原理,如“中心偏置”或者“中心环绕对比度”计算像素点局部或全局对比度值,而后通过传统的特征融合机制综合不同的对比度计算结果,生成最终的显著图。如Itti[4]等提出的基于生物视觉原理的检测方法,将不同的特征图(亮度I、颜色C、方向O)经过线性综合,得到最终的显著图。

然而,特征融合机制并不能很好地符合人眼视觉原理,生成的显著图中仅考虑到图像低层信息,单个像素点无法完整地保留物体整体轮廓,因此仅能提取出图像边缘角点等信息。为解决以上问题,本文通过贝叶斯框架融合前文生成的超像素级显著性以及目标物体位置信息,最终计算出显著物体后验概率。

当在视觉场景中搜索显著物体obj时,基于Zhang等的假设:该显著物体obj的显著程度可以由物体显著性特征和位置信息共同决定。本文以超像素级显著性和似物性信息 pi为先验知识,检测显著物体,具体计算过程如下:

假设目标物体的显著性特征和位置信息彼此相互独立,通过条件独立简化式(8):

对上式取对数,得到:

由于原始Objectness方法中显著性特征是通过在频域计算普残差的SR方法得到,与本文在空间域计算对比度的思想不一致,为保证超像素内显著值性质相同,本文优化原始似物性度量,删除Objectness中的SR方法,并将原打分函数替换为本文的贝叶斯后验,在超像素级显著图中搜索分数最高的区域作为最终检测出的显著物体。

3 实验结果与分析

本文的超像素级显著性方法和显著物体检测方法均在标准数据集MSRA-1000上与其他方法进行对比实验。MSRA-1000含有丰富的场景,图像颜色特征明显,并由Achanta[7]实验室提供真值图(Ground-Truth),以便客观地评估性能。实验中将本文显著性方法与8种影响广泛的显著性方法对比 ,分 别 为 Itti[1],GBVS[19],SR[24],FT[7],Context-Aware[22],LTD[2],SEG[20]和 Lu[21]。将本文显著物体检测算法与原始Objectness对比,所有实验结果均通过原作者提供的实验源码运行得到。

3.1 超像素级显著性方法实验及分析

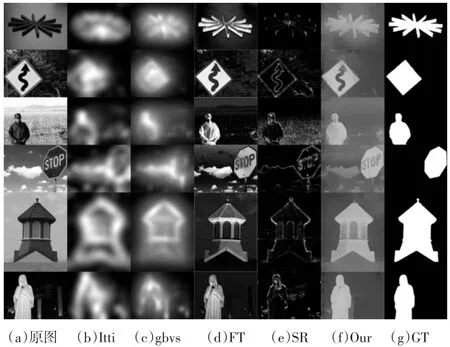

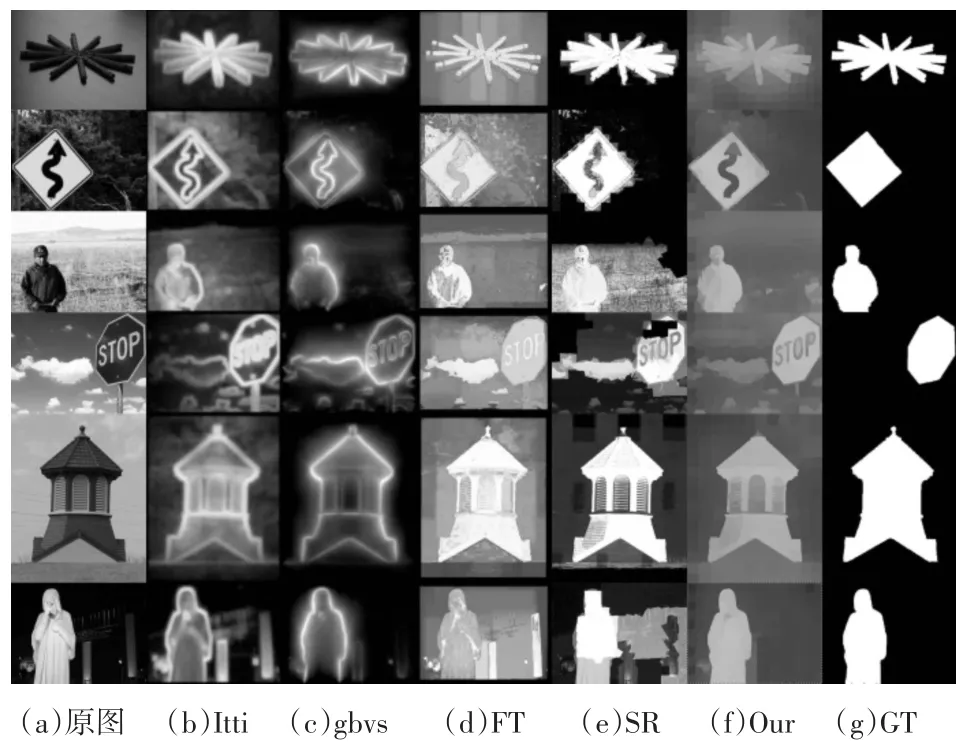

在state-of-the-art显著性方法中选取最具代表性且性能较好的8种与本文颜色显著性方法实验比较。其中Itti、GBVS、SR、FT均为采用视觉机制自底向上的传统方法,SR和FT在频域计算对比度。Context-Aware综合全局和局部特征,是传统显著性研究中检测精度最高的方法。LTD是检测显著物体的方法,本文与该算法中的多尺度显著性对比。SEG和Lu都采用了贝叶斯模型作为整体框架融合多个目标对象特征检测显著物体,值得一提的是Lu方法中同样综合考虑了图像低层和中层信息,检测效果明显高于其他几种,本文与以上8种方法的显著图和PR曲线比较,如图3~5所示。

从以上的显著性图对比分析可以看出,传统显著性模型仅能检测出目标对象的边缘或角点等信息,无法将显著物体完整地从视觉场景中分割出来。不同于传统的显著性算法,本文超像素级显著性模型综合考虑了图像中层超像素信息,又经过相邻超像素间的紧致性及RGB颜色关系优化,使得显著图中目标前景更加突出,从以上的显著图实验中可以看出本文算法分割效果明显好于其他8种方法。

图3 在MSRA-1000数据集上的显著图对比

图4 在MSRA-1000数据集上的显著图对比

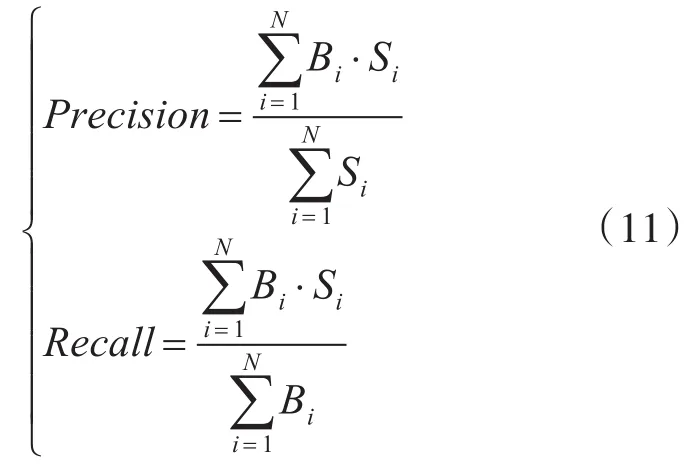

本文使用PR曲线对比分析不同方法的检测准确率,假设B、S分别表示显著区域的二值化基准图和显著区域检测算法生成的并被阈值二值化的显著图,PR精度计算公式和PR精度曲线如式(11)及图5所示。

从以上的PR曲线可以看出,在频域中计算的FT和SR方法精度最低,同样使用贝叶斯框架融合多种特征的SEG和Lu方法精度相对高于其他几种,Lu方法中也加入了超像素信息计算显著值,然而其使用角点作为兴趣点构建凸包作为显著物体的粗糙检测区域,从显著图中可以看出,显著物体周围存在大量由于异常兴趣点构建的误检区域,对最终检测精度造成极大的影响,而本文显著性方法通过综合考虑图像中层超像素所带有的目标对象边缘结构信息,结合超像素间临域关系及空间一致性等性质,使得优化后的显著图能够从视觉场景中完整地分割出显著物体,而不仅仅是边缘角点等信息,检测精度也高于其他几种方法。

图5 在MSRA-1000数据集上的PR曲线

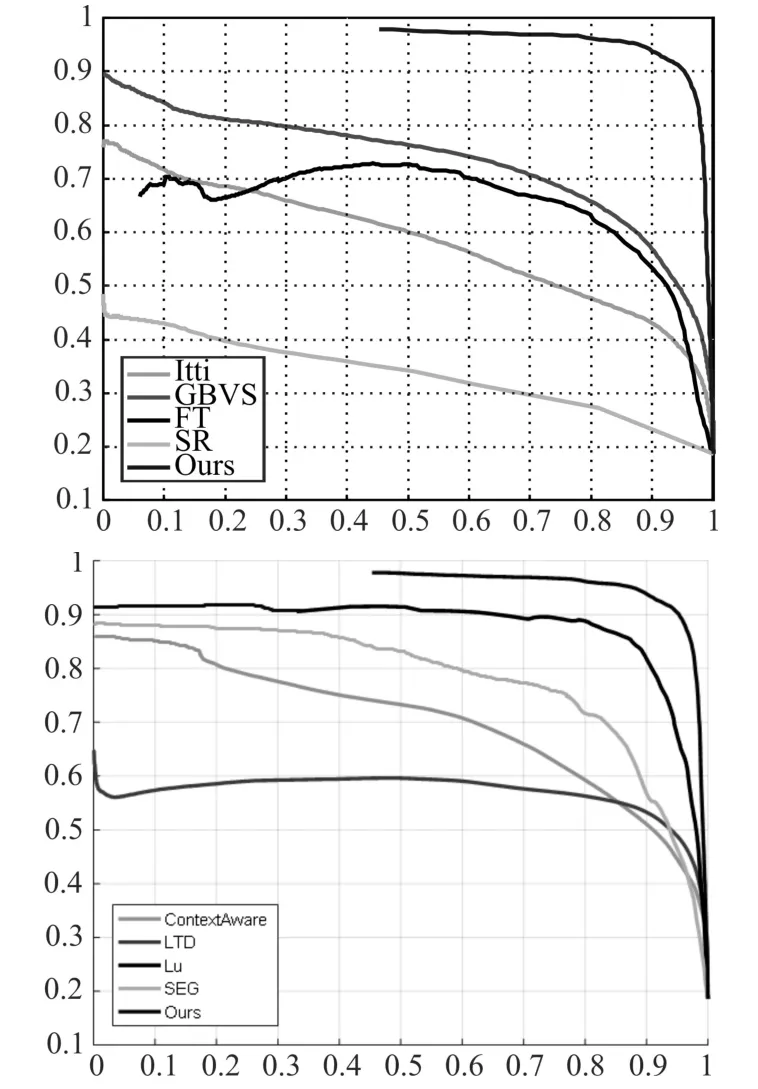

3.2 本文显著物体检测结果及分析

图6 在MSRA-1000数据集上的最终显著物体检测对比

原始Objectness方法中仅考虑到物体边缘、颜色、位置和频域显著性特征,丢失了物体在空间域中以显著物体为目标的任务驱动型自顶向下显著性信息,而本文算法通过贝叶斯框架融合超像素级显著性、似物性和自顶向下显著性信息计算得到符合人眼视觉原理的显著物体贝叶斯后验信息,并以此为评分标准,在超像素级显著图中搜索得到较完整的显著物体。从以上的实验结果可以看出,Objectness方法仅能检测出显著物体部分信息,因此该方法常用作显著物体的粗糙检测,提供显著物体位置等先验知识。而本文算法使用似物性作为粗糙检测,综合考虑图像中层超像素结构信息,实验表明本文算法能检测处于多个不同性质区域的显著物体,较完整地分割出显著物体整体。

4 结语

传统显著性方法仅能检测出目标物体边缘或角点等方面信息,丢失了大量物体内部数据,为解决以上问题,本文考虑以超像素为基本单元,而不只是单个像素点信息,综合考虑超像素之间的临域关系,优化得到超像素级显著图。其次,利用通用似物性度量计算目标物体粗糙检测区域,避免了传统滑窗法巨大的时间开销问题,给出目标物体位置信息。最后通过贝叶斯框架融合超像素自底向上显著性、位置信息和自顶向下显著性信息,计算得到显著物体贝叶斯后验概率,并以此为本文优化后的似物性方法评分标准。从实验结果可以看出本文超像素级显著图精度明显高于其他8种一流算法,在显著图上的搜索最终能够完整分割出显著物体。