卷积神经网络在手写字符识别中的应用

丁蒙 戴曙光 于恒

摘要:随着人工智能的发展,计算机对于输入的手写字符识别需求越来越大,采用改进的卷积神经网络对手写字符进行识别分类。用VGGNet16模型构造卷积神经网络模型,每一层都加上批标准化,通过平均值池化对卷积层进行下采样,利用PRELU激活函数代替ReLU激活函数,最后通过Softmax分类器对手写字符图像进行分类。在MNIST手写数字数据集和EMNIST-bymerge手写字母及数字数据集下进行实验,改进的卷积神经网络模型在MNIST数据集中识别准确率提升到99.65%,在EMNIST数据集中识别准确率为90.37%。因此,改进模型识别准确率较高,适用于手写字符识别。

关键词:人工智能;卷积神经网络;手写字符识别;全局平均池化

DOI: 10. 11907/rjdk.191411

开放科学(资源服务)标识码(OSID):

中图分类号:TP317.4

文献标识码:A

文章编号:1672-7800(2020)001-0275-05

0 引言

智能化信息时代的到来,使得人工智能与机器学习技术得到了飞速发展。深度学习是机器学习的分支,是一种试图使用包含复杂结构或由多重非线性变换构成的多个处理层通过大规模原始数据进行高层抽象的算法。典型的深度学习网络有卷积神经网络[1-2]( Convolution NeuralN etwork,CNN)、深度置信网络[3](Deep Belief Network,DBN)、堆叠自动编码器[4](Stacked Auto Encoders,SAE)3种类型。深度学习技术在图像分类方面有显著效果,其中CNN能够对输入数据的二维结构进行处理,避免了将二维数据转成一维数据时丢失输入图像的空间结构特征分布,因此在图像处理方面能够得到了更好的结果。2014年,由牛津大学计算机视觉几何组( Visual Geometry Group)和Google DeepMind公司研究院共同研发的深度卷积神经网络VGCNet[5]模型在ILSVRC2014图像分类和定位项目比赛中分别取得第二、第一名的成绩。

手写字符识别应用广泛,在数据信息处理与存储、办公自动化和人机交互等方面扮演着重要角色,是图像处理与模式识别的一个重要组成部分。Cortes等[6]在1995年提出了利用SVM分类器进行手写字符识别,Amit等[7]在1997年通过最邻近分类对手写字符进行识别。不过上述两种方法容易受外界影响,特征表达能力不足。早在1990年,文献[2]就提出了卷积神经网络,Goodfellow等[8]在2013年通过在卷积层加Maxout操作对手写字符进行识别。由于卷积神经网络参数众多,因此Lin[9]提出用mlpconv层和全局平均池化对手写字符进行识别,以更少量的参数达到同样效果。文献[10]提出使用随机池化代替最大值池化进行手写字符识别。卷积层使用ReLU激活函数,可能会将负值特征信息丢弃导致分类出现错误,因此文献[11]提出了一种参数修正线性单元( Parametric Rectified linear unit.PReLU)代替ReLU激活函数对手写字符进行识别。2015年,文献[12]提出用基于CNN和SVM的}昆合卷积神经网络对手写字符进行识别,使手写数字识别准确率达到了99.15%,文献[21]使用融合卷积神经网络模型对手写数字进行识别,准确率达到了99.36%。本文基于VGCNet16模型,用全局平均池化代替全连接层以减少训练参数,利用PReLU作为激活函数保留负值特征信息,采用批标准化[13]( Batch Normalization,BN)操作加速收敛过程,在MNIST数据集[15]上与其它方法对比验证模型的有效性,在EM-NIST-bymerge数据集[16]上评估模型识别英文和数字有效性。

1 卷积神经网络模型VGGNet

VCCNet模型是由牛津大学计算机视觉几何组和Google DeepMind公司研究院共同研发的深度卷积神经网络模型。如图1所示,在VGGNet16模型中,整组结构都包含五组卷积层,每个卷积层后面跟随着一个池化层,5组卷积层中包含级联的卷积层越来越多。在卷积层中使用非常小的感受野,其卷积核大小为3x3,卷积步长为1。池化层采用最大值池化,池化核大小为2x2,步长为2。最后三层为全连接层,前两层每层均有4 096个通道,第3个通道为Softmax分类层。全连接层的配置相同,因此隐藏层都配备了修正线性单元ReLU。

2 卷积神经网络改进方法

传统的卷积神经网络模型,采用ReLU激活函数丢弃负值特征信息,全连接层的参数占所有参数的绝大部分,导致模型收敛速度慢。改进的卷积神经网络模型应用PReLU激活函数保留负值特征信息,使用全局平均池化代替全连接层以减少参数数量,用批标准化操作使模型更快收敛。

2.1 批标准化

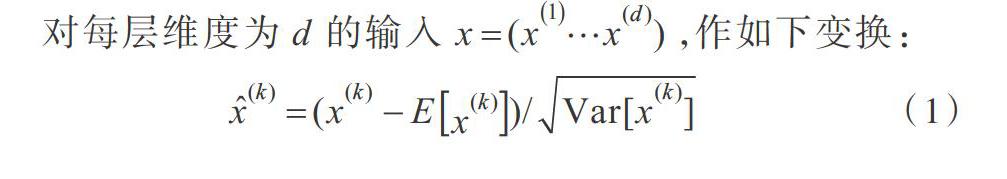

训练深层神经网络是复杂的,在网络训练中,每一层的参数是不断更新变化的,这导致每层的输入分布逐渐发生偏移变动,整体分布慢慢往非线性函数取值区间的上下限靠近,使得后向传播时底层神经网络梯度消失,引起In -ternal Covariate Shift现象,从而减慢训练速度。在神经网络模型训练中,可以采用批标准化操作以避免Internal Co-variate Shift发生。

在卷积神经网络中,BN使用权值共享策略,每一个特征图为一个小批次B,再求得特征图里所有神经元的均值和方差,对特征图做归一化操作。本文网络BN层位于激活函数后面,此时前向传导如下:

z=BN(g(Wu+ b))

(7)

其中,u为BN层的输入,W为权重,b为偏差,g(.)为激活函数,z为输出。

2.2 PReLU激活函數

修正线性单元对于深度卷积神经网络必不可少。应用ReLU激活函数可能会出现部分神经元永远不会被激活,相应参数也永远不会被更新的情况,为了避免这种情况的发生,本文采用PReLU激活函数。ReLU与PReLU的区别如图2所示。

2.3 全局平均池化(Global Average Pooling,GAP)

传统卷积神经网络中,全连接层的作用是将卷积层与Softmax层连接起来,将卷积层产生的特征图展开成向量并对向量做乘法以降低其维度,最后通过Softmax层中进行分类,其操作如图3(a)所示。然而,全连接层参数量过大,导致训练速度降低,容易过度拟合,从而阻碍整个网络的泛化能力。本文采用全局平均池化层替代全连接层,在卷积层生成若干个特征图后,全局平均池化对每个特征图取平均值,将生成的向量直接送入Softmax层中进行分类,其操作如图3(b)所示。全局平均池化相对于全连接层的一个优点是,通过强制映射特征和类别之间的对应关系,它更接近卷积结构。因此,特征图可以容易地解释为类别置信图。另一个优点是在全局平均池化中没有要优化的参数,因此在这一层中避免了过拟合。同时,全局平均池对空间信息进行了求和,从而对输入的空间平移具有更强的鲁棒性。

2.4 改进的卷积神经网络模型结构

改进的卷积神经网络模型基本结构主要由5个卷积块、5个BN层、5个池化层、1个全局平均池化层和一个Soft-max层组成。网络具体配置和参数数量如表1所示。

3 实验结果与分析

为了评估模型性能,本文在MNIST数据集和收集的英文数据集上进行实验。采用基于Pvthon语言的Keras深度学习框架,实验平台为Windowsl0 64位操作系统,硬件环境为2.3 CHz Intel Core i5-6300HQ和NVDIA GeForce CTX950M CPU。

3.1 MNIST数据集

MNIST数据集包含了70 000张手写数字图像,其中训练样本有60 000个,测试样本有1 000个,每张图像的大小为28x28。设置epoch为100. batch设置为500,每个epoch需要训练120次,总迭代训练次数为12 000次。卷积层步长设置为1,池化层步长设置为2,采用Adam优化算法[17]进行网络训练,用反向传播算法调整网络权值,用交叉熵函数衡量训练损失,采用自适应学习速率对训练集样本进行学习,训练结果如图4所示。经过100次迭代准确率已达到 99.65%。

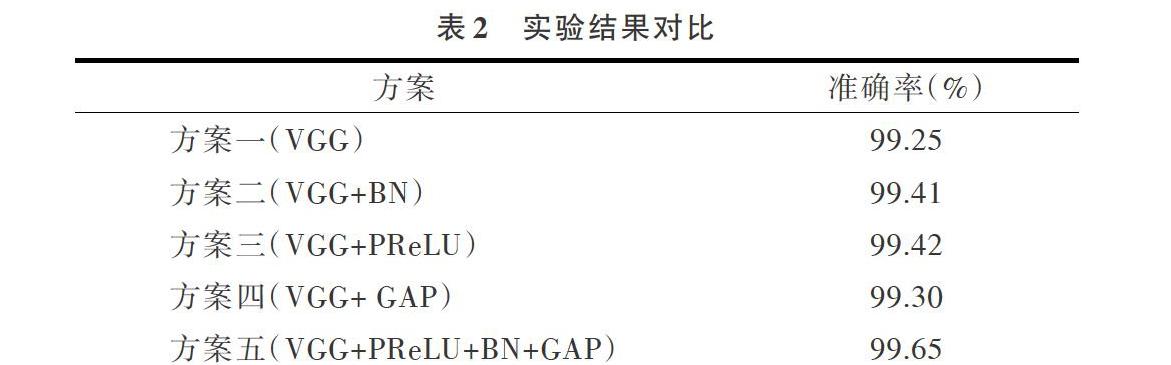

本文通过以下实验进行对比,方案一采用传统的VCG模型,方案二是加了Batch Normalization的VGC模型,方案三是采用PReLU作为激活函数的VCC模型,方案四是全局平均池化层代替全连接层的VGC模型,方案五是本文提出的用全局平均池化代替全连接层,利用PReLU作为激活函数,加入Batch Normalization的VCC模型。实验结果如图5与表2所示。其中图5为训练过程中的损失曲线,表2为5种方案测试集的最大準确率。从图5可以看出,加入BatchN ormalization之后,神经网络收敛更快,使用PReLU激活函数之后,效果比原来的更好,全局平均池化因为减少了训练参数,也较VGC模型收敛稍快,本文改进VGC模型收敛更快,参数更少,且测试准确率最高,达99.65%,验证了本文模型的有效性。

为进一步验证模型的有效性,本文将提出的方法与近几年手写字符识别的方法进行对比试验,实验结果如表3所示。文献[18]表明通过减少全连接层参数可以提高识别准确率到99.29%,文献[19]通过在隐藏层设置SVM辅助分类器提高学习过程,使识别准确率达到了99.61%,文献[20]通过一种融合卷积神经网络使识别准确率为99.10%,文献[21]通过基于PCA及k-邻近算法识别准确率为94%,文献[22]在TensorFlow平台使用CNN卷积神经网络使识别准确率达到99.36%,文献[23]基于深度残差网络识别准确率为99.45%。而本文方法识别准确率明显高于其它文献所提方法,极大降低了手写数字分类错误率。

3.2 EMNIST-bymerge数据集

为进一步验证模型有效性,继续在EMNIST-bymerge英文数字数据集[16]上进行实验。所选的数据集训练集有697 932张图片,测试集有116 323张图片,图片大小为28x28。图片包括0-9、小写字母a-z和大写字母A-Z,因为部分数字和英文大小写字母(例如0和0,w、v和z等字母的大小写)不能分辨,因此只分类47种,部分数据集图片显示如图6所示。

用本文提出的模型在EMNIST-bymerge数据集上进行实验,训练结果如图7所示。EMNIST-bymerge数据集测试中将BP神经网络设定为10 000个神经元,并对数据集进行测试,得到的测试准确率为80.87%+0.05%,本文使用改进的卷积神经网络模型在数据集上进行实验得到的测试准确率为90.37%,因此本文提出的模型极大提高了测试准确率,验证了其对手写字符识别的有效性。

4 结语

本文提出了一种基于VCCNet的改进模型,通过对每层输入进行Batch Normalization,用PReLU激活函数以保留特征图的负值信息,全局平均池化减少参数数量,最后输入到Softmax层中进行分类。本文在MNIST手写数字数据集上进行实验并与其它方法对比,实验表明,改进的卷积神经网络模型对手写字符识别准确率更高,具有更好的鲁棒性和泛化能力。本文还在EMNIST-bymerge手写英文数字数据集上进行实验,将数据集的测试准确率从80.87%提高到90.37%。因此,本文提出的改进模型可以应用于手写数字和手写英文识别。后续研究可围绕以下方面开展:①使用手写汉字等数据集,进一步验证网络结构的泛化能力;②对改进模型作进一步研究,例如采用随机池化等方式,进一步提高识别准确率;③采用其它深度学习算法,如ResNet或者DenseNet等模型在手写字符方面作进一步探讨;④本文方法应用不限于手写字符方面,例如可应用于人脸表情识别等图像分类领域,在人脸表情数据集上进行测试验证。

參考文献:

[1]

LECUN Y,BOTTOU L,BENCIO Y,et al.Gradient-based learningapplied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11):2278-2324.

[2]

LECUN Y,BOSER B E,DENKER J S,et al.Hanchvritten digit rec-ognition with a back-propagation network[C].Advances in neural in—formation processing systems, 1990: 396-404.

[3]

HINTON G E,OSINDERO S, TEH Y W.A fast learning algorithm fordeep belief nets[J]. Neural Computation, 2006, 18(7):1527-1554.

[4]

HINTON G E,Salakhutdinov R R.Reducing the dimensionalitv of da-to with neural networks[J]. Science, 2006, 5786( 313): 504-507.

[5]

SIMONYAN K,ZISSERMAN A.Very deep convolutional networks forlarge-scale image recognition[EB/OL]. https://arxiv.org/abs/1409. 1556.

[6]

CORTES C, VAPNIK V.Support-vector net,vorks[J].Machine Learn-ing,1995, 20(3):273-297.

[7]

AMIT Y, GEMAN D, WILDER K.Joint induction of shape featuresand tree classifiers [J]. IEEE Transactions on Pattern Analvsis&Ma-chine Intelligence, 1997( 11): 1300-1305.

[8]

GOODFELLOW I J,WARDE-FARLEY D. MIRZA M,et al. Maxoutnet,vorks[C]. The 30th International Conference on Machine Learn-ing, 2013:1319-1327.

[9]

LIN M,CHEN Q, YAN S. Network in network[ C]. International Con-ference on Learning Representations( ICLR), 2014: 1-10.

[10] ZEILER M D, FERGUS R.Stochastic pooling for regularization ofdeep convolutional neural networks[C].Proceedings of the Interna-tional Conference on Learning Representation( ICLR), 2013: 1-9.

[11]

CLOROT X, BORDES A, BENCIO Y.Deep sparse rectifier neuralnetworks[C].Proceedings of the Fourteenth International Conferenceon Artificial Intelligence and Statistics, 201 l:3 15-323.

[12]

HE K, ZHANC X, REN S,et al. Delving deep into rectifiers: sur-passing human-level performance on imagenet classification[C].Pro-ceedings of the IEEE International Conference on Computer Vision,2015:1026-1034.

[13]

YU N, JIAO P,ZHENG Y. Handwritten digits recognition base on im-proved LeNet5 [Cl.The 27th Chinese Control and Decision Confer-ence.2015:4871-4875.

[14]

IOFFE S,SZEGEDY C.Batch normalization: accelerating deep net-work training by reducing internal covariate shift [C].ICML'15 Pro-ceedings of the 32nd International Conference on Machine Learning,2015:448-458.

[15]

LECUN Y, CORTES C. The mnist database of handwritten digits[Z].2010.

[16]

COHEN G,AFSHAR S, TAPSON J, et al. EMNIST: an extension ofMNIST to handwritten letters[DB/OL]. https://arxiv.org/pdf/1702.05 373.pdf.

[17]

KINCMAD P,BA J. Adam:a method for stochastic optimization[ EB/OL]. https: //newzoo.com/insights/articles.

[18]

YANG Z, MOCZULSKI M,DENIL M,et al. Deep fried convnets[C].Proceedings of the IEEE International Conference on Computer Vi-sion,2015:1476-1483.

[19]

LEE C Y, XIE S,GALLAGHER P, et al. Deeply-supervised nets[C]. Artificial Intelligence and Statistics, 2015: 562-570.

[20] 陳玄,朱荣,王中元.基于融合卷积神经网络模型的手写数字识别[J].计算机工程,2017( 11):187-192.

[21]顾潘龙,史丽红.基于PCA及k-邻近算法的复杂环境数字手写体识别[J].电子技术,2018, 47(10):44-48.

[22] 陈昊,郭海,刘大全,等.基于TensorFlow的手写数字识别系统[J].信息通信,2018 (3):46.

[23]赵朋成,冯玉田,罗涛,等.基于深度残差网络的手写体数字识别[J].工业控制计算机,2017,30( 10):82-83.

(责任编辑:孙娟)

作者简介:丁蒙(1995-),女,上海理工大学光电信息与计算机工程学院硕士研究生,研究方向为图像处理、机器视觉;戴曙光(1957-)男,上海理工大学光电信息与计算机工程学院教授、博士生导师,研究方向为机器视觉、图像处理;于恒(1998-),男,上海理工大学光电信息与计算机工程学院学生,研究方向为图像处理。