用于草坪场景理解的轻量化图像分割算法

侯枘辰,刘 瑜,廉 华,巩彦丽

(浙江理工大学 机械与自动控制学院,浙江 杭州 310018)

0 引 言

随着经济社会发展进程的加快,人们对于环境的要求从最基础的满足生存需求转移到了满足发展需求。随着绿化草坪面积的不断增加,草坪养护的工作量也日益增多,草坪养护的过程中,修剪是一项量大且枯燥的工作。基于生产率提升的需求,使得该工作亟需自动化程度、安全性能好的智能割草机器人设备。目前大部分的草坪场景都是在城市内,场景较为复杂,草坪形状不一,草坪上可能会有各种的障碍物,草坪附近可能有停车、有行人。这给智能移动割草机器人的自主导航与避障带来较大的困难,因此研究草坪复杂场景的理解识别变得尤为重要。场景理解[1]是对图像场景中各类对象进行像素级的分割,是智能割草机器人设备研究中基础且关键的技术之一,可以准确地识别出环境中的障碍物,分辨出需要工作的区域,为之后的自主导航和避障提供支持。

近年来,深度学习成为图像分割的重要方式[2],加州伯克利分校的Shelhamer等提出用于图像分割的全卷积网络FCN(fully convolutional networks)[3],第一次将深度学习应用到图像分割领域,主要思想是使用卷积操作代替分类任务中的全连接层,以及上采样操作将特征图还原至原始尺寸;剑桥大学机器智能实验室提出了SegNet网络[4],该网络将图像分割分成了编码阶段和解码阶段,可以更准确地将特征还原至原始位置;Chen等提出了DeepLab图像分割模型[5],先通过全卷积网络粗提取特征,再通过全连接条件随机场优化,得到精确的分割图;Lin G等人设计了RefineNet模块[6],不断输入低层特征得到精确的分割结果。

但是像素级的图像分割算法存在运算量大、占用资源多、处理速度较慢等缺点,难以满足硬件配置不高的割草机器人实时检测的需求。因此该文在RefineNet的基础上,结合MobileNetV3网络[7]提出一种用于草坪场景理解的轻量级图像分割卷积神经网络,该网络同时兼顾分割准确率和运行速度,具有更好的综合性能。同时建立了草坪场景的分割数据集,将构建的神经网络模型在该数据集上训练,验证了移动机器人在草坪场景理解上的可行性。

1 算法理论

1.1 RefineNet网络

图像分割任务可以被看作是一种密集的分类任务,深度神经网络中重复的下采样操作使得原始图像在分辨率上产生了严重的损失,在整个过程中会丢失大量的图像结构信息,因此很多在分类任务上表现很好的网络在分割任务上显得力不从心。

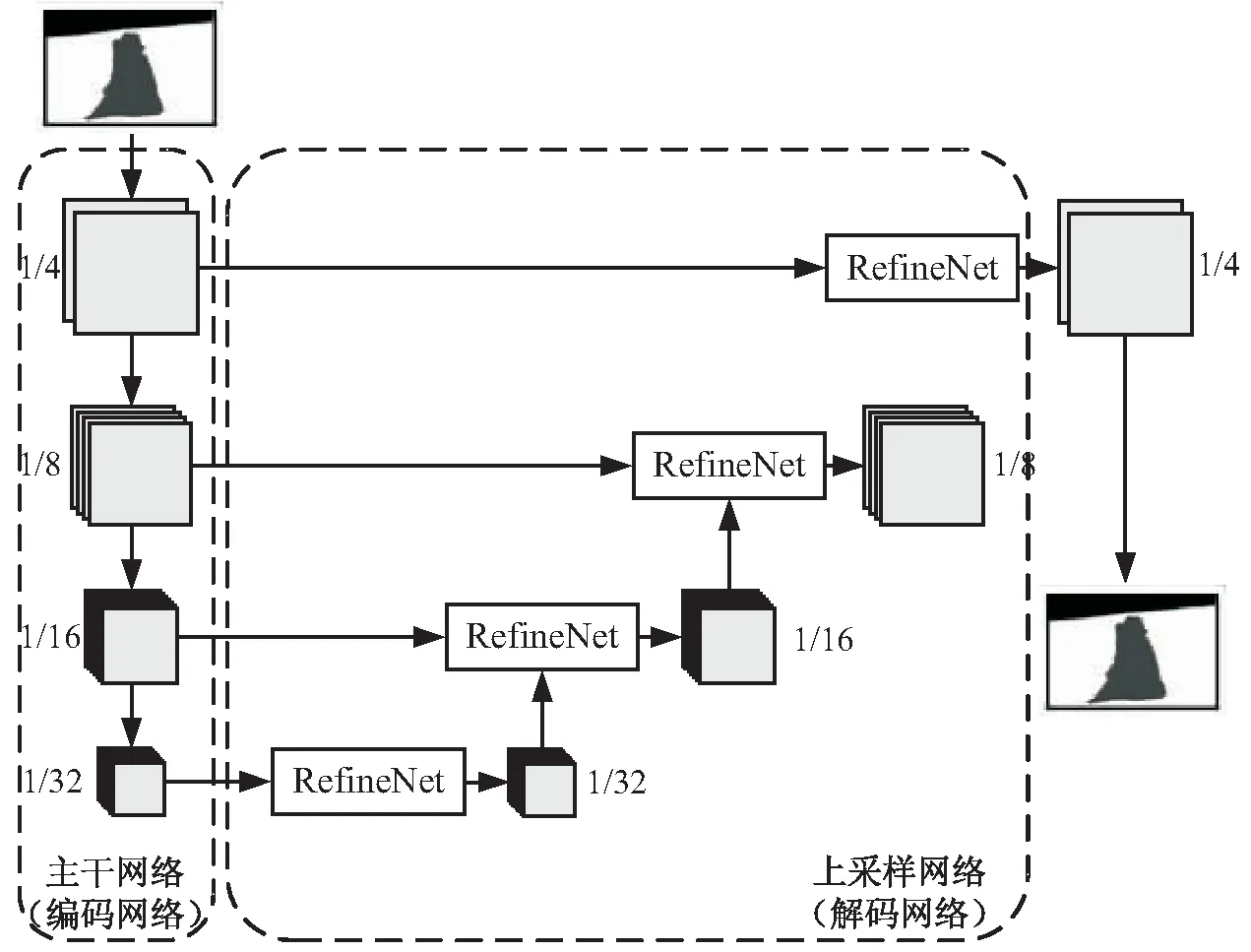

RefineNet网络是2016年由Lin G等人提出的,是一种以ResNet101[8]为主干网络用于图像分割的神经网络框架。RefineNet是一种生成式的多路径增强网络,具有以下优势:(1)可以利用多个层次网络层提取特征,采用递归的方式增强低分辨率(粗糙)的语义特征以产生高分辨率的分割特征图;(2)级联的网络结构可以进行端到端的训练;(3)提出了一种链式池化操作,可以以一种高效的方式捕捉背景的上下文信息。因此RefineNet在图像分割的任务上有很好的表现。图1是标准的RefineNet网络结构。

(a)网络框架

1.2 算法的轻量化

该文旨在提出一种用于图像分割的轻量化神经网络结构,从图1可以看出,RefineNet的网络分为编码网络和解码网络,因此对网络的轻量化可以从两个方面进行。在编码网络方面,在保证不影响准确率的前提下,使用深度可分离卷积代替传统卷积;在解码网络方面,使用小尺寸的卷积核代替大尺寸卷积核。

1.2.1 深度可分离卷积的编码网络

标准RefineNet网络的特征提取网络采用的是ResNet101网络,ResNet网络提出了残差学习的思想,在网络中添加了直连通道,解决了随着网络加深而产生的梯度下降和梯度爆炸问题,但其使用的依旧是传统卷积方式。

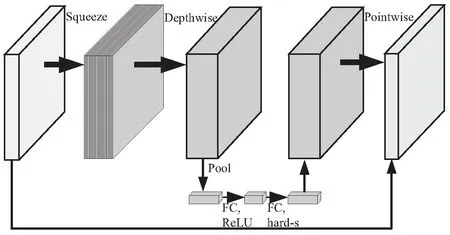

而MobileNet采用深度可分离的卷积方式,深度可分离卷积[9]是将标准的卷积分解成一个深度卷积和一个点卷积:首先采用1×1的卷积核对每一个通道进行卷积,然后再采用3×3的卷积核进行通道间的信息融合。假设输入的尺寸是DF×DF×M,输出的尺寸是DK×DK×N,对于标准卷积,卷积核数为DK×DK×M×N,所以计算量为DF×DF×M×N×DK×DK,而相应的深度可分离卷积的计算量为DF×DF×M×DK×DK+DF×DF×M×N。这样就将标准卷积计算中的乘法运算转换成为了加法运算,在不损失精确值的同时,极大地减少了计算量和模型的大小。使用h-swish激活函数代替了ReLU激活函数,有效地提高了网络的精度,h-swish激活函数[10]的表达式如式(1)所示:

(1)

图2是使用的MobileNetV3的网络块结构,不仅使用了深度可分离卷积的思想,同时结合了具有线性瓶颈的逆残差结构[9]和轻量型注意力机制[11],在减小网络计算量的情况下,保证了网络的精度。

图2 MobileNetV3网络块结构

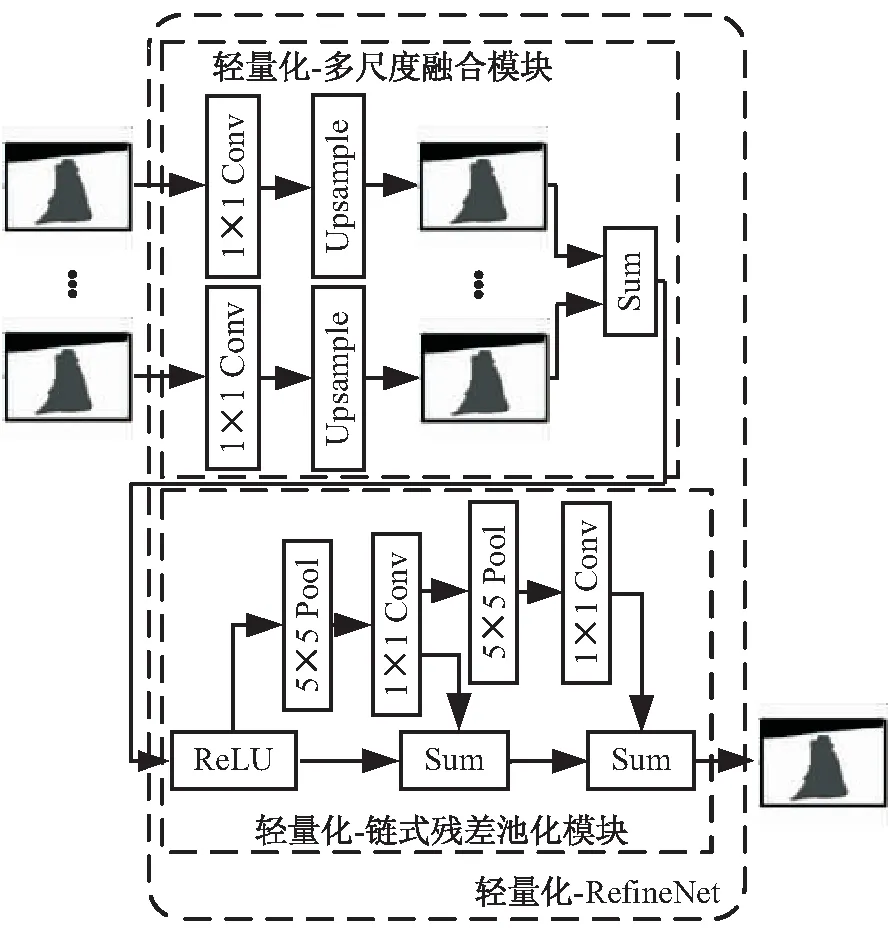

1.2.2 轻量化的解码网络

由图1可以看出,RefineNet的解码网络主要依赖两个模块:RCU(residual convolutional unit)和CPR(chained residual pooling),所有的这些模块都采用了3×3的卷积和5×5的池化,并进行相应的填充以保持空间尺寸。采用大尺寸卷积核的目的是为了增加接受域的大小,但是经过实验发现,在RefineNet网络下,使用1×1的卷积核替代接受域并没有明显的差异。反而因为3×3的卷积核的大量使用,网络的参数数量和浮点运算数量都会变得很大,影响了网络在移动端的处理效率。因此,将原网络的CPR模块和融合模块中3×3的卷积核用1×1的卷积核代替,仅在最后的分类层中使用了3×3的卷积核。通过这样的方式,网络的参数减少了50%。

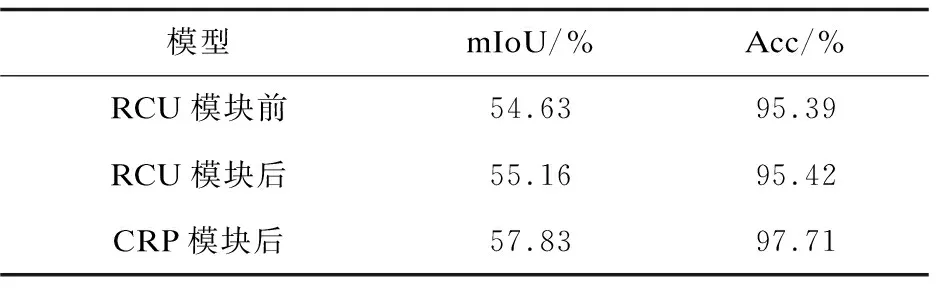

通过分析各模块的功能,可以得到如表1所示的结果,在轻量化后的网络结构里,不管是在精确分割分类还是增加上下文覆盖率上,CPR模块都是主要的模块,而RCU模块对结果只有微小的提升。所以为了最大限度上地减小参数量和模型大小,在最后的网络结构里,去除掉了RCU模块。图3是轻量化后的解码网络。

图3 轻量化的RefineNet解码模块

表1 各模块的效果分析

2 数据集的制作

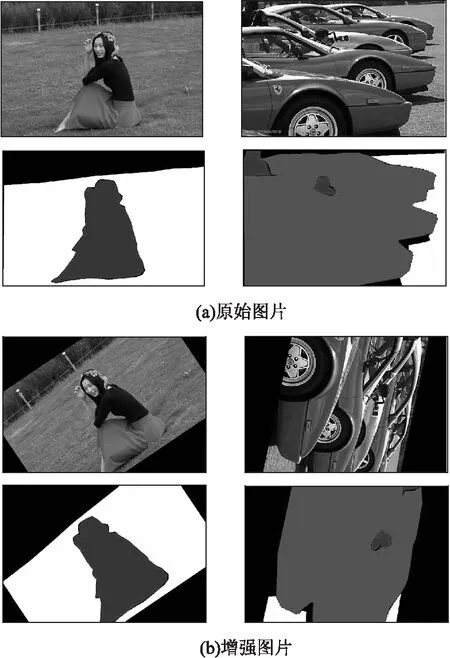

对于草坪的场景分割任务来说,目前并没有公开的数据集,因此该文通过获取网络上的图片以及使用相机收集生活中的草坪场景,共231张,通过颜色抖动、随机裁剪、图片旋转等数据增强[12]方式扩充至2 540张,作为实际的训练测试数据集。

根据生活中草坪的实际环境,结合网络的使用场景,将任务定义为识别出环境中的障碍物,分辨出需要工作的区域,因此将草坪场景图像中的对象划分为5种类别,分别是“背景、草地、行人、汽车以及道路”。使用公开的LabelMe工具对数据集进行标注,并将所有的图片按照PASAL VOC2012分割样本集的格式处理和存储,将整个数据集按照10∶1的比例分为训练集和测试集。图4是部分原数据集以及增强后的数据集图片。

图4 训练集样本与Mask图

3 实验结果分析

3.1 训 练

前文提到,目前没有用于草坪场景分割的公共数据集,人工标注制作数据集需要耗费大量的人力物力,因此采用迁移学习[13](transfer learning)的方法对构建的网络进行训练。迁移学习本质是利用将一个问题上训练的所得,用于改进在另一个问题的效果,因此可以在文中有限的数据集上,有效地提高模型的泛化能力。该文采用了MobileNetV3在PASAL VOC2012数据集[14]上的训练模型作为整个网络的预训练模型。首先,将预训练模型的部分参数载入RefineNet网络,由于预训练模型的参数是分类网络训练得来的,所以只加载特征提取层的参数;然后,没有预训练参数的RefineNet模块解码网络部分参数使用Kaiming初始化的方法进行初始化,可以有效地避免激活函数的输出值趋向于0,保证网络的训练效率。

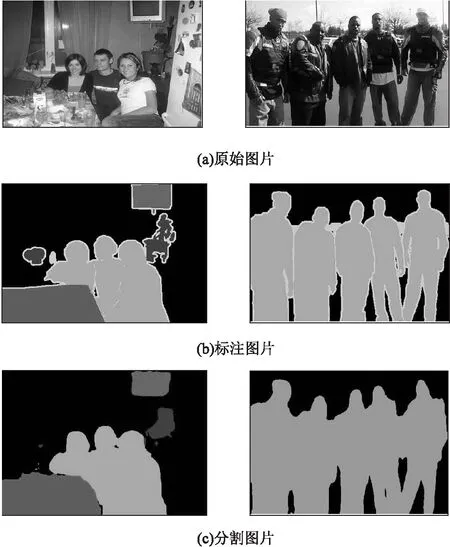

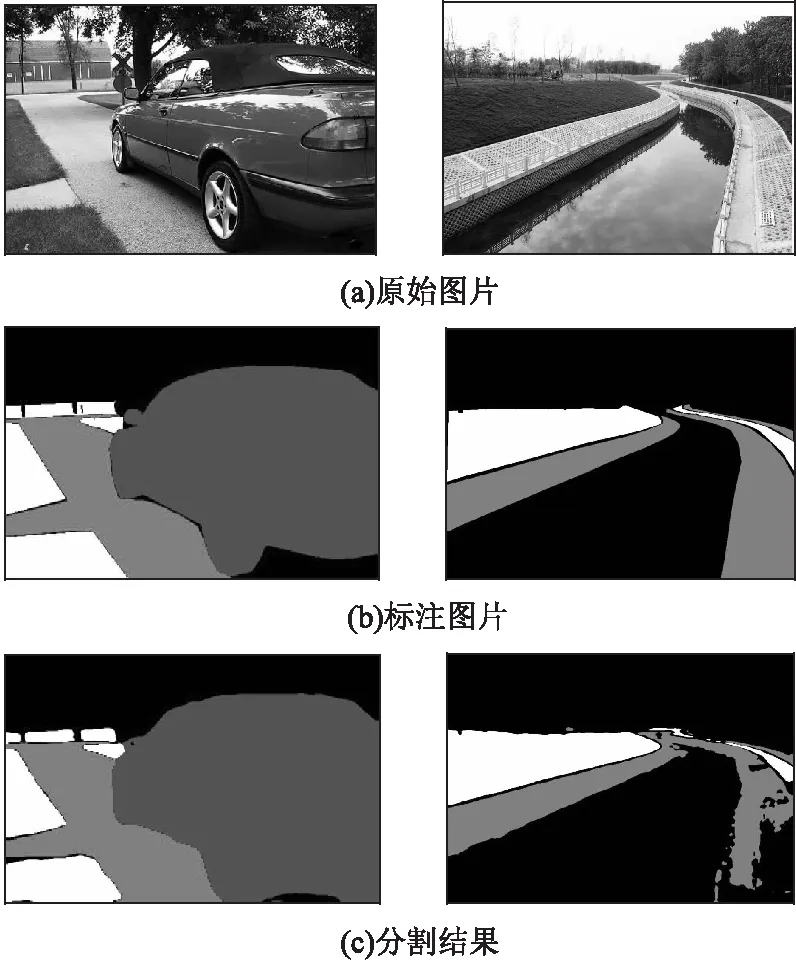

经过预训练后对网络进行评估,图5是分割的结果。从图中可以看出:该网络的性能较好,可以实现多种类别的像素级的分割,对目标边缘细节信息的分割效果也很好。但同时也会在局部出现一些误检和漏检的情况,造成这些情况的原因是,与目标识别任务比较,图像分割任务要做到像素级别的分类,本身任务的难度较大,再加上该文使用轻量化的网络,参数量相对较少,会对特征描述的能力造成一定的影响。

图5 PASAL VOC2012数据集上的分割效果

实验过程均在以下的工作条件下完成训练与测试:IntelCore i5 8300-H CPU,配备8 GB RAM与Win10操作系统,NVIDIA GTX1050Ti配备4 G显存,以及Pytorch深度学习框架,并配置RefineNet的运行环境,然后将标定完成后的样本数据集使用轻量化后的RefineNet进行训练与评估[15]。

3.2 评估参数

分割任务中常用的评价指标是平均交叉联合度量(mean intersection over union,MIoU,也称为平均交并比),是各类目标IoU的均值,其中IoU计算方式如式(2)所示:

(2)

其中,TP是被模型预测为正的正模型,FP是被模型预测为正的负样本,FN是被模型预测为负的正样本。在图像分割任务中,更高的MIoU值通常代表着模型对小目标有着更好的检测分割能力。

3.3 结果分析

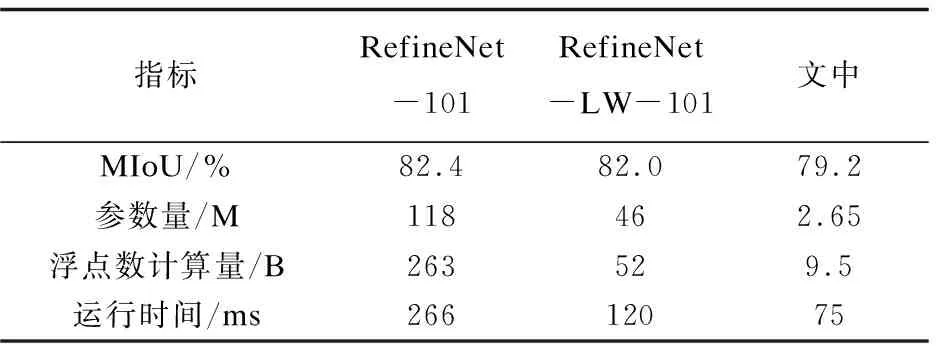

使用的数据集是前文所提到的手动标注的草坪场景分割数据集,该数据集包含了2 540张图片,其中2 300张用来训练,240张用来测试。从运行时间、参数量、浮点数运算量和算法性能进行对比测试。运行时间通过输入480×480的图像测试取得,测试的结果如表2所示。

表2 不同方法的结果比较

表2中,RefineNet-101表示的是原始的以ResNet101为编码网络的RefineNet,RefineNet-LW-101表示的是仅仅轻量化解码网络后的RefineNet,文中网络是编码网络和解码网络均轻量化后的网络。从表中的数据可以看出,文中的网络具有轻量化、运行速度快、准确率较高的特点。通过对比可以看出,对解码网络的轻量化(用1×1的小尺寸卷积代替3×3的卷积并去掉RCU模块)使得网络的参数量有大幅度的降低,约61%,并且运行速度也有很大的提升,运行时间少约55%;在解码网络轻量化的基础上,再对编码网络轻量化(使用MobileNetV3作为特征提取网络)又很大地降低了网络的参数量,约94%,提高了网络的运行速度,运行时间约少37%,并且保证了较高的准确率。

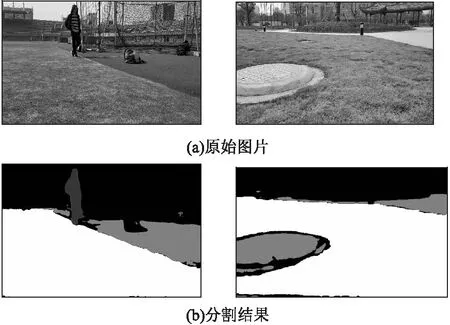

与采用ResNet101作为编码模块的网络相比,ResNet101得益于更深更宽的网络结构,作为特征提取模块时取得了最高的准确率,而文中算法在准确率上有一定的落后,但是整个网络的参数量仅有ResNet101的3%左右,而且运行时间也不到ResNet101的30%。所以算法结构兼顾了运行效率和准确率,在移动机器人的草坪场景理解任务上有更好的综合性能。提出的网络在草坪场景下的分割效果如图6、图7所示,其中图6中的数据是测试集中的结果,而图7中的数据来源是元数据集中没有的随机图片。由图7可以看出:设计的网络具有较好的综合性能,能够准确地实现草坪场景下的图像分割。

图6 草坪场景数据集上的分割效果

图7 随机样本的分割效果

4 结束语

设计了一种兼顾准确率和运行效率的轻量化神经网络图像分割算法,在网络的编码阶段结合使用了MobileNetV3网络;在网络的解码阶段中,通过分析原RefineNet模块中各部分的功能,通过使用1×1的小尺寸卷积核代替3×3的卷积核,并且去掉RCU单元,大幅度地减少了网络的参数量,有效地提高了网络的运行效率。与其他的网络相比,该方法准确率较高,MIoU指标达到了79.2%,运行速率较快,75ms/帧,综合性能较好,更适合应用于移动机器人草坪场景理解的任务中。采用图像分割的方法进行场景理解可以获得比传统目标检测方法更丰富的信息,在草坪场景的任务中,对草坪区域的识别效果更好,是未来移动机器人视觉感知技术的发展方向。下一步工作是通过增大训练样本数,对不同时期形态的草坪进行识别,以进一步提高模型的识别度。