缺株玉米行中心线提取算法研究

李祥光,赵 伟,赵雷雷

缺株玉米行中心线提取算法研究

李祥光,赵 伟※,赵雷雷

(河南科技大学车辆与交通工程学院,洛阳 471000)

无人驾驶农机自主进行行驶路径检测和识别系统需要具备环境感知能力。作物行的中心线识别是环境感知的一个重要方面,已有的作物行中心线识别算法在缺株作物行中心线提取中存在检测精度低的问题。该研究提出了一种能够在缺株情况下提取玉米作物行中心线的算法。首先采用限定HSV颜色空间中颜色分量范围的方法将作物与背景分割,通过形态学处理对图像进行去噪并填补作物行空洞;然后分别在图像底部和中部的横向位置设置条状感兴趣区(Region of Interest,ROI),提取ROI内的作物行轮廓重心作为定位点。在图像顶端间隔固定步长设置上端点,利用定位点和上端点组成的扫描线扫描图像,通过作物行区域最多的扫描线即为对应目标作物行的最优线;将获取的最优线与作物行区域进行融合填充作物行中的缺株部位;最后设置动态ROI,作物行区域内面积最大轮廓拟合的直线即为目标作物行中心线。试验结果表明,对于不同缺株情况下的玉米图像,该算法的平均准确率达到84.2%,每帧图像的平均检测时间为0.092 s。该研究算法可提高缺株情况下的作物行中心线识别率,具有鲁棒性强、准确度高的特点,可为无人驾驶农机在作物行缺株的农田环境下进行作业提供理论依据。

算法;图像处理;机器视觉;玉米;中心线;图像去噪;动态ROI

0 引 言

为确保无人驾驶农机在田间作业过程中能根据实际情况调整作业路径,需要其具备实时导航[1-3]的能力。现有的导航线检测算法大部分针对连续作物行,对于存在缺株现象的作物行中心线提取方法有待进行深入研究。

目前国内外应用比较广泛的导航方法主要有全球卫星导航(Global Navigation Satellite System,GNSS)、机器视觉导航[4-5]和传感器融合导航等方式。机器视觉导航以其成本低、鲁棒性强、实时性高的优点成为关注的热点。诸多学者对此展开了研究,张雄楚等[6]利用垂直累计直方图标准差和最小值的关系判断枣园种类,以扫描像素点的方法确定每行候补点,将候补点作为已知点进行Hough变换[7-9]来提取导航线。Jiang等[10]采用移动窗口扫描的方式来获取目标像素的分布,然后利用K均值(K-means)与Hough变换结合的方法筛选导航线。Meng等[11]采用微分算法、亮度分析法、颜色分析法分割水田图像[12-16],利用过已知点的Hough变换进行目标直线检测,计算速度相对于Hough变换方法有所提高,但是在不规则作物行及缺株情况下会导致目标点的检测失准。李景彬等[17]使用颜色分量差的方法提取棉花已收获和未收获区域的边界。亢洁等[18]提出了基于轮廓查找与线扫描的检测算法,穿过定位点的直线中绿色元素最多的即为导航线,但是未解决作物缺失时无法获取定位点的问题。曾宏伟等[19]采用区域生长算法进行图像分割,利用相邻像素的相似性将像素或子区域组合成更大的区域,能够保证分割区域的连通性,由于计算复杂,平均耗时需要0.41 s。杨洋等[20]利用垂直投影法确定静态ROI(Region of Interest)[21-23],通过对识别出的ROI进行动态更新来拟合玉米行间导航线,但是投影结果受作物密度影响较大,适用性不强。

综上可知,现有的研究方法大部分以连续作物作为研究对象,实际田地中由于受外界环境等因素的影响,作物行中会存在作物缺失的现象,这时传统算法难以保证作物行中心线的检测精度。针对上述问题,本研究提出了一种能够在缺株情况下检测目标作物行中心线的算法。首先在设置的ROI以轮廓查找的方法获取定位点;然后利用穿过定位点的直线以一定的步长扫描图像,通过作物行区域最多的扫描线即为最优线。用最优线填充目标作物行的缺株部位,在动态ROI内面积最大轮廓拟合的直线即为目标作物行中心线,以期为为无人驾驶农机提供检测缺株作物行中心线的算法,有助于无人驾驶农机在作物行缺株的农田环境下进行有效的作业。

1 图像预处理

1.1 玉米图像采集

图像采集设备采用中国海康威视MV-CE100-30GC彩色相机(CMOS类型,最大分辨率为3 840×2 748(像素))。考虑相机视角以及后续相机在农机上的安装高度等因素,图像采集时相机距地面高度为1.5 m,俯角为30°(图 1a)。样本图像分辨率为640×480(像素),视频帧率为每秒30帧。图像采集地点为中国一拖集团有限公司孟津试验田(112°41′E,34°79′N),采集日期为2020年7月,试验对象为玉米,苗高0.3~0.4 m,行间距0.2~0.3 m。为确保样本的普遍性,分别对试验田不同地块的玉米进行样本图像采集。

对采集到的玉米图像进行处理和作物行识别时,靠近图像中心的2~3行比较容易分辨,并且处于农机的行驶轨迹上。因此本研究将图像居中的2行设定为目标行(图1b)[24-25]。

采用的图像处理软件为Python 3.6与OpenCV 3.4视觉库,编译器为Pycharm,硬件为处理器Inter Core i5(主频1.6 GHz),显卡AMD 8600(显存2 G),内存12 G。

1.2 背景分割

采集到的图像格式为RGB彩色图像,而利用RGB确定颜色阈值需要具体判断每种分量的所占权重,计算较为复杂。由于图像中作物行区域为绿色,行间的土壤区域为灰褐色。为对作物行所在区域进行分割,首先将RGB图像转换至HSV颜色空间[26],然后根据作物的颜色设定相应的颜色阈值。

RGB模型转换为HSV模型的过程为:根据、、像素点在红绿蓝3个通道的取值(其取值范围均为[0,255]),通过运算得到RGB模型中的色品坐标(,,)(其取值范围均为[0,1]),将(,,)代入转换函数求得HSV模型中、、值(其中使用角度衡量,取值范围为[0°,360°];和为比例值,取值范围均为[0,1])。为方便计算将的取值范围量化为[0,180],和的取值范围均量化为[0,255]。

根据绿色在HSV颜色空间模型中的映射范围,将颜色阈值的取值范围设置为∈[35,77]、∈[43,255]、∈[46,255]。通过OpenCV视觉库中的二值化函数对图像进行处理[27],得到图像的二值图(图2a)。采用文献[10]和文献[20]的超绿(Excess Green,ExG)算法[28]对图像做灰度处理并利用大津法[29]做阈值分割(图2b)。通过对比可知,HSV颜色阈值分割方法每帧平均用时为0.013 s,ExG算法的平均用时为0.028 s,且ExG算法对作物密集区域的区分效果并不理想,相邻行间粘连情况严重。因此,本研究选用HSV颜色阈值分割的方法进行图像处理。

1.3 图像去噪

由于杂草、落叶等因素导致采集的图像中存在大量噪声。为了减少噪声并保持图像细节[30],采用先膨胀后腐蚀的闭运算对图像进行形态学处理,消除噪声和作物行区域内的孔洞(图3a),滤波窗口为5×5矩阵。

由于光照因素的影响,图像在进行阈值处理后出现苗尖与苗株分离的情况,形成了离散的小块。针对这种情况可采用限制面积的方式进行离散小块去除。通过对图像进行轮廓查找,计算不同离散小块的轮廓面积并删除像素面积较小的区域,避免对作物行中心线的提取造成影响。样本预处理后的二值化图像如图3b所示。

2 作物行中心线检测

Hough变换作为一种穷尽式搜索的算法,计算过程需要耗费大量的时间;文献[10]采用过已知点的Hough变换算法可减少计算量,但仍会受到杂草或缺株情况的影响;最小二乘法计算量较少,但是在作物缺失或作物密集的情况下聚类精度会受到影响[31],聚类中心会倾向于作物密度大的区域,导致生成的聚类中心点偏移。为了解决这些问题,本研究提出一种能够在缺株情况下检测目标作物行中心线的算法。

2.1 底部和中部最优线的获取

2.1.1 获取底部和中部定位点

本研究将获取的作物图像左上角设定为为坐标原点,原点向右为横轴正方向,原点向下为纵轴正方向。设置图像底部ROI,对图像坐标系纵轴0.95~1.00倍的高度(H,像素)区域进行掩膜操作。为避免目标行以外的区域对检测结果造成干扰,将掩膜宽度限制在(0.20~0.80)倍的图像宽度(W,像素)之间;设置图像中部ROI,在图像(0.50~0.55)H区域进行掩膜操作。由于相机视角影响,作物行顶端向中心靠拢,整体呈现梯形,因此将掩膜宽度限制在(0.30~0.70)W之间(图 4)。然后对条状ROI内的作物行进行重心提取,所采用图像矩的定义如下:

在分辨率为×的灰度图像中,设像素点(,)处的灰度值为(,)。用零阶矩(即00)表示目标区域的灰度和,也可看作目标区域的质量或面积[32]。

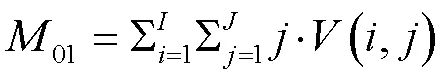

零阶矩的定义如式(1)所示。

式中表示图像像素的总行数;表示图像像素的总列数;、表示每个像素的横、纵坐标。在二值化图像中(图 3b),白色像素的像素面积为1,黑色像素的像素面积为0,因此零阶矩的值即为所有白色区域的像素面积。

一阶矩中10、01表示白色像素对应的横、纵坐标的累加和,反映横纵坐标的平均值。两者定义如式(2)和式(3)所示。

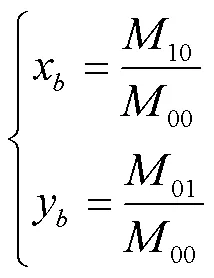

利用零阶矩和一阶矩可求出作物区域重心的坐标(x,y),如式(4)所示。

式中x、y分别表示二值图中白色区域重心的横、纵坐标。

2.1.2 扫描范围

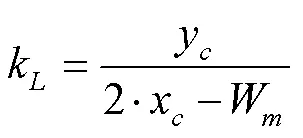

根据图像矩的定义,求得图像底部和中部ROI的重心作为定位点,为构成扫描作物区域的扫描线还需要确定每个定位点对应的上端点。上端点的坐标在图像第一行像素中设定。设上端点的坐标为(,0),为减少计算量的同时保持较高的精度,步长设定为5个像素,并对扫描的范围进行限制。设定位点坐标为(x,y),点(W-x,y)为点关于图像垂直平分线的对称点,点(W-x,0)为点在图像顶部的垂直投影点,以点与点连接的直线作为扫描范围的边界,如图4。扫描线和直线的斜率、k如式(5)和式(6)所示。

式中为第一行像素点的横坐标。通过改变与k的大小来限定扫描范围,当定位点位于图像纵向对称轴左侧且<k<0时,可确定左侧定位点对应扫描线的扫描范围;当定位点位于图像纵向对称轴右侧且>k>0时,可确定右侧定位点对应扫描线的扫描范围。

2.1.3 提取最优线

将每条扫描线中所有像素点的点集作为集合P中的元素,即P= {1,2,,l};扫描线与作物行重合部分的像素点的点集作为集合P中的元素,P= {1,2,,m},其中m≥0.3l,表示扫描线的数量。P中最大的元素所对应的扫描线即为穿过作物行区域最多的线。最终筛选出符合条件的最优线(图4)。

2.2 最优线与目标作物行融合

为确保在不同的情况下都能够对目标作物行进行填充,提出算法融合的思路,即把底部定位点和中部定位点获取的最优线同时与作物行区域融合,以达到最佳的填充效果。将最优线与作物行区域融合,能够有效填补目标作物行中的缺株部位,融合后的图像如图5所示。分别把底部和中部定位点对应的最优线与作物行区域融合,能够对作物行中、底部区域的缺株部位起到填充效果。若在作物行中无法获取底部或中部定位点,则无法对缺株部位进行填充。

2.3 作物行中心线提取

本研究提出的最优线与作物行区域融合的算法可以分别将底部和中部缺株情况下的最优线提取出来。2种算法融合可以满足不同缺株情况下作物行区域的填充。在填充后的图像中筛选出面积最大的作物行轮廓,并利用最小二乘法进行直线拟合,拟合结果即为目标作物行中心线。具体步骤为:

1)检测过程中同时运行获取底部和中部定位点对应最优线的算法,使用图像融合函数把2种算法的结果进行合并,对合并后的图像进行轮廓提取操作。为方便筛选作物行轮廓,对图像设置动态ROI(图6a)。对融合后的图像再次提取定位点。

计算底部最外侧两个定位点之间的距离,如式(7)所示。

式中B_R表示图像底部右侧定位点的横坐标,B_L表示图像底部左侧定位点的横坐标。左侧定位点的连线与图像上下边线的交点分别定义为点、,直线的斜率k和截距b分别如式(8)、式(9)所示。

式中B_L和B_L分别表示图像底部左侧定位点的横纵坐标,M_L和M_L分别表示图像中部左侧定位点的横纵坐标。由于图6a中点的纵坐标为0,点B的纵坐标为高度H,点、点的横坐标如式(10)所示。

由此可得、点的坐标,将直线向外平移0.25的距离至直线处。在右侧执行相同的操作。最终点、、和构成的区域即为动态ROI。

2)利用轮廓面积计算函数求出动态ROI内各作物行轮廓的面积,从中提取2个面积最大的作物行区域。利用直线拟合函数对这2个区域进行最小二乘法直线拟合操作,即可得到目标作物行中心线(图6b)。

3 算法验证

3.1 不同缺株情况下算法可靠性验证

为验证不同缺株情况下本研究算法的可靠性,分别在不同种植密度的农田环境下采样。在样本图像中以人工标记的作物行中心线作为标准线,根据标准线与作物行区域重合部分在标准线中所占的比重,对作物缺株情况进行分类:

1)若重合部分在标准线中所占的比重为≥0.30~0.50之间,表明作物生长较为稀疏,此时存在大量缺株现象;

2)若重合部分在标准线中所占的比重为≥0.50~0.70之间,作物存在少量缺株现象;

3)若重合部分在标准线中所占的比重≥0.70,则作物间距正常。

式中为设定的角度误差,(°),本文将设定为5°。

为验证算法融合后最优线对目标作物行的填充效果,对定位点的各种分布情况进行测试验证,试验结果如图7所示。

根据获取到的定位点数与对应最优线之间的关系可以把图像分为3种类型。类型Ⅰ:如图7a~图7d,为定位点缺失1个时获取的最优线;类型Ⅱ:如图 7f~图7h,为定位点缺失2个时获取的最优线;类型Ⅲ:如图7e,为定位点都存在时获取的最优线。对存在少量缺株情况的387帧玉米图像进行试验验证,其中符合类型Ⅰ、Ⅱ、Ⅲ情况的分别有93、25、266帧。通过分析可知,每个目标作物行基本对应1条最优线,可对目标作物行的缺株部位进行填充,填充的平均成功率为95.3%。表明本研究算法对不同缺株情况的玉米行均有较好填充效果,可为目标作物行中心线的拟合提供先验条件。

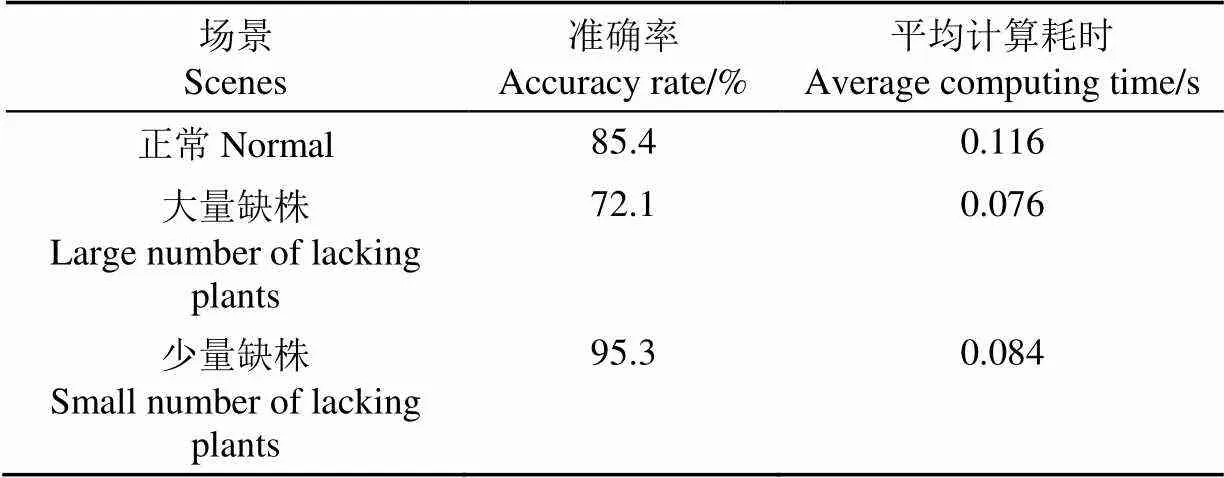

为量化分析缺株情况下本研究算法的可靠性,随机选取1 190帧玉米图像进行试验验证,其中包含正常图像431帧,大量缺株图像372帧,少量缺株图像387帧,检测结果如表1所示。针对正常、大量和少量缺株3种情况,中心线检测准确率分别为85.4%、72.1%和95.3%,平均准确率为84.2%,平均处理速度为每帧0.092 s。正常情况下相邻作物行间可能存在粘连现象,导致最优线的获取数增加,检测用时增加;大量缺株情况下存在无法获取定位点的现象,检测准确度随之下降;在少量缺株情况下作物行间距明显,定位点容易获取,因此检测准确度较高。通过试验验证,本文算法在大量及少量缺株情况下仍保持较高的准确度,表明本文算法在缺株玉米行中心线检测中具有较强的鲁棒性。

3.2 不同场景下算法适用性验证

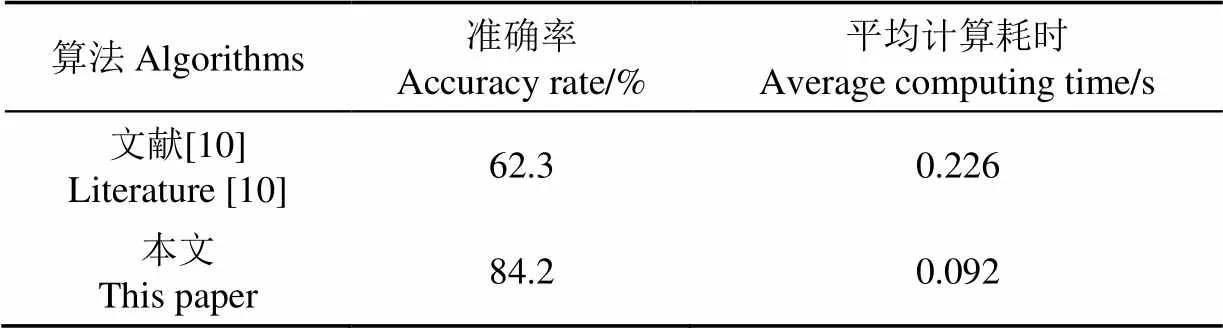

为进一步验证本算法对其他作物的适用性,选取不同类型作物进行中心线提取试验,并与文献[10]算法进行对比,结果如图8和表2所示。

表1 不同缺株情况下玉米行中心线的检测结果

由图8可知,本研究算法在作物行中心线检测精度上具有一定的优势,检测后的平均角度误差小于文献[10],且对不同种类的作物均有较好的效果。文献[10]在检测生长较密集的马铃薯及小麦图像时具有较好的检测效果,但对生长较稀疏的玉米图像中心线检测精度明显下降,误差超过本研究算法的检测结果。试验结果表明,本算法在不同作物环境中具有一定的适用性。

分析表2数据可知,由于文献[10]采用的算法是对全图作物密集区域进行聚类进而拟合作物行中心线,处理过程中容易将未连通的作物区域识别为作物行,当试验样本存在缺株现象较多时,该算法将较密集的作物区域进行聚类,导致聚类中心与实际作物行中心相差过大,拟合的作物行中心线随之偏离,提取作物行中心线平均准确率为62.3%,其平均耗时为0.226 s;本研究算法通过限制最优线的检测范围,节省了计算量,检测耗时较少,处理每帧图片平均耗时0.092 s,平均检测准确率为84.2%。对比可知,本研究算法步骤比较简单,且对农田环境依赖性不强,适用于多种缺株场景下的作物行中心线检测。

表2 文献[10]与本文算法对玉米行中心线提取结果

4 结 论

本研究以存在多种缺株情况的玉米作物行的检测和识别为研究内容,以期提取缺株情况下的作物行中心线。

1)采用限定作物行在HSV颜色空间中颜色范围的方法对图像进行二值化处理,通过形态学处理对图像进行去噪并填补作物行空洞。相较于超绿(Excess Green,ExG)算法,该算法减少了作物行间的粘连情况,用时也得到降低。

2)通过图像底部及中部设置的条状感兴趣区(Region of Interest,ROI)确定定位点,将穿过定位点获取的最优线与作物行区域融合,以此达到填充目标作物行缺株部位的效果。经过试验验证,该算法提高了对目标作物行缺株部位填充的准确率,适用于存在不同缺株情况的作物行区域。

3)最终采用在动态ROI内提取面积最大轮廓的方法来拟合作物行中心线。通过随机选取的玉米图像进行试验,表明本研究算法提取玉米行中心线的平均准确度为84.2%,满足在缺株情况下的农田环境中提取作物行中心线的要求,完善了传统算法面对缺株作物行分析的不足。本研究算法对计算量的要求较低,所述检测算法对应每帧图像的平均检测时间为0.092 s,满足无人驾驶农机田间作业时对玉米或其他作物实时提取作物行中心线的要求。

[1] 陈兵旗. 农田作业视觉导航系统研究[J]. 科技导报,2018,36(11):66-81.

Chen Bingqi. Study on vision navigation for field work[J]. Science & Technology Review, 2018, 36(11): 66-81. (in Chinese with English abstract)

[2] 韩树丰,何勇,方慧. 农机自动导航及无人驾驶车辆的发展综述[J]. 浙江大学学报:农业与生命科学版,2018,44(4):381-391.

Han Shufeng, He Yong, Fang Hui. Recent development in automatic guidance and autonomous vehicle for agriculture: A review[J]. Journal of Zhejiang University: Agriculture and Life Sciences Edition, 2018, 44(4): 381-391. (in Chinese with English abstract)

[3] 崔维,丁玲. 基于视觉导航和RBF的移动采摘机器人路径规划研究[J]. 农机化研究,2016,38(11):234-238.

Cui Wei, Ding Ling. Research on path planning for mobile picking robot based on visual navigation and RBF[J]. Journal of Agricultural Mechanization Research, 2016, 38(11): 234-238. (in Chinese with English abstract)

[4] 孟庆宽,何洁,仇瑞承,等. 基于机器视觉的自然环境下作物行识别与导航线提取[J]. 光学学报,2014,34(7):180-186.

Meng Qingkuan, He Jie, Qiu Ruicheng, et al. Crop recognition and navigation line detection in natural environment based on machine vision[J]. Acta Optica Sinica, 2014, 34(7): 180-186. (in Chinese with English abstract)

[5] 梁习卉子,陈兵旗,李民赞,等. 质心跟踪视频棉花行数动态计数方法[J]. 农业工程学报,2019,35(2):175-182.

Liang Xihuizi, Chen Bingqi, Li Minzan, et al. Dynamic counting method of cotton rows in video based on centroid tracking[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(2): 175-182. (in Chinese with English abstract)

[6] 张雄楚,陈兵旗,李景彬,等. 红枣收获机视觉导航路径检测[J]. 农业工程学报,2020,36(13):133-140.

Zhang Xiongchu, Chen Bingqi, Li Jingbin, et al. Path detection of visual navigation for jujube harvesters[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(13): 133-140. (in Chinese with English abstract)

[7] Gongal A, Silwal A, Amatya S, et al. Apple crop-load estimation with over-the-row machine vision system[J]. Computers and Electronics in Agriculture, 2016, 120: 26-35.

[8] 宋宇,刘永博,刘路,等. 基于机器视觉的玉米根茎导航基准线提取方法[J]. 农业机械学报,2017,48(2):38-44.

Song Yu, Liu Yongbo, Liu Lu, et al. Extraction method of navigation baseline of corn roots based on machine vision[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(2): 38-44. (in Chinese with English abstract)

[9] 彭顺正,坎杂,李景彬. 矮化密植枣园收获作业视觉导航路径提取[J]. 农业工程学报,2017,33(9):45-52.

Peng Shunzheng, Kan Za, Li Jingbin. Extraction of visual navigation directrix for harvesting operation in short-stalked and close-planting jujube orchard[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(9): 45-52. (in Chinese with English abstract)

[10] Jiang G Q, Wang X J, Wang Z H, et al. Wheat rows detection at the early growth stage based on Hough transform and vanishing point[J]. Computers and Electronics in Agriculture, 2016, 123: 211-223.

[11] Meng Q H, Qiu R C, He J, et al. Development of agricultural implement system based on machine vision and fuzzy control[J]. Computers and Electronics in Agriculture, 2015, 112: 128-138.

[12] 姜国权,王志衡,赵翠君. 基于已知点的作物行检测方法[J]. 应用基础与工程科学学报,2013,21(5):983-990.

Jiang Guoquan, Wang Zhiheng, Zhao Cuijun. Crop row detection method based on known points[J]. Journal of Applied Basic and Engineering Science, 2013, 21(5): 983-990. (in Chinese with English abstract)

[13] Zhang Q, Chen S J, Li B. A visual navigation algorithm for paddy field weeding robot based on image understanding[J]. Computers and Electronics in Agriculture, 2017, 143: 66-78.

[14] 陈子文,李伟,张文强,等. 基于自动Hough变换累加阈值的蔬菜作物行提取方法研究[J]. 农业工程学报,2019,35(22):314-322.

Chen Ziwen, Li Wei, Zhang Wenqiang, et al. Vegetable crop row extraction method based on accumulation threshold of Hough transformation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(22): 314-322. (in Chinese with English abstract)

[15] Hamuda E, Glavin M, Jones E. A survey of image processing techniques for plant extraction and segmentation in the field[J]. Computers and Electronics in Agriculture, 2016, 125: 184-199.

[16] 刘琼,史诺. 基于Lab和YUV颜色空间的农田图像分割方法[J]. 国外电子测量技术,2015,34(4):39-41,57.

Liu Qiong, Shi Nuo. Farmland image segmentation method based on Lab and YUV color space[J]. Foreign Electronic Measurement Technology, 2015, 34(4): 39-41, 57. (in Chinese with English abstract)

[17] 李景彬,陈兵旗,刘阳,等. 采棉机视觉导航路线图像检测方法[J]. 农业工程学报,2013,29(11):11-19.

Li Jingbin, Chen Bingqi, Liu Yang, et al. Detection for navigation route for cotton harvester based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2013, 29(11): 11-19. (in Chinese with English abstract)

[18] 亢洁,马振. 基于轮廓查找与线扫描的作物行检测算法[J]. 科学技术与工程,2019,19(20):273-277.

Kang Jie, Ma Zhen. Detection algorithm of crop row based on contour searching and line scanning[J]. Science, Technology and Engineering, 2019, 19(20): 273-277. (in Chinese with English abstract)

[19] 曾宏伟,雷军波,陶建峰,等. 低对比度条件下联合收割机导航线提取方法[J]. 农业工程学报,2020,36(4):18-25.

Zeng Hongwei, Lei Junbo, Tao Jianfeng, et al. Navigation line extraction method for combine harvester under low contrast conditions[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(4): 18-25. (in Chinese with English abstract)

[20] 杨洋,张博立,查家翼,等. 玉米行间导航线实时提取[J]. 农业工程学报,2020,36(12):162-171.

Yang Yang, Zhang Boli, Zha Jiayi, et al. Real-time extraction of navigation line between corn rows[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(12): 162-171. (in Chinese with English abstract)

[21] 刘琼,罗晴,彭绍武. 车载热成像行人检测ROI提取方法[J]. 东北大学学报:自然科学版,2020,41(8):1083-1090.

Liu Qiong, Luo Qing, Peng Shaowu. ROI extraction for vehicular thermal infrared pedestrian detection[J]. Journal of Northeastern University: Natural Science Edition, 2020, 41(8): 1083-1090. (in Chinese with English abstract)

[22] 张强. 最小二乘法原理及其处理方法的探讨[J]. 计量与测试技术,2020,47(4):75-76.

Zhang Qiang. Exploring for the principle of least square method and its treatment method[J]. Metrology and Testing Technology, 2020, 47(4): 75-76. (in Chinese with English abstract)

[23] 李源韬. 基于K-means与区域生长的ROI图像分割算法[D]. 南昌:南昌大学,2015.

Li Yuantao. ROI Algorithm for Image Segmentation Based on Region Growing and K-means[D]. Nanchang: Nanchang University, 2015. (in Chinese with English abstract)

[24] 陈兵旗,机器视觉技术及应用实例详解[M]. 北京:化学工业出版社,2014.

[25] Choi K H, Han S K, Han S H, et al. Morphology-based guidance line extraction for an autonomous weeding robot in paddy fields[J]. Computers and Electronics in Agriculture, 2015, 113: 266-274.

[26] Jiang GQ, Wang ZH, Liu HM. Automatic detection of crop rows based on multi-ROIs[J]. Expert Systems with Applications, 2015, 42(5): 2429-2441.

[27] 乔诗展. 基于OpenCV的机器人目标检测候选区域生成算法[J]. 科技创新与应用,2020(17):1-5,10.

Qia Shizhan. Opencv-based algorithm for generating candidate regions for robot target detection[J]. Science and Technology Innovation and Application, 2020(17): 1-5, 10. (in Chinese with English abstract)

[28] 赵腾,野口伸,杨亮亮,等. 基于视觉识别的小麦收获作业线快速获取方法[J]. 农业机械学报,2016,47(11):32-37.

Zhao Teng, Noboru Noguchi, Yang Liangliang, et al. Fast edge detection method for wheat field based on visual recognition[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(11): 32-37. (in Chinese with English abstract)

[29] 王春雷,卢彩云,陈婉芝,等. 基于遗传算法和阈值滤噪的玉米根茬行图像分割[J]. 农业工程学报,2019,35(16):198-205.

Wang Chunlei, Lu Caiyun, Chen Wanzhi, et al. Image segmentation of maize stubble row based on genetic algorithm and threshold filtering noise[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(16): 198-205. (in Chinese with English abstract)

[30] 易诗,李俊杰,贾勇. 基于红外热成像的夜间农田实时语义分割[J]. 农业工程学报,2020,36(18):174-180.

Yi Shi, Li Junjie, Jia Yong. Real-time semantic segmentation of farmland at night using infrared thermal imaging[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(18): 174-180. (in Chinese with English abstract)

[31] 姜国权,杨小亚,王志衡,等. 基于图像特征点粒子群聚类算法的麦田作物行检测[J]. 农业工程学报,2017,33(11):165-170.

Jiang Guoquan, Yang Xiaoya, Wang Zhiheng, et al. Crop rows detection based on image characteristic point and particle swarm optimization-clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(11): 165-170. (in Chinese with English abstract)

[32] 蔡道清,李彦明,覃程锦,等. 水田田埂边界支持向量机检测方法[J]. 农业机械学报,2019,50(6):22-27,109.

Cai Daoqing, Li Yanming, Qin Chengjin, et al. Detection method of boundary of paddy fields using support vector machine[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(6): 22-27, 109. (in Chinese with English abstract)

Extraction algorithm of the center line of maize row in case of plants lacking

Li Xiangguang, Zhao Wei※, Zhao Leilei

(,,471000,)

Identification of crop centerlines has been one of the most essential links in the environmental perception, particularly for the detection of driving paths during operation for the emerging unmanned agricultural machinery at present. However, the current detection of centerlines presents a low accuracy in the extraction of lacking rows for the maize seedling. In this study, an algorithm was proposed to extract the centerlines of maize rows in the lacking seedlings. The collection date was in July 2020, and the experimental subjects were maize seedlings. The height of the seedling was 0.3-0.4 m and the seedling spacing was 0.2-0.3 m at the time of image collection. The height of the camera was 1.5 m and the pitch angle was about 30°. The images of maize seedling rows were also collected in different plots of the experimental fields to ensure the universality of samples. Firstly, the range of HSV color components was limited to segment the seedlings and the background. The average time of threshold processing per frame of the image was 0.013 s. Morphological processing was utilized to fill the holes in the crop areas of denoised images. Secondly, a strip Region of Interest (ROI) was set in the horizontal position at the bottom and middle of the images. The barycenter was extracted from the seedlings contour located in the ROI as the locating points. Specifically, the upper endpoint was determined by the fixed step size in the pixel point of the first line of the image. The row area of the crop within a limited range was scanned using a straight line through the locating points and upper endpoint, where the line that crossed the most seedlings was the optimal line of target seedlings. As such, the contour feature of the seedling was strengthened, and the lack of seedling in the bottom area was filled, when the optimal line was fused with the seedling area. Because the algorithm was used to extract the crop centerline under different conditions of seedlings lacking, the optimal lines at the bottom and the middle of rows were fused with the region to fill the lacking part of the row. Finally, the dynamic ROI was set, where the fitting profile of the maximum area within the region was the target centerlines of seedling rows. The experimental results showed that the algorithm fully met the extracting requirement for the centerlines of seedlings in the field with seedling deficiency, compared with the traditional. It was also utilized to deal with the low detection rate when there was a seedling deficiency. Experimental verification was also performed on 1 190 frames of maize seedlings images for the reliability of the algorithm in the lack of seedlings. The results showed that this algorithm required a relatively small amount of computation. Specifically, the average accuracy rate was 84.2%, and the average detection time of each frame was 0.092 s, indicating a better filling effect on the maize seedlings row with different crop lacked conditions. Consequently, the improved algorithm presented strong robustness and high accuracy for the recognition rate when seedlings were lacking. The finding can provide sound theoretical support to the operation of unmanned agricultural machinery in the field environment of seedlings lacking.

algorithms; image processing; machine vision; maize; centerlines; image denoising; dynamic ROI

李祥光,赵伟,赵雷雷. 缺株玉米行中心线提取算法研究[J]. 农业工程学报,2021,37(18):203-210.

10.11975/j.issn.1002-6819.2021.18.024 http://www.tcsae.org

Li Xiangguang, Zhao Wei, Zhao Leilei. Extraction algorithm of the center line of maize row in case of plants lacking[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(18): 203-210. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.18.024 http://www.tcsae.org

2020-09-26

2021-04-02

河南省科技攻关项目(202102210278)

李祥光,研究方向为机器视觉。Email:nourixiix@163.com

赵伟,博士,副教授,研究方向为无人驾驶、机器视觉。Email:zhaowei@haust.edu.cn

10.11975/j.issn.1002-6819.2021.18.024

TP391.41

A

1002-6819(2021)-18-0203-08