基于单目立体视觉的焊缝粗定位方法

陆苗,王化明,邰凤阳,朱雄伟,易文韬

(南京航空航天大学 机电学院,江苏 南京 210016)

0 引言

基于视觉的焊缝引导和跟踪技术是未来智能化焊接技术的主要发展方向,而焊缝粗定位是实现焊缝精准引导和跟踪的前提[1-2]。目前基于视觉的焊缝粗定位方法主要包括常规立体视觉法、在线模型匹配法、视觉伺服控制法、线激光传感器扫描法等。

常规立体视觉方法[3-5]在实施过程中需多次调整相机位置,且存在一定的盲目性,需要较多的先验性工作。在线模型匹配法[6]需预先知道焊缝形式,对焊件周边环境要求较高且智能获取焊缝的二维信息。视觉伺服控制法[7]需连续人工干预,根据图像处理结果调整机器人位姿逼近焊缝,操作较为繁琐。线激光传感器扫描法[8]分为人工示教扫描、从三维模型中提取路径扫描两种,均存在操作繁琐、耗时长、扫描过程的安全性难以保证等问题。

针对以上问题,本文提出一种基于单目立体视觉的焊缝粗定位方法。通过沿焊缝布置发光条以削弱周围环境对粗定位方法的限制;通过控制机械臂带动相机精确移动,避免常规双目立体视觉的多相机位姿标定和立体视觉标定过程。求取方法简单、高效,对环境的适应性得到提高。

1 焊缝粗定位视觉系统

焊缝粗定位的目的是在焊接实时引导和跟踪前确定某条焊缝相对机器人的位姿,焊缝的定位与坡口形式无关,因此可用数学曲线来描述焊缝模型。焊缝在机器人基坐标系下的位姿包括平移和旋转两部分,用齐次变换来表示则为

(1)

其中:[n1,n2,n3]T、[O1,O2,O3]T、[a1,a2,a3]T分别为x、y、z方向的旋转变换矢量;[t1,t2,t3]T为平移交换矢量,共包含6个独立参数。粗定位的目标即确定所有未知参数的值。

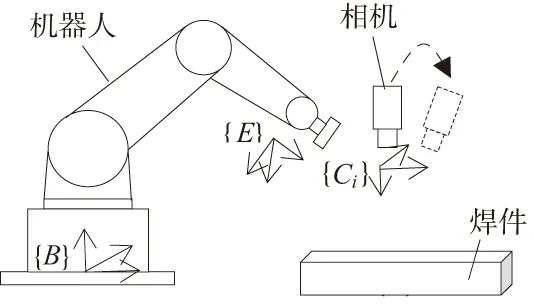

基于单目立体视觉的焊缝粗定位系统包括单目相机、机器人和目标焊件,其中单目相机负责视觉图像的采集、机器人系统由机器人本体和控制箱组成,用来控制机器人带动相机运动。

系统工作示意图如图1所示,{B}为机器人基坐标系,{E}为机器人末端坐标系,{Ci}、{Cj}分别为i、j位置处的相机坐标系。根据相机小孔成像原理,空间点P(X,Y,Z)在i、j两个位置处相机的成像点分别为Pi(ui,vi)、Pj(uj,vj),则满足以下方程:

图1 焊缝粗定位视觉系统示意图

(2)

其中Mi、Mj分别为相机在i、j位置处的投影矩阵。

2 粗定位视觉系统标定

2.1 单目相机标定

相机标定的目的是利用空间物体上点的三维坐标与它在图像上对应点之间的对应关系来确定相机内、外部参数。采用张正友平面标定[9],具体标定步骤如下:

1)固定单目相机位置不变;

2)在相机视野范围内,任意移动和转动标定板,控制相机拍摄15张左右的标定板图像;

3)检测和标记所有标定板图像的特征点;

4)求解单目相机内外参数矩阵。

标定得到的具体相机参数如表1所示。

表1 单目相机标定结果

2.2 手眼标定

手眼标定的目的是获取机器人坐标系和相机坐标系的关系,从而将视觉识别的结果转移到机器人坐标系中[9]。焊缝粗定位视觉定位系统采用眼在手上(eye-in-hand)的布置形式[10],具体标定步骤如下:

1)在相机视野范围内固定合适大小的标定板;

2)控制相机以不同的姿态获取15~20张标定板图像,并记录对应的机械臂末端位姿矩阵;

3)根据标定板图像、机械臂末端位姿矩阵、相机标定参数,求解方程AiX=XBi。其中X为相机坐标系到末端坐标系的转换矩阵;Ai和Bi分别为相机、机械臂末端坐标系运动前、后的转换矩阵。

坐标系转换矩阵可分解为旋转矩阵R和平移矩阵t两部分,可将AiX=XBi方程分解整理为下式:

(3)

其中:Rx、tx为待求参数;Ra、ta为相机坐标系两次运动前后的参数,可通过标定相机外参矩阵求出;Rb、tb为机器人末端坐标系两次运动前后的参数,可从机器人控制器读取。

3 焊缝粗定位方法

基于单相机的立体视觉测量技术来实现焊缝粗定位的流程包括:

1)控制机器人以两个不同位姿采集焊缝发光条图像,并记录对应的机器人末端坐标系位姿矩阵;

2)提取焊缝发光条图像中心线;

3)根据立体视觉三维重建模型重建焊缝点、直线或圆弧焊缝。

3.1 发光条图像中心线提取

使用二维零均值离散高斯函数式(4)作为平滑滤波器对图像进行平滑去噪,在尽量保留图像细节特征的条件下抑制图像噪声。

(4)

对高斯滤波后的发光条图像采用基于局部的自适应图像分割算法进行分割。该算法通过对图像按列扫描求出每列的最大灰度值gmax,并根据发光条图像的灰度直方图设定偏移量ΔT,对每列像素值进行如下操作:

(5)

其中f(x,y)、g(x,y)分别为分割处理前、后图像在当前像素点(x,y)的灰度值。

使用灰度质心法提取发光条的亚像素级中心坐标。将灰度值作为质量处理,按行或者列遍历图像,以灰度质心点来代表该截面发光条中心点位置,用公式表示如下:

(6)

其中:y为图像每列中心点的纵坐标值;g(x,y)为点(x,y)处的灰度值。

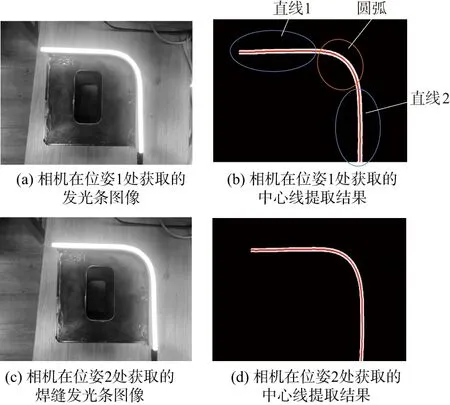

为了进一步提高发光条中心坐标提取的精度,在按式(6)初步提取出发光条各截面中心坐标后,通过计算相邻中心点间的斜率,根据斜率突变来判定提取的中心点是否存在较大的偏离,若提取出的中心点偏离较大,则根据前后像素点的斜率对该点进行优化,调整该点位置。提取效果图如图2所示。

图2 焊缝中心线提取效果图

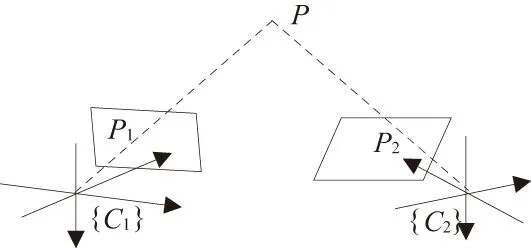

3.2 计算焊缝点空间坐标

焊缝可由多个离散点连接而成,因此在获取发光条图像起终点像素坐标的基础上,基于立体视觉空间点重建模型(图3)可计算出发光条的起点、终点空间坐标。焊缝粗定位视觉系统在控制相机以两次不同位姿获取同一焊缝发光条图像的过程中,考虑发光条自身厚度d对焊缝粗定位z向精度的影响,设定世界坐标系与相机位于位姿1时的相机坐标系重合,并尽量保持此位姿下的相机与焊缝所在平面垂直,对世界坐标系下焊缝的z向进行修正,则有

图3 空间点三维重建模型

(7)

经机器人控制器获取相机运动前后的末端位姿矩阵,结合手眼标定和相机内参矩阵,可确定相机在两次位姿下的投影矩阵,记作M1、M2,则有:

(8)

(9)

展开并整理式(7)、式(8)可获得有关空间点Pw的线性方程:

(10)

由最小二乘法求解式(10)计算出像素点对应的世界坐标Pw(Xw,Yw,Zw),根据式(7)对Zw进行修正,并利用下式求取焊缝点在机器人基坐标系下的坐标:

(11)

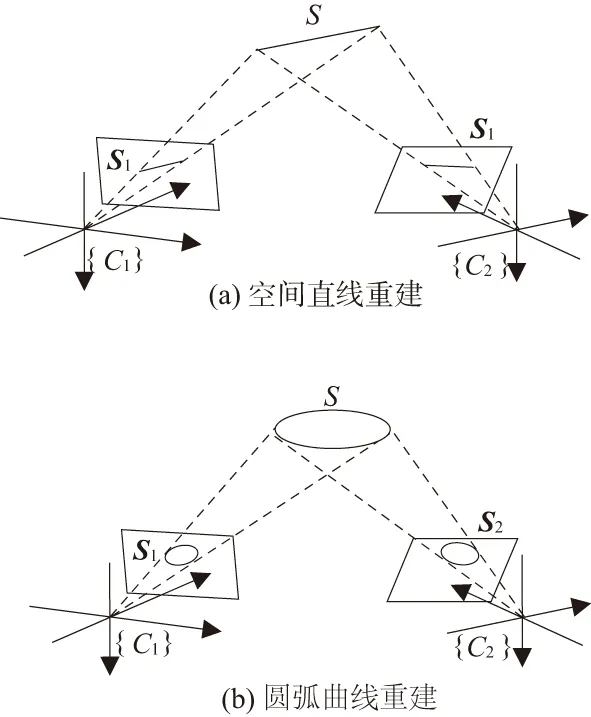

3.3 计算直线和圆弧焊缝空间方程

确定焊缝起终点坐标信息后,基于立体视觉模型的线重建方法[11]可获得焊缝空间直线和圆弧方程,三维重建模型如图4所示。

图4 空间直线和圆弧三维重建模型

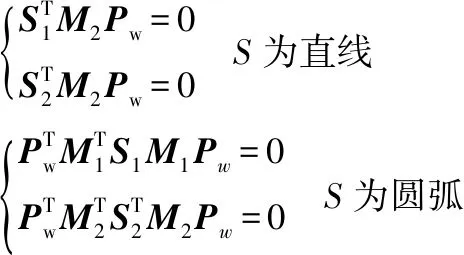

空间直线和圆弧的三维重建等同于求解两空间平面和锥面的交线问题。假设S1、S2分别为空间直线或圆弧S在两次不同位姿相机上的投影,通过最小二乘法拟合中心点求得Si、Sj的方程,可表示为:

(12)

其中:u1(u1,v1,1)为成像直线或圆弧S1、S2上点的齐次坐标;S1、S2为成像直线或圆弧S1、S2方程系数构成的对称矩阵。

由空间点投影关系式(8)、式(9)结合式(12)可得:

(13)

通过求解式(13)即可获得直线和圆弧焊缝的空间方程。

4 试验结果分析

图5 发光条中心线提取结果图

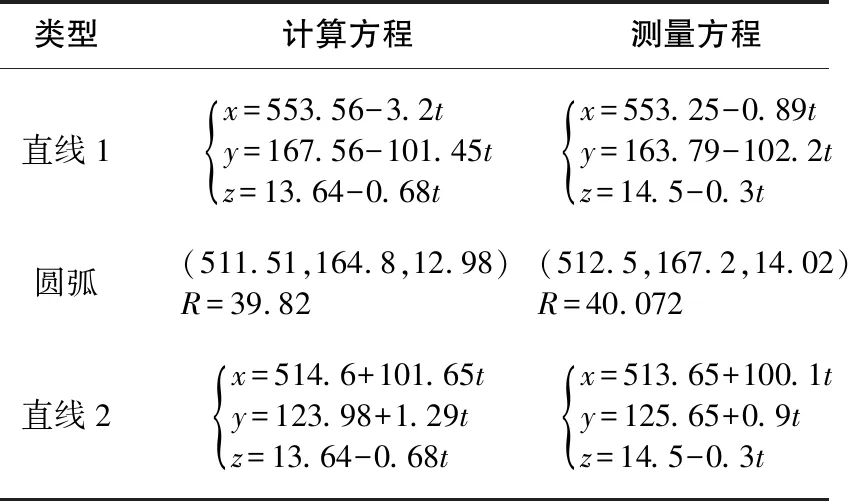

通过人工示教机器人跟踪焊缝,记录焊缝点坐标并拟合获取焊缝空间方程作为实际测量结果。将基于焊缝粗定位视觉系统计算出焊缝起点、终点坐标和空间方程与实际测量结果进行对比,如表2、表3所示。

表2 起点、终点坐标值对比 单位:mm

表3 焊缝曲线方程对比

将坐标点的计算值与测量值在x、y、z三个方向的平均偏差E和计算点与测量点间的平均距离D作为衡量焊缝粗定位精度的指标,如下式:

(14)

(15)

坐标的计算值与测量值在三个方向的平均偏差约为1.27 mm,计算坐标与测量坐标的平均距离约为2.031 mm。实验表明,该方法能够实现焊缝跟踪前的粗定位,可以满足一定的精度要求。

5 结语

本文提出了一种基于通用双目测量模型的单目双工位三维测量方法来实现焊缝粗定位。沿着焊缝布置发光条,控制单目相机以两个不同位姿采集图像,利用灰度质心法提取发光条图像中心线,基于立体视觉模型重建焊缝特征点和焊缝空间方程,获得焊缝在机器人基坐标系的粗定位信息。

该方法通过沿焊缝布置发光条,有效降低了环境噪声对图像处理的影响,提高了粗定位方法的精度和适应性,可满足焊缝跟踪前的粗定位需求。