基于TMU-Net网络的苹果果心分割方法

刘长勇,李思佳,史 慧,查志华,邓红涛

基于TMU-Net网络的苹果果心分割方法

刘长勇1,李思佳3,史 慧2,查志华2,邓红涛2※

(1. 新疆农垦科学院,石河子 832000;2.石河子大学机械电气工程学院,石河子 832000;3. 中山大学电子与通信工程学院,深圳 510275)

针对苹果内在品质检测过程中传统测量果心大小方法效率低、准确性差等问题,该研究提出一种基于TMU-Net网络自动分割果心的方法,将Transformer编码器融入U-Net网络结构中,构建改进U型卷积网络TMU-Net模型。模型由特征提取模块、特征处理模块、解码器、特征拼接模块组成,以VGG-16前13层作为主干特征提取网络,在跳跃连接中叠加多重残差空洞卷积(Multiple Residual Dilated Convolution,MRDC)模块,增大感受野的同时增强了模型对底层特征提取能力。采用数据增强技术对果心数据集扩充后,利用迁移学习方法冻结特定的网络层,对TMU-Net模型进行训练。试验结果表明:引入迁移学习并使用最佳训练方式使模型分割精确率提高了22.48个百分点;TMU-Net网络模型在果心分割任务中实现了96.72%的精确率,与U-Net、PSPNet、DeeplabV3+网络对比,精确率分别提升了14.28、9.98、7.15个百分点。该方法能够精准、有效地实现果心分割,可为实现苹果内在品质智能检测提供参考。

模型;图像分割;果心分割;TMU-Net网络;多重残差空洞卷积;Transformer;迁移学习

0 引 言

苹果果心比例是评价苹果内在品质的重要指标[1]。目前,果心数据主要依靠人工测量获取,这种方法不仅工作量大、效率低,而且苹果果心形状不规则、边缘凹凸等因素导致手工测量误差大,难以满足当前发展的需求。

随着计算机理论和硬件设备的快速发展,机器视觉技术在工业中取得了广泛应用[2]。刘浩等[3]通过转换色彩空间,选取合适的色度阈值实现果心区域分割,但是图像中往往存在一些不确定的噪声点,单一的阈值分割精度较低。胡智元[4]通过Canny边缘检测算法、霍夫变换特征提取算法、梯度下降算法等多种方法结合实现水果位置信息的计算,但是水果的不规则形状和表皮颜色的深浅对定位效果影响较大。上述方法只能提取图像的低级特征,难以准确提取出边缘细节,识别精度有限。

近年来,深度学习技术在图像分割领域的应用取得了显著成功[5-7]。Chen等[8]提出的DeeplabV3+模型通过在编码器中使用大量的空洞卷积,使每个卷积输出都包含了较大范围的信息。U-Net[9]是基于编码器与解码器结构的网络,由主干特征提取、加强特征提取、跳跃连接(skip-connection)三部分组成,能够融合低层次和高层次的语义信息,近年来被研究者优化后广泛应用于农业图像分割领域[10-11]。在模型结构融合中,Ge等[12]提出将不同分辨率的图像作为网络的输入,使用空洞卷积代替U-Net中间3层的标准卷积,在膀胱癌数据集中取得了较高精度,为U-Net模型优化提供了新思路。Maji等[13]通过在跳跃连接中引入注意门(Attention gates),只将相关信息进行特征拼接,并采用引导解码器(guided decoder)增强每一层的特征表示能力。Song等[14]将可分离卷积融合在SegNet网络中,并结合条件随机场模型对向日葵遥感图像进行倒伏识别,取得了较好的识别效果。

虽然卷积神经网络(Convolutional Neural Network,CNN)有较强的特征表示能力,但是由于卷积运算的固有局部性,其在纹理和形状差异较大的目标结构中表现出的性能较弱,为了克服这种局限性,现有的研究提出建立基于注意力机制的卷积神经网络。Transformer[15]最初应用于自然语言处理(Natural Language Processing,NLP)领域,与之前基于CNN的方法不同,其采用完全依赖于注意力机制的卷积算子,具有强大的全局信息获取能力,在各种图像识别任务中达到甚至超越了现有网络模型[16-17]。已有学者展开了在卷积神经网络中融合Transformer[15]结构的研究。贾伟宽等[18]针对绿色目标果实检测,提出一种基于Transformer的优化模型,将卷积神经网络提取到的特征输入Transformer编码-解码器,可并行处理多个对象,提高了检测效率。针对动物骨骼关键点检测,张飞宇等[19]通过在HRNet模型中引入Transformer编码器和多尺度信息融合模块,提高了网络高维特征提取能力,大大提升了检测效率和精度。安小松等[20]将Transformer应用于缺陷柑橘分选,通过预测果实路径指导机器手臂准确抓取缺陷柑橘,实现快速分选。以上研究为开展Transformer融合CNN应用于苹果果心的精确分割提供了参考和可行性依据。

因此,本研究提出了一种融合Transformer的改进U型卷积网络结构,通过Transformer编码器增强网络的全局信息获取能力,改善卷积运算的固有局部性,并使用VGG-16网络[21]的前13层作为主干特征提取网络,加强对苹果图像细节特征的提取;在跳跃连接路径中引入多重残差空洞卷积(Multiple Residual Dilated Convolution,MRDC),通过叠加不同空洞率的卷积操作提取多尺度信息,从而减小来自编码器和解码器的特征之间存在的语义差异;训练过程中通过加载预训练权重并在训练前期冻结部分层的方式进行迁移学习,以期提高果心分割精度,为苹果去心研究提供新思路。

1 材料与方法

1.1 数据采集与数据集制作

1.1.1 图像采集

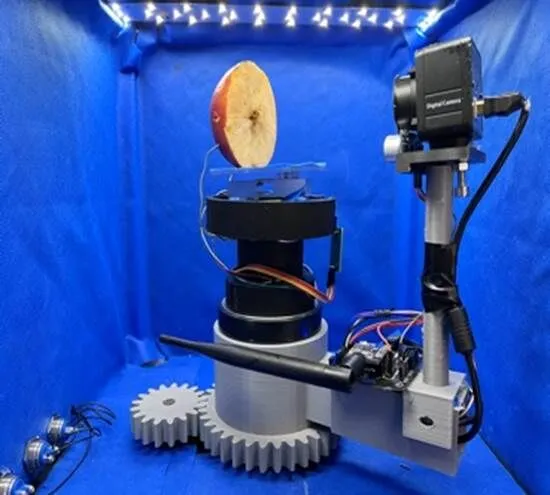

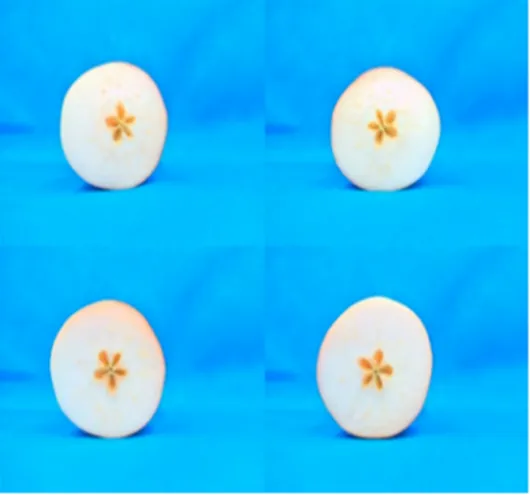

选取红富士、嘎拉、黄元帅三类苹果(产地:新疆)。使用配有索尼IMX377感光芯片的KS12A884摄像头作为采集设备,最大分辨率为3 840×2 880(像素)。依据NY/T 2316—2013苹果评价指标规范[1],沿苹果最大横径处切开,得到两个样本。如图1所示,采集时将样本放置于大小为50 cm×50 cm×50 cm(长×宽×高)的影棚中,样本横切面距摄像头12 cm且与摄像头平行。图像采集过程中每个苹果样本旋转90°进行两次拍摄,并将图像大小统一调整为800×600(像素),最终得到的苹果样本图像如图2所示。

图1 采集设备

图2 苹果图像

1.1.2 数据增强

训练深度学习网络模型参数需要足够的样本数据。因此,本文对采集的311幅样本图像随机采用平移、水平翻转、垂直翻转和高斯模糊的方法来进行数据增强,以提高模型的泛化能力[22]。通过数据增强,最终共获得933幅样本图像。

数据增强过程中,每张原始图片会输出两张不同的增强效果图,并且每种增强方式被触发的概率均为25%。进行平移变换时,随机产生平移方向,但平移的距离不超过100像素。高斯模糊处理时,随机添加均值为0,方差为0.01的高斯白噪声。

1.1.3 数据集制作

本研究采用VOC数据集格式,使用图像标注工具Labelme标注果心区域。标注完成后得到的类别标签、坐标等标注信息存为.json文件,经处理后生成8位彩色标签图,其中每个像素点的值代表了该像素所属的种类。将扩充后的样本图像依据留出法[22]按7∶2∶1的比例划分,分别得到训练集、验证集和测试集。

1.2 改进U型卷积网络TMU-Net

U-Net[23]网络是典型的“U型”编码-解码架构,其编码器和解码器之间引入了跳跃连接,能够融合不同层次的语义信息,从而提升网络性能。但简单的跳跃连接忽略了特征之间存在的语义差异,导致其对形状不规则且拐角尖锐的果心分割效果较差,无法精确分割果心边缘,且难以识别图像中的模糊目标。

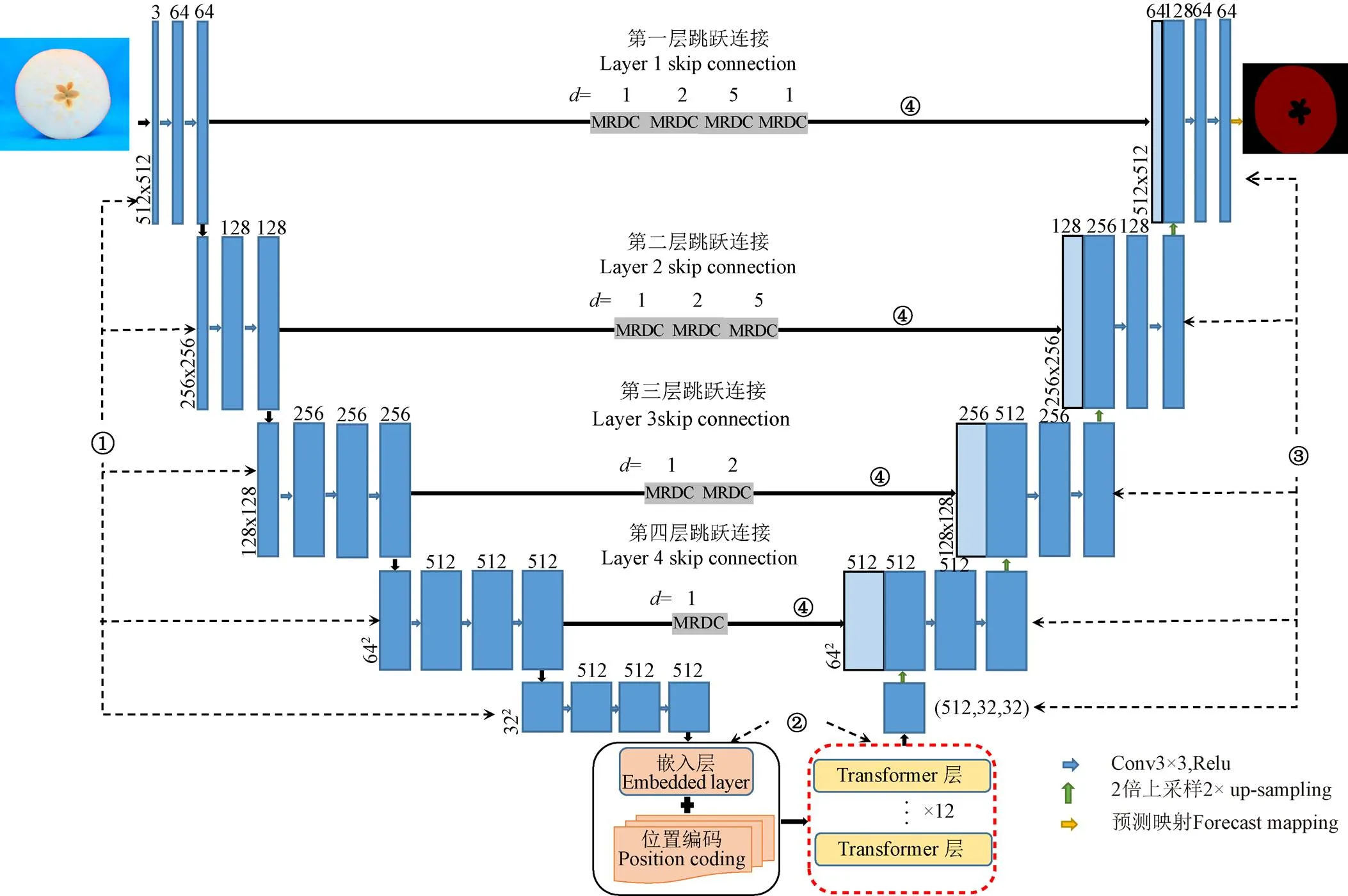

针对上述问题,本研究提出一种融合Transformer改进U型卷积网络TMU-Net(Transformer Multiple U Networks),该模型以VGG-16的前13层作为特征提取网络,引入Transformer编码器进行特征处理,增强网络的全局特征提取能力,在解码路径中,对特征图进行上采样操作,并在跳跃连接中引入多重残差空洞卷积(MRDC),以弥补编码器和解码器特征之间存在的语义差异,最后使用预测映射函数对卷积层的输出进行像素分类,获得分割结果。

1.2.1 TMU-Net网络结构

TMU-Net主要由4部分组成:特征提取模块、特征处理模块、解码器、特征拼接模块。网络结构如图3所示。

特征提取模块:VGG-16中13个卷积层均采用大小为3×3的卷积核,5个池化层均采用2×2的池化核,最后为3个全连接层,其结构与U-Net的编码结构相似。本研究中对VGG-16网络进行裁剪,仅保留前13个卷积层作为特征提取网络,并使用其在ImageNet数据集中的预训练权重,帮助网络进行特征学习。

注:①:特征提取模块;②:特征处理模块;③:解码器;④:特征拼接模块;d:空洞率;MRDC:多重残差空洞卷积。

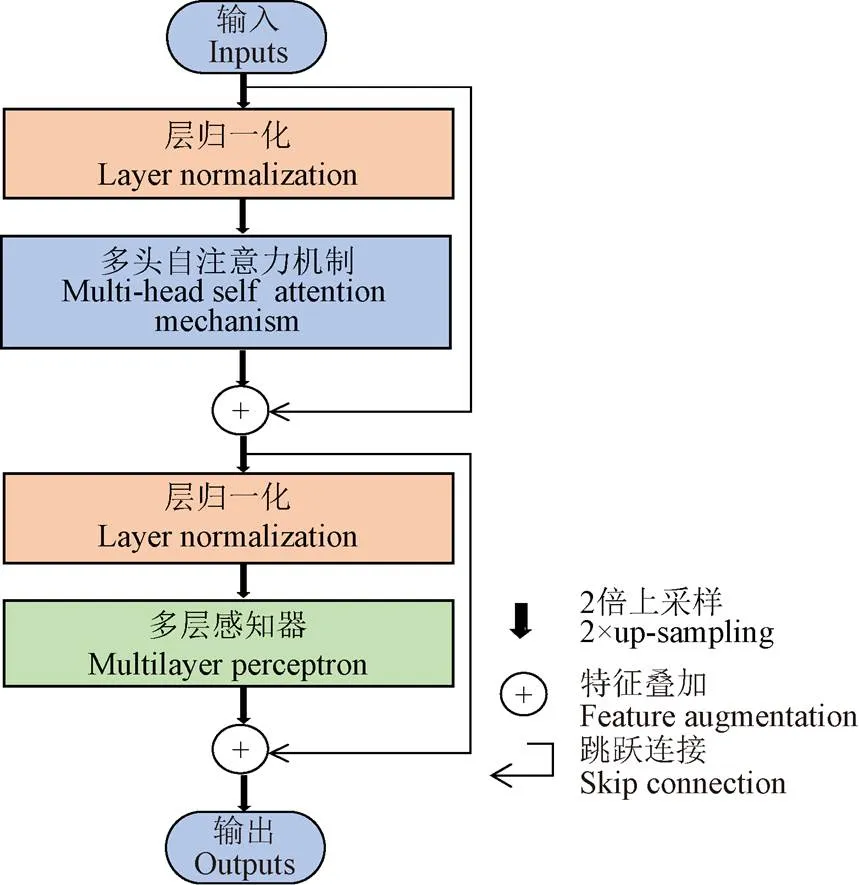

图4 Transformer层结构

解码器:在编码器中卷积和池化操作将图像进行降维,压缩图像分辨率,导致部分细节信息损失。解码路径中,通过两倍上采样在一定程度上补全图像信息,使图像恢复至原始尺寸以便对每一个像素点进行分类。

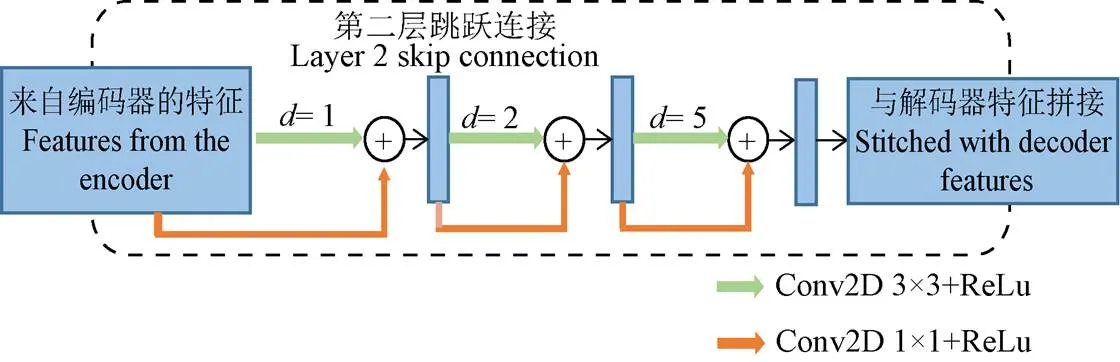

特征拼接模块:在U-Net以及类似的U型体系结构中,跳跃连接将图像的细粒度特征与抽象特征进行拼接,传递丢失的空间信息。然而来自编码器的特征是较为原始的,来自解码器的特征则是经过网络深层计算得到的,二者之间存在语义差异,直接将两组不兼容的特征进行拼接会在网络学习过程中产生不一致性,从而影响最后的预测结果。为了解决上述问题,本研究重新设计了跳跃连接,如图4所示,通过多重残差空洞卷积(MRDC)对来自编码器的特征进一步计算处理,与对应的解码器特征进行拼接。空洞卷积[24]扩大了卷积核的感受野,通过空洞率调整卷积核中非零值之间的间隔数量,卷积核大小计算式为

=·(-1)+1 (1)

式中为空洞卷积的卷积核尺寸;为空洞率;为原始卷积核尺寸。由于空洞卷积引入了0值,大小为的卷积区域实际参与计算的像素点仅有个,因此空洞卷积只能以网格形式提取图像信息,破坏了局部信息的连续性。为了减小上述问题对分割效果的影响,本研究叠加使用不同的空洞率,使其能覆盖更多的底层特征,其中空洞率的组合采用混合膨胀卷积(Hybrid Dilated Convolution,HDC)[25]中的组合要求。

为了弥补拼接特征之间的语义差异,不同跳跃连接路径上卷积块的个数随着编码器深度的减小而增加。同时在卷积块中引入1×1卷积作为残差连接,使网络训练更加容易。为了弥补拼接特征之间存在的语义差异,不同跳跃连接路径上的卷积块个数随着编码器深度的减小而增加,如图5所示,第四层的编码器特征得到的计算处理较多,因此仅使用一个MRDC模块,而第一层的编码器特征得到的计算处理较少,需使用多个MRDC模块进一步处理,从而使网络达到更好的性能。

图5 TMU-Net中第二个跳跃连接结构

综上所述,TMU-Net模型以VGG-16网络的前13层作为特征提取网络,用于捕获低层次细节特征,Transformer编码器能增强网络的全局特征提取能力,弥补卷积操作的局部性,引入多重残差空洞卷积后的跳跃连接能够减小拼接特征之间存在的语义差异,最终完成果心分割。

1.2.2 构建损失函数

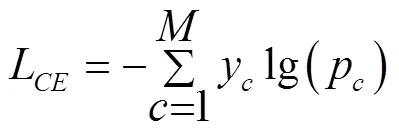

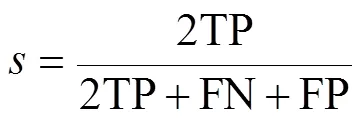

试验中采用交叉熵损失(Cross Entropy Loss)与Dice Loss结合作为模型的损失函数。交叉熵损失函数的计算公式为

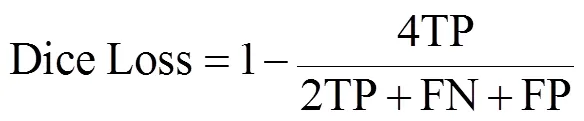

式中L为交叉熵损失;是样本的类别个数;y仅有0和1两种取值,若样本类别与当前类别一致,y取1,否则y取0;p为当前样本预测属于类的概率。Dice Loss最早由Milletari等[26]提出,用于评价样本的相似性,被广泛应用于图像分割领域。Dice Loss的计算与Dice系数有关,Dice系数用来度量集合相似度,在分割任务中其表达式为

式中为Dice系数;TP、FN、FP分别代表真阳性、假阴性、假阳性的像素个数。Dice Loss计算公式为

Dice Loss能减少样本不均衡带来的影响,但是在训练过程中不够稳定,不利于网络收敛,因此本研究中结合交叉熵损失函数来稳定训练过程。

1.3 迁移学习

迁移学习是将一项任务中学到的知识进行存储,并将其用于解决相关但不同的问题。给定源域、源任务、目标域、目标任务,迁移学习在源域和源任务中学到的知识有助于改进目标任务中预测函数的学习能力,在源域数据量充足而目标域数据量较少时能有效提升模型性能。

本研究利用模型迁移的方法,将VGG-16和Transformer的预训练权重共享于TMU-Net网络模型的特征空间,能够使TMU-Net网络模型获得更好的初始性能,帮助模型更快地学习,提高模型训练的效率和鲁棒性。

1.4 试验设计

1.4.1 TMU-Net网络结构训练环境

硬件环境:算法处理平台为MistGPU服务器,处理器为Intel Core i7,16GB内存,显卡型号为NVIDIA Titan RTX。

软件环境:采用Linux操作系统,编程语言为Python3.7.8,使用深度学习框架Pytorch1.9.0进行网络搭建。

1.4.2 训练参数及方法

模型训练过程分为冻结与解冻两个阶段,前10个训练轮次(Epoch)采用较大的学习率,冻结部分网络参数,防止权值被破坏,仅对网络进行微调,将更多的资源用于训练网络后半部分的参数,从而提高训练的效率。解冻阶段整个网络的参数都会发生改变,因此采用较小的学习率。试验中每完成一个Epoch迭代便保存一次权重文件。本研究中网络优化器选用Adam优化器,冻结训练阶段初始学习率设置为10-4,解冻训练阶段初始学习率设置为10-5,批次输入样本数为2,采用衰减率为0.9的随机梯度下降法训练50个轮次。

1.4.3 模型评价指标

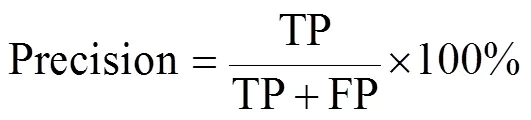

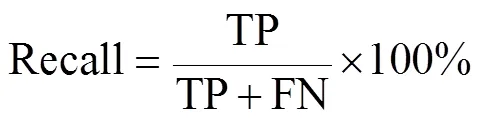

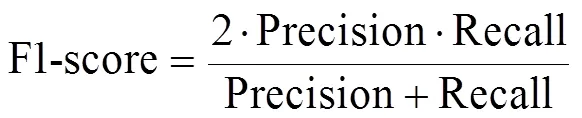

本研究采用交并比(Intersection Over Union,IOU)、精确率(Precision)、召回率(Recall)、F1值(F1-score)作为模型评价指标。

交并比为预测区域和真实区域重叠部分与集合部分的比值。精确率与召回率的计算公式如下:

精确率表示预测正确的正样本数量与全部预测为正样本的样本数量之比,即“查准率”。召回率表示预测正确的正样本数量与真实正样本数量之比,即“查全率”。F1值(F1-score)是调和平均值,综合考虑了精确率与召回率,计算公式为

2 结果与分析

2.1 迁移学习训练对模型性能的影响

训练过程中使用预训练权重,模型中VGG-16的预训练权重来自VOC拓展数据集,Transformer层的预训练权重来自ImageNet数据集。

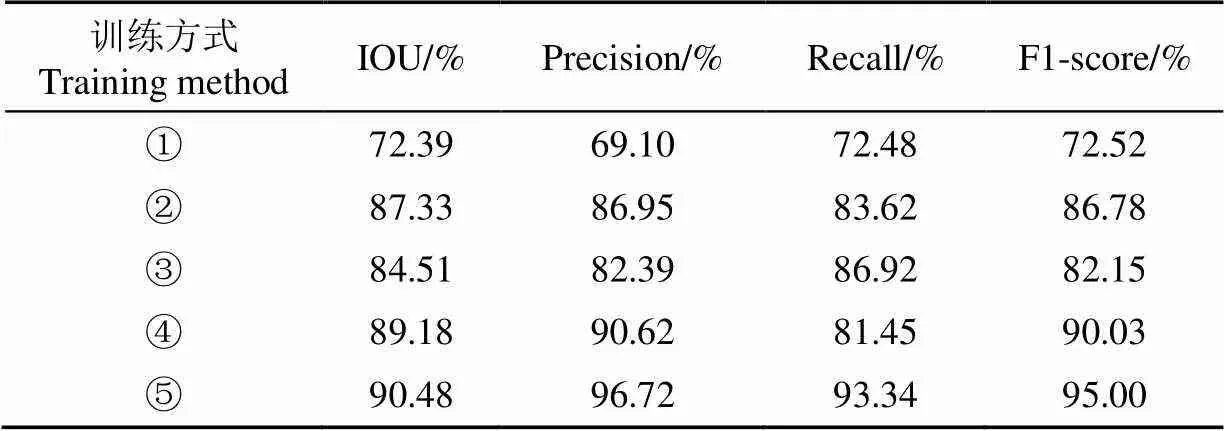

本研究对比了不同训练方式对网络模型分割效果的影响:①不使用预训练权重,直接对网络模型进行训练;②使用VGG-16预训练权重,冻结所有层;③使用Transformer预训练权重,冻结所有层;④使用VGG-16和Transformer预训练权重,冻结所有层;⑤使用VGG-16和Transformer预训练权重,冻结特定层。训练方式⑤冻结了Transformer编码器所在层的参数,冻结层位置如图 3的虚线框所示。最终得到的试验结果如表1所示。

表1 不同训练方式的试验结果

注:训练方式中的序号①~⑤分别为:未使用迁移学习的训练方式、仅使用VGG-16权重迁移训练的方式、仅使用Transformer权重迁移训练的方式、使用VGG-16和Transformer权重迁移训练的方式、使用VGG-16和Transformer权重并冻结特定层迁移训练的方式;IOU表示交并比,Precision表示精确率,Recall表示召回率,F1-score表示F1值。

Note: The serial numbers ①-⑤ in the training methods are: the training method without transfer learning, the method using only VGG-16 weight transfer training, the method using only Transformer weight transfer training, the method using VGG-16 and Transformer weight transfer training, the method using VGG-16 and Transformer weights and freezing specific layer transfer training; IOU represents intersection-union ratio, Precision represents precision, Recall represents recall, and F1-score represents F1 value.

在相同的训练环境下,同时使用VGG-16和Transformer的预训练权重比使用单个预训练权重效果更优,说明多权重同时迁移训练的方式更适合TMU-Net网络模型。在训练过程中,训练方式⑤与未使用迁移学习的训练方式①相比,IOU、精确率、召回率、F1值分别提升了18.09、27.62、20.86、22.48个百分点;与冻结网络所有层参数的训练方式④相比,IOU、精确率、召回率、F1值分别提升了1.30、6.10、11.89、4.97个百分点。因此,使用迁移学习并选择冻结合适的网络层进行训练可以有效提升模型的检测性能。

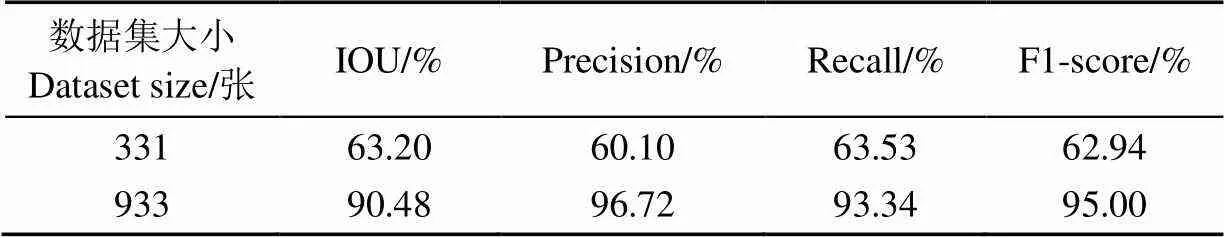

2.2 数据增强对模型性能的影响

为了保证试验设置的合理性,在其他参数相同的条件下,分别使用扩充前后的数据集对TMU-Net网络模型进行训练,试验结果如表2所示。

由表2可知,相比于原始数据集,使用扩增数据集训练,TMU-Net网络模型的IOU、精确率、召回率、F1值分别提高27.28、36.62、29.81、32.06个百分点。说明使用扩增数据集训练效果更好。

表2 不同大小数据集的试验结果

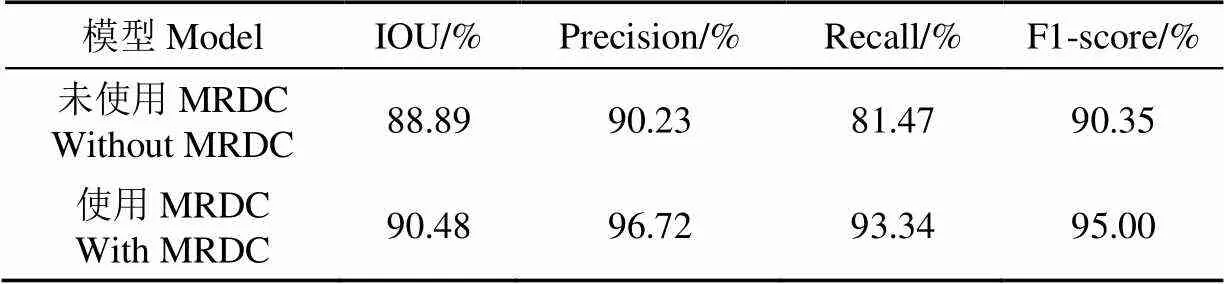

2.3 MRDC模块对模型性能的影响

在其他参数相同的条件下,本研究对使用MRDC模块前后的模型进行训练,并在测试集上进行验证,试验结果如表3所示。相比于未使用MRDC模块,优化的TMU-Net模型分割的IOU、精确率、召回率、F1值分别提高了1.59、6.49、11.87、4.65个百分点,说明MRDC模块有效地提升了网络模型的性能。

表3 使用MRDC模块前后的试验结果

为了更直观、清楚地看到MRDC模块在苹果横切面不同区域特征提取的效果,本文将U-Net与TMU-Net中每一层跳跃连接的输出特征进行热力图可视化,热力图中高温区域(红色区域)颜色越深,表明网络对该区域的关注度越高,提取到的特征越多,如图6所示。

图6 不同跳跃连接输出特征可视化图

通过热力图纵向比较可知,第4层跳跃连接中使用MRDC模块的TMU-Net提取的特征能够较为准确的覆盖果心区域,对图像中的其他区域也有一定的识别能力。在TMU-Net模型的第3层和第2层跳跃连接中,未使用MRDC模块的TMU-Net提取的果心特征轮廓较为模糊,果心区域存在部分损失,而使用MRDC模块的TMU-Net对果心边缘的提取更加精细,并且网络进行预测时对果心区域的关注度更高。

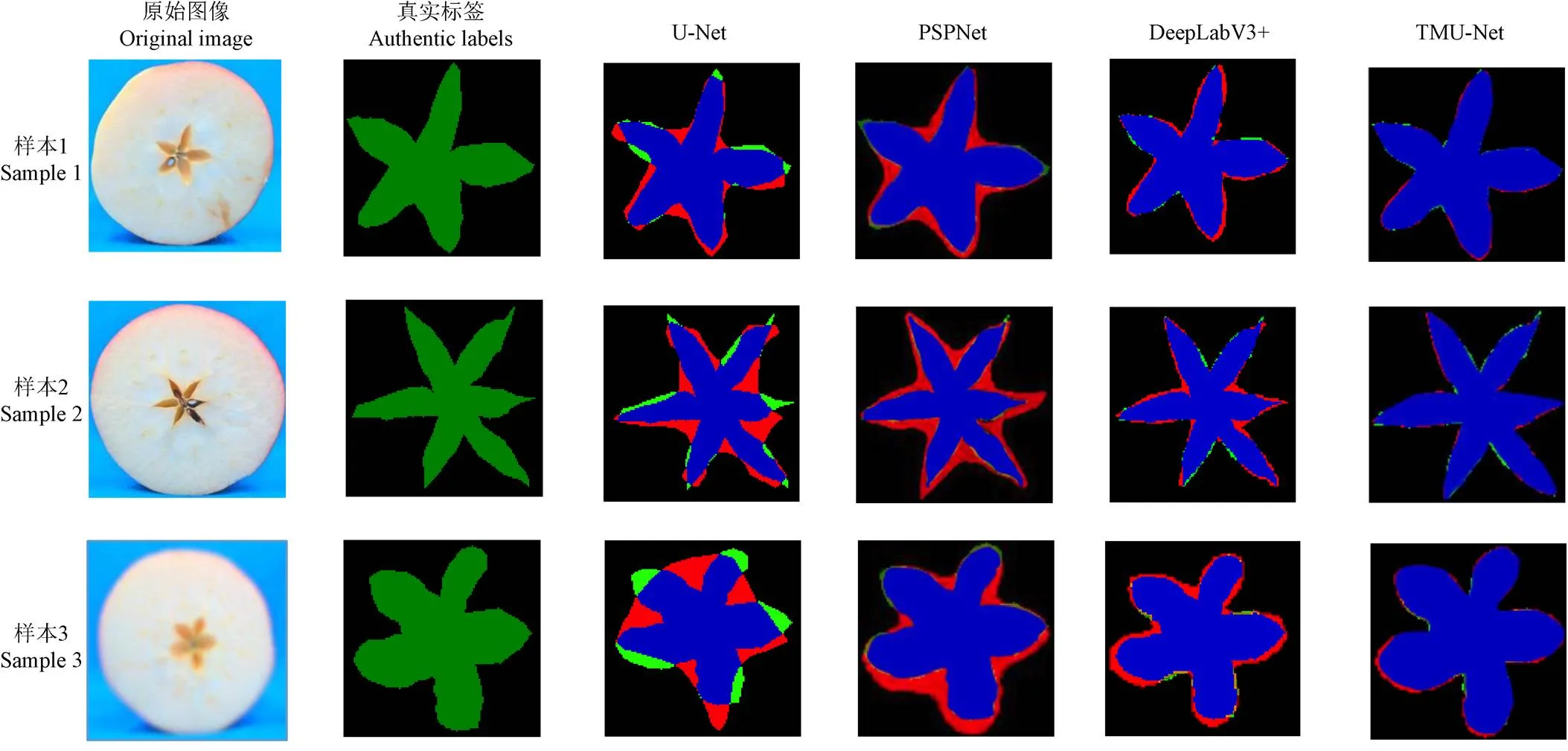

2.4 TMU-Net网络模型改进效果

U-Net、PSPNe和DeeplabV3+作为语义分割中的经典模型,具有检测准确度高、模型创新性强的特点。因此,在果心分割效果试验中,选取U-Net模型、PSPNet模型、DeeplabV3+模型与TMU-Net模型进行分割效果对比。不同网络模型的苹果果心分割效果如图7所示,真实标签为自人工标注的果心边界标签。通过横向对比可知,对于形状较均匀的苹果果心,如样本1,TMU-Net模型可以较为准确和全面地分割果心,DeeplabV3+模型所分割的果心各角会有细微的错误分割现象,而PSPNet模型分割出的果心各角连接处有明显的错误分割现象;样本2的果心较细,需要处理的细节较多,与其他模型相比,TMU-Net网络对细节的分割效果最佳,PSPNet与U-Net网络模型,在果心各角连接处分割错误面积较多,严重影响结果;虽然样本3的原始图像较为模糊,但TMU-Net的分割结果最接近真实标签,其余网络分割的错误区域过多,难以精确识别果心的边缘轮廓,进一步表明本研究做出的改进是有效的。

通过纵向对比可知,TMU-Net对精细的尖锐边角及连接处的分割效果优于圆滑的边沿;DeeplabV3+模型对原始图片的质量要求较高,对于低清晰度图片,该模型只能分出大致形状,难以应用在实际任务中;PSPNet与U-Net网络模型,在本次果心分割任务中,只能分割出果心的大致范围。说明以上两个模型对果心的特征利用不够,信息丢失的情况严重,不适合做果心类的小目标精细分割任务。

注:分割结果中,蓝色部分代表正确分割的区域,绿色部分代表未分割到的区域,红色部分代表误分割的区域。

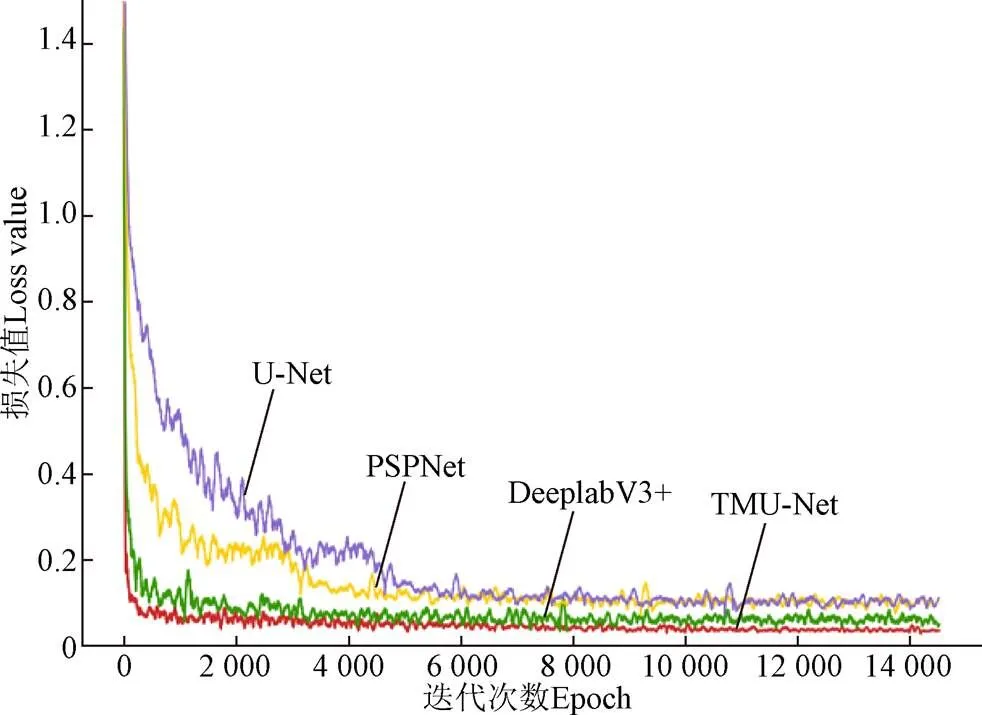

为了全面分析TMU-Net模型与U-Net模型、PSPNet模型、DeeplabV3+模型的分割性能差异,在其他参数相同的试验条件下,使用本研究构建的果心数据集训练50个轮次,各模型训练精度损失(Loss)和交并比(IOU)变化曲线如图8和图9。

如图8所示,在训练初期网络的损失值快速下降,随着迭代次数的增加,在模型迭代至4 000次时,各模型的损失值逐渐趋于平缓,最终模型达到收敛。相较与其他模型,TMU-Net网络模型在迭代至2 000次时,损失函数基本保持不变,说明此时模型已经收敛,该模型的收敛速度最快。当达到稳定后,TMU-Net网络损失曲线始终处于最下方且波动幅度更小,表明模型达到预期训练效果。

如图9所示,当训练前5个轮次时,各网络模型的IOU随着轮次的增加而快速增长,在此过程中,PSPNet网络模型的IOU曲线在最低处。当各网络模型的IOU值出现拐点后,训练轮次的增加对U-Net网络模型、DeeplabV3+网络模型和TMU-Net网络模型的IOU值的提升影响不大,但PSPNet网络模型的IOU值在缓慢提升,在此过程中,U-Net模型的IOU值逐渐转变为较低水平。通过对比发现,相较与其他模型,TMU-Net模型的IOU曲线一直处于最上方,IOU值最终稳定在90.48%,说明在训练初期便达到了较好的性能。

图8 损失值随迭代次数变化曲线

图9 IOU值随训练轮次变化曲线

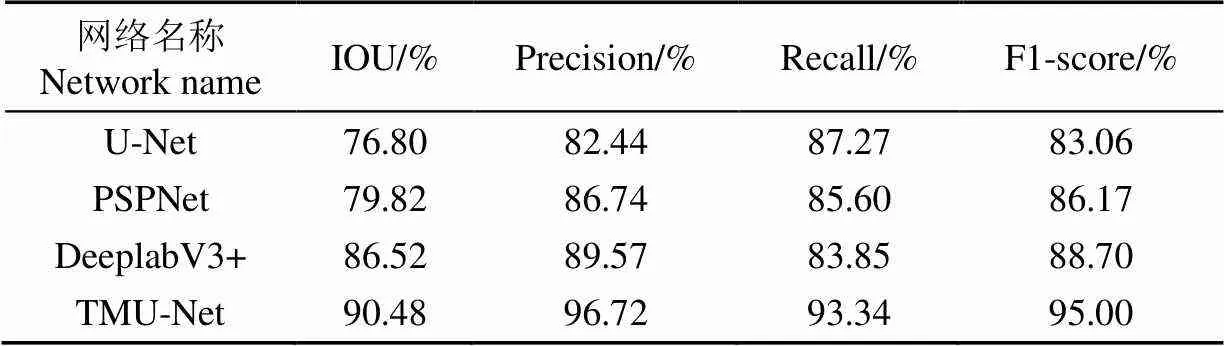

将训练好的不同网络模型在果心测试集图像上进行模型测试,以IOU、Precision、Recall、F1-score为评价依据,试验结果如表4所示。

表4 不同网络模型对果芯分割效果的精度评价

由表4可知,与U-Net模型相比,TMU-Net模型在果心分割任务中性能有大幅提升,其中IOU值、精确率、F1值分别提升了13.68、14.28、11.94个百分点;与性能较好的DeeplabV3+网络相比,IOU值、精确率、F1值分别提升了3.96、7.15、6.30个百分点;与PSPNet模型对比,精确率提升了9.98个百分点。在单张图片的推理时间中,TMU-Net模型平均耗时为1.688 s。将现阶段手工测量方法改为智能识别,在考量不同智能识别方法的性能时,检测精度要求比检测时间更关键,单个果心检测时间在“秒”数量级都可满足检测要求,所以TMU-Net模型1.688 s的检测时长已满足需求。

3 结 论

为满足苹果内在品质检测中精准定位果心的需求,本研究提出了一种针对小目标精细分割的模型TMU-Net。该模型在U-Net网络模型的基础上以VGG-16前13层作为主干特征提取网络,并将Transformer编码器融入网络结构、在跳跃连接中叠加多重残差空洞卷积(Multiple Residual Dilated Convolution,MRDC)模块,构建了TMU-Net网络模型,该模型实现了苹果果心的精准分割,为苹果内在品质自动检测提供了技术参考,主要结论如下:

1)VGG-16网络的前13层和Transformer编码器的引入,有效地提高了网络的特征提取能力,与原始的U-Net网络模型相比,交并比(Intersection Over Union,IOU)、精确率、F1值分别提升13.68、14.28、11.94个百分点,在一定程度上提高了模型分割的性能。

2)MRDC模块可以使模型获取丰富的底层信息,因此模型在果心的尖锐拐角及连接处,能够实现精准分割,模型的分割精度高达96.72%,与未使用MRDC模块的TMU-Net模型相比提升6.49个百分点,已满足实际应用水平。

3)通过数字图像处理技术中的随机平移、水平镜像、垂直镜像、高斯模糊等方法对原始数据集进行数据增强,构建了适合网络模型训练的果心数据集。从对比结果可以看出,数据增强后的数据集从能有效提升模型的各项性能, IOU、精确率、召回率、F1值分别提高27.28、36.62、29.81、32.06个百分点,因此,增强了网络的泛化能力,避免网络在训练过程中出现过拟合问题的问题。

4)采用双权重迁移训练并部分冻结特征层的训练方式,与采用双权重迁移训练并冻结所有层的训练方式相比,IOU、精确率、召回率、F1值分别提升了1.30、6.10、11.89、4.97个百分点。通过模型训练曲线可以看出,该训练方式还可以加快训练时的收敛速度。

[1] 中华人民共和国农业部. NY/T2316—2013苹果品质指标评价规范[S]. 北京:农业部农产品加工标准化技术委员会,2013.

[2] Hu Q, Jiang Y, Zhang J B, et al. Development of an automatic identification system autonomous positioning system[J]. Sensors, 2015, 15(11): 28574-28591.

[3] 刘浩,袁野,庄守望,等. 一种用于水果去核的视觉识别方法:CN106203527A[P]. 2016-07-18.

[4] 胡智元. 新型水果榨汁机定位关键技术研究[D]. 赣州:江西理工大学,2018.

Hu Zhiyuan. Research on Key Positioning Technology of New Fruit Juicer[D]. Ganzhou: Jiangxi University of Technology, 2018. (in Chinese with English abstract)

[5] 钟昌源,胡泽林,李淼,等. 基于分组注意力模块的实时农作物病害叶片语义分割模型[J]. 农业工程学报,2021,37(4):208-215.

Zhong Changyuan, Hu Zelin, Li Miao, et al. Real-time crop disease leaf semantic segmentation model based on group attention module[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(4): 208-215. (in Chinese with English abstract)

[6] 孙志同,朱珊娜,高郑杰,等. 基于波段增强的DeepLabv3+多光谱影像葡萄种植区识别[J]. 农业工程学报,2022,38(7):229-236.

Sun Zhitong, Zhu Shanna, Gao Zhengjie, et al. Grape planting area recognition based on band enhanced DeepLabv3+ multi-spectral image[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(7): 229-236. (in Chinese with English abstract)

[7] 杨蜀秦,王鹏飞,王帅,等. 基于多头自注意力DeepLab v3+的无人机遥感影像小麦倒伏检测[J/OL]. 农业机械学报(2022-06-23) [2022-07-23]http: //kns. cnki. net/kc ms/detail/11. 196 4. S. 2022, 06, 22. 1158. 012. html.

Yang Shuqin, Wang Pengfei, Wang Shuai, et al. Wheat lodging detection based on multi-head self-attention DeepLabv3+ UAV remote sensing image [J/OL]. Transactions of the Chinese Society for Agricultural Machinery (2022-06-23) [2022-07-23]http: //kns. cnki. net/kcms/detail/11. 1964. S. 2022, 06, 22. 1158. 012. html. (in Chinese with English abstract)

[8] Chen L C, Zhu Y, Papandreou G, et al. Encoder-decoder with atrous separable convolution for semantic image segmentation[C]//Proceedings of the European conference on computer vision (ECCV). Munich, Germany: 2018: 801-818.

[9] Ronneberger O, Fischer P, Brox T. U-net: Convolutional networks for biomedical image segmentation[C]//International Conference on Medical image computing and computer-assisted intervention. Munich, Germany: Technical University Munich, 2015: 234-241.

[10] 饶秀勤,朱逸航,张延宁,等. 基于语义分割的作物垄间导航路径识别[J]. 农业工程学报,2021,37(20):179-186.

Rao Xiuqin, Zhu Yihang, Zhang Yanning, et al. Navigation path recognition between crop ridges based on semantic segmentation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(20): 179-186. (in Chinese with English abstract)

[11] 赵晋陵,詹媛媛,王娟,等. 基于SE-UNet的冬小麦种植区域提取方法[J/OL]. 农业机械学报(2022-07-12) [2022-07-23]http: //kns. cnki. net/kcms/detail/11. 1964. S. 20220711. 1350. 016. html.

Zhao Jinling, Zhan Yuanyuan, Wang Juan, et al. SE-UNet based extraction method for planting area of winter wheat[J/OL]. Transactions of the Chinese Society for Agricultural Machinery (2022-07-12) [2022-07-23]http: //kns. cnki. net/kcms/detail/11. 1964. S. 20220711. 1350. 016. html. (in Chinese with English abstract)

[12] Ge R, Cai H, Yuan X, et al. MD-UNET: Multii-nput dilated U-shape neural network for segment-ation of bladder cancer[J]. Computational Biology and Chemistry, 2021, 93: 107510-107510.

[13] Maji D, Sigedar P, Singh M. Attention Res-UNet with Guided Decoder for semantic segmentation of brain tumors[J]. Biomedical Signal Processing and Control, 2022, 71: 103077.

[14] Song Z, Zhang Z, Yang S, et al. Identifying sunflower lodging based on image fusion and deep semantic segmentation with UAV remote sensing imaging[J]. Computers and Electronics in Agriculture, 2020, 179: 105812.

[15] Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need[J]. Advances in Neural Information Processing Systems, 2017, 30.

[16] Dosovitskiy A, Beyer L, Kolesnikov A, et al. An image is worth 16x16 words: Transformers for image recognition at scale[C]//International Conference on Learning Representations (ICLR). Online: Yoshua Bengio, Yann LeCun, 2020.

[17] Zheng S, Lu J, Zhao H, et al. Rethinking semantic segmentation from a sequence-to-sequence perspective with transformers[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Online: IEEE, 2021: 6881-6890.

[18] 贾伟宽,孟虎,马晓慧,等. 基于优化Transformer网络的绿色目标果实高效检测模型[J]. 农业工程学报,2021,37(14):163-170.

Jia Weikuan, Meng Hu, Ma Xiaohui, et al. Efficient detection model of green target fruit based on optimized Transformer network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(14): 163-170. (in Chinese with English abstract)

[19] 张飞宇,王美丽,王正超. 引入Transformer和尺度融合的动物骨骼关键点检测模型构建[J]. 农业工程学报,2021,37(23):179-185.

Zhang Feiyu, Wang Meili, Wang Zhengchao. Construction of the animal skeletons keypoint detection model based on transformer and scale fusion[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(23): 179-185. (in Chinese with English abstract)

[20] 安小松,宋竹平,梁千月,等. 基于CNN-Transformer的视觉缺陷柑橘分选方法[J/OL]. 华中农业大学学报(自然科学版),2022,41(4):158-169

An Xiaosong, Song Zhuping, Liang Qianyue, et al. Citrus sorting method for visual defects based on CNN transformer[J]. Journal of Huazhong Agricultural University (Natural SScience Edition), 2022, 41(4): 158-169. (in Chinese with English abstract)

[21] Simonyan K, Zisserman A. Very Deep Convolutional Networks for Large-Scale Image Recognition[C]//International Conference on Learning Representations (ICLR). San Diego, CA, USA: Yoshua Bengio, Yann LeCun, 2015.

[22] Park P S, Kshirsagar A M. Correlation between successive values of Anderson's classification statistic in the hold-out method[J]. Statistics & Probability Letters, 1996, 27(3): 259-265.

[23] Ronneberger O, Fischer P, Brox T. U-net: Convolutional networks for biomedical image segmentation[C]// International Conference on Medical Image Computing and Computer-assisted Intervention. Munich, Germany: Technical University Munich, 2015: 234-241.

[24] Yu F, Koltun V. Multi-scale context aggregation by dilated convolutions[C]//International Conference on Learning Representations (ICLR). San Juan, Puerto Rico: Yoshua Bengio, Yann LeCun,2016

[25] Wang P, Chen P, Yuan Y, et al. Understanding convolution for semantic segmentation[C]//2018 IEEE Winter Conference on Applications of Computer Vision (WACV). Lake Tahoe, Nevada, USA: IEEE, 2018: 1451-1460.

[26] Milletari F, Navab N, Ahmadi S A. V-net: Fully convolutional neural networks for volumetric medical image segmentation[C]//2016 Fourth International Conference on 3D Vision (3DV). Stanford, CA, USA: IEEE, 2016: 565-571.

Apple core segmentation method based on TMU-Net network

Liu Changyong1, Li Sijia3, Shi Hui2, Zha Zhihua2, Deng Hongtao2※

(1.,832000,; 2.,,832000,; 3.,-,510275,)

Apple quality has been ever increasingly required with the improvement of living standards in recent years. The core ratio is one of the most significant factors to determine the quality of apples. But, the manual measurement on the fruit core cannot fully meet the current detection requirements, in terms of cost and accuracy at present. In this study, an automatic segmentation was proposed for the fruit core using a TMU-Net network model. Firstly, three common types of apples were selected in the Xinjiang of China. An acquisition device was then used to capture the 311 cross-sectional images of the fruit core. Secondly, the preprocessing operations were also conducted to enhance the original images, including translation, vertical mirroring, horizontal mirroring, and adding Gaussian noise. Better training was achieved in the expanded dataset, compared with the original. Specifically, the Intersection Over Union (IOU), Precision, Recall, and F1-score of the TMU-Net network increased by 27.28, 36.62, 29.81, and 32.06 percentage points, respectively. It infers that the data enhancement improved the robustness and generalization of the model after training. The Multiple Residual Dilated Convolution (MRDC) module was also constructed with the Cavity convolution in the different void ratios and shortcut connections. Shortcut connections are skipping one layers, they simply perform identity mapping. As such, the information loss was reduced in the jump connection part of the model. There was also less semantic difference between the encoder and the decoder. The MRDC module was finally used to verify the TMU-Net jump connection. The results showed that: 1) The MRDC module was introduced to effectively improve the segmentation performance of the model, in which the IOU, Precision, and F1-score were improved by 1.59, 6.49, and 4.65 percentage points, respectively. 2) The first 13 layers of VGG-16 network were used as the backbone to capture the low-level features. The Transformer encoder was integrated into the network structure to enhance the global extraction of the network, particularly for the locality of convolution operations. The segmentation shows that the TMU-Net network was much more precise to process the sharp corner and edge details of the fruit center, indicating the feasibility of the model in the segmentation task of the fruit center. 3) The TMU-Net model was trained under a variety of transfer learning. Therefore, freezing the training of specific network layers can be expected to effectively improve the indicators of the model. The training curve of the model showed that the training was used to accelerate the convergence speed. Subsequently, the TMU-Net, DeeplabV3+, U-Net, and PSPNet models were trained to verify the test set under the same experimental parameters. The IOU, Precision, Recall, and F1-score of the TMU-Net model increased by 3.96, 7.15, 9.49, and 6.30 percentage points, respectively, compared with the DeeplabV3+ model with better effect. Therefore, this TMU-Net model can be expected to accurately and effectively realize the fruit core segmentation. The finding can also provide a strong reference for the intelligent detection of apple quality.

models; image segmentation; core segmentation; TMU-Net network; MRDC; Transformer;transfer learning

10.11975/j.issn.1002-6819.2022.16.033

TP391.4;S126

A

1002-6819(2022)-16-0304-09

刘长勇,李思佳,史慧,等. 基于TMU-Net网络的苹果果心分割方法[J]. 农业工程学报,2022,38(16):304-312.doi:10.11975/j.issn.1002-6819.2022.16.033 http://www.tcsae.org

Liu Changyong, Li Sijia, Shi Hui, et al. Apple core segmentation method based on TMU-Net network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(16): 304-312. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2022.16.033 http://www.tcsae.org

2022-04-29

2022-08-12

国家自然科学基金(31860466);苹果内在品质指标评价技术研究(KH011402)

刘长勇,高级实验师,研究方向为食品质量安全。Email:lw01_inf@shzu.edu.cn

邓红涛,副教授,研究方向为人工智能。Email:denghtshzu@163.com