联结主义人工智能的历史回顾及其哲学审视

陈明益,张友恒

(武汉理工大学 马克思主义学院,湖北 武汉 430070)

引言:何为联结主义AI?

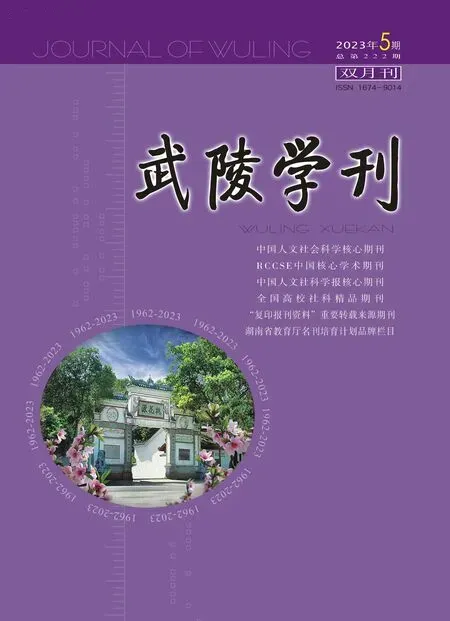

时至今日,AI 领域仍面临诸多质疑,如公众认为AI 的进步是基于炒作,而非实质上的进步[1]28。当前AI 领域的热情来源于联结主义,也就是人工神经网络(Artificial Neural Networks,ANNs);而这些质疑,也是对ANNs 能走多远的提问。自图灵(A.M.Turing)提出智能机器的设想后,AI 研究进路主要分为在20 世纪获得巨大成功的符号主义与在21世纪迎来发展高潮的联结主义。与符号派重视逻辑推理不同,ANNs 初期受到生物学的启发,企图通过计算神经网络模拟生物神经网络运行使AI进行智能活动(见图1)。联结主义AI 在当前研究中取得了突破式的进展并拥有广阔的应用市场,甚至可以说ANNs 的构想在符号派盛行的年代是一种“哥白尼式的革命”。相比于符号AI 的串行方法,ANNs 的并行程序能让AI 完成一些常识的、经验性的简单任务,如人脸识别、语音识别、无人驾驶等。但要注意的是,在虚拟机上模拟的“神经元”与大脑中的生物神经元有着质的区别,联结主义构造的“人工神经网络”与生物神经网络不能一概而论;且从“强人工智能”定义来看,由于缺少逻辑结构,ANNs 无法达到真正意义上的强人工智能[2]94。

图1 生物神经网络与人工神经网络

一、联结主义AI 的历史发展进程

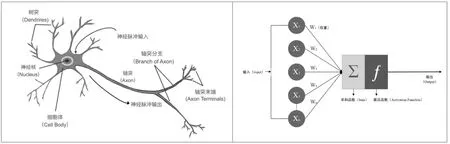

相比于符号派从盛行到衰退的发展过程,ANNs 的发展更为“跌宕起伏”。从20 世纪40 年代至今:联结主义AI 的早期发展可以分为“感知机(Perceptron)”和“反向传播(Back Propagation,BP)”两个主要阶段。随着20 世纪90 年代互联网的浪潮兴起,AI 研究曾一度停摆,直至2006 年随着“深度学习(Deep Learning,DL)”的复兴,联结主义才再一次迎来了它的发展浪潮。1.第一阶段:人工神经网络的兴起到感知机的挫败(1940—1970)。在图灵成为AI 领域的“幽灵神话” 前,还有一种思潮——控制论(Cybernetics),促生了人工智能。具有哲学背景的维纳(Norbert Wiener)从科学哲学的视角创立了这个交叉领域——“关于在动物和机器中控制和通信的研究”[2]16。早期ANNs 的研究者无不受到这门学科的影响,他们从生物、通信、工程而不是从逻辑和数学的角度来建立AI 的模型。逻辑学出身的皮茨(Walter Pitts)和哲学出身的麦卡洛克(W.S.McCulloch)是维纳的追随者,他们在1943 年发表的论文《神经活动内在思维的逻辑演算》中,基于生物神经网络的特点提出了M-P 模型(见图2)。当存在抑制性输入时,刺激性输入无法触发神经元(output = 0);当存在刺激性输入而不存在抑制性输入时,若是输入之和大于预设阈值θ 则触发神经元(output = 1)。“他们试图用命题的符号逻辑符号来记录神经网络的复杂行为”[3]117,从而初创了AI 的联结主义进路。1957 年,心理学家罗森布拉特(Frank Rosenblatt)在“赫布(Hebb)学习规则①”的影响下开发了名为“感知机”的人工神经网络模型,这个模型可以处理一些简单的视觉任务[4]120。感知机模型与M-P 模型类似,其与后者的主要区别在于对每个输入进行加权,输入的权重不再统一,加之一些刺激性输入也会产生抑制性影响,M-P 模型的绝对抑制规则不再适用。罗森布拉特因此名声大噪,当时,一些美国媒体甚至对此宣传“机器即将模拟出人的意识”[5]。1962 年,罗森布拉特在《神经动力学原理》一书中总结了自己的研究成果,但随即遭到了信奉符号主义的明斯基(M.L.Minsky)的批判。明斯基与佩伯特(Seymour Parpert)在1969 年合作出版的《感知机:计算几何学》 一书中指出,感知机无法解决异或(XOR)问题[4]121,此书被广泛解释为ANNs 表现出的有限性存在致命的缺陷,由此切断了ANNs 近十年的研究资助。

图2 M-P 模型与感知机模型对比

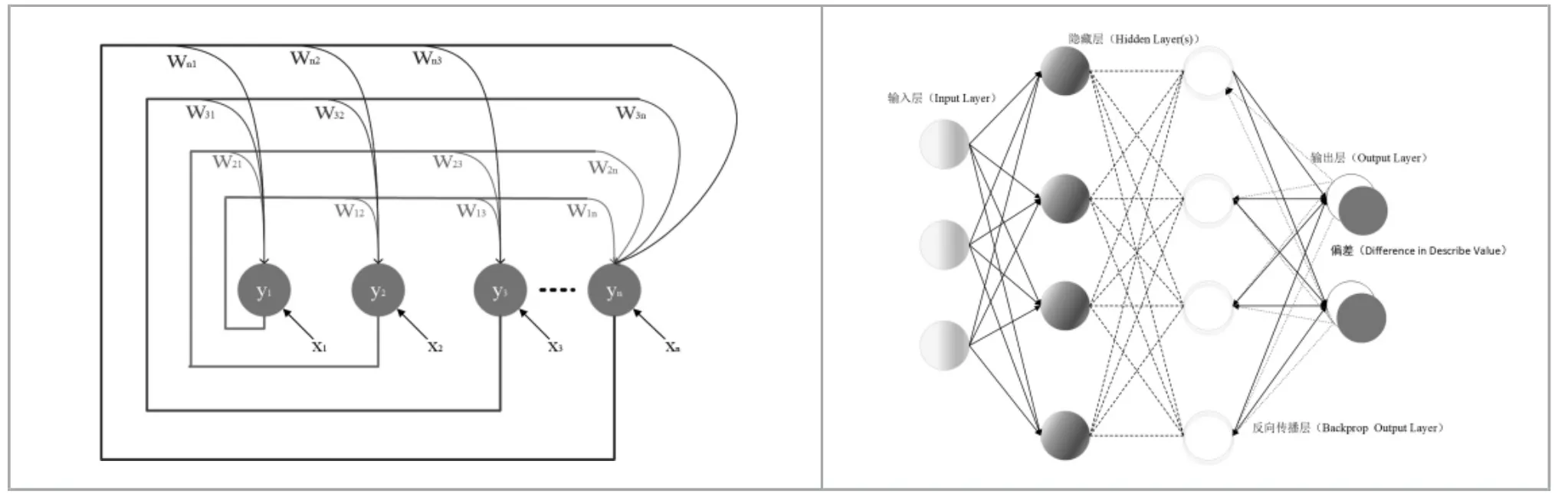

2.第二阶段:霍普菲尔德网络的中兴到反向传播的挣扎(1980—1990)。1974 年,沃波茨(Paul Werbos)在其博士论文中将弗洛伊德的精神分析理论转换成一种新的算法——反向传播算法。BP 将神经网络多加了一层(隐藏层),从而解决了XOR问题[4]125,但由于ANNs 正处于低谷期,沃波茨的工作并未得到重视。ANNs 的第一次复兴并非源于AI领域本身,而是来自物理学家霍普菲尔德(J.J Hopfield)。他的工作成果被称为霍普菲尔德网络(Hopfield Networks)(见图3),HN 是源于自旋系统[6]、由一组神经元组成的多回路反馈系统。其中,反馈循环数与神经元数量相等,每个神经元都只对除自身之外的其他神经元进行输出。霍普菲尔德网络不仅解决了XOR 问题,并且能在组合优化和NP 完全问题②上找到近似的解决方案,从而体现出其实用性[1]318-319。这重新掀起了ANNs 研究的热潮,一批仍对此抱有希望的学者重新投入这个领域,并于1986 年出版了论文集《并行分布式处理》(Parallel Distributed Processing,PDP)。当提到AI里的联结主义,通常所指的就是PDP[2]96。这股计算机和认知科学领域的“春风”认为,大脑可以用一个并行处理的模型来表示,各个神经元单位联结在一起,被激活的信号通过这个网络流动,整个运行过程同时发生且呈分布式。辛顿(Geoffrey Hinton)是这个运动的参与者之一,他与人合著的论文《通过反向传播误差来学习表征》使BP 算法重获重视,此算法(见图3)反复调整网络中连接的权重,以使得网络的实际输出向量与期望输出向量之间的差异最小化[7]。这时的BP 算法仅适用于少量隐藏层的网络,而当联结主义者们将它运用到更多层神经网络时,BP 网络就变成了“慢速学习者”。一个多层网络可能需要千万次迭代才能学习,这就使BP 网络取得的成就越来越有限[8]。随着20 世纪90 年代互联网浪潮的冲击,联结主义者的声音逐渐被淹没。

图3 霍普菲尔德网络与反向传播算法

3.第三阶段:深度学习的复苏到复杂神经网络的发展(2006 至今)。互联网技术与AI 技术其实有重叠的目标,更快捷的“互联”似乎也能嗅到一丝联结主义的气味,“恰恰是互联网所产生的海量数据给了神经网络更大的机会”[4]130。2006 年,辛顿等在《Science》上发表的《通过神经网络降低数据维数》一文彻底拉开了这个帷幕。此文描述了一种将高维数据转换为低维代码,并通过逐层预先训练的机器学习方法[9]。一个在20 世纪已经被提及的方法即深度学习(Deep Learning,DL)因为此项工作而获得了实用性。深度学习是机器学习的方法之一,该方法与其他方法的不同之处在于训练者不用再给数据集“贴标签”,而是使机器对数据集的特征进行主动学习。到此,我们可以发现ANNs 研究的两个主要方向:一个是方法(算法),另一个则是如何建构神经网络。许多神经网络的建模在20 世纪就已经被作为猜想或是“半成品”提出,但是没有合适的算法能让它们得到更好的应用。在研究初期,AI 从诸多学科那里汲取了养分,“在吸收很多后,AI 已经打破了它们的框架,并开始反过来影响它们”[10],这些因DL 的复苏而重新得到重视的复杂神经网络就是如此:卷积神经网络(Convolutional Neural Networks,CNNs)是一种主用于机器视觉的神经网络,“卷积层”是其内核,它将一个函数转化为另一个函数,通过池化层选取对象的主要特征,再由全连接层给出对象是某事物的概率[11];循环神经网络(Recurrent Neural Networks,RNNs)是一种主用于自然语言处理的神经网络,其特点在于高度重视顺序数据或时间序列,将隐藏层的独立激活变为依赖激活,形成一个循环,从而获得一定的记忆能力[12];图神经网络(Graph Neural Networks,GNNs)是一种非传统的人工神经网络,它处理的是对象的分析图示,在图示中,节点就代表一个实体,边则代表不同实体间的关系,这种图示关系可用于单个或集合对象[13];量子神经网络(Quantum Neural Networks,QNNs)是一种前沿的、适用于量子计算机的神经网络,它将量子理论推广到ANNs 研究中,希望突破传统ANNs的一些限制性问题[14]。诸如此类的神经网络的宏观目标是模拟大脑的智能,这不禁让我们想起了罗森布拉特,这不正是他的梦想吗[4]133?

二、关于联结主义AI 的智能命题

无论是符号派还是联结主义者,对于任意AI程序最初的构想都并非源于每一步的精确计算,而是先产生一个理论上的“命题”。这个“命题”的构想虽然基于他们的研究工作,但是指向的是机器智能的可行方案,因此每一个AI 工作者的“智能命题”都已经在向哲学思考进发。因此,关于联结主义AI的哲学问题,要先回到AI 专家的研究中去寻找,再从哲学家对联结主义AI 的思考中去寻找。

1.神经活动内在思维的逻辑演算。在数学方面极有天赋的皮茨和从哲学方面对大脑进行研究的麦卡洛克可能从未想过自己的影响可以持续近一个世纪。麦卡洛克将哲学理论和实践相结合,并在与皮茨的合作中通过科学来检验自己的哲学构想,二人合著的《神经活动内在思维的逻辑演算》就是联结主义AI 哲学的开篇之作。“神经活动‘全有或全无(all-or-none)’的定律可以把任意神经元的活动表示为一个命题”[3]117,这个首创性的理论把大脑和心智简化为数学模型,为哲学家们解释心智开辟了一个新的进路。“神经活动之间的生理关系与命题之间的关系相对应”[3]117,命题之间的逻辑关系描述了神经活动的因果流,麦卡洛克和皮茨把这种逻辑关系诉诸时间,从而使神经活动的每个过程成为定在,以形式化的方式揭开了神经活动的“面纱”。基于上述理论,麦克洛克和皮茨提出了两个猜想:“无环网(netswithoutcircle)”理论和“有环网(netswithcircle)”理论。无环网③即M-P 模型,这个神经网络中的突触不形成循环。无环网的一阶逻辑在这里被称为“时态命题表达式”[3]120(Temporal Propositional Expressions,TPE),而TPE 可以通过这种非递归神经网络来实现,即实现了图灵机的功能。有环网则是具有循环连接的神经网络,对此,麦卡洛克和皮茨解释道,“若是不满足于无环网的自由假设,要实现这种情况要难上许多”[3]124。相比于无环网,有环网的表达式更为复杂,因为在循环中神经元活动的时间是不确定的,这就涉及多次量化。之后,克莱尼(S.C.Kleene)优化了无环网理论,他通过数学表达式描述所有输入神经元激活序列的集合,在将这些序列进行完全处理后,再将有环网的给定网络带到特定状态,从而发现其中的规律[15]。

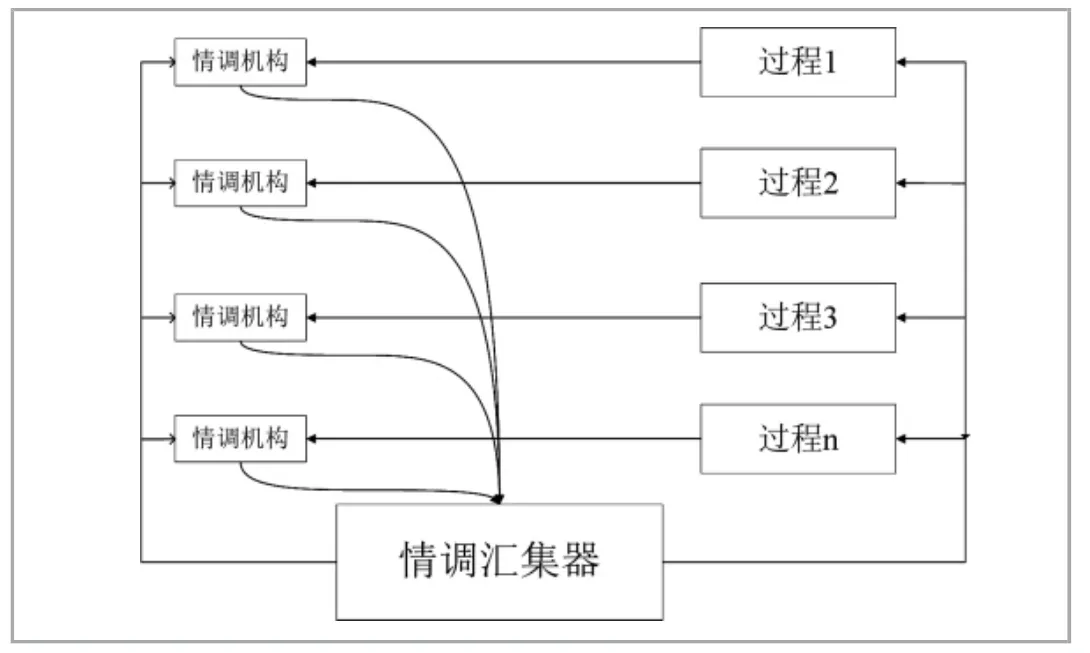

2.维纳及其情调(Affective Tone)机制。维纳是天才式的数学家,他的贡献得到了初期AI 工作者的共同承认。今日再谈控制论,应把《控制论》中的一些想法同当前AI 的发展和哲学思考联系起来,“情调”便是维纳在计算机和神经系统的讨论中提出的重要概念。智能体要对外界做出反应,就必须有观念的作用,观念不仅包括智能体面对当下对象做出的反应,也包括由观念的积累而形成的显在或潜在的复杂观念。维纳将经验论者的简单观念和复杂观念与巴普洛夫的行为心理学进行了比较,把前者将简单观念联系起来的原则称为“邻接原则”[16]105,把后者将复杂观念相联系的原则称为“行为方式的联合”[16]106。从这种比较中,他提出“情调”这一概念,用以阐述机器行为和机器学习。“情调机制”是一个循环的反馈系统,与神经网络十分相似(见图4)。情调的变化会影响神经系统正在进行的活动,并且源于情调汇集器的反馈可以增强或抑制情调的二次能力[16]106。“情调机构”则是在活动过程中形成观念的一个分布式的反馈机制,多个“情调机构”将在“情调汇集器”中被综合。“情调汇集器”的输出指的是以潜在的“复杂观念”作用于活动过程,并对“情调机构”阈值作出调整。值得注意的是,情调汇集器的输出和被输出过程是一个长期过程,而且在维纳的理论中,情调汇集器不必是一个独立的电子元件,它可以代表一种将情调自然综合的作用,成为“敬告所有与此事有关者”式的消息发送出去[16]107。情调机制是机器“心灵”中的动力学机制,而非机器的运行机制。人类的行为不是单纯的机械性程序行为,而是会受到如动机、情感、记忆、信念等方面影响的行为,若要使AI 的行为更加拟人化,也必须使它能感受到来自“心灵”的某种动机[17]。

图4 维纳的“情调机制”

3.德雷福斯与普特南的不同观点。列宁曾说过“聪明的唯心论好过愚蠢的唯物论”,这句话在人工智能哲学中也同样适用:聪明的哲学家好过愚蠢的AI 专家,反之亦然。人工智能哲学溯源于图灵,但不仅限于图灵。现象学家德雷福斯(Hubert Dreyfus)对AI 的批判使他名声大噪。他从生物层面对ANNs 进行了批判,认为“人脑的‘信息加工’方式可能完全不同于数字计算机”[18]。德雷福斯认为,M-P 神经模型只是部分地解释了神经元的工作方式,而ANNs 只是人类在有限经验的情况下,被神经学家和AI 专家采用的一种不加批判地接受的解释。他的批判方式是用哲学的综合来打击AI 的分析,但是其哲学的综合是建立在具体分析之上的。从未受过计算机教育的德雷福斯的简单分析招致了AI 和哲学领域的研究者对他的共同批判。德雷福斯也随着20 世纪80 年代符号主义的衰退和ANNs 复兴的浪潮,在与其表亲④的合作中重新审视了自己的批判,如他们在合作发表的论文中将对AI 的批判范围缩小至符号派,而对ANNs 仍抱有一定的期待。德雷福斯曾说,哲学在自然科学中找到的有效方法在AI 研究中也必定是有效的[19],但是他却用传统哲学的模糊语句去论证一些在传统哲学中早已被指出的计算机语言和AI 程序设计,这种牵强附会的证明方法同样招致了批判。与德雷福斯不同,科学哲学家普特南(Hilary Putnam)作为机器定理证明早期发展的推动者,同时也是AI 一些分支领域的开创者,他的一些哲学思考通常会被“内行人”所接受。普特南在心灵哲学中将心智的功能与计算机的功能进行了类比,认为人类心灵的运作也是输入、处理和输出的过程,开创了功能主义进路。在1981 年出版的《理性、真理和历史》一书中,普特南在开篇给出了“缸中大脑”和“孪生地球”两个熟知的思想实验,其目的在于对“意向性”概念进行否定。普特南认为,“构成理解的不是内在心理现象,而是主体运用这种现象的能力以及能在正确的环境中产生正确的心理现象”[20]19-20,因此,“对外部事物的理解并不需要一系列的心理现象”[20]20。“意向性”是困扰AI 的一个难题,它涉及对机器意识、机器的主体地位等命题的辩论。但“意向性(intentionality)⑤”不是“意图(intention)⑥”,在对这一问题的探讨中,普特南的功能主义论证对于今日AI 的发展是有效的,如在机器的理解中加入其他参照物、知识图谱中的本体论联结、在人工神经系统中加入逻辑结构。古典哲学中的“意向性”并未阻止AI 科技的进步。

三、对联结主义AI 的反思与展望

鉴于近期生成式AI 的火热,这种在使用上通过文本描述而生成内容的AI 重新燃起了对智能和“通用人工智能”这类话题的讨论热情,其中最为火热的莫过于ChatGPT 及其所引发的争议。GPT 打造了一个LLM(大型语言模型),这种模型使用了神经网络来监督和强化学习算法,打破了以往很多哲学上关于AI 的偏见,相应的争议更是接踵而至。尽管ANNs 已经取得了如此高的成就,但是它仍旧存在着根本性的限制。因此,在这一部分,我们将从学科理论基础的角度阐述这些问题。

1.联结不是一切。1997 年,IBM 公司的深蓝(Deep Blue)使用穷举法击败了国际象棋大师;2019年,DeepMind 的Alpha Star 在星际争霸2⑦中完胜人类职业选手。通过对监督学习算法建立的神经网络强化学习的训练,联结主义AI 已经能在许多电子游戏中优于人类玩家,但Alpha 和各种Game AI只能用于特定环境中,如下围棋的Alpha Go 并不能玩转星际争霸,这不仅是由于训练出的神经网络的独特性,更是因为这些网络使用的能力是决策而不是推理。这种基于权重的决策可以称为衡量,而推理则是逻辑,这两种能力都存在于人类的大脑之中。即使这两种能力有某种程度的相似,即都是在环境下作出的正确判断,但是在规则和目标明确的环境中作出判断和在开放环境中作出判断所运用的能力是不同的,这也就是为何无法将联结主义AI 作为操盘者运用在规则明晰但是环境开放的股票市场中的主要原因。其中一个主要限制在于:微观层面上的突触重组、神经递质和激素神经调节对神经元兴奋性的影响无法达到宏观层面上的大范围同步尖峰活动、具备全球连通性[21]。联结主义AI的网络模型仍无法在多个层次上模拟大脑,若是要摆脱“专用人工智能”的限制,就必须开发出将符号系统的表达性和程序多样性与联结主义表达的模糊性和适应性相结合的系统[22]。

神经符号人工智能(Neural-Symbolic AI,NeSy AI)的理念是对联结主义和符号派的一种综合,此项研究在理论上一直有进展,但在实际应用中却很难有突破。原因在于:其一,虽然人脑可以使用完全物理的神经网络来解决高度抽象的推理问题,但我们对其中的潜在机制只有部分了解;其二,人脑是由神经元通过交换颤动的生物电脉冲而不是像单词一样的符号来工作[23],思维中逻辑结构的工作方式与人脑的工作方式显然不同。尽管存在如此大的差异,布雷泽克(P.J.Blazek)和米洛林(M.M.Lin)的近期研究在解决神经符号问题上还是更进了一步。本质神经网络(Essence Neural Networks,ENNs)(见图5)在一定程度上破除了由反向传播和随机梯度下降带来的“不可解释性”,在其中,每个神经元都具有区分功能:概念神经元区分“像A”和“不像A”,分化神经元则区分“更像B”和“更像D”。ENNs 通过此过程建立起逻辑结构,模拟出符号AI 程序的功能。布雷泽克表示,“ENNs 建立了一个广泛的计算框架,以破译认知神经为基础而追求通用人工智能”[24]。虽然ENNs 在逻辑推理方面做出了很大的努力,但这仍然不够,其中的神经元仍然要经过训练,训练集仍然是其智能的“先天条件”。在图像识别和文本翻译中,ENNs 或许能取得不错的成绩,但这些能力离“通用人工智能”仍有很大距离。总的来说,这至少是个不错的开端,AI 程序或许并不需要直接复制人类的认知过程,但通过AI 的认知过程可以反思人类的认知结构,从而了解我们是如何思考以及大脑机能是如何促成这种思考的。AI 的作用之一就是在我们对人类思维的思考中引入更多的结构,若是只把思维看作一种东西,就无法深入了解更多了[25]。

图5 本质神经网络

2.如何理解“智能”。学习算法是ANNs 得以体现智能的方法,但它与人类的学习模式仍有很大的区别。在生物神经网络中,大脑中存在着康德所说的“先天综合判断”的结构,即在进行任何学习之前,大脑中已存在一种先验的知识结构⑧,如“时间感”“空间感”“数学知识”“趋利避害”等先天能力,这些初始状态部分最初并不需要通过学习来获得,而是遗传衍生的生物进化的副产品,是由生物本能所带来的生物智能[26]。这个结构中配置了一切使我们获得知识得以可能的重要信息,通过学习可以不断对原始的知识表示结构做出调整,并使新获得的知识和能力在大脑中呈现一贯性和结构化;与生物神经网络不同,ANNs 的这种结构通常都是从数据集中训练、以所选择的问题为导向、通过算法优化调整神经元中的权重而得来的。知识表示结构对于ANNs 来说不是先验的,而是经验的,且这种结构不会随着时间的推移发生新的改变。当然,也可以通过调整ANNs的学习目标从而使神经元中的权重再次发生变化,但同一ANNs 程序仍无法习得多种不同的知识或能力。

由此可见,学习在生物智能中表现出的是一种综合性行为,而在人工智能中则是一种专门性行为,这也就是为何ANNs 在某一方面的学习和功能可以比肩甚至超过人类的能力,但仍无法达到智能的综合层面即“触类旁通”“举一反三”等的原因所在。这对于人工智能功能化的编程存在着潜在挑战:从经验水平上研究大脑,可以把大脑限定为精确“编写”的水平,即计算机中的“逻辑门”水平,但是大脑处于神经元的生物水平,编写出神经元的所有脉冲联结序列,就足以说明“神经计算”吗?[27]答案显然是否定的,即使可以确定神经活动的规则,也很难得到生物的神经规则和计算的思维规则相一致的解释。生物智能和人工智能不仅有层次的区别也有质的区别,若要使人工智能适应不同的环境并真正智能化,需要选择适当的程序来解决它们在不同环境中遇到的新问题。能够解决选择程序问题的程序称为“元程序”,ANNs 的编程在特定问题上的执行效率可能高于生物智能,但这种特定程序不具备也无法作为“元程序”;恰恰相反,只有生物智能可以作为生物全部行为和思想的“元程序”。这种从生物的生存和繁殖的历史过程中发展出的“元程序”以生命作为载体,但编写出的人工智能程序没有也永远不会有这种独特属性。除非有一场思想革命认为“生命”之类的词应该被删除,否则“智能”在人工智能和生物智能中永远会有这种区别。

3.认知科学的大模型理论愿景。上述两节分别谈到了ANNs 无法达到生物神经活动的宏观层面和生物“元程序”缺失的问题,说明了联结主义进路上的部分技术缺陷。尽管NeSy AI 这种将符号和联结进路相混合的方式给后续的研究指明了一定的方向,但由于基础理论的缺失,其仍需进一步发展[28]。基于现有的研究基础,认知科学中的大模型理论也被广泛认为是理解和解释“智能”的方法之一。

在20 世纪,由罗森布鲁姆(Paul Rosenbloom)等人提出的SOAR 认知模型和安德森(John Anderson) 提出的ACT-R 获得了广泛的关注。SOAR 模型把推理、学习、感知、运动控制、语言、认知发展、情感甚至可能是意识等不可言喻的品质,所有这些都放在一个连贯的框架内[29]。由于人类认知的多样性,SOAR 无法囊括所有结构,因此在应用中可能会提出其创建者从未预料到的解决方案⑨[30]。ACT-R 则是典型的ANNs 模型,它是一个关于大脑的总体框架,规定了大脑的组织以及这种组织如何产生思想[31]。无论是SOAR 还是ACT-R 都超越了联结主义和符号进路的传统辩论,事实上,任何一个大模型都必须包含二者的优点,因为所有关于认知的符号方法都旨在使用某类实体和系统将思维描述为大脑功能的产物。最近的认知科学理论提出了产生人类行为的双重过程(有时被称为系统1 和系统2),这为协调符号和联结主义人工智能AI 的各个方面提供了一个理论框架。根据心理双过程理论,系统1 是联想的、默示的、意象的、个性化的、快速的,而系统2是分析的、外显的、言语的、概括的、缓慢的[32]。值得注意的是,此项研究认为,人类认知中的系统1和系统2 之间的关系并不是直接的一对一的对应关系。虽然系统1 可能同时包含了符号和联结AI的抽象功能和算法,但系统2 中的功能和算法尽管是基于符号方法的,却是在人脑的神经网络上实现的。

当下ANNs 技术性问题已经越来越少,而科学性的问题却越来越多,这些问题大部分都与认知科学相关。虽然能在GPT 上看到LLM 的成功,但是自然语言毕竟只是认知的一部分;虽然语言处理很重要,但并不能代表整个认知模型和过程。因此,认知大模型的理论在AI 研究中经常是缺失的,这一方面是由于认知科学的发展放缓,另一方面也是由于技术性研究超过了科学性研究。在这一点上,认知科学的整体(包括哲学和AI 研究)仍然需要做出努力。

结 语

本研究探讨了联结主义范式,揭示了其哲学根源,并基于当下研究对未来的可能方向做出了展望。虽然人工神经网络已经取得了重大进展,但联结主义人工智能目前仍无法实现真正的智能。这不仅源于人工神经元与生物神经元之间存在的差异,更是源于人工智能对工程师所定义的问题的依赖。人工智能要实现真正的智能,必须具备自主决策和主动寻求解决方案的能力。“强人工智能”的愿景不断激励着人工智能学者,但其复杂性往往导致人们将注意力集中在较窄的领域,从而导致对这一话题的相对沉默。中世纪的哲学家们提出的关于“智能机器”的观点,虽然与今日的人工智能概念相去甚远,但现代技术娴熟的人工智能专家也仍未为实现强人工智能建立起一套被普遍接受的科学理论。因此,未来的研究应侧重于识别人工智能解决问题范式中的固有局限性和偏见,同时加强人工智能与认知科学之间的跨学科合作,将人工智能哲学研究中考虑的认知因素、主体责任观念和人类价值观等融入人工智能的发展之中。随着人工智能对我们的世界的不断塑造,我们的目标仍然是超越当前研究的界限,开创一个让人工智能系统真正体现智能、具备自主性和伦理责任的时代。

注 释:

①赫布学习规则认为,大脑学习新的东西时,神经元会被激活并与其他神经元连接,形成一个神经网络。这些连接最初很弱,但重复刺激会使连接越来越强,它们之间的连接的权重就会相应增加。参见:Hebbian theory[Z/OL]//Wikipedia.(2023-08-27)[2023-09-01].https://en.wikipedia.org/w/index.php?title=Hebbian_theory&oldid=1172449656.

②NP 完全问题最直观的一个例子就是旅行推销员问题,它是一个被广泛研究的组合优化问题。即给定一组城市中某城市到另一个城市的距离和旅行成本,在同一个城市开始和结束,每个城市只需访问一次,求解推销员最小成本的最优路线。参见:Travelling salesman problem [Z/OL]//Wikipedia.(2023-08-18)[2023 -09 -01].https://en.wikipedia.org/w/index.php?title =Travelling_salesman_problem&oldid=1171041134.

③在此文中,麦卡洛克和皮茨使用了非现在所熟知的逻辑语言来论述无环网的具体推理步骤,为节省篇幅在此不进行解释,但其功能已在“人工神经网络的兴起到感知机的挫败”段做出概述。

④斯图亚特·德雷福斯(Dreyfus S.E.) 是休伯特·德雷福斯(Dreyfus H.L.)的亲戚,他的研究方向是人工神经网络。

⑤See JACOB P.Intentionality [M/OL]//ZALTA E N, Nodelman U.The stanford encyclopedia of philosophy.Spring 2023.Metaphysics Research Lab, Stanford University,(2023-02-07)[2023-09-01].https://plato.stanford.edu/archives/spr2023/entries/intentionality/.

⑥See SETIYA K.Intention[M/OL]//ZALTA E N, Nodelman U.The stanford encyclopedia of philosophy.Winter 2022.Metaphysics Research Lab, Stanford University,(2022-07-20)[2023-09-01].https://plato.stanford.edu/archives/win2022/entries/intention/.

⑦暴雪公司推出的一款即时战略游戏。星际争霸的游戏地图与围棋地图同样是坐标系,不同的是前者在这个坐标系中添加了资源、环境等为获得游戏胜利而需要考虑的因素,但是二者仍然具有类似的基本规则,即进攻、防守和布局等基本游戏策略。

⑧在这里的先验知识采用的是康德的解释,这是一种在逻辑上先于经验并使得经验知识得以可能的知识。

⑨由于人类认知的复杂性,这往往是大模型的通病。