价值对齐:AIGC时代人机信任传播模式的构建路径

喻国明 滕文强 武迪

【内容摘要】信任是沟通人与智能技术的桥梁。当人机传播的构建与协调成为当下传播学的重要议题,将信任这一要素纳入关系的构建是打造可持续发展的“人—机”关系的必要举措。本文以构建人机传播之间的信任为核心议题,通过梳理信任传播的要素变迁,站在任务—技术匹配视角下探寻人机信任的关键地带,并厘清信任校准的动态过程,以及信任校准的关键通路。作者认为未来要致力于发展可信的人工智能,实现健康的人机传播关系,以推动未来传播的良序健康、以人为本的发展。

【关键词】信任传播;人机信任;信任校准;AIGC

一、问题的提出:人机同构下的信任传播

马克思认为“社会是人与人形成的关系总和”,社会的构建离不开关系。当下,信息技术的革命加速社会与媒介的相互融合与渗透,媒介不仅拓展了传播场景,打破了时空界限,也丰富了关系构建的多样性。“人机传播”(Human-Machine Communication,简称HMC)就是在此背景下,由人工智能技术赋能的全新关系。AIGC时代,“人机传播”不仅实现了关系上的“耦合”,也实现了个体从思维到行动自由度的拓展。从人际传播到人机传播,不仅意味着传播主体数量上的丰富,也意味着因人际传播产生的问题出现了可以由人工智能解决的可能性。①

“信任”(Trust)是任何稳定关系展开的前提。萨布丽娜·罗曼诺夫(Sabrina Romanoff)认为,“信任是人际关系的基础。”当人机传播的构建与协调成为当下传播学的重要议题,将信任这一要素纳入关系的构建是打造可持续发展的“人—机”关系的必要举措。而信任建立的前提是完成机器从“工具理性”到“价值理性”的视角转化。

人机耦合的场景下,人类与人工智能的关系具有超过工具主义的内在特征。②“代具性”是理解人与机器关系的逻辑之一,正如笛卡尔的“身心二元论”将身体和心灵视为互不相干的两个实体一样,“代具性”突出人体与技术的分离性。麦克卢汉的“媒介即人的延伸”同样蕴含“工具主义”的色彩。技术哲学家斯蒂格勒认为,“人类发明了技术,技术同时又发明了人类,二者互为主客体”,其强调人类缺乏足以维持自身生存的本能,必须借助外在于自身的技术而生存,则为体外化(exosomatization)。③显然,工具理性下的人机关系强调体外化延伸并强化某种器官的功能,机器只是作为人类的感官化延伸。这个阶段,人机关系停留在功能“互补”层面,忽略了人机协同共生发展的可能性。

芒福德认为,在“新生代”的技术体系下,如果人们不能采取整体的、系统的、以生活为中心的观念去衡量技术,那么新的技术未必能塑造出新的文化和观念。当下,一些技术离身的二元框架在社会与媒介互嵌的场景下有忽略人主体间性的嫌疑。而芒福德的观点为我们理解人与技术的关系提供了别样的视角,即从整体理解人与技术。同构性(Isomorphism)在哲学中可以理解为逻辑层上不同事物之间在结构和性质上具有相似性和可比性,对于以模仿人的特性而被称之为人工智能的机器而言,“图灵测试”的提出已经印证人工智能技术发展的目标,即机器对人心智的模拟,似乎人与机器的同构从制造之初已埋下伏笔。我们在那些器物中见到的品性,其实正是人性的“復现”,是自己的映像。④唐·伊德认为,技术不仅转化了我们对世界的经验、知觉和对世界的解释,反过来,我们在这一过程中也同样被转化了。⑤因此,从人机同构性上整体考量人机关系将为构建人机信任传播模式提供整体的发展路径。

生成式人工智能时代(Artificial Intelligence Generated Content,简称AIGC时代),传统的二元论已然无法解释人与技术的关系问题,新技术的涌现不仅完成了个体思维版图的扩张,也完成了技术具身的可能。人工智能已内嵌于社会技术之中,与人工智能的交互普适化已不言而喻。在这样常态化的背景之下维持良好关系互动,人机信任的构建是必要且唯一的,而构建一个完善且适配的信任传播模式才能实现人机信任。

二、技术与社会互嵌:信任传播要素的变迁

理论学家对于信任的研究缘起于齐美尔⑥。齐美尔提出“信任是社会中最重要的凝聚力之一”⑦,其提出的“货币理论”同样突出了信任的重要性。齐美尔的媒介货币哲学认为“货币即媒介”,在媒介化社会的背景下,媒介的社会连接功能或社会形式影响人们的身体感知与信息获取。⑧社会连接肇始于互动,而互动的主要形式是交换,当货币作为媒介进行交换时,信任的获取显得尤为重要。从齐美尔的信任延伸至人际交往中的信任可知,信任的定义虽因学科领域区别而有所出入,但目前达成共识的定义是:信任是涉及交易或交换关系的基础。从齐美尔的货币时代到当下的数字文明时代,从狭义的货币媒介再到数字媒介,技术与社会互嵌成为常态,人机关系如何构建成为社会网络延伸的重点。信任是人机协作的必要条件,由此可见,传统的围绕人展开的信任传播要素将全方位围绕信任主体、信任关系、信任场景重新构建。⑨

(一)信任主体的多维:从个体到算法再到机器

信任是嵌入在反复、紧密的关系当中,⑩而关系的构建离不开主体,信任传播的主体在数字文明时代随着技术的发展呈现多维发展趋势。在人际信任中,信任的双方都是人,作为人际关系互动的重要条件,信任帮助人们面对不确定性。作为社会环境的基本特征,不确定性贯穿于人类历史始终,而在不同的历史阶段,使信任成为可能的确定性基础存在不同。从农业社会、工业社会再到后工业社会,依托人际关系的形态即熟人社会和陌生人社会,信任被区分为习俗型信任、契约型信任以及合作型信任,这种信任的分类方式也是基于“不确定性”而构建的。这种“不确定性”随着工业化的发展愈演愈烈。当人们进入现代性状态,社会变迁引发的人类的“不安”将成为一种常态,这也愈加凸显信任的价值。当这种不安感随着数字文明时代的逐步扩展进入网络社会,在信任主体多维化的赛博空间构建信任,成为媒介化社会关系网络建立前提。

显而易见,信任的讨论离不开人这个主体。信任围绕着互动产生,按照这个逻辑,凡是能与人进行互动的对象均能作为信任的发生与接受的主体。那么对于算法与机器而言,将其纳入信任传播模式的构建路径中显得尤为必要。算法,作为人工智能技术的本质,也是一种权力。福柯将权力视为一种关系,当算法与人的关系在认识论上偏向二元论框架时,就会存在“算法神话”的理解,即强调了算法的无所不能。“无所不能”延伸出的并不一定是人们对算法的依赖,也可能是“算法黑箱”。算法或算法公司目标与意图的模糊性与不确定性增加了人与算法信任构建的难度。算法作为人工智能技术的基石,将这一问题同样延伸到了AIGC时代。如果说信任方是Trustor,目标信任对象是Trustee,那么在人机协作中,Trustee可以是技术本身,也可以是技术提供者。人机合作中的信任是人向机器发起的意向行为,如尤斯拉纳所说,“信任是通往合作的道路”,由此可见,人机共生、人机协同离不开信任的构建,从人际关系到人机关系,呈现主体多维化趋势,但关系的构建仍有一脉相通之处。

(二)信任关系的拓展:从人际关系到人机关系

信任主体的增加意味着关系的建立也实现从人际关系向人机关系的转变,这种转变并不是取代,而是信任关系的拓展。关系的建立一直是社会学讨论的重点。从费孝通的“差序格局”到李沛良“工具性差序格局”,都表明关系的理解是理解社会重要现象的重要基础。关系的建立与工具主义导向密不可分,“关系是以交互性,即传统的‘报’的概念为基础的”。人际关系的工具属性在于双方互惠互利得以维持关系的继续。工业时期,人与机器关系的建立同样凸显技术利己的特性。随着时代的变迁,当人工智能机器成为关系建立的对象,从人机协同到共存,人使用机器通常伴随着辅助工作、提高效率、解放人力等提升人自由度的目的,而这种关系的建立是脆弱的。当技术的成熟度与人类的信任不相匹配时,便会出现危机。当信任存在风险,那么信任的产生就没有必要性。因此,从人际到人机的关系的拓展,是一项需要逐步建立信任、强化信任、维持信任的过程。而发展可信的人工智能则需要在“人—技”关系问题上选择并确定一个恰当的认识论。

罗杰斯的“创新扩散理论”为技术接受模型提供原始理论框架。数字文明时代,以人工智能为驱动的人机交互技术已经扩散并与各类场景相融合。该技术的发展也为人机关系的形成奠定基础,而人机关系的发展也历经了从“人适应机器”到“机器适应人”的转变。早期的人机关系呈分离状态,人作为适应机器的存在,各方面受限于技术的用户界面。随着技术的演进,人类的“自然”交流方式和人类的情感逐渐被纳入交互技术的考量之中。人机关系随着技术发展动态演变,当下随着技术形态的进一步发展,以人工智能为核心的机器不仅能够辅助个体达成目标,并能够依据人类目标不断完善其智能性,实现人机双向互动。而这种状态的维系,需要信任的支撑。塔德欧将数字环境下的信任称为电子信任(E-trust),并否认信任的产生需要直接的身体互动的观点,这也说明人机关系中信任的建立在路径上是可行的。

(三)信任场景的流动:从现实空间到虚拟空间

AIGC拥有数据巨量化、内容创造力、跨模态融合以及认知交互力的技术特征,这些特征融合在一起便具有了拓展个体认知边界、提高知识生产力、丰富创造能力的功用。卢曼认为,“不管组织与理性计划怎样努力,人们不可能根据对行动后果的可靠预测来指导所有的行动。仍有剩余的不确定性有待处理,信任就是妥善安排这些不确定因素的角色。”AIGC时代,人工智能辅助生产便是消除人们不确定性的存在。当人机共生成为常态,信任的发生场景也就随着信任对象迁移至虚拟空间中。人机共生有广义与狭义之分,广义的人机共生可以看作一种新的生存环境,而狭义的人机共生强调的是人新的生存状态。当讨论信任场景流动时,我们关注的是广义的人机共生。

数字化生存成为常态,人们对于信任的获取打破了地域、场景、时间的限制。当人们不是依赖于具体生活环境取得信任时,那么脱离具体情境的信任就会走到虚拟的时间和空间中去。吉登斯的“脱域”为信任场景的流动提供理论支撑,其指的是社会关系从彼此互动的地域性关联中,从通过对不确定的时间的无限穿越而被重构的关联中脱离出来。当人机共生成为一种新的生存环境,赛博格化的人成为虚拟空间中的存在,其关系的建立并不仅仅局限于现实空间中因地缘联结的人,而是同样包含了内嵌于复杂虚拟社交网络中的人工智能。也就是说,信任建立的场景已然朝向虚拟空间的“流动”发生变化。那么如何在流动的信任场景中构建人机信任将成为传播学考察的重点,而基于任务技术匹配理论,人机信任传播的构建成为可能。

三、有效匹配:任务—技术匹配视角下人与机器信任塑造的关键地带

人的本质不是单个人所固有的抽象物,在其现实性上,它是一切社会关系的总和。当前,在智能技术不断发展和深度媒介化进程不断深入的背景下,媒介技术成为社会变革和向前发展的内核程序(Kernel)。AIGC时代的技术发展已不再仅仅是对于人感知系统的重新整合,更是对传统媒介社会的重新定义和全面超越,社会新的文明环境系统将由此落地达成。智能也是人、机和社会环境系统相互作用的产物。任务技术匹配模型(Task-Technology Fit)认为信息技术对用户的使用绩效有显著影响,用户对技术使用的感知会随着任务变化而改变,技术和任务只有有效匹配才能有助于提高工作绩效。在当前的技术环境下,如何实现“有效匹配”依然是研究的热点话题。

智能是一个复杂系统,想要厘清各个主体之间的关系,我们需要利用主体责任的思维来看。在这个复杂系统之中,人要解决的是“做正确的事”,机器要解决的是“正确地做事”,媒介环境要解决的是“提供做事平台”。AI技术充分赋能媒介的社会系统,这个混合智能系统需要的不仅是技术的强计算能力,更重要的是人的智慧,进而形成一种理性与非理性、技术的计算和人的算计深度混合的智能系统。而要想实现各个主体之间的相互协作与系统效用最大化,一个关键的要素就是“信任”。要想准确把握系统主体之间的信任要素建造逻辑,首先我们需要厘清智能主体之间的认知模型。

(一)人的意向性与机器的形式化认知因素

人类的认知结构可以分为“注意—意向—决策—感知與行为”,是通过后天习得的认知能力来完成对外界环境的感知,是一种意向性的思维认知。机器对外界环境的感知通路是通过传感器,其认知过程经历知识库目标层、任务计划层、感知层和执行层,进而形成形式化思维。以人和机器对算法的认知路径为例,人们在对算法产生意向性后,此时算法已经走向人们的日常生活,成为普遍性的分析和处理问题的方法,认知到的新算法也成为人们认识和理解世界的“方法革命”的新策源地;而机器将算法形式化,通过程序开发与计算机可以识别和执行的具体指令实现算法操作的“计算机世界”。同时,智能从一定程度上来说源于人的认知方法,是人们适应智能技术的产物,是人的认知与智能技术内在逻辑的交叉。两类主体之间,技术是人类认知的一种映射,这种映射在形式上将“我们是怎样思考和解决问题的”这一看不见的脑中路径以看得见的符号形式和符号变换过程表征出来,并成为机器的信息运作规范,成为一种“镜像”可以供人反过来阐释自己的认知。因此,人与机器在认知世界的过程中具有相同的分层认知架构,在不同层级之间会形成一定因果关系,在相同的层级之间会形成混合空间,而未来传播的关键在于掌握混合层级之间的“恰好”。

(二)双向信任:人机传播过程中信任的建立过程

人机传播是在技术嵌入的过程中形成的一种新的传播模式。人的生活需要通过媒介实现,媒介的价值需要人的发展实现,二者的耦合共生直接决定了新媒介环境下人机传播的新方式。首先,在传播的输入端,人机传播内容并不仅仅依靠机器这样的硬件来收集主观感知,而是通过智能技术把人与机器连接为知识生产的流水线,将人与机器两个接触点相结合,将人们的具身认知与延展认知集合为一个新的认知系统,先验知识形成一种新的输入模式。其次,在传播的信息处理阶段,智能技术将人类的认知模式优势与计算机的计算能力优势相结合,构建成一种新的信息理解方式,人们将部分计算、推理、识别等功能移交给智能技术,技术成为延展认知的桥梁;在传播的输出端,技术将反作用于传播者的影响力和整个社会操作系统的运作效率,同时也使得知识的产生和运用进入一种新的组合方式,将人类决策的价值效用添加到智能技术的迭代之中,进而实现传播模式的进化与迭代。在传播互动的过程中,人与机器的理解将会从单向度迭代为双向化,机器不断从人类积累的传播资源中完成价值赋权,人的主动性与机器的被动化交互在一起。

信任是一种心理状态,是指一方基于对关系中另外一方意图或行为的正面期望而愿意承担损失的倾向。媒介信任作为一种个体行为,是个体在调整对自身和媒介环境认知的基础上能动反思,持续建构的结果。而在人机传播中,信任是预测传播关系是否健康的一个重要指标,是交换关系的基础,是一种随着社会关系出现或嵌入社会关系中的一种应然属性。人机互动中的信任不是直接发生在人际之间,而是发生在人与智能系统的交互之中,信任的产生能够帮助人们在与智能系统的交互中克服不确定性。人机互动过程中的信任会随着合作状态和信任主体的变化而变化,人机互动中的信任是一个持续的关系,而不是一个静态的概念,因此对于信任的理解应该进一步考虑信任主体双方的合作动态。建立默契的信任机制,可以在发挥人类智慧的同时,合理运用人工智能系统的高性能,实现技术资源的有效匹配。

技术本身蕴含着对于个体行为的塑造与偏向,在人机交互过程中的信任演化可以分为两个阶段:初始型信任(Initial Trust)和持续型信任(continuous Trust)。初始型信任发生于人机交互之前,是信任方(人类)对于目标信任主体(智能技术)认知不充分的条件下进行预期责任的一种行为。在初始型信任阶段,信任方会基于先前的认知判断作出理性决定进而扩展信任。持续型信任发生在人机交互之后,是信任方(人类)对于目标信任主体(智能技术)积累了一定的认知条件,在具体的情境下完成互动行为。持续型信任的本质是将交互结果加入反馈路径之中,交互的最终结果将会影响信任双方的下一次互动。

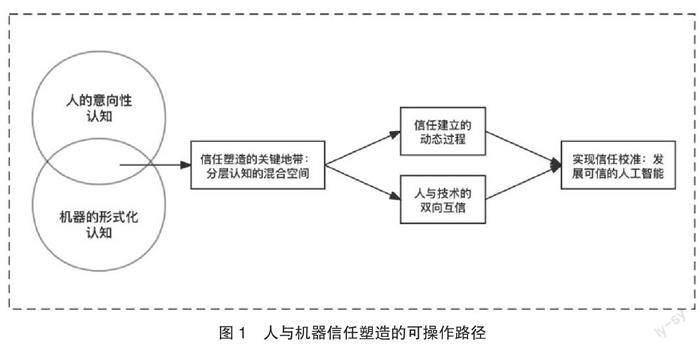

在一个充满变量的人机交互系统中,信任的逻辑并不是必然或确定,而是一种可能性的同步,人机信任是一个变化过程。人机交互信任的建立过程,本质上也是反映人们对于智能技术的心理预期建设与智能技术自身优化效能的一种交互过程,这种交互过程是在人类与技术双向互动中逐步建立起来的(如图1)。

四、信任校准:人机传播协同演化的底层逻辑

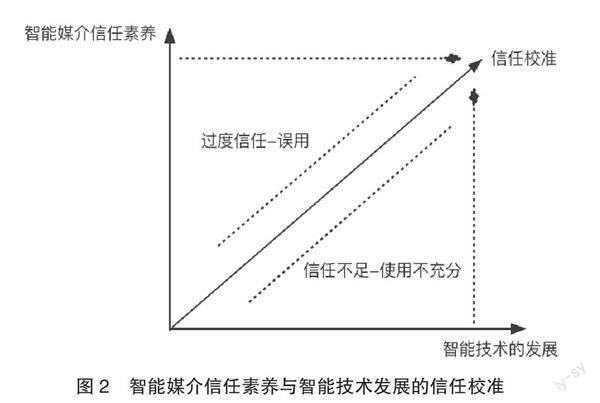

正如前文所言,人机之间的信任程度是连续的,人机之间信任链的产生过程常常是:陌生—不信任—初始信任—持续信任—强信任。在这个过程中,信任在人机传播中占有重要的作用,是沟通人与智能技术的桥梁。人们的智能媒介信任素养和智能技术发展水平要始终保持在正比例关系上,一旦偏离,便会产生过度信任和信任缺失。因此,如何完成信任校准便成为了一个重要的课题。

(一)智能媒介信任素养与智能技术发展的价值对齐

如图2所示,在良好的信任校准过程中,人们的智能媒介信任素养与智能技术的发展程度处于动态性变化中,两者之间应处于正比例关系,理想型的信任校准处于直线上。如果人机传播中的信任要素分布于直线上方,即人们的智能媒介信任素养超过了智能技术的发展程度,这就会导致过度信任的情况。当我们向智能技术让渡过度的媒介信任,减弱对智能技术的控制和监管,就会出现秩序紊乱。如果人机传播中的信任要素分布于直线下方,即人们的智能媒介信任素养低于智能技术的发展程度,就会产生信任缺失,导致智能技术的不充分利用甚至停用。我们要认识到滞后的信任素养可能正成为智能技术发展的掣肘。“信任滞后”抑制了我们指导技术并明智、合乎道德和审慎地控制技术的能力,不能就现代技术的适当应用快速形成广泛的社会共识。因而,人机交互过程中的“信任校准”是指可感知信任与实际信任的平衡,对过度信任进行抑制,而对信任不足进行修复。

以当前AIGC赋能媒介社会的发展来看,人与技术的相容相生、互相形塑为人的行为边界扩展与自由度提升乃至于个性的解放提供了可能。而要正确利用ChatGPT优化人与技术的黏性,就需要信任校准的参与过程。一方面,ChatGPT对于个体需求以及积极回应达到了更为全面的状态,要想正确利用AI技术解决实现人类增强,仅有技术的突破是远远不够的,还需要人们形成与之匹配的大模型信任素养、智能技术信任素養等。另一方面,ChatGPT要学习人们不断增长的知识库,针对对话进行加强,减少不恰当回复,让人工智能模型的产出和人类的常识、认知、需求、价值观尽可能匹配。因此,信任的动态调整过程也是技术与人、与社会之间的感知认知一体化的过程,在调整的过程中实现自我修复和自我迭代,在动态结构中重塑社会信任模式。

(二)信任校准的关键通路:发展可信的人工智能

智能技术与人类的生存不再是传统的二元对立,技术发展所催生的人机同构、人机共生的深度融合关系塑造了人类以技术为中介的生存样态。唐·伊德认为,说到底人和技术的关系是一种内在的“存在论关系”模式。而人类与智能技术的关系应该向存在论的内在关系转变。社会学家迪戈·甘贝塔(Diego Gambetta)认为,信任是降低复杂性的一种有效形式。其实,信任是必须被预设的内在基本要素,它不是创造出来的,而是从社会关系中产生的。在人机传播的模式中,人机交互已经内化成为人类社会存在的一部分,智能技术也是媒介社会的底层操作系统,因此,发展可信的人工智能就是在这种社会关系和发展逻辑上被预设的。

发展可信人工智能的关键在于增强人工智能的可信任性,而不是谋求满足人工智能对“类人信任”的前置条件。构建并增强AI的可信任性,需要构建一个值得被信任的社会技术系统。欧盟发布的可信AI伦理道德指南中建议可信AI系统需要满足4项基本原则:一是尊重人类自治原则(the principle of respect for human autonomy),即智能技术的用户应能够保持充分和有效的自我决策。同时智能技术系统的设计应该以补充和增强人的能力为目的;二是伤害预防原则(the principle of prevention of harm),即AI系统不应对用户或环境造成伤害或加剧伤害,AI系统及其运行环境必须是可靠的;三是公平性原则(the principle of fairness),即利益和成本的平等,通过公平分配以确保个体或群体不受不公平的偏见和歧视;四是可解释性原则(the principle of explicability),即智能技术的能力和目的需要被公开,且需要尽可能使直接和间接受影响的人能够理解系统的决策过程。生成式AI的信任构建并不是一个短期的表现和过程,其形塑的新的模式、新的机制将会长期影响且存在于信息生态之中。

如果说互联网是信息传播的成本和效率革命,即信息的零成本复制传播,那么生成式AI则是信息生产的成本和效率革命,即有望形成信息和知识的零成本生产创造。的确,任何事物的发展都必将有一个泡沫的过程,尽管目前生成式AI有各样的问题,存在着高度的不确定性,但我们不能目光仅仅聚焦于它的风险以及人们对其的依赖,而需要我们通过信任的视角去理解智能技术嵌入人类生活的方式。技术发展的最终目的仍是服务于人类的发展,如何充分利用好AIGC技术,应对可能存在的风险,发展可信的人工智能,在前进的过程中实现信任校准和价值对齐,这应是AI开发者、从业者、信息平台和每个AI技术的使用者共同参与解决的。

五、结语

麦克卢汉在《理解媒介》中表明,新技术对社会变迁的影响从来不是沿着其出生目的那一方面线性的延伸,而是对整个社会有机体做的系统性“大手术”。新媒介以新的连接、新的标准和新的尺度构造新的社会,实现社会的再组织,信任也在持续不断的人机交互中呈现组织动态变化。当信任的预期落空,感知到信任违反,信任校准偏离,信任受损也随之产生。尼尔·波兹曼在《技术垄断:文化向技术投降》中提到“每一种技术既是包袱也是恩赐,不是非此即彼的结果,而是利弊同在的产物”。AIGC时代,分析当前的技术背景与信任边界有助于研判人机关系的新特征,预测与指导传播生态良序发展。未来,AIGC还将进一步深化社会深度媒介化的进程,要想实现健康的人机传播关系,实现人机协同与共生,在信任受损后的信任修复、信任再校准(Trust Re-calibration)也是值得深入讨论的话题。

参考文献:

①彭兰:《人机传播与交流的未来》,《湖南师范大学社会科学学报》2022年第5期。

②刘永安:《类人信任与可信任性:可信人工智能发展的路径选择》,《昆明理工大学学报(社会科学版)》2023年第4期。

③Stiegler B. Technics and time, 1: The fault of Epimetheus. Stanford University Press, 1998, 1.

④胡翌霖、李诗:《拥抱碎片化的麦克卢汉——阅读〈理解媒介〉的一种新视角》,《中国传媒科技》2021年第10期。

⑤〔美〕唐·伊德:《让事物“说话”:后现象学与技术科学》,韩连庆译,北京大学出版社2008年版,第10-15页。

⑥郑也夫:《信任:溯源与定义》,《北京社会科学》1999年第4期。

⑦Georg S, Tom B, David F. The philosophy of money. Trans. Tom Bottomore and David Frisby. New York: Routledge, 1978.

⑧王佳鵬:《作为纯粹媒介的货币:作为媒介理论的“货币哲学”》,《国际新闻界》2022年第7期。

⑨Schoeller F, Miller M, Salomon R,et al. Trust as extended control: Human-machine interactions as active inference. Frontiers in Systems Neuroscience, Frontiers Media SA, 2021, 15: 669810.

⑩Hardin R. The street-level epistemology of trust. Politics & society, SAGE Periodicals Press, 1993, 21(4): 505–529.

张康之:《在历史的坐标中看信任——论信任的三种历史类型》,《社会科学研究》2005年第1期。

张乾友:《论不确定性中的信任》,《道德与文明》2013年第6期。

翟学伟:《信任与风险社会——西方理论与中国问题》,《社会科学研究》2008年第4期。

喻国明、杨莹莹、闫巧妹:《算法即权力:算法范式在新闻传播中的权力革命》,《编辑之友》2018年第5期。

陈炳辉:《福柯的权力观》,《厦门大学学报(哲学社会科学版)》2002年第4期。

毛湛文、孙曌闻:《从“算法神话”到“算法调节”:新闻透明性原则在算法分发平台的实践限度研究》,《国际新闻界》2020年第7期。

Siau K, Wang W. Building trust in artificial intelligence, machine learning, and robotics. Cutter business technology journal, 2018, 31(2): 47–53.

〔美〕埃里克·尤斯拉纳:《信任的道德基础》,张敦敏译,中国社會科学出版社2006年版,第 3 页。

孙立平:《“关系”、社会关系与社会结构》,《社会学研究》1996年第5期。

Gold T B. After comradeship: personal relations in China since the Cultural Revolution. The China Quarterly, Cambridge University Press, 1985, 104: 657–675.

杨子莹:《人机交互关系中的信任问题研究》,大连理工大学2022年硕士研究生论文。

Taddeo M. Defining trust and e-trust: from old theories to new problems. International journal of technology and human interaction (IJTHI), IGI Global, 2009, 5(2): 23-35.

李白杨、白云、詹希旎等:《人工智能生成内容(AIGC)的技术特征与形态演进》,《图书情报知识》2023年第1期。

汪磊:《人而非自然的话语:脱域演进中社会信任的式微与重建》,《中南大学学报》2023年第3期。

彭兰:《从ChatGPT透视智能传播与人机关系的全景及前景》,《新闻大学》2023年第4期。

〔英〕安东尼·吉登斯:《现代性的后果》,田禾译,译林出版社2000年版,第 69-72页。

〔德〕马克思、恩格斯:《马克思恩格斯选集》第1卷,人民出版社1995年版,第56页。

Goodhue D L, Thompson R L.Task-technology fit and individual performance. MIS quarterly, 1995:213-236.

刘伟:《人机混合智能:新一代智能系统的发展趋势》,《上海师范大学学报(哲学社会科学版)》2023年第1期。

肖峰:《认知的算法阐释:人工智能对当代认识论研究的启示》,《学术界》2021年第2期。

喻国明、滕文强、郅慧:《元宇宙推动社会“重新部落化”的底层逻辑与关键入口》,《未来传播》2022年第6期。

段伟文:《深度智能化时代算法认知的伦理与政治审视》,《中国人民大学学报》2022年第3期。

Rousseau D M,Sitkin S B,Burt R S,et al. Not so different after all:A cross-discipline view of trust.Academy of management review,1998,23(3):393-404.

赵梓昕、臧志彭:《激励与治理:社会认知视角下平台型媒体的媒介信任机制——基于身份认同的中介效应实证》,《科学与管理》2023年6月网络首发。

ITOH M,Pacaux-Lemoine M P.Trust View from the Human-Machine Cooperation Framework.2018IEEE International Conference on Systems,Man,and Cybernetics (SMC).IEEE,2018.

朱翼:《行为科学视角下人机信任的影响因素初探》,《国防科技》2021年第4期。

Visser D J E,Peeters M M M,Jung F M, et al. Towards a Theory of Longitudinal Trust Calibration in Human–Robot Teams. International Journal of Social Robotics,2020,12(2),459-478.

喻国明、滕文强、郅慧:《ChatGPT浪潮下媒介生态系统演化的再认知——基于自组织涌现范式的分析》,《新闻与写作》2023年第4期。

杨雅、滕文强、杨嘉仪:《流动·互塑·共生:AIGG时代“人—机”关系新范式》,《社会治理》2023年第4期。

张璐:《浅谈唐·伊德的人—技关系理论中的四种关系》,《吉林省教育学院学报(下旬)》2014年第9期。

于雪:《基于机器能动性的人机交互信任建构》,《自然辩证法研究》2022年第10期。

COECKELBERGH M.Can we trust robots?[J].Ethics and Information Technology,2012,14(1).

刘永安:《类人信任与可信任性:可信人工智能发展的路径选择》,《昆明理工大学学报(社会科学版)》2023年第4期。

European Commission. Ethics guidelines for trustworthy AI. Publications Office of the European Union,2019.https://op.europa.eu/en publication-detail/-/publication/d3988569-0434-11ea-8c1f-01aa75ed71a1.

李功源、刘博涵、杨雨豪等:《可信人工智能系统的质量属性与实现:三级研究》,《软件学报》2023年第9期。

喻国明、滕文强:《生成式AI对短视频的生态赋能与价值迭代》,《学术探索》2023年第7期。

曹建峰:《迈向可信AI:ChatGPT类生成式人工智能的治理挑战及应对》,《上海政法学院学报(法治论丛)》2023年第4期。

喻国明:《生成式内容生产崛起环境下社会协同治理的一项重要举措——试论全过程式AIGC标识的重要性与必要性》,《青年记者》2023年第11期。

喻国明、滕文强、王希贤:《分布式社会的再组织:基于传播学的观点——社会深度媒介化进程中协同创新理论的实践逻辑》,《学术界》2022年第7期。

〔美〕尼尔· 波兹曼:《技术垄断:文化向技术投降 = Technopoly the surrender of culture to technology》,何道宽译,中信出版集团股份有限公司2019年版,第126页。

齐佳音、张亚:《人—机器人信任修复与信任再校准研究》,《机器人产业》2021年第4期。

(作者喻国明系教育部“长江学者”特聘教授、北京师范大学传播创新与未来媒体实验平台主任、中国新闻史学会传媒经济与管理专业委员会理事长;滕文强系北京师范大学新闻传播学院博士研究生;武迪系北京师范大学传播创新与未来媒体实验平台研究助理)

【责任编辑:李林】