基于注意力机制的CNN-LSTM剩余寿命预测研究

赵志宏,李 晴,杨绍普,李乐豪

(1.石家庄铁道大学 信息科学与技术学院,河北 石家庄 050043;2.石家庄铁道大学 省部共建交通工程结构力学行为与系统安全国家重点试验室,河北 石家庄 050043)

随着我国工业技术快速发展,我国在2015年提出了《中国制造2025》以推动中国工业化前进,深入对机械设备健康状态监测的研究。通过对传感器获取的机械设备运行状态监测数据进行分析,构建对应的寿命预测系统可以有效地预测可能发生的故障以及剩余寿命(Remaining Useful Life,RUL),从而给出合理的维修决策,以避免可能造成的人员或经济财产损失[1]。

现有的剩余寿命预测方法主要分为基于模型的方法、基于数据驱动的方法和两者混合的方法[2]。基于模型的方法主要利用研究人员的先验知识对机械设备进行建模研究[3-4]。但是实际工业状况复杂多变,研究人员很难拥有充足的先验知识,因此该方法实践上存在一定的难度。基于数据驱动的方法利用统计学和机器学习的方法提取特征信息进行RUL预测[5],例如支持向量机[6]、人工神经网络[7]、贝叶斯[8]等,但在提取特征时可能造成特征信息的丢失,会对剩余寿命预测结果造成一定的影响。

深度学习的快速发展使得深度学习在预测剩余寿命研究方面取得了不错的效果。WANG B等[9]提出了一种基于递归卷积神经网络的剩余寿命预测方法,得到了较好的预测结果。YOO Y等[10]提出了一种基于卷积神经网络(Convolutional Neural Networks,CNN)的RUL预测方法,利用CNN提取空间特征,进而预测剩余寿命。王奉涛等[11]将长短期记忆网络(Long Short-Term Memory,LSTM)应用于RUL预测,通过LSTM提取时间序列特征以预测滚动轴承的剩余寿命,并获得有效的预测结果。但以上剩余寿命预测方法没有考虑到不同特征对于剩余寿命预测结果的影响不同,应找出对于剩余寿命预测结果影响大的关键特征。韩光洁等[12]将注意力机制应用于RUL预测方法,先通过LSTM提取时间特征,后利用Attention对提取的特征信息分配不同的权重以提高剩余寿命预测的准确性。

为研究不同注意力机制对于剩余寿命预测结果的影响,本文提出了一种基于注意力机制的CNN-LSTM剩余寿命预测方法,包括通道注意力、CBAM机制和自注意力等进行剩余寿命预测试验。该方法利用CNN提取局部空间信息,通过LSTM获取时间特征信息,再使用注意力机制向CNN-LSTM提取的特征信息分配不同的权重,突出关键的特征信息,过滤无用信息,以更准确地表示设备的退化特征信息,最终得到设备的剩余寿命。

1 理论分析

1.1 CNN

LeCun Y[13]等提出的CNN被广泛应用于深度学习各个领域。Abdeljaber O[14]等通过研究发现:1D-CNN可以提取时间序列特征信息。CNN通过局部连接、权值共享和空间池化等提取数据的局部特征,具有较强的抽象表达能力。CNN主要由卷积层、池化层和全连接层组成[15]。

卷积层通过局部连接和权值共享对于信息进行卷积操作,从中提取局部特征信息,其中卷积操作如式(1)所示:

(1)

式中:yk-1——第k个卷积层的输入;

*——卷积运算;

池化层对于获取的特征信息压缩降维,以降低计算复杂度和突出主要特征,常见的池化方法是平均池化和最大池化。

1.2 LSTM

为解决Bengio Y等[16]在研究中发现RNN在处理长数据时存在梯度消失或梯度爆炸的问题,Hochreiter S等[17]提出改进的RNN-LSTM。LSTM网络结构如图1所示,与RNN相比,LSTM增加了3个门结构判断是否保存现有信息,更适用于处理长时间数据的预测问题。

图1 LSTM网络结构

LSTM的3个门结构分别为:遗忘门、输入门和输出门,各个门的作用及计算如下:

(1)遗忘门是对细胞状态中的历史信息选择性丢弃,计算如式(2)所示:

ft=σ(Wf[ht-1,xt]+bf)

(2)

(2)输入门是选择性保存新信息到细胞单元状态中,更新状态信息,计算如式(3)~式(5)所示:

it=σ(Wi[ht-1,xt]+bi)

(3)

(4)

(5)

(3)输出门是根据细胞单元状态决定输出信息,计算如式(6)、式(7)所示:

σt=σ(Wo·[ht-1,xt]+bo)

(6)

ht=ot·tanh(ct)

(7)

式中:ft,it,ot,ct——分别表示t时刻对应的遗忘门、输入门、输出门结构和细胞单元状态;

Wf、bf——分别为遗忘门的权重、偏置;

Wi、bi——分别为输入门的权重、偏置;

Wc、bc——分别为细胞状态的权重、偏置;

Wo、bo——分别为输出门的权重、偏置;

ht-1、ht——分别为t-1、t时刻的隐藏层信息;

ct-1——t-1时刻的细胞状态信息;

xt——t时刻输入信息;

σ——Sigmoid激活函数。

1.3 注意力机制

注意力机制最初于2014年被Bahdanau提出并应用于机器翻译[18],现已广泛应用于语音识别[19]、图像处理[20]等方面。注意力机制有多种实现方式,本文主要选取常用的通道注意力[21](Squeeze and Excitation,SE)、CBAM(convolutional block attention module)机制[22]和自注意力机制。

1.3.1 SE

在实际工业情况下,不同通道有不同的重要性,SE用于解决传统卷积池化中特征图每个通道占比相同带来的信息损失情况。SE利用网络训练特征通道权重,对重要的通道赋予较高的权重,主要分为2个部分:Squeeze和Excitation,其结构如图2所示。

图2 SE结构

(1)Squeeze:对于特征进行压缩,嵌入全局信息得到对应的值,主要通过全局平均池化实现,其计算如式(8)所示:

(8)

式中:zc——矩阵压缩的输出;

dc——第c个输入特征矩阵图;

w——dc的宽度;

h——dc的高度;

i——dc的宽度序号为i;

j——dc的高度序号为j。

(2)Excitation:生成每个特征通道对应的权重,主要通过全连接层实现,第1个全连接层进行降维操作,第2个全连接层升维以拟合通道的复杂性,利用Sigmoid激活函数获取对应的权重矩阵S:

S=σ(W2δ(W1z))

(9)

式中:σ——Sigmoid激活函数;

δ——Relu激活函数;

W1、W2——权重矩阵;

z——Squeeze的输出。

1.3.2 CBAM机制

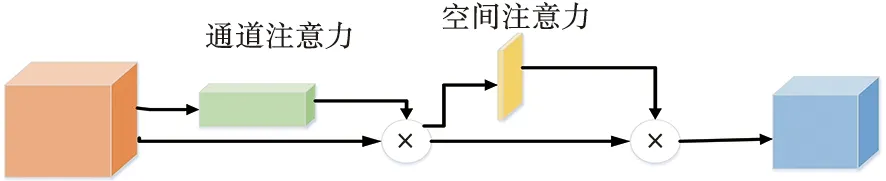

通道注意力机制通过全局平均池化计算各个通道的权重,导致空间信息被忽略。为解决这一问题,WOO S等[22]提出了CBAM,CBAM包含全局平均池化和最大池化在通道和空间2个维度上将注意力串联,得到对应的权重。CBAM结构如图3所示。

图3 CBAM结构

(1)利用通道注意力对特征矩阵经过全局平均池化和最大池化操作,经过2层全连接层以及Sigmoid激活函数获得新的特征矩阵;

(2)通过空间注意力对特征矩阵进行平均池化和最大池化,将经过以上2个池化操作得到的特征合并,经过CNN和Sigmoid激活函数获得新的特征矩阵。

1.3.3 自注意力机制

自注意力机制主要由查询值query、key和value组成[23],其计算步骤如下:

(1)query与每个key点积相似度计算获得权重;

(2)通过Softmax归一化指数、函数对上一步得到的权重归一化;

(3)将归一化后的权重与对应value加权求和得到最终的Attention。

Attention计算如式(10):

(10)

式中:Q、K、V——分别为query、key、value的矩阵表示,Q=K=V;

dk——query的向量维度。

2 预测模型

本文提出的基于注意力机制的CNN-LSTM剩余寿命预测方法网络结构如图4所示,主要由CNN层、Dropout层、LSTM层、Attention层、平铺层和全连接层组成。

图4 注意力机制的CNN-LSTM模型网络结构

寿命预测的具体步骤如下:

(1)将输入的原始数据进行数据预处理,获得n个特征向量{x1,x2,x3,…,xn} 作为基于注意力机制的CNN-LSTM网络结构的输入;

(2)通过CNN层获取其中蕴含的局部空间状态特征;

(3)利用LSTM层提取时间特征信息;

(4)将经过CNN-LSTM提取到的特征信息输入到Attention机制进行加权,本文选用3种不同的注意力机制进行试验,包括通道注意力、CBAM机制和自注意力机制;

(5)将注意力机制的输出经过平铺层转化为一维数据,通过2个全连接层以多对一的形式输出剩余寿命预测结果。

3 试验

3.1 试验数据及参数设置

为验证本文所提出的基于注意力机制的CNN-LSTM剩余寿命预测方法的有效性,选用NASA发布的C-MAPSS[24]数据集进行RUL预测试验。C-MAPSS数据集如表1所示,分为4个子集,每个子集都包含训练集、测试集以及测试集对应的真实剩余寿命值。每个子集均为n×26矩阵,其中n表示每个子集中的数据个数。每一行对应每个时间周期内的26列数据[25],第1列表示发动机单元号,第2列表示当前工作周期数,第3~5列表示操作设置,第6~26列表示传感器值。

表1 C-MAPSS数据集

3.2 寿命预测结果

为证明本文提出的剩余寿命

预测模型的有效性和可行性,选择CNN-LSTM、CNN-LSTM-SE、CNN-LSTM-CBAM和CNN-LSTM-Self-Attention(简称为“CNN-LSTM-SA”)预测模型在同样的C-MAPSS数据集的FD001子集中进行试验训练。利用4种方法得到的发动机预测RUL结果如图5所示。由图5可知,运行周期数较小时预测较为准确,随着运行周期数增加,设备出现故障,预测曲线出现波动,准确性降低。通过对比图5中FD001子集的实际寿命和预测结果可以看出,CNN-LSTM-SA预测结果优于其余3种预测模型结果。因此,在本文中Self-Attention对于剩余寿命预测结果影响较大。

图5 4种模型的RUL预测结果

3.3 寿命预测结果评价指标对比

为评估本文所提出的剩余寿命预测方法的有效性,选用了2种客观的性能度量指标:评分函数和均方根误差(Root Mean Square Error,RMSE)。其中选用PHM2008数据挑战赛的评分函数,其定义如下:

(11)

其中,

d=RULestimated-RULreal

(12)

式中:S——最终计算评分;

n——测试集的引擎个数;

d——RUL预测值和真实值的差值。

RMSE常用于衡量真实值和预测值之间的偏差,具有无偏性。RMSE计算公式为:

(13)

yi——真实值。

为证明本文提出的剩余寿命预测模型的有效性和可行性,选择CNN-LSTM、CNN-LSTM-SE、CNN-LSTM-CBAM和CNN-LSTM-SA与已有论文中D-LSTM[26]、LSTM[27]、FADCNN[28]和GB[29]预测模型在同样的C-MAPSS数据集的4组子集中进行试验训练,获取不同预测方法得到的评分函数和RMSE,并进行比较。

不同预测方法评分函数、RMSE对比如表3所示。从表3中可以看到,本文提出的CNN-LSTM-SA预测模型与CNN-LSTM、CNN-LSTM-SE、CNN-LSTM-CBAM模型相比,CNN-LSTM-SA预测模型在评分函数和RMSE 2个方面均获得较好的结果。

表3 基于C-MAPSS数据集的不同方法与本文方法对比

通过以上分析可知,本文提出的CNN-LSTM-SA预测模型比CNN-LSTM、CNN-LSTM-SE、CNN-LSTM-CBAM模型具有更好的数据特征提取能力。综上所述,本文提出的CNN-LSTM-SA预测模型在航空发动机数据集上的剩余寿命预测结果更准确。

3.4 可视化分析

为进一步验证本文所提出的基于CNN-LSTM-SA剩余寿命预测模型的有效性,对于该模型不同层所提取的特征可视化,选取的可视化的层分别为Input层输出、Conv_5层输出、LSTM层输出、Attention层输出和Dense_2层输出,可视化结果如图6所示。图6中的每个点表示不同时刻的特征,颜色表示对应点的剩余寿命。由图6可知,随着模型的深入,所提取的特征由Input层的杂乱无序,经过Conv_5层后的逐渐分离,再经过LSTM层后的逐渐聚合,至Attention层输出的逐渐有序,最终到Dense_2层的有序排列,反映了CNN-LSTM-SA具有较好的提取特征能力。

图6 隐藏层特征可视化

4 结论

本文提出了一种基于注意力机制的CNN-LSTM剩余寿命预测方法,得出以下结论:

(1)基于注意力机制的CNN-LSTM剩余寿命预测方法对于机械设备的剩余寿命预测具有一定的有效性。

(2)将通道注意力机制、CBAM机制和自注意力机制应用于基于注意力机制的CNN-LSTM剩余寿命预测方法。试验表明,不同的注意力机制对于剩余寿命预测结果的影响不同,其中自注意力机制相比其他2种注意力机制具有较好的效果。