融合多尺度多头自注意力和在线难例挖掘的小样本硅藻检测

邓杰航,郭文权,陈汉杰,顾国生*,刘景建,杜宇坤,刘超,康晓东,赵建

(1.广东工业大学计算机学院,广州 510006;2.广东工业大学自动化学院,广州 510006;3.法医病理学公安部重点实验室(广州市刑事科学技术研究所),广州 510442)

0 引言

硅藻是一类很重要的浮游植物,硅藻检测是溺水诊断中常用的一种重要诊断方法[1]。当法医诊断从水中打捞起来的尸体是属于溺水而亡还是死后抛尸时,法医需要借助硅藻在尸体器官内的含量和种类进行辅助判断。在人体溺水的过程中,硅藻会随着水流被人体吸入肺中,并通过血液循环流到其他器官,如大脑和骨髓[2]。而当人体是死后被抛入水中时,人体停止了呼吸和血液循环,仅有少量的硅藻流入人体内。另外,硅藻的种类和数量会受到水质环境的影响,即不同的水质环境存在不同种类和数量的硅藻,法医可以根据这个关系推断出尸体的落水点。因此,硅藻检测为诊断溺水案件提供可靠的诊断依据。

硅藻检测一直以来都是一个具有挑战性的任务。传统的硅藻检测方法是由人工透过显微镜观察硅藻细胞并计数,不仅耗时耗力,还需要熟悉硅藻细胞的专家来执行,因为大部分的法医不具备硅藻分类的专业知识。为了提高法医对溺水诊断的速度,亟须一种使用计算机代替人工对硅藻进行识别与分类的方法。

随着卷积神经网络(Convolution Neural Network,CNN)的快速发展,图像分类和目标检测任务的性能得到了飞速提升。借助于CNN 强大的特征提取能力,Pedraza 等[3]把CNN应用到硅藻分类任务中并取得很好的分类效果。Zhou 等[4]为了充分利用人工智能和传统硅藻检测方法的优点,设计了一个结合传统硅藻检测方法的人工智能系统对硅藻进行识别,该系统的识别性能与5 位具有丰富硅藻检测经验的法医学家的识别效果相媲美[5]。应用目标检测模型Faster R-CNN(Faster Regional CNN)[6]对硅藻进行识别与定位,相较于传统的识别方法大幅提高了识别准确率。为了设计一种用于硅藻统计的工具,Krause 等[7]应用全卷积神经网络(Fully Convolutional Neural network,FCN)[8]对硅藻进行计数;Yu等[9]使用RetinaNet[10]对硅藻进行自动搜索。这些方法虽然从不同方面对硅藻检测进行了研究,但它们都需要大量的训练样本。然而,由于溺水案件涉及伦理问题且实际上残留在尸体器官内的硅藻数量不多,硅藻图像的获取相当困难。即使能够获得大量的硅藻图像数据,图像标注工作也需要专家花费大量的时间完成。因此,提出面向小样本的硅藻检测。

小样本目标检测方法可以分为四类,分别是元学习、度量学习、迁移学习和微调方法。基于元学习的方法[11-13]通过设计大量的相同视觉任务,使检测模型学习如何学习检测的能力。Kang 等[11]提出了一个元模型,该模型可以对从已标注的输入图像提取的特征进行重新加权。模型预测器可根据重新加权的特征有效地对只有少量样本的类别进行分类和定位。基于度量学习的方法[14-15]利用待预测图像与参考图像之间的距离,判断待预测图像的种类。Karlinsky 等[15]提出了一个度量学习模块,该模块评估每个预测框里的特征与从少量标记图像中提取的特征的相似度,并用这个度量学习模块取代了Faster R-CNN 的分类分支。基于迁移学习的方法[16-17]将从源域中学习到的预训练权重泛化到目标域,其中,源域具有大量的训练样本,目标域仅有少量可用的训练样本。Chen 等[17]提出了迁移知识正则化和背景抑制正则化以解决直接在少量标记图像上训练时的过拟合问题。基于微调的方法[18-19]主要关注模型对小样本训练集的微调过程。微调技术实现简单,且通过对模型进行简单微调即可在Pascal VOC(Visual Object Classes)2007 数据集[20]的小样本设置上显著提高检测精度,并且优于基于元学习的方法。因此,本文选择基于微调的方法作为小样本硅藻检测的基线模型。

TFA(Two-stage Fine-tuning Approach)[18]是一个基于微调方法的两阶段模型,只需微调模型的最后一层且模型的训练策略简单,在Pascal VOC[20]数据集和MS COCO(Common Objects in COntext)[21]数据集上的检测性能都比基于元学习的方法[11-13]好。因此,本文基于TFA 提出一种融合多尺度多头自注意力(Multi-scale Multi-head Self-attention,MMS)和在线难例挖掘策略(Online Hard Example Mining,OHEM)[22]的小样本硅藻检测(MMS and OHEM based Few-shot Diatom Detection,MMSOFDD)模型。该模型针对小样本的硅藻识别问题,将基于CNN 的ResNet-101[23]的最后三个空间3 × 3 卷积替换为多头自注意力,形成一个基于Transformer[24]的特征提取网络 BoTNet-101(Bottleneck Transformer Network-101)[25]。通过改进其中的多头自注意力为多尺度多头自注意力,称之为多尺度BoTNet-101。由多尺度BoTNet-101 生成的特征图经过池化等处理后,在嵌入OHEM的模型预测器中进行预测。采用从高清电镜下采集的复杂背景硅藻图像进行实验,验证了本文模型对小样本硅藻检测的有效性。

1 MMSOFDD

在本文中,为了实现小样本硅藻目标检测,在少量硅藻训练样本的情况下,基于TFA 模型提出了融合多尺度多头自注意力和OHEM 的小样本硅藻检测模型MMSOFDD。该模型的总体架构如图1 所示。

图1 MMSOFDD的总体架构Fig.1 Overall architecture of MMSOFDD

从图1 中可以看出,MMSOFDD 模型的总体架构采用Faster R-CNN[6]的架构,主要的组成部分包括特征提取器、区域生成网络RPN(Region Proposal Network)、RoI(Region of Interest)池化、全连接层和预测器。在MMSOFDD 中,特征提取器是一个基于Transformer 的多尺度BoTNet-101,其内部结构如图2 所示。区域生成网络RPN 的作用主要是通过卷积运算对图像锚框进行前景和背景的分类及对锚框位置的粗调整。预测器分为目标分类器和边界框回归器。在目标分类器中,使用余弦相似度计算预测值与目标值之间的距离,使用交叉熵损失函数计算分类损失。交叉熵损失函数的定义如下:

其中:C为类别数;gi为真实标签,表示当前的真实类别为第i类;pi为模型输出的预测值,表示预测为类别i的概率。

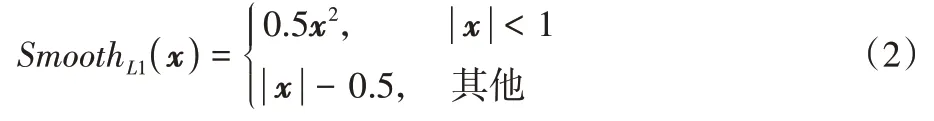

边界框回归器对锚框的位置进行细调整,使锚框更加准确地把图像目标标记出来,使用SmoothL1损失函数计算回归损失,定义如下:

其中:x表示预测边界框的坐标向量与真实边界框的坐标向量的差,坐标向量包含边界框的中心坐标、宽度和高度。

图1 中的圆角虚线框表示本文的主要改进工作,分别是多尺度BoTNet-101 和嵌入OHEM 的预测器。

1.1 多尺度BoTNet-101

BoTNet-101 是一个基于Transformer 的新型骨干网络,通过把图2(a)ResNet-101 结构的Block 5 的3 × 3 卷积替换成图2(b)中Block 5 的多头自注意力(Multi-Head Self-Attention,MHSA)而形成,该模型架构简单但功能强大。将图2(b)BoTNet-101 的多头自注意力改进为多尺度多头自注意力,即可得到多尺度BoTNet-101,如图2(c)所示。在多尺度BoTNet-101 中,同时使用CNN 和多头自注意力机制提取图像特征,能够有效地结合图像的局部特征和全局特征。其中:Block 1、Block 2、Block 3 和Block 4 使用CNN 处理大尺度图像并提取局部特征信息,生成低分辨率的特征图;Block 5 则基于多头自注意力对低分辨率特征图的全局信息进行聚合。多尺度BoTNet-101 把CNN 和Transformer 的优势结合起来,提升骨干网络的特征提取能力。多头自注意力的运算过程如图3 所示,其中,⊕表示逐元素相加,⊗表示矩阵乘法。

图2 特征提取网络的结构变化Fig.2 Structure change of feature extraction network

在图3 中,输入特征图与1 × 1 卷积核WQ、WK、WV相乘分别得到特征图q、k、v。Rh和Rw分别是使用二维相对位置自注意力[26-27]计算得到的垂直和水平方向上的相对位置信息,将Rh和Rw调整大小并相加融合得到位置编码r。通过计算qkT+qrT得到空间敏感的相似性特征,让多头自注意力机制关注合适区域,其中T 表示矩阵的转置运算。注意力得分由空间敏感的相似性特征经过Softmax 运算得到,并与v相乘作为多头自注意力的输出。

图3 多尺度多头自注意力的运算过程Fig.3 Multi-scale multi-head self-attention calculation process

在多头自注意力机制中,要求输入固定尺寸的特征图。因此,训练样本在输入后需要缩放到固定的尺寸。检测模型基于该缩放尺度生成相应的预测框,当这些预测框在原始图像上标定目标时,预测框的位置和大小会出现偏差。另外,由于骨干网络对单尺度图像提取到的特征信息不够丰富,模型容易出现对图像目标的误检和漏检的情况,导致模型的检测精度下降。因此,本文根据硅藻图像的特性,设计并收集硅藻图像采集的所有尺寸,在模型训练的过程中,根据当前的图像大小选择对应的多头自注意力层,即多尺度多头自注意力。多尺度多头自注意力可以兼容CNN 对不同尺寸的输入图像生成的特征图,使特征提取网络能够提取更加丰富的图像特征。

1.2 嵌入OHEM的预测器

在小样本目标检测中,可用的训练资料有限,检测模型不能利用大量的训练样本逐步更新模型参数,所以每一次的参数更新都至关重要。在小样本硅藻检测中,硅藻目标与背景存在类别不平衡,为了让少量的硅藻训练样本得到高效利用,在模型预测器中嵌入OHEM。通过挖掘难以识别的目标区域并基于此更新参数,模型的检测性能可以得到有效提升。

OHEM 是一种能够自动选择难以识别的样本进行训练的方法,可用于解决简单样本和难识别样本之间的类别不平衡问题。OHEM 的基本结构如图4 所示,由特征提取器和RPN 运算输出的N个感兴趣区域RoIs 作为输入,分别经过分类损失计算和边界框损失计算,得到每个RoI 的分类损失值和回归损失值。将分类损失值与回归损失值之和从大到小排序,损失值之和大的为难识别样本。由于位置上相邻的RoI 会输出相近的损失值,其表示的实际上是同一个目标实例。因此,OHEM 使用非极大值抑制(Non-Maximum Suppression,NMS)算法[28]移除交并比(Intersection over Union,IoU)大于一定阈值的RoI。最后选择B个损失值最大的RoI 作为难例样本,剩下的RoI 则作为非难例样本。难例样本将用于反向传播进行参数更新。

图4 OHEM结构Fig.4 Structure of OHEM

2 模型训练

2.1 数据集

2.1.1 Pascal VOC数据集

为了让模型学习类不可知的特征,使用Pascal VOC 2007+2012 的train/val 数据集中的15 个类别作为基础训练阶段的训练集,其中包含aeroplane、bicycle、boat、bottle、car、cat、chair、diningtable、dog、horse、person、pottedplant、sheep、train、tvmonitor。每一个类别的图像数量以及实例个数如表1所示。

表1 Pascal VOC数据集的15类分类明细Tab.1 Classification details of 15 classes in Pascal VOC dataset

2.1.2 硅藻数据集

为了有效评估本文模型在仅用少量训练样本的条件下,对硅藻进行识别与定位的性能,通过高分辨率扫描电子显微镜对硅藻进行成像并构建了一个硅藻数据集。数据集包含的硅藻种类及其对应的数量如表2 所示。其中,硅藻图像的种类分别有小环藻、舟形藻、菱形藻、针杆藻、异极藻、桥弯藻、卵形藻和直链藻,总量为2 606 张。小环藻、舟形藻、菱形藻和直链藻各有400 张,针杆藻有280 张,异极藻有220 张,桥弯藻有346 张,卵形藻有160 张。实例表示硅藻目标,一张硅藻图像中可存在多个实例。在本文所构建的硅藻数据集中,硅藻实例的总量为2 652 个,其中小环藻有417 个,舟形藻有404 个,菱形藻有407 个,针杆藻有283 个,异极藻有222个,桥弯藻有347 个,卵形藻有161 个,直链藻有411 个。各类硅藻图像如图5 所示。

图5 硅藻样本图像Fig.5 Diatom sample images

表2 硅藻数据集统计信息Tab.2 Diatom dataset statistics

本文研究的是10-shot 硅藻检测,即从每一类硅藻图像中选择10 个硅藻实例作为训练样本。通过设置固定的随机种子,在每一类硅藻图像中随机选择10 个硅藻实例,共80个,小样本硅藻训练集数据分布如表3 所示。测试集是由除训练集以外的所有硅藻实例组成,具体分布如表4 所示。

表3 小样本硅藻训练集Tab.3 Few-shot diatom training set

表4 硅藻测试集Tab.4 Diatom test set

2.2 小样本目标检测设置

在本文中,硅藻小样本目标检测的实验设置遵循由Wang 等[18]所提TFA 的实验设置。在小样本目标检测中,数据集可以分为基类Cb和新类Cn。基类是具有大量可用训练样本的类别,一般用于预训练目标检测模型。新类,也称为未知类,指在基类预训练中没有参与训练的类别,即Cb∩Cn=∅,而且新类中每一类只有K(K一般小于等于10)个可用标注样本。小样本目标检测的目标是把模型从大量的基类中学习到的知识泛化到新类,使新类在少量训练样本的条件下能够获得一个检测性能良好的目标检测模型。因此,本文的基类设置采用TFA 中使用的Pascal VOC 数据集的15 个类别,新类设置为8 类硅藻。

2.3 改进训练策略

原始TFA 的训练策略分为两个阶段:1)基础训练阶段,使用大量的训练数据训练整个模型并输出预训练权重用于小样本微调阶段的初始化;2)小样本微调阶段,固定特征提取器,使其不进行参数更新,只微调模型的最后一层。在基类为Pascal VOC 数据集的15 个类别、新类为8 类常见硅藻的设置下,将原始TFA 的训练策略应用到小样本硅藻检测中,得到的平均精度均值(mean Average Precision,mAP)约为27.60%。导致硅藻类别的检测精度低的原因是硅藻图像与Pascal VOC 数据集的图像存在较大的差异,在特征提取器固定的情况下,检测模型无法学习硅藻目标的特征表示,从而出现使用旧的知识难以预测新的类别的情况。因此,本文模型对原始TFA 模型的训练策略进行改进。通过开启骨干网络和RPN 的参数更新,特征提取网络能够在模型训练的过程中学习硅藻的特征表示,从而使检测模型在预测的过程中能够准确地识别硅藻,提高检测模型对硅藻的检测精度。

2.4 模型训练过程

模型的训练过程分为两个阶段:1)模型基础训练阶段,该阶段涉及的网络模块如图6 灰色模块所示;2)模型微调训练阶段,该阶段涉及的网络模块为图6 中的所有模块。在图6 中,灰色模块参与了模型基础训练。整个网络参与了模型的微调训练。

1)为了使模型学习类不可知的特征,即与类别不相关的特征,在模型基础训练阶段,使用大型图像数据集Pascal VOC 的15 个类别共20 335 张图像,34 084 个目标实例作为训练集。该阶段使用的检测模型是Faster R-CNN,其组成部分有骨干网ResNet-101、区域提议网络RPN、RoI 池化、全连接层以及由分类器和边界框回归器构成的预测器。其中ResNet-101 由5 个Block 组成,每个Block 各有1、9、12、69、9层卷积层,共100 层。在模型预测器中,分类器网络由全连接层和分类函数组成,边界框回归网络由全连接层和回归函数组成。通过大型图像数据集Pascal VOC 对整个模型进行训练,图6 中灰色模块的参数基本固定,即图像的类不可知特征。对于预测器学习到的参数,在模型微调阶段将会被随机初始化。

2)为了充分利用硅藻图像的局部和全局信息以及解决简单样本和难识别样本之间的类别不平衡问题,在模型微调训练阶段,把图6 骨干网的Block5 的3 × 3 卷积层替换为多尺度多头自注意力机制,以及在模型预测器中引入OHEM 策略,形成MMSOFDD 模型。在此阶段,训练集更改为8 类硅藻图像数据集,其中每一类硅藻只有10 个实例用于训练,共80个。在微调模型进行训练之前,为了保留基础训练得到的与目标类别不相关的特征,将基础训练阶段的结果对MMSOFDD 模型进行初始化,即保持图6 灰色模块的卷积层参数不变。为了避免基础训练的Pascal VOC 的15 个类别分类特征对微调训练8 类硅藻类别特征造成负面影响,随机初始化分类器与回归器的参数权值,同时调整学习率、迭代次数等超参数。由于硅藻图像的目标与背景的概貌和细节与Pascal VOC 数据集的图像之间相差巨大,因此,在微调阶段,网络所有的参数都需要更新。模型微调阶段开始训练,硅藻图像经过放缩后,多尺度BotNet-101 对其进行特征提取。首先,通过多尺度BotNet-101 的Block1、Block2、Block3 和Block4 的卷积层获取硅藻目标的局部特征信息并生成低分辨率的特征图;其次,通过Block5 的多尺度多头自注意力提取该低分辨率的特征图的全局特征信息得到特征图;然后,通过RPN 和RoI 池化处理后,得到包含硅藻目标信息的RoI;分别计算这些RoI 的分类损失值与边界框回归损失值的和,采用OHEM 策略,选择损失值和最大的若干个RoI 进行参数更新;最后,确定MMSOFDD 模型的参数。

图6 网络训练结构Fig.6 Structure of network training

3 实验与结果分析

3.1 实验设置与评价指标

本文实验基于64 位操作系统Ubuntu 18.04 和PyTorch 框架完成,处理器型号为Intel Core i9-10900X,16 GB 内存。显卡型号为Nvidia GeForce GTX 3090,24 GB 内存,采用Nvidia CUDA 11.0 加速工具箱。

在训练过程中,输入数据的批大小设置为8,使用随机梯度下降优化器(Stochastic Gradient Descent,SGD)进行训练,其中,权重衰减为0.000 1,动量参数为0.9;学习率策略为step,其中基础学习率是0.000 5,学习率调整倍数γ 是0.1,学习率变化步长为18 000,最大迭代次数为20 000,当训练迭代次数小于18 000 时,学习率为0.000 5,训练迭代次数大于等于18 000 时,学习率为0.000 05。

为了验证本文实验的有效性,本文采用Pascal VOC 标准的平均精度(Average Precision,AP)、平均精度均值(mAP)和8 类常见硅藻的检测精度的标准差作为小样本硅藻检测实验的评价指标。

3.2 消融实验结果分析

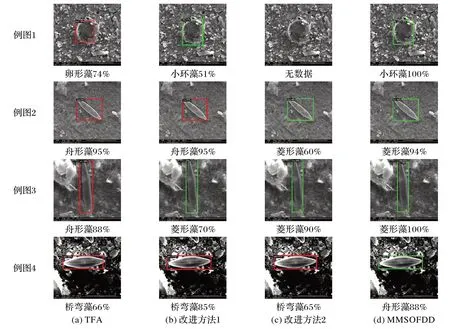

为了验证新增模块在MMSOFDD 模型中具有提升模型检测性能的作用,分别独立引入多尺度多头自注意力和嵌入OHEM 进行实验,并结合两个模块进行实验以探索两者之间的相互作用。实验定性结果如图7 所示,其中:改进方法1 表示只引入多尺度多头自注意力而没有嵌入OHEM;改进方法2 表示只嵌入OHEM 而不引入多尺度多头自注意力;MMSOFDD 表示同时引入多尺度多头自注意力和嵌入OHEM,红色矩形框表示识别错误,绿色矩形框表示识别正确。以下实验均在调整训练策略后进行。

在图7 的例图1 中,图像背景非常粗糙,存在很多大小不一且不同形状的干扰,这些干扰的分布随机,亮度变化没有规律。其中有一个小环藻在中央,小环藻的部分边缘被遮挡导致部分纹理缺失。从图7 可以看出:改进方法1 能够充分提取图像的特征提高TFA 的识别能力,从而正确识别硅藻。虽然改进方法2 漏检了图7 中例图1 的硅藻,但当改进方法1和改进方法2 结合在一起时,MMSOFDD 既能够正确检测也能够提高识别准确率。在图7 的例图2 中,菱形藻的形状比较扁,内部纹理非常模糊且图像背景复杂。TFA 算法和改进方法1 把菱形藻误识别为舟形藻,改进方法2 和MMSOFDD则检测正确且MMSOFDD 的识别准确率更高,说明嵌入OHEM 既能够正确识别TFA 中难识别的硅藻目标,也能够与多尺度多头自注意力相互作用,提高识别准确率。图7 中的例图3 的硅藻目标清晰度低且纹理丢失,与背景十分相似且图像左上角有大面积的白色干扰,图7 中的例图4 硅藻目标虽然形状完整,但背景十分复杂,亮度分布不均匀。TFA 方法对图7 中的例图3 和例图4 中的硅藻都识别错误,改进方法1 和改进方法2 对其都识别正确,而MMSOFDD 对硅藻识别正确且准确率比改进方法1 和改进方法2 都高。因此,改进方法1 和改进方法2 都能够有效提高TFA 的检测精度,结合两者能够起到相互增益的作用,互补双方的检测能力,MMSOFDD 可以获得更高的检测性能。

图7 不同模块在消融实验中定性结果Fig.7 Qualitative results of different modules in ablation experiment

实验定量结果如表5 所示。

表5 不同模块的mAP比较Tab.5 Comparison of mAP of different modules

为了进一步定量地检验模型的性能,统计了不同模块的mAP 值,如表5 所示。从表5 中可以看出,引入多尺度多头自注意力后,图像的局部信息和全局信息得到有效利用,改进方法1 的mAP 比TFA 提升了1.47 个百分点,精度达到65.18%。改进方法2 基于ResNet-101 提取图像特征,在预测器中嵌入OHEM 解决前景目标和背景之间的不平衡问题,检测精度达到66.83%,比TFA 提升了3.12 个百分点。从改进方法1 和改进方法2 中可以看出,多尺度多头自注意力和OHEM 都对模型的检测精度有所提升,因此,MMSOFDD 把多尺度多头自注意力和OHEM 结合起来进行实验,得到检测精度69.60%。与TFA、改进方法1 和改进方法2 相比,MMSOFDD 分别提升了5.89、4.42 和2.77 个百分点,证明结合多尺度多头自注意力与OHEM 对模型的检测效果的提升有相互增益的作用。上述实验结果表明,本文提出的MMSOFDD 能够在少量训练样本的条件下有效提升硅藻的检测精度。

3.3 对比实验结果分析

为了进一步验证MMSOFDD 能够在训练样本量少的条件下获得较高检测精度,将其与FSRW(Few-Shot Re-Weighting)[11]、Meta R-CNN[13]、FSIW(Few-Shot In Wild)[12]、Context-Transformer[16]、MPSR(Multi-scale Positive Sample Refinement)[29]、DeFRCN(Decoupled Faster R-CNN)[30]、FSCE(Few-Shot object detection via Contrastive proposals Encoding)[19]小样本目标检测模型在10-shot 的训练集设置下进行比较分析。实验结果如表6 所示。

从表6 可以看出:

1)在8 类硅藻中,小环藻、针杆藻、卵形藻和直链藻在所有模型上的精度都比较高,而舟形藻、菱形藻、异极藻和桥弯藻的精度都比较低。因此,保证小环藻、针杆藻、卵形藻和直链藻的检测精度的同时提升舟形藻、菱形藻、异极藻和桥弯藻的检测精度是关键。MMSOFDD 对舟形藻、菱形藻和异极藻的检测精度分别是55.37%、59.1%和62.60%,是所有模型中最高的,对比其他模型都有大幅度的提升。桥弯藻的检测精度相较于Meta R-CNN、FSIW、Context-Transformer 和MPSR 也有较大的提升。从评价指标平均精度均值mAP 来看,MMSOFDD 达到69.60%,相较于FSRW、Meta R-CNN、FSIW、Context-Transformer、MPSR、DeFRCN 和FSCE,分别提高了2.71、8.00、8.70、56.02、8.69、4.96 和8.34 个百分点,说明MMSOFDD 对硅藻检测的综合性能更高。

2)从算法的鲁棒性上看,鲁棒性越好的模型,对不同硅藻的识别率AP 的标准差越接近零。表6 中统计了不同模型对不同硅藻的识别率AP 的标准差。虽然Context-Transformer模型获得AP 的标准差达到4.42,但其各类硅藻的检测精度较低,mAP 只有13.58%,不宜用于硅藻检测。MMSOFDD 的标准差为14.67,低于除Context-Transformer 以外的所有对比模型,说明MMSOFDD 模型对8 类硅藻的检测精度更为平衡,模型的鲁棒性更好,在实际应用中的应用范围更加广泛。

表6 不同模型对8类硅藻的AP、mAP和AP标准差的比较Tab.6 Comparison of AP,mAP and standard deviation of AP among different models for 8 species of diatoms

因此,在法医诊断溺水案件中,即使硅藻图像的获取和标注困难,MMSOFDD 能够利用少量的硅藻样本训练得到一个精度较高的硅藻检测器,有助于提高法医的诊断速度。

4 结语

把小样本目标检测应用到硅藻检测中,能够有效解决硅藻样本获取困难的问题,有助于提高法医诊断溺水案件的速度,但目前小样本目标检测仍然是一个挑战。本文基于两阶段微调方法TFA 进行改进,引入基于Transformer 的特征提取网络BoTNet 并将其改进为多尺度BoTNet-101,在预测器中嵌入OHEM 提出一个融合多尺度多头自注意力和OHEM 的小样本硅藻检测模型MMSOFDD。实验结果表明,多尺度BoTNet-101 结合了CNN 和Transformer 的优势,同时使用图像的局部特征和全局特征,在训练样本量少的条件下能够充分地利用训练样本。同时,多尺度BoTNet-101 中的多尺度多头自注意力能够处理CNN 输出的不同尺寸的特征图,从而提取更加丰富的信息。在预测器中加入OHEM 可以自动选择出难识别的样本并针对其进行训练,有效解决前景目标与背景之间的类别不平衡问题。通过与其他小样本目标检测模型进行对比实验验证了MMSOFDD 有效地提高对硅藻的检测能力,在10-shot 的条件下能够达到较好的检测效果,未来可以基于MMSOFDD 继续提高对其他硅藻的检测精度。