基于掩模注意型交互的SAR舰船实例分割

张天文, 张晓玲,*, 邵子康, 曾天娇

(1. 电子科技大学信息与通信工程学院, 四川 成都 611731;2. 电子科技大学航空航天学院, 四川 成都 611731)

0 引 言

合成孔径雷达(synthetic aperture radar, SAR)具有全天时、全天候工作的能力[1],并因此特性被广泛应用于舰船检测领域[2]。传统SAR舰船检测方法依靠专家提取的手工特征[3],例如基于恒虚警率检测[4]和基于视觉显著性检测[5]。近年来,基于深度学习的SAR舰船检测方法受到学者广泛关注[6-7]。文献[8]改进了深度残差网络(residual network, ResNet)网络,实现了复数SAR图像舰船检测。文献[9]改进了YOLOX[10],实现了近岸复杂场景的轻量化SAR舰船检测。文献[11]基于平衡学习,提出了一种能够平衡复杂场景与简单场景的SAR舰船检测机制。大多数学者实现了框等级检测,而未实现SAR舰船的像素级表征[12]。

为了实现SAR舰船的像素级表征,一些学者将实例分割引入至SAR舰船检测领域。文献[13]发布了用于SAR舰船实例分割的HRSID数据集,但未提供新的方法论。文献[14]设计了一种基于协同注意力机制的实例分割方法,但在复杂场景中精度较差。文献[15]基于设计了一种基于上下文机制和压缩激励机制的实例分割方法,但其方法精度有限。以上方法未实现掩模交互或提供交互收益有限,可能阻碍实例分割精度提高。

因此,本文提出一种基于掩模注意型交互网络(mask attention interaction network, MAI-Net)的SAR舰船实例分割方法,主要创新点如下:

(1) MAI-Net使用了膨胀空间金字塔池化(atrous spatial pyramid pooling, ASPP),来获取多分辨率特征响应,增强了对背景鉴别能力。

(2) MAI-Net使用了非局部模块(non-local block, NLB),来抑制低价值信息,实现了空间特征自注意。

(3) MAI-Net提出了拼接混洗注意力模块(concatenation shuffle attention block, CSAB),来充分利用多阶段掩模信息,进一步提高实例分割精度。

1 方法原理

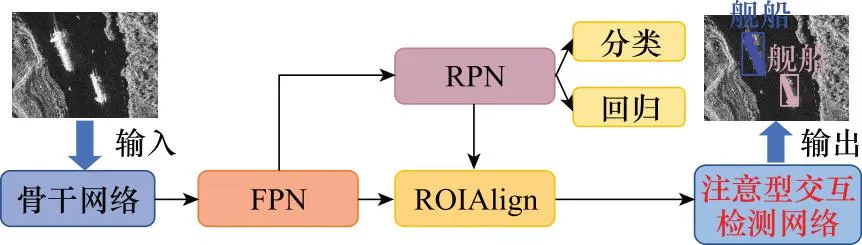

MAI-Net网络结构如图1所示,类似于经典的双阶段实例分割网络混合任务级联(hybrid task cascade, HTC)[16],MAI-Net由骨干网络、特征金字塔网络(feature pyramid network, FPN)[17]、区域建议网络(region proposal network, RPN)和检测网络构成。输入图像首先由骨干网络和FPN提取多尺度特征图,接着由RPN和感兴趣区域对齐(region of interest alignment, ROIAlign)提取特征子集,最后将特征子集输入检测网络来获得实例分割结果。

图1 MAI-Net结构图Fig.1 Structure of MAI-Net

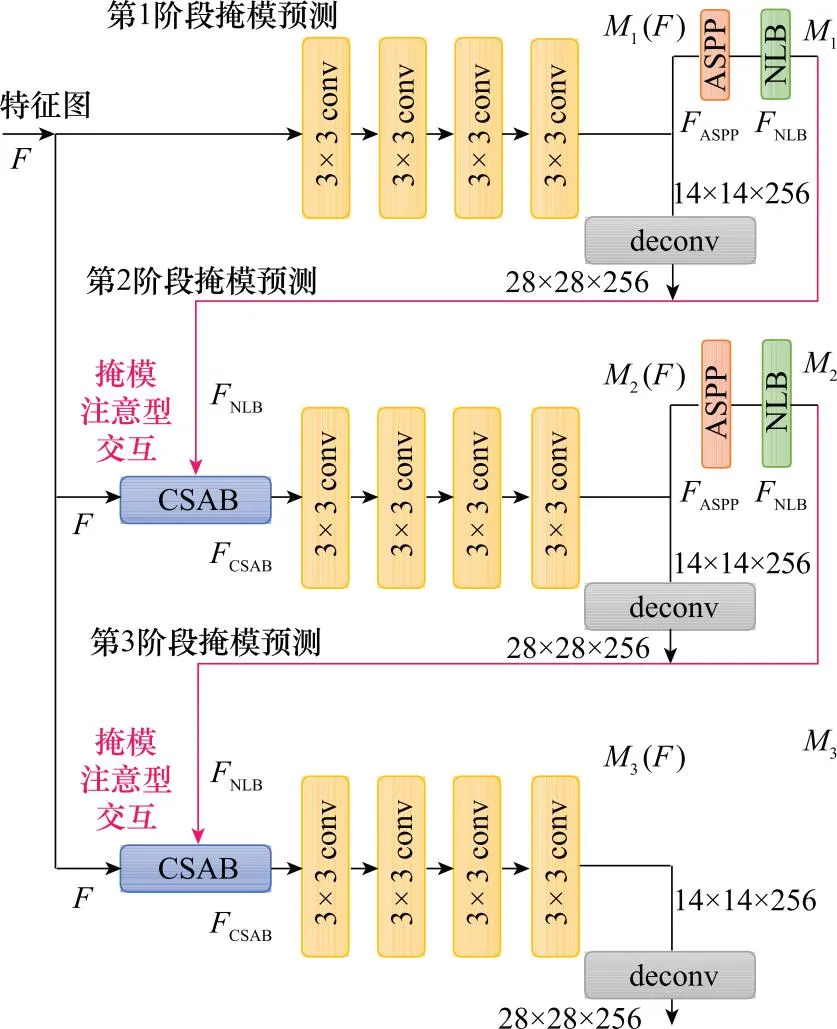

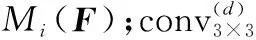

本文提出的MAI-Net基于HTC模型,将其检测网络改进为注意型交互检测网络,具体结构如图2所示。掩模交互指在多阶段掩模预测中,下一阶段的输入在原有输入特征图的基础上融合上一个阶段的掩模预测输出特征图。MAI-Net在每个掩模预测阶段使用ASPP和NLB提取前一阶段中更具有代表性的多视野特征和全局空间依赖特征,并将其与下一阶段的输入特征图进行融合。这里,ASPP输入为前一阶段掩模特征图输出Mi-1(F),其中F记为ROIAlign特征子集,ASPP输出记为FASPP。NLB输入为FASPP,NLB输出记为FNLB。此外,MAI-Net使用CSAB进行特征求和,这样可以平衡前一阶段掩模特征图Mi-1(F)和注意型交互检测网络的输入特征图F两种类型的特征输入的贡献,从而解决可能存在深浅层特征语义不平衡的问题[18]。这里,CSAB输入为FNLB和F,CSAB输出记为FCSAB。通过使用ASPP,NLB和CSAB模块,MAI-Net获取了多分辨率响应,进行了精细化提炼,平衡了不同特征图的贡献,从而增强了网络的掩模交互性能。下面详细介绍MAI-Net的各项改进。

图2 注意型交互检测网络结构Fig.2 Structure of attentive interactive detection network

1.1 膨胀空间金字塔池化ASPP

舰船周围包含各种类型的上下文环境,如模糊轮廓、旁瓣、相干斑噪声和岸上设施等[19]。这些背景上下文信息都会影响最终的舰船像素预测性能。为了关注舰船上下文信息,获取多分辨率响应,受文献[20]和文献[21]启发,引入ASPP。ASPP通过使用具有不同膨胀率的膨胀卷积在单分辨率分支中提取多分辨率的特征响应,使多阶段掩模预测网络中能够充分利用先前阶段的多视野特征,增强掩模交互的多分辨率响应。图3展示了ASPP具体结构。

图3 ASPP结构图Fig.3 Structure of ASPP

由图3可知,ASPP使用4个3×3膨胀卷积对输入特征图处理,并设置膨胀率d分别为经验值2、3、4、5,每个膨胀卷积输出被拼接起来得到通道被扩展4倍的特征图;为保持原有维度便于后续操作,一个1×1卷积被用来进行通道降维,得到ASPP输出FASPP。以上过程可描述为

(1)

1.2 非局部注意力模块NLB

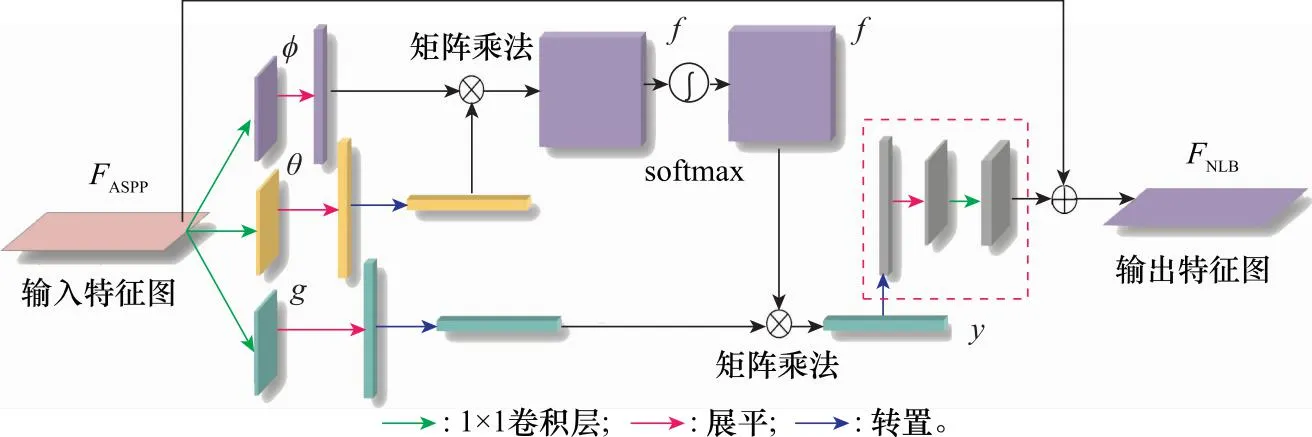

在ASPP中采用4个并行的3×3卷积能够提取不同范围上下文的特征,但是当扩张率较大时,ASPP可能会引入过多的低价值背景的干扰,从而导致定位精度的下降[22]。因此,受文献[23]和文献[24]的启发,本文使用NLB来对ASPP的输出进行精细化提炼。NLB建模输入特征图中每个元素在整个空间中的全局依赖关系,抑制低价值信息,从而抑制掩模交互过程中的低价值信息,NLB可描述为

(2)

式中:x是NLB的输入;xi对应第i位置的输入;xj对应第j位置的输入;ζ(·)是一个学习映射函数,用于计算第i位置和第j位置之间的空间内容相似度;f(·)是一个学习映射函数,用来表征第j位置的空间特征;g(·)表示归一化系数,用来对输入每个位置响应进行归一化操作。式(2)中第i位置表示当前位置响应,第j位置表示除i之外全局响应,故加权求和需遍历所有参数j,即∀j。

NLB的具体结构如图4所示。类似于文献[25],使用一个卷积层(记为g)来自适应学习第j位置的空间特征表征:

g(FASPP)=Wg·FASPP

(3)

式中:Wg为1×1卷积层g的权重系数。使用一个嵌入高斯函数来计算第i位置和第j位置之间的空间内容相似度f,即

f(xi,xj)=eθT(xi)φ(xj)

(4)

式中:T表示转置;θ(FASPP,i)=Wθ·FASPP,i,表示第i位置的特征嵌入,使用一个1×1卷积层(记为θ)来学习权重系数Wθ;φ(FASPP,j)=Wφ·FASPP,j,为第j位置特征嵌入,使用一个1×1卷积层(记为φ)来学习权重系数Wφ。

图4 NLB结构图Fig.4 Structure of NLB

此外,归一化系数ζ(·)通过输入所有位置相似度求和得到,即

(5)

基于以上卷积实现,式(4)可实例化为

(6)

最终,式(6)可通过一个softmax计算函数来实现,softmax函数定义为

(7)

如图4所示,首先两个1×1卷积层θ和φ分别被用来计算Wθ和Wφ,然后通过矩阵乘法计算θTφ,得到相似度f。另外一个1×1卷积层g被用来计算Wg,得到特征表示。最后,被softmax函数激活过的f与特征表示g的乘积得到NLB的输出yi。此外,yi还由另外一个1×1卷积层(记为o)处理进行维度变化,目的是使输出和输入维度一致,便于后续残差连接操作,即

FNLB=Wo·yi+FASPP

(8)

式中:Wo为该1×1卷积层o的权重系数;FNLB表示NLB的输出。

1.3 拼接混洗注意力模块CSAB

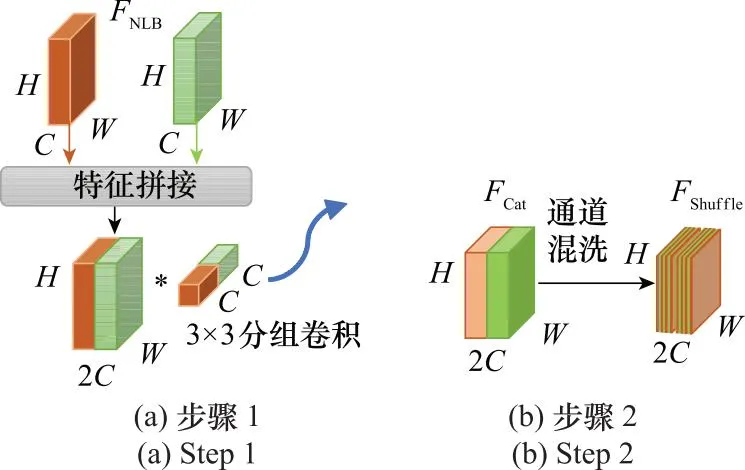

为平衡两种类型的特征图,即掩模交互过程中前一阶段掩模特征图和注意型交互检测网络的输入特征图,对检测结果的贡献,从而解决可能存在的深浅层特征语义不平衡的问题,本文提出了CSAB来对两种类型输入特征进行处理。图5展示了拼接混洗注意力模块CSAB的网络结构示意图。由图5可知,CSAB主要由特征拼接、通道混洗和特征注意这3个基本步骤组成,下面将进行详细介绍。

图5 CSAB结构图Fig.5 Structure of CSAB

步骤 1特征拼接。将两种类型输入特征图FNLB和F拼接起来,然后使用一个3×3分组卷积对拼接后的特征图进行通道降维,便可以对不同输入进行差异的特征提取,分组系数设为2。以上过程可以描述为

(9)

步骤 2通道混洗。为了尽可能降低因通道协同一致性效应可能导致的特征学习局部优化,将步骤1输出特征图FCat的通道进行随机打乱操作,得到FShuffle。

步骤 3特征注意。使用通道注意力机制和空间注意力机制对通道混洗后特征图FShuffle进行细化处理,学习得到自适应通道加权系数和自适应空间加权系数来平衡两种不同输入特征的贡献。通道注意力模块操作过程可描述为

FCA=WCA·FShuffle=sigmoid{MLP[GAP(FShuffle)]+ MLP[GMP(FShuffle)]}·FShuffle

(10)

式中:GAP(·)表示全局平均池化操作;GMP(·)表示全局最大池化操作;MLP(·)表示多层感知机处理;sigmoid(·)表示sigmoid激活函数。最终,产生的通道权重WCA=(w1,w2,…,wn)T,其中n为输入特征图通道数,wi来衡量第i个通道重要性,通过这种通道加权方式便可实现通道间特征注意。

空间注意力模块操作过程可描述为

FSA=WSA·FCA=sigmoid{DS-Conv7×7· (GAP(FCA)ⒸGMP(FCA))}·FCA

(11)

式中:DS-Conv7×7(·)表示7×7深度可分离卷积。最终,产生的WSA=(wi,j)1≤i≤l,1≤j≤l,其中l示输入特征图二维空间尺寸,wi,j表示输入(i,j),通过空间信息加权方式可实现空间上特征注意。

2 实验数据及配置

2.1 实验数据

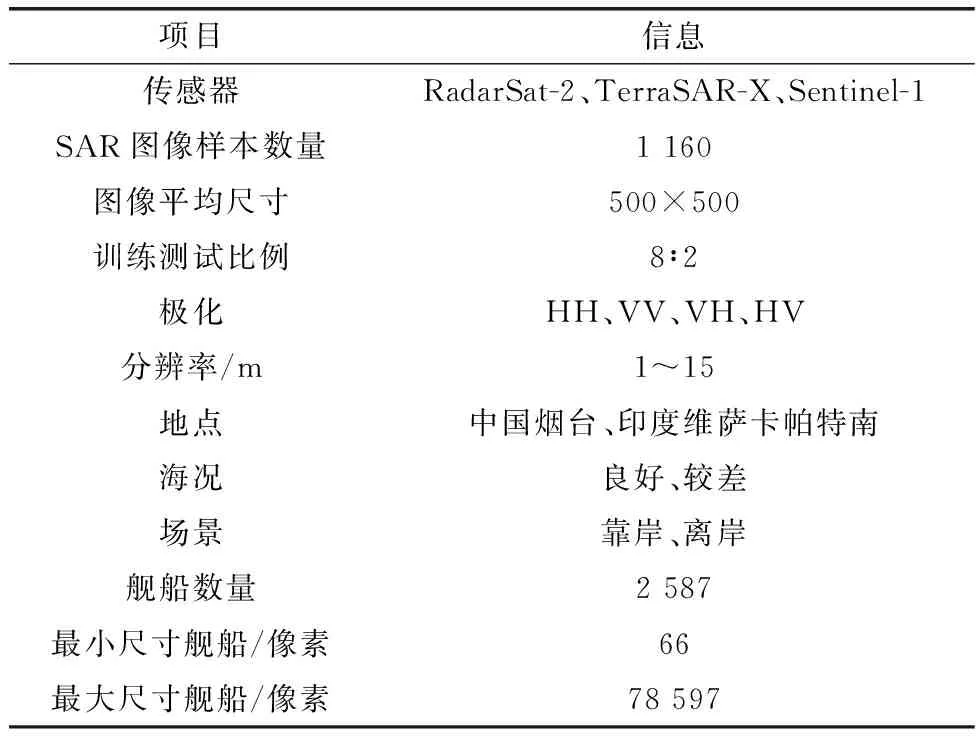

本文在多边形分割SAR舰船检测数据集(polygon segmentation SAR ship detection dataset, PSeg-SSDD)[26]上进行实验。表1展示了PSeg-SSDD的信息概览。如表1所示,PSeg-SSDD有来自多个卫星的1 160个样本,其中图像平均尺寸为500像素×500像素,PSeg-SSDD数据集中共有2 587只舰船,其中最小尺寸舰船所占像素为66像素,最大舰船所占像素为78 597像素。

表1 PSeg-SSDD数据集信息Table 1 Information of PSeg-SSDD

2.2 实验设置

MAI-Net的骨干网络使用在ImageNet数据集[27]上预训练过的ResNet-101[28],这可加速网络收敛。训练及测试的输入图像大小均统一调整为512像素×512像素,除此以外对输入图像没有其他的数据增强预处理操作。使用随机梯度下降(stochastic gradient descent, SGD)优化器[29]来训练模型,设置学习率为0.004,动量为0.9,权重衰减系数为0.000 1,总训练迭代次数为12次,当迭代次数到第8次和第11次时,学习率降低为原来的10倍。由于图形处理单元内存限制,训练批次大小设置为2。

训练MAI-Net的损失函数由分类损失和回归损失两部分组成,分类损失LCLS选择经典交叉熵损失[30],回归损失LREG选择经典平滑L1[31],即

(12)

(13)

(14)

(15)

(16)

(17)

smoothL1为平滑L1损失,定义为

(18)

MAI-Net的分类损失LCLS除上述类别预测损失外,还包含像素预测损失,该像素预测损失也使用经典交叉熵损失。在测试期间,使用非极大值抑制(non-maximum suppression, NMS)[32]去除冗余重复的检测框,NMS的重叠度(intersection over union, IOU)阈值设置为经验值0.5。

3 实验结果与分析

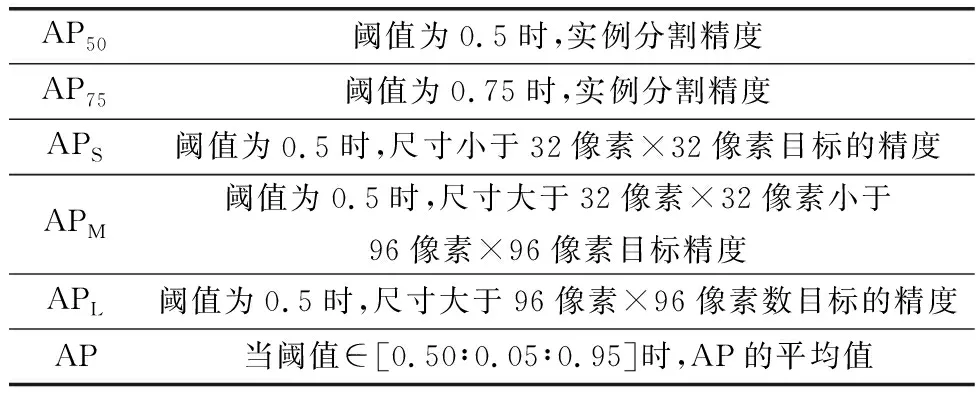

3.1 评价指标

本文采用COCO数据集[33]的评价指标来评估SAR舰船实例分割性能。记实例分割平均精度为AP,定义为

(19)

式中:r表示召回率;p表示准确率;p(r)表示精度召回率曲线。详细评价指标如表2所示,APS表示小型目标的实例分割精度,APM表示中等目标的实例分割精度,APL表示大型目标的实例分割精度,AP反映了在不同IOUM阈值条件下的综合检测性能,因此被选择作为衡量SAR舰船实例分割精度的唯一核心指标[34],计算公式为

(20)

式中:IOUM∈[0.50∶0.05∶0.95]。IOUM计算公式为

(21)

式中:MaskG为舰船真值像素掩模;MaskP为舰船预测像素掩模。

表2 实例分割精度评估指标Table 2 Instance segmentation accuracy evaluation index

3.2 对比实验结果

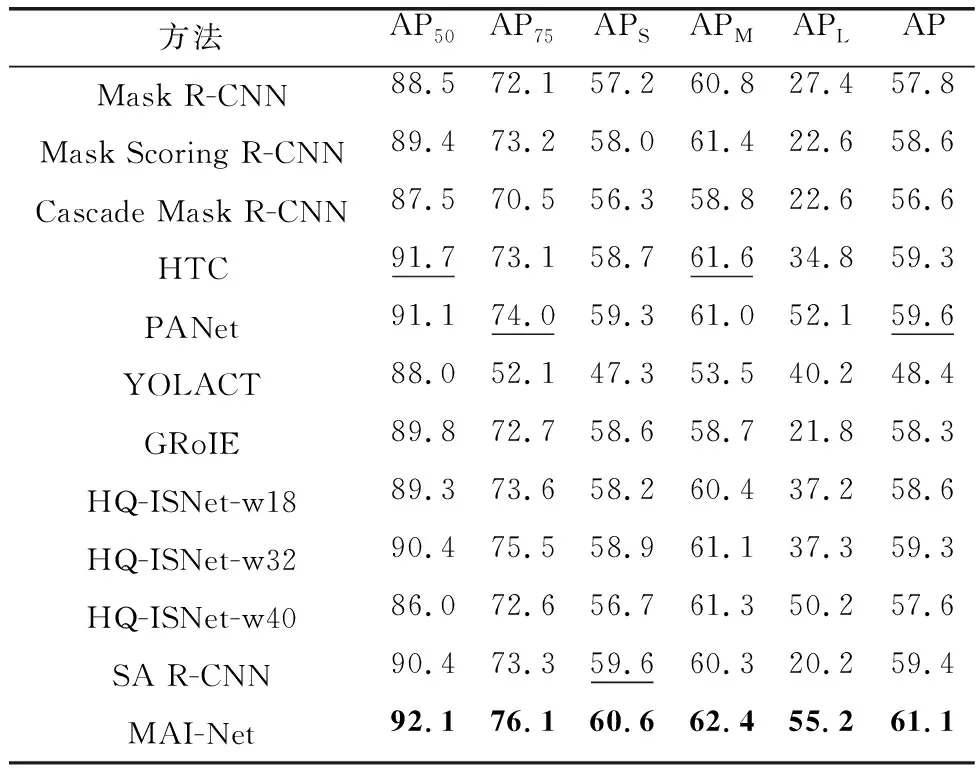

表3展示了在舰船实例分割数据集PSeg-SSDD上,MAI-Net和其他11种现有方法的SAR舰船实例分割的定量对比结果。包括掩膜区域卷积神经网络(mask region-convolutional neural network, Mask R-CNN)[35]、Mask scoring R-CNN[36]、级联Mask R-CNN[37]、HTC[16]、路经聚合网络(path aggregation network, PANet)[38]、YOLACT(you only look at coefficients)[39]、GRoIE(generic RoI extractor)[40]、HQ-ISNet-w18(high-quality instance segmentation-w18)[41]、HQ-ISNet-w32[41]、HQ-ISNet-w40[41]和SA R-CNN(synergistic attention R-CNN)[42]。前7个方法为通用实例分割网络,后4种方法为SAR舰船实例分割网络,通用性模型参数与它们的原始工作基本保持一致。其他SAR舰船检测任务模型超参数与MAI-Net基本保持一致。其中,最优检测结果用加粗字体标出,次优检测结果用下划线标出。

表3 定性对比实验结果Table 3 Quantitative comparison of experimental results %

由表3可知,本文提出的MAI-Net提供了精度最高的SAR舰船实例分割,具体地,其AP达到了61.1%,比其他11种对比方法中最优模型PANet还要高出1.5% AP,这充分表明了MAI-Net更优越的SAR舰船实例分割性能。此外,MAI-Net的其他所有指标均优于其他11种对比方法,这充分证明了MAI-Net对于多尺度目标均有较好的实例分割性能。相较于同样具有掩模交互结构的网络HTC,MAI-Net由于使用了ASPP、NLB和CSAB等模块,增强了掩模交互性能,可以进一步改善多尺度舰船检测精度。虽然在数学上难以对掩模交互性能做出准确定义,但是实验结果从侧面证明了MAI-Net具有更好的掩模交互性能。总而言之,根据以上定量评估对比结果,本文提出的MAI-Net可以提供更优越的SAR舰船实例分割精度。

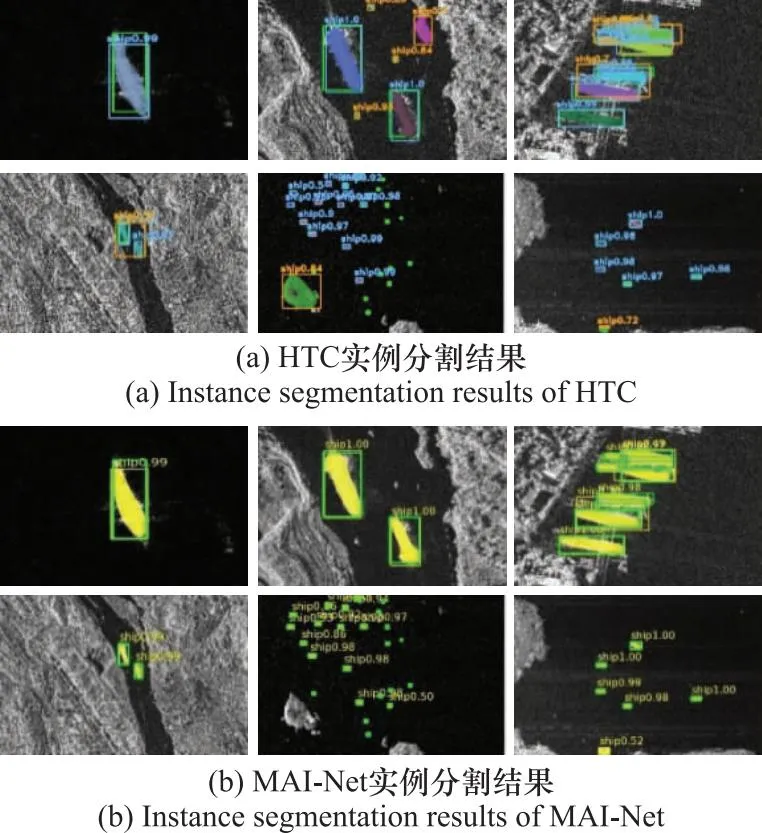

图6展示了在PSeg-SSDD数据集上,本文提出的MAI-Net和HTC的SAR舰船实例分割定性检测结果对比。由于MAI-Net是在HTC模型基础上进行改进的,受限于篇幅,这里只展示其与HTC的定性检测结果对比。

图6 实例分割定性结果对比Fig.6 Instance segmentation qualitative results comparison

由图6可知,MAI-Net具有良好的虚警抑制能力,例如对比图6(a)和图6(b)中第1行第2列图像中的舰船实例分割结果,HTC在陆地和海面产生了许多虚警,但是MAI-Net可以成功抑制该虚警。又例如,对比图6(a)和图6(b)中第1行第3列图像中的舰船实例分割结果,HTC在检测一些并排停泊在港口中的舰船时,出现了很多由于舰船船体交叠导致的检测虚警,但是MAI-Net没有产生任何虚警。又例如,对比图6(a)和图6(b)中第2行第2列图像中舰船实例分割结果,HTC在检测海面小尺度舰船时,错误地将岛屿检测为舰船,但是MAI-Net没有产生虚警。这都表明了MAI-Net具有更优越的复杂场景适应能力。

此外,MAI-Net相较于HTC模型,能够检测出更多舰船,具有更低的漏检概率,例如对比图6(a)和图6(b)中第2行第2列图像中舰船实例分割结果,HTC遗漏了很多小尺寸舰船,但是MAI-Net检测遗漏较少,这也表明MAI-Net具有更优越的小目标实例分割性能。

最后,MAI-Net还能提供更好的舰船定位准确度,例如对比图6(a)和图6(b)中第1行第1列图像中舰船检测结果,HTC和MAI-Net都能够成功检测出该只舰船。不同的是,HTC检测框和真值框存在较大空间错位,因此其框定位准确度不够高,但是MAI-Net检测框更贴近真值框,所以MAI-Net能够更准确地定位舰船,当框定位准确度被提高,框中舰船船体实例分割精度也会得到相应的改善。根据以上定性评估结果, MAI-Net可以提供更高实例分割精度。

3.3 消融实验结果

表4 MAI-Net逐渐加入改进模块对精度影响Table 4 Impact of gradually adding improvement block to MAI-Net on accuracy %

4 结 论

针对现有SAR舰船实例分割方法未实现多阶段掩模预测或未充分利用多阶段掩模预测信息的问题,本文提出了一种基于MAI的SAR舰船实例分割方法MAI-Net。首先,MAI-Net使用了膨胀空间金字塔池化,来获取多分辨率特征响应,增强了对背景鉴别能力;其次,MAI-Net使用了非局部注意力模块,来抑制低价值信息,实现了空间特征自注意;最后,MAI-Net提出了拼接混洗注意力模块,来增强掩模交互性能,提高了实例分割精度。在公开数据集PSeg-SSDD上的实验结果显示,MAI-Net的检测精度高于其他11种对比模型,高于次优模型1.5%。消融实验证明了MAI-Net每项改进的有效性。