投影寻踪和神经网络算法的比较分析

新疆农业大学交通与物流工程学院 董丹华 吐尔逊·买买提

投影寻踪回归对复杂系统的原始数据进行建模分析与预测具有重要意义。以经过简化处理的波士顿房价数据集作为建模和预留检验的样本数据,对自变量因子采用了线性降维技术、非线性拟合技术、迭代寻优方法,分别应用投影寻踪回归算法和神经网络回归算法创建房价趋势预测模型,对波士顿房价进行预测。预测结果表明:投影寻踪回归算法具有较高的准确度,且投影寻踪回归算法具有较强的稳健性、抗干扰性,为回归预测模型计算预测值,并对预测值进行综合分析提供思路和方法。

投影寻踪(Projection Pursuit)简称PP,是国际统计界于20世纪70年代中期发展起来的[1],是应用数学、统计学、计算机技术的交叉学科,主要用于处理、分析高维观测数据,是非正态、非线性高维数据的一种新兴统计方法[2],是将高维数据投影至低维子空间,并寻找出能反映原高维数据的结构、特征的投影,达到分析、研究原高维数据的目的。投影寻踪统计方法具有抗干扰性、稳健性、准确度高等特点,因而被广泛应用于很多领域[3]。

投影寻踪统计方法主要涉及三方面内容,即聚类分析、回归、学习网络[4]。其中投影寻踪回归算法原理解决了传统间隔方法(PCA等)的不足,通过极值化来选定投影指标,寻找最能反映数据特征的投影方向,将高维数据投影到低维空间,进行分析[5]。

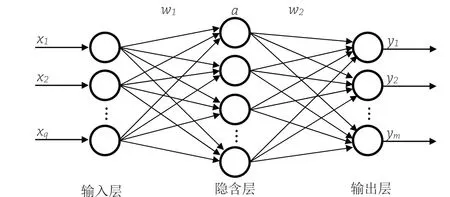

本文所述的神经网络是最传统的BP(Back-propagation)神经网络,即反向传播神经网络。反向传播是指在模拟过程中收集系统所产生的误差,并且返回这些误差到输出值,从而调整神经元的权重,此过程不断重复,最终生成一个可以模拟出原始问题的人工神经网络系统[6]。人工神经网络(ANN,Artificial Neural Network)也叫多层感知机(MLP,Multilayer Perceptron),除了输入输出层,它中间可以有多个隐层,最简单的MLP只含一个隐层,即三层结构[7]。

本文依据波士顿房价预测问题,采用了上述两种回归算法进行建模,对模型进行训练和测试,通过对模型表现以及训练过程的总结,探究神经网络回归算法和投影寻踪回归算法在这一具体问题中的应用。

1 投影寻踪回归算法与神经网络回归算法原理

投影寻踪回归算法(PPR)与神经网络回归算法(MLPR),都是对自变量因子采用了线性降维技术和非线性拟合技术,并进而通过迭代寻优的方法,创建回归模型的[8]。

1.1 投影寻踪回归算法(PPR)的数学表达式及预测算法流程

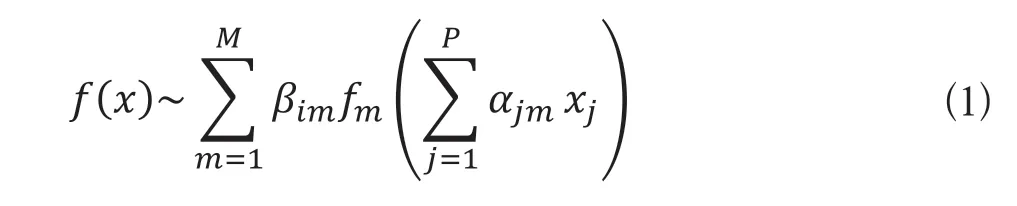

PPR技术是将投影寻踪(PP)与回归分析(RA)方法相结合的多因子建模技术,对统计数据不作任何假定和变换等人为干预,对数据的降维优化是借助计算机进行处理[9]。数据结构的审视较客观,并以数值函数描述后再用于预测,非正态、非线性的有用信息获取充分,其数学表达式描述如式(1)所示:

式(1)中:f(x)回归方程可用岭函数,进行逼近;

αjm第j个自变量因子的权重系数,或称投影方向,自变量因子的维度=P;

βim第m个岭函数的权重系数;

权重系数是按自变量因子x与目标y的相关程度计算出来的。

其算法流程如下:

(1)对y进行标准化处理→R(中间变量);

(2)循环创建最多M个岭函数,步骤如下:

1)按(R,x)的主成分方向设置第一个岭函数的投影方向数组A;

2)计算岭函数的水平坐标值A×X→T;

3)用超级滤波器求解岭函数值→F;

4)计算剩余值Y[j]-F[j]→R;

5)计算β系数=R[i,j]×F[j]/(F[j])×(F[j]),计算下一轮建模数据R=R[i,j]-B[LM-1,i]×F[LM-1,j];

6)检查循环条件,创建下一个岭函数;

(3)如果所建模型个数>MU,需进行全局优化,以保证模型个数≤MU。MU、M都是模型参数,通常为3,8;

(4)输出回归模型的结果数据。

1.2 神经网络回归算法(MLPR)的数学表达式及预测算法流程

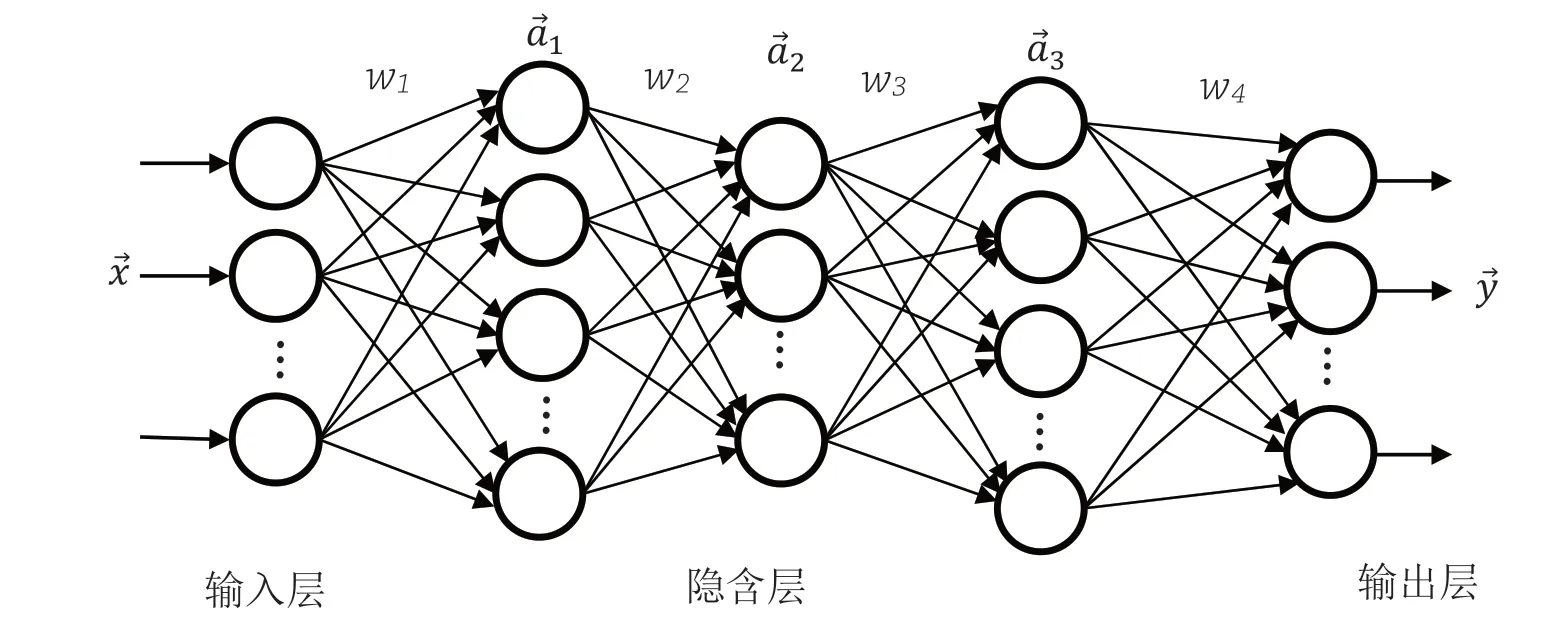

神经网络回归(MLPR)是多隐层BP神经网络(四层以上网络),由输入层、隐藏层、输出层、节点(每一个节点就是一个神经元)组成,输入层神经元个数与输入数据的维数相同,输出层神经元个数与需要拟合的数据个数相同,隐含层神经元个数与层数需要根据具体规则和目标设定[10]。如图1、图2所示分别是单隐藏层和多隐藏层模型。

图1 单隐藏层模型Fig.1 Single hidden layer model

图2 多隐藏层模型Fig.2 Multiple hidden layer models

其数学表达式描述如式(2)所示:

式(2)中:a是激活函数,w是权值,b是偏移量(截距)

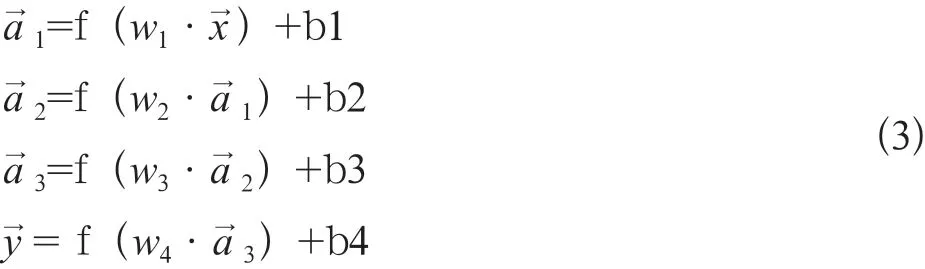

其数学表达式描述如式(3)所示:

式(3)中:w1,w2,w3,w4和b1,b2,b3,b4为 权重和截距数组。

x→为训练因子数组(X[N,P],N=27,P=4),w1为训练因子权重,相当于PPR中的自变量因子的权重系数,在神经网络算法中,它的初始值是随机设定的。

f( )为神经元激活函数,相当于PPR中的岭函数,在神经网络算法中是按指定函数设定的。

其算法流程如下:

(1)当模型参数设定为hidden_layer_sizes=(10,5),activation= 'relu', solver='lbfgs',alpha = 0.01,max_iter = 200)时,用随机数初始化权重矩阵W[w1[4,10],w2[10,5],w3[5,1]]和截距矩阵B[b1[10],b2[5],b3[1]];

(2)按最大迭代次数200,对权重矩阵和截距矩阵共111个数据进行残差最小化寻优。每次迭代过程的流程如下:

1)按当前的权重和截距计算各层神经元数组;

2)计算回归方程与目标Y的平均平方差(loss);

3)按loss反向计算权重和截距的更新值;

4)迭代循环1)~3)直到结束。

(3)输出回归模型。

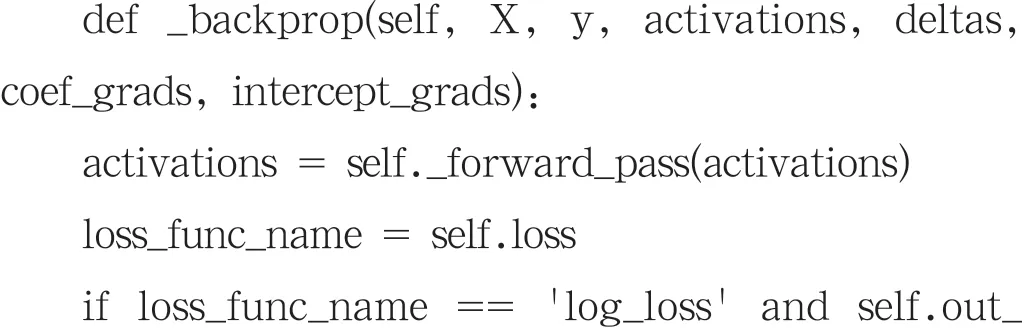

部分实现核心代码如下:

2 数据实例

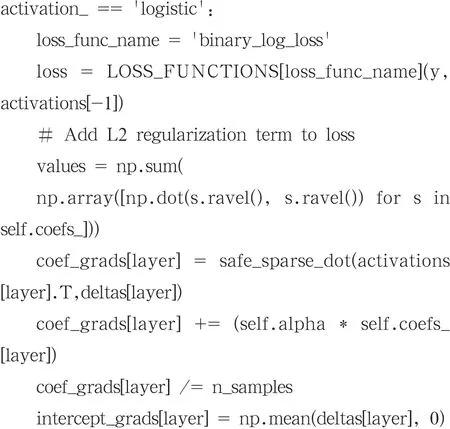

为了深入了解MLPR算法流程,并便于与PPR进行比较,本文使用经过简化处理的波士顿房价数据集作为建模和预留检验的样本数据,其值如表1所示。

表1 简化处理的波士顿房价数据集Tab.1 A simplified Boston house price dataset

3 建模与计算

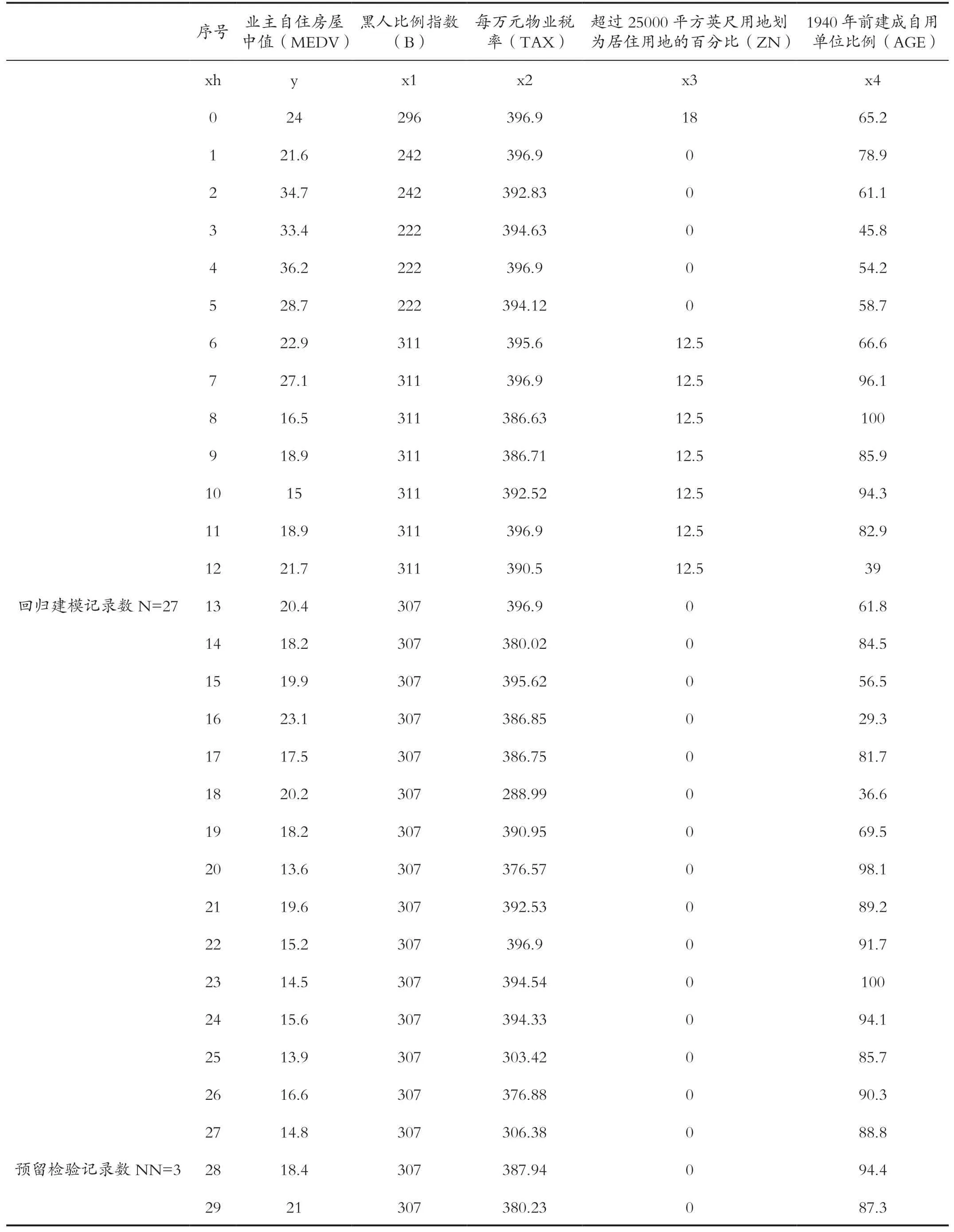

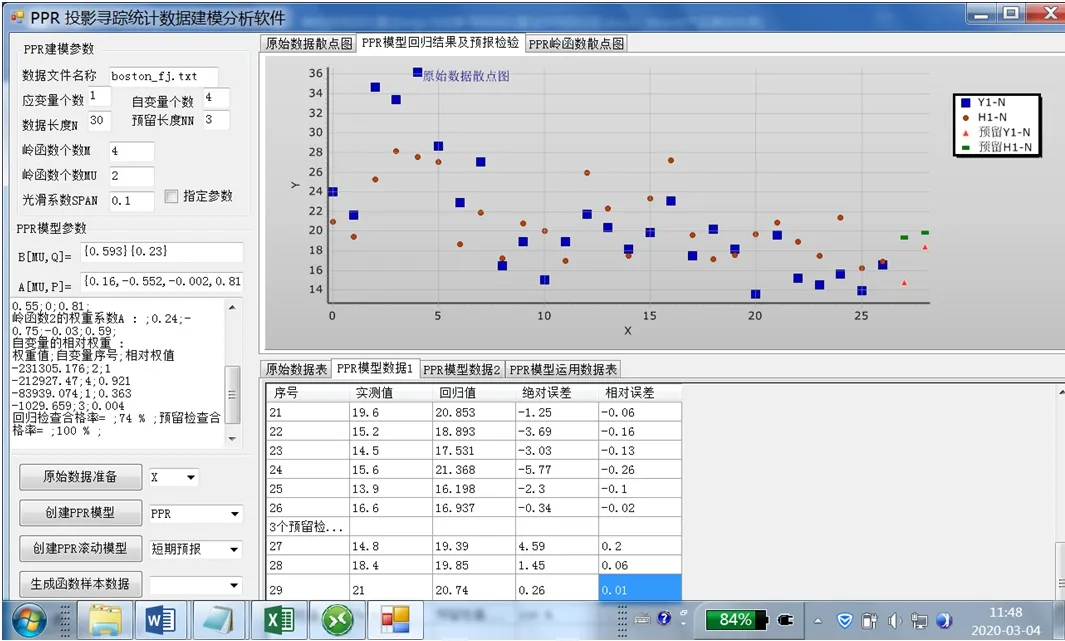

PPR模型是通过计算机程序运算不断寻优的过程,使其满足如下极小化准则,即按PPR(P4,N27,NN3,M4;MU2)建模,预报结果如图3所示。

图3 PPR模型回归结果及预报检验Fig.3 PPR model regression results and forecast verification

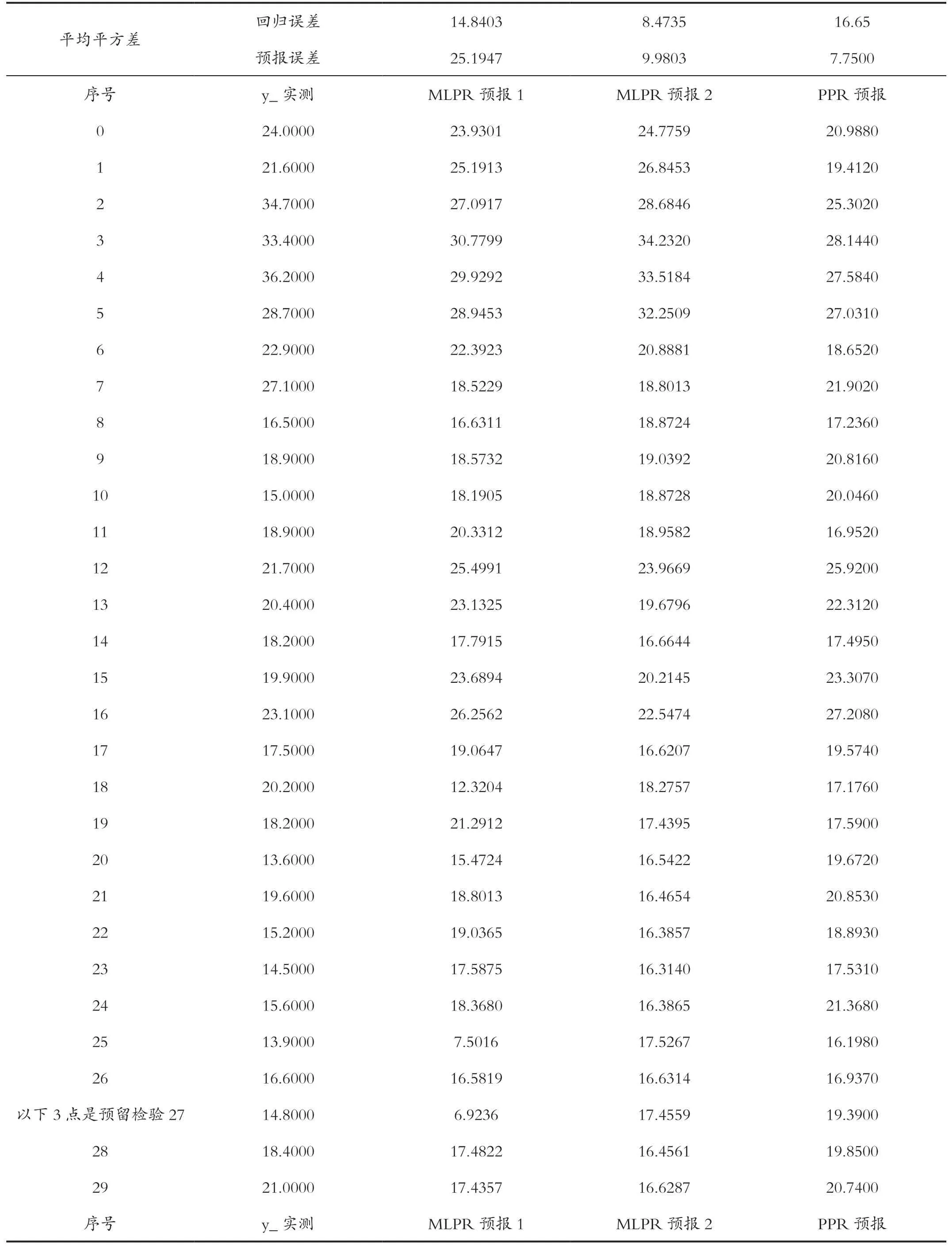

按MLPR(P4,N27,NN3,(10,5))建模预报处理的结果数据与PPR对比如表2所示。

表2 MLPR与PPR建模处理预报结果数据对比Tab.2 Comparison of MLPR and PPR modeling and processing forecast data

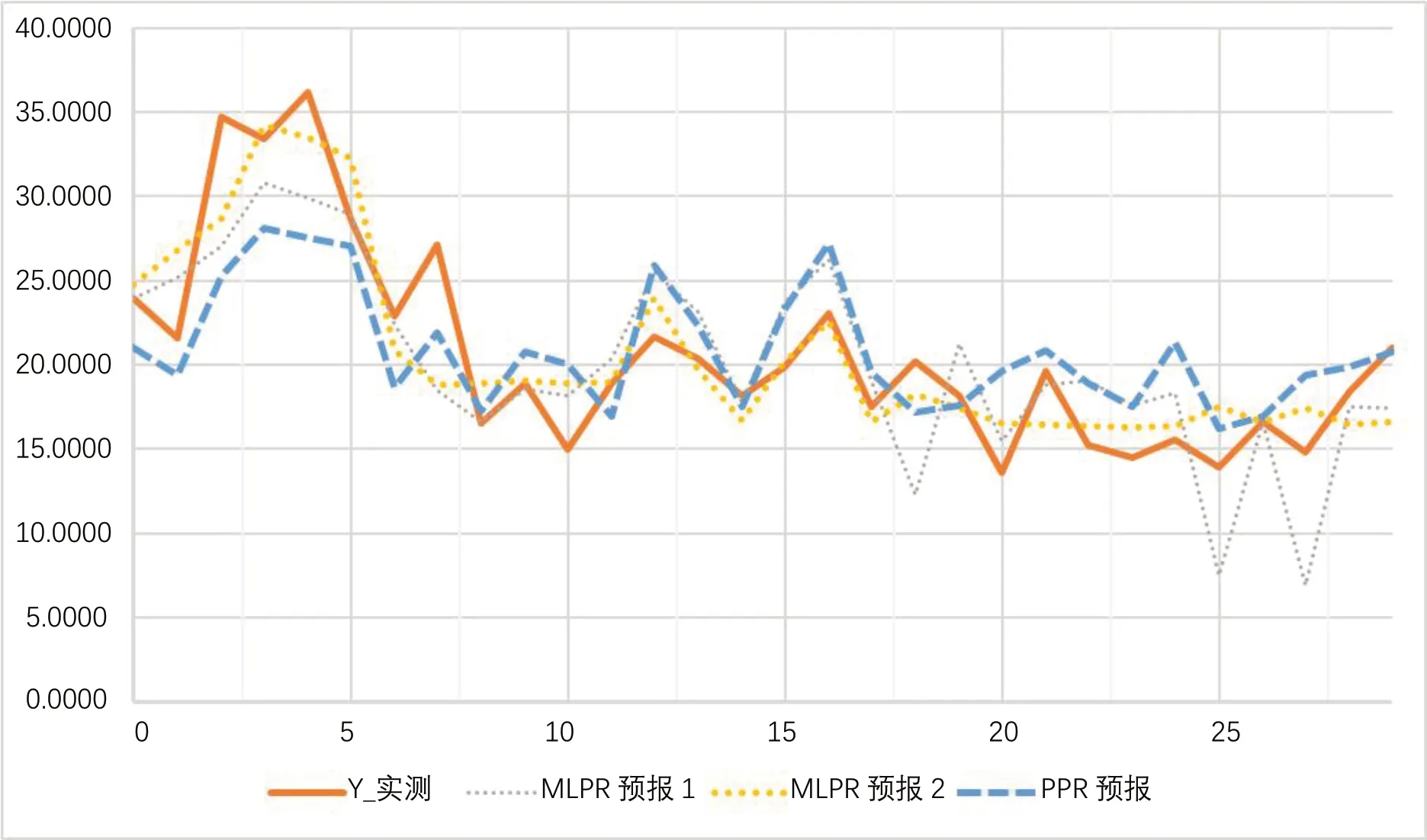

表2数据用图形表示如图4所示。

图4 PPR与MLPR预报结果比较Fig.4 Comparison of PPR and MLPR forecast results

4 结论

预测结果验证了回归模型的可行性。同时,对投影寻踪回归算法和神经网络回归算法进行对比,结果表明两者算法非常类似,都是通过对P维训练因子,进行坐标转换,构建回归模型,再按回归模型的残差,对回归模型参数进行迭代寻优处理。两者的区别是回归模型参数个数不同,投影寻踪回归算法的回归模型参数个数=P训练因子维数×MU+MU岭函数最终个数。神经网络回归算法的回归模型参数个数=P训练因子维数×第1隐藏层节点数+……+第(n-1)隐藏层节点数×第n隐藏层节点数+输出层节点数(即目标Y的维数)。当使用同一个样本数据(波士顿房价数据集)进行建模预报比较时,PPR最后3个预留检验点的预报误差比MLPR低。投影寻踪回归算法具有较强的稳健性和抗干扰性,神经网络回归算法的结果是不稳定的,原因是神经网络回归模型的初始参数是随机的,导致模型不稳定。

引用

[1] 宋晓涛,孙海龙.基于神经网络的自动源代码摘要技术综述[J].软件学报,2022,33(01):55-77.

[2] 刘方爱,王倩倩,郝建华.基于深度神经网络的推荐系统研究综述[J].山东师范大学学报(自然科学版),2021,36(4):325-336.

[3] 白祉旭,王衡军,郭可翔.基于深度神经网络的对抗样本技术综述[J].计算机工程与应用,2021,57(23):61-70.

[4] 李舵,董超群,司品超,等.神经网络验证和测试技术研究综述[J].计算机工程与应用,2021,57(22):53-67.

[5] 李炳臻,刘克,顾佼佼,等.卷积神经网络研究综述[J].计算机时代,2021(4):8-12+17.

[6] 张驰,郭媛,黎明.人工神经网络模型发展及应用综述[J].计算机工程与应用,2021,57(11):57-69.

[7] 梁苗.基于粒子群优化投影寻踪模型的大型商场火灾风险评价[D].武汉:武汉理工大学,2020.

[8] 李贝贝.基于投影寻踪法的股权激励对公司绩效的影响研究[D].徐州:中国矿业大学,2019.

[9] 顾婷.基于RAGA的投影寻踪模型的广西资源环境承载力评价[D].武汉:武汉大学,2018.

[10] 苏屹,姜雪松,张成功.投影寻踪法在企业评价体系中的应用综述[J].科技和产业,2013,13(11):104-107.