细胞病理图像质量评价方法

彭晨辉 刘皓晨 高玮宁 何勇军

摘 要:智能病理輔助诊断系统可以辅助医生诊断宫颈癌,筛除低质量的样本图像能够有效减少智能病理辅助诊断系统的漏诊和误诊,提高诊断的效率和准确率。目前智能辅助诊断领域没有完整的细胞病理图像质量评价的方法,因此提出一种细胞病理图像质量评价方法。利用病理诊断知识和医生经验,归纳总结出图像质量评价指标,包括图像有效视野、栅格样成像、清晰度、染色标准、鳞状上皮细胞数量、细胞团面积和脏污面积占比等。首先针对图像有效视野和栅格样成像利用图像分割和图像纹理特征提取的方法进行评价;再采用引入通道注意力的ResNet-34模型对清晰度进行评价;然后对图像进行颜色反卷积处理,获得染色剂通道灰度值,用于判断细胞的染色是否标准;再通过目标检测模型Yolov5s,对鳞状上皮细胞、细胞团和脏污进行检测;最后利用回归模型为细胞图像质量评分,并将结果应用到智能辅助诊断项目中。实验表明,方法规范了细胞病理图像质量评价的流程,避免由于主观评价带来的差异,提高了病理诊断效率和准确率。

关键词:智能病理辅助诊断系统;图像质量评价;金字塔图像;图像特征

DOI:10.15938/j.jhust.2023.05.010

中图分类号: TP315.69

文献标志码: A

文章编号: 1007-2683(2023)05-0075-10

收稿日期: 2022-05-02

基金项目: 黑龙江省自然科学基金杰出青年项目(JJ2019JQ0013).

作者简介:

彭晨辉(1978—),男,高级工程师;

刘皓晨(1996—),女,硕士研究生.

通信作者:

何勇军(1980—),男,博士,博士研究生导师,E-mail:holywit@163.com.

Quality Evaluation Methods for Cytopathological Cell Image

PENG Chenhui1, LIU Haochen2, GAO Weining2, HE Yongjun3

(1.Information Center, The Sixth Affiliated Hospital of Harbin Medical University, Harbin 150080, China;

2.School of Computer Science and Technology, Harbin University of Science and Technology, Harbin 150080,China;

3.School of Computer Science and Technology, Harbin Institute of Technology, Harbin 150080,China)

Abstract:The intelligent pathological auxiliary diagnosis system can assist doctors in diagnosing cervical cancer, and screening out low-quality sample images can effectively reduce the missed diagnosis and misdiagnosis of the intelligent auxiliary diagnosis system, and improve the efficiency and accuracy of diagnosis. At present, there is no complete cytopathological image quality evaluation method in the field of intelligent auxiliary diagnosis, so we propose a cytopathological image quality evaluation method. Using the knowledge of pathological diagnosis and the experience of doctors, the image quality evaluation indicators were summarized, including the effective field of view, grid-like imaging, sharpness, staining standard, the number of squamous epithelial cells, the area of cell clusters and the proportion of dirty areas. First, the effective field of view and grid-like imaging are evaluated by image segmentation and image texture feature extraction; the ResNet-34 model with channel attention is used to evaluate the sharpness; then the color deconvolution is performed on the image. The gray value of the dye channel is obtained, which is used to judge whether the staining of cells is standard. Then, the target detection model Yolov5s is used to detect squamous epithelial cells, cell clusters and dirt. Finally, the regression model is used to score the cell image quality, and the results are applied to the intelligent auxiliary diagnosis project. Experiments show that the method in this paper standardizes the process of cytopathological image quality evaluation, avoids differences caused by subjective evaluation, and improves the efficiency and accuracy of pathological diagnosis.

Keywords:intelligent pathology assistant diagnosis system; image quality evaluation; pyramid image; object detection; image features

0 引 言

病理切片数字化积累了大量的数据,是人工智能辅助诊断的重要前提。图像质量不合格会严重影响人工智能诊断系统的效率和准确率,甚至出现漏诊和误诊[1]。因此急需细胞病理数字图像质量评价方法。

图像质量的客观评价方法是由计算机按照算法计算出的图像质量评价指标,客观评价使用数学模型给出量化值,使用图像处理技术评价失真图像,操作简单,已经成为图像质量评价研究的重点。由于深度学习在许多计算机视觉任务中取得成功,基于深度学习的图像质量评价方法蓬勃发展[2]。Hosu等人通过对多种基线网络进行测试,证实了语义特征在图像质量评价领域的有效性[3]。Zhang等[4]提出了一种双流网络结构来预测合成图像和真实图像的失真,其中真实图像预测流采用VGG-16进行特征提取。Li等[5]提出使多批次ResNet-50提取特征的统计数据进行质量预测。姚旺等[6]将多通道网络引入到FR-IQA算法中,获取理想参考图像和失真图像的梯度差异图,将梯度差异图和失真图像同时输入到多通道网络中学习质量分数。王同罕等[7]提取失真图像的梯度特征,用于全参考图像质量评价。也有一些学者基于医学领域提出一些质量评价方法,Senaras等[8]就组织病理学图像評价提出一种质量评价方法流程,综合评价了噪声,清晰度,伪影等指标,可以在各个方面评价组织病理图像的质量,并且开源了算法代码。Shakhawat H M等[9]对组织病理图像进行手工特征提取,将提取到的特征输入到支持向量机(support vector machine,SVM)分类器,用以检测组织病理图像中的伪影。

现有图像评价方法的研究大多都是基于自然图像,在医学领域没有完整的图像质量评价方法,且清晰度评价函数只能采用有参考的方式判断,在细胞病理图像领域适应性差[2],因此我们通过研读《宫颈液基细胞学的数字病理图像采集与图像质量控制中国专家共识》(简称,《共识》)和TBS(The Bethesda system)系统[10],总结细胞病理图像评价的关键因素,参考自然图像的评价方法,提出针对细胞病理图像评价的方法,从图像有效视野、栅格样成像、清晰度、染色标准、鳞状上皮细胞数量、细胞团面积和脏污面积占比七个指标对全视野数字图像(whole slide images,WSI)整体质量可靠性进行评价。

针对图像有效视野和栅格样成像本文选择使用图像分割和图像纹理特征提取的方法进行评价;采用引入注意力通道的ResNet-34模型对清晰度进行评价;对图像进行颜色反卷积处理,获得染色剂通道灰度值,用于判断细胞染色是否标准;最后,通过目标检测模型Yolov5s,对鳞状上皮细胞、细胞团和脏污进行检测。根据提取出来的图像特征指标,对细胞病理图像的质量进行综合评分,为智能病理辅助诊断系统提供标本的满意度评价。本方法旨在减少需要医生或使用人员对图像质量进行主观评分的工作量,帮助规范病理诊断流程,为智能病理辅助诊断系统提供有力支持,提高病理诊断效率和准确率。

1 方法介绍

根据TBS诊断标准和《共识》,本文通过以下7个指标对图像质量进行评价:

1)有效视野是否完整;

2)图像是否存在栅格样成像;

3)染色是否标准;

4)图像清晰度;

5)鳞状上皮细胞数目;

6)脏污面积占比;

7)细胞团遮挡面积。

细胞图像质量评价方法的关键在于图像特征的提取,WSI图像的数据量非常大,通常WSI图像包含上亿数量级的像素。WSI图像系统采用多分辨率金字塔模型,高放大率可获得高分辨率图像,低放大率可获得低分辨率图像。高分辨率图像包含更精细的图像细节,有助观察细胞结构与形态,便于分析和诊断。用金字塔分割的方式,获得金字塔不同层的图像[11]。对不同特征的计算需求选择合适的分辨率,能有效提高运算的速度,减少计算资源浪费。图像的有效视野是否完整、图像是否存在栅格样成像的判别在低分辨率金字塔图像中即可完成判别,故上述两个特征在金字塔第六层图像中完成评价;在金字塔图像的第五层,完成染色标准、图像清晰度的评价;高分辨率图像包含更精细的图像细节,有助于观察细胞结构与形态,因此在金字塔图像的第二层完成脏污面积占比、鳞状上皮细胞数量和细胞团数量的评价。将以上7个图像特征指标输入XGBoost模型中[12],获得细胞病理图像的质量分数,依据分数给出图像在智能病理辅助诊断系统中的应用。上述细胞病理图像质量评价流程如图1所示。

1.1 图像有效视野及栅格样成像判定方法

在扫描成像过程中,扫描镜头不洁净会造成图像有效视野被遮挡,成像不清等。此外,还会出现白平衡失调、扫描对准不精确等,图像呈现栅格样成像等问题,导致细胞不可辨认,影响细胞判读阅片诊断。利用图像标本区域与背景区域有较大的差异的特点采用图像分割方法,获得有效视野的位置,判断其是否完整;根据栅格样成像的图像与正常图像纹理特征的差异,对图像是否存在栅格样成像进行判断。

图像金字塔是指在同一的空间参照下,根据用户的需求以不同的分辨率进行存储与显示,形成分辨率由粗到细、数据量从大到小的金字塔结构,金字塔中的每一级都是一幅图像。按需求选择合适的分辨率能够有效减少运算的数据量。观察图像有效视野是否完整以及是否存在栅格样成像,在金字塔图像的第6层可以完成判定,同时运算数据量最小,因此在提取图像有效视野时,选择提取图像金字塔的第6层,获得一张完整视野图像I,利用图像分割方法分割图像I,获得二值图像T,对二值图像T做预处理将图像中所有轮廓连成一个大轮廓,得到样本的有效视野。然后根据有效视野轮廓坐标,获得其外接矩形,判断其外接矩形在整张图像中的位置,确定有效视野是否完整,若完整则记为f1=1,若不完整则记为f1=0。根据获得的大轮廓,提取轮廓以外区域的纹理特征值T,然后对特征值做聚类分析,获得标准图像的纹理特征值范围,判断纹理特征值T是否在标准图像的纹理特征值范围内,若在标准图像的纹理特征值范围内则不存在栅格样成像,判定为合格记为f2=1,若存在栅格样成像则记为f2=0。

1.2 无参考评价的图像清晰度判定方法

传统的图像清晰度评价函数都是采用有参考评价的评价思路,对于不同视野下的图像无法统一评价,也缺乏对WSI图像的清晰度评价的方法,因此本文提出一种针对WSI图像无参考评价的清晰度评价方法。首先获取不同焦平面的扫描图像,不同焦平面与聚焦平面相差的距离作为评价标签,并对获得的图像进行增广处理,以此制作数据集对分类模型进行训练,使其对不同焦平面的图像进行准确地分类,从而用于WSI图像质量的评价。

1)判别模型的训练

本方法利用ResNet-34神经网络进行特征提取,并且为了进一步提高模型分类准确率在Res-Net34网络中添加通道注意力机制模块[13]和最大值最小值池化,然后输入全连接层进行分类[14],利用反向传播对网络参数进行更新和微调,最后进行分类,模型如图2所示。

通过ResNet-34提取图像特征,并根据特征向量对图像进行清晰度分类。与传统的清晰度评价函数相比,不仅可以提取到更多的图像特征,而且可以无参考地评价图像是否清晰。通过深度学习端到端的优势,不需要提前手动进行特征提取。将本模型作为图像清晰度判断模型,可以有效地对清晰图像和模糊图像进行分类。

2)数据预处理与增广

为了提高模型的泛化能力,避免分类模型受光照、颜色等外在环境影响,在模型训练测试之前对训练数据进行数据预处理操作。为了加快训练梯度下降的求解速度,进而加快网络模型收敛。对图像数据进行通道维度的归一化操作。

为了使数据的分布更均匀,减少模型学习到数据分布的可能行,提高模型的模型精度,对图像数据进行标准化操作。模型训练过程中,在数据量小网络模型复杂的情况下容易出现过拟合现象,导致模型在实际训练数据上效果不好。因此对数据进行数据增强以增加数据量。

由于不同医院的细胞病理图像的染色效果可能不同,为了降低模型对颜色的敏感性,提升模型的鲁棒性,采用交换原始数据颜色通道的数据增广策略。该操作只改变离焦图像的颜色表现,不会影响图像中蕴含的离焦信息。数据增强结果如图3所示。

图像清晰度评价中,若符合要求,则指标f3=1,不符合则f3=0。

1.3 基于颜色反卷积的染色标准评价

临床上对组织图像的细胞核和基质进行染色最常规染色方法是苏木精和伊红染色(H&E染色),苏木精(Hematoxylin)将细胞核染成深蓝紫色;伊红(Eosin)将细胞质染成粉红色。在显微镜下,使用这两种染料可以明确区分细胞核和基质。在H&E癌症组织病理学图像中,医生可以通过分析癌症组织病理学图像中细胞核的信息,完成临床诊断。但是细胞病理图像中常常会出现染色模糊,染色程度不均等,都影响着医生的诊断结果。

为了评价样本的染色情况是否符合标准,本文使用颜色反卷积的方式对图像进行染色分离[15],对分离后的通道图像进行阈值分割获得苏木精通道和伊红通道的图像掩膜,图像掩模与原图像进行图像与运算就可以获取到苏木精和伊红染色像素所在位置,然后计算苏木精和伊红像素的平均灰度值。染色分离及灰度计算流程图如图4所示。

本文中使用自适应颜色反卷积对原始图像进行染色分离后,再通过大津法阈值分割对分离后的通道图像进行阈值分割,获得苏木精通道和伊红通道的图像掩膜。大津法是一种图像灰度自适应的阈值分割算法[16],按照图像上灰度值的分布,将图像分成背景和前景两部分看待,前景就是我们要按照阈值分割出来的部分。图像掩模與原图像进行图像与运算就可以获取到苏木精和伊红染色像素所在位置,然后计算苏木精和伊红像素的平均灰度值。

为了确定苏木精和伊红染色的染色标准,本文对医生提供的标准样片进行聚类分析,确定最佳的染色强度。在病理专家的帮助下,选取了200张医生认为苏木精和伊红染色良好的样本。因为染色样本特征具有正态分布的概率分布特性,进行聚类分析后确定出伊红通道平均灰度值位于185~190之间为伊红染色标准范围,苏木精通道平均灰度值位于180~200为苏木精染色标准范围,均在范围内记染色特征f4=1,反之f4=0。

1.4 基于YOLOv5s的图像特征提取

为了实现对鳞状上皮细胞计数、细胞团遮挡面积和脏污面积占比的计算,首先要采用要对鳞状上皮细胞、细胞团和脏污区域进行目标检测。本方法采用YOLOv5s模型对鳞状上皮细胞和细胞团进行目标检测[17]。YOLOv5s网络结构图如图5所示。

使用YOLOv5s完成对鳞状上皮细胞、细胞团和脏污区域的目标检测后,根据目标检测结果,通过统计图像中被检测为鳞状上皮细胞的标签数量完成鳞状上皮细胞的计数[18-19];通过对检测为细胞团和脏污的区域进行阈值分割,可以得出细胞团和脏污区域的面积占比。

根据TBS诊断标准,鳞状上皮细胞数量应该在5000~8000范围内、细胞团数量在50以下及脏污面积占比小于25%,因此可按公式计算得到图像特征f5-f7的值,f5-f7的计算公式分别为式(1),式(3),式(4):

f5=0x≤3000,x>10000

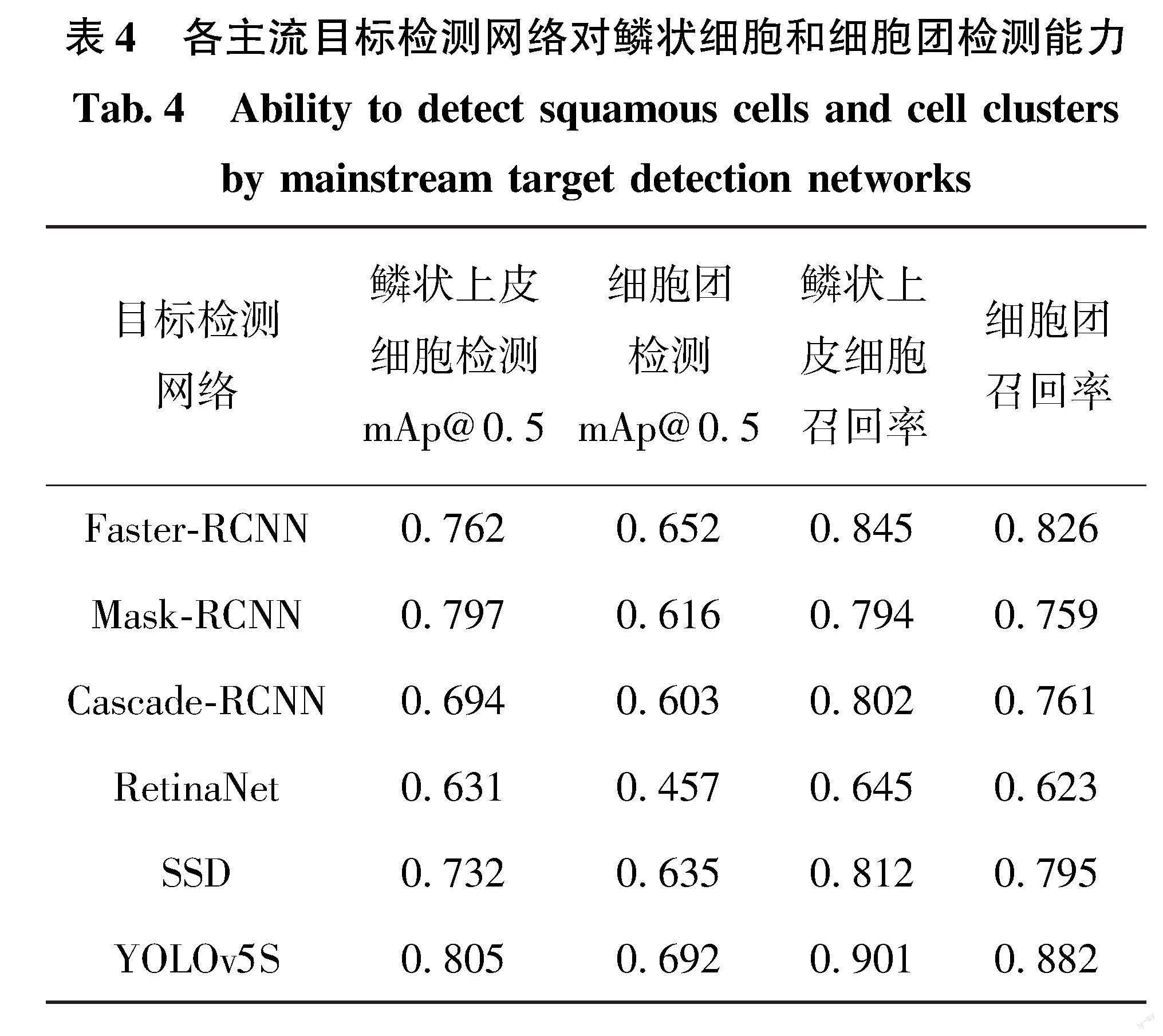

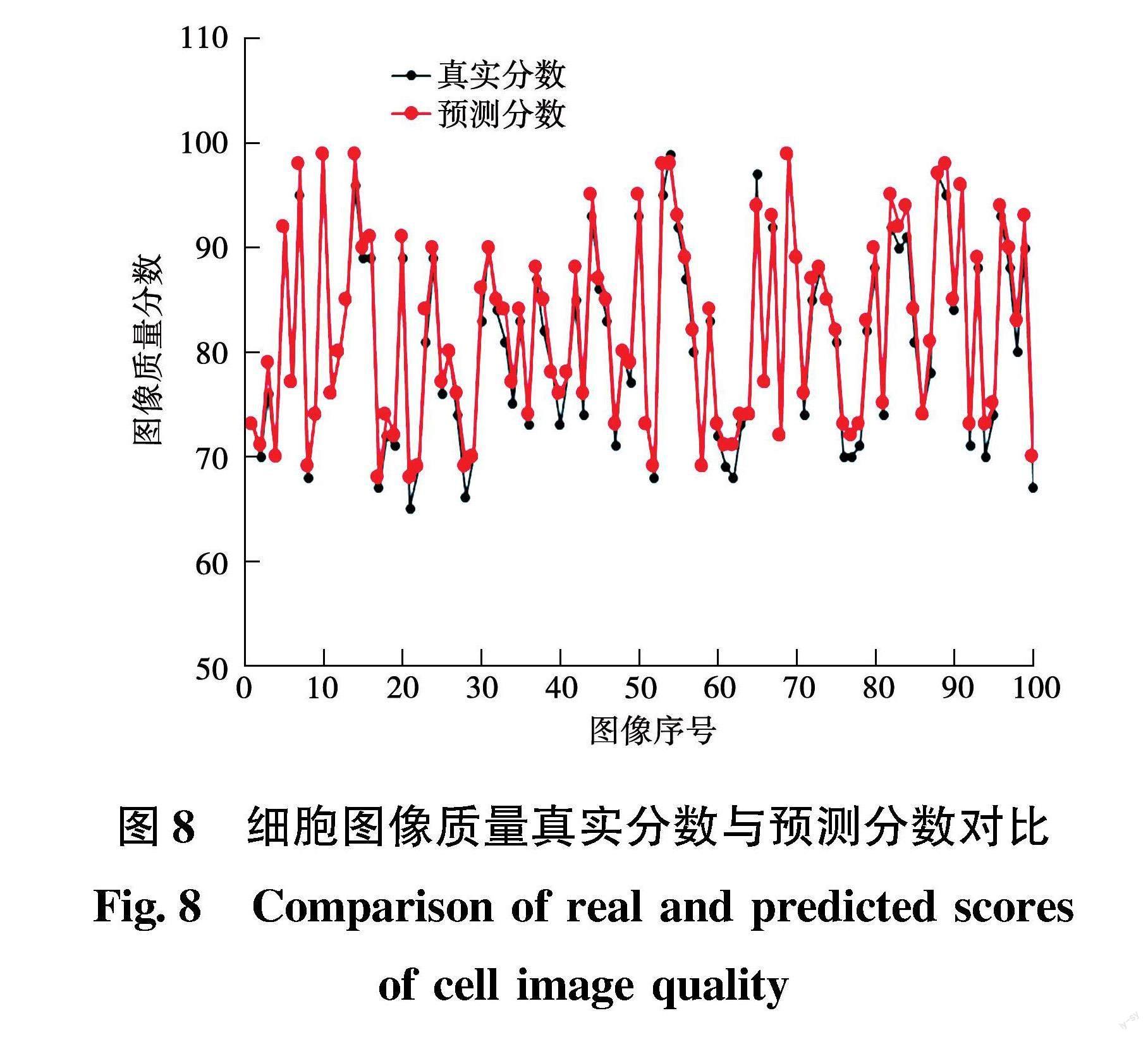

x/50003000 15000 1-(x-8000)/80008000 S=Scell+Scell_mass+Sdirty (2) f6=1-Scell_mass/S(3) f7=1-Sdirty/S(4) 其中:x为鳞状上皮细胞的数量;Scell为鳞状上皮细胞面积;Scell_mass为细胞团面积;Sdirty为脏污部分的面积。 1.5 图像质量评分方法 XGBoost高效地实现梯度提升决策树(grandient boosting decision tree,GBDT),有较高的计算效率。在本次任务中将细胞病理图像的7个指标输入XGBoost,完成特征指标与图像质量分数的映射。选取100张细胞病理图像,由经验丰富的病理医生依照TBS诊断标准对细胞病理图像进行打分,打分结果作为细胞病理图像的真实分数,与XGBoost模型输出的细胞病理图像质量分数进行对比,验证XGBoost回归模型的预测性能。 XGBoost是由k个决策树组成的一个加法运算式,在给出n个实例,m维特征的情况下,XGBoost可以表示为 D={(xi,yi)}(|D|=n,xi∈Rm,yi∈R)(5) i=∑kt=1ft(xi),ft∈F(6) 其中:fk为第k个决策树;i为第i个样本的预测值;F是由K个基函数组成的函数空间。根据TBS诊断标准和细胞形态学特征,提取7个特征对XGBoost进行训练,Rm代表第m个特征。 上述方法中提取到的图像特征f1~f7输入XGBoost模型,输出最终的细胞图像质量评价分数。 根据得到的细胞图像质量分数,对宫颈液基细胞WSI的整体质量进行可信度评估。细胞图像质量分数在5分以及上评定为整体“可信度好”,5分以下评定为“可信度差”。在智能病理辅助诊断系统中,对于可信度好的图像,可用于辅助医生判读项目的研究测试或应用,并予以存储。对于可信度差的图像,无法提供可靠的判读结果,建议重新扫描、存储。 2 实验分析 2.1 无参考评价的图像清晰度判定方法实验 本次使用的训练数据包含16张不同的H&E染色的全视野数字切片。对于每一张幻灯片,我们用全视野数字切片扫描仪在20倍放大倍数下扫描一个约为6毫米面积的感兴趣区域(region of interest, ROI),像素大小约为0.98μm×0.98μm 。对于每个ROI,由熟练的操作员手动选取25个聚焦点,并根据所选聚焦点进行聚焦,以确保焦平面与样本高度对齐良好。然后在[-2.5μm,+2.5μm]之间对聚焦平台加入固定扰动,以获得相同的ROI以及相同ROI的不同焦平面图像,距离准焦平面越远的图像模糊程度越高,反之模糊程度越低。最后,将所有感兴趣区域图像划分为512×512像素大小的瓦片图,共18万张瓦片图。将偏移量在[-0.5,+0.5]之间的瓦片图,标记为清晰图片,其余图像标记为模糊。由于模糊的瓦片图的数量(12万)大于聚焦瓦片数量(6万),因此随机模糊瓦片图随机抽取10.8万个样本进行数据集构造,以防止分类训练集的不平衡,最后10%的瓦片图被选为验证集。数据集中的所有样本是完全匿名的。 首先,为了验证ResNet-34模型分类的高效性,分别选用ResNet-34,ResNet-18,VGG-16进行训练,将特征提取结果直接输入到SVM进行分类。各种网络的分类准确率如表1所示。从表1中可以看出,与准焦平面相邻的焦平面分类准确率低,与准焦平面相距越远的分类准确率越高。因为越远离准焦平面,图片越模糊,分类也就越容易。然而上述模型中其他3个分类模型在焦点附近的分类准确率较低,ResNet-34在焦点附近的准确率远高于其他方法,并且平均分类准确率最高。为了更加清晰地看出各网络分类准确率之间的关系绘制分类准确率点线图,从图6可以看出,ResNet-34对各个焦平面都有较高的分类准确率。 为了验证注意力机制的有效性进行消融实验,選取ResNet-34与加入通道注意力机制的ResNet-34在3个测试集上进行测试,平均分类准确率如表2所示,在3个测试集上,本文提出的方法均高于原本ResNet-34,这表明引入注意力机制模块可以有效地提升原ResNet-34的分类准确率。 ResNet-34网络结构中使用最大值池化和平均池化,最大池化和平均池化可以有效地对数据进行降维度。但是在清晰度判断的应用场景下,平均池化和最大池化导致图像高频和低频信息模糊,造成特征信息缺失,进而影响清晰模糊分类准确率。为了解决此问题,将ResNet-34网络中的池化层改成最大最小值池化,具体操作如下:将特征向量同时做最大值和最小值池化,然后将池化后的特征向量进行连接,输入到全连接层。为了验证最大值+最小值池化的有效性进行消融实验,在ResNet-34+通道注意力机制的网络结构基础上,最后一层的池化操作中分别使用最大值池化,最小值池化,平均池化和最大值+最小值池化进行验证。在3个数据集中,进行分类准确率验证,实验结果如表3所示,其中,最小值池化在3个测试集上的分类准确高于平均池化和最大值池化,最大池化在3个测试集的平均分类准确率较低,最大值+最小值池化的在3个测试集上的平均准确率更高,平均准确率提高约2%。 为了验证网络的计算效率,本节中提出的方法与多种清晰度评价与Yu′s CNN[20]、Brenner、Sobel、SMD、Roberts、CPBD、JNB、EMBM[21]清晰度评价方法进行对比,各方法运行平均时间如图7所示。从上述实验可以看出,本节提出的基于深度学习的清晰度判定方法,不仅有着优秀的判定准确率,而且计算效率也由于多数的评价方法。 2.2 基于YOLOv5s的图像特征提取实验 对比了多种目标检测网络对于鳞状上皮细胞和细胞团的检测能力,对比目前主流目标检测的检测能力,目前主流目标检测模型对于鳞状上皮细胞和细胞团检测的召回率和mAp@0.5如表4所示。目标检测中使用mAP(Mean Average Precision,平均精度均值)来评估检测准确度,mAP值越大目标检测效果越好。 从上表可以看出,YOLOv5s在细胞团和鳞状上皮细胞的mAp@0.5和召回率效果都很好,可以用于鳞状上皮细胞计数和细胞团检测。 2.3 图像质量评分方法验证 为了验证XGBoost回归模型的预测性能,选取100张细胞病理图像,由经验丰富的病理医生依照TBS诊断标准对图像质量进行打分,打分结果作为细胞病理图像质量的真实分数。XGBoost的参数设置为:学习率范围设置为0.01~0.9,迭代次数范围设置为100~10000,随机采样比例范围设置为0~0.9。通过搜索遍历,最终确定本文所使用的XGBoost模型树的最佳参数设置。其中选择提升器选用gbtree,学习率设置为0.05,树的最大高度设置为3,叶子最小权重和设置为1,样本采样比率设置为0.2,迭代次数设置为1000,评估指标选用MAPE,任务函数选择Gamma。实际分数与预测分数的对比图如图8所示。 实验表明XGBoost可以准确地评价细胞病理图像质量,并且符合TBS诊断标准。 2.4 评价性能实验 为了评价基于TBS的细胞病理图像质量评价方法的运算性能,选取5个不同分辨率的WSI图像,每个样本的分辨率如表5所示。本实验的计算机环境为Ubuntu64位操作系统,CPU为Intel(R) Xeon(R) CPU E5-2678,GPU为NVIDIA 2080Ti,编程语言为python实现。 细胞病理图像质量评价所耗时间如表6所示,从表6可以看出,质量评估过程主要包括清晰度评价时间、目标检测时间、染色判断时间和磁盘读写时间;分辨率越高的细胞病理图像评估时间越长;其中清晰度判断和目标检测时间比较耗时,这两个阶段占用了质量评估的大部分时间,在整体评估时间中占总体的90%以上。 3 结 论 本文针对WSI图像质量评估方面缺乏病理医学知识的问题,提出了一种基于TBS诊断标准和图像质量共识的细胞病理图像评价方法。该方法融合了传统图像评价指标和TBS诊断标准。为了完成基于TBS的细胞病理图像评价方法,首先提出了基于残差网络的清晰度判定方法,采用Resnet-34提取图像特征,并在原有的网络基础上添加通道注意力机制模块和最大值最小值池化,将图像特征输入到全连接层中,进行图像清晰模糊分类,可以高效快速地检测WSI图像中的模糊区域,解决了传统清晰度评价函数难以直接评价图像是否清晰这一问题。然后根据颜色反卷积,成功地分离出苏木精和伊红染色通道,并且计算出两个通道的平均灰度值,可以用于评价细胞病理图像的染色标准。通过yolov5s目标检测网络,对图像中鳞状上皮细胞、细胞团和脏污区域进行检测和评价。最后将提取出来的特征指标输入到XGBoost回归模型中完成细胞圖像质量评价。根据图像质量的可靠性将其应用在智能病理辅助诊断系统中。实验表明,本文提出的质量评价方法适用于H&E染色的细胞病理图像质量评价,并且将TBS病理知识融合到评价流程,解决了临床图像质量评价难的问题。 参 考 文 献: [1] 中国病理医师协会数字病理与人工智能病理学组, 中华医学会病理学分会数字病理与人工智能工作委员会, 中华医学会病理学分会细胞病理学组. 宫颈液基细胞学的数字病理图像采集与图像质量控制中国专家共识[J]. 中华病理学杂志, 2021, 50(4): 4. Expert Group of Digital Pathology and Artificial Intelligence Pathology of Chinese Association of Pathologists; Expert Group of Digital Pathology and Artificial Intelligence Pathology of Chinese Society of Pathology; Expert Group of Cytopathology of Chinese Society of Pathology. Chinese Exports′ Consensus on Digital Pathological Image Acquisition and Quality Control of Cervical Liquid Based Cytology[J]. Chin J Pathol, April 2021, 50(4): 4. [2] 王紫旋,谢怡宁,何勇军.病理辅助诊断系统中数字滤光片的实现方法[J]. 哈尔滨理工大学学报, 2022, 27(1): 40. WANG Zixuan, XIE Yining, HE Yongjun. Realization Method of Digital Filter in Pathological Assistant Diagnosis System.[J]. Journal of Harbin University of Science and Technology, 2022, 27(1): 40. [3] HOSU V, LIN H, SZIRANYI T, et al. KonIQ-10k: An Ecologically Valid Database for Deep Learning of Blind Image Quality Assessment[J]. IEEE Transactions on Image Processing, 2020, 29: 4041. [4] ZHANG W, MA K, YAN J, et al. Blind Image Quality Assessment Using a Deep Bilinear Convolutional Neural Network[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2018, 30(1): 36. [5] LI D, JIANG T, LIN W, et al. Which Has Better Visual Quality: The Clear Blue Sky or a Blurry Animal?[J]. IEEE Transactions on Multimedia, 2018, 21(5): 1221. [6] 姚旺,刘云鹏,朱昌波.基于人眼视觉特性的深度学习全参考图像质量评价方法[J] .红外与激光工程, 2018, 47(7): 39. YAO Wang, LIU Yunpeng, ZHU Changbo. Deep Learning of Full-reference Image Quality Assessment Based on Human Visual Properties[J]. Infrared and Laser Engineering, 2018, 47(7): 39. [7] 王同罕,贾惠珍,舒华忠.基于梯度幅度和梯度方向直方图的全参考图像质量评价算法[J] .东南大学学报(自然科学版), 2018, 48(2): 276. WANG Tonghan, JIA Huizhen, SHU Huazhong. Full-reference Image Quality Assessment Algorithm Based on Gradient Magnitude and Histogram of Oriented Gradient[J]. Journal of Southeast University (Natural Science Edition) , 2018, 48(2): 276. [8] SENARAS C, NIAZI M K K, LOZANSKI G, et al. Deep Focus: Detection of Out-of-focus Regions in Whole Slide Digital Images Using Deep Learning[J]. PloS One, 2018, 13(10): e0205387. [9] SHAKHAWAT H M, NAKAMURA T, KIMURA F, et al. Automatic Quality Evaluation of Whole Slide Images for the Practical Use of Whole Slide Imaging Scanner[J]. ITE Transactions on Media Technology and Applications, 2020, 8(4): 252. [10]CIBAS E S, ALI S Z. The Bethesda System for Reporting Thyroid Cytopathology[J]. Thyroid, 2009, 19(11): 1159. [11]劉佳甲.基于特征金字塔网络的目标检测算法研究[D].秦皇岛:燕山大学,2020. [12]ABDU-ALJABAR R D, AWAD O A. A Comparative Analysis Study of Lung Cancer Detection and Relapse Prediction Using XGBoost Classifier[J]. IOP Conference Series Materials Science and Engineering, 2021, 1076(1):012048. [13]JIE H, LI S, GANG S, et al. Squeeze-and-Excitation Networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017(1): 99. [14]HE K, ZHANG X, REN S, et al. Deep Residual Learning for Image Recognition[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016: 770. [15]S·楚卡, 蓝舟. 辅助组织样本分析的载玻片图像颜色反卷积系统及方法[P]. CN111095358A, 2020. [16]刘巍, 张彦泽, 于斌超,等. 基于大津法与K均值聚类算法联合优化的图像二值化方法[P]. 中国:CN112037233A, 2020-12-04. [17]REDMON J,DIVVALA S, GIRSHICK R, et al. You Only Look Once: Unified, Real-time Object Detection[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016: 779. [18]梁義钦, 赵司琦, 王海涛, 等. 两阶段分析的异常簇团宫颈细胞检测方法[J]. 哈尔滨理工大学学报, 2022, 27(2): 76. LIANG Yiqin, ZHAO Siqi, WANG Haitao, et al. Two-stage Detection Method for Abnormal Cluster Cervical Cells[J]. Journal of Harbin University of Science and Technology, 2022, 27(2): 76. [19]赵司琦. 基于深度学习的宫颈异常细胞检测方法[D]. 哈尔滨:哈尔滨理工大学, 2022. [20]YU S, WU S, WANG L, et al. A Shallow Convolutional Neural Network for Blind Image Sharpness Assessment[J]. PloS one, 2017, 12(5): e0176632. [21]GUAN J, ZHANG W, GU J, et al. No-reference Blur Assessment Based on Edge Modeling[J]. Journal of Visual Communication and Image Representation, 2015, 29: 1. (编辑:温泽宇)