基于卷积神经网络的光学遥感影像分析综述

田启川 吴施瑶 马英楠

1(北京建筑大学电气与信息工程学院 北京 100044)

2(北京建筑大学建筑大数据智能处理方法研究北京市重点实验室 北京 100044)

3(北京城市系统工程研究中心 北京 100048)

0 引 言

光学遥感影像识别是遥感技术应用的一个重要环节,是使用特定算法从遥感影像中提取特征并判断感兴趣的目标在图像上的差异,识别其类别属性。光学遥感影像识别常应用于环境监测、矿产勘查、城市规划与建设、抢险救灾等方面。21世纪以来,遥感技术的发展使得遥感图像的分辨率越来越高,其中地物细节更加清晰,光谱特征更加复杂。传统的遥感影像识别算法主要依赖主观提取的特征,基于这些特征进行分类的方法,有支持向量机[1]、决策树[2]、主成分分析法[3]等。这些方法易受图像噪声干扰,浪费大量时间在选取特征和调整阈值上,且泛化能力不够,已不适合处理大量复杂特征。

近年来卷积神经网络(Convolutional Neural Networks,CNN)活跃于计算机视觉领域,在图像分类、检测和检索等多类图像分析任务有所应用。基于CNN在图像特征处理方面的优秀表现,遥感影像识别也逐渐向CNN方向发展,一些研究人员将其推广到遥感图像分类、检测和检索方面。利用CNN自动提取多层次特征信息的优势,有效识别高分辨率遥感图像中复杂的地物信息,可以提升识别精度和增强泛化能力,从而推动遥感图像智能化解译的发展。

国内对光学遥感影像识别进行综述的文献,一种是作为图像识别综述中的一部分内容,多为简单列举光学遥感影像研究成果,总结不全面[4]。另一种虽然围绕遥感影像识别方法进行全面的综述,但多为介绍机器学习方法的大方向,没有具体分析卷积神经网络在遥感影像中的研究成果[5]。并且,对于涉及基于卷积神经网络的光学遥感影像算法综述,大多数只针对遥感影像应用的某一类的方法进行综述,缺乏系统地总结不同应用背景的遥感影像训练算法。

因此,本文从场景分类、目标检测和图像检索三个遥感影像的重要应用背景,对以CNN为研究网络的光学遥感影像算法进行具体综述研究,介绍了相关数据集和目前的研究成果,对各类算法进行对比分析,最后对该领域的发展方向进行展望。

1 遥感影像识别的发展

1.1 光学遥感影像

遥感影像是利用卫星和飞行器通过不同方式采集到的图像,采集方式有航空摄影、航空扫描和微波雷达三种。航空摄影是通过光学成像,这类遥感影像分辨率较高,适合用于识别研究。光学遥感影像有以下几个特点,同时产生了遥感影像研究中面临的问题。

(1) 多模的遥感信息。大多数的对地观测卫星同时提供了图像信息和光谱信息,单从视觉上看,获得的图像与实际情况可能会完全不同。这是一个具有潜力的挑战,如果能更好地融合多模态信息,可以促进识别精度的提高,扩大遥感图像识别的应用领域。

(2) 大数据的遥感信息。近年来,“遥感30号6组”“高分二号”“天绘二号”等遥感卫星相继发射,采集了海量高质量遥感图像,推动地理测绘、海洋和气候气象观测、城市管理等领域的应用发展。采集的遥感图像分辨率越来越高,地物的几何结构、位置布局和纹理尺寸越来越清晰,图像背景越来越复杂,精度识别的难度增加。

(3) 定位的遥感信息。普通图像直接从特征中获取图像的解译信息,如识别街道上的汽车和行人。而遥感数据的每个像素都是一个空间坐标,这有利于影像信息与其他来源获取的数据进行融合。因此,遥感影像特征提取后需要配合经纬度等具体地理信息才可以应用在实际项目中。

传统的遥感影像识别方法需要人工提取图像特征,在图像预处理和特征提取的过程中会遗失许多有效信息,导致识别精度不稳定,鲁棒性不高。CNN算法能够解决传统方法难以有效提升的问题,有能力对海量数据的进行处理,自动提取多层次和多维度的复杂图像特征,可以快速和直接地从遥感图像中获得有效的特征信息。

1.2 基于经典网络模型的遥感影像识别

近年来,CNN模型在计算机视觉上的优异表现促进其不断发展,延伸出一些经典的网络模型。研究人员将它们用于遥感影像识别的研究,这些模型为遥感影像识别研究做出了许多杰出的贡献。下面分析经典网络模型的特点和缺陷,并举例基于经典的网络模型的遥感影像研究成果。

(1) LeNet-5是Yann LeCun成功搭建了第一个卷积神经,为后来卷积神经网络的发展奠定了基础[6]。2016年,曲景影等[7]对LeNet-5网络进行改进并用于对遥感图像目标识别。该算法在LeNet-5网络基础上采用卷积展开方法,把Sigmoid和Tanh激活函数换成ReLU激活函数,在遥感图像上的分类准确率达到91.2%。但LeNet-5网络只局限于小规模的数据处理问题,网络宽度和深度的加深都无法在大规模数据集上实现良好的效果,无法在大数据遥感图像识别上取得更优秀的成绩。

(2) AlexNet模型采用双GPU并行运行,提出了ReLU激活函数,扩大数据集[8]。另外,模型使用Dropout正则化方法减少局部神经元之间的连接,利用重叠池化等方法防止过拟合情况的发生。王鑫等[9]在AlexNet模型基础上设计一个七层CNN模型进行遥感图像分类。特征图通过第五层池化后进行PCA降维和最后两个全连接层输出,得到三种高层特征进行融合,基于逻辑回归分类器对图像进行分类。在UCNerced_LandUse遥感图像数据集上的准确率达到95.7%。Chen等[10]提出了一种新的全卷积网络。它只由稀疏连接的层组成,可以减少参数数量且缓解过拟合问题。在MSTAR数据集上,A-ConvNets对10类目标的检测平均准确率达到99%。AlexNet模型网络层数较少,结构简单,对深层特征提取的能力有限,但它为后续的研究提供了许多新的思路。

(3) VGG模型利用小卷积将网络深度延伸至11至19层,并采用多尺度(Multi-Scale)训练方式[11]。Tang等[12]对VGGNet进行改进,提出一种将像素级和区域级相结合的遥感影像目标显著性检测方法。该模型使用多尺度特征学习,预测遥感图像的像素显著性。Wei等[13]基于VGG结构设计了一种道路结构细化卷积神经网络(RSRCNN)以提取航空图像中的道路。RSRCNN结构中包含了反卷积层和融合层,并设计了基于道路特征信息的交叉熵损失函数。Lin等[14]提出了一种基于HOG和深度学习特征的飞机识别方法。首先采用SVM分类器对图像中的飞机位置粗略定位,再利用VGGNet模型进行精确定位,排除识别错误的区域。测试中,对飞机定位的精确率达到99.7%,识别精度为98.1%。VGGNet模型在遥感图像研究的表现良好。但由于VGGNet模型自身计算量大的缺陷,使得训练效率无法提高,这是早期CNN模型的通病。针对这一问题,之后研究人员设计了许多新型的CNN模型,有效提高了遥感图像识别的效率问题。

(4) GoogLeNet模型设计了Inception结构[15]。创新点是使用多尺度特征融合,使用平均池化层取代全连接层,增加两个辅助的softmax用于向前传导梯度。Inception结构如图1所示。Castelluccio等[16]采用GoogLeNet模型,对目标数据微调来预训练网络进行遥感图像的场景分类任务。该算法对UCMerced土地使用数据集和巴西咖啡场景数据集进行场景分类,准确率分别达到97.10%和91.83%。但GoogLeNet模型在网络宽度和深度增加的同时,浅层的梯度值变小,随之带来新的问题——梯度消失。而且由于网络复杂度的增加导致参数数量的增加,优化参数的难度随之增加,简单地增加层数和宽度只能产生更大的训练误差而非提升精度。

图1 Inception结构

(5) ResNet模型设计了残差模块,增加一个恒等映射(Identity mapping),并用网络主线路之外的一条分支连接[17]。残差模块结构如图2所示。在遥感图像应用中,Zhang等[18]提出一种端到端远程图像分类方法,侧重于恢复像素级和原始特征的详细信息。该方法的设计思路是将U-Net和ResNet结构相结合,重点提高特征质量而不增加标签。Scott等[19]基于ResNet模型,利用迁移学习和数据增强相结合的方法分类遥感图像。ResNet模型的优势在于增强了网络层之间的信息传递,优化了CNN模型不断加深而网络性能退化的问题,但新增的恒等映射结构在分支上的特征较少。

图2 残差模块结构

(6) DenseNet模型是根据随机深度的思想进一步提出的[20]。DenseNet模型是在ResNet模型基础上,通过捷径将所有层直接连接起来,使得每一层均能获得前面所有层的特征图,强化了特征在层间的关联性,且为了在特征融合上保证信息流通,采用拼接的方式。张静等[21]提出一种基于多尺度信息融合的遥感图像语义分割算法。基于DenseNet模型进行编码,利用短解码器进行不同层次特征融合,以分层监督网络模型监督网络训练。但DenseNet随网络层加深,会带来特征宽度不断加大的问题。

(7) SeNet模型提出一个新的结构模块“SE Block”[22]。SeNet模块结构如图3所示。该模型没有引入新的空间维度,利用全局信息有选择的增强,以达到特征通道自适应学习。Yang等[23]通过美国航空图像探测建筑物,对CNN网络进行评估。相比全卷积神经网络和递归神经网络,支持语义像素级标记的SegNet对NAIP图像处理效果最佳,在精确度和速度上都有着不错的成绩。

图3 SeNet模块结构

(8) MobileNet模型是一个可以在移动端使用的网络模型[24]。它采用深度可分离卷积[25]替代传统卷积,以达到减少参数数量和提升运算速度的目的。孙皓泽等[26]以MobileNet模型为基础,提出一种检测装甲目标的方法。该方法与经典SSD目标检测方法精度相当,且模型大小降低,运行速度加快。MobileNet模型参考ResNet模型的残差结构,提出倒置残差结构,升级为MobileNet V2模型。乔梦雨等[27]提出一种基于MobileNetV2模型的轻量级CNN算法,对遥感陆战目标进行识别。设计思路是采用ELU函数和全局池化缓解梯度消失和控制参数的数量,提高了模型的泛化能力。

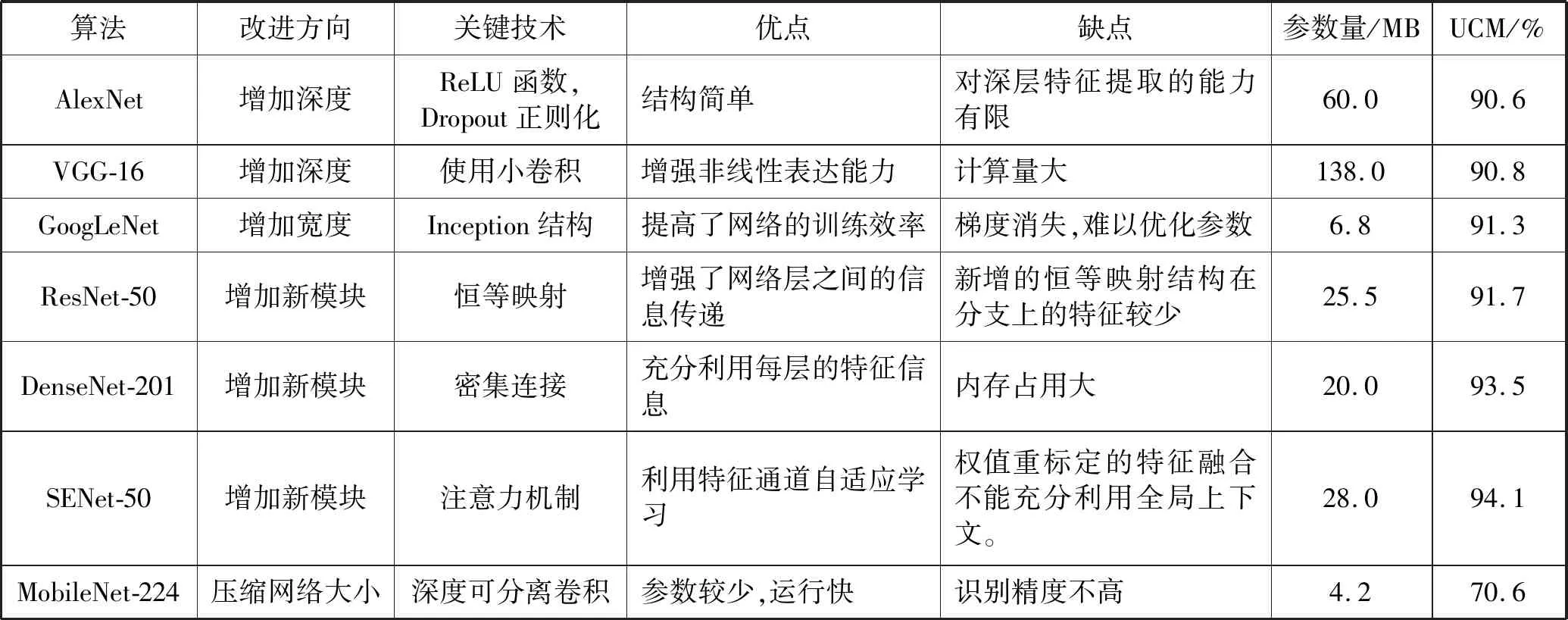

表1给出了基于UCM遥感数据集的CNN模型性能对比。可以看出一味增加深度和宽度并不能使得网络性能有效提升;新模块的添加促进了特征间的关联性,使得精度提高,但随之带来运行速度下降的问题;轻量级的小网络的训练精度虽然不高,但计算空间和成本大大降低,使得CNN模型朝便携的移动端发展,是一个很有潜力的发展方向。

表1 基于UCM数据集的CNN模型性能对比

2 基于光学遥感影像的场景分类研究

图像场景分类是通过对给定图像中的信息进行整体图像的类型判断。遥感场景分类是指对遥感影像类型进行划分,并贴上标签,应用在功能区分别、城市规划、土地资源管理等多个领域。遥感场景图像分类综合了计算机视觉、模式识别和遥感技术等多类学科知识,是大数据遥感领域的一个重要研究方向。

2.1 数据集

算法的研究需要大量的数据进行训练和检测,目前常用于遥感场景分类研究的公开数据集有以下几种:

(1) UC Merced数据集:由Yang和Newsam从美国地质调查局的美国地区土地利用遥感影像中采集的不同区域影像。图像分辨率为0.3 m,像素大小为256×256。包含海滩、港口、立交桥等共21类土地利用场景图像,每一类有100幅,共2 100幅。

(2) WHU-RS数据集:由武汉大学实验室从Google Earth影像中采集的不同分辨率的遥感影像,图像像素大小为600×600,总包含19类场景图像,每一类大概50幅,共1 005幅。

(3) AID数据集:于2017年由武汉大学和华中科技大学发布,是一个遥感影像数据集,图像像素大小为600×600,总包含30类场景图像,每一类大概220~420幅,共10 000幅。

(4) RSSCN7数据集:遥感影像像素大小为400×400,有4类自然场景和3类人类生活场景,包含7类场景图像,每一类有400幅,共2 800幅。

2.2 遥感场景分类发展

早期的场景分类思路是考虑像素间的权重关系,再由人工干预进行语义分割,从而确定类型。随着计算机视觉领域上对特征提取算法的优化和语义分割算法的优化,场景分类由基于特征和基于语义两个方面发展。

基于特征的场景分类是通过纹理、尺寸等能够对图像描述的简单特征实现分类。在一般场景分类任务中有效,但在大数据项目中表现能力差,无法进行深层特征分析,不适用于背景复杂的遥感场景分类。基于语义的场景分类侧重点在于研究图像语义层面的表达,将图像中的目标转化为语义进行场景分类。相比基于特征的方法,基于语义的场景分类可以建立多层次的分类器,分类效果更好。但同样无法利用深层特征,无法进行深层语义理解,且计算量大,这约束了分类精度无法进一步提高。

卷积神经网络的兴起推动了遥感场景分类的发展。一方面,CNN可以自动学习深层特征,实现了大数据训练,提高分类精度;另一方面,CNN模型的设计有效减少大量参数,运算能力提高,能够更高效完成分类任务。无论在特征提取和语义分割上,均可以使用CNN进行训练,同样推动了上述提到的两种场景分类技术。

近年来,许多研究人员使用CNN进行遥感影像的场景分类,随着经典CNN模型的不断提出,基于CNN的遥感影像场景分类研究广泛应用在各个项目中。

Hu等[28]提出一种基于预处理的CNN的多尺度特征提取方法。他们将提取局部特征与特征编码技术相结合,通过特征编码将最后一个卷积层的多通道特征转化为全局图像特征进行场景分类任务。

Zhang等[29]提出一种基于对象深度学习特征的生态环境要素分类方法。从各个区域抽取子图像来代表相应区域,利用训练好的DCNN模型提取子图像特征,softmax分类器预测子图像类概率从而确定区域类别。在崇明岛遥感图像分类的准确率达到98.44%,对异形区域的分类精度也达到了96.77%。

周明非等[30]先CNN模型在ILSVRC-2012数据集上进行预训练,并对其微调后对UCM数据集遥感影像分类,分类效果达到94.44%。

周强等[31]采用随机多选择残差网络集成的遥感图像分类算法。算法将多个残差网络融合,通过最小化子网络对样本的最有分类误差,使得子网络自适应于不同的分类任务,有效提升了分类性能。

龚希等[32]提出一种融合全局和局部深度特征的视觉词袋模型。设计思路是融合CNN模型不同层次的特征,使用支持向量机对其分类,充分利用局部信息和全局信息来描述遥感图像的场景。

蔡之灵等[33]一种改进的Inception-V3提出遥感场景分类模型——Inception-L1。该模型在全连接层前加入Dropout层避免过拟合,并基于迁移学习进一步提高训练效率,在AID数据集和NWPU-RESISC45数据集上分类精度达到94.44%和93.95%。

余东行等[34]提出一种联合CNN与集成学习的遥感影像场景分类算法。利用多个网络模型提取高度抽象语义特征,再通过集成学习构建概率特征,对其进行训练和预测。

汪鹏等[35]将跳跃连接和协方差池化嵌入残差网络中,对遥感图像进行场景分类。新模型通过连接不同特征映射,将不同层的特征信息进行融合,保留中间层的互补特征信息。

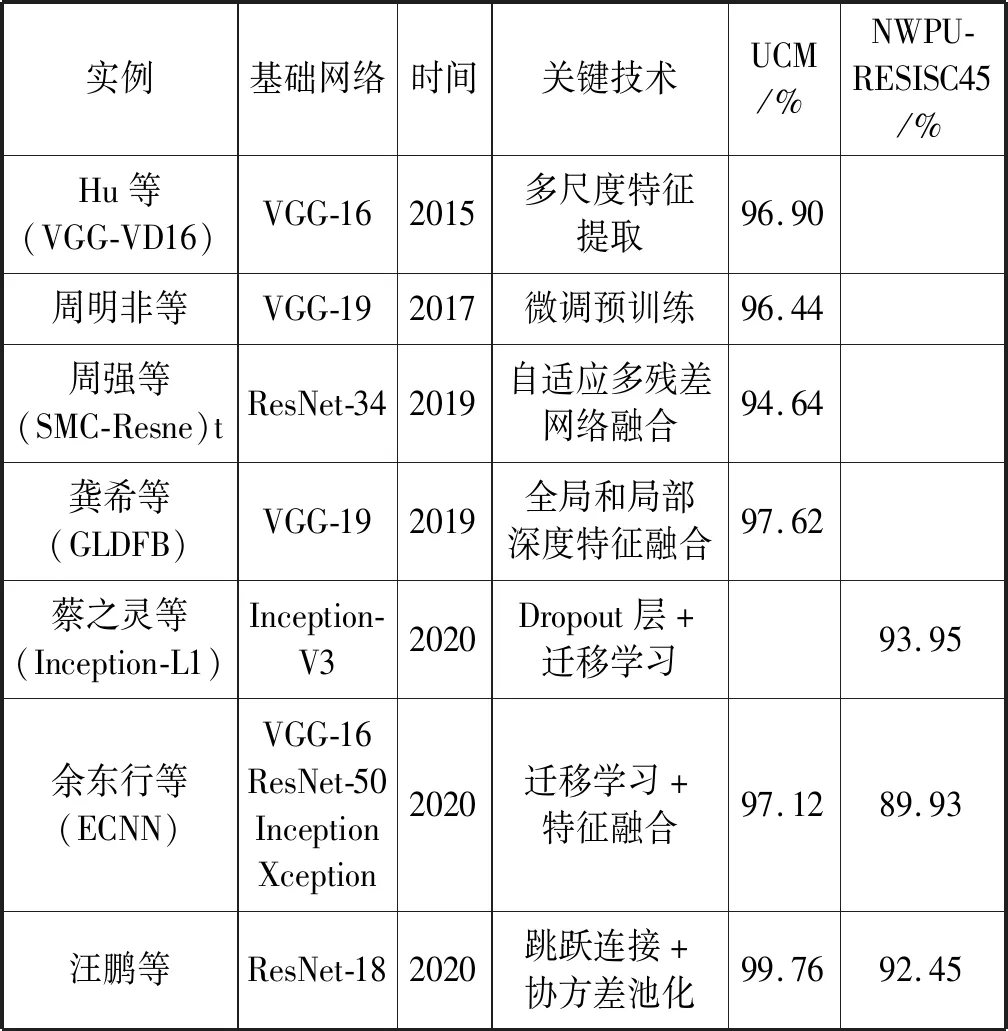

2.3 场景分类算法对比

通过评价指标——准确率(Precision),基于UCM数据集和NWPU-RESISC45数据集对上述介绍的场景分类研究成果进行算法对比。算法对比结果见表2。根据表2可以看出,基于卷积神经网络的遥感场景分类算法改进方向主要在特征提取上,主要有提取单层特征和融合特征。利用单层特征可以有效压缩大信息量的特征图,提高训练速度,但同时会带来局部信息丢失和语义信息不连续的问题。特征融合可以获得有效的全局信息,提高训练精度。但融合方式的不同会产生不同的效果,由于计算机通过图像得到的语义信息和用户对图像感知的语义信息不一致,容易产生感知鸿沟和语义鸿沟问题。

表2 基于UCM数据集和NWPU-RESISC45数据集的遥感场景分类算法对比

3 基于光学遥感影像的目标检测研究

目标检测是对兴趣对象进行位置定位和识别类型。遥感影像中包含大量的地物信息,针对不同目标的检测,在航通交通和军事侦察等领域有着重要的应用价值。

3.1 数据集

目标检测的数据集需要对目标做标注,目前常用于遥感目标检测研究的公开数据集有以下几种:

(1) DOTA数据集:由武汉大学和华中科技大学2018年联合制作。总共2 806幅遥感图像,包括188 282个目标,分为15个对象类,图像像素约800×800到4 000×4 000范围内。

(2) NWPU VHR-10数据集:由西北工业大学2014年发布。总共800幅图像,10种对象类,其中包括650幅目标图像和150幅背景图像,图像分辨率为0.5~2 m。

(3) RSOD数据集:由武汉大学于2017年发布,其包含飞机、操场、立交桥和油桶四类目标,总共2 397幅遥感图像。

(4) DIOR数据集:是一个大规模的光学遥感影像数据集,总共23 463幅遥感图像和192 472个目标,分为桥梁、港口、车辆等20个对象类。

3.2 遥感影像目标检测的发展

传统的遥感影像目标检测算法有尺度不变特征变换(SIFT)、定向梯度直方图(HOG)和显著性等,需要人工设计特征,依赖先验知识,因此模型的自适应能力和泛化能力较差。卷积神经网络在遥感影像目标检测中实现对特征的自动提取,挖掘深层特征,有效弥补了人工设计特征的不足,提高检测效率和精度。基于CNN模型的遥感影像目标检测方法可分类三类。

(1) 基于全卷积神经网络(FCN)的检测算法。FCN将CNN中的全连接层替换成卷积层,以便适应任意尺寸的输入;在网络中使用反卷积增大图像尺寸以提高检测精度;通过跳跃方法将多层信息融合,增加模型的精度和鲁棒性。

Maggiori等[36]设计的CNN模型由卷积层和反卷积层[37]共四个卷积层构成。他们利用反卷积层获得初始分辨率尺寸一致的标记图像,提升分类精度且缩短运行时间。

Huang等[38]提出了一种基于多源信息融合的端到端深度反卷积网络(DeconvNet)的建筑物提取方法。首先对图像进行预处理,得到高质量的建筑数据集,然后预训练一个深度反卷积网络,并对RGB和NRG组合波段组合调整后,融合输出。在建筑数据集分类中,准确率达87.58%,为遥感图像分类提供了一些新的思路。

Liu等[39]提出多任务CNN结构,实现同时预测路面、边缘和中心线。利用三个全卷积网络组成一个道路网系统,学习训练多尺度和多层级的特征。

李文斌等[40]提出DC-DNN模型对遥感影像进行目标检测。区域提取将FCN模型和DBSCAN算法融合,基于VGG-16模型提取特征,利用检测抑制算法,在数据集上实验获得95.78%的精度。

(2) 基于回归问题的检测算法。常用算法有SSD系列、YOLO系列、RetinaNet等[41-43]。这类算法将检测问题看作回归问题,直接对输入的遥感影像上不同位置、尺寸和边框进行采样和处理,从而检测出目标的边框位置和物理类别。

Etten等[44]提出一种基于YOLOv2的船舶检测算法Yolt,对输出特征尺寸进行修改,结果表明在稀疏的小目标场景下检测效果良好。

戴伟聪等[45]基于YOLOv3提出一种实时的遥感影像飞机检测算法。算法在YOLOv3基础上采用密集连接模块来融合多尺度特征且添加尺度检测和最大池化,促进模块间的特征传递,检测效果达到96.26%。

姚群力等[46]基于SSD模型提出一种遥感影像的飞机目标检测框架MultDet。算法采用端到端的多尺度特征融合,利用反卷积和跳跃连接得到多层次的融合特征。在UCAS-AOD数据集上取得94.8%的精度。

(3) 基于候选区域的检测算法。常用算法有R-CNN、Faster R-CNN、FPN、Mask RCNN等[47-50]。算法思想是将目标检测分为分类和回归两个步骤,在分类之前需要生成候选区域框并修正边框位置。

Han等[51]基于Faster R-CNN提出一种遥感影像目标检测算法。该算法在区域生成部分选用RPN全卷积网络,Fast R-CNN用于检测和定位,再通过交替优化实现特征融合,在NWPU VHR-10数据集获得了76.50%的检测准确度。

赵江洪等[52]对Faster R-CNN模型进行改进,实现对遥感影像舰船的目标检测。该算法通过数据增强和将VGG模型换成ResNet模型,提高目标检测的训练速度和精确度,且有效处理背景复杂等问题。

Yang等[53]基于FPN模型,提出一种旋转密集特征的金字塔网络(R-DFPN)。R-DFPN通过多尺度旋转的区域检测算法和DenseNet的密集连接思想,有效检测在不同场景下的船舶目标,特别是在密集船舶的检测中表现优秀。

Nie等[54]提出一种基于Mask RCNN的驻港船舶检测方法。算法将柔性非极大值抑制机制融入进来,由此提高鲁棒性。

3.3 目标检测算法对比

对上述介绍的遥感影像目标检测研究成果进行算法对比,结果见表3。可以看出,基于回归问题的检测算法在检测准确率上高于另外两类算法,随着算法的改进,这类算法在检测小目标和多目标上的效果不断提高,能够实现多尺度和高精度检测,但检测精度的提升会带来检测速度下降的问题。FCN网络的优势在于适应不用尺寸的图像和运行速度快,但由于没有考虑全局的上下文信息,获得的结果不够精细,限制了精度的提升。基于候选区域的检测算法的计算较为简单,但由此出现类不均衡问题,所以检测精度相对较低。这类目标检测算法在不断改进的过程中,检测流程越来越简单,检测精度不断提升,向着满足更多样化需求的方向发展,但算法模型规模大和检测速度慢的问题始终没有根本性的解决,导致精度无法进一步提升,且不能满足实时检测任务的要求。

表3 不同的遥感目标检测算法对比

4 基于光学遥感影像的图像检索研究

图像检索分为基于文本的图像检索技术(TBIR)和基于内容的图像检索技术(CBIR)。其中遥感影像检索属于基于内容的图像检索中的一种,在气象预报、环境检测和军事监测等方面具有广泛的应用前景。基于内容的图像检索是检索数据库中内容相近的图像,关键技术在于相关特征提取和特征相似性比较,图像特征的描述能力决定了图像检索的性能。遥感影像检索除了普通图像检索需注意的特征提取外,还需要考虑地理位置、不同传感器参数和比例等信息与影像的关系。因此,遥感影像检索在特征选取和相似性计算上有着其自身的特点。

4.1 数据集

由于遥感影像检索和遥感场景分类及目标检测一样,有特征提取的过程,再利用提取的特征进行相似度比较,因此,遥感影像检索研究常用到的数据集与遥感场景分类及目标检测的数据集相同。

4.2 遥感影像检索的发展

传统的图像检索方法通过对低层次特征,如颜色、纹理等进行编码,可以有效检索小规模数据集,但识别性能非常有限,且需要人工设计特征,无法实现大数据的遥感影像检索。CNN的优势在于可以提取图像的深度特征,这为图像检索提供了更多的技术支撑。Napoletano等[55]在检索遥感图像上,对低级手工方法和CNN方法进行评估。结论是无论什么检索方案,CNN提取的特征表现与全局或局部的手工特征表现优异。目前,基于CNN的遥感影像检索算法有以下几个方向:

(1) 对CNN模型提取的特征进一步处理。张洪群等[56]基于CNN训练图像特征图实现遥感图像检索,使用稀疏自动编码对遥感图像进行特征学习得到特征字典。彭晏飞等[57]基于GoogLeNet模型提出一种基于CNN和相关反馈支持向量机的遥感图像检索方法。该算法利用CNN提取特征,支持向量机作为分类器,最后融合相关反馈策略对其进行调整。

(2) 对CNN模型进行微调。葛芸等[58]预训练4种不同CNN模型用于遥感图像检索。算法对高层次特征进行高斯归一化,利用欧氏距离计算图像相似度进行图像检索。

(3) 多尺度特征融合。Ge等[59]通过将不同池化层的特征聚合,并进行特征压缩。该算法对UCM数据集进行图像检索,虽然平均精度仅有65.98%,但为之后基于CNN的遥感影像检索提供了新的思路。

(4) 卷积层与全连接层进行特征融合。杨珂等[60]提出一种跨层特征融合的遥感影像检索算法。该算法将卷积层和全连接层的特征融合,充分利用局部信息和全局信息,提高遥感影像的检索性能。

(5) 重排序。叶发茂等[61]利用CNN模型与重排列相结合的方法进行检索图像,以提高农业遥感图像的检索性能。算法从CNN训练中获得类别去权重和类别查准率并结合计算,对结果进行排序再对初始检索输出进行重排。

4.3 影像检索算法对比

遥感影像检索的评价指标有平均精确率的平均值(mean Average Precision,mAP)和平均归一化调整的检索之秩(Average Normalized Modified Retrieval Rate,ANMRR)。根据评价指标,基于UCM数据集对上述阐述的遥感影像检索的研究成果进行算法对比。根据表4可以看出,同样以GoogLeNet作为基础网络的条件下,融合反馈策略优于特征聚合和压缩;仅仅对CNN的微调无法让影像检索精度有明显的精度提升;ResNet-50加上重排序的算法获得最高的mAP值和最低的ANMRR,检索精度最高。重排序利用信息间的流形关系,对度量结果进行重新排序,从而得到更好的检索结果。但重排序作为监督信号,在检索过程中,它的质量会影响到重排序之后的效果,因此重排序对图像噪声处理提出了更高的要求。

表4 基于UCM数据集的遥感影像检索算法对比

5 结 语

本文介绍了光学遥感影像的特点,对基于经典卷积神经网络模型的光学遥感影像识别的研究实例进行了算法分析,从遥感影像的场景分类、目标检测和图像检索三大任务出发,对常见的遥感影像数据集和研究进展进行了详细综述,未来的研究趋势如下:

(1) 多源异构数据融合。在信息化的快速发展下,数据呈现多类型海量增长趋势,可将传感器、智能终端、社交网络等收集到的多类型数据利用起来。在遥感图像应用中,对同一目标的不同数据集进行图像特征信息提取并融合,可以有效避免数据描述的客观性,使得实验结果更加可靠。

(2) 实时识别。实时数据更新是一个很热的课题,如自动驾驶对环境目标进行实时检测。由于遥感图像识别时的网络计算量大,许多基于遥感数据的识别研究效率不高,无法达到实时识别的要求。而一味追求网络精度导致空间和速度问题的出现已不适用于高效的社会。在遥感图像领域,便捷性和高效性的需求会不断提高,但目前将轻量级网络运用在遥感图像领域的研究比较少。只有在保证精度的同时,有效减少网络计算空间和成本,使得深度网络朝便携的移动端发展,才能更好将其用于实际应用中,进而实现遥感图像的实时识别。

(3) 弱监督化。监督学习是图像识别领域目前应用最广泛的深度学习方法,但数据集的标签需要人为添加。特别是遥感图像中,有标注的数据非常有限,如果进行人工标注会浪费大量人力物力。近年刚兴起的非监督学习和半监督学习可以解决监督学习的不足,其中包括[20]生成式对抗网络和胶囊网络[62-64]等,但它们在遥感影像识别领域的精确度与监督学习相比还有些差距,有待发展。

(4) 物理建模与神经网络相结合。遥感图像的成像方式和显示方式都基于光反射和微波散射等物理原理,许多遥感图像应用是基于物理机理建模进行研究,如果能结合神经网络进行数据分析,必将有助于推动遥感图像应用的发展。