基于样本加权条件对抗域适应网络的遥感影像作物分类

丁 伟 黄 河 孙友强

1(中国科学院合肥物质科学研究院智能机械研究所 安徽 合肥 230031)

2(中国科学技术大学 安徽 合肥 230026)

3(安徽省智慧农业工程实验室 安徽 合肥 230031)

0 引 言

随着遥感技术的不断发展,使用遥感图像进行大规模农业信息获取、分析已经成为一种重要手段。使用遥感图像对作物进行分类得到地块信息,对于辅助农业政策决策、作物产量估计等方面有着重要的意义。相比于传统的遥感影像特征提取、分类方法,深度学习技术的进步,使其在遥感影像分类、分割任务上都有着效果显著的应用。文献[3]基于卷积神经网络,使用GF-2卫星影像对龙虎庄道路、建筑物等6种典型地物进行面向对象分类。文献[4]使用语义分割网络同时融入循环神经网络来捕捉遥感图像时序信息,完成像素级别的大棚提取。文献[5]使用基于模型的迁移学习来解决多类遥感影像场景分类中样本标签少的问题。

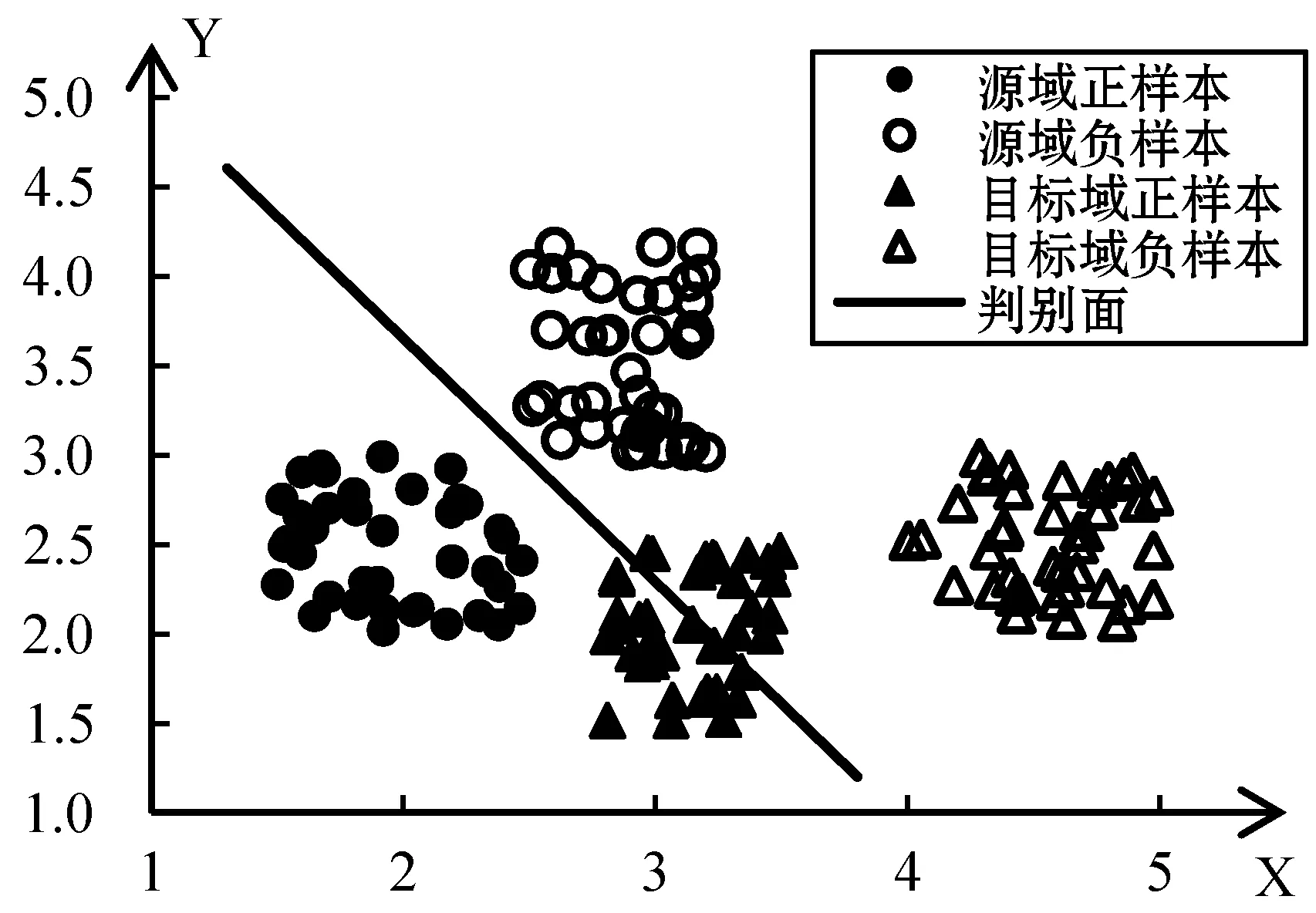

然而遥感图像分类一个重要的问题是跨域数据预测。造成这个问题的原因主要有两个:首先是对于空间分辨率低的遥感图像,我们无法直接通过目译确定现有的地块作物到底输入哪一类,也就导致了无法直接使用监督学习模型;其次,遥感影像会由于天气变化、获取的时间不一致、图像矫正的参数不同等原因,导致图像分布不同。在建模过程中我们一般会假设训练集和测试集分布基本一致。然而,当训练集和测试集分布不一致时,基于最小化训练集经验风险得到的模型在测试集上不一定会有好的表现。如图1所示,基于源域数据训练出的模型,无法正确预测目标域数据。

图1 跨域数据预测问题

领域自适应(Domain Adaptation)是迁移学习一个重要分支。通常会把数据分为两部分:源域Ds和目标域Dt,目的是利用从源域数据Ds和学习任务Ts学习到的知识来提高目标域数据Dt在目标任务Tt上的表现。源域和目标域的特征、类别空间相同,但是特征分布不同,即Ps(x)≠Pt(x)。此外,会假设源域有更多的样本,并且所有数据都是有标签的,而目标域的数据只有样本,没有类别信息或者只有少量标签。

文献[6]的方法在自然场景、人脸数据集等领域自适应任务中取得不错的效果,然而在遥感领域研究相对较少。本文针对遥感影像跨时间域作物分类问题,使用改进特征提取模块的CDAN模型对不同年份地块作物的深度特征进行对齐,从而完成无标签目标域作物的分类;在上述迁移模型基础之上,改进样本迁移性度量方式,通过引入可学习的样本加权网络来学习样本的可迁移性,使模型在单月、多月影像迁移效果上都有更好的表现。

1 基于可学习样本权重的CDAN模型

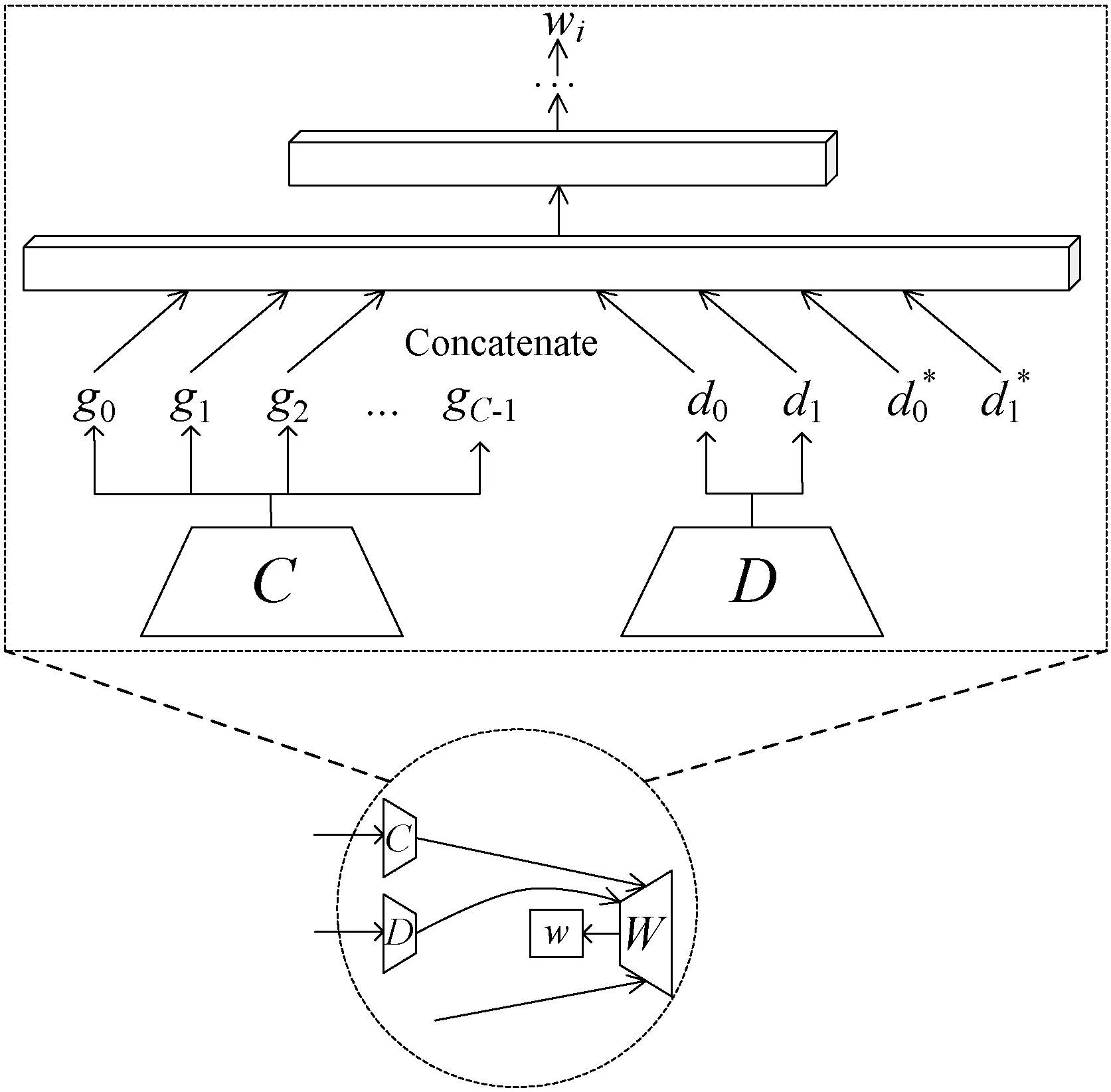

模型结构如图2实线部分所示。其中梯形表示CDAN三个重要的子网络:特征提取网络F、类别分类网络C和领域判别网络D;矩形表示模型运算的中间向量和已有的数据标签。特征提取网络F使用经典的卷积网络,如AlextNet、ResNet[10],输出是从源域样本xs和目标域样本xt提取出的一维向量fs、ft;分类网络C是全连接网络,通过Softmax函数计算出模型预测的源域和目标域样本的类别概率分布gs、gt;判别网络D是全连接网络,输出是模型预测的样本来源的概率分布d,即样本来自源域还是目标域的概率分布。

图2 CDAN-SWN网络结构图

Ex~pt(x)[1-logD(F(x))]

(1)

模型损失包括判别损失LD和分类交叉熵损失LC,优化目标如式(1)所示。即更新D参数使得域判别损失LD最小;更新C参数使得分类损失LC最小;更新F网络参数使得LC最小、LD最大;F网络和D网络形成对抗关系。

(2)

当模型收敛后fs和ft的分布相似,由于网络C通过最小化LC已经能正确分类源域数据特征fs,当再输入目标域数据特征ft=F(xt)给C时,也能输出正确分类结果。

1.1 面向地块对象的特征提取网络

CDAN网络使用AlextNet[11]或Resnet-50作为特征提取模块,然而这些网络结构由于过多的非填充(No Padding)卷积或者下采样操作的存在会使输出的特征尺寸逐层变小。以Resnet-50为例,直到全连接层之前,特征图的尺寸缩小到了输入图像的1/32。在面向对象的方法中,尤其是当遥感影像的空间分辨率低时,每个对象的尺寸很小,使用过深的卷积网络或者过多下采样操作,会提取不出或者丢失有效的信息。因此须对小对象设计高效的特征提取结构。

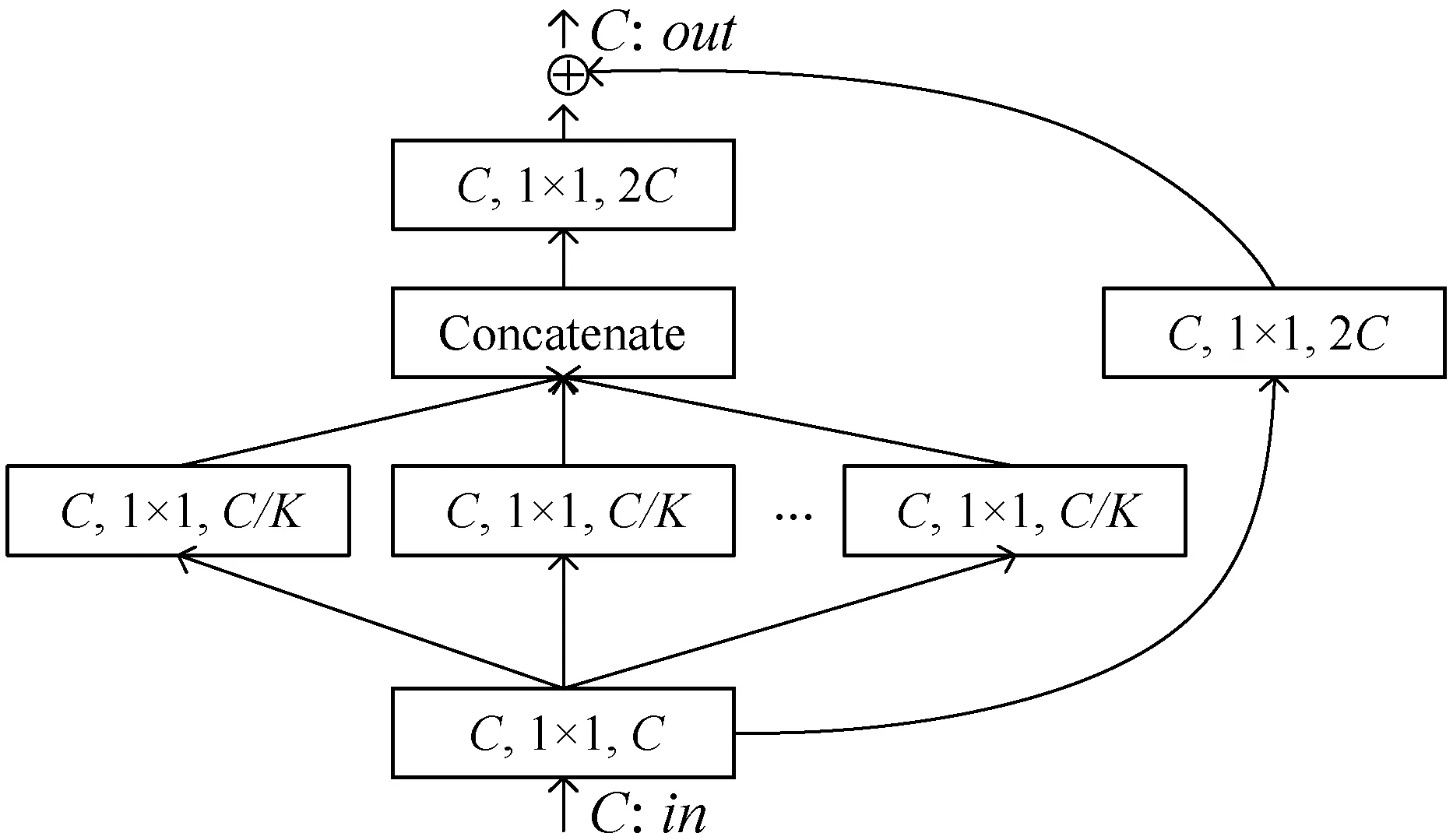

现有的深度学习主干网络大多由若干个瓶颈结构(Bottleneck)串联而成,如Inception网络[12]、ResNet网络等。为了避免过多的串联卷积结构带来的特征尺寸减小问题,本文以ResNeXt提出的瓶颈结构为基础,构建出特征提取网络,瓶颈如图3所示。可以看出,通过引入并联卷积结构对同一层输入提取K组特征,再将这K组特征进行合并输入到下一层,仅使用少量Bottleneck的串联结构,就能够提取出更丰富的特征。此外对比图4同样采用并联结构的Inception网络,文中使用的结构每个分支都使用相同大小的卷积核不需要精心的设计,并且在硬件并行计算上也更加高效。

图3 ResNeXt网络瓶颈结构

图4 Inception网络瓶颈结构

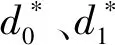

1.2 基于可学习样本权重的CDAN

由于错误标注、存在异常样本等原因,源域和目标域存在一些迁移困难的样本,在对齐特征时过多关注这些样本会产生负迁移现象。

原CDAN模型为每个样本i计算其“可迁移性”wi,并且使用分类概率分布的熵来衡量样本的可迁移性。熵越小,可迁移性越高,在计算域判别器损失LD时权重wi越大如式(3)所示。

(3)

权重计算如式(4)所示。其中gi是第i个样本经过分类网络C输出的概率分布。

(4)

文献[13]中的作者认为样本的可迁移性并不体现在分类网络输出的概率分布gi上,而是应该体现在判别网络输出的概率分布di上。具体的,判别器输出的概率分布熵越大,样本可迁移性越小。然而,上述两种方案都没有很好解决样本可迁移性的度量问题。

图5 嵌入的样本加权网络W

2 实验与分析

2.1 数据源

本文研究区域仪征市位于江苏省中西部,总面积为857平方千米,雨量充沛,光照充足,多种植水稻、棉花、小麦等农作物。

实验中使用的是哨兵二号遥感影像,包括2019年3月13日和5月12日两期图像;2020年3月7日、3月17日和4月26日三期图像。这5幅遥感图像覆盖整个仪征市,其中红、绿、蓝、近红外波段均提供10米空间分辨率。

在数据预处理方面,2019年两期图像,通过ENVI软件对L1C级多光谱数据进行大气校正、几何校正得到的融合图像,共4个波段。2020年三期影像是直接得到的L2A数据。由于预处理流程、参数等不同,2019年数据和2020年数据存在着较大的差异。

仪征全市的地块矢量边界是已有的数据。2019年,实地采样了3 328样本点,其中包括水稻区域1 393块、非水稻区域1 935块;2020年采集了803样本点,同样也标记成水稻、非水稻两类,测试数据占了总数据量的20%。整个实验过程中,2020年作物的标签只在测试的时候会使用,训练的时候不会使用。地块影像的分辨率固定为40×40大小。

2.2 不同特征提取模块效果对比

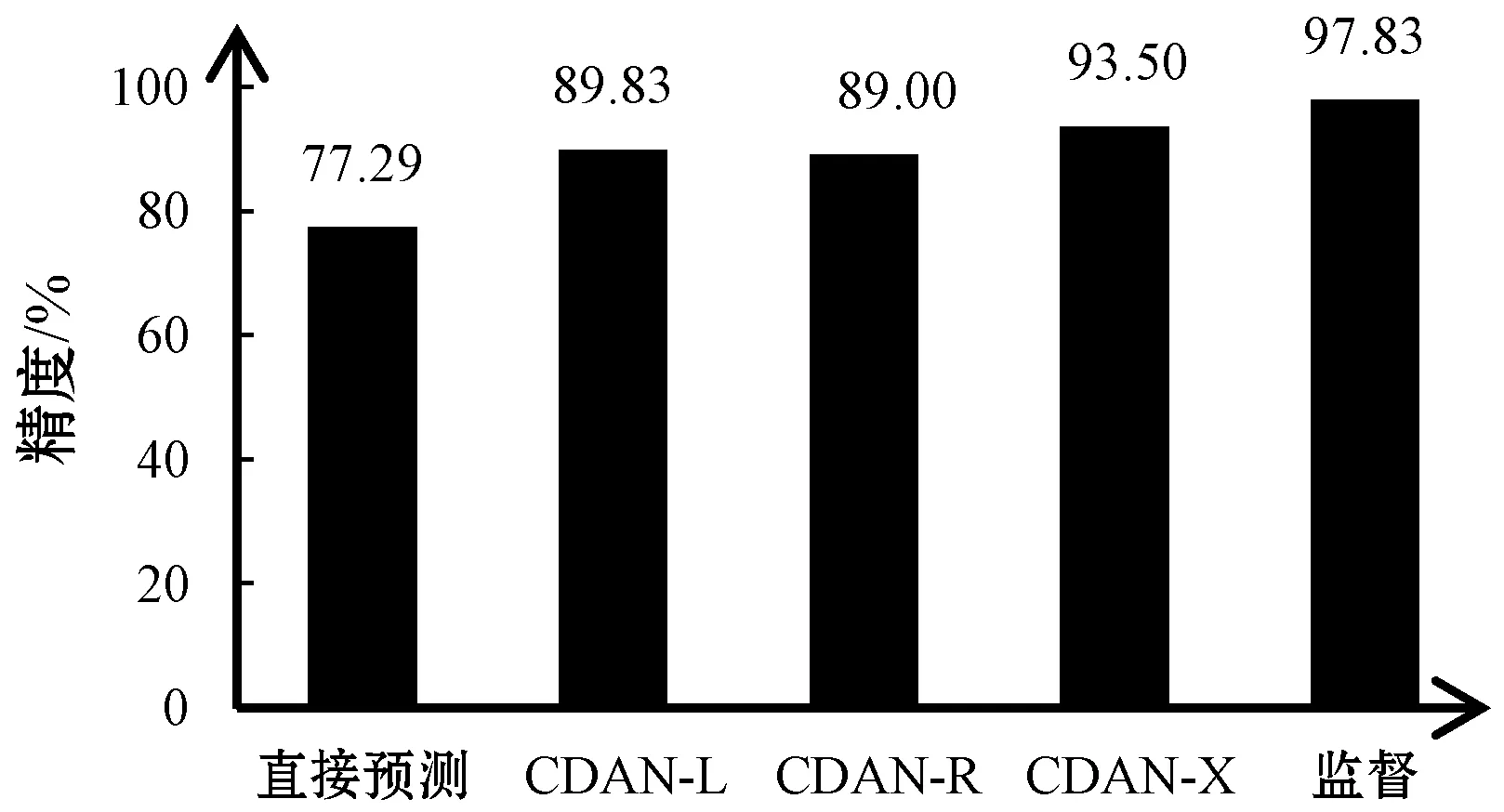

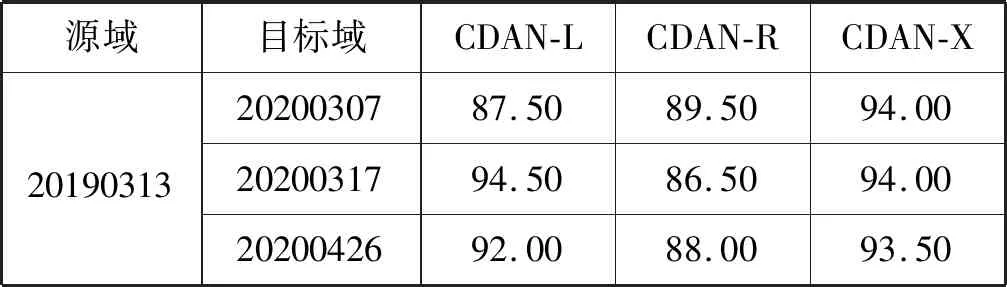

针对1.1节提出的改进,本节使用单期影像进行迁移实验,将使用ResNeXt瓶颈结构作为特征提取模块的CDAN模型(CDAN-X)与使用ResNet瓶颈结构的CDAN-R,以及针对小尺寸输入的LeNet[15]网络作为特征提取层的CDAN-L进行比较。

其中CDAN-X使用1.1节的2层瓶颈结构来提取特征。为了保持相近参数量,CDAN-R的特征提取网络同样使用ResNet50前两个瓶颈结构,如表1所示。CDAN-L使用C5作为提取出的特征,C5是LeNet网络的第五层的输出。

表1 CDAN-R特征提取网络结构

三种特征提取网络构成的CDAN模型精度对比如图6,同时也对比直接预测目标域数据、基于监督的效果。其中监督学习指的是,直接用目标域的训练集训练模型,预测目标域测试数据。首先可以看出如果不进行迁移,由于2019年源域数据和2020年目标域数据分布差异大,直接预测精度较低;其次,对比三种不同特征提取网络构成的CDAN模型,可以看出由1.1节提出的改进模型CDAN-X在平均精度上达到最高;最后,对比监督学习方法,可以看出精度上仍然有一定差距。

图6 不同特征提取网络效果对比

具体的不同月份的迁移精度如表2所示。

表2 不同特征提取网络的CDAN精度对比(%)

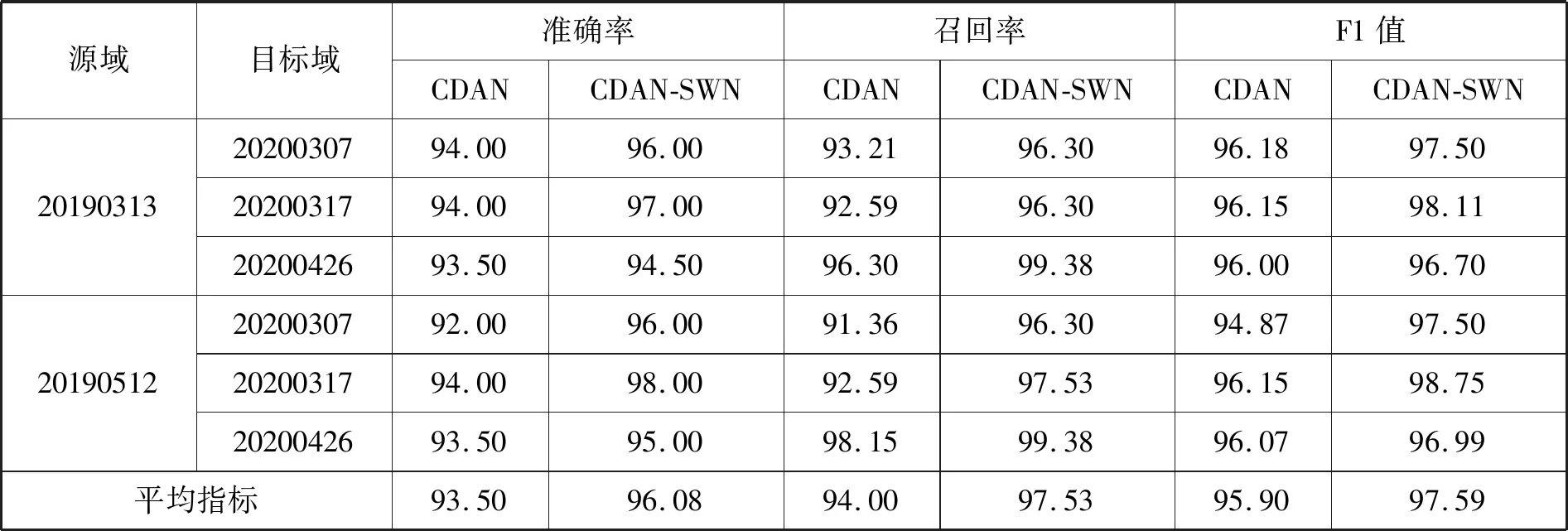

2.3 基于学习样本权重的迁移实验

在固定特征提取网络后,为了验证本文提出的样本权重加权网络的有效性,我们首先在单月影像上进行迁移,对比原始CDAN模型和嵌入样本加权网络的CDAN在准确率,召回率以及F1值三个方面的评价指标。由表3我们可以发现嵌入了样本加权网络的CDAN在三个指标上均高于原始模型,准确率方面高了2.58百分点,召回率高了3.53百分点,F1值高了1.69百分点。说明样本加权网络的CDAN在多种迁移数据场景下均有一定的性能提升。召回率和F1值的提高说明了,在样本不均衡的情况下,模型并没有只偏向于某一类,而是学到了有用的模式。

表3 CDAN与CDAN-SWN在多项指标上对比(%)

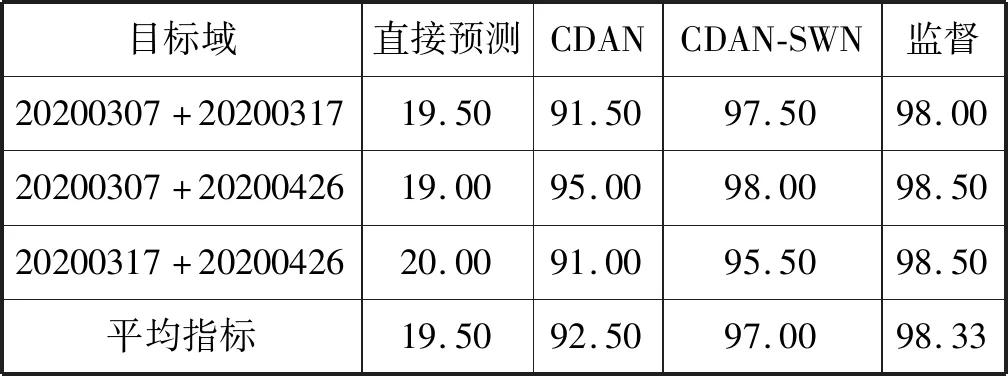

文献[16]表明,使用多期遥感影像作为输入能让模型在轮廓提取、耕地信息提取等任务上有较为明显的性能提升,因此我们还需要关注模型在多期影像输入的情况下能否完成迁移。实验中,我们使用2019年3月份和5月份的影像作为源域输入,目标域为2020年三期影像的两两组合,共形成三组数据。直接使用通道叠加的方式融合两个月份的影像。实验结果如表4所示。

表4 在多时相上CDAN-SWN迁移精度对比(%)

可以发现:第一,直接预测的结果非常差,这可以解释为随着多期影像的加入,输入特征增多,在更加高维的空间中,样本分布的稀疏性导致源域和目标域样本分布更加分散,距离更大;其次我们可以发现,特征的增多给特征对齐增加了难度,CDAN并没有因为输入特征的增多而提升模型的精度,反而由于特征对齐的难度增大有精度的降低;第三,对比CDAN模型,加入样本加权网络的CDAN-SWN能更好地处理多时像特征对齐问题;最后,表3中最后一列是直接使用目标域数据训练的监督模型精度,如第一行则是使用20200307和20200317带标签的训练集数据训练模型,来预测20200307和20200317测试集数据。可以发现,使用本文提出的迁移模型与监督模型在精度上仅有1.33百分点的差别。

为了能够更加直观观察到对齐后的特征,针对第一组数据,在训练好模型之后,从2019年和2020年测试集中各取130个样本,提取出深层特征后使用t-SNE算法[20]进行可视化后的结果如图7所示。可以看出2019年和2020年水稻地块特征(实心标记)聚成一簇,非水稻地块(空心标记)聚成另一簇。因此当模型的分类器能够正确区分2019年地块作物标签时,分类器也就能正确判别2020年地块作物类别。

图7 源域和目标域深度特征可视化

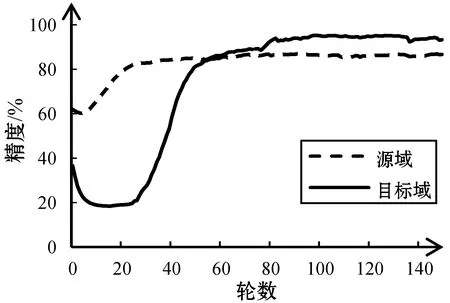

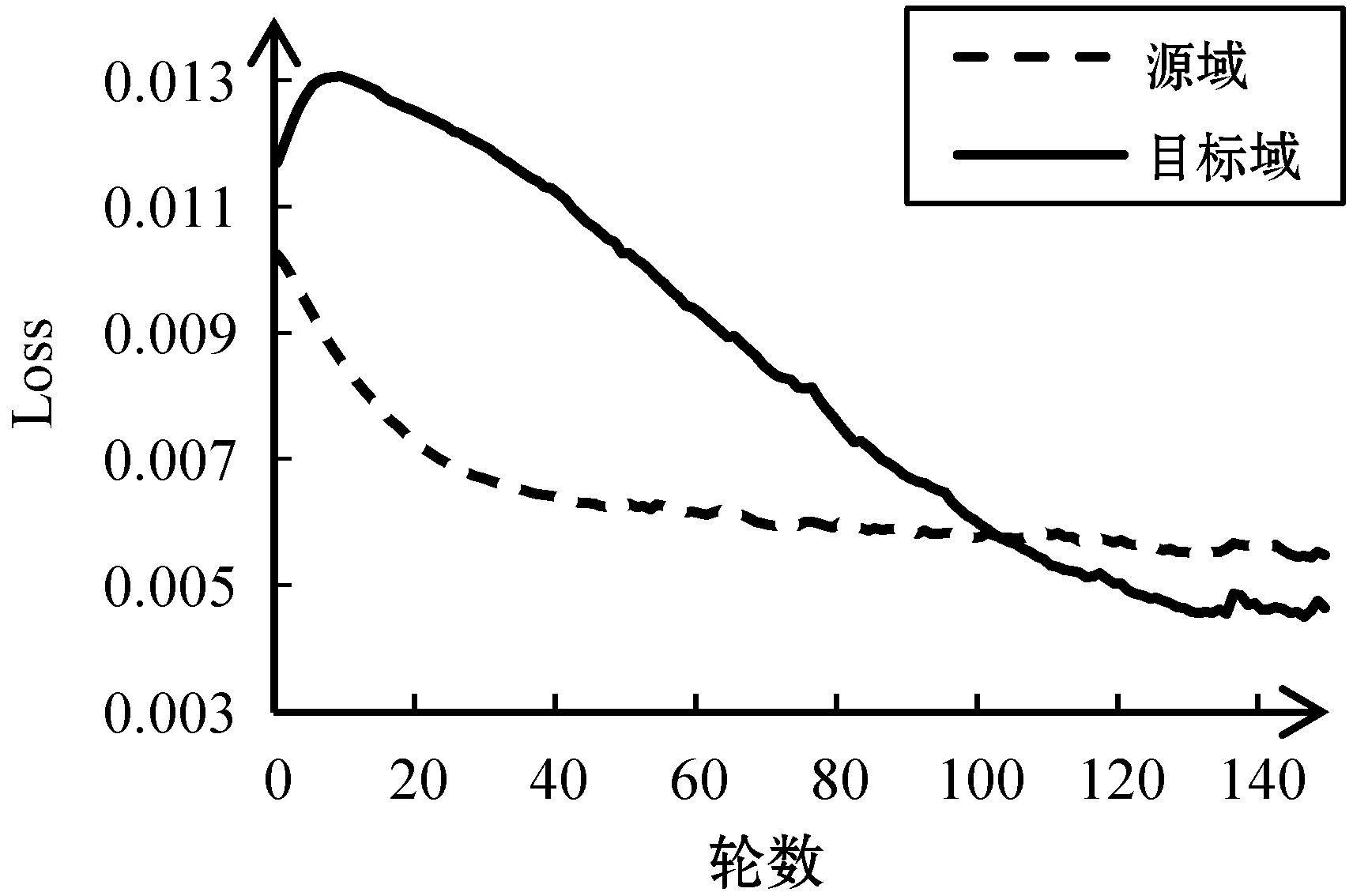

在模型收敛性方面,从图8、图9我们可以看出,目标域的预测精度是稳步上升的。前期,由于模型没有得到足够的训练,导致在目标域上的分类精度也一直处于较低水平,情况随着源域分类精度的提升慢慢缓解。后期,可以看出分类精度基本趋于平稳,而分类的损失依然会有小幅下降,说明分类器输出的概率分布仍然是慢慢接近样本类别真实值的,只是没有体现在更多样本被正确分类上。

图8 源域和目标域验证集精度

图9 源域和目标域验证集损失

3 结 语

本文针对遥感影像的迁移分类问题引入深度学习中的领域自适应方法。基于CDAN模型,本文在特征提取网络上作出改进,并且提出新的样本加权网络代替直接使用熵计算的方式,通过实验得出结论:(1) 跨时间域的预测问题会显著降低模型的性能。虽然在某些特殊场景下,直接进行跨域数据预测会有较好的效果,但这完全依赖于两个域的数据分布,是十分不可靠的。并且当使用多期影像输入,特征增多时,两个域的特征分布差别会更加明显,直接预测效果会更差。(2) 在面向对象的遥感影像分类问题上,本文构建的特征提取网络能有效支持CDAN模型完成特征对齐。(3) 可学习的样本加权网络相比于熵计算,能更好地度量样本可迁移性,在多项指标上均有一定的提升。尤其在多月数据融合的情况下,更能体现其优越性。

目前使用域自适应方法应对遥感影像变化的研究还较少,本文也仅仅在水稻分类任务上取得了较好的结果,下一步需要考虑能否将迁移模型应用在更加精细化的多类分类任务上,以及如何将领域自适应方法应用到遥感影像分割等其他任务上。